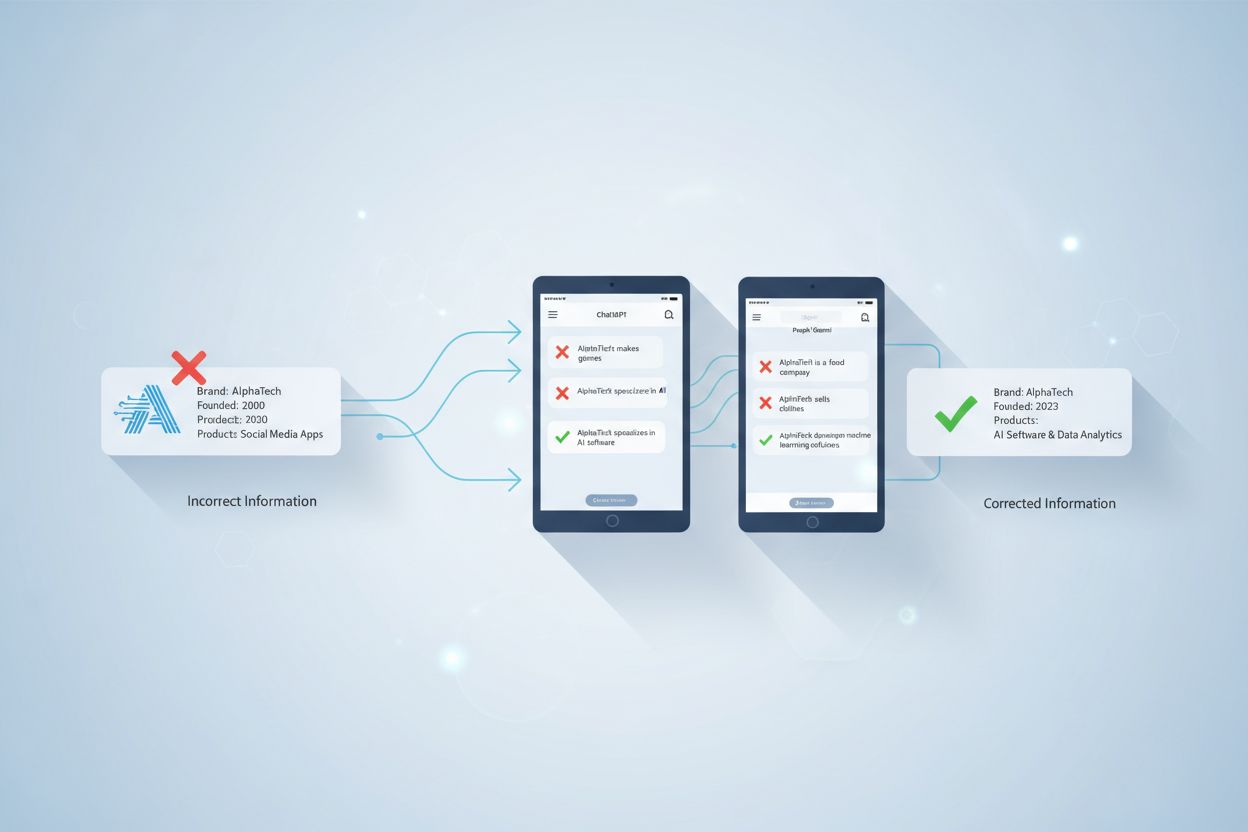

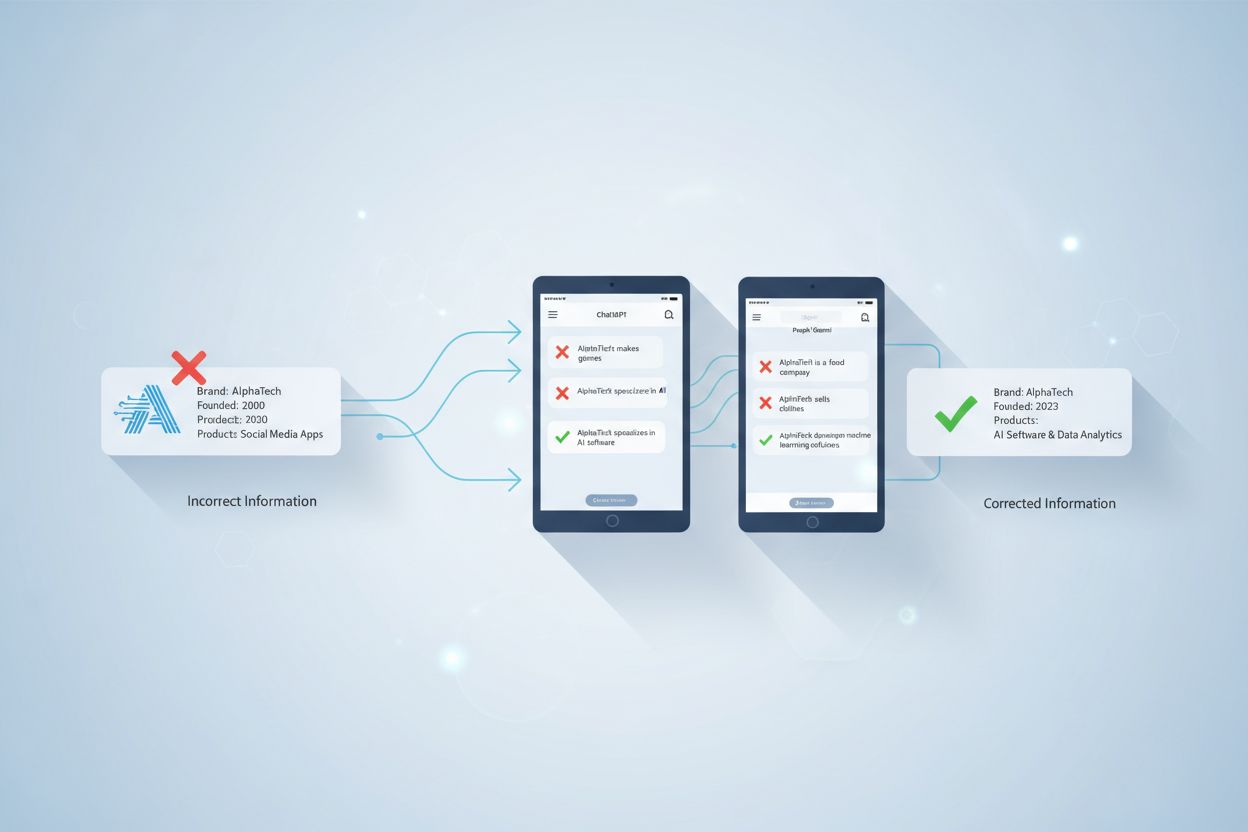

Korrigering av AI-feilinformasjon

Lær hvordan du identifiserer og korrigerer feilaktig merkevareinformasjon i AI-systemer som ChatGPT, Gemini og Perplexity. Oppdag overvåkingsverktøy, strategier...

Lær hvordan du bestrider unøyaktig AI-informasjon, rapporterer feil til ChatGPT og Perplexity, og implementerer strategier for å sikre at merkevaren din representeres riktig i AI-genererte svar.

Du kan bestride unøyaktig AI-informasjon ved å rapportere det direkte til AI-plattformen, optimalisere innholdet ditt for AI-systemer, bruke verktøy for merkevareovervåkning og implementere strukturert data for å sikre nøyaktig representasjon på tvers av ChatGPT, Perplexity og andre AI-søkemotorer.

Unøyaktig informasjon i AI-svar utgjør en betydelig utfordring for bedrifter og enkeltpersoner i dagens digitale landskap. Når AI-systemer som ChatGPT, Perplexity og Gemini genererer feilaktig informasjon om merkevaren din, produkter eller tjenester, kan det skade omdømmet ditt, villede potensielle kunder og føre til tapte forretningsmuligheter. Problemet er særlig alvorlig fordi disse AI-drevne søkemotorene grunnleggende endrer hvordan brukere oppdager og vurderer informasjon på nettet. Med 60 % av Google-søk som ender uten et klikk i 2024 og organiske klikkrater som faller med mer enn halvparten når AI-svar vises, har det blitt kritisk å sikre korrekt merkevarerepresentasjon i AI-svar for å opprettholde konkurransefortrinn.

AI-systemer genererer unøyaktig informasjon på flere måter. Disse systemene opererer på en dobbel arkitektur bestående av forhåndstrent kunnskap og sanntids søkeutvidelse, noe som betyr at feilinformasjon kan bli innebygd på to ulike måter. For det første kan utdatert eller feilaktig informasjon fra treningsdata vedvare i modellens svar. For det andre kan unøyaktig innhold fra nåværende nett-kilder bli hentet og sitert av AI-systemet. Det grunnleggende problemet er at AI-modeller er designet for å generere den mest sannsynlige ordsekvensen for å svare på et spørsmål, ikke for å verifisere om informasjonen faktisk er korrekt. Dette betyr at AI ikke kan skille mellom nøyaktig og unøyaktig informasjon—den produserer bare det den tror er det mest sannsynlige svaret basert på treningsdataene.

De fleste store AI-plattformer tilbyr mekanismer for brukere til å rapportere unøyaktige eller problematiske svar. Perplexity lar for eksempel brukere rapportere feilaktige eller unøyaktige svar ved å bruke flagg-ikonet under svaret. Brukere kan også opprette en supportsak via Perplexitys støttevindu eller sende en e-post til support@perplexity.ai med detaljer om unøyaktigheten. Denne rapporteringsmekanismen hjelper plattformen med å identifisere mønstre av feilinformasjon og forbedre svarenes kvalitet over tid. Når du rapporterer unøyaktig informasjon, er det viktig å være spesifikk om hva som er feil, gi bevis på korrekt informasjon, og forklare hvordan unøyaktigheten kan påvirke brukere eller virksomheten din.

ChatGPT og andre AI-plattformer tilbyr lignende tilbakemeldingsmekanismer, selv om den spesifikke prosessen varierer mellom plattformene. Brukere kan vanligvis merke svar som problematiske eller unøyaktige via innebygde tilbakemeldingsknapper. Det er imidlertid viktig å forstå at rapportering av unøyaktig informasjon til enkeltstående AI-plattformer er en reaktiv tilnærming—den adresserer spesifikke tilfeller, men forhindrer ikke fremtidige hendelser. Den virkelige utfordringen er at AI-systemer kontinuerlig genererer nye svar basert på treningsdata og sanntids søkeresultater, så en enkelt rapport kan ikke forhindre at den samme feilen dukker opp i fremtidige svar på lignende spørsmål.

Den mest effektive strategien på lang sikt for å bestride unøyaktig AI-informasjon er å optimalisere innholdet ditt spesielt for AI-systemers konsumering. Denne tilnærmingen, kjent som Generative Engine Optimization (GEO), skiller seg grunnleggende fra tradisjonell SEO. Mens tradisjonell SEO fokuserer på rangering i søkeresultatsider, sikrer GEO at merkevareinformasjonen din blir korrekt sitert og innebygd i AI-genererte svar. Dette innebærer å strukturere og formatere innholdet slik at det enkelt kan forstås, hentes ut og siteres av AI-plattformer.

Strukturert datamerking spiller en avgjørende rolle i denne prosessen. Ved å implementere riktig schema-merking på nettstedet ditt gir du AI-systemene klar, maskinlesbar informasjon om virksomheten, produktene og tjenestene dine. Dette gjør det betydelig enklere for AI-systemer å få tilgang til nøyaktig informasjon om merkevaren din i stedet for å stole på utdatert eller feilaktig data fra andre kilder. I tillegg bidrar klar og konsistent merkevarekommunikasjon på alle digitale kontaktpunkter til at AI-systemer forstår og representerer merkevaren din korrekt. Når nettstedet, sosiale medieprofiler og andre nettbaserte eiendeler presenterer konsistent informasjon, er det mer sannsynlig at AI-systemer siterer denne korrekte informasjonen i sine svar.

| Strategi | Implementering | Forventet resultat |

|---|---|---|

| Strukturert datamerking | Implementer schema.org-merking på nettsiden | AI-systemer får tilgang til nøyaktige, maskinlesbare data |

| Innholdsoptimalisering | Lag klart, faktabasert, godt dokumentert innhold | Forbedret siteringsnøyaktighet i AI-svar |

| Merkevarekonsistens | Oppretthold konsistent kommunikasjon på alle plattformer | Redusert forvirring og feiltolkning |

| Regelmessige oppdateringer | Hold innholdet oppdatert og relevant | AI-systemer prioriterer fersk, autoritativ informasjon |

| Autoritetsbygging | Bygg relasjoner med bransjepublikasjoner | Økt troverdighetssignaler for AI-systemer |

AI-verktøy for merkevareovervåkning gir essensiell innsikt i hvordan merkevaren din blir representert på tvers av ulike AI-plattformer. Disse spesialiserte verktøyene overvåker kontinuerlig hvordan AI-systemer beskriver merkevaren din, identifiserer inkonsistenser og sporer endringer i merkevarerepresentasjonen over tid. Ved å bruke slike verktøy kan du raskt oppdage unøyaktigheter og iverksette korrigerende tiltak før det forårsaker betydelig skade på omdømmet ditt.

Omfattende AI-verktøy for merkevareovervåkning tilbyr flere sentrale funksjoner. De kan analysere hvordan merkevaren din fremstår på ChatGPT, Perplexity og andre AI-søkemotorer, og gir detaljert informasjon om merkevaresentiment, nøkkelordbruk og konkurranseposisjonering. Disse verktøyene inkluderer ofte AI-synlighetspoeng som kombinerer omtaler, siteringer, sentiment og rangeringer for å gi en pålitelig oversikt over merkevarens synlighet i AI-systemer. Ved å overvåke merkevarens AI-tilstedeværelse regelmessig, kan du identifisere mønstre av feilinformasjon, følge opp effekten av korrigerende tiltak og sikre at korrekt informasjon blir sitert i AI-svar.

Fordelen med dedikerte overvåkningsverktøy er at de gir kontinuerlig, systematisk sporing i stedet for å stole på tilfeldige manuelle sjekker. Dette gjør det mulig å fange opp unøyaktigheter raskt og svare med korrigerende innhold før feilinformasjonen blir utbredt. I tillegg gir disse verktøyene ofte konkurranseinnsikt, slik at du kan se hvordan merkevarens AI-representasjon sammenlignes med konkurrentene og identifisere muligheter for å forbedre posisjoneringen din.

Når du har identifisert unøyaktig informasjon om merkevaren din i AI-svar, er det mest effektive tiltaket å lage og distribuere autoritativt korrigerende innhold. Dette innholdet bør direkte adressere unøyaktighetene og gi klar, faktabasert informasjon som AI-systemene enkelt kan hente ut og sitere. Nøkkelen til suksess er å sørge for at dette korrigerende innholdet er svært autoritativt, godt dokumentert og optimalisert for AI-forståelse.

Effektivt korrigerende innhold følger flere beste praksiser. For det første bør det inneholde klare, faktabaserte uttalelser som direkte motsier den unøyaktige informasjonen. I stedet for bare å si hva som er riktig, bør innholdet forklare hvorfor den tidligere informasjonen var feil og gi bevis som underbygger den korrekte informasjonen. For det andre bør innholdet ha strukturert oppsett med tydelige overskrifter, punktlister og organiserte seksjoner, slik at AI-systemer lett kan analysere og forstå det. For det tredje bør innholdet oppdateres jevnlig for å reflektere den mest oppdaterte informasjonen om merkevaren din, slik at AI-systemene oppfatter det som autoritativt og aktuelt nok til å bli sitert.

Distribusjonsstrategien er like viktig som selve innholdet. Ditt korrigerende innhold bør publiseres på høyt autoritative plattformer hvor AI-systemer sannsynligvis vil finne og sitere det. Dette inkluderer ditt offisielle nettsted, bransjepublikasjoner og relevante kataloger. Ved å distribuere korrigerende innhold på flere kanaler øker du sannsynligheten for at AI-systemer vil finne og sitere denne nøyaktige informasjonen, i stedet for å støtte seg på utdaterte eller feilaktige kilder. I tillegg kan å forsterke innholdet via sosiale medier og bransjeinfluensere øke synligheten og autoritetssignalene, noe som gjør det mer sannsynlig at AI-systemene vil sitere det.

AI-hallusinasjoner er en spesielt utfordrende form for unøyaktig informasjon der AI-systemer genererer fullstendig oppdiktede fakta, siteringer eller kilder. Dette er ikke enkle feil eller feiltolkninger—det er tilfeller der AI-en selvsikkert presenterer falsk informasjon som om den var sann. For eksempel kan en AI sitere ikke-eksisterende forskningsartikler, finne opp falske statistikker eller lage falske sitater tilskrevet virkelige personer. Disse hallusinasjonene er spesielt problematiske fordi de ofte presenteres med så stor selvtillit at brukere ikke nødvendigvis stiller spørsmål ved riktigheten.

Rotårsaken til AI-hallusinasjoner ligger i hvordan systemene trenes og fungerer. AI-modeller er optimalisert for å generere plausible tekster snarere enn å verifisere faktiske forhold. Når et AI-system får en forespørsel det ikke har klare treningsdata for, kan det generere det som virker som et rimelig svar basert på mønstre i treningsdataene, selv om svaret er fullstendig oppdiktet. Dette er grunnen til at AI-systemer ofte genererer falske siteringer og kilder—de lager det de tror er plausible referanser, i stedet for å hente ekte kilder.

For å bekjempe AI-hallusinasjoner om merkevaren din må du sørge for at nøyaktig, autoritativ informasjon om merkevaren din er bredt tilgjengelig og lett å finne for AI-systemene. Når AI-systemene har tilgang til klar, faktabasert informasjon fra autoritative kilder, er det mindre sannsynlig at de “hallusinerer” alternative fakta. I tillegg kan du ved å overvåke AI-svar regelmessig fange opp hallusinasjoner raskt og iverksette korrigerende tiltak før de sprer seg.

I tilfeller der unøyaktig AI-informasjon forårsaker betydelig skade på virksomheten din, kan juridiske tiltak være nødvendige. Flere profilerte saker har etablert presedens for å holde AI-systemer og deres operatører ansvarlige for feilinformasjon. For eksempel ble Air Canada holdt juridisk ansvarlig da deres AI-chatbot ga feilaktig informasjon om sorgpriser, noe som førte til at flyselskapet ble dømt for uaktsom feilrepresentasjon. Disse sakene viser at selskaper kan holdes ansvarlige for unøyaktig informasjon generert av deres AI-systemer.

Utover juridiske tiltak kan rådgivning fra merkevarekonsulenter og SEO-eksperter hjelpe deg med å utvikle helhetlige strategier for å rette opp utbredt feiltolkning. Slike fagpersoner kan hjelpe deg å identifisere årsakene til unøyaktigheter, utvikle korrigerende innholdsstrategier og implementere systematiske tilnærminger for å forbedre merkevarens representasjon i AI-systemer. I tillegg er det viktig å samarbeide med ditt juridiske team for å forstå dine rettigheter og mulige løsninger, spesielt hvis den unøyaktige informasjonen gir målbare forretningstap.

For komplekse merkevareutfordringer eller utbredt feiltolkning er profesjonell hjelp ofte nødvendig. Spesialister innen Generative Engine Optimization og AI-merkevarehåndtering kan hjelpe deg å navigere kompleksiteten i å korrigere unøyaktig informasjon på tvers av flere AI-plattformer. De kan også hjelpe deg med å implementere systematiske overvåkings- og korrigeringsprosesser for å forebygge fremtidige feil.

Å bestride unøyaktig AI-informasjon effektivt krever systematisk måling og oppfølging av innsatsen din. Ved å etablere klare måleparametere og overvåke fremdriften over tid, kan du avgjøre om dine korrigerende strategier fungerer og justere tilnærmingen etter behov. Viktige nøkkelindikatorer bør inkludere forbedringer i nøyaktighet, økt synlighet og endringer i konkurranseposisjonering.

Bedrifter som implementerer systematiske korrigeringstiltak opplever vanligvis 80–95 % reduksjon i faktiske feil innen 30 dager, sammen med betydelig forbedret merkevaresynlighet og konkurranseposisjonering. Disse forbedringene er målbare gjennom regelmessig testing av AI-svar på merkevarerelaterte spørsmål, sporing av hvordan AI-systemer beskriver merkevaren din, og overvåking av sentiment og siteringsmønstre. Ved å etablere grunnlinjemålinger før du implementerer korrigerende strategier, kan du tydelig dokumentere effekten av tiltakene dine.

I tillegg kan måling av forretningsmessige resultater som lead-kvalitet, kundehenvendelser og konverteringsrater hjelpe deg å forstå de reelle konsekvensene av unøyaktig AI-informasjon og verdien av dine korrigeringstiltak. Når du kan vise at korrigering av feilaktig AI-informasjon gir bedre forretningsresultater, blir det enklere å forsvare investeringer i kontinuerlig overvåking og optimalisering.

Ta kontroll over hvordan merkevaren din vises i AI-genererte svar. Følg omtaler, sentiment og synlighet på tvers av ChatGPT, Perplexity og andre AI-plattformer.

Lær hvordan du identifiserer og korrigerer feilaktig merkevareinformasjon i AI-systemer som ChatGPT, Gemini og Perplexity. Oppdag overvåkingsverktøy, strategier...

Lær effektive metoder for å identifisere, verifisere og korrigere unøyaktig informasjon i AI-genererte svar fra ChatGPT, Perplexity og andre AI-systemer.

Lær effektive strategier for å identifisere, overvåke og rette opp unøyaktig informasjon om merkevaren din i AI-genererte svar fra ChatGPT, Perplexity og andre ...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.