Hva er AI-innholdsattribusjon? Definisjon, typer og plattformsforskjeller

Lær hva AI-innholdsattribusjon er, hvordan forskjellige plattformer siterer kilder, hvorfor det er viktig for merkevaresynlighet, og hvordan du kan optimalisere...

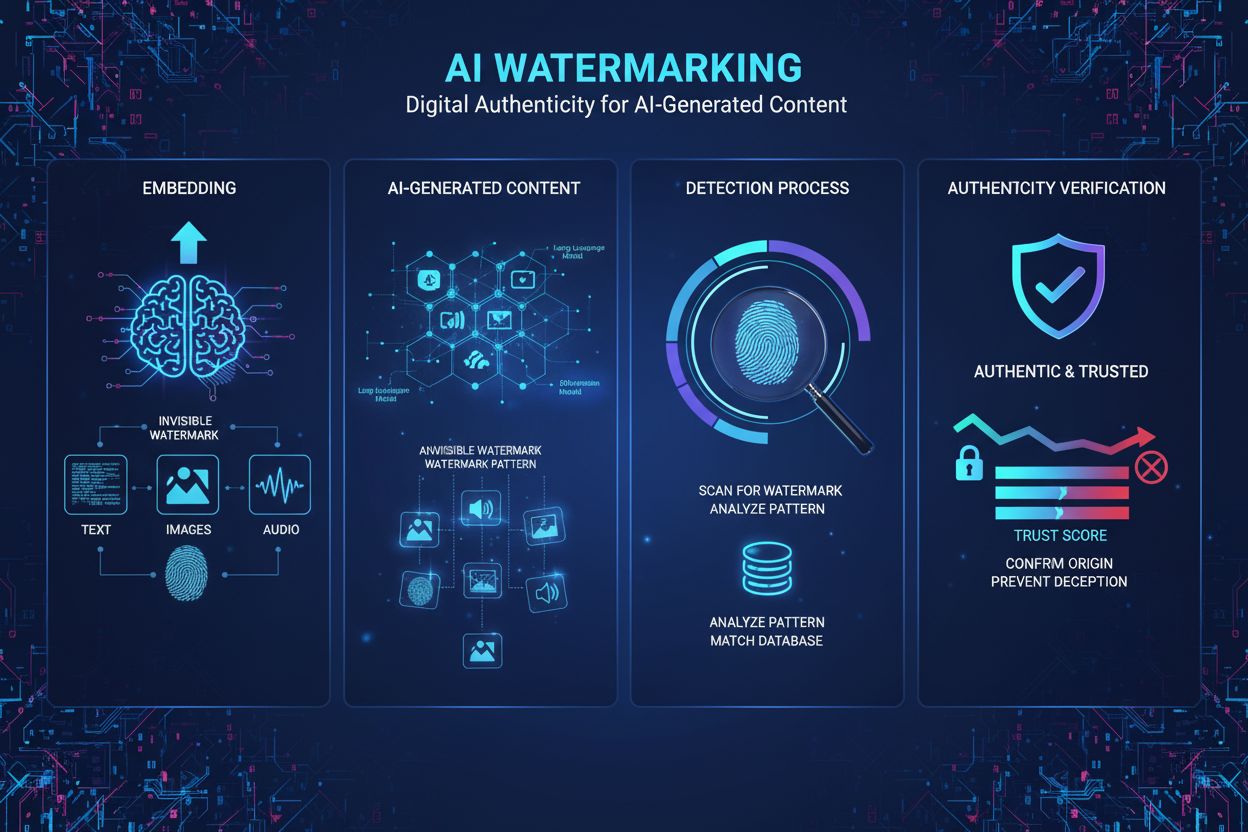

Vannmerking av AI-innhold er prosessen med å bygge inn usynlige eller synlige digitale markører i AI-generert tekst, bilder, lyd eller video for å identifisere og autentisere innholdet som maskinelt generert. Disse vannmerkene fungerer som digitale fingeravtrykk som muliggjør deteksjon, verifisering og sporing av AI-generert materiale på tvers av plattformer og bruksområder.

Vannmerking av AI-innhold er prosessen med å bygge inn usynlige eller synlige digitale markører i AI-generert tekst, bilder, lyd eller video for å identifisere og autentisere innholdet som maskinelt generert. Disse vannmerkene fungerer som digitale fingeravtrykk som muliggjør deteksjon, verifisering og sporing av AI-generert materiale på tvers av plattformer og bruksområder.

Vannmerking av AI-innhold refererer til prosessen med å bygge inn digitale markører, mønstre eller signaturer i AI-generert materiale for å identifisere, autentisere og spore opprinnelsen. Disse vannmerkene fungerer som digitale fingeravtrykk som skiller maskinprodusert innhold fra menneskeskapt materiale på tvers av tekst, bilder, lyd og video. Hovedformålet med vannmerking av AI-innhold er å gi åpenhet om innholdets opprinnelse, bekjempe feilinformasjon, beskytte immaterielle rettigheter og sikre ansvarlighet i det raskt voksende landskapet for generativ kunstig intelligens. I motsetning til tradisjonelle vannmerker som er synlige på fysiske dokumenter eller bilder, benytter moderne AI-vannmerkingsteknikker ofte usynlige mønstre som kun kan oppdages gjennom spesialiserte algoritmer, og ivaretar dermed innholdskvaliteten samtidig som autentiseringsmulighetene opprettholdes.

Konseptet med vannmerking har sitt opphav i den fysiske verden, hvor usynlige merker på sedler og dokumenter fungerte som tiltak mot forfalskning. Etter hvert som digitalt innhold spredte seg, tilpasset forskere vannmerkingsteknikker for bilder, lyd og video gjennom 1990- og 2000-tallet. Fremveksten av avanserte generative AI-modeller som ChatGPT, DALL-E og Midjourney i 2022–2023 skapte imidlertid et akutt behov for standardiserte metoder for autentisering av AI-innhold. Den raske utviklingen av AI-systemer som produserer stadig mer realistisk syntetisk innhold, førte til at myndigheter, teknologiselskaper og sivilsamfunn prioriterte vannmerking som et avgjørende vernetiltak. Forskning fra Brookings Institution viser at over 78 % av virksomheter anerkjenner viktigheten av AI-drevne overvåkingsverktøy for å håndtere risikoen knyttet til syntetiske medier. EU AI Act, formelt vedtatt i mars 2024, ble det første store regulatoriske rammeverket som pålegger vannmerking av AI-innhold og krever at tilbydere av AI-systemer merker sitt output som AI-generert. Dette regulatoriske momentumet har akselerert forskning og utvikling innen vannmerkingsteknologi, og selskaper som Google DeepMind, OpenAI og Meta investerer betydelig i robuste vannmerkingsløsninger.

AI-vannmerking opererer gjennom to hovedtekniske tilnærminger: synlig vannmerking og usynlig vannmerking. Synlige vannmerker inkluderer tydelige etiketter, logoer eller tekstindikatorer lagt til innhold – slik som de fem fargede rutene DALL-E legger til på genererte bilder eller ChatGPTs innledning “as a language model trained by OpenAI”. Selv om dette er enkelt å implementere, er synlige vannmerker svært lette å fjerne gjennom enkel redigering. Usynlig vannmerking, derimot, bygger inn subtile mønstre som ikke kan oppfattes av mennesker, men som kan detekteres av spesialiserte algoritmer. For AI-genererte bilder brukes teknikker som tree-ring-vannmerking utviklet ved University of Maryland, som bygger inn mønstre i det første tilfeldige støybildet før diffusjonsprosessen, noe som gjør dem motstandsdyktige mot beskjæring, rotasjon og filtrering. For AI-generert tekst er statistisk vannmerking den mest lovende tilnærmingen, hvor språkmodellen subtilt favoriserer visse token (“grønne token”) og unngår andre (“røde token”) basert på tidligere kontekst. Dette skaper et statistisk uvanlig ordmønster som deteksjonsalgoritmer kan identifisere med høy sikkerhet. Lydvannmerking bygger inn uoppfattelige mønstre i frekvensområder utenfor menneskelig hørsel (under 20 Hz eller over 20 000 Hz), på lignende måte som for bilder, men tilpasset akustiske egenskaper. SynthID-teknologien fra Google DeepMind er et eksempel på moderne vannmerking, hvor genererings- og deteksjonsmodeller trenes sammen for å sikre robusthet mot transformasjoner og samtidig bevare innholdskvaliteten.

| Vannmerkingstype | Innholdstype | Robusthet | Kvalitetspåvirkning | Krever modelltilgang | Detekterbarhet |

|---|---|---|---|---|---|

| Synlig vannmerking | Bilder, Video | Svært lav | Ingen | Nei | Høy (menneskelig) |

| Statistisk vannmerking | Tekst, Bilder | Høy | Minimal | Ja | Høy (algoritmisk) |

| Maskinlæringsbasert | Bilder, Lyd | Høy | Minimal | Ja | Høy (algoritmisk) |

| Tree-ring-vannmerking | Bilder | Svært høy | Ingen | Ja | Høy (algoritmisk) |

| Innholdsproveniens (C2PA) | Alle medier | Middels | Ingen | Nei | Middels (metadata) |

| Etterfølgende deteksjon | Alle medier | Lav | Ikke relevant | Nei | Lav (upålitelig) |

Statistisk vannmerking er den mest realistiske teknikken for autentisering av AI-generert tekst, og møter den unike utfordringen at tekst mangler det dimensjonale rommet bilder eller lyd har for å bygge inn mønstre. Under genereringsprosessen får en språkmodell instruksjoner om å favorisere visse token basert på en kryptografisk nøkkel som kun er kjent for modellutvikleren. Modellens tilfeldighet “lastes” etter denne ordningen, slik at den foretrekker spesifikke ord eller fraser og unngår andre. Deteksjonsprotokoller analyserer den genererte teksten for å beregne sannsynligheten for at de oppdagede token-mønstrene oppstår ved tilfeldighet; statistisk usannsynlige mønstre indikerer tilstedeværelsen av et vannmerke. Forskning fra University of Maryland og OpenAI har vist at denne tilnærmingen gir høy deteksjonsnøyaktighet med god tekstkvalitet. Likevel har statistisk vannmerking for tekst iboende begrensninger: faktabaserte svar med liten generasjonsfleksibilitet (som matematiske løsninger eller historiske fakta) er vanskeligere å vannmerke effektivt, og grundig omskriving eller oversettelse til andre språk kan redusere deteksjonssikkerheten betydelig. SynthID Text-implementasjonen, nå tilgjengelig i Hugging Face Transformers v4.46.0+, tilbyr produksjonsklar vannmerking med konfigurerbare parametere inkludert kryptografiske nøkler og n-gram-lengde for å balansere robusthet og detekterbarhet.

AI-genererte bilder drar nytte av mer sofistikerte vannmerkingstilnærminger på grunn av det høydimensjonale rommet for å bygge inn mønstre. Tree-ring-vannmerking bygger inn skjulte mønstre i det opprinnelige tilfeldige bildet før diffusjonsprosessen, og skaper vannmerker som overlever vanlige transformasjoner som beskjæring, uskarphet og rotasjon uten å forringe bildekvaliteten. Maskinlæringsbasert vannmerking fra Meta og Google bruker nevrale nettverk til å bygge inn og oppdage uoppfattelige vannmerker, og oppnår over 96 % nøyaktighet på uendrede bilder, samtidig som de er motstandsdyktige mot endringer på pikselnivå. Lydvannmerking benytter lignende prinsipper ved å bygge inn uoppfattelige mønstre i frekvensområder utenfor menneskets hørsel. AudioSeal, utviklet av Meta, trener generator- og detektormodeller sammen for å skape vannmerker som er robuste mot naturlige lydtransformasjoner og samtidig opprettholder uatskillelig lydkvalitet. Teknologien bruker perseptuelt tap for å sikre at vannmerket lydmateriale låter identisk med originalen, mens lokaliserings-tap gjør det mulig å oppdage vannmerker uavhengig av forstyrrelser. Disse tilnærmingene viser at usynlig vannmerking kan oppnå både robusthet og kvalitet når det implementeres riktig, selv om det krever tilgang til den underliggende AI-modellen for å bygge inn vannmerket.

Det regulatoriske landskapet for vannmerking av AI-innhold har utviklet seg raskt, med flere jurisdiksjoner som har innført eller foreslått obligatoriske krav til vannmerking. EU AI Act, formelt vedtatt i mars 2024, er det mest omfattende regulatoriske rammeverket til nå, og pålegger tilbydere av AI-systemer å merke sitt output som AI-generert innhold. Dette gjelder alle generative AI-systemer som tas i bruk innenfor EU, og etablerer en juridisk forpliktelse til å etterleve vannmerkingskravene. Californias AI Transparency Act (SB 942), gjeldende fra 1. januar 2026, pålegger relevante AI-leverandører å gjøre gratis, offentlig tilgjengelige AI-innholddeteksjonsverktøy tilgjengelige, noe som i praksis krever vannmerking eller tilsvarende autentiseringsmekanismer. USAs National Defense Authorization Act (NDAA) for regnskapsåret 2024 inneholder bestemmelser om en premie-konkurranse for å evaluere vannmerkingsteknologi og pålegger forsvarsdepartementet å studere og prøve ut “åpne tekniske industristandarder” for å bygge inn informasjon om innholdsproveniens i metadata. Det hvite hus’ Executive Order on AI pålegger handelsdepartementet å identifisere og utvikle standarder for merking av AI-generert innhold. Disse regulatoriske initiativene gjenspeiler en økende enighet om at AI-vannmerking er avgjørende for åpenhet, ansvarlighet og forbrukerbeskyttelse. Imidlertid gjenstår betydelige implementeringsutfordringer, spesielt med hensyn til modeller med åpen kildekode, internasjonal koordinering og den tekniske gjennomførbarheten av universelle vannmerkingsstandarder.

Til tross for betydelige teknologiske fremskritt møter AI-vannmerking betydelige begrensninger som hemmer praktisk effektivitet. Fjerning av vannmerker er fortsatt mulig gjennom ulike omgåelsesteknikker: omskriving av tekst, beskjæring eller filtrering av bilder, oversettelse til andre språk eller bruk av adversarielle forstyrrelser. Forskning fra Duke University har vist konseptbevis for angrep mot maskinlæringsbaserte vannmerkedetektorer, noe som indikerer at selv avanserte tilnærminger er sårbare for målrettede angripere. Manglende universalitet er en annen kritisk begrensning – vannmerkedetektorer er modellspesifikke, noe som betyr at brukerne må kontakte hver AI-leverandørs deteksjonstjeneste separat for å verifisere innholdsopprinnelse. Uten et sentralt register og standardiserte protokoller blir kontroll av AI-opphav en ineffektiv og tilfeldig prosess. Falske positiver ved vannmerkedeteksjon, spesielt for tekst, er problematisk; deteksjonsalgoritmer kan feilaktig merke menneskeskapt innhold som AI-generert, eller unnlate å oppdage vannmerket innhold etter små endringer. Kompatibilitet med åpen kildekode gir styringsutfordringer, siden vannmerker kan fjernes ved å ta ut kode fra nedlastede modeller. Kvalitetsforringelse oppstår når vannmerkingsalgoritmer kunstig begrenser modellens output for å bygge inn detekterbare mønstre, noe som kan redusere innholdskvaliteten eller begrense genereringsfriheten for faktabaserte eller restriktive oppgaver. Personvernimplikasjonene av vannmerking – spesielt hvis vannmerker inkluderer brukeridentifikasjon – krever nøye policyvurdering. I tillegg reduseres deteksjonssikkerheten betydelig med innholdslengden; kortere tekster og sterkt modifisert innhold gir lavere deteksjonssikkerhet, noe som begrenser vannmerkingens nytte i visse bruksområder.

Fremtiden for AI-vannmerking avhenger av videre teknologisk innovasjon, regulatorisk harmonisering og etablering av pålitelig infrastruktur for deteksjon og verifikasjon av vannmerker. Forskere utforsker offentlig detekterbare vannmerker som bevarer robusthet selv om deteksjonsmetoden er kjent, noe som kan muliggjøre desentralisert verifisering uten å stole på tredjepartstjenester. Standardiseringsarbeid gjennom organisasjoner som ICANN eller bransjekonsortier kan etablere universelle vannmerkingsprotokoller, redusere fragmentering og muliggjøre effektiv deteksjon på tvers av plattformer. Integrasjon med innholdsproveniensstandarder som C2PA kan gi lagvise autentiseringstilnærminger som kombinerer vannmerker med metadata-basert sporing. Utviklingen av vannmerker robuste mot oversettelse og omskriving er et aktivt forskningsområde, med potensielle anvendelser for autentisering av flerspråklig innhold. Blokkjede-baserte verifikasjonssystemer kan gi uforanderlige registre over vannmerkedeteksjon og innholdsproveniens, og øke tilliten til autentiseringsresultater. Etter hvert som generativ AI blir mer avansert, må vannmerkingsteknikkene videreutvikles for å opprettholde effektivitet mot stadig mer sofistikerte omgåelsesforsøk. Det regulatoriske momentumet fra EU AI Act og californisk lovgivning vil trolig drive global innføring av vannmerkingsstandarder og skape markedsinsentiver for robuste tekniske løsninger. Realistisk sett vil vannmerking primært kunne håndtere AI-generert innhold fra populære kommersielle modeller, men være begrenset i situasjoner med høy risiko hvor umiddelbar deteksjon kreves. Integrasjonen av AI-innholdsovervåkingsplattformer som AmICited med vannmerkingsinfrastruktur vil gjøre det mulig for organisasjoner å spore merkevareattribusjon på tvers av AI-systemer, og sikre korrekt anerkjennelse når deres domener nevnes i AI-genererte svar. Fremtidig utvikling vil trolig vektlegge samarbeid mellom mennesker og AI i innholdsautentisering, hvor automatisert vannmerkedeteksjon kombineres med menneskelig vurdering i kritiske bruksområder som journalistikk, rettsforhandlinger og akademisk integritet.

Synlige vannmerker er lett oppdagbare for mennesker, som logoer eller tekstetiketter lagt til bilder eller lydklipp, men de er enkle å fjerne eller forfalske. Usynlige vannmerker bygger inn subtile mønstre som ikke kan oppfattes av mennesker, men som kan oppdages av spesialiserte algoritmer, noe som gjør dem betydelig mer robuste mot manipulering og forsøk på fjerning. Usynlige vannmerker foretrekkes vanligvis for autentisering av AI-innhold fordi de opprettholder innholdskvaliteten samtidig som de gir sterkere sikkerhet mot omgåelse.

Statistisk vannmerking for tekst fungerer ved å subtilt påvirke språkmodellens valg av token under generering. Modellutvikleren 'laster terningen' ved å bruke en kryptografisk ordning, noe som får modellen til å favorisere visse 'grønne token' og unngå 'røde token' basert på foregående kontekst. Deteksjonsalgoritmer analyserer deretter teksten for å identifisere om favoriserte token opptrer med statistisk uvanlig frekvens, noe som indikerer tilstedeværelse av et vannmerke. Denne tilnærmingen bevarer tekstkvaliteten samtidig som den bygger inn et detekterbart fingeravtrykk.

Viktige utfordringer inkluderer hvor enkelt det er å fjerne vannmerker ved små endringer eller transformasjoner, mangelen på universell deteksjon på tvers av ulike AI-modeller, samt hvor vanskelig det er å vannmerke tekst sammenlignet med bilder eller lyd. I tillegg krever vannmerking samarbeid fra AI-modellutviklere, er uforenlig med utgivelser av åpen kildekode, og kan forringe innholdskvaliteten dersom det ikke implementeres nøye. Falske positive og falske negative ved deteksjon er også betydelige tekniske hindringer.

EU AI Act, formelt vedtatt i mars 2024, krever at tilbydere av AI-systemer merker sitt output som AI-generert innhold. Californias AI Transparency Act (SB 942), gjeldende fra 1. januar 2026, pålegger de aktuelle AI-leverandørene å gjøre gratis, offentlig tilgjengelige verktøy for innholddeteksjon tilgjengelig. USAs National Defense Authorization Act (NDAA) for regnskapsåret 2024 inkluderer bestemmelser for evaluering av vannmerkingsteknologi og utvikling av industristandarder for innholdsproveniens.

Vannmerking bygger inn identifiserende mønstre direkte i AI-generert innhold, og skaper et permanent digitalt fingeravtrykk som vedvarer selv om innholdet kopieres eller endres. Innholdsproveniens, slik som C2PA-standarden, lagrer metadata om innholdets opprinnelse og endringshistorikk separat i filens metadata. Vannmerking er mer robust mot omgåelse, men krever samarbeid fra modellutviklere, mens proveniens er lettere å implementere, men kan fjernes ved kopiering av innhold uten metadata.

SynthID er Google DeepMinds teknologi som vannmerker og identifiserer AI-generert innhold ved å bygge inn digitale vannmerker direkte i bilder, lyd, tekst og video. For tekst bruker SynthID en logits-prosessor som utvider modellens genereringspipeline for å kode vannmerkingsinformasjon uten å påvirke kvaliteten nevneverdig. Teknologien benytter maskinlæringsmodeller for både å bygge inn og oppdage vannmerker, noe som gjør den motstandsdyktig mot vanlige angrep samtidig som innholdets ekthet bevares.

Ja, motiverte aktører kan fjerne eller omgå vannmerker gjennom ulike teknikker, inkludert omskriving av tekst, beskjæring eller filtrering av bilder, eller oversetting av innhold til andre språk. Å fjerne sofistikerte vannmerker krever imidlertid teknisk kompetanse og kjennskap til vannmerkingsmetoden. Statistiske vannmerker er mer robuste enn tradisjonelle tilnærminger, men forskning har vist konseptbevis for angrep selv mot avanserte vannmerkingsteknikker, noe som indikerer at ingen vannmerkingsteknikk er helt idiotsikker.

Begynn å spore hvordan AI-chatbots nevner merkevaren din på tvers av ChatGPT, Perplexity og andre plattformer. Få handlingsrettede innsikter for å forbedre din AI-tilstedeværelse.

Lær hva AI-innholdsattribusjon er, hvordan forskjellige plattformer siterer kilder, hvorfor det er viktig for merkevaresynlighet, og hvordan du kan optimalisere...

Lær hva AI-innholddeteksjon er, hvordan deteksjonsverktøy fungerer med maskinlæring og NLP, og hvorfor de er viktige for merkevareovervåking, utdanning og bekre...

Lær om AI-innholdslisensieringsavtaler som regulerer hvordan kunstig intelligens bruker opphavsrettsbeskyttet innhold. Utforsk lisensieringstyper, nøkkelkompone...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.