Budowanie autorytetu dla widoczności w AI

Dowiedz się, jak budować autorytet dla widoczności w AI. Poznaj strategie E-E-A-T, autorytet tematyczny oraz jak być cytowanym w AI Overviews i odpowiedziach LL...

Dowiedz się, jak budować autorytet tematyczny dla LLM-ów dzięki głębi semantycznej, optymalizacji encji i klastrom treści. Opanuj strategie, które sprawiają, że systemy AI cytują Twoją markę.

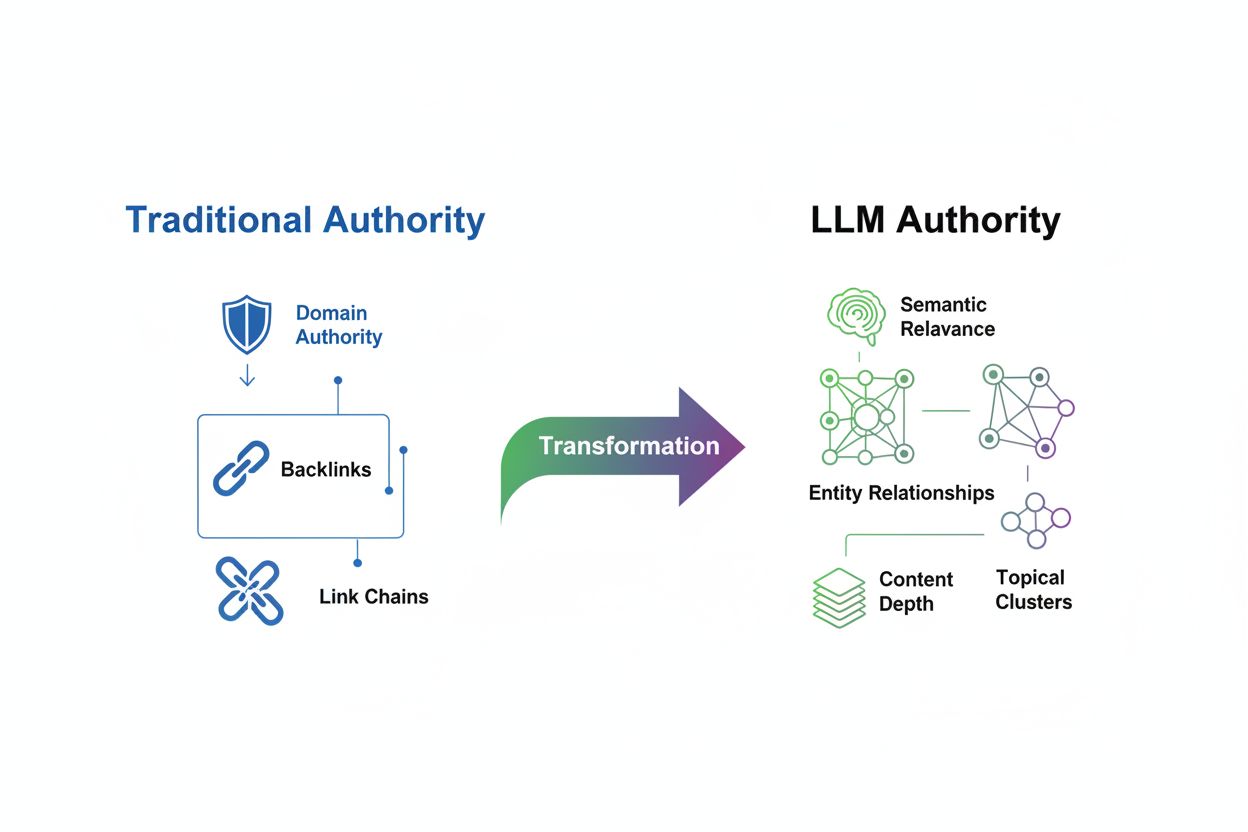

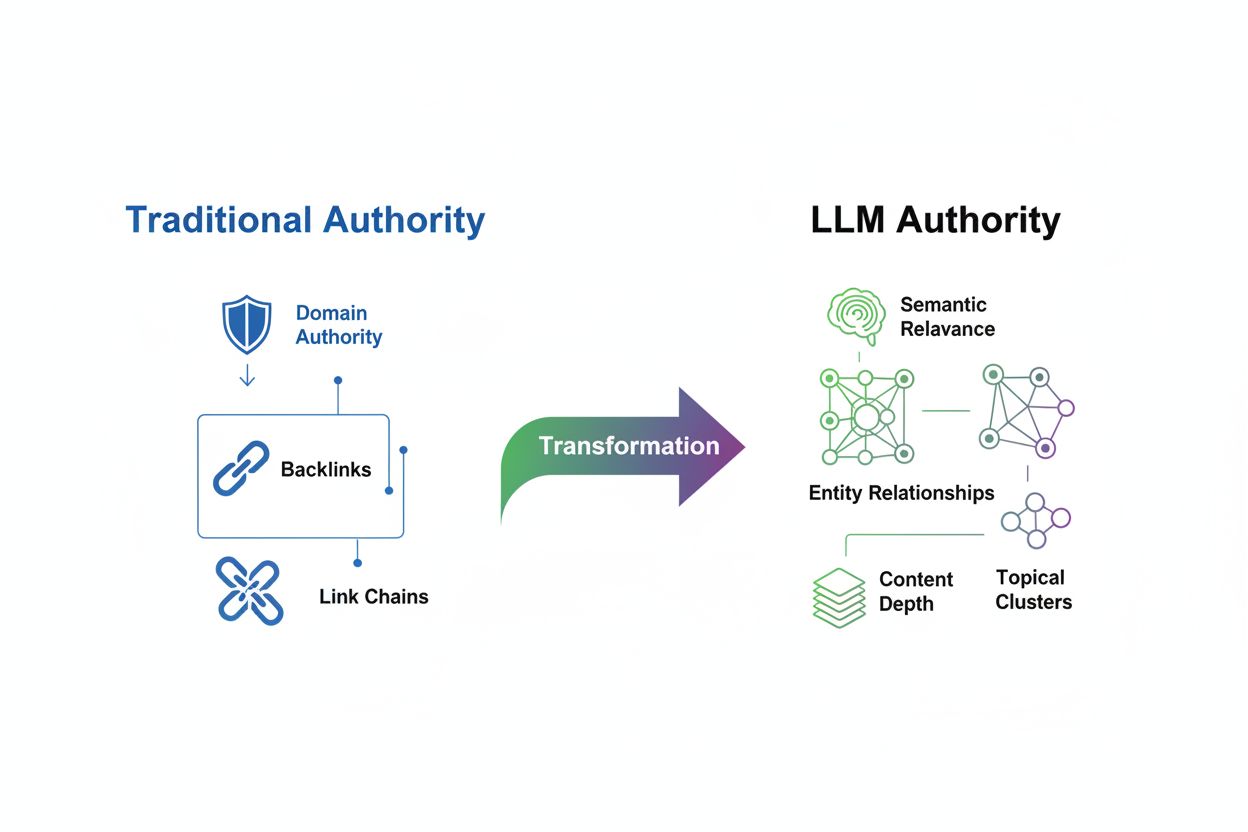

Ocena autorytetu tematycznego przeszła fundamentalną transformację w erze dużych modeli językowych (LLM). Tam, gdzie tradycyjne SEO stawiało na pierwszym miejscu linki zwrotne i nasycenie słowami kluczowymi jako główne sygnały autorytetu, nowoczesne LLM-y oceniają treści z zupełnie innej perspektywy, koncentrując się na istotności semantycznej, głębi kontekstowej i relacjach między encjami. Ta zmiana to coś więcej niż kolejna aktualizacja algorytmu – to całkowite przemyślenie sposobu, w jaki wyszukiwarki oraz systemy AI decydują, które źródła zasługują na widoczność i zaufanie. Stary model nagradzał ilość i liczbę linków; nowy paradygmat premiuje bogactwo semantyczne i kompleksowe pokrycie tematu. Zrozumienie tej zmiany jest kluczowe, ponieważ marki, które dalej optymalizują pod kątem przestarzałych sygnałów autorytetu, staną się coraz mniej widoczne w odpowiedziach generowanych przez AI, nawet jeśli zachowają silne tradycyjne wskaźniki SEO. Przyszłość widoczności należy do tych, którzy zrozumieją, że LLM-y rozpoznają autorytet poprzez głębię, konsekwencję i klarowność semantyczną, a nie przez gromadzenie zewnętrznych linków.

Autorytet tematyczny to poziom wiedzy, głębi i konsekwencji, jaki strona internetowa prezentuje w wybranym obszarze tematycznym, rozpoznawany zarówno przez wyszukiwarki, jak i systemy sztucznej inteligencji. W przeciwieństwie do tradycyjnych metryk opierających się głównie na zewnętrznej weryfikacji przez linki zwrotne, ocena autorytetu przez LLM koncentruje się na tym, jak kompleksowo i spójnie domena omawia wybrany temat. Istotność semantyczna stała się fundamentem tej nowej metody – LLM-y sprawdzają, czy treść w pełni odpowiada na intencję użytkownika, obejmuje różne aspekty tematu i utrzymuje logiczne powiązania między koncepcjami. To zasadnicza różnica: strona z 50 powierzchownymi, przeładowanymi słowami kluczowymi artykułami może mieć silne tradycyjne sygnały autorytetu, ale słaby autorytet tematyczny w oczach LLM, podczas gdy konkurent z 10 dogłębnie opracowanymi, powiązanymi artykułami może dominować w odpowiedziach generowanych przez AI.

| Sygnał autorytetu | Tradycyjne SEO | Ocena LLM |

|---|---|---|

| Główny wskaźnik | Ilość linków zwrotnych i autorytet domeny | Głębia semantyczna i pokrycie tematu |

| Podejście do treści | Optymalizacja słów kluczowych i ilość | Kompleksowe, powiązane klastry treści |

| Rozpoznawanie encji | Minimalny nacisk | Kluczowe dla rozumienia relacji |

| Linkowanie wewnętrzne | Drugorzędne znaczenie | Niezbędne do demonstracji ekspertyzy |

| Fokus pomiaru | Metryki na poziomie domeny (DA, DR, DP) | Widoczność i cytowalność na poziomie tematu |

Duże modele językowe oceniają autorytet za pomocą zaawansowanych mechanizmów, które zasadniczo różnią się od tradycyjnych algorytmów wyszukiwarek. Gdy LLM analizuje treść, nie liczy po prostu linków zwrotnych czy częstotliwości słów kluczowych; zamiast tego angażuje się w rozpoznawanie wzorców w miliardach dokumentów, by zrozumieć relacje między pojęciami. Model analizuje relacje encji – powiązania między osobami, organizacjami, produktami i koncepcjami – by ocenić, czy źródło rzeczywiście rozumie temat, a nie tylko go wspomina powierzchownie. Bogactwo semantyczne odgrywa kluczową rolę, gdy LLM-y oceniają głębię wyjaśnień, różnorodność perspektyw i logiczny przepływ między wątkami. Dodatkowo konsekwencja w wielu treściach sygnalizuje prawdziwą ekspertyzę; gdy domena wielokrotnie wykazuje wiedzę o powiązanych subtematach, LLM traktuje to jako autorytatywne.

Kluczowe mechanizmy rozpoznawania autorytetu przez LLM-y to:

W erze LLM głębia treści stała się wielokrotnie cenniejsza niż jej objętość. Opublikowanie jednej kompleksowej publikacji na 5 000 słów, która gruntownie omawia temat z wielu perspektyw, przykładami i praktycznymi wskazówkami, przyniesie lepszy efekt niż dziesięć artykułów po 500 słów traktujących temat powierzchownie. Zasada ta zasadniczo podważa tradycyjne podejście content marketingu, które nagradzało ilość. LLM-y preferują pokrycie semantyczne – stopień, w jakim treść obejmuje wszystkie istotne aspekty tematu – ponad powtarzalność słów kluczowych. Tworząc treści eksplorujące temat z różnych stron, odpowiadające na powiązane pytania i łączące się z szerszymi koncepcjami, budujesz tzw. klastry tematyczne – sieć powiązanych treści, które razem prezentują ekspertyzę. Przykładowo, firma finansowa budująca autorytet wokół „planowania emerytalnego” powinna tworzyć treści o strategiach inwestycyjnych, podatkach, kosztach opieki zdrowotnej, optymalizacji ZUS i sukcesji – a nie publikować 20 wariacji „jak zaplanować emeryturę”. Takie podejście pokazuje LLM-om, że naprawdę rozumiesz ekosystem tematu, co zwiększa szansę na cytowanie przez AI.

Tworzenie skutecznych klastrów tematycznych wymaga strategicznego, hierarchicznego podejścia do organizacji treści, które sygnalizuje ekspertyzę zarówno użytkownikom, jak i LLM-om. Fundamentem tej strategii jest strona filarowa – kompleksowy, autorytatywny materiał szeroko omawiający główny temat i będący centrum dla wszystkich powiązanych treści. Stronę filarową wspierają strony klastrowe, które zgłębiają konkretne subtematy i są jasno powiązane z filarem poprzez linkowanie wewnętrzne.

Aby zbudować skuteczny klaster tematyczny i strategię linkowania wewnętrznego:

Zidentyfikuj główny temat filarowy: Wybierz szeroki obszar, w którym Twoja organizacja ma prawdziwą ekspertyzę i jest na niego popyt. Temat powinien być wystarczająco szczegółowy, by pokazać autorytet, ale na tyle szeroki, by wspierać wiele tekstów wspierających. Przykład: „Wdrożenie systemu ERP dla przedsiębiorstw” zamiast samego „ERP”.

Zmapuj powiązane subtematy i pytania: Skorzystaj z narzędzi takich jak SEMrush, AnswerThePublic czy „Ludzie pytają także” Google, by zidentyfikować wszystkie pytania i zagadnienia istotne dla odbiorców. Stwórz mapę pokazującą powiązania subtematów z filarem i między sobą.

Stwórz stronę filarową: Przygotuj kompleksowy przewodnik (3 000–5 000+ słów) holistycznie omawiający główny temat. Uwzględnij przegląd subtematów, kluczowe definicje i linki do treści klastrowych. Użyj przejrzystych nagłówków i logicznej struktury.

Opracuj treści klastrowe: Napisz 8–15 artykułów wspierających, dogłębnie omawiających konkretne subtematy. Każdy tekst powinien mieć 1 500–2 500 słów i koncentrować się na jednym aspekcie. Każdy artykuł powinien linkować do strony filarowej przy użyciu kontekstowych anchorów.

Zastosuj strategiczne linkowanie wewnętrzne: Łącz artykuły klastrowe między sobą tam, gdzie to uzasadnione, tworząc sieć powiązań. Używaj opisowych anchorów zawierających słowa kluczowe i nazwy encji. Dodaj sekcje „powiązane artykuły” i widgety nawigacyjne.

Zachowaj spójność i aktualizuj regularnie: Okresowo przeglądaj klaster pod kątem luk, nieaktualnych informacji i nowych subtematów. Dodawaj nowe artykuły wraz z rozwojem tematu i aktualizuj istniejące treści.

Optymalizacja encji to zmiana paradygmatu w podejściu do struktury treści i SEO. Zamiast optymalizować pod kątem słów kluczowych, skupiamy się na encjach – konkretnych osobach, organizacjach, produktach, lokalizacjach i pojęciach, które LLM-y wykorzystują do rozumienia znaczenia treści. Jasno definiując i konsekwentnie odwołując się do encji w treściach, uczysz graf wiedzy LLM, jak Twoje treści wpisują się w szerszy ekosystem informacji. Znaczniki schema ze Schema.org stanowią techniczną bazę optymalizacji encji, pozwalając wyraźnie wskazać wyszukiwarkom oraz LLM-om, o jakich encjach jest mowa i jakie są między nimi relacje.

Praktyczne wskazówki optymalizacji encji:

Jasno zdefiniuj kluczowe encje: Wskaż główne encje (np. „Google Analytics”, „optymalizacja współczynnika konwersji”, „testy A/B”) i wymieniaj je w nagłówkach, śródtytułach i treści. Unikaj ogólników – bądź precyzyjny.

Używaj znaczników strukturalnych: Wdrażaj Schema.org do definiowania encji i relacji. Wykorzystaj schema Article dla bloga, Organization dla firmy, Product dla oferty i Person dla autora. Strukturalne dane pomagają LLM-om wyodrębnić kluczowe informacje.

Łącz encje z autorytatywnymi źródłami: Linkuj encje do zewnętrznych źródeł takich jak Wikipedia, DBpedia czy Google Knowledge Graph. Taka walidacja wzmacnia wiarygodność i kontekst.

Zachowaj spójność w nazwach encji: Używaj tych samych nazw, pisowni i konwencji w całej witrynie, mediach społecznościowych oraz branżowych. Spójność sygnalizuje LLM-om, że opisujesz tę samą encję.

Framework Google E-E-A-T – Doświadczenie (Experience), Ekspertyza (Expertise), Autorytatywność (Authoritativeness) i Wiarygodność (Trust) – zyskał nowe znaczenie wraz z rosnącą rolą LLM-ów. Sygnały te pozostają ważne dla tradycyjnych pozycji, ale ich interpretacja w AI jest inna. LLM-y oceniają je przez analizę treści, kwalifikacje autora i wzorce konsekwencji, a nie tylko przez linki.

Doświadczenie pokazuje, że autor lub firma faktycznie działa w temacie. LLM-y rozpoznają je przez studia przypadków, rezultaty klientów, osobiste historie autorów i szczegółowe opisy procesów. Zamiast deklarować ekspertyzę, pokaż ją na przykładach. Dodaj biogramy autorów i referencje klientów.

Ekspertyza to kompleksowe, pogłębione treści pokazujące dogłębną wiedzę. LLM-y oceniają ją, analizując czy treść obejmuje niuanse, omawia złożoność, cytuje badania i przekazuje wnioski wykraczające poza podstawy. Publikuj materiały o zaawansowanych tematach, kontrowersjach i aktualnych trendach.

Autorytatywność w erze LLM to rozpoznanie jako źródło odniesienia w branży. Buduje się ją przez regularną publikację wysokiej jakości treści, cytowania przez inne autorytety, wystąpienia, publikacje naukowe i branżowe nagrody. LLM-y śledzą, które źródła są często cytowane razem i pojawiają się w odpowiedziach na eksperckie zapytania.

Wiarygodność budują transparentność, dokładność i odpowiedzialność. Publikuj daty i aktualizacje treści, jasno cytuj źródła, ujawniaj potencjalne konflikty interesów i koryguj błędy. Wykorzystuj kwalifikacje autorów, certyfikaty i afiliacje. LLM-y coraz lepiej wykrywają nieprawdziwe informacje i nagradzają rzetelne źródła.

Śledzenie metryk autorytetu tematycznego wymaga przesunięcia uwagi z tradycyjnych wskaźników SEO na nowe, odzwierciedlające postrzeganą przez LLM ekspertyzę. Domain Authority i Domain Rating nadal mają znaczenie, ale ich korelacja z widocznością LLM jest niska – badania Search Atlas na próbie 21 767 domen wykazały korelacje od -0,08 do -0,21, co oznacza ograniczony wpływ tradycyjnych sygnałów na efekty AI.

Kluczowe wskaźniki i narzędzia monitoringu autorytetu tematycznego:

Wskaźnik widoczności w LLM: Śledź, jak często i na jakich pozycjach Twoje treści pojawiają się w odpowiedziach ChatGPT, Gemini i Perplexity. Narzędzia takie jak Search Atlas mierzą częstotliwość cytowań i udział widoczności w różnych modelach.

Ruch na poziomie tematu: Monitoruj ruch organiczny nie tylko dla pojedynczych słów, ale dla całych klastrów tematycznych. W Google Analytics segmentuj ruch według obszaru tematycznego i sprawdzaj widoczność na powiązane zapytania.

Metryki kompletności treści: Oceń, czy Twoje treści obejmują wszystkie kluczowe subtematy i pytania. Narzędzia typu Clearscope i MarketMuse mierzą pokrycie tematyczne i wskazują luki.

Siła linkowania wewnętrznego: Analizuj strukturę linków, by upewnić się, że strony klastrowe logicznie łączą się z filarem i między sobą. Screaming Frog pomaga wizualizować i optymalizować linkowanie.

Monitoring spójności encji: Sprawdzaj, czy konsekwentnie wymieniasz i definiujesz kluczowe encje w swoich treściach. Google Search Console pozwala zobaczyć, z jakimi encjami wiązane są Twoje treści w wynikach.

Wiele organizacji nieświadomie niweczy swoje wysiłki w budowie autorytetu tematycznego przez proste błędy. Zrozumienie tych pułapek pozwala uniknąć marnowania zasobów.

Najczęstsze błędy to:

Publikacja powierzchownej treści: Tworzenie wielu krótkich (300–500 słów) artykułów liżących temat po wierzchu. LLM-y rozpoznają to jako niewystarczające pokrycie i preferują mniej, ale bardziej wyczerpujące materiały.

Słaba struktura linkowania wewnętrznego: Brak powiązań między powiązanymi treściami lub używanie ogólnych anchorów typu „kliknij tutaj” zamiast opisowych, bogatych w encje. To utrudnia LLM-om zrozumienie relacji między treściami.

Niespójność w nazewnictwie encji: Używanie różnych określeń dla tej samej koncepcji w różnych artykułach (np. „optymalizacja współczynnika konwersji”, „CRO”, „zwiększanie konwersji”). To rozbicie uniemożliwia LLM-om rozpoznanie ekspertyzy.

Ignorowanie luk w treściach: Publikowanie materiałów o niektórych aspektach tematu, pomijając ważne subtematy. LLM-y dostrzegają niekompletność i mogą faworyzować konkurencję z pełniejszymi zasobami.

Brak aktualizacji treści: Pozostawianie starszych materiałów bez aktualizacji przy równoczesnej publikacji nowych na ten sam temat. To prowadzi do redundancji i dezorientacji, która treść jest aktualnym źródłem ekspertyzy.

Budowa autorytetu tematycznego to uporządkowany proces wymagający planowania, realizacji i ciągłej optymalizacji. Oto klarowna ścieżka działania.

Etapy budowy autorytetu tematycznego rozpoznawanego przez LLM:

Audyt autorytetu tematycznego: Przeanalizuj istniejące treści pod kątem najmocniejszych tematów i luk. Sporządź mapę tematów obecnie pokrywanych, brakujących subtematów i miejsc, gdzie treści są powierzchowne lub nieaktualne. Skorzystaj z SEMrush Topic Research i Ahrefs do analizy konkurencji.

Wybierz kluczowe filary tematyczne: Wskaż 3–5 głównych obszarów, w których masz realną ekspertyzę i istnieje na nie popyt. Tematy powinny być na tyle szczegółowe, by pokazać autorytet, ale i szerokie, by wesprzeć liczne artykuły. Udokumentuj, dlaczego Twoja organizacja jest ekspertem w tych obszarach.

Stwórz kompleksową mapę treści: Opracuj wizualizację filarów i klastrów treści. Pokaż powiązania subtematów z filarami i między sobą. Wskaż, które materiały już istnieją, które należy stworzyć, a które zaktualizować lub usunąć.

Stwórz lub odśwież strony filarowe: Opracuj kompleksowe strony filarowe (3 000–5 000+ słów) dla każdego głównego tematu. Każda powinna szeroko opisywać temat, definiować kluczowe encje i linkować do wszystkich tekstów klastrowych. Optymalizuj je za pomocą schema dla LLM.

Buduj treści klastrowe i linkowanie wewnętrzne: Stwórz 8–15 wspierających artykułów dla każdego filaru, każdy dogłębnie omawiający subtemat. Wprowadzaj strategiczne linkowanie z opisowymi anchorami. Łącz artykuły klastrowe z filarem i między sobą tam, gdzie to zasadne.

Wdrażaj optymalizację encji i schema: Dodawaj Schema.org w całej treści, by wyraźnie zdefiniować encje i ich relacje. Dbaj o spójność nazw encji na wszystkich materiałach. Linkuj encje do autorytatywnych źródeł zewnętrznych.

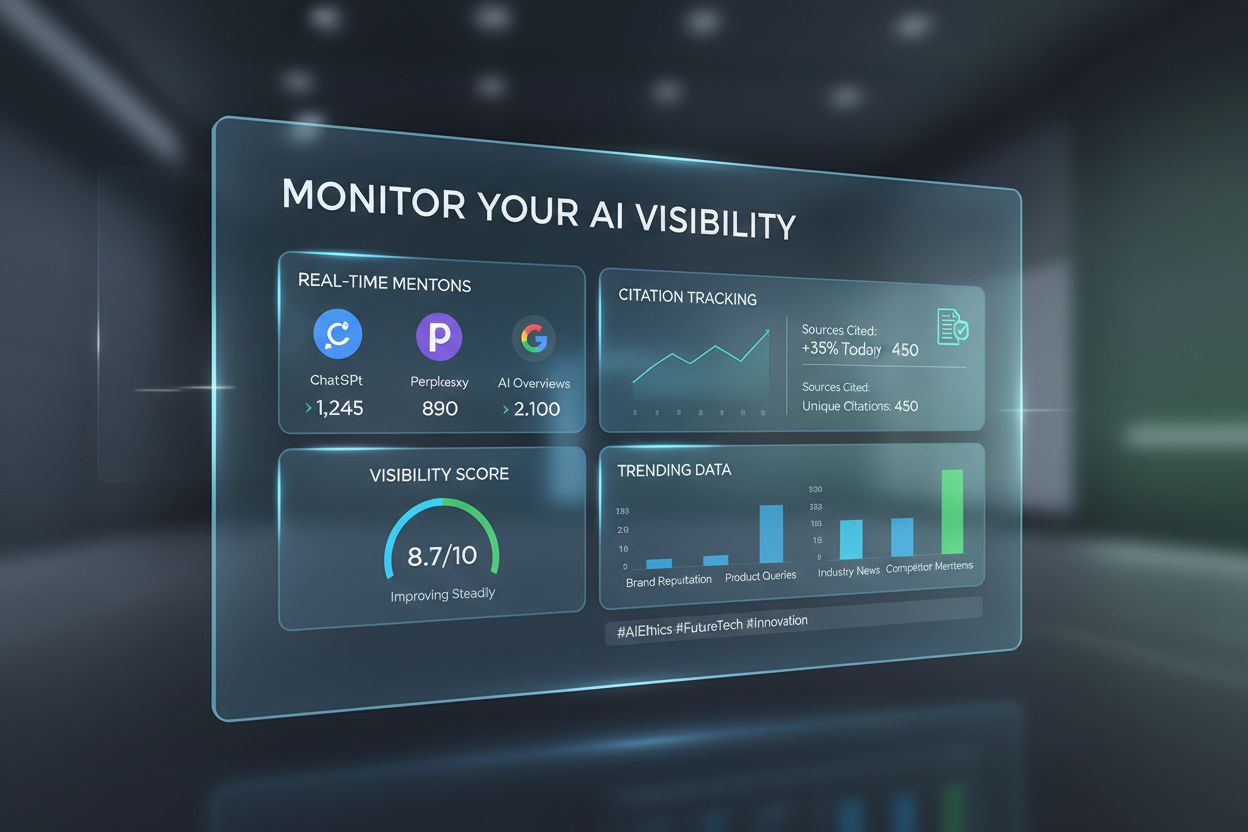

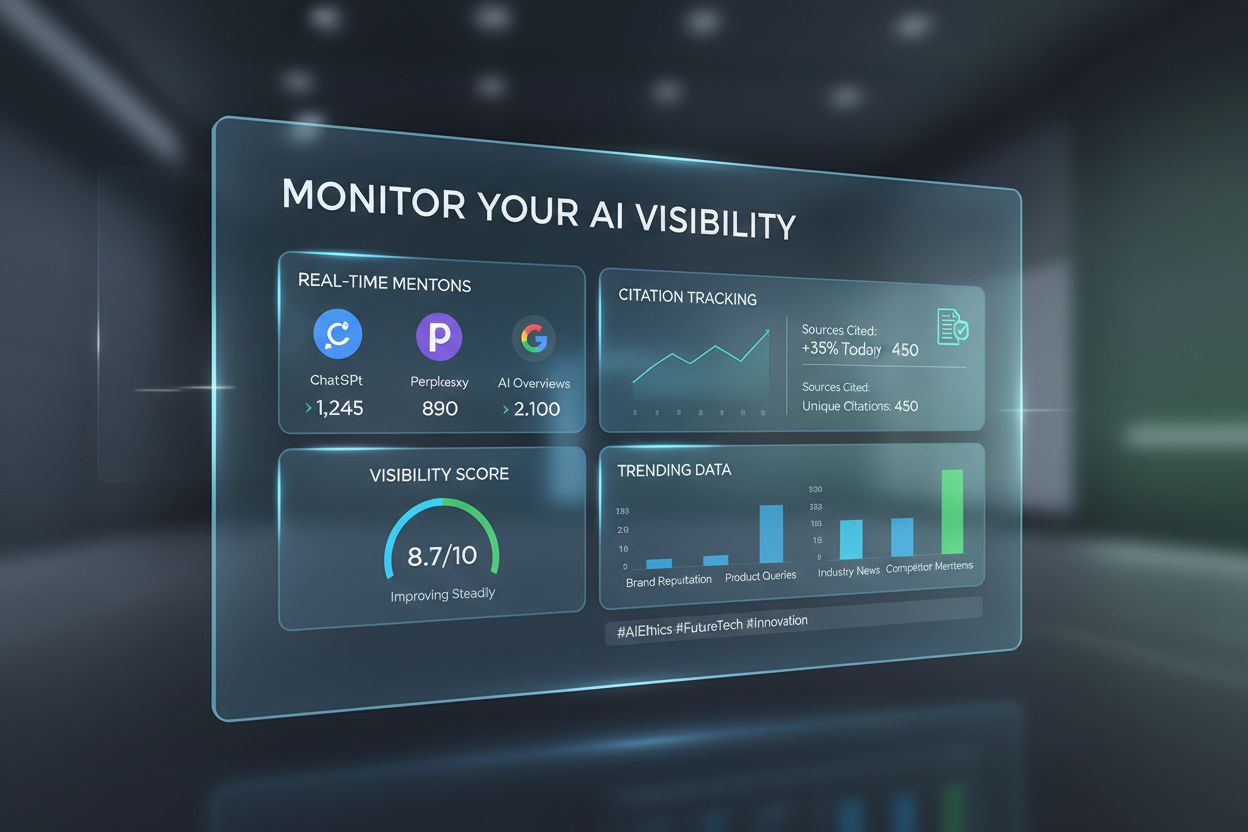

Wraz ze wzrostem autorytetu tematycznego kluczowe staje się śledzenie, jak przekłada się on na widoczność w AI. AmICited to specjalistyczna platforma do monitorowania obecności i cytowań Twojej marki w dużych modelach językowych, dająca wgląd w to, jak AI rozpoznaje i odnosi się do Twoich treści. W przeciwieństwie do klasycznych narzędzi SEO skupionych na rankingach Google, AmICited śledzi widoczność w LLM – mierzy, jak często i jak wyraźnie Twoja marka pojawia się w odpowiedziach ChatGPT, Gemini, Perplexity oraz innych AI generatywnych.

Platforma oferuje kluczowe korzyści w monitorowaniu autorytetu w AI:

Śledzenie cytowań na wielu platformach: Monitoruj wzmianki i cytowania marki w różnych LLM-ach jednocześnie, sprawdzając, gdzie Twój autorytet jest najsilniejszy, a gdzie występują luki.

Benchmarking z konkurencją: Porównuj widoczność w LLM-ach z konkurentami z branży. Zobacz, kto jest częściej cytowany i analizuj strategie treściowe rywali.

Analiza kontekstu cytowań: Sprawdzaj nie tylko, że jesteś cytowany, ale także w jakim kontekście. Zobacz, jakie tematy wywołują cytowania, w jakim kontekście AI odnosi się do marki i czy cytowania są pozytywne i trafne.

Monitorowanie trendów widoczności: Śledź zmiany widoczności w LLM-ach w czasie, wdrażając zmiany w treściach. Mierz wpływ nowych publikacji, aktualizacji i zmian strukturalnych na widoczność w AI.

Wskazówki dotyczące sygnałów autorytetu: Otrzymuj rekomendacje, jakie luki uzupełnić, które tematy rozbudować i które encje zoptymalizować na podstawie wzorców cytowań oraz analizy konkurencji.

Korzystając z AmICited równolegle z tradycyjnymi narzędziami SEO, otrzymujesz pełny obraz autorytetu zarówno w klasycznym wyszukiwaniu, jak i w odkrywaniu przez AI. To niezbędne podejście w 2025 roku i dalej, gdy wyszukiwanie oparte na LLM staje się centralnym sposobem zdobywania informacji. Marki, które monitorują i optymalizują zarówno pod kątem tradycyjnej, jak i AI-widoczności, zachowają przewagę konkurencyjną w świecie coraz bardziej konwersacyjnych, generowanych przez AI odpowiedzi.

Autorytet tematyczny mierzy, jak kompleksowo i konsekwentnie obejmujesz dane zagadnienie, podczas gdy pozycjonowanie na słowa kluczowe dotyczy pojedynczych fraz. LLM-y oceniają autorytet tematyczny, analizując głębię semantyczną, relacje encji i powiązania treści. Strona może zajmować pozycje na konkretne słowa kluczowe bez prawdziwego autorytetu tematycznego, ale autorytet tematyczny zwykle prowadzi do widoczności w wielu powiązanych zapytaniach i odpowiedziach generowanych przez AI.

Budowanie autorytetu tematycznego to strategia długoterminowa, która zwykle wymaga 3-6 miesięcy na pierwsze rezultaty i 6-12 miesięcy na uzyskanie mocnego rozpoznania. Czas zależy od punktu wyjścia, jakości treści, poziomu konkurencji i konsekwencji wdrożenia strategii. LLM-y rozpoznają autorytet na podstawie wzorców w czasie, dlatego ważniejsze są spójność i głębia niż szybkość.

Tak, zdecydowanie. W przeciwieństwie do tradycyjnych metryk autorytetu, które premiują uznane domeny z wieloma linkami zwrotnymi, LLM-y oceniają autorytet tematyczny na podstawie głębi semantycznej i jakości treści. Mała marka z 10 kompleksowymi, powiązanymi artykułami na dany temat może przewyższyć dużego wydawcę mającego 100 powierzchownych tekstów. Skup się na głębi, konsekwencji i optymalizacji encji zamiast naśladownictwa ilości.

Linki zwrotne pozostają istotne dla tradycyjnych pozycji Google, ale mają słabą korelację z widocznością w LLM-ach. Badania wykazują korelacje między klasycznymi metrykami autorytetu a widocznością w LLM-ach na poziomie od -0,08 do -0,21. Chociaż linki nadal są ważne dla SEO, LLM-y przedkładają znaczenie semantyczne, głębię treści i relacje encji. Skup się na tworzeniu wyjątkowych treści, które naturalnie przyciągają cytowania, zamiast zdobywania linków dla samego celu.

Objawy autorytetu tematycznego to: pojawianie się w odpowiedziach AI na wiele powiązanych zapytań, konsekwentne cytowania w różnych LLM-ach, pozycjonowanie na klastry tematyczne zamiast pojedynczych słów, wysokie zaangażowanie na treściach filarowych i klastrowych, oraz rozpoznanie jako źródło w branży. Korzystaj z narzędzi takich jak AmICited do monitorowania cytowań w LLM-ach oraz Search Atlas do śledzenia widoczności na poziomie tematów.

Powinieneś skupić się na obu, ale z różnymi priorytetami. Autorytet tematyczny nabiera coraz większego znaczenia dla odkrywania przez AI i długoterminowej widoczności, podczas gdy tradycyjne SEO wciąż jest kluczowe dla pozycji w Google. Dobra wiadomość jest taka, że strategie budowania autorytetu tematycznego (głębia semantyczna, optymalizacja encji, klastry treści) również poprawiają klasyczne SEO. Zacznij od autorytetu tematycznego jako fundamentu, a tradycyjne SEO przyniesie dodatkowe korzyści.

Sygnały zaangażowania użytkowników, takie jak czas spędzony na stronie, głębokość przewijania i powroty, wskazują LLM-om, że Twoje treści dostarczają realnej wartości. Gdy użytkownicy czytają Twoje treści i eksplorują powiązane artykuły w klastrze, sygnalizuje to, że są one kompleksowe i autorytatywne. LLM-y interpretują te wzorce zaangażowania jako wskaźniki jakości i trafności, dlatego optymalizacja doświadczenia użytkownika jest kluczowa dla autorytetu tematycznego.

LLM-y analizują, jak wspominasz i łączysz różne encje (osoby, organizacje, produkty, koncepcje) w swoich treściach. Kiedy konsekwentnie odnosisz się do powiązanych encji i wyjaśniasz ich relacje, LLM-y traktują to jako dowód kompleksowego zrozumienia tematu. Znaczniki schema pomagają wyraźnie definiować powiązania encji. Na przykład połączenie 'planowanie emerytalne' z 'ZUS', 'strategie inwestycyjne' oraz 'optymalizacja podatkowa' pokazuje, że rozumiesz ekosystem tematu.

Śledź, jak LLM-y cytują Twoje treści i mierz autorytet tematyczny w ChatGPT, Gemini i Perplexity dzięki platformie monitoringu AI AmICited.

Dowiedz się, jak budować autorytet dla widoczności w AI. Poznaj strategie E-E-A-T, autorytet tematyczny oraz jak być cytowanym w AI Overviews i odpowiedziach LL...

Dowiedz się, jak systemy AI oceniają jakość treści poza tradycyjnymi metrykami SEO. Poznaj semantyczne rozumienie, dokładność faktów i sygnały jakości ważne dla...

Dowiedz się, czym jest LLMO, jak działa i dlaczego ma znaczenie dla widoczności w AI. Poznaj techniki optymalizacji, aby Twoja marka była wspominana w ChatGPT, ...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.