E-E-A-T (Doświadczenie, Ekspertyza, Autorytatywność, Wiarygodność)

E-E-A-T (Doświadczenie, Ekspertyza, Autorytatywność, Wiarygodność) to framework Google do oceny jakości treści. Dowiedz się, jak wpływa na SEO, cytowania AI i w...

Dowiedz się, jak sygnały E-E-A-T wpływają na cytowania przez LLM i widoczność AI. Zobacz, jak doświadczenie, ekspertyza, autorytet i zaufanie kształtują odkrywalność treści w wyszukiwarkach zasilanych AI.

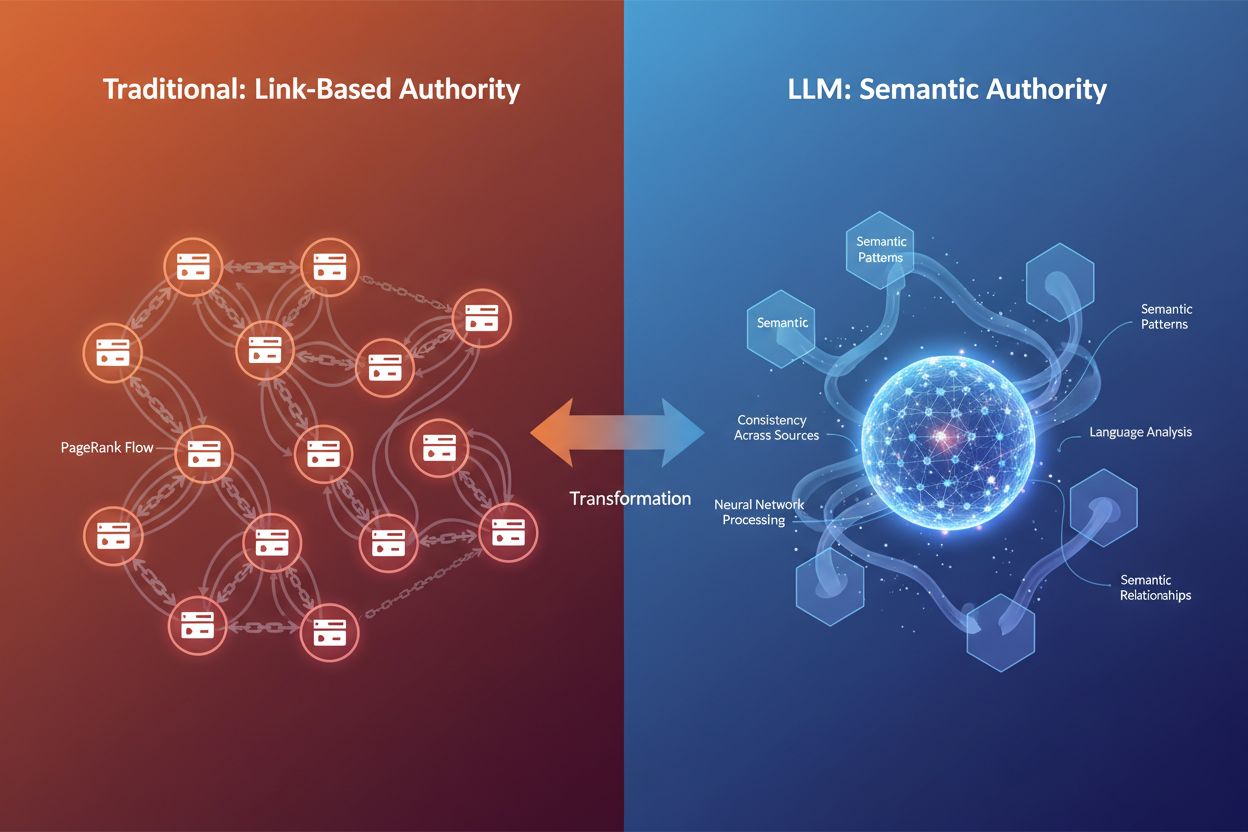

Cyfrowy krajobraz zmienia się na naszych oczach. Przez dekady backlinki były głównym wyznacznikiem autorytetu — im więcej jakościowych linków prowadziło do Twojej strony, tym wyżej wyszukiwarki oceniały jej autorytet. Jednak gdy modele językowe (LLM) jak ChatGPT, Claude czy Gemini przekształcają sposób, w jaki odkrywamy i oceniamy informacje, definicja autorytetu również ewoluuje. E-E-A-T — Doświadczenie, Ekspertyza, Autorytet i Zaufanie — przesunęło się z pobocznego aspektu SEO do podstawowych ram decydujących o widoczności zarówno w tradycyjnych wyszukiwarkach, jak i platformach opartych na AI. Kluczowy wniosek jest taki, że backlinki nie są już jedynym markerem autorytetu decydującym o tym, czy Twoje treści zostaną zacytowane przez systemy AI. LLM-y oceniają autorytet poprzez bogactwo semantyczne, spójność między źródłami oraz głębię wiedzy ujawnioną w treści. Ta zmiana ma ogromne znaczenie dla marek, które chcą budować widoczność w systemach cytowań AI, takich jak Google AI Overviews, Perplexity i ChatGPT. Gdy AmICited monitoruje, jak AI odnosi się do Twojej marki na tych platformach, śledzimy sygnały zdecydowanie wykraczające poza tradycyjne profile linków. Pytanie nie brzmi już tylko “kto linkuje do Ciebie?”, lecz “czy Twoja treść pokazuje autentyczną ekspertyzę i czy systemy AI mogą jej zaufać na tyle, by ją cytować?” Zrozumienie tej różnicy jest kluczowe dla każdego, kto poważnie myśli o budowie autorytetu w świecie wyszukiwania napędzanego AI.

E-E-A-T to cztery powiązane ze sobą wymiary wiarygodności treści, z których każdy odgrywa odrębną rolę w ocenie wartości Twoich treści przez Google i LLM-y. Rozłóżmy każdy filar na czynniki pierwsze i zobaczmy, jak funkcjonują w kontekście cytowań AI:

Doświadczenie oznacza, że faktycznie robisz to, o czym piszesz. Recenzja produktu napisana przez osobę, która korzystała z niego przez sześć miesięcy, ma większą wagę niż ogólny opis. W erze AI LLM-y rozpoznają treści oparte na doświadczeniu po wzorcach językowych wskazujących na osobisty udział — konkretnych szczegółach, obserwacjach z życia i kontekście, który może znać tylko ktoś z bezpośrednim doświadczeniem.

Ekspertyza to wykazana wiedza poparta kwalifikacjami, edukacją lub udokumentowanym dorobkiem. Doradca finansowy z certyfikatem CFA piszący o inwestycjach ma większy autorytet niż bloger lifestyle’owy piszący o finansach. LLM-y rozpoznają ekspertyzę po spójnym użyciu terminologii technicznej, logicznej głębi wyjaśnień i umiejętności precyzyjnego omawiania złożonych zagadnień.

Autorytet pochodzi z zewnętrznego uznania — inne wiarygodne źródła cytują Cię, linkują do Ciebie lub wymieniają jako eksperta. Tradycyjnie mierzyło się to przez backlinki. Jednak w kontekście LLM autorytet coraz częściej mierzony jest przez ślad semantyczny — jak często Twoja marka lub nazwisko pojawia się w powiązaniu z daną niszą w różnych źródłach i platformach.

Zaufanie to parasol spinający wszystko razem. Bez zaufania pozostałe filary się rozpadają. Zaufanie buduje się przez transparentność (jasne autorstwo, kontakt), rzetelność (faktyczne treści z odpowiednimi źródłami) i bezpieczeństwo (HTTPS, profesjonalna infrastruktura). Google jasno stwierdza, że zaufanie to najważniejszy członek rodziny E-E-A-T, a LLM-y podobnie mocno ważą spójność i wiarygodność przy wyborze cytowanych źródeł.

| Sygnał | Ocena SEO tradycyjna | Ocena cytowań LLM |

|---|---|---|

| Doświadczenie | Bio autora, osobiste anegdoty | Wzorce językowe wskazujące na osobisty udział |

| Ekspertyza | Kwalifikacje, backlinki z autorytatywnych stron | Głębia semantyczna, terminologia techniczna, zakres tematyczny |

| Autorytet | Profil linków, autorytet domeny | Rozpoznanie encji, wzmianki na różnych platformach, autorytet semantyczny |

| Zaufanie | HTTPS, struktura strony, opinie użytkowników | Spójność między źródłami, weryfikacja rzetelności, przejrzystość |

Kluczowa różnica polega na tym, że tradycyjne SEO opiera się na sygnałach strukturalnych (linki, metryki domeny), a LLM-y oceniają E-E-A-T przez analizę semantyczną i kontekstową. Oznacza to, że możesz budować autorytet bez wielkich kampanii link buildingowych — jeśli Twoje treści pokazują autentyczną ekspertyzę i spójność.

Duże modele językowe nie myślą jak tradycyjne wyszukiwarki. Nie indeksują sieci w poszukiwaniu backlinków ani nie sprawdzają wyników autorytetu domeny. Działają jako maszyny probabilistyczne, rozpoznające wzorce w języku, kontekście i spójności informacji. Gdy LLM ocenia, czy zacytować Twoje treści, zadaje zasadniczo inne pytania niż algorytm rankingowy Google.

Rozpoznawanie wzorców vs. sygnały strukturalne: Tradycyjne wyszukiwarki weryfikują autorytet przez zewnętrzną walidację — kto do Ciebie linkuje? LLM-y rozpoznają autorytet językowo. Analizują, czy Twój tekst pokazuje ekspertyzę przez poprawne użycie terminów technicznych, logiczny tok wywodu, pewny ton i zdolność omawiania niuansów tematu. Strona o chorobach serca, która naturalnie wplata powiązane pojęcia jak “cholesterol”, “blaszka miażdżycowa” czy “czynniki ryzyka sercowo-naczyniowego”, sygnalizuje autorytet semantyczny nawet bez backlinków.

Semantyczna trafność i głębia tematyczna: LLM-y premiują treści, które całościowo omawiają temat z różnych perspektyw. Gdy zapytasz AI asystenta, system rozbija prompt na wiele zapytań (“query fan-out”), po czym pobiera treści pasujące do tych wariacji. Treści, które wyczerpująco pokrywają temat — omawiają podtematy, odpowiadają na pytania pomocnicze i dają kontekst — mają większą szansę na cytowanie. Dlatego bogactwo semantyczne stało się nową formą autorytetu.

Spójność między źródłami: LLM-y porównują informacje w milionach dokumentów. Jeśli Twoja treść zgadza się z uznanym konsensusem, dodając unikalne spostrzeżenia, traktowana jest jako bardziej autorytatywna. Odwrotnie, jeśli Twoja treść przeczy faktom bez podparcia, AI może ją zignorować jako niewiarygodną. Możesz wprowadzać świeże idee, ale muszą być one osadzone w weryfikowalnych danych.

Kluczowe różnice w ocenie autorytetu:

Wniosek: LLM-y rozpoznają autorytet przez znaczenie, nie metryki. To fundamentalnie zmienia podejście do optymalizacji treści pod kątem widoczności w AI.

Jednym z najciekawszych odkryć najnowszych badań nad cytowaniami LLM jest silne uprzywilejowanie aktualności na wszystkich głównych platformach. Analiza 90 000 cytowań z ChatGPT, Gemini i Perplexity z aktywnym wyszukiwaniem internetowym ujawniła wyraźny trend: większość cytowanych adresów URL została opublikowana w ciągu kilkuset dni przed odpowiedzią LLM. To nie przypadek — to celowe działanie. LLM-y są trenowane do rozpoznawania, że świeże treści często korelują z aktualnością i jakością, szczególnie w przypadku tematów wrażliwych na czas.

Dlaczego świeżość ma znaczenie w RAG Retrieval: Gdy LLM korzysta z Retrieval-Augmented Generation (RAG) — czyli wyszukuje w sieci na bieżąco, by uwiarygodnić swoje odpowiedzi — pyta: “Jakie są najnowsze, najbardziej aktualne informacje?” Świeżość staje się wyznacznikiem rzetelności. Jeśli pytasz o bieżące wydarzenia, trendy rynkowe czy nowe wyniki badań, artykuł sprzed miesiąca jest naturalnie bardziej wiarygodny niż tekst sprzed pięciu lat. To przewaga dla twórców, którzy regularnie aktualizują swoje strony.

Wzorce świeżości na poszczególnych platformach: Badania pokazują, że Gemini wykazuje najsilniejszą preferencję dla świeżych treści, z największą koncentracją cytowań z ostatnich 0–300 dni. Perplexity jest po środku, cytując mieszankę świeżych i umiarkowanie starych treści. OpenAI wykorzystuje najszerszy zakres wiekowy źródeł, ale również preferuje treści aktualne. Oznacza to, że strategia optymalizacji powinna uwzględniać, z jakich platform AI korzysta Twoja grupa docelowa.

Tematy wrażliwe na czas wymagają aktywnych aktualizacji: W przypadku tematów YMYL (Twoje Pieniądze lub Twoje Życie) — zdrowie, finanse, prawo — oraz branż dynamicznych świeżość jest obowiązkowa. Artykuł o regulacjach kryptowalut z 2021 r. rzadko będzie cytowany w odpowiedziach z 2025 r. Rozwiązaniem jest systematyczna aktualizacja treści: coroczna (a w szybko zmieniających się branżach kwartalna) aktualizacja statystyk, widoczne daty “ostatniej aktualizacji” i odświeżanie kluczowych danych. To sygnał zarówno dla AI, jak i ludzi, że Twoje treści są aktualne i wiarygodne.

Dane o uprzywilejowaniu aktualności: Analiza 21 412 adresów URL z możliwą do wydobycia datą publikacji pokazała, że na wszystkich platformach LLM cytowania kulminują między 0 a 300 dni od publikacji, by potem stopniowo maleć. Oznacza to, że pierwszy rok życia treści jest kluczowy dla widoczności w AI. Treści starsze niż trzy lata mają znacznie niższy wskaźnik cytowań, chyba że są wiecznie aktualne lub niedawno zaktualizowane.

LLM-y nie analizują bezpośrednio wyników autorytetu domeny, ale istnieje wyraźna korelacja między wysokim autorytetem domeny a częstotliwością cytowań. Analiza 1000 najczęściej cytowanych przez ChatGPT stron pokazuje jasny trend: AI preferuje strony o Domain Rating (DR) powyżej 60, a większość cytowań pochodzi z domen DR 80–100. Jest to jednak korelacja pośrednia — witryny o wysokim DR lepiej wypadają w wynikach wyszukiwania, a ponieważ LLM-y pobierają treści przez wyszukiwarki, częściej napotykają te autorytatywne źródła.

Pośredni efekt autorytetu: Relacja między autorytetem domeny a cytowaniami LLM działa tak: LLM-y korzystają z wyszukiwarek (lub podobnych systemów), by znaleźć treści. Strony o wysokim autorytecie lepiej się pozycjonują. W rezultacie częściej pojawiają się w wynikach pobieranych przez LLM-y. Nie chodzi o to, że LLM-y czytają Twój wynik DR; autorytet po prostu koreluje z widocznością w wyszukiwarce, a ta z szansą na cytowanie. To oznacza, że budowa tradycyjnego autorytetu SEO poprzez jakościowe backlinki wciąż ma wartość, nawet w świecie AI.

Semantyczne bogactwo jako nowy sygnał autorytetu: Poza metrykami domeny LLM-y rozpoznają autorytet przez bogactwo semantyczne — głębię i szerokość omówienia tematu. Strona, która wyczerpująco omawia zagadnienie, naturalnie wykorzystuje powiązane słowa kluczowe, opisuje podtematy i daje kontekst, sygnalizuje AI ekspertyzę. Np. artykuł o “korzyściach diety śródziemnomorskiej”, omawiający aspekty kulturowe, konkretne wyniki zdrowotne, porównania z innymi dietami i odpowiadający na typowe pytania, wykazuje większy autorytet semantyczny niż ogólny artykuł-lista.

Powiązania encji i autorytet tematyczny: LLM-y wykorzystują rozpoznawanie encji, by zrozumieć, jak Twoje treści wpisują się w szerszy graf wiedzy. Jeśli Twój artykuł o “Steve Jobsie” konsekwentnie łączy Apple, innowacje, przywództwo i projektowanie produktów, AI buduje pełniejszy obraz Twojego autorytetu. Dlatego strukturalne dane i schema markup są coraz ważniejsze — pomagają AI jasno zrozumieć powiązania tematyczne i encje.

Treści muszą odpowiadać na szerokie zapytania: Gdy LLM otrzymuje zapytanie użytkownika, często rozszerza je na wiele powiązanych wyszukiwań. Twoje treści powinny odpowiadać nie tylko na główne zapytanie, ale i na jego wariacje. Ktoś pyta “jak rozpoznać dojrzałego awokado” — LLM może też szukać “wskaźniki dojrzałości awokado”, “ile dojrzewa awokado”, “przechowywanie dojrzałego awokado”. Treści, które kompleksowo pokrywają te aspekty, mają większe szanse na cytowanie w różnych wariantach zapytań.

Optymalizacja E-E-A-T pod kątem cytowań przez LLM wymaga strategicznego, wielowarstwowego podejścia. Celem jest tworzenie treści pokazujących autentyczną ekspertyzę i ułatwiających AI rozpoznanie oraz wydobycie tej wiedzy. Oto praktyczne ramy działania:

1. Wyraźnie pokazuj kwalifikacje i ekspertyzę Bio autora powinno być rozbudowane i łatwe do zweryfikowania. Umieść konkretne kwalifikacje (certyfikaty, wykształcenie, tytuły zawodowe), lata doświadczenia i bezpośrednią znajomość tematu. Nie pisz tylko “ekspert marketingu” — napisz “CMO z 15-letnim doświadczeniem w marketingu B2B SaaS, w tym w HubSpot i Salesforce”. Ta konkretność pomaga LLM-om rozpoznać autentyczną ekspertyzę. Dodawaj bio autora do każdej treści i rozważ schema markup (Author schema), by kwalifikacje były czytelne dla maszyn.

2. Twórz oryginalne badania i dane Oryginalne badania to jeden z najsilniejszych sygnałów autorytetu. Gdy publikujesz dane niedostępne nigdzie indziej — wyniki ankiet, benchmarki, case studies — stajesz się źródłem pierwotnym. LLM-y cytują źródła pierwotne, bo dają wyjątkową wartość. Strona Ahrefs “How Much Does SEO Cost?” oparta o ankietę 439 osób to jeden z ich najczęściej cytowanych artykułów właśnie dlatego, że to oryginalne badanie. Klucz: transparentna metodologia i jasna liczebność próby.

3. Utrzymuj spójny autorytet na różnych platformach Twój autorytet nie ogranicza się już do Twojej strony. LLM-y analizują obecność na LinkedIn, w publikacjach branżowych, wystąpieniach, wzmiankach medialnych i innych miejscach. Dbaj o spójność informacji zawodowych, pozycji eksperckiej i przekazu na wszystkich kanałach. Gdy AI widzi Twoje nazwisko stale powiązane z niszą w wielu miejscach, wzmacnia to Twój autorytet.

4. Wdrażaj odpowiedni schema markup Schema markup czyni sygnały ekspertyzy czytelnymi dla maszyn. Użyj Article schema do oznaczania dat publikacji i autorów, FAQ schema dla treści z pytaniami, Author schema do powiązania kwalifikacji z treścią. Badania pokazują, że 36,6% fraz wywołuje featured snippets pochodzące ze schema markup, a te strukturalne dane pomagają LLM-om lepiej zrozumieć Twoje treści.

5. Buduj autorytet tematyczny poprzez klastry treści Zamiast publikować pojedyncze wpisy blogowe, twórz huby tematyczne pokazujące całościową wiedzę o danym zagadnieniu. Linkuj powiązane artykuły, wyczerpująco omawiaj podtematy i buduj sieć semantyczną, dowodząc, że opanowałeś temat z różnych stron. Takie klastry sygnalizują autorytet tematyczny wyszukiwarkom i LLM-om.

6. Systematycznie aktualizuj treści Świeżość to czynnik rankingowy zarówno dla Google, jak i LLM-ów. Wprowadź harmonogram przeglądania i aktualizacji ważnych stron co kwartał, odświeżaj statystyki co rok i umieszczaj widoczne daty “ostatniej aktualizacji”. To sygnał, że Twoje treści są na bieżąco i godne zaufania.

7. Cytuj autorytatywne źródła Odwołując się do innych wiarygodnych źródeł, budujesz sieć zaufania. Cytuj badania naukowe, raporty branżowe, uznanych ekspertów. To nie tylko wzmacnia Twoją wiarygodność, ale też pomaga LLM-om zrozumieć kontekst i rzetelność Twoich twierdzeń.

8. Bądź transparentny co do ograniczeń Prawdziwa ekspertyza to także świadomość własnych ograniczeń. Jeśli temat wykracza poza Twoją wiedzę — napisz to. Jeśli dane mają ograniczenia — zaznacz to. Taka transparentność buduje zaufanie zarówno u ludzi, jak i AI, które doceniają uczciwą, niuansową komunikację.

Zrozumieć E-E-A-T w teorii to jedno; zobaczyć, jak działa w praktyce, to drugie. Sprawdźmy, co sprawia, że niektóre treści są chętnie cytowane, i jak te zasady realizują się w realnych przykładach.

Anatomia treści chętnie cytowanych: Strona Ahrefs “How Much Does SEO Cost?” to modelowy przykład optymalizacji E-E-A-T pod cytowania LLM. Odpowiada bezpośrednio na popularne pytanie, opiera się na oryginalnych badaniach (ankieta 439 osób), ma wyraźną datę, rozbija ceny według różnych kryteriów (freelancerzy vs agencje, godzina vs abonament, różnice geograficzne). Treść jest czytelna — nagłówki, wizualizacje danych z opisem, wieloaspektowe omówienie tematu. Autor podaje kwalifikacje, a treść jest zrecenzowana przez eksperta — kolejny poziom zaufania.

Co sprawia, że treść jest cytowalna: Najchętniej cytowane treści mają cechy: odpowiadają konkretnie na pytania, bazują na weryfikowalnych danych lub oryginalnych badaniach, są czytelnie sformatowane, omawiają temat z różnych stron i pokazują autentyczną ekspertyzę głębią i niuansami. LLM, oceniając potencjalną cytację, de facto pyta: “Czy mogę wydobyć stąd jasną, poprawną odpowiedź? Czy źródło jest godne zaufania? Czy ta strona wnosi unikatową wartość?”

Strukturalne formatowanie jako sygnał cytowania: Treści z jasną hierarchią nagłówków, punktami, tabelami i krótkimi akapitami są częściej cytowane. To nie tylko kwestia czytelności dla człowieka — to ułatwienie ekstrakcji dla AI. LLM szybciej znajdzie kluczowe informacje w dobrze sformatowanym tekście. Porównaj ścianę tekstu z artykułem z H2, H3 i punktami: ta druga wersja jest wyraźnie bardziej cytowalna.

Wielowątkowe omawianie tematów: Treści pokazujące temat z różnych perspektyw zwiększają szanse na cytowanie. Np. artykuł o “produktywności pracy zdalnej” może omawiać produktywność różnych ról (deweloperzy, managerowie, obsługa klienta), stref czasowych, środowisk domowych i typów osobowości. Taka wieloaspektowość pozwala odpowiadać na wiele zapytań z jednego źródła, zwiększając potencjał cytowań.

Realne wzorce cytowań: Badanie SearchAtlas analizujące 90 000 cytowań w głównych LLM pokazuje, że cytowane treści pochodzą z domen o wysokim autorytecie, ale także od ekspertów niszowych z głęboką wiedzą. Odpowiedzi z Reddita czy artykuły na Substacku często pojawiają się w cytowaniach AI, nawet bez silnego profilu backlinków, bo pokazują autentyczną ekspertyzę i jasność wypowiedzi. To dowodzi, że autorytet to coraz częściej wykazana wiedza, a nie tylko metryki linków.

Budowa E-E-A-T to jedno; pomiar skuteczności to drugie. Tradycyjne metryki SEO, jak pozycje słów kluczowych czy liczba backlinków, nie oddają pełni Twojej widoczności w AI. Potrzebujesz nowych narzędzi i wskaźników dostosowanych do ery AI.

Testy manualne na platformach AI: Zacznij od własnych testów. Stwórz listę 10–20 pytań, na które Twoje treści powinny odpowiadać, i testuj je co miesiąc w ChatGPT, Perplexity, Claude i Gemini. Notuj cytowane źródła (Twoje i konkurencji), śledź zmiany w czasie i szukaj wzorców. Metoda czasochłonna, ale daje bezpośredni wgląd w to, co widzi Twój odbiorca. Wystarczy prosty Google Sheet do śledzenia wyników i trendów.

Analiza ruchu z AI w narzędziach analitycznych: Większość platform analitycznych śledzi już ruch z wyszukiwania AI jako osobny kanał. W Ahrefs Web Analytics (dostępne bezpłatnie w Ahrefs Webmaster Tools) ruch z AI jest już segmentowany, więc zobaczysz, które strony generują ruch z AI i jak zachowują się ci użytkownicy. Monitoruj wskaźniki jak czas na stronie, współczynnik odrzuceń, głębokość przewijania, konwersje. Obecnie ruch AI to mniej niż 1% całości, ale odwiedzający z AI często są bardziej zdecydowani i konwertują lepiej niż z tradycyjnego wyszukiwania.

Pomiar skuteczności E-E-A-T: Zamiast szukać bezpośrednich “punktów E-E-A-T”, śledź takie wskaźniki zastępcze: cytowania AI Overviews (monitoring przez BrightEdge, Authoritas), wolumen wyszukiwań markowych, wzmianki branżowe na różnych platformach, stabilność pozycji podczas aktualizacji algorytmów. Treści z silnymi sygnałami E-E-A-T zwykle wykazują mniejszą zmienność podczas core update’ów. Możesz też skorzystać z narzędzi typu LLM SEO E-E-A-T Score Checker, by uzyskać szczegółową analizę wyników w każdej kategorii.

Płatny monitoring na szeroką skalę: By monitor

E-E-A-T oznacza Doświadczenie, Ekspertyzę, Autorytet i Zaufanie. To ramy określające wiarygodność treści zarówno w tradycyjnych wyszukiwarkach, jak i systemach AI. LLM-y wykorzystują sygnały E-E-A-T, by zdecydować, które źródła cytować w odpowiedziach, co czyni je kluczowymi dla widoczności w AI.

LLM-y oceniają autorytet przez wzorce semantyczne, spójność między źródłami i wykazaną ekspertyzę, a nie przez backlinki. Rozpoznają autorytet językowo dzięki specjalistycznej terminologii, głębi logicznej i zakresowi tematycznemu. Oznacza to, że witryny o wysokim autorytecie nadal są częściej cytowane, ale głównie dlatego, że lepiej wypadają w wynikach wyszukiwania, z których LLM-y korzystają do pozyskiwania treści.

Tak. Choć większe strony mają przewagę, eksperci niszowi z mniejszą liczbą backlinków regularnie pojawiają się w cytowaniach LLM. Najważniejsze jest wykazanie autentycznej ekspertyzy w swojej dziedzinie przez bogactwo semantyczne, głębię tematyczną i spójną pozycję. Specjalistyczny blog z dużą wiedzą może wyprzedzić ogólne strony z większą liczbą backlinków.

E-E-A-T to strategia długoterminowa. Budowa autentycznych sygnałów autorytetu i zaufania zwykle trwa miesiące, nie tygodnie. Jednak wdrożenie odpowiedniego schema markup i przypisania autora może dać szybsze efekty. Pierwszy rok życia treści jest kluczowy dla widoczności AI, a wskaźnik cytowań spada znacząco po trzech latach, jeśli zawartość nie jest aktualizowana.

Backlinki pozostają wartościowymi sygnałami autorytetu, ale nie są już jedyną walutą. Strony o wysokim autorytecie są częściej cytowane przez LLM-y, lecz głównie dlatego, że lepiej wypadają w wynikach wyszukiwania. Kluczowy wniosek: backlinki wciąż mają znaczenie jako część większej układanki, która obejmuje teraz także autorytet semantyczny, świeżość i wykazaną ekspertyzę.

Śledź częstotliwość cytowań AI, różnorodność cytowań według tematów i platform, wyniki semantycznej trafności, wskaźniki świeżości i pokrycie domenowe z konkurencją. Wykorzystaj narzędzia jak Ahrefs Brand Radar do kompleksowego monitoringu w 150 milionach promptów lub testuj ręcznie swoje docelowe zapytania co miesiąc w ChatGPT, Perplexity, Claude i Gemini.

Nie, E-E-A-T nie jest bezpośrednim czynnikiem rankingowym. To ramy wpływające na ocenę jakości treści przez systemy AI. Optymalizacja pod E-E-A-T to tak naprawdę tworzenie autentycznie autorytatywnych, godnych zaufania treści z myślą o odbiorcach ludzkich. Korzyści pojawiają się pośrednio poprzez lepszą satysfakcję użytkowników i wzrost liczby cytowań.

Świeżość jest silnie premiowana przy wyborze cytowań przez LLM. Badania pokazują, że LLM-y cytują treści opublikowane w ciągu 300 dni znacznie częściej. W przypadku tematów wrażliwych na czas, artykuł z zeszłego miesiąca jest naturalnie bardziej godny zaufania niż tekst sprzed pięciu lat. Systematyczna aktualizacja treści i widoczne daty 'ostatniej aktualizacji' są niezbędne dla utrzymania widoczności w AI.

Śledź, jak Twoja marka jest cytowana przez ChatGPT, Perplexity, Google AI Overviews i inne LLM-y. Poznaj swoje sygnały E-E-A-T i zoptymalizuj widoczność w AI dzięki AmICited.

E-E-A-T (Doświadczenie, Ekspertyza, Autorytatywność, Wiarygodność) to framework Google do oceny jakości treści. Dowiedz się, jak wpływa na SEO, cytowania AI i w...

Poznaj E-E-A-T (Doświadczenie, Wiedza, Autorytatywność, Wiarygodność) i jego kluczowe znaczenie dla widoczności w wyszukiwarkach AI takich jak ChatGPT, Perplexi...

Dowiedz się, jak cytaty ekspertów zwiększają widoczność Twojej marki w wyszukiwarkach AI, takich jak ChatGPT i Perplexity. Odkryj strategie zdobywania cytowań i...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.