Jak zapobiec utracie widoczności treści w wyszukiwarkach AI

Poznaj sprawdzone strategie utrzymania i poprawy widoczności Twoich treści w odpowiedziach generowanych przez AI w ChatGPT, Perplexity i Google AI Overviews. Do...

Dowiedz się, jak instytucje rządowe mogą zoptymalizować swoją obecność cyfrową dla systemów AI takich jak ChatGPT i Perplexity. Poznaj strategie poprawy widoczności w AI, zapewnienia przejrzystości oraz odpowiedzialnego wdrażania AI w sektorze publicznym.

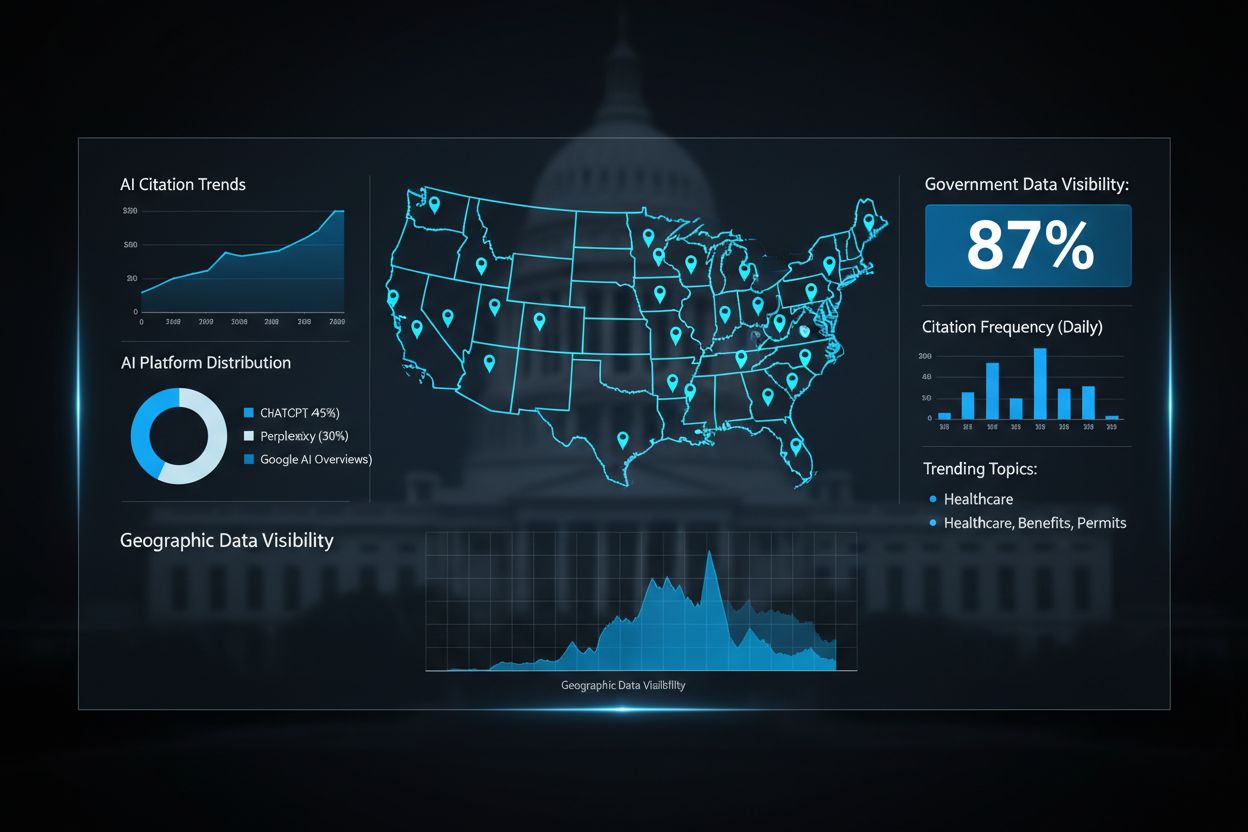

Widoczność AI rządu odnosi się do tego, w jakim stopniu systemy sztucznej inteligencji — w tym GPT, Perplexity i Google AI Overviews — mogą odkrywać, uzyskiwać dostęp i cytować dane oraz zasoby rządowe odpowiadając na pytania obywateli. Ta widoczność jest kluczowa, ponieważ agencje rządowe dysponują wiarygodnymi informacjami na temat wszystkiego, od przepisów zdrowotnych po usługi społeczne, jednak znaczna część tych danych pozostaje niewidoczna dla nowoczesnych systemów AI. Gdy obywatele pytają asystentów AI o programy, świadczenia czy politykę rządu, zasługują na dokładne, aktualne odpowiedzi pochodzące z oficjalnych źródeł, a nie niepełne lub nieaktualne informacje. Zaufanie publiczne do rządu zależy od tego, czy systemy AI właściwie odwołują się do danych rządowych i przypisują je, dbając o integralność oficjalnych informacji w coraz bardziej zdominowanym przez AI krajobrazie informacyjnym. Przejrzystość AI staje się filarem demokratycznego zarządzania, gdy obywatele mogą zweryfikować, że rekomendacje AI opierają się na uznanych źródłach rządowych. AmICited.com pełni rolę kluczowej platformy monitorującej, która śledzi, jak dane rządowe są cytowane i przywoływane w głównych systemach AI, pomagając agencjom zrozumieć ich widoczność i wpływ w ekosystemie AI. Dzięki zapewnieniu przejrzystości cytowań rządowych przez AI, organizacje sektora publicznego mogą lepiej służyć obywatelom i zachować autorytet nad własnymi informacjami.

Agencje rządowe nadal borykają się z silosami danych powstałymi w wyniku dekad fragmentarycznych inwestycji IT, gdzie kluczowe informacje pozostają zamknięte w niekompatybilnych systemach legacy, które nie mogą łatwo komunikować się z nowoczesnymi platformami AI. Te przestarzałe systemy były projektowane z myślą o tradycyjnych interfejsach internetowych i zarządzaniu dokumentami, a nie o semantycznym rozumieniu i dostępie do danych w czasie rzeczywistym, których wymagają systemy AI. Koszt tej technologicznej fragmentacji jest ogromny: organizacje marnują około 140 miliardów dolarów rocznie na niewykorzystanych korzyściach wynikających z przestarzałych procesów, które można by usprawnić dzięki integracji AI. Poza stratami efektywności systemy legacy stwarzają poważne zagrożenia bezpieczeństwa, gdy dane rządowe muszą być ręcznie wyodrębniane i udostępniane publicznym systemom AI, zwiększając ryzyko wycieków i nieautoryzowanego dostępu. Problem pogłębia fakt, że wiele stron rządowych nie posiada oznaczeń danych strukturalnych, metadanych ani infrastruktury API niezbędnej do prawidłowego indeksowania i rozumienia informacji przez roboty AI.

| Tradycyjne IT rządu | Infrastruktura gotowa na AI |

|---|---|

| Scentralizowane bazy z ograniczoną interoperacyjnością | Zintegrowane platformy danych z API i formatami strukturalnymi |

| Ręczne procesy ekstrakcji i udostępniania danych | Zautomatyzowane, bezpieczne przepływy danych |

| Niestrukturalizowane dokumenty i PDF-y | Standardy sieci semantycznej i formaty maszynowe |

| Reaktywne działania bezpieczeństwa | Prywatność w fazie projektowania i ciągły monitoring |

| Ograniczony dostęp do danych w czasie rzeczywistym | Strumienie danych live i dynamiczna prezentacja treści |

Zamiast pośpiesznego wdrażania technologii AI, skuteczne organizacje rządowe realizują strategiczną, etapową mapę wdrożenia, która przedkłada planowanie i gotowość organizacyjną nad możliwości technologiczne. Takie podejście uwzględnia, że wdrożenie AI w sektorze publicznym wymaga starannej koordynacji wielu grup interesariuszy — od działów IT, przez pracowników liniowych, po samych obywateli.

Pięć kroków wdrożenia AI w rządzie:

Identyfikacja strategicznych możliwości: Przeprowadzenie audytów działań rządu w celu wskazania obszarów, gdzie AI może przynieść wymierną wartość publiczną, np. skrócenie czasu rozpatrywania wniosków, poprawa dostępności usług czy wsparcie decyzji opartych na danych.

Kompleksowe przygotowanie: Ocena obecnej infrastruktury danych, identyfikacja problemów z integracją systemów legacy, ustanowienie ram zarządzania i rozwijanie kompetencji AI w całej organizacji przed rozpoczęciem wdrożenia technologicznego.

Projektowanie pilotaży: Uruchamianie kontrolowanych pilotaży w wybranych działach lub obszarach usług z jasno określonymi wskaźnikami sukcesu, aby zespoły mogły uczyć się na prawdziwych wyzwaniach wdrożeniowych w środowisku o niskim ryzyku przed skalowaniem.

Zarządzanie zmianą organizacyjną: Opracowanie programów szkoleniowych, adresowanie obaw pracowników dotyczących utraty pracy, ustanowienie jasnych kanałów komunikacji i mechanizmów informacji zwrotnej, aby pracownicy i interesariusze czuli się wysłuchani w trakcie transformacji.

Pomiar wpływu: Ustalenie wskaźników KPI zgodnych z celami rządu, ciągłe monitorowanie wydajności systemów AI, badanie satysfakcji obywateli, mierzenie oszczędności kosztów i dostosowywanie strategii wdrożeniowych na podstawie dowodów.

To podejście „technologia na drugim miejscu” zapewnia, że wdrożenia AI odpowiadają na prawdziwe potrzeby publiczne, a nie stają się kosztownymi rozwiązaniami szukającymi problemów.

Etyczne zarządzanie AI stało się niezbędne, ponieważ rządy na całym świecie uznają, że systemy AI podejmujące decyzje dotyczące obywateli muszą działać w jasnych ramach etycznych i prawnych. Kanadyjskie Ramowe Oceny Wpływu Algorytmicznego stanowią praktyczny model, kategoryzując systemy AI na cztery poziomy wpływu — minimalny, umiarkowany, wysoki i bardzo wysoki — z odpowiednimi wymaganiami nadzoru i zarządzania na każdym poziomie. Takie podejście umożliwia rządom proporcjonalne alokowanie zasobów, stosując rygorystyczną kontrolę wobec kluczowych systemów, jak algorytmy wymiaru sprawiedliwości, jednocześnie utrzymując rozsądny nadzór nad aplikacjami niższego ryzyka. Estonia wdrożyła zasadę prywatności na etapie projektowania poprzez system Data Tracker, monitorujący cały dostęp do danych rządowych w infrastrukturze cyfrowej, dając 450 000 obywateli pełną przejrzystość, które agencje mają dostęp do ich danych i w jakim celu. Odpowiedzialność algorytmiczna wymaga od agencji rządowych dokumentowania sposobu podejmowania decyzji przez systemy AI, tworzenia ścieżek audytu i utrzymania możliwości wyjaśniania rekomendacji obywatelom. AmICited.com odgrywa istotną rolę w tym systemie przejrzystości, monitorując sposób cytowania i przywoływania danych rządowych w publicznych systemach AI, pomagając agencjom zweryfikować, czy ich informacje są reprezentowane i przypisywane właściwie. Bez solidnych ram monitorowania i zarządzania systemy AI rządu mogą podkopywać zaufanie społeczne i utrwalać uprzedzenia dotykające szczególnie grup zagrożonych wykluczeniem.

Rządy na całym świecie udowadniają, że przemyślane wdrożenie AI przynosi wymierną wartość publiczną. Australijski Departament Spraw Wewnętrznych wdrożył system Targeting 2.0, oparty na AI, który poprawił bezpieczeństwo granic i wykrywanie oszustw, zapobiegając szkodom rzędu 3 miliardów AUD, a jednocześnie skracając czas obsługi legalnych podróżnych i wnioskodawców. Czatbot National Highways w Wielkiej Brytanii pokazuje, jak AI może poprawić obsługę obywateli, obsługując rutynowe zapytania o warunki na drogach i wypadki, uwalniając pracowników do sytuacji wymagających ludzkiej oceny i empatii. Estońska platforma Bürokratt to zdecentralizowane, zgodne z RODO podejście do AI w rządzie, umożliwiające obywatelom realizację rutynowych spraw urzędowych z pomocą AI, przy zachowaniu ścisłej ochrony danych i zapewnieniu, że decyzje o dużym znaczeniu pozostają pod kontrolą człowieka. Podejście do zarządzania AI w Maryland wyznaczyło jasne struktury odpowiedzialności i regularne audyty systemów AI w rządzie stanowym, tworząc model przyjmowany przez inne stany USA. Japońska Agencja Cyfrowa z powodzeniem zdigitalizowała konsultacje dotyczące dzieci z użyciem AI, skracając czas oczekiwania z tygodni do godzin, przy zachowaniu nadzoru człowieka w skomplikowanych sprawach. Te różnorodne przykłady pokazują, że sukces AI w rządzie zależy nie od zaawansowania technologicznego, lecz od przemyślanego wdrażania, które stawia potrzeby obywateli, przejrzystość i nadzór człowieka na pierwszym miejscu.

W miarę jak systemy AI stają się głównym interfejsem dostępu do informacji przez obywateli, optymalizacja stron rządowych pod kątem wykrywalności przez AI staje się równie ważna jak tradycyjne SEO. Strony rządowe muszą wdrażać oznaczenia danych strukturalnych, rozbudowane metadane i formaty do odczytu maszynowego, by roboty AI mogły zrozumieć i poprawnie indeksować informacje rządowe, zapewniając obywatelom dokładne, wiarygodne odpowiedzi na pytania o usługi publiczne. Obecnie wiele stron rządowych prezentuje informacje w formatach zoptymalizowanych pod kątem ludzi — PDF-ach, niestrukturalnym tekście i złożonych hierarchiach nawigacji — które są trudne do analizy i zrozumienia przez AI. REI Systems prowadzi pionierskie prace nad optymalizacją stron federalnych pod kątem dostępności dla AI, pokazując, że stosunkowo proste ulepszenia techniczne mogą znacznie zwiększyć widoczność rządu w odpowiedziach AI. AmICited.com monitoruje widoczność AI rządu na głównych platformach, pomagając agencjom zrozumieć, jak często ich informacje pojawiają się w odpowiedziach AI i wskazując luki, gdzie dane rządowe powinny być bardziej wykrywalne. Wdrażając standardy sieci semantycznej, infrastrukturę API i funkcje dostępności, strony rządowe zwiększają szansę, że AI będzie cytować oficjalne źródła, a nie wtórne lub nieaktualne informacje. Optymalizacja ta daje obywatelom dostęp do wiarygodnych informacji ze źródeł rządowych, a agencjom pozwala kontrolować, jak ich dane są prezentowane i interpretowane.

Pomiar wpływu AI w rządzie wymaga ustalenia jasnych wskaźników KPI zgodnych z celami sektora publicznego, wykraczających poza proste miary efektywności, by objąć szerokie aspekty satysfakcji obywateli, równości i odpowiedzialności demokratycznej. Estoński model oceny stanowi praktyczne rozwiązanie, analizując inicjatywy AI w czterech wymiarach: efektywność czasu (ile czasu pracowników zaoszczędzono), opłacalność (zwrot z inwestycji), potencjał innowacyjny (czy system umożliwia nowe modele usług) oraz mierzalny wpływ (wymierna poprawa wyników dla obywateli). Systematyczny pomiar pozwala agencjom rządowym zidentyfikować, które aplikacje AI przynoszą realną wartość publiczną, a które wymagają korekty lub wycofania, zapobiegając marnotrawieniu środków na technologie nie służące obywatelom. Dzielenie się wiedzą między agencjami przyspiesza naukę, umożliwiając wdrażanie udanych rozwiązań z jednej jednostki w innych obszarach administracji, co zwielokrotnia zwrot z początkowych inwestycji w AI. Ciągłe doskonalenie i systemy monitoringu — wspierane przez narzędzia takie jak AmICited.com, śledzące widoczność AI i wzorce cytowań — pozwalają agencjom doskonalić systemy AI na podstawie rzeczywistych danych, a nie założeń. Budowanie wiedzy instytucjonalnej o tym, co działa w AI rządu, tworzy fundament dla trwałego wdrażania, odpornego na zmiany kadrowe i cykle budżetowe.

Pomimo oczywistych korzyści, agencje rządowe stoją przed poważnymi barierami we wdrażaniu AI, które wykraczają daleko poza wyzwania technologiczne. Obawy pracowników stanowią istotną przeszkodę — 31% pracowników rządowych wskazuje bezpieczeństwo zatrudnienia jako główny niepokój związany z AI, co wymaga przejrzystej komunikacji o tym, jak AI będzie wspierać, a nie zastępować ludzi. Niedobór talentów pogłębia ten problem — 38% organizacji rządowych wskazuje trudności z rekrutacją specjalistów AI zdolnych wdrażać i utrzymywać zaawansowane systemy. Niedoszacowanie kosztów to kolejna bariera — agencje rządowe często odkrywają, że rzeczywiste koszty wdrożenia AI są 5-10 razy wyższe niż początkowe szacunki, co nadwyręża budżety i budzi opór polityczny wobec dalszych inwestycji. Obawy dotyczące prywatności i bezpieczeństwa danych są najważniejszą przeszkodą — 60% liderów rządowych wskazuje je jako główną barierę wdrożenia AI, co odzwierciedla realne obawy o ochronę danych obywateli w czasach rosnących zagrożeń cybernetycznych. Skuteczne strategie zarządzania zmianą muszą bezpośrednio adresować te bariery poprzez zaangażowanie interesariuszy, przejrzystą komunikację o możliwościach i ograniczeniach AI, inwestycje w szkolenia i rozwój pracowników oraz jasne ramy zarządzania chroniące prywatność obywateli przy równoczesnym wspieraniu innowacji. Agencje rządowe, które skutecznie pokonują te przeszkody, zwykle inwestują intensywnie w zarządzanie zmianą, tworzą jasne kanały komunikacji z pracownikami i obywatelami oraz prezentują szybkie sukcesy budujące zaufanie do systemów AI przed wdrożeniem ich w krytycznych obszarach.

Widoczność AI rządu odnosi się do tego, jak łatwo systemy AI takie jak ChatGPT, Perplexity czy Google AI Overviews mogą odkrywać i cytować dane rządowe. Jest to ważne, ponieważ obywatele zasługują na dokładne, wiarygodne informacje pochodzące z oficjalnych źródeł rządowych, gdy pytają asystentów AI o polityki, świadczenia i usługi. Niska widoczność oznacza, że systemy AI mogą podawać nieaktualne lub niepełne informacje zamiast kierować obywateli do oficjalnych zasobów rządowych.

Strony rządowe powinny wdrażać oznaczenia danych strukturalnych, rozbudowane metadane, formaty do odczytu maszynowego oraz odpowiednią infrastrukturę API. Obejmuje to stosowanie standardów sieci semantycznej, zapewnienie dostępu treści dla robotów AI oraz organizację informacji w taki sposób, aby systemy AI mogły je łatwo zrozumieć i prawidłowo przypisać do oficjalnych źródeł rządowych.

Główne bariery to obawy dotyczące prywatności i bezpieczeństwa danych (wskazywane przez 60% liderów rządowych), niedobór talentów (38%), obawy pracowników związane z utratą pracy (31%), niedoszacowanie kosztów (rzeczywiste koszty często są 5-10 razy wyższe niż prognozowane) oraz niewystarczająca infrastruktura cyfrowa (45%). Pokonanie tych barier wymaga strategicznego planowania, zarządzania zmianą i jasnych ram zarządzania.

Skuteczne podejścia to m.in. ustanowienie ram oceny wpływu algorytmicznego (jak kanadyjski system warstwowy), wdrożenie zasad prywatności na etapie projektowania, tworzenie mechanizmów przejrzystości umożliwiających obywatelom monitorowanie dostępu do danych, ustanowienie jasnych ram zarządzania oraz utrzymanie nadzoru człowieka nad decyzjami o dużym znaczeniu. Regularne audyty i zaangażowanie interesariuszy są kluczowe.

Plan obejmuje: (1) Identyfikację strategicznych możliwości skupioną na wartości publicznej, (2) Kompleksowe przygotowanie infrastruktury i zarządzania, (3) Projektowanie strategicznych pilotaży z jasno określonymi wskaźnikami sukcesu, (4) Zarządzanie zmianą organizacyjną uwzględniające obawy pracowników oraz (5) Pomiar wpływu i ciągłe doskonalenie. Takie podejście stawia na pierwszym miejscu planowanie i gotowość organizacyjną, a nie wdrożenie technologii za wszelką cenę.

Rządy powinny ustalać wskaźniki KPI zgodne z celami sektora publicznego, obejmujące efektywność czasu, opłacalność, potencjał innowacyjny i mierzalne rezultaty obywatelskie. Estoński model ocenia systemy AI w tych czterech wymiarach. Ciągły monitoring, opinie interesariuszy i przejrzyste raportowanie pomagają agencjom identyfikować skuteczne rozwiązania i dostosowywać wdrożenia na podstawie dowodów.

Zarządzanie danymi jest podstawą skutecznej AI rządowej. Zapewnia jakość danych, wyznacza jasnych właścicieli i kontrolę dostępu, chroni prywatność obywateli, utrzymuje zgodność z przepisami takimi jak RODO i umożliwia bezpieczne udostępnianie między systemami. Bez solidnego zarządzania danymi systemy AI rządu narażone są na wycieki danych, uprzedzenia i utratę zaufania społecznego.

AmICited śledzi, jak dane rządowe są cytowane i przywoływane w głównych systemach AI, w tym ChatGPT, Perplexity i Google AI Overviews. Pomaga agencjom rządowym zrozumieć ich widoczność w ekosystemie AI, wskazać luki tam, gdzie oficjalne informacje powinny być bardziej widoczne, oraz zapewnić prawidłowe przypisanie danych rządowych przez systemy AI. To monitorowanie wspiera przejrzystość i odpowiedzialność.

Śledź, w jaki sposób dane rządowe są cytowane i przywoływane w systemach AI. AmICited pomaga organizacjom sektora publicznego zrozumieć ich widoczność w ekosystemie AI i zapewnić prawidłową reprezentację oficjalnych informacji.

Poznaj sprawdzone strategie utrzymania i poprawy widoczności Twoich treści w odpowiedziach generowanych przez AI w ChatGPT, Perplexity i Google AI Overviews. Do...

Dowiedz się, jak wdrożyć skuteczne polityki zarządzania treściami AI z wykorzystaniem ram widoczności. Poznaj wymogi regulacyjne, najlepsze praktyki i narzędzia...

Dowiedz się, jak przeprowadzić bazowy audyt widoczności AI, aby zrozumieć, jak ChatGPT, Google AI i Perplexity wspominają o Twojej marce. Przewodnik krok po kro...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.