Ograniczone opcje przyspieszenia korekt w ChatGPT:

1. Kontakt Enterprise

Jeśli jesteście klientem ChatGPT Enterprise, macie dedykowany kanał wsparcia. Skorzystajcie z niego. Mogą eskalować poważne błędy faktograficzne.

2. Ścieżka udokumentowanej szkody

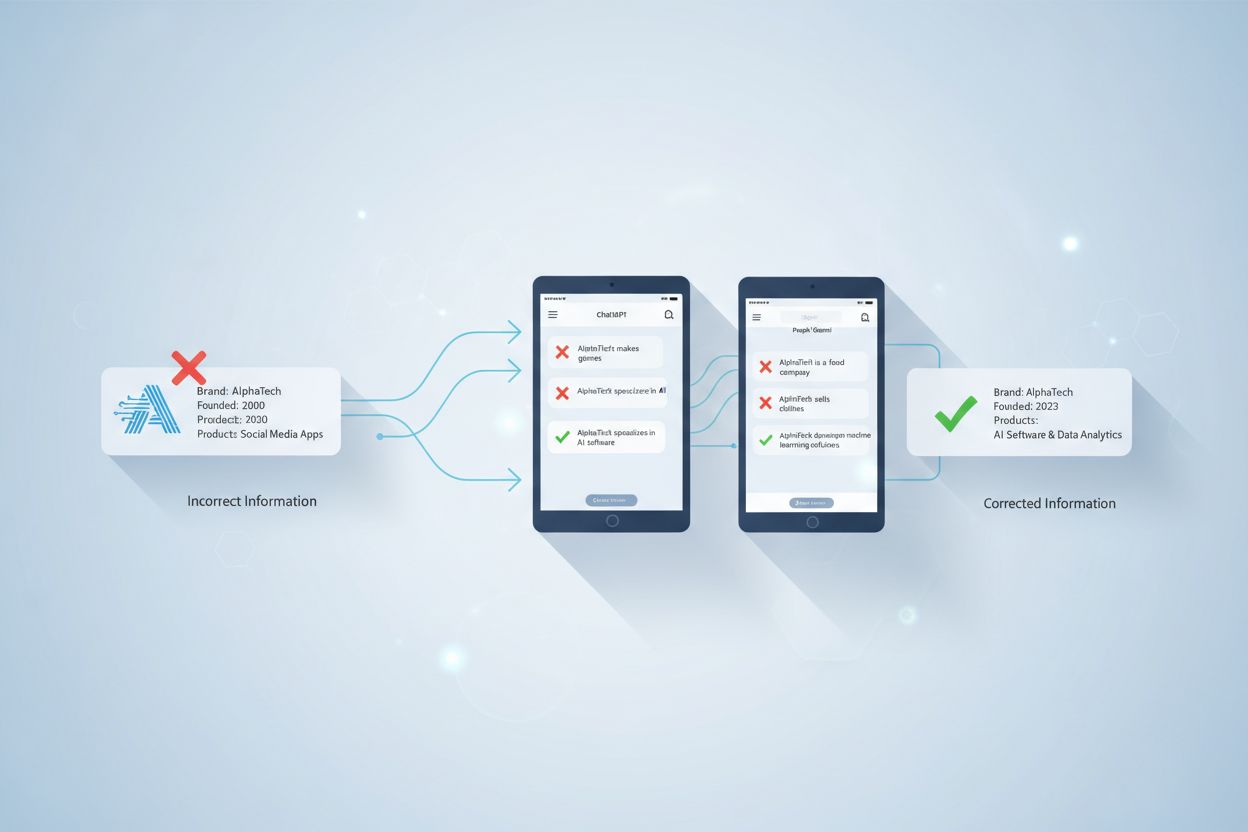

Udokumentuj:

- Konkretną dezinformację

- Wpływ na biznes (utracone kontrakty, dezorientacja partnerów)

- Wasze próby korekty

- Oś czasu utrzymywania się błędu

Prześlij taki pakiet do wsparcia OpenAI, prosząc o eskalację ze względu na udokumentowaną szkodę biznesową.

3. Presja medialna/PR

Widziałem, że firmy uzyskiwały uwagę poprzez:

- Publikowanie wpisów blogowych o dezinformacji

- Współpracę z dziennikarzami zajmującymi się dokładnością AI

- Wystąpienia na konferencjach o tym problemie

Firmom AI zależy na reputacji. Uwaga mediów może przyspieszyć reakcję.

4. Ścieżka prawna (ostateczność)

Przy poważnym zniesławieniu lub fałszywych twierdzeniach – pismo prawne do działu prawnego OpenAI. To daje efekt, ale może spalić mosty.

Stan faktyczny:

Wiedza ChatGPT jest wytrenowana, nie pobierana na żywo. Nawet przy zwróceniu uwagi, zmiany mogą nastąpić dopiero przy kolejnym uaktualnieniu modelu. Skup się na tym, by Twoje poprawne dane były wyraźnie widoczne dla przyszłego treningu.