Dlaczego moja marka nie pojawia się w odpowiedziach AI: Kompletny przewodnik

Dowiedz się, dlaczego Twoja marka nie pojawia się w ChatGPT, Perplexity, Google AI Overviews i Claude. Poznaj 5 kluczowych czynników i sposoby ich naprawy.

Dowiedz się, jak zrównoważyć widoczność marki w odpowiedziach AI z ochroną treści. Poznaj strategie monitorowania wzmianek AI, ochrony własności intelektualnej oraz utrzymania zaufania klientów przy jednoczesnym maksymalizowaniu obecności w ChatGPT, Perplexity i innych platformach AI.

Zrównoważ widoczność i ochronę treści, wdrażając wielowarstwową strategię łączącą zabezpieczenia techniczne, takie jak DRM i znakowanie wodne, z transparentnymi zasadami przetwarzania danych, pozyskiwaniem danych pierwszej strony oraz narzędziami monitorującymi. Dzięki temu Twoja marka pojawia się w odpowiedziach AI, zachowując kontrolę nad wykorzystaniem treści i chroniąc dane klientów przed nieautoryzowanym dostępem.

Współczesny krajobraz cyfrowy stawia przed markami fundamentalne wyzwanie: musisz być widoczny tam, gdzie szukają Twoi klienci, ale jednocześnie musisz chronić swoją własność intelektualną i dane klientów przed nadużyciami. Napięcie to znacząco wzrosło wraz z pojawieniem się wyszukiwarek i generatorów odpowiedzi opartych na AI, takich jak ChatGPT, Perplexity czy Google AI Overviews. Te platformy generują obecnie znaczący ruch na stronach internetowych — niektóre firmy odnotowują ponad 1% wszystkich sesji pochodzących z AI — ale jednocześnie tworzą nowe ryzyka kradzieży treści i zniekształcenia wizerunku marki. Kluczem do sukcesu nie jest wybór pomiędzy widocznością a ochroną, lecz wdrożenie strategicznego, wielowarstwowego podejścia, które pozwala osiągnąć oba cele jednocześnie.

Widoczność w odpowiedziach AI stała się tak samo kluczowa jak pozycjonowanie w tradycyjnych wyszukiwarkach. Gdy użytkownicy pytają platformy AI o Twoją branżę, kategorię produktów lub konkretne problemy, które rozwiązujesz, Twoja marka albo pojawi się w odpowiedzi, albo nie. Jeśli jesteś niewidoczny, potencjalni klienci trafiają do konkurencji. Osiągnięcie tej widoczności wymaga jednak publikowania treści, do których systemy AI mają dostęp i mogą je cytować — co zwiększa ryzyko. Twoje treści mogą zostać opublikowane bez przypisania autorstwa, informacje zastrzeżone mogą zostać wyodrębnione i ponownie użyte, a marka zniekształcona w odpowiedziach AI. Stawka jest wysoka: marki, które opanują tę równowagę, zyskują udział w rynku trudny do odzyskania dla konkurencji, a te, które ją ignorują, mierzą się zarówno z lukami w widoczności, jak i podatnością na utratę ochrony.

Pierwsza warstwa Twojej strategii to zabezpieczenia techniczne, które pozwalają publikować treści dla widoczności w AI, zachowując kontrolę nad ich wykorzystaniem. Technologia Digital Rights Management (DRM) jest kluczowa dla ochrony treści wideo, kursów online i zastrzeżonych materiałów szkoleniowych. Systemy DRM kontrolują dostęp, zapobiegają nieautoryzowanemu kopiowaniu i blokują nagrywanie ekranu — typowe metody wykorzystywane przez piratów do kradzieży treści. Publikując treści dostępne dla AI, DRM zapewnia, że tylko upoważnieni użytkownicy mają dostęp do pełnej, niechronionej wersji. Dla dokumentów i plików PDF szyfrowanie oraz DRM na poziomie dokumentu zapewniają podobną ochronę, umożliwiając udostępnianie treści określonym odbiorcom i zapobiegając ich dalszemu rozpowszechnianiu.

Znakowanie wodne pełni funkcję zarówno odstraszającą, jak i śledzącą. Widoczne znaki wodne z logo lub brandingiem przypominają użytkownikom o właścicielu treści i zniechęcają do przypadkowego udostępniania. Niewidoczne znaki wodne — tzw. fingerprinting — osadzają unikalne identyfikatory powiązane z konkretnym użytkownikiem lub znacznikiem czasu. Jeśli Twoje treści pojawią się na nieautoryzowanych platformach, znak wodny wskaże dokładnie, które konto użytkownika dopuściło się wycieku, umożliwiając podjęcie działań. Dynamiczne znakowanie wodne, zmieniające się w zależności od tożsamości odbiorcy, jest szczególnie skuteczne, ponieważ każda kopia jest unikalna i możliwa do wyśledzenia. Dzięki takiemu podejściu możesz swobodnie publikować treści dla widoczności w AI, zachowując możliwość identyfikowania i zatrzymywania nieautoryzowanej dystrybucji.

Szyfrowanie zabezpiecza dane podczas transmisji i przechowywania, uniemożliwiając przechwycenie lub nieautoryzowany dostęp. Publikując treści, do których będą mieć dostęp systemy AI, szyfrowanie gwarantuje, że wrażliwe informacje zawarte w tych treściach pozostaną chronione. Jest to szczególnie ważne dla treści zawierających zastrzeżone metodyki, dane klientów lub informacje o konkurencji. Szyfrując wrażliwe fragmenty lub wymagając uwierzytelnienia do uzyskania pełnego dostępu, możesz publikować wystarczająco dużo informacji, by AI cytowało Twoją markę, jednocześnie chroniąc najcenniejszą własność intelektualną.

Podczas gdy zabezpieczenia techniczne chronią Twoje treści, strategie marketingowe zorientowane na prywatność chronią klientów i budują zaufanie. Wyzwanie polega na tym, że wiele marek zbiera obszerne dane klientów w celu personalizacji działań marketingowych i zwiększania widoczności, co wiąże się z ryzykiem naruszenia prywatności i karami regulacyjnymi. Rozwiązaniem jest pozyskiwanie danych pierwszej strony — zbieranie informacji bezpośrednio od klientów poprzez ankiety, subskrypcje e-mail, interakcje na stronie i mechanizmy wyrażania zgody, zamiast polegać na zewnętrznych plikach cookie czy brokerach danych.

Dane pierwszej strony są bardziej wiarygodne, zgodne z regulacjami takimi jak RODO i CCPA, oraz cenniejsze, bo pochodzą bezpośrednio od odbiorców. Pozyskując je w sposób przejrzysty, klienci dokładnie wiedzą, jakie informacje są zbierane i w jakim celu. To buduje zaufanie i zmniejsza ryzyko wycieku danych lub ich nadużycia. Następnie możesz wykorzystać te dane, by poprawić widoczność w odpowiedziach AI, rozumiejąc, o co pytają Twoi klienci i tworząc treści odpowiadające tym potrzebom — bez inwazyjnego śledzenia czy udostępniania danych.

Przejrzyste zasady przetwarzania danych są równie istotne. Polityka prywatności powinna jasno wyjaśniać, jakie dane zbierasz, jak je wykorzystujesz, jak długo przechowujesz i jakie prawa mają klienci do dostępu czy usunięcia swoich danych. Uczyń te zasady łatwo dostępnymi i zrozumiałymi — unikaj żargonu prawnego, który zaciera rzeczywiste praktyki. Kiedy klienci widzą, że jesteś transparentny w kwestii danych, chętniej dzielą się informacjami, co faktycznie zwiększa Twoją zdolność do tworzenia celowanych, wartościowych treści wspierających widoczność w AI. To tworzy efekt synergii: przejrzystość buduje zaufanie, zaufanie pozwala lepiej zbierać dane, a lepsze dane umożliwiają skuteczniejsze strategie widoczności.

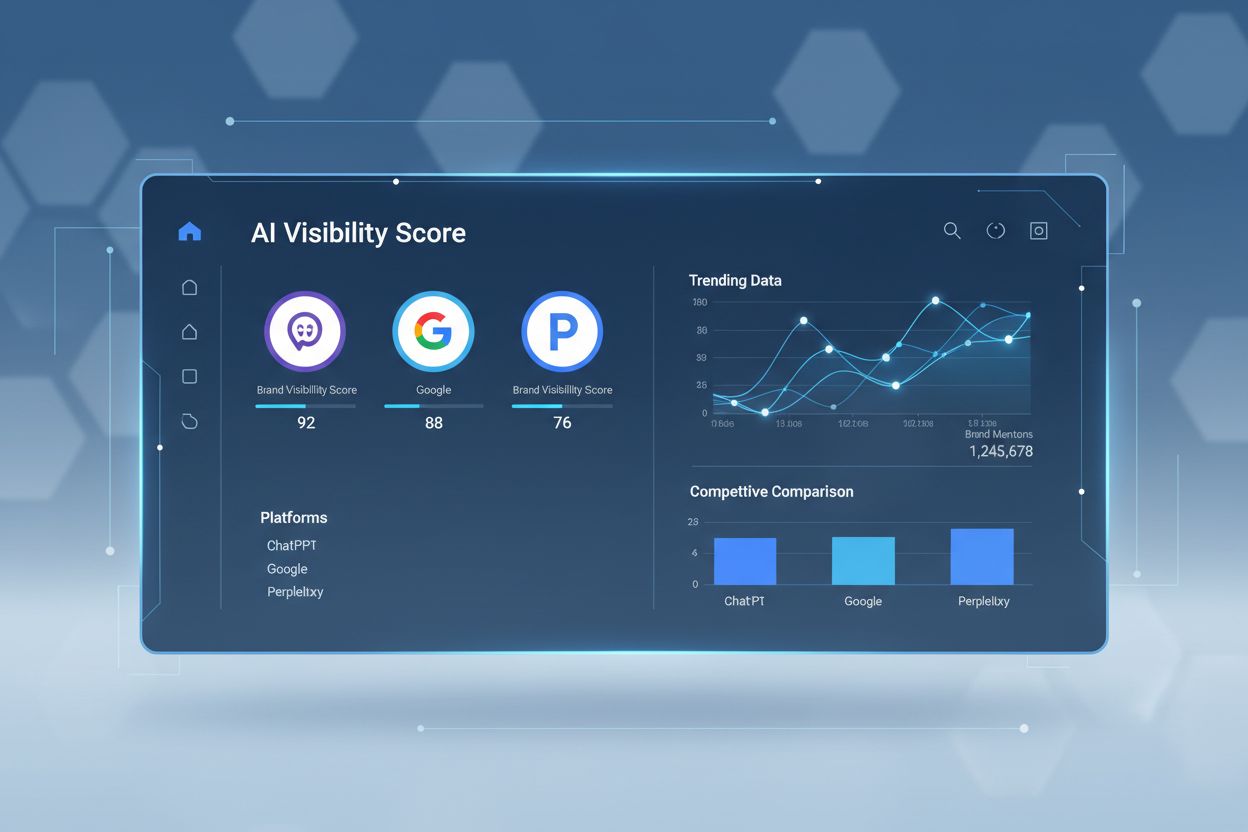

Monitorowanie w czasie rzeczywistym tego, jak Twoja marka pojawia się w odpowiedziach AI, jest kluczowe dla utrzymania zarówno widoczności, jak i ochrony. W przeciwieństwie do tradycyjnych wyszukiwarek, gdzie możesz ręcznie sprawdzić pozycje, platformy AI aktualizują się nieustannie i generują odpowiedzi dynamicznie na podstawie zapytań użytkowników. Potrzebujesz specjalistycznych narzędzi śledzących wzmianki o marce na wielu platformach AI, monitorujących kontekst wzmianek oraz identyfikujących, kiedy Twoje treści są cytowane lub zniekształcane.

| Wymiar monitorowania | Co śledzić | Dlaczego to ważne |

|---|---|---|

| Częstotliwość wzmianek | Jak często marka pojawia się w odpowiedziach AI na różnych platformach | Ujawnia luki w widoczności i możliwości poprawy |

| Kontekst cytowania | Czy jesteś wymieniany jako lider, alternatywa czy przypis | Określa, czy wzmianki AI generują wartościowy ruch, czy dezorientują klientów |

| Przypisanie źródła | Które treści są cytowane przez AI | Pokazuje, jakie typy treści i tematy są preferowane przez platformy AI |

| Pozycjonowanie konkurencyjne | Jakie marki pojawiają się obok Twojej w odpowiedziach | Wskazuje możliwości rynkowe i zagrożenia konkurencyjne |

| Sentiment i dokładność | Jak marka jest opisywana i czy informacje są aktualne | Pozwala wychwycić zniekształcenia lub nieaktualne dane zanim zaszkodzą wizerunkowi |

| Korelacja z ruchem | Czy wzrost widoczności AI przekłada się na wizyty na stronie | Udowadnia ROI i wskazuje priorytety optymalizacji |

Różne platformy AI preferują różne źródła. ChatGPT stawia na Wikipedię, Reddit i Forbes. Perplexity wybiera Reddit, YouTube i Gartnera. Google AI Overviews cytuje Reddit, YouTube i Quorę. Tylko około 50% cytowań AI pokrywa się z wynikami tradycyjnego Google, co oznacza, że sama strategia SEO nie zapewni widoczności w AI. Potrzebujesz monitoringu specyficznego dla platform, by wiedzieć, gdzie jesteś obecny, a gdzie nie. Narzędzia aktualizujące się co najmniej raz dziennie – najlepiej co cztery godziny – są niezbędne, ponieważ platformy AI nieustannie zmieniają algorytmy i dane treningowe. Zmiana strategii treści u konkurencji czy aktualizacja algorytmu platformy może wpłynąć na Twoją widoczność w ciągu kilku godzin, a nie tygodni.

Tworzenie treści cytowanych przez systemy AI przy jednoczesnej ochronie własności intelektualnej wymaga strategicznego podejścia do treści. Systemy AI preferują treści uporządkowane, bogate w fakty, z wyraźnymi nagłówkami, zwięzłymi odpowiedziami i jasną strukturą semantyczną. Oznacza to, że Twoje treści powinny bezpośrednio odpowiadać na typowe pytania klientów, zawierać konkretne dane i przykłady oraz być sformatowane tak, by informacje były łatwe do wyodrębnienia. Szczególnie dobrze sprawdzają się strony FAQ, poradniki oraz artykuły porównawcze, gdyż odpowiadają na pytania użytkowników AI.

Nie musisz jednak publikować najcenniejszej własności intelektualnej, by uzyskać widoczność w AI. Zamiast tego, publikuj tyle informacji, by być cytowanym, ale zachowaj najgłębszą wiedzę, zastrzeżone metodyki i przewagi konkurencyjne za paywallem, wymogiem członkostwa lub kontrolą dostępu. Na przykład możesz stworzyć szczegółowy przewodnik z najlepszymi praktykami branżowymi (który AI zacytuje), a własną implementację i wyniki klientów udostępnić tylko płacącym odbiorcom. Takie podejście daje widoczność w AI przy jednoczesnej ochronie najcenniejszych treści.

Dywersyfikacja treści jest równie ważna. Ponieważ różne platformy AI preferują różne źródła, zwiększ obecność nie tylko na swojej stronie. Twórz treści na Reddit, Quorze, w branżowych publikacjach i na YouTube – tam, gdzie AI często szuka informacji. Nie oznacza to duplikowania treści ze strony, lecz tworzenie materiałów specyficznych dla wybranej platformy, odpowiadających na pytania typowe dla jej użytkowników. Szczegółowa dyskusja na Reddit na temat wyzwań branżowych będzie cytowana inaczej niż tutorial na YouTube – obie formy budują inną widoczność. Dywersyfikując obecność, zwiększasz szansę na cytowanie przez AI w różnych kontekstach i na różnych platformach.

Kontrola dostępu oparta na rolach (RBAC) zapewnia, że tylko upoważnieni członkowie zespołu mają dostęp do wrażliwych treści i danych klientów. Wdrażając RBAC, definiujesz konkretne role — np. twórca treści, redaktor, menedżer, administrator — i przypisujesz uprawnienia w zależności od potrzeb. Freelancer może mieć prawo publikowania treści, ale nie przeglądania danych klientów. Pracownik obsługi klienta może mieć dostęp do danych klientów, ale nie do finansów. Ta zasada minimalnych uprawnień znacząco zmniejsza ryzyko wycieku lub nadużycia wewnętrznego.

Logi dostępu i audyty zapewniają rozliczalność i umożliwiają wykrywanie podejrzanych działań. Wiedząc, kto i kiedy uzyskał dostęp do określonych informacji, możesz identyfikować nietypowe wzorce wskazujące na naruszenie bezpieczeństwa lub celowe nadużycie. Regularne audyty aktywnych użytkowników i uprawnień pozwalają wychwycić nadmierne uprawnienia zanim staną się problemem. Przykładowo, jeśli wykonawca nie utracił dostępu po zakończeniu projektu, audyt ujawni to i pozwoli natychmiast ograniczyć uprawnienia.

Umowy NDA i kontrakty dotyczące własności intelektualnej z pracownikami, freelancerami i dostawcami zapewniają ochronę prawną Twoich treści. Powinny jasno określać, że treści należą do Ciebie, pracownicy i wykonawcy nie mogą używać ich dla konkurencji i muszą zachować poufność. Podpisanie NDA uświadamia konsekwencje prawne wycieku lub nadużycia treści, co działa odstraszająco. Połączenie zabezpieczeń technicznych, monitoringu i umów prawnych tworzy kompleksowy system ochrony.

Najskuteczniejszym podejściem do równoważenia widoczności i ochrony jest radykalna przejrzystość praktyk. Gdy jasno komunikujesz, jak zbierasz dane, jak je chronisz i wykorzystujesz, klienci bardziej ufają i chętniej się angażują. Dotyczy to także strategii treści: bądź wyraźny, które informacje są ogólnodostępne, które wymagają autoryzacji, a które są zarezerwowane dla klientów premium. Takie podejście poprawia widoczność w odpowiedziach AI, bo systemy lepiej rozumieją strukturę treści i trafniej cytują Twoją markę.

Przejrzystość dotyczy także reprezentacji marki. Jeśli monitoring AI ujawni zniekształcenia, reaguj szybko i transparentnie. Skontaktuj się z platformą AI, przekaż poprawne informacje i wyjaśnij, dlaczego dotychczasowa prezentacja jest błędna. Wiele platform oferuje mechanizmy zgłaszania nieścisłości i coraz lepiej reaguje na takie zgłoszenia, bo zależy im na rzetelności odpowiedzi. Przejrzystość w korygowaniu i udoskonalaniu buduje wiarygodność zarówno wobec platform AI, jak i użytkowników.

Monitoruj zarówno metryki widoczności, jak i ochrony, by mieć pewność, że strategia działa. Metryki widoczności to częstotliwość wzmianek na platformach AI, kontekst cytowania (czy jesteś liderem, czy alternatywą), a także ruch pochodzący z AI. Metryki ochrony obejmują incydenty nieautoryzowanej dystrybucji, próby naruszenia danych i wskaźniki zaufania klientów. Celem jest wzrost widoczności przy stabilnych lub poprawiających się wskaźnikach ochrony.

Na przykład, jeśli liczba wzmianek w AI wzrośnie o 40%, ale wykryjesz też 20% wzrost nieautoryzowanej dystrybucji, strategia wymaga korekty. Być może potrzebujesz mocniejszego DRM, intensywniejszego monitorowania lub innego pozycjonowania treści. Jeśli zaś widoczność rośnie, a dystrybucja nieautoryzowana maleje, strategia działa — znalazłeś punkt równowagi między widocznością tam, gdzie to ważne, a ochroną tego, co najcenniejsze.

W miarę jak platformy AI stają się coraz bardziej zaawansowane i wpływowe, równowaga między widocznością a ochroną będzie coraz istotniejsza. Personalizacja rozwija się błyskawicznie — systemy AI potrafią już zapamiętywać wcześniejsze wyszukiwania i personalizować odpowiedzi na podstawie historii użytkownika. Oznacza to, że widoczność marki będzie coraz bardziej zależna od preferencji i kontekstu, a nie tylko jakości treści. Optymalizacja w czasie rzeczywistym stanie się koniecznością, bo platformy promują treści dynamicznie aktualizowane i aktualne. Kontrola regulacyjna będzie narastać, a rządy zaostrzą wymagania co do cytowania źródeł i zarządzania wpływem komercyjnym w odpowiedziach AI.

Marki, które odniosą sukces, to te, które opanują równowagę: będą widoczne tam, gdzie szukają klienci, chroniąc własność intelektualną, transparentne w zarządzaniu danymi i aktywnie monitorujące reprezentację w AI. To nie jest jednorazowe wdrożenie — to strategia, która ewoluuje wraz z rozwojem platform AI i oczekiwań klientów. Wdrażając opisane tu zabezpieczenia techniczne, strategiczne i prawne, pozycjonujesz swoją markę, by wykorzystać szanse, jakie daje widoczność w AI, równocześnie chroniąc to, co nadaje jej wartość.

Śledź, jak Twoja marka pojawia się w ChatGPT, Perplexity i innych platformach AI, jednocześnie chroniąc swoje treści przed nieautoryzowanym użyciem. Uzyskaj wgląd w czasie rzeczywistym w widoczność AI i pozycjonowanie konkurencyjne.

Dowiedz się, dlaczego Twoja marka nie pojawia się w ChatGPT, Perplexity, Google AI Overviews i Claude. Poznaj 5 kluczowych czynników i sposoby ich naprawy.

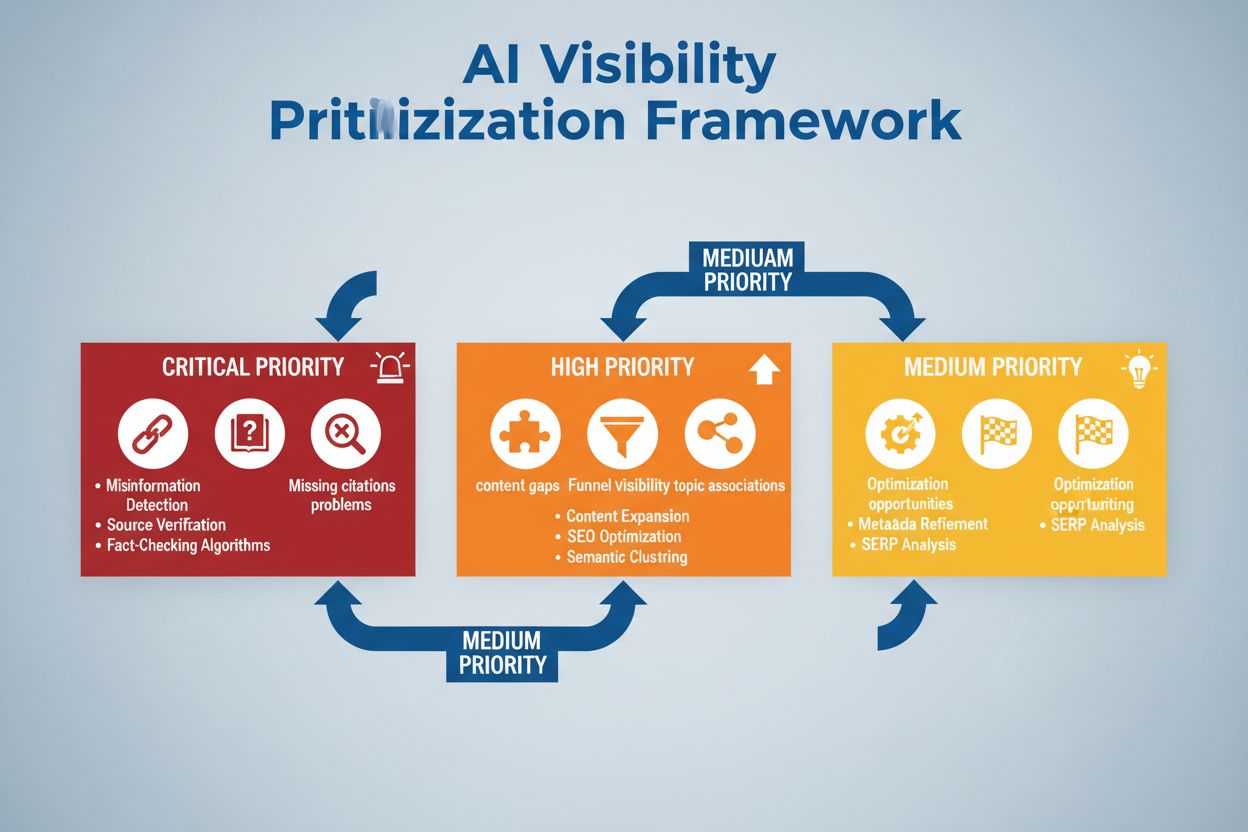

Dowiedz się, jak strategicznie priorytetyzować problemy z widocznością w AI. Poznaj ramy identyfikowania krytycznych, wysokich i średnich priorytetów w obecnośc...

Opanuj Semrush AI Visibility Toolkit z naszym kompleksowym przewodnikiem. Dowiedz się, jak monitorować widoczność marki w wyszukiwaniu AI, analizować konkurencj...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.