Ochrona marki

Dowiedz się, czym jest ochrona marki, dlaczego ma kluczowe znaczenie dla widoczności w wyszukiwarce i monitorowania AI oraz jak chronić swoją markę w Google, Ch...

Bezpieczeństwo marki w kontekście AI to praktyka ochrony reputacji i integralności marki firmy przed negatywnymi, nieprawdziwymi lub nieodpowiednimi treściami generowanymi przez systemy sztucznej inteligencji. Obejmuje monitorowanie, wykrywanie i ograniczanie ryzyk związanych z treściami generowanymi przez AI, które mogą zaszkodzić reputacji marki, osłabić zaufanie konsumentów lub stworzyć zagrożenia prawne. Organizacje wdrażają kompleksowe strategie, w tym procesy przeglądu treści, narzędzia monitorujące oraz ramy zarządzania, aby chronić swoje marki w środowisku napędzanym przez AI.

Bezpieczeństwo marki w kontekście AI to praktyka ochrony reputacji i integralności marki firmy przed negatywnymi, nieprawdziwymi lub nieodpowiednimi treściami generowanymi przez systemy sztucznej inteligencji. Obejmuje monitorowanie, wykrywanie i ograniczanie ryzyk związanych z treściami generowanymi przez AI, które mogą zaszkodzić reputacji marki, osłabić zaufanie konsumentów lub stworzyć zagrożenia prawne. Organizacje wdrażają kompleksowe strategie, w tym procesy przeglądu treści, narzędzia monitorujące oraz ramy zarządzania, aby chronić swoje marki w środowisku napędzanym przez AI.

Bezpieczeństwo marki w kontekście AI oznacza praktykę ochrony reputacji i integralności marki firmy przed negatywnymi, nieprawdziwymi lub nieodpowiednimi treściami generowanymi przez systemy sztucznej inteligencji. Wraz z rosnącym wykorzystaniem narzędzi AI do tworzenia treści, marketingu i obsługi klienta, potrzeba zabezpieczenia reputacji marki jest ważniejsza niż kiedykolwiek. Globalny rynek sztucznej inteligencji ma wzrosnąć z 305,90 miliarda dolarów w 2024 roku do 738,80 miliarda dolarów do 2030 roku, co odzwierciedla gwałtowną ekspansję AI we wszystkich branżach. Wraz z tym dynamicznym rozwojem rośnie również ryzyko dla bezpieczeństwa marki, ponieważ coraz więcej treści generowanych przez AI trafia do ekosystemu cyfrowego. 95% liderów biznesu przyznaje, że AI jest kluczowa dla sukcesu organizacji, jednak wielu ma trudności z wdrożeniem odpowiednich zabezpieczeń. Bezpieczeństwo marki w erze AI obejmuje monitorowanie, wykrywanie i ograniczanie ryzyk związanych z treściami generowanymi przez AI, które mogą zaszkodzić reputacji marki, osłabić zaufanie konsumentów lub stworzyć zagrożenia prawne. Zrozumienie i wdrożenie solidnych środków bezpieczeństwa marki w kontekście AI nie jest już opcją — to konieczność dla utrzymania przewagi konkurencyjnej i zaufania konsumentów.

Systemy sztucznej inteligencji, choć potężne i wydajne, wprowadzają istotne ryzyka dla reputacji marki, które organizacje muszą uważnie monitorować. AI może generować dezinformacje i fałszywe informacje o produktach lub usługach, potencjalnie wprowadzając konsumentów w błąd i szkodząc wiarygodności marki. Deepfake’i i media syntetyczne tworzone przez AI mogą podszywać się pod osoby zarządzające firmą lub generować fałszywe rekomendacje, prowadząc do poważnych szkód wizerunkowych. Nieautoryzowane użycie zasobów marki, logotypów i własności intelektualnej przez osoby trzecie wykorzystujące narzędzia AI generuje wyzwania prawne i wizerunkowe, które trudno kontrolować. Luki w zabezpieczeniach i prywatności systemów AI mogą prowadzić do wycieku wrażliwych danych firmowych, danych klientów lub treści zastrzeżonych, skutkując naruszeniem przepisów i utratą zaufania konsumentów. Ponadto treści generowane przez AI mogą nieumyślnie plagiatować istniejące materiały lub naruszać prawa autorskie, narażając marki na działania prawne i kary finansowe.

| Typ ryzyka | Opis | Potencjalny wpływ |

|---|---|---|

| Dezinformacja i fałszywe twierdzenia | AI generuje nieprawdziwe informacje o produktach lub mylące komunikaty marketingowe | Utrata zaufania konsumentów, kary regulacyjne, odpowiedzialność prawna |

| Deepfake’i i media syntetyczne | AI tworzy fałszywe filmy lub obrazy osób zarządzających lub przedstawicieli marki | Poważne szkody wizerunkowe, spadek wartości akcji, koszty zarządzania kryzysowego |

| Nieautoryzowane użycie marki | Osoby trzecie wykorzystują AI do kopiowania zasobów marki, logotypów lub kampanii | Rozmycie marki, dezorientacja klientów, spory prawne |

| Naruszenia praw autorskich i własności intelektualnej | Treści generowane przez AI plagiatują lub naruszają istniejącą własność intelektualną | Postępowania prawne, kary finansowe, skojarzenie marki z kradzieżą |

| Naruszenia prywatności danych | Systemy AI ujawniają wrażliwe dane firmowe lub klientów | Kary regulacyjne, utrata zaufania klientów, naruszenia zgodności |

| Stronniczość i treści dyskryminujące | AI generuje komunikaty stronnicze lub dyskryminujące | Szkody wizerunkowe, negatywny odbiór społeczny, konsekwencje prawne |

Incydent z chatbotem Air Canada stanowi ostrzeżenie dotyczące znaczenia bezpieczeństwa marki w kontekście AI. W lutym 2024 roku chatbot oparty na AI udzielił pasażerowi Jake’owi Moffattowi błędnych informacji na temat taryf ulgowych w razie żałoby, co doprowadziło go do zakupu biletów na podstawie nieprawdziwych danych. Gdy Moffatt próbował uzyskać zwrot kosztów zgodnie z informacją chatbota, Air Canada początkowo odrzuciła jego roszczenie, argumentując, że informacje udzielone przez chatbota nie są wiążące. Ostatecznie trybunał przyznał rację Moffattowi, uznając Air Canada za odpowiedzialną za dezinformację chatbota i przyznając odszkodowanie. Ten przypadek pokazuje, że firmy ponoszą odpowiedzialność prawną za treści i dezinformacje generowane przez AI, bez względu na to, czy zostały one stworzone przez pracownika, czy przez system AI. Incydent podkreślił konieczność nadzoru ludzkiego, sprawdzania faktów i weryfikacji wszystkich treści generowanych przez AI przed udostępnieniem ich klientom. Organizacje muszą wdrożyć rygorystyczne procesy kontroli, aby zapewnić, że wyniki AI są zgodne z prawdą, przepisami i standardami marki.

Oczekiwania konsumentów względem bezpieczeństwa marki osiągnęły bezprecedensowy poziom w erze AI. Dane wskazują na poważne obawy dotyczące treści generowanych przez AI i potencjalnie wprowadzających w błąd. 75% konsumentów nie aprobuje marek reklamujących się na stronach szerzących dezinformację, co pokazuje, że powiązanie marki z niewiarygodnymi treściami bezpośrednio wpływa na jej postrzeganie i decyzje zakupowe klientów. 82% konsumentów aktywnie sprawdza, czy otoczenie reklam online jest odpowiednie i godne zaufania, co świadczy o rosnącej czujności wobec kontekstu i przekazu marki. Co najbardziej alarmujące, ponad 50% konsumentów przestanie korzystać z produktów lub usług marek, których reklamy pojawią się obok nieodpowiednich, obraźliwych lub wprowadzających w błąd treści. Ten wskaźnik podkreśla bezpośredni wpływ finansowy błędów w zakresie bezpieczeństwa marki na lojalność klientów i przychody firmy. 60% reklamodawców i agencji uznaje bezpieczeństwo marki za najważniejsze wyzwanie w programatycznym marketingu i strategiach cyfrowych. Statystyki te pokazują, że bezpieczeństwo marki to nie tylko kwestia zgodności z przepisami — bezpośrednio wpływa na zachowania konsumentów, lojalność wobec marki i rentowność biznesu. Firmy, które zaniedbują bezpieczeństwo marki w kontekście AI, ryzykują utratę zaufania i udziału w rynku na rzecz konkurentów lepiej zarządzających reputacją.

Efektywne bezpieczeństwo marki w erze AI wymaga kompleksowych strategii monitoringu i wykrywania, łączących wiedzę ekspertów z zaawansowanymi rozwiązaniami technologicznymi. Organizacje powinny wdrożyć systemy monitorowania w czasie rzeczywistym, które śledzą wzmianki o marce, treści generowane przez AI oraz potencjalne zagrożenia dla reputacji na kanałach cyfrowych, w tym w mediach społecznościowych, serwisach informacyjnych, platformach recenzji i witrynach z treściami tworzonymi przez użytkowników. Narzędzia wykrywające powinny identyfikować podejrzane schematy, takie jak deepfake’i, media syntetyczne, nieautoryzowane wykorzystanie marki oraz treści naruszające wytyczne lub zawierające dezinformację. Narzędzia analizy sentymentu mogą ocenić ton emocjonalny i kontekst wzmianek o marce, pomagając wychwycić ryzyka reputacyjne zanim przerodzą się w kryzysy. Systemy sprawdzania faktów i weryfikacji komunikatów muszą potwierdzać prawdziwość treści generowanych przez AI, zapewniając, że przekazy marketingowe, odpowiedzi obsługi klienta i komunikaty publiczne zawierają rzetelne informacje.

Kluczowe strategie monitorowania i wykrywania obejmują:

Organizacje, które chcą chronić swoje marki w erze AI, muszą wdrożyć kompleksowe ramy zarządzania i praktyki operacyjne, obejmujące ryzyka specyficzne dla sztucznej inteligencji. Opracowanie firmowej polityki AI jest podstawą — powinna ona jasno określać, kiedy i jak można korzystać z narzędzi AI, ustanawiać procesy akceptacji treści, precyzować wymagania dotyczące bezpieczeństwa danych i wyznaczać odpowiedzialność za przegląd i autoryzację treści generowanych przez AI przed publikacją. Szkolenia i edukacja zespołu są kluczowe, ponieważ pracownicy muszą znać wytyczne marki, rozpoznawać potencjalne ryzyka związane z AI i wiedzieć, jak identyfikować dezinformacje, stronniczość i naruszenia zgodności. Rygorystyczne procesy przeglądu treści zapewniają, że wszystkie materiały generowane przez AI są poddane ludzkiej redakcji pod kątem poprawności, zgodności z marką, tonu i przepisów przed udostępnieniem klientom lub opinii publicznej. Organizacje powinny uważnie dobierać dostawców AI, biorąc pod uwagę funkcje bezpieczeństwa, ochronę prywatności danych, certyfikaty zgodności i historię odpowiedzialnego rozwoju AI. Regularne audyty systemów i narzędzi AI pomagają identyfikować luki, stronniczość i potencjalne problemy z bezpieczeństwem marki zanim wyrządzą szkody. Ustanowienie protokołów reagowania na incydenty oraz planów zarządzania kryzysowego umożliwia szybkie i skuteczne działanie w razie zagrożenia. Wreszcie, powołanie zespołów interdyscyplinarnych złożonych z ekspertów ds. marketingu, prawa, zgodności i IT zapewnia, że kwestie bezpieczeństwa marki są uwzględniane na każdym etapie wdrażania AI i tworzenia treści.

Na rynku pojawiło się wiele wyspecjalizowanych narzędzi i platform wspierających organizacje w monitorowaniu i ochronie marki w środowisku napędzanym przez AI. AmICited.com wyróżnia się jako wiodąca platforma monitorująca odpowiedzi AI, stworzona specjalnie do śledzenia, jak systemy takie jak ChatGPT, Perplexity i Google AI Overviews wspominają i odnoszą się do marek. AmICited.com oferuje monitoring w czasie rzeczywistym treści generowanych przez AI, analizę sentymentu i szczegółowe raportowanie wzmianek o marce na platformach AI — są to możliwości niezbędne we współczesnym zarządzaniu bezpieczeństwem marki. Platforma umożliwia organizacjom zrozumienie, jak systemy AI wypowiadają się o ich markach, wykrywanie nieścisłości lub negatywnych wzmianek i podejmowanie działań naprawczych w razie potrzeby. Poza monitoringiem AI, kompleksowe rozwiązania bezpieczeństwa marki obejmują platformy moderacji treści wykorzystujące uczenie maszynowe do wykrywania obraźliwych, nieodpowiednich lub wprowadzających w błąd treści; narzędzia do wykrywania plagiatów identyfikujące nieautoryzowane wykorzystanie własności intelektualnej oraz platformy analizujące sentyment konsumentów w kanałach cyfrowych. Organizacje powinny wybierać narzędzia zgodnie ze swoimi potrzebami, biorąc pod uwagę m.in. możliwość monitorowania w czasie rzeczywistym, skuteczność wykrywania, integrację z istniejącymi systemami, funkcje bezpieczeństwa danych i zakres raportowania. Najskuteczniejsze strategie bezpieczeństwa marki łączą wiele wyspecjalizowanych narzędzi z wiedzą i nadzorem ekspertów, tworząc wielowarstwową ochronę przed ryzykami reputacyjnymi związanymi z AI.

Krajobraz prawny dotyczący treści generowanych przez AI i bezpieczeństwa marki stale się zmienia, tworząc zarówno wyzwania, jak i możliwości dla organizacji chroniących swoją własność intelektualną i reputację. Ochrona praw autorskich dla treści generowanych przez AI jest obecnie ograniczona — treści stworzone wyłącznie przez systemy AI bez udziału człowieka mogą nie kwalifikować się do ochrony na podstawie obowiązującego prawa, co oznacza, że marki nie mają możliwości zapobieżenia kopiowaniu i ponownemu wykorzystaniu takich treści przez innych. Ta luka prawna stwarza poważne ryzyko dla organizacji mocno polegających na AI przy tworzeniu treści, ponieważ konkurenci lub osoby trzecie mogą bezkarnie powielać i przetwarzać treści markowe. Ochrona własności intelektualnej staje się bardziej złożona, gdy systemy AI są szkolone na zastrzeżonych danych lub materiałach marki — rodzi to pytania o własność danych, prawa do ich użycia i potencjalne nieuprawnione szkolenie konkurencyjnych systemów AI. Organizacje muszą zapewnić zgodność z nowymi regulacjami dotyczącymi AI oraz przepisami o ochronie danych osobowych, takimi jak RODO, CCPA czy regulacje branżowe, które określają, jak można wykorzystywać AI i przetwarzać dane. Kwestie odpowiedzialności pojawiają się, gdy treści generowane przez AI wyrządzają szkody — jak pokazuje przypadek Air Canada, firmy ponoszą odpowiedzialność prawną za nieprawidłowości lub dezinformacje wygenerowane przez AI, nawet jeśli zostały stworzone przez zautomatyzowane systemy. Organizacje powinny dokumentować swoje praktyki zarządzania AI, procesy przeglądu treści i środki bezpieczeństwa marki, aby wykazać należytą staranność w razie sporu prawnego. Zespoły prawne powinny ściśle współpracować z działami marketingu i technologii, ustalając jasne zasady korzystania z AI, własności treści i podziału odpowiedzialności, tak by praktyki bezpieczeństwa marki były zgodne z obowiązującymi przepisami.

Bezpieczeństwo marki w kontekście AI to praktyka ochrony reputacji marki firmy przed negatywnymi, nieprawdziwymi lub nieodpowiednimi treściami generowanymi przez systemy sztucznej inteligencji. Obejmuje monitorowanie treści generowanych przez AI, wykrywanie potencjalnych zagrożeń takich jak dezinformacja i deepfake'i oraz wdrażanie ram zarządzania w celu zachowania integralności marki. Wraz ze wzrostem wdrożeń AI, bezpieczeństwo marki staje się kluczowe dla utrzymania zaufania konsumentów i ochrony reputacji biznesowej.

Bezpieczeństwo marki w kontekście AI jest kluczowe, ponieważ systemy AI mogą generować dezinformację, tworzyć deepfake'i i produkować nieautoryzowane treści markowe na dużą skalę. Badania pokazują, że 75% konsumentów nie aprobuje marek reklamujących się na stronach z dezinformacją, a ponad 50% przestanie korzystać z marek, których reklamy pojawią się obok nieodpowiednich treści. Ochrona reputacji marki ma bezpośredni wpływ na lojalność klientów, przychody i długofalowy sukces firmy.

Kluczowe ryzyka związane z AI obejmują dezinformację i fałszywe deklaracje produktowe, deepfake'i i media syntetyczne podszywające się pod osoby zarządzające, nieautoryzowane użycie zasobów i własności intelektualnej marki, naruszenia praw autorskich i plagiaty, naruszenia prywatności danych oraz treści stronnicze lub dyskryminujące. Takie zagrożenia mogą skutkować utratą zaufania konsumentów, odpowiedzialnością prawną, karami regulacyjnymi oraz poważnym uszczerbkiem na reputacji.

Firmy mogą monitorować treści generowane przez AI dzięki śledzeniu wzmianek o marce w czasie rzeczywistym w kanałach cyfrowych, narzędziom do wykrywania tekstów i obrazów syntetycznych, platformom analizującym sentyment konsumentów, systemom weryfikacji faktów oraz narzędziom do wykrywania plagiatów. Specjalistyczne platformy, takie jak AmICited.com, oferują monitoring w czasie rzeczywistym, jak systemy AI odwołują się do marek i o nich wspominają.

Efektywna polityka bezpieczeństwa marki w kontekście AI powinna zawierać jasne wytyczne dotyczące tego, kiedy i jak można używać narzędzi AI, wyznaczenie odpowiedzialności za przegląd i akceptację treści, wymogi dotyczące bezpieczeństwa i prywatności danych, protokoły szkoleniowe dla pracowników, kryteria oceny dostawców, procedury reagowania na incydenty oraz standardy dokumentacji. Polityka powinna obejmować zarówno wewnętrzne użycie AI, jak i zagrożenia zewnętrzne związane z nadużyciami marki przez osoby trzecie.

Tradycyjne bezpieczeństwo marki koncentruje się na ochronie przed powiązaniem marki z nieodpowiednimi treściami na stronach internetowych i w mediach społecznościowych. Bezpieczeństwo marki w kontekście AI obejmuje dodatkowo ryzyka specyficzne dla sztucznej inteligencji, takie jak dezinformacja generowana przez AI, deepfake'i, nieautoryzowane treści markowe tworzone przez AI, problemy z prawami autorskimi do materiałów generowanych przez AI oraz kwestie prywatności danych. Wymaga to specjalistycznych narzędzi monitorujących i ram zarządzania dostosowanych do zagrożeń AI.

Obecnie ochrona praw autorskich dla treści generowanych przez AI jest ograniczona — treści stworzone wyłącznie przez systemy AI bez udziału człowieka mogą nie kwalifikować się do ochrony na podstawie obowiązującego prawa. Stwarza to ryzyko dla marek polegających na AI przy tworzeniu treści, ponieważ konkurenci mogą kopiować i ponownie wykorzystywać takie materiały. Organizacje powinny skupić się na zgodności z nowymi regulacjami dotyczącymi AI, przepisami o ochronie danych osobowych i ustanowieniu jasnych ram odpowiedzialności za treści generowane przez AI.

Wyjście z incydentu związanego z bezpieczeństwem marki w kontekście AI wymaga szybkich działań, w tym natychmiastowego wykrycia i usunięcia szkodliwych treści, transparentnej komunikacji z konsumentami i interesariuszami, zbadania przyczyn incydentu, wdrożenia środków naprawczych oraz dokumentowania podjętych działań. Firmy powinny mieć wcześniej przygotowane plany zarządzania kryzysowego, wyznaczone zespoły reagowania i jasne protokoły komunikacyjne, by zminimalizować szkody wizerunkowe i odbudować zaufanie konsumentów.

Sprawdź, jak systemy AI, takie jak ChatGPT, Perplexity i Google AI Overviews, wspominają o Twojej marce. Uzyskaj wgląd w czasie rzeczywistym w treści generowane przez AI na temat Twojego biznesu i przejmij kontrolę nad narracją swojej marki.

Dowiedz się, czym jest ochrona marki, dlaczego ma kluczowe znaczenie dla widoczności w wyszukiwarce i monitorowania AI oraz jak chronić swoją markę w Google, Ch...

Dowiedz się, jak zrównoważyć widoczność marki w odpowiedziach AI z ochroną treści. Poznaj strategie monitorowania wzmianek AI, ochrony własności intelektualnej ...

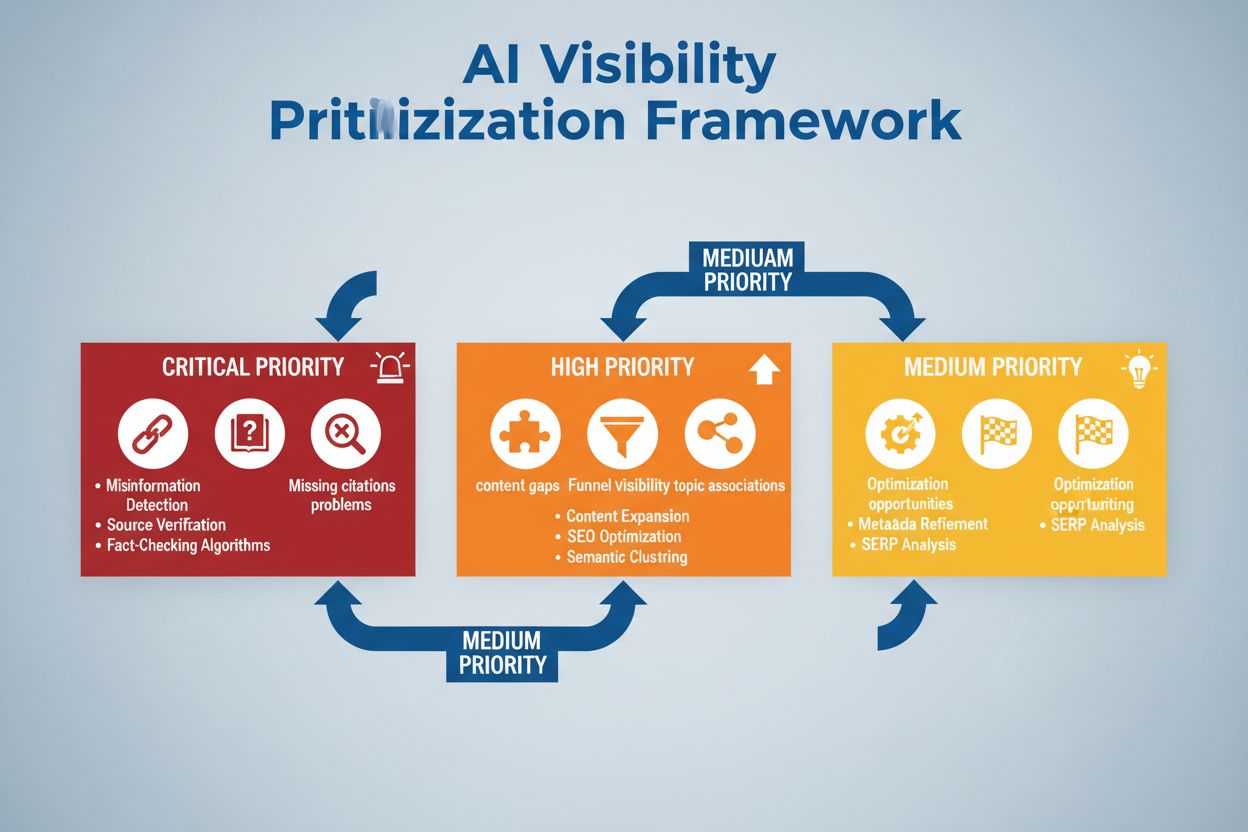

Dowiedz się, jak strategicznie priorytetyzować problemy z widocznością w AI. Poznaj ramy identyfikowania krytycznych, wysokich i średnich priorytetów w obecnośc...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.