Optymalizacja Claude AI: Jak pojawić się w odpowiedziach Anthropic

Opanuj optymalizację Claude AI i zwiększ widoczność swojej marki w odpowiedziach Anthropic. Poznaj strategie cytowania, wymagania techniczne i budowanie autoryt...

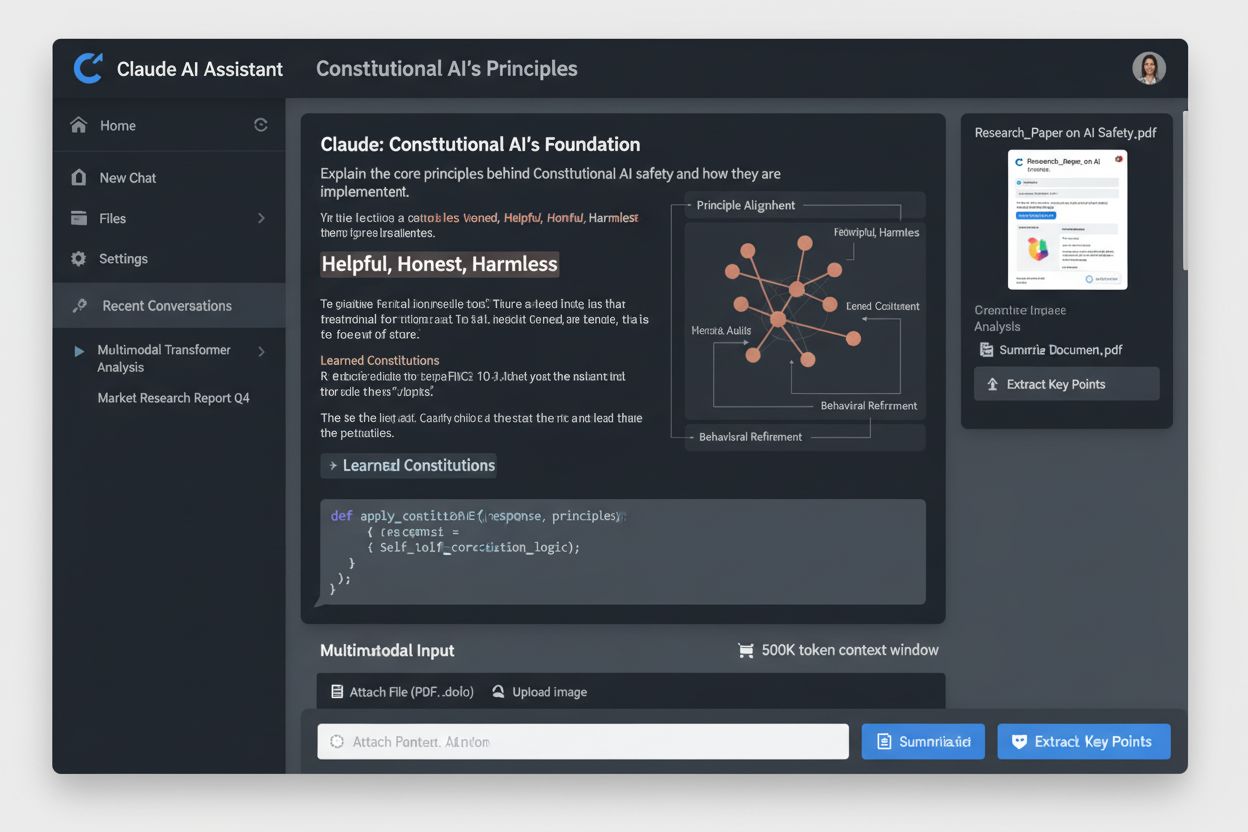

Claude to rodzina dużych modeli językowych opracowanych przez Anthropic, zaprojektowanych jako pomocny, uczciwy i nieszkodliwy asystent AI. Zbudowany w oparciu o zasady Constitutional AI oraz architekturę transformerów, Claude wyróżnia się w przetwarzaniu języka naturalnego, generowaniu kodu, analizie dokumentów oraz zadaniach multimodalnych obejmujących tekst, dźwięk i obraz.

Claude to rodzina dużych modeli językowych opracowanych przez Anthropic, zaprojektowanych jako pomocny, uczciwy i nieszkodliwy asystent AI. Zbudowany w oparciu o zasady Constitutional AI oraz architekturę transformerów, Claude wyróżnia się w przetwarzaniu języka naturalnego, generowaniu kodu, analizie dokumentów oraz zadaniach multimodalnych obejmujących tekst, dźwięk i obraz.

Claude to nowoczesny duży model językowy (LLM) oraz rodzina asystentów AI opracowanych przez Anthropic, wiodącą firmę badawczą w dziedzinie bezpieczeństwa AI założoną w 2021 roku przez byłych pracowników OpenAI, w tym Dario i Danielę Amodei. Claude został zaprojektowany z myślą o byciu pomocnym, uczciwym i nieszkodliwym dzięki zastosowaniu Constitutional AI — nowatorskiej metody treningu dopasowującej zachowanie AI do wartości ludzkich i zasad etycznych. W przeciwieństwie do tradycyjnych asystentów AI, które polegają głównie na opinii ludzi, Claude wykorzystuje zarówno uczenie nadzorowane, jak i uczenie ze wzmocnieniem na bazie opinii AI (RLAIF), by zapewnić wyższy poziom bezpieczeństwa i niezawodności. Model jest dostępny przez interfejs webowy na claude.ai, API dla deweloperów oraz integracje z platformami firmowymi jak Notion, DuckDuckGo czy rozwiązania biznesowe Accenture. Claude to istotny krok naprzód w konwersacyjnej AI, łącząc najnowsze rozumienie języka z solidnymi mechanizmami bezpieczeństwa, dzięki czemu nadaje się do zastosowań wrażliwych w różnych branżach.

Prace nad Claude’em wynikają z założycielskiej misji Anthropic: stworzenia systemów AI, które są fundamentalnie bezpieczniejsze i lepiej dopasowane do ludzkich intencji niż dostępne dotąd alternatywy. Gdy Anthropic startował w 2021 roku, krajobraz AI zdominowany był przez modele GPT od OpenAI i modele językowe Google, jednak brakowało im wyraźnych metod treningu nastawionych na bezpieczeństwo. Badania Anthropic nad Constitutional AI rozpoczęły się jako akademicka eksploracja sposobów na samodoskonalenie AI bez rozległego oznaczania przez ludzi, czego efektem była przełomowa publikacja z grudnia 2022 roku: “Constitutional AI: Harmlessness from AI Feedback”. Claude po raz pierwszy został zaprezentowany publicznie w marcu 2023 roku w zamkniętej alfie u partnerów takich jak Notion, Quora czy DuckDuckGo, co pozwoliło Anthropic na ostrożne testowanie systemu w praktycznych zastosowaniach przed szerszym udostępnieniem. Od tego czasu firma wydała wiele generacji Claude’a, z rodziną Claude 3 (premiera maj 2024) wprowadzającą funkcje multimodalne i znacznie rozszerzone okno kontekstu. Na II kwartał 2025 roku Claude 3.5 przekroczył 30 milionów aktywnych użytkowników miesięcznie na świecie, co stanowi 40% wzrost rok do roku i pokazuje szybkie przyjęcie na rynku oraz zaufanie korporacji do tej platformy.

Claude bazuje na architekturze transformerów — tym samym podstawowym projekcie sieci neuronowej, który napędza większość współczesnych dużych modeli językowych. Transformatory świetnie sprawdzają się w przetwarzaniu języka naturalnego dzięki zastosowaniu mechanizmów self-attention, umożliwiających modelowi ważenie istotności poszczególnych słów w sekwencji i rozumienie kontekstu w dłuższych fragmentach tekstu. Architektura Claude’a przetwarza dane wejściowe, dzieląc je na tokeny (pojedyncze słowa lub ich fragmenty), konwertując tokeny na wektory (embeddings) w przestrzeni wielowymiarowej, a następnie stosując mechanizmy uwagi do generowania najbardziej prawdopodobnych odpowiedzi. Okno kontekstu modelu o wielkości do 500 000 tokenów to kluczowa przewaga techniczna, pozwalająca Claude’owi przetwarzać ok. 350 stron tekstu w jednej rozmowie — znacznie więcej niż limit 128 000 tokenów w GPT-4 Turbo. Tak duże okno kontekstu pozwala Claude’owi zachować spójność w długich dokumentach, analizować całe bazy kodu i prowadzić rozbudowane rozmowy bez utraty informacji. Proces treningowy łączy nadzorowane dostrajanie na wysokiej jakości przykładach z uczeniem ze wzmocnieniem, lecz wyróżnikiem Claude’a jest integracja zasad Constitutional AI, które kierują modelem ku bezpieczniejszym, lepiej dopasowanym odpowiedziom bez konieczności żmudnego oznaczania szkodliwych treści przez ludzi.

Constitutional AI to autorskie podejście Anthropic do trenowania systemów AI, które są z założenia bezpieczniejsze i lepiej odzwierciedlają wartości ludzkie. Zamiast polegać na ocenach tysięcy szkodliwych wyników przez ludzi, Constitutional AI używa “konstytucji” — zbioru zasad i reguł wywiedzionych z ludzkich opinii — by kierować zachowaniem modelu na zasadzie samonadzoru. Anthropic zebrał wkład ok. 1000 osób, które głosowały i proponowały reguły dla etycznego funkcjonowania AI. Zasady te obejmują m.in.: “wybierz odpowiedź najmniej niebezpieczną lub nienawistną”, “wybierz odpowiedź jak najbardziej rzetelną, uczciwą i zgodną z prawdą” oraz “wybierz odpowiedź najczytelniej wyrażającą intencje”. Podczas treningu Claude generuje kilka kandydatów odpowiedzi do podanego prompta, ocenia je pod kątem zasad konstytucji i poprawia zgodnie z nimi. Proces ten jest następnie wzmacniany przez Reinforcement Learning from AI Feedback (RLAIF), w którym osobny model AI ocenia, które odpowiedzi najlepiej realizują konstytucję. To podejście zasadniczo różni się od tradycyjnego Reinforcement Learning from Human Feedback (RLHF), gdzie ludzie oznaczają odpowiedzi jako dobre lub złe. Automatyzując proces opiniowania, Constitutional AI obniża koszty i czas potrzebny na szkolenie bezpiecznych systemów AI, a potencjalnie osiąga lepsze dopasowanie do wyznaczonych zasad. Metoda ta okazała się skuteczna: pierwsi użytkownicy raportują, że Claude “znacznie rzadziej generuje szkodliwe treści, łatwiej się z nim rozmawia i jest bardziej sterowalny” niż konkurencyjne modele.

Ewolucja Claude’a w kierunku funkcjonalności multimodalnej oznacza znaczące poszerzenie jego możliwości poza interakcje tekstowe. Najnowsze modele Claude 3 potrafią przetwarzać i analizować tekst, obrazy oraz dźwięk, umożliwiając użytkownikom przesyłanie dokumentów w różnych formatach (PDF, Word, obrazy), zadawanie pytań o treści wizualne i otrzymywanie szczegółowych analiz. Przykładowo, użytkownik może przeciągnąć zdjęcie do Claude’a i otrzymać szczegółowy opis zawartości obrazu, łącznie z identyfikacją obiektów, analizą kompozycji i interpretacją kontekstu. Ta możliwość multimodalna ma zastosowanie profesjonalne: firmy e-commerce generują opisy produktów na podstawie zdjęć, prawnicy analizują umowy i dokumenty wizualne, a naukowcy przetwarzają złożone diagramy i wykresy. Claude potrafi też przetwarzać dane audio, choć samodzielnie nie generuje dźwięku ani wideo. Zamiast tego świetnie sprawdza się w tworzeniu interaktywnych wizualizacji i komponentów React przez funkcję Artifacts, co pozwala użytkownikom budować wykresy, diagramy, kalkulatory, a nawet proste gry uruchamiane w czasie rzeczywistym w interfejsie. Połączenie przetwarzania danych multimodalnych z zaawansowaną generacją wyników czyni Claude’a wyjątkowo cennym narzędziem dla pracowników wiedzy, którzy analizują różnorodne źródła informacji i potrzebują praktycznych wniosków.

| Funkcja | Claude (Anthropic) | ChatGPT (OpenAI) | Gemini (Google) |

|---|---|---|---|

| Okno kontekstu | Do 500 000 tokenów | Do 128 000 tokenów | Do 1 000 000 tokenów (Gemini 2.0) |

| Metodologia treningu | Constitutional AI + RLAIF | RLHF + opinia ludzka | RLHF + opinia ludzka |

| Generowanie obrazów | Nie (tylko Artifacts) | Tak (DALL-E 3) | Tak (Imagen 3) |

| Generowanie wideo | Nie | Tak (Sora) | Tak (Veo) |

| Wyszukiwanie w sieci | Tak | Tak | Tak |

| Polityka przechowywania danych | Usuwane po 30 dniach | Mogą być przechowywane do ulepszania modeli | Zależnie od poziomu produktu |

| Możliwości kodowania | Doskonałe (Artifacts + Claude Code) | Dobre (funkcja Canvas) | Dobre |

| Wejście multimodalne | Tekst, obrazy, dźwięk | Tekst, obrazy, dźwięk | Tekst, obrazy, dźwięk, wideo |

| Darmowy dostęp | Claude 3.5 Sonnet | GPT-4o mini | Gemini 2.0 Flash |

| Użytkownicy miesięcznie (II kw. 2025) | 30+ mln | 200+ mln | 100+ mln |

| Adopcja korporacyjna | Rośnie (Accenture, Snowflake) | Dominująca (integracja z Microsoft) | Silna (integracja z Google Cloud) |

Wszechstronność Claude’a sprawia, że nadaje się do szerokiego zakresu profesjonalnych i kreatywnych zastosowań w różnych branżach. W programowaniu Claude wyróżnia się w generowaniu kodu, debugowaniu i planowaniu architektury, a deweloperzy szczególnie chwalą jego zdolność do wyjaśniania złożonych fragmentów kodu i proponowania ulepszeń. Funkcja Artifacts umożliwia wizualizację działania kodu w czasie rzeczywistym, co ułatwia iteracyjne poprawki. W tworzeniu treści i pisaniu Claude generuje bardziej naturalny, ludzki tekst niż konkurenci, co czyni go idealnym narzędziem do blogów, marketingu, fikcji literackiej czy dokumentacji technicznej. Funkcja Styles pozwala definiować własne style pisarskie dla różnych kontekstów — formalne dla biznesu, konwersacyjne do social mediów, analityczne do prac naukowych. W usługach prawnych i finansowych zdolność Claude’a do przetwarzania długich dokumentów i wyciągania kluczowych informacji jest cenna przy analizie umów, due diligence i zgodności regulacyjnej. Juni Learning korzysta z Claude’a do zasilania bota edukacyjnego oferującego wsparcie naukowe, a Robin AI wykorzystuje zrozumienie języka przez Claude’a do analizy umów i alternatywnych propozycji zapisów. W badaniach i analizie rozbudowane okno kontekstu Claude’a umożliwia naukowcom przesyłanie całych artykułów, zbiorów danych czy raportów i zadawanie zaawansowanych pytań analitycznych. Model częściej przyznaje się do niepewności zamiast tworzyć pozornie wiarygodne, ale nieprawdziwe odpowiedzi (halucynacje), co czyni go szczególnie wartościowym w zastosowaniach, gdzie kluczowa jest precyzja.

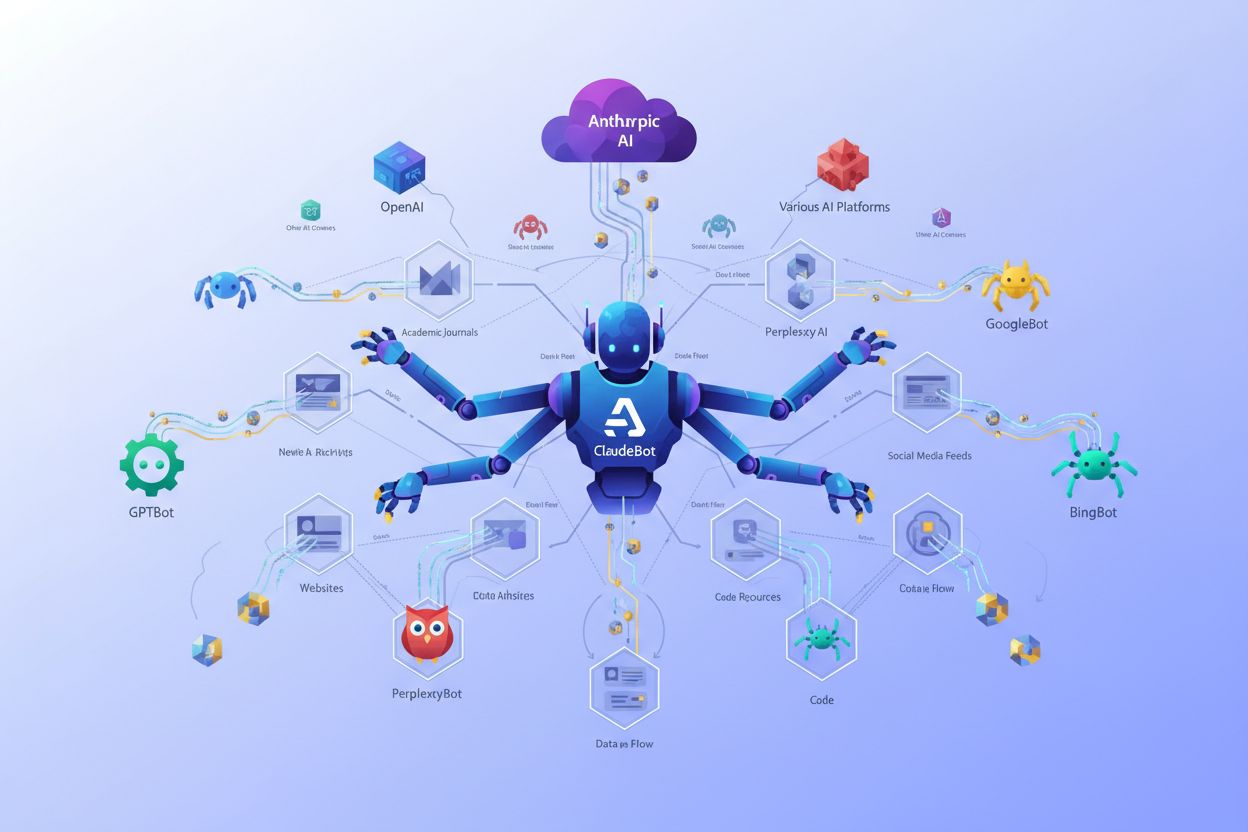

Anthropic strategicznie współpracuje z głównymi platformami technologicznymi i biznesowymi, by zintegrować Claude’a z firmowymi procesami i znacząco poszerzyć jego zasięg oraz praktyczne zastosowania. Notion zintegrował Claude’a ze swoją platformą, umożliwiając użytkownikom korzystanie z AI do pisania, podsumowywania i generowania treści bez wychodzenia z narzędzi do produktywności. DuckDuckGo współpracuje z Anthropic przy tworzeniu DuckAssist — funkcji natychmiastowych odpowiedzi, która wykorzystuje Claude’a do generowania naturalnych odpowiedzi na zapytania, bazując na Wikipedii i innych źródłach. Accenture ogłosiło wieloletnie partnerstwo z Anthropic, pomagając firmom przejść z pilotaży AI do wdrożeń produkcyjnych, z Claude’em jako kluczowym elementem strategii AI. Snowflake i Anthropic zawarły partnerstwo warte 200 mln dolarów, by dostarczać agentową AI globalnym firmom, integrując Claude’a z platformą danych Snowflake. Te współprace świadczą o zaufaniu korporacji do niezawodności, bezpieczeństwa i wydajności Claude’a. Dodatkowo Claude jest dostępny przez API dla deweloperów, z elastycznym cennikiem dostosowanym do startupów i małych firm oraz opłacalnym dla dużych wdrożeń korporacyjnych. Dostępność Claude’a przez wiele kanałów — interfejs webowy, API i integracje platformowe — gwarantuje, że organizacje mogą wdrożyć Claude’a w zgodzie ze swoimi technologiami i procesami.

Przewagi konkurencyjne Claude’a wynikają z unikalnego połączenia możliwości technicznych, mechanizmów bezpieczeństwa i projektu doświadczenia użytkownika. Okno kontekstu 500 000 tokenów to ogromny atut w pracy z dużymi dokumentami — użytkownicy mogą przesyłać całe książki, bazy kodu czy repozytoria badawcze i zachować spójność rozmowy na całości materiału. Trening zgodny z Constitutional AI skutkuje odpowiedziami wyraźnie bezpieczniejszymi i bardziej dopasowanymi do wartości ludzkich, z mniejszą liczbą szkodliwych lub wymijających odpowiedzi. Funkcja Artifacts umożliwia wizualizację kodu i wykonywanie komponentów na żywo, co daje przewagę w zadaniach programistycznych i wizualizacji danych. Jakość pisania Claude’a jest regularnie oceniana jako bardziej naturalna i ludzka niż w ChatGPT, z mniejszym naciskiem na schematyczne frazy czy wypunktowania. Polityka prywatności — rozmowy są usuwane po 30 dniach i nie są używane do trenowania modeli — przyciąga firmy i osoby ceniące bezpieczeństwo danych. Możliwości multimodalne Claude’a pozwalają na zaawansowaną analizę obrazów, dokumentów i treści wizualnych, co znacznie wykracza poza interakcje tekstowe. Wreszcie, dynamiczny wzrost liczby użytkowników (40% r/r do 30 mln miesięcznie) oraz partnerstwa korporacyjne z Accenture i Snowflake potwierdzają silną pozycję Claude’a i zaufanie do platformy.

Zestaw funkcji Claude’a został zaprojektowany, by maksymalizować produktywność i kontrolę użytkownika w różnych zastosowaniach:

Rozwój Claude’a wskazuje na dalsze poszerzanie możliwości, szerszą adopcję w firmach i głębszą integrację z procesami biznesowymi. Roadmapa Anthropic zapowiada ciągłe udoskonalenia metodologii Constitutional AI, w tym badania nad jeszcze bardziej zaawansowanymi technikami dopasowania, które mogłyby dalej ograniczyć szkodliwe treści przy zachowaniu użyteczności. Funkcja Computer Use, obecnie w fazie beta, to ważny krok w kierunku agentowej AI — systemów zdolnych do autonomicznego wykonywania złożonych zadań w wielu aplikacjach i systemach. Wraz z jej rozwojem Claude może stać się nie tylko asystentem konwersacyjnym, lecz także w pełni autonomicznym agentem zarządzającym procesami biznesowymi, prowadzącym badania czy realizującym zadania z minimalnym udziałem człowieka. Rozbudowa możliwości multimodalnych prawdopodobnie będzie kontynuowana, z możliwym dodatkiem przetwarzania i generowania wideo, by rywalizować z Sora od ChatGPT i Veo od Google. Skupienie Anthropic na bezpieczeństwie i dopasowaniu AI pozycjonuje Claude’a korzystnie w kontekście zaostrzających się regulacji dotyczących AI — firmy coraz częściej wybierają dostawców z udokumentowanym podejściem do odpowiedzialnej AI. Ekspansja geograficzna Claude’a (aktywny w 150+ krajach i wszystkich stanach USA) potwierdza ambicję Anthropic, by uczynić Claude’a globalnym standardem AI dla firm. Wreszcie, integracja Claude’a z takimi platformami jak Snowflake i Accenture sugeruje przyszłość, w której Claude stanie się elementem infrastruktury korporacyjnej na wzór chmury obliczeniowej w nowoczesnym biznesie. Wraz z przyspieszającą adopcją AI — 40% pracowników w USA korzysta z AI w pracy, wobec 20% w 2023 roku — Claude, jako asystent AI z naciskiem na bezpieczeństwo i zastosowania korporacyjne, jest dobrze przygotowany do zdobycia istotnego udziału w rynku w nadchodzących latach.

Constitutional AI to metodologia szkolenia stosowana przez Anthropic, która dostosowuje zachowanie Claude'a do zbioru zasad etycznych i wartości ludzkich. Zamiast polegać wyłącznie na opinii ludzi, Constitutional AI wykorzystuje opinie generowane przez AI (RLAIF) do oceny i udoskonalania odpowiedzi względem zdefiniowanej konstytucji zasad. To podejście sprawia, że Claude rzadziej generuje szkodliwe treści, zachowując jednocześnie pomocność i uczciwość, co odróżnia go od konkurencji korzystającej wyłącznie z tradycyjnego wzmacniania przez ludzką opinię (RLHF).

Chociaż Anthropic nie ujawnił publicznie dokładnej liczby parametrów modeli Claude, najnowsze modele Claude 3.5 Sonnet oraz Claude Opus 4 oferują imponujące okno kontekstu sięgające do 500 000 tokenów — co odpowiada około 350 000 słów lub 350 stron tekstu. To znacząco przewyższa konkurentów, takich jak GPT-4 Turbo (128 000 tokenów), pozwalając Claude'owi analizować i zapamiętywać informacje z dużo obszerniejszych dokumentów i rozmów.

Anthropic oferuje trzy główne modele Claude 3: Claude 3.5 Sonnet (najszybszy i najbardziej ekonomiczny), Claude 3 Opus (najpotężniejszy do złożonych zadań) oraz Claude 3 Haiku (najmniejszy i najszybszy do zastosowań w czasie rzeczywistym). Claude 3.5 Sonnet jest dostępny w darmowej wersji Claude AI, natomiast Opus i Haiku są dostępne dla subskrybentów Claude Pro. Każdy model jest zoptymalizowany pod inne zastosowania — od szybkich zapytań po zaawansowane rozumowanie.

Claude nie generuje samodzielnie obrazów ani filmów. Jednak wyróżnia się w tworzeniu interaktywnych wizualizacji, diagramów, schematów blokowych oraz komponentów React za pomocą funkcji Artifacts. Choć to różni się od możliwości DALL-E czy Sora, siła Claude'a leży w zaawansowanej generacji tekstu, tworzeniu kodu i wizualizacji danych, a nie w produkcji generatywnych mediów.

Anthropic stosuje rygorystyczną politykę przechowywania danych, zgodnie z którą wszystkie dane wejściowe i wyjściowe użytkowników są usuwane po 30 dniach. W przeciwieństwie do ChatGPT firmy OpenAI, który może przechowywać dane użytkowników w celu ulepszania modeli, Claude nie wykorzystuje rozmów do trenowania lub ulepszania swoich modeli, o ile użytkownik wyraźnie się na to nie zgodzi. Takie podejście pro-prywatności jest atrakcyjne dla firm i osób dbających o bezpieczeństwo i poufność danych.

Na II kwartał 2025 roku Claude 3.5 przekroczył 30 milionów aktywnych użytkowników miesięcznie na całym świecie, co stanowi wzrost o 40% w porównaniu z II kwartałem 2024 roku. Ten szybki wzrost odzwierciedla rosnącą adopcję wśród firm, m.in. Notion, DuckDuckGo i Accenture, które zintegrowały Claude'a ze swoimi platformami. Szeroki rynek AI odnotował w 2025 roku wydatki firm na generatywną AI na poziomie 37 miliardów dolarów (wzrost z 11,5 miliarda w 2024), przy czym Claude zdobywa znaczący udział w rynku.

Claude jest powszechnie uznawany za lepszego w zadaniach kodowania, przede wszystkim dzięki funkcji Artifacts, umożliwiającej wizualizację i wykonywanie kodu w czasie rzeczywistym. Programiści twierdzą, że Claude generuje czytelniejszy, bardziej funkcjonalny kod i udziela lepszych wyjaśnień. Niedawno wprowadzono też Claude Code — agenta AI do kodowania, który może samodzielnie modyfikować repozytoria kodu, uruchamiać testy i zatwierdzać zmiany na GitHubie, co daje mu przewagę nad ChatGPT w profesjonalnych procesach developerskich.

Zacznij śledzić, jak chatboty AI wspominają Twoją markę w ChatGPT, Perplexity i innych platformach. Uzyskaj praktyczne spostrzeżenia, aby poprawić swoją obecność w AI.

Opanuj optymalizację Claude AI i zwiększ widoczność swojej marki w odpowiedziach Anthropic. Poznaj strategie cytowania, wymagania techniczne i budowanie autoryt...

Dowiedz się, jak zoptymalizować swoją markę, domenę i adresy URL pod odpowiedzi Claude AI. Poznaj najlepsze praktyki inżynierii promptów, strategii treści i wid...

Dowiedz się, czym jest ClaudeBot, jak działa oraz jak zablokować lub zezwolić temu botowi firmy Anthropic na dostęp do Twojej strony za pomocą konfiguracji robo...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.