Czym dokładnie są silniki generatywne? Czym różnią się od Google?

Dyskusja społecznościowa wyjaśniająca silniki generatywne. Przejrzyste wyjaśnienia, jak ChatGPT, Perplexity i inne systemy AI różnią się od tradycyjnego wyszuki...

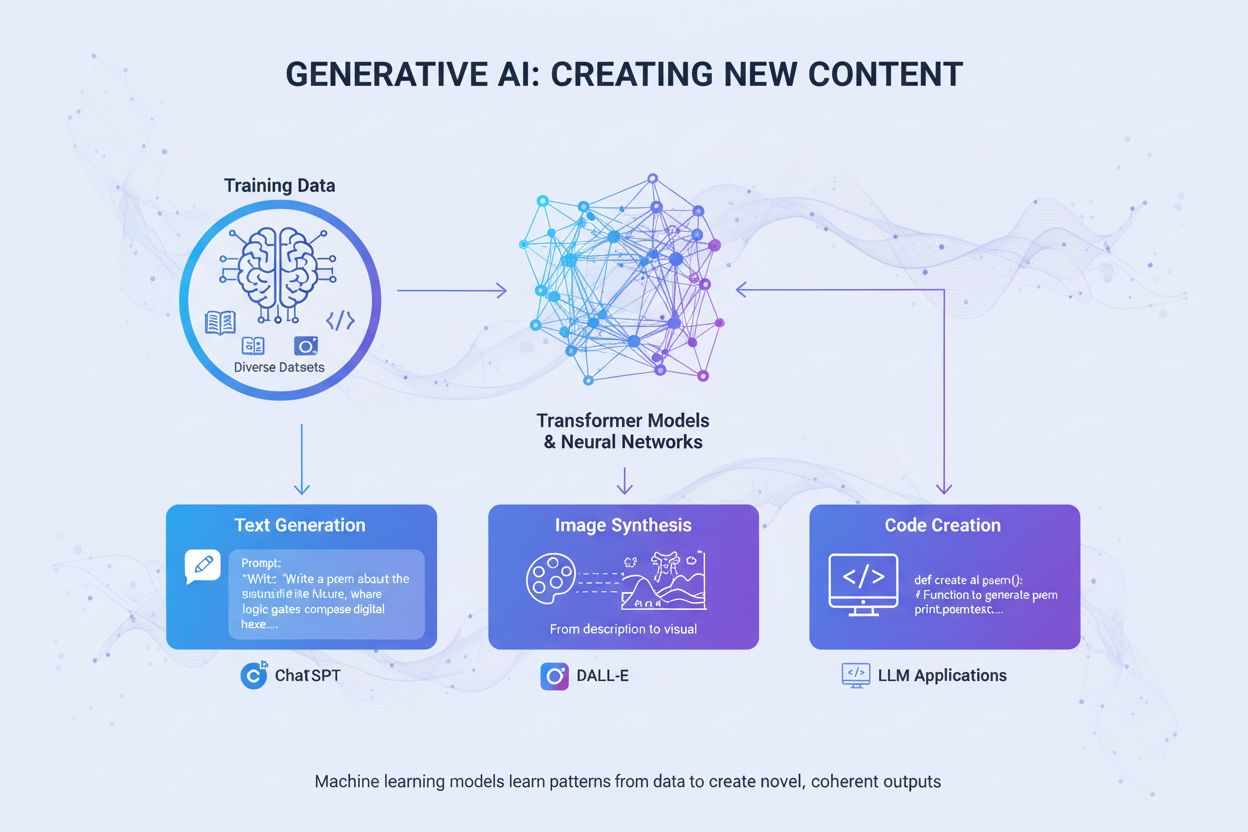

Generatywna SI to sztuczna inteligencja, która tworzy nowe, oryginalne treści, takie jak tekst, obrazy, wideo, kod i dźwięk, na podstawie wzorców wyuczonych z danych treningowych. Wykorzystuje modele głębokiego uczenia, takie jak transformatory i modele dyfuzyjne, aby generować różnorodne wyniki w odpowiedzi na polecenia lub zapytania użytkownika.

Generatywna SI to sztuczna inteligencja, która tworzy nowe, oryginalne treści, takie jak tekst, obrazy, wideo, kod i dźwięk, na podstawie wzorców wyuczonych z danych treningowych. Wykorzystuje modele głębokiego uczenia, takie jak transformatory i modele dyfuzyjne, aby generować różnorodne wyniki w odpowiedzi na polecenia lub zapytania użytkownika.

Generatywna SI to kategoria sztucznej inteligencji, która tworzy nowe, oryginalne treści na podstawie wzorców wyuczonych z danych treningowych. W przeciwieństwie do tradycyjnych systemów SI, które klasyfikują lub przewidują informacje, modele generatywnej SI autonomicznie produkują nowe wyniki, takie jak tekst, obrazy, filmy, dźwięk, kod i inne typy danych w odpowiedzi na polecenia lub zapytania użytkownika. Systemy te wykorzystują zaawansowane modele głębokiego uczenia i sieci neuronowe do identyfikacji złożonych wzorców i relacji w ogromnych zbiorach danych, a następnie używają zdobytej wiedzy do generowania treści podobnych, lecz odmiennych od danych treningowych. Termin “generatywna” podkreśla zdolność modelu do generowania — tworzenia czegoś nowego, a nie jedynie analizowania lub kategoryzowania istniejących informacji. Od momentu publicznego udostępnienia ChatGPT w listopadzie 2022 roku, generatywna SI stała się jedną z najbardziej przełomowych technologii w informatyce, zasadniczo zmieniając podejście organizacji do tworzenia treści, rozwiązywania problemów i podejmowania decyzji w praktycznie każdej branży.

Podstawy generatywnej SI sięgają dziesięcioleci, choć technologia ta ewoluowała dramatycznie w ostatnich latach. Wczesne modele statystyczne XX wieku stworzyły podwaliny pod zrozumienie rozkładów danych, ale prawdziwa generatywna SI pojawiła się wraz z rozwojem głębokiego uczenia i sieci neuronowych w latach 2010. Wprowadzenie wariacyjnych autoenkoderów (VAE) w 2013 roku stanowiło przełom, umożliwiając generowanie realistycznych wariantów danych, takich jak obrazy i mowa. W 2014 roku pojawiły się generatywne sieci przeciwstawne (GAN) oraz modele dyfuzyjne, jeszcze bardziej podnosząc jakość i realizm generowanych treści. Przełomowy moment nastąpił w 2017 roku, kiedy naukowcy opublikowali pracę “Attention is All You Need”, wprowadzając architekturę transformera — innowację, która zasadniczo zmieniła sposób, w jaki modele generatywnej SI przetwarzają i generują dane sekwencyjne. Umożliwiło to rozwój dużych modeli językowych (LLM), takich jak seria GPT firmy OpenAI, które wykazały bezprecedensowe możliwości rozumienia i generowania ludzkiego języka. Według badań McKinsey, już w 2023 roku jedna trzecia organizacji regularnie korzystała z generatywnej SI w co najmniej jednej funkcji biznesowej, a Gartner prognozuje, że do 2026 roku ponad 80% przedsiębiorstw wdroży aplikacje generatywnej SI lub będzie korzystać z jej API. Szybkie przejście od ciekawostki badawczej do niezbędności w biznesie jest jednym z najszybszych cykli przyjmowania technologii w historii.

Generatywna SI działa poprzez wieloetapowy proces, który rozpoczyna się od treningu na ogromnych zbiorach danych, następnie dostrajania do konkretnych zastosowań oraz ciągłych cykli generowania, ewaluacji i ponownego dostrajania. W fazie treningu praktycy podają algorytmom głębokiego uczenia terabajty surowych, nieustrukturyzowanych danych — takich jak teksty z internetu, obrazy czy repozytoria kodu — a algorytm wykonuje miliony ćwiczeń “uzupełnij lukę”, przewidując kolejny element w sekwencji i dostosowując się, by zminimalizować błąd predykcji. W ten sposób powstaje sieć neuronowa parametrów, które kodują wzorce, byty i relacje odkryte w danych treningowych. Efektem jest model bazowy — duży, wstępnie wytrenowany model, zdolny wykonywać wiele zadań w różnych dziedzinach. Modele bazowe, takie jak GPT-3, GPT-4 i Stable Diffusion, stanowią podstawę licznych wyspecjalizowanych aplikacji. Faza dostrajania obejmuje fine-tuning modelu bazowego na oznaczonych danych specyficznych dla danego zadania lub wykorzystanie uczenia ze wzmocnieniem z informacją zwrotną od człowieka (RLHF), gdzie ludzie oceniają różne wyniki, by skierować model na większą dokładność i trafność. Programiści i użytkownicy stale oceniają wyniki i dalej dostrajają modele — czasem nawet co tydzień — aby poprawić wydajność. Inną techniką optymalizacji jest Retrieval Augmented Generation (RAG), która rozszerza model bazowy o dostęp do istotnych zewnętrznych źródeł, zapewniając aktualność informacji i przejrzystość źródeł.

| Typ modelu | Podejście treningowe | Szybkość generowania | Jakość wyników | Różnorodność | Najlepsze zastosowania |

|---|---|---|---|---|---|

| Modele dyfuzyjne | Iteracyjne usuwanie szumu z losowych danych | Wolna (wiele iteracji) | Bardzo wysoka (fotorealistyczna) | Wysoka | Generowanie obrazów, synteza wysokiej wierności |

| Generatywne sieci przeciwstawne (GANs) | Rywalizacja generatora i dyskryminatora | Szybka | Wysoka | Niższa | Generowanie specyficzne dla domeny, transfer stylu |

| Wariacyjne autoenkodery (VAE) | Enkoder-dekoder z przestrzenią latentną | Umiarkowana | Umiarkowana | Umiarkowana | Kompresja danych, wykrywanie anomalii |

| Modele transformerowe | Self-attention na danych sekwencyjnych | Umiarkowana do szybkiej | Bardzo wysoka (tekst/kod) | Bardzo wysoka | Generowanie języka, synteza kodu, LLM |

| Podejścia hybrydowe | Łączenie wielu architektur | Zmienna | Bardzo wysoka | Bardzo wysoka | Generowanie multimodalne, złożone zadania |

Architektura transformera to obecnie najbardziej wpływowa technologia umożliwiająca współczesną generatywną SI. Transformatory wykorzystują mechanizmy samo-uwagi, by określić, które części danych wejściowych są najważniejsze podczas przetwarzania każdego elementu, co pozwala modelowi uchwycić długodystansowe zależności i kontekst. Kodowanie pozycji pozwala reprezentować kolejność elementów wejściowych, umożliwiając rozumienie struktury sekwencji bez przetwarzania liniowego. Ta równoległość znacząco przyspiesza trening w porównaniu do wcześniejszych rekurencyjnych sieci neuronowych (RNN). Struktura enkoder-dekoder transformera, połączona z wieloma warstwami głów uwagi, pozwala modelowi równocześnie rozważać różne aspekty danych i na każdej warstwie udoskonalać kontekstowe osadzenia. Osadzenia te obejmują zarówno gramatykę i składnię, jak i złożone znaczenia semantyczne. Duże modele językowe (LLM), takie jak ChatGPT, Claude i Gemini, są zbudowane na architekturze transformera i zawierają miliardy parametrów — zakodowanych reprezentacji wzorców. Skala tych modeli w połączeniu z treningiem na danych z internetu pozwala im wykonywać różnorodne zadania: od tłumaczeń i streszczeń po kreatywne pisanie i generowanie kodu. Modele dyfuzyjne, kolejna kluczowa architektura, działają poprzez dodanie szumu do danych treningowych aż do ich losowości, a następnie trenowanie algorytmu do iteracyjnego usuwania tego szumu, by uzyskać pożądane wyniki. Choć modele dyfuzyjne wymagają więcej czasu treningu niż VAE czy GAN, dają większą kontrolę nad jakością wyjściową, szczególnie w przypadku narzędzi do generowania obrazów o wysokiej wierności, takich jak DALL-E i Stable Diffusion.

Biznesowy przypadek dla generatywnej SI okazał się przekonujący — przedsiębiorstwa odnotowują wymierne wzrosty produktywności i redukcje kosztów. Według raportu OpenAI dla przedsiębiorstw z 2025 roku, użytkownicy generatywnej SI oszczędzają 40–60 minut dziennie, co przekłada się na znaczną poprawę efektywności organizacji. Rynek generatywnej SI został wyceniony na 16,87 miliarda USD w 2024 roku i prognozuje się, że osiągnie 109,37 miliarda USD do 2030 roku, rosnąc w tempie CAGR 37,6% — jednym z najszybszych w historii oprogramowania dla biznesu. Wydatki przedsiębiorstw na generatywną SI sięgnęły 37 miliardów USD w 2025 roku, w porównaniu do 11,5 miliarda USD w 2024 roku, co oznacza wzrost o 3,2x rok do roku. To przyspieszenie odzwierciedla rosnącą pewność ROI — nabywcy SI konwertują w 47% przypadków, podczas gdy tradycyjne SaaS osiąga 25%, co wskazuje, że generatywna SI zapewnia wystarczającą wartość natychmiastową do uzasadnienia szybkiego wdrożenia. Organizacje wdrażają generatywną SI w wielu funkcjach: zespoły obsługi klienta używają chatbotów SI do personalizowanych odpowiedzi i rozwiązywania zapytań przy pierwszym kontakcie; działy marketingu wykorzystują generowanie treści do blogów, maili i social mediów; zespoły programistyczne stosują narzędzia generowania kodu do przyspieszania cykli wytwarzania; zespoły badawcze analizują ogromne zbiory danych i proponują nowe rozwiązania. Firmy finansowe wykorzystują generatywną SI do wykrywania oszustw i personalizowanych porad finansowych, a organizacje medyczne — do odkrywania leków i analizy obrazowania medycznego. Wszechstronność tej technologii w różnych branżach pokazuje jej transformacyjny potencjał dla działalności biznesowej.

Zastosowania generatywnej SI obejmują praktycznie każdy sektor i funkcję. W generowaniu tekstu modele tworzą spójne, kontekstowo adekwatne treści, w tym dokumentację, teksty marketingowe, artykuły blogowe, prace naukowe i twórcze pisanie. Świetnie sprawdzają się w automatyzacji żmudnych zadań pisarskich, takich jak streszczanie dokumentów czy generowanie metadanych, uwalniając ludzi do kreatywniejszych zadań. Narzędzia do generowania obrazów, takie jak DALL-E, Midjourney i Stable Diffusion, tworzą fotorealistyczne obrazy, oryginalne grafiki, dokonują transferu stylu i edycji zdjęć. Generowanie wideo pozwala na tworzenie animacji na podstawie tekstu oraz nakładanie efektów specjalnych szybciej niż tradycyjnymi metodami. Generowanie dźwięku i muzyki umożliwia syntezę naturalnie brzmiącej mowy do chatbotów i asystentów cyfrowych, tworzenie narracji do audiobooków oraz komponowanie oryginalnej muzyki na poziomie profesjonalnym. Generowanie kodu pozwala programistom pisać oryginalny kod, autouzupełniać fragmenty, tłumaczyć między językami programowania i debugować aplikacje. W medycynie generatywna SI przyspiesza odkrywanie leków, generując nowe sekwencje białek i struktury molekularne o pożądanych właściwościach. Generowanie syntetycznych danych tworzy oznakowane zbiory treningowe dla modeli uczenia maszynowego, szczególnie cenne, gdy prawdziwe dane są ograniczone, niedostępne lub niewystarczające dla rzadkich przypadków. W motoryzacji generatywna SI tworzy symulacje 3D do projektowania pojazdów oraz generuje syntetyczne dane do treningu pojazdów autonomicznych. Media i rozrywka korzystają z generatywnej SI do tworzenia animacji, scenariuszy, środowisk gier i personalizowanych rekomendacji treści. Firmy energetyczne stosują generatywne modele do zarządzania siecią, optymalizacji bezpieczeństwa operacyjnego i prognozowania produkcji energii. Szerokość zastosowań pokazuje, że generatywna SI jest technologią fundamentalną, zmieniającą sposób, w jaki organizacje tworzą, analizują i wdrażają innowacje.

Pomimo imponujących możliwości generatywna SI niesie ze sobą poważne wyzwania, którym organizacje muszą stawić czoła. Halucynacje SI — pozornie wiarygodne, ale faktycznie nieprawdziwe odpowiedzi — pojawiają się, ponieważ modele generatywne przewidują kolejne elementy na podstawie wzorców, a nie weryfikacji faktów. Prawnik, który użył ChatGPT do badań prawniczych, otrzymał całkowicie fikcyjne cytaty z orzeczeń wraz z cytatami i przypisaniami. Problemy z uprzedzeniami i sprawiedliwością wynikają z obecności uprzedzeń społecznych w danych treningowych, przez co modele generują stronnicze, niesprawiedliwe lub obraźliwe treści. Niespójne wyniki to rezultat probabilistycznego charakteru modeli generatywnych, gdzie te same wejścia mogą dawać różne odpowiedzi — co jest problematyczne w zastosowaniach wymagających spójności, jak chatboty obsługi klienta. Brak wyjaśnialności utrudnia zrozumienie, jak modele dochodzą do konkretnych wyników; nawet inżynierowie mają trudności z wyjaśnieniem działania tych “czarnych skrzynek”. Zagrożenia dla bezpieczeństwa i prywatności pojawiają się, gdy poufne dane są wykorzystywane do treningu modeli lub gdy generowane treści naruszają własność intelektualną. Deepfake’i — generowane lub zmanipulowane przez SI obrazy, wideo czy dźwięk — stanowią jedno z najbardziej niepokojących zastosowań, a cyberprzestępcy stosują je do phishingu głosowego i oszustw finansowych. Koszty obliczeniowe pozostają znaczące, a trening dużych modeli bazowych wymaga tysięcy GPU i tygodni pracy, kosztując miliony dolarów. Organizacje ograniczają te ryzyka poprzez zabezpieczenia ograniczające modele do zaufanych źródeł danych, ciągłą ewaluację i dostrajanie celem redukcji halucynacji, zróżnicowane dane treningowe by minimalizować uprzedzenia, inżynierię promptów dla spójnych wyników oraz protokoły bezpieczeństwa chroniące informacje poufne. Przejrzystość użycia SI i nadzór człowieka nad kluczowymi decyzjami pozostają kluczowymi dobrymi praktykami.

Wraz z tym, jak systemy generatywnej SI stają się głównym źródłem informacji dla milionów użytkowników, organizacje muszą rozumieć, jak ich marki, produkty i treści są przedstawiane w odpowiedziach generowanych przez SI. Monitorowanie widoczności SI polega na systematycznym śledzeniu, jak główne platformy generatywnej SI — w tym ChatGPT, Perplexity, Google AI Overviews i Claude — opisują marki, produkty i konkurencję. Jest to kluczowe, ponieważ systemy SI często cytują źródła i przywołują informacje, nie korzystając z tradycyjnych wskaźników widoczności wyszukiwarek. Marki, które nie pojawiają się w odpowiedziach SI, tracą szanse na widoczność i wpływ w świecie wyszukiwania napędzanego SI. Narzędzia takie jak AmICited umożliwiają organizacjom śledzenie wzmianek o marce, monitorowanie poprawności cytowań, identyfikowanie, które domeny i adresy URL są przywoływane w odpowiedziach SI oraz zrozumienie, jak systemy SI przedstawiają ich pozycję konkurencyjną. Dane te pomagają optymalizować treści pod kątem cytowania przez SI, identyfikować dezinformację lub nieprawidłowe przedstawienia oraz utrzymać widoczność konkurencyjną, gdy SI staje się głównym interfejsem między użytkownikami a informacją. Praktyka GEO (Generative Engine Optimization) skupia się na optymalizacji treści pod kątem cytowania i widoczności w SI, uzupełniając tradycyjne strategie SEO. Organizacje, które proaktywnie monitorują i optymalizują swoją widoczność w SI, zyskują przewagę konkurencyjną w nowym, opartym na SI ekosystemie informacyjnym.

Krajobraz generatywnej SI ewoluuje bardzo szybko, a kilka kluczowych trendów kształtuje przyszłość. Systemy multimodalne SI, które płynnie integrują tekst, obraz, wideo i dźwięk, stają się coraz bardziej zaawansowane, umożliwiając generowanie bardziej złożonych i subtelnych treści. Agentowa SI — autonomiczne systemy SI zdolne do realizacji zadań i osiągania celów bez udziału człowieka — to kolejny etap ewolucji, w którym agenci SI wykorzystują generowane treści do interakcji z narzędziami i podejmowania decyzji. Mniejsze, wydajniejsze modele pojawiają się jako alternatywa dla ogromnych modeli bazowych, pozwalając wdrażać generatywną SI przy niższych kosztach obliczeniowych i szybszych czasach odpowiedzi. Retrieval Augmented Generation (RAG) stale się rozwija, umożliwiając modelom dostęp do aktualnych informacji i zewnętrznych źródeł wiedzy, co rozwiązuje problem halucynacji i poprawia dokładność. Ramy regulacyjne rozwijają się na całym świecie, a rządy tworzą wytyczne dla odpowiedzialnego rozwoju i wdrażania SI. Personalizacja dla przedsiębiorstw poprzez fine-tuning i modele specyficzne dla domen przyspiesza, gdy organizacje dążą do adaptowania generatywnej SI do swoich unikalnych kontekstów biznesowych. Etyczne praktyki SI stają się przewagą konkurencyjną, a organizacje priorytetowo traktują przejrzystość, sprawiedliwość i odpowiedzialne wdrażanie. Konwergencja tych trendów sugeruje, że generatywna SI będzie coraz bardziej zintegrowana z działalnością biznesową, bardziej wydajna i dostępna dla organizacji każdej wielkości oraz objęta silniejszym nadzorem i standardami etycznymi. Organizacje, które inwestują w zrozumienie generatywnej SI, monitorują swoją widoczność w SI i wdrażają odpowiedzialne praktyki, będą najlepiej przygotowane do czerpania wartości z tej przełomowej technologii, jednocześnie skutecznie zarządzając związanymi z nią ryzykami.

Generatywna SI tworzy nowe treści poprzez naukę rozkładu danych i generowanie nowych wyników, podczas gdy dyskryminacyjna SI koncentruje się na zadaniach klasyfikacji i predykcji poprzez uczenie się granic decyzyjnych między kategoriami. Modele generatywne, takie jak GPT-3 i DALL-E, tworzą kreatywne treści, natomiast modele dyskryminacyjne lepiej sprawdzają się w zadaniach takich jak rozpoznawanie obrazów czy wykrywanie spamu. Oba podejścia mają różne zastosowania w zależności od tego, czy celem jest tworzenie treści, czy klasyfikacja danych.

Modele transformerowe wykorzystują mechanizmy samo-uwagi (self-attention) oraz kodowanie pozycji do przetwarzania sekwencyjnych danych, takich jak tekst, bez konieczności przetwarzania sekwencyjnego. Ta architektura pozwala transformerom uchwycić długodystansowe zależności między słowami i lepiej rozumieć kontekst niż wcześniejsze modele. Zdolność transformera do jednoczesnego przetwarzania całych sekwencji i uczenia się złożonych zależności sprawiła, że stał się on podstawą większości współczesnych systemów generatywnej SI, w tym ChatGPT i GPT-4.

Modele bazowe to wielkoskalowe modele głębokiego uczenia wstępnie wytrenowane na ogromnych ilościach nieoznaczonych danych, które mogą wykonywać wiele zadań w różnych dziedzinach. Przykładami są GPT-3, GPT-4 i Stable Diffusion. Modele te stanowią podstawę dla różnych zastosowań generatywnej SI i mogą być dostrajane do konkretnych przypadków użycia, co sprawia, że są bardzo wszechstronne i opłacalne w porównaniu do trenowania modeli od podstaw.

Wraz z tym, jak systemy generatywnej SI, takie jak ChatGPT, Perplexity i Google AI Overviews, stają się głównymi źródłami informacji, marki muszą śledzić, jak są przedstawiane w odpowiedziach generowanych przez SI. Monitorowanie widoczności SI pozwala organizacjom zrozumieć percepcję marki, zapewnić prawidłową reprezentację informacji i utrzymać konkurencyjną pozycję w świecie wyszukiwania napędzanego SI. Narzędzia takie jak AmICited umożliwiają markom śledzenie wzmianek i cytowań na wielu platformach SI.

Systemy generatywnej SI mogą generować 'halucynacje' — brzmiące wiarygodnie, ale faktycznie niepoprawne odpowiedzi — ze względu na wzorcowy charakter uczenia. Modele te mogą również odzwierciedlać uprzedzenia obecne w danych treningowych, generować niespójne odpowiedzi dla tych samych zapytań oraz brakować im przejrzystości w procesie podejmowania decyzji. Rozwiązaniem tych problemów jest zróżnicowane zbiory danych treningowych, ciągła ewaluacja i wdrażanie zabezpieczeń ograniczających modele do zaufanych źródeł danych.

Modele dyfuzyjne generują treści poprzez iteracyjne usuwanie szumu z losowych danych, oferując wysoką jakość wyników, ale wolniejsze generowanie. GAN-y wykorzystują dwa konkurujące ze sobą sieci neuronowe (generator i dyskryminator), aby szybko tworzyć realistyczne treści, ale o mniejszej różnorodności. Modele dyfuzyjne są obecnie preferowane do generowania obrazów o wysokiej wierności, natomiast GAN-y pozostają skuteczne w zastosowaniach wymagających równowagi między szybkością a jakością.

Rynek generatywnej SI został wyceniony na 16,87 miliarda USD w 2024 roku i prognozuje się, że osiągnie 109,37 miliarda USD do 2030 roku, rosnąc ze skumulowaną roczną stopą wzrostu (CAGR) na poziomie 37,6% w latach 2025–2030. Wydatki przedsiębiorstw na generatywną SI osiągnęły 37 miliardów USD w 2025 roku, co stanowi wzrost 3,2x rok do roku z 11,5 miliarda USD w 2024 roku, co świadczy o szybkim przyjęciu w różnych branżach.

Odpowiedzialne wdrażanie generatywnej SI wymaga rozpoczęcia od zastosowań wewnętrznych, aby testować wyniki w kontrolowanych środowiskach, zapewnienia przejrzystości przez jasne komunikowanie, kiedy używana jest SI, wdrożenia zabezpieczeń zapobiegających nieautoryzowanemu dostępowi do danych i przeprowadzenia szeroko zakrojonych testów w różnych scenariuszach. Organizacje powinny również ustanowić jasne ramy zarządzania, monitorować wyniki pod kątem uprzedzeń i dokładności oraz utrzymywać nadzór człowieka nad kluczowymi decyzjami.

Zacznij śledzić, jak chatboty AI wspominają Twoją markę w ChatGPT, Perplexity i innych platformach. Uzyskaj praktyczne spostrzeżenia, aby poprawić swoją obecność w AI.

Dyskusja społecznościowa wyjaśniająca silniki generatywne. Przejrzyste wyjaśnienia, jak ChatGPT, Perplexity i inne systemy AI różnią się od tradycyjnego wyszuki...

Dowiedz się, czym są silniki generatywne, jak różnią się od tradycyjnego wyszukiwania i jaki mają wpływ na ChatGPT, Perplexity, Google AI Overviews i Claude. Ko...

Dowiedz się, czym jest Search Generative Experience (SGE), jak działa i dlaczego monitorowanie widoczności Twojej marki w wynikach SGE jest kluczowe dla Twojej ...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.