Semnal de încredere

Semnalele de încredere sunt indicatori de credibilitate care stabilesc fiabilitatea brandului pentru utilizatori și sisteme AI. Află cum insignele verificate, m...

Află cum evaluează sistemele AI semnalele de încredere prin cadrul E-E-A-T. Descoperă factorii de credibilitate care ajută LLM-urile să citeze conținutul tău și să-ți crească autoritatea.

Semnalele de încredere sunt indicatorii și markerii digitali pe care sistemele AI îi folosesc pentru a evalua credibilitatea și fiabilitatea conținutului atunci când generează răspunsuri. Pe măsură ce inteligența artificială devine tot mai integrată în căutare și recuperarea informațiilor, înțelegerea modului în care aceste sisteme evaluează încrederea a devenit esențială pentru creatorii de conținut și branduri. Cadrul E-E-A-T—care înseamnă Experiență, Expertiză, Autoritate și Încredere—oferă o abordare structurată pentru a înțelege cum evaluează AI calitatea conținutului. Dintre acești patru piloni, încrederea a devenit cel mai important factor, deoarece sistemele AI recunosc că chiar și sursele foarte bine informate pot fi nesigure dacă le lipsesc transparența și acreditările verificabile. Modele moderne de limbaj precum ChatGPT, Perplexity și Google AI Overviews analizează mai multe categorii de semnale—including calitatea conținutului, infrastructura tehnică, tiparele comportamentale și alinierea contextuală—pentru a determina ce surse merită să fie evidențiate în răspunsurile lor.

| Pilon | Definiție | Semnal AI | Exemplu |

|---|---|---|---|

| Experiență | Cunoștințe practice, dobândite prin implicare directă | Conținut care demonstrează aplicare reală și implicare personală în subiect | Un dezvoltator software care scrie despre tehnici de depanare pe care le-a folosit personal în mediul de producție |

| Expertiză | Cunoștințe și abilități specializate și aprofundate într-un domeniu anume | Acuratețe tehnică, utilizarea terminologiei de nișă și demonstrarea stăpânirii subiectului | Un cardiolog care explică factorii de risc ai bolilor de inimă folosind terminologie medicală precisă și citări din cercetări actuale |

| Autoritate | Recunoaștere și respect în industrie sau domeniu | Citări din alte surse autoritare, mențiuni media, prezentări și poziții de leadership în industrie | Un cercetător publicat ale cărui lucrări sunt frecvent citate de colegi și prezentate în publicații de top din industrie |

| Încredere | Fiabilitate, transparență și onestitate în comunicare | Atribuire clară a autorului, dezvăluirea conflictelor de interese, acreditări verificabile și acuratețe constantă în timp | Un consultant financiar care dezvăluie clar relațiile de afiliere, își menține acreditările la zi și oferă perspective echilibrate |

Fiecare pilon funcționează în armonie cu ceilalți pentru a crea un profil complet de încredere pe care sistemele AI îl evaluează. Experiența demonstrează că un autor a trecut efectiv prin subiect, făcându-i perspectiva mai valoroasă decât cunoștințele pur teoretice. Expertiza semnalează că autorul deține cunoștințe specializate necesare pentru a oferi informații corecte și nuanțate. Autoritatea indică faptul că industria mai largă recunoaște și respectă contribuțiile autorului. Încrederea, însă, servește drept fundație—fără ea, ceilalți trei piloni își pierd credibilitatea. Sistemele AI acordă o pondere mare încrederii pentru că înțeleg că o sursă de încredere cu expertiză moderată e mai valoroasă decât o sursă nesigură care pretinde o expertiză excepțională.

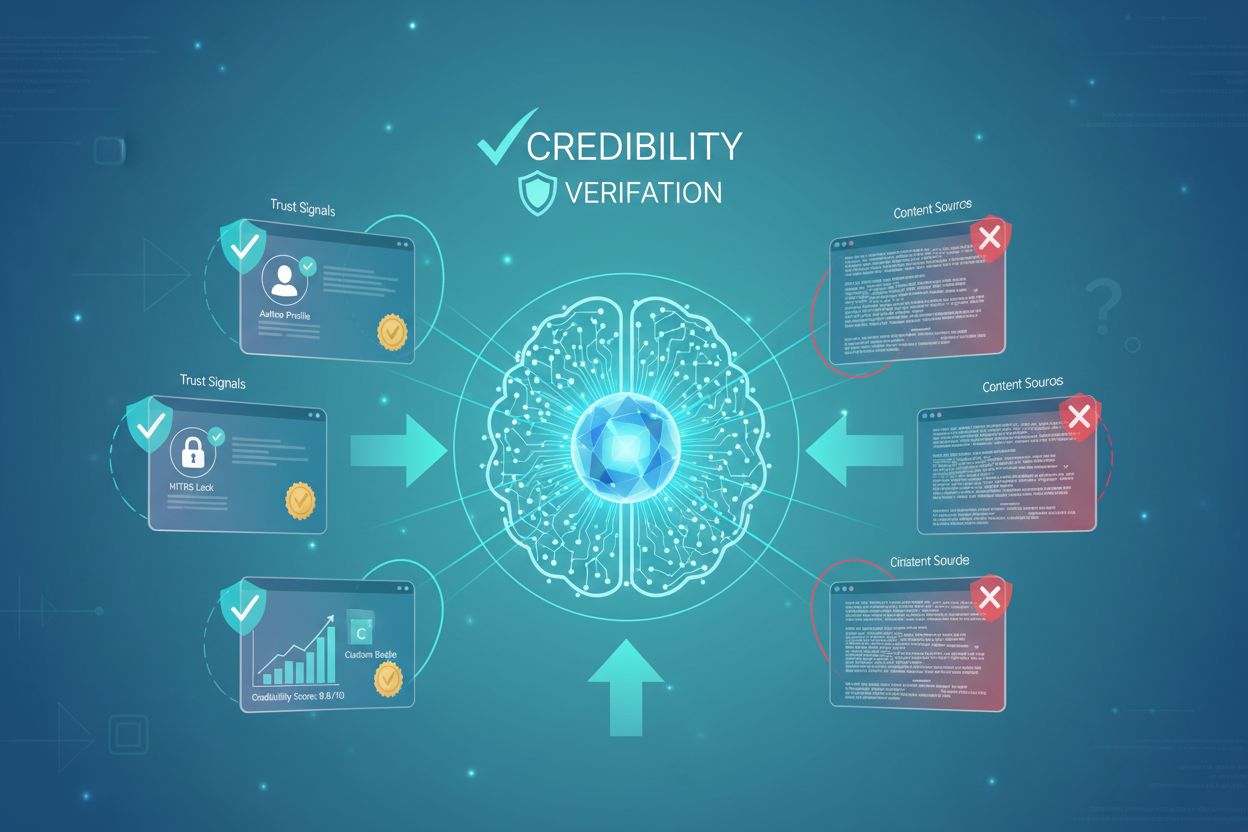

Sistemele AI folosesc un proces sofisticat, în mai multe etape, pentru a evalua semnalele de încredere din conținut. Când un utilizator trimite o interogare, sistemul începe cu înțelegerea interogării, analizând intenția și contextul pentru a determina ce tip de informație este necesară. Sistemul efectuează apoi recuperarea conținutului, extrăgând pasaje relevante din surse indexate de pe web. În faza de clasare a pasajelor, algoritmii AI evaluează credibilitatea fiecărei surse folosind semnale de încredere, aducând în top sursele de calitate superioară și mai de încredere. Verificarea sursei implică verificarea acreditărilor autorului, a datelor de publicare, a autorității domeniului și a coerenței cu alte surse autoritare pe același subiect. Sistemul efectuează apoi selectarea citărilor, alegând ce surse să atribuie în răspunsul final pe baza scorurilor lor de încredere. În cele din urmă, filtrele de siguranță analizează conținutul selectat pentru a se asigura că respectă standardele de acuratețe și nu propagă dezinformare. Întregul proces are loc în milisecunde, iar sistemele AI iau decizii instantanee despre ce surse merită să fie citate în răspunsurile lor.

Credibilitatea autorului este unul dintre cele mai puternice semnale de încredere pe care sistemele AI le evaluează când determină fiabilitatea unei surse. Când conținutul include atribuirea clară a autorului cu acreditări verificabile, sistemele AI pot verifica aceste informații în baze de date recunoscute de experți, profesioniști și autorități. Prezența unui autor nominalizat creează responsabilitate—sistemele AI recunosc că persoanele care își asumă conținutul sunt mai motivate să asigure acuratețea și să mențină standarde profesionale. Dincolo de simpla menționare a numelui, sistemele AI caută câțiva markeri cheie de credibilitate:

Când sistemele AI întâlnesc conținut cu atribuiri de autor detaliate, atribuie scoruri de încredere mai mari deoarece pot verifica istoricul și expertiza autorului. Acest proces de verificare ajută sistemele AI să facă diferența între adevărații experți și creatorii oportuniști fără acreditări reale. Organizațiile care investesc în profiluri solide de autori—cu bios, acreditări și istorii de publicare consistente—transmit sistemelor AI că tratează calitatea conținutului cu seriozitate și își susțin afirmațiile.

Sistemele AI evaluează calitatea conținutului prin mai mulți indicatori de factualitate care arată dacă informația este de încredere și corectă. Afirmațiile specifice și cuantificabile semnalează o încredere mai mare decât generalitățile vagi—când conținutul include statistici precise, date și măsurători, sistemele AI recunosc că autorul a investit efort în cercetare și verificare. Informațiile fundamentate care fac referire la studii, rapoarte sau evenimente documentate cântăresc mai mult decât afirmațiile abstracte, deoarece sistemele AI pot verifica aceste surse cu informații de încredere. Exemplele concrete care ilustrează concepte prin scenarii reale demonstrează o înțelegere profundă și oferă cititorilor perspective aplicabile, ceea ce sistemele AI recunosc ca un semn al calității. Absența erorilor factuale este deosebit de importantă; sistemele AI mențin baze de date interne și pot identifica când conținutul contrazice fapte bine stabilite sau conține informații învechite. De asemenea, prezentarea echilibrată a mai multor perspective asupra subiectelor complexe semnalează încredere, deoarece sistemele AI recunosc că argumentele simplificate sau unilaterale ascund adesea o înțelegere incompletă sau interese ascunse.

Infrastructura tehnică din spatele conținutului tău transmite semnale importante de încredere către sistemele AI care evaluează fiabilitatea și legitimitatea site-ului tău. Criptarea HTTPS este acum o așteptare de bază; sistemele AI recunosc că site-urile care folosesc protocoale sigure tratează cu seriozitate protecția datelor și sunt mai predispuse să mențină standarde ridicate în toate operațiunile. Măsurile de performanță ale site-ului, inclusiv timpii rapizi de încărcare și responsivitatea pe mobil, indică faptul că ai investit într-o infrastructură de calitate, ceea ce corelează cu profesionalismul și calitatea conținutului. Crawlabilitatea și indexabilitatea asigură că sistemele AI pot accesa și analiza eficient conținutul tău; site-urile cu fișiere robots.txt corecte, sitemap-uri XML și structuri URL curate semnalează că înțelegi și respecți modul în care motoarele de căutare și AI descoperă conținutul. Markup-ul schema și implementarea datelor structurate (folosind formate ca JSON-LD pentru informații despre autor, date de publicare și metadate de articol) oferă sistemelor AI informații în format citibil de mașini care confirmă și validează afirmațiile din conținutul tău. Toate aceste elemente tehnice lucrează împreună pentru a crea un mediu în care sistemele AI pot evalua și cita cu încredere conținutul tău, știind că infrastructura de bază susține acuratețea și fiabilitatea.

Transparența este o piatră de temelie a încrederii pe care sistemele AI o evaluează activ când analizează credibilitatea surselor. Pagini Despre și Contact care oferă informații clare despre organizație, misiune și modalități de contact demonstrează că ești dispus să răspunzi pentru conținutul tău. Declarațiile de afiliere și dezvăluirile conflictelor de interese sunt deosebit de importante; sistemele AI recunosc că sursele care recunosc deschis posibilele prejudecăți sunt mai de încredere decât cele care ascund relațiile financiare. Politicile de confidențialitate care explică modul în care gestionezi datele utilizatorilor semnalează respect pentru confidențialitate și conformitate cu reglementările, ceea ce sistemele AI asociază cu încrederea generală. Datele de publicare și actualizare le permit sistemelor AI să evalueze prospețimea conținutului și să înțeleagă când a fost creată sau revizuită ultima dată informația—acest aspect e crucial pentru subiectele în care informația se schimbă frecvent. Documentarea corecțiilor care arată că ai identificat și corectat erori demonstrează onestitate intelectuală și angajament pentru acuratețe. Organizațiile care mențin practici transparente pe toate aceste dimensiuni semnalează sistemelor AI că prioritizează acuratețea și încrederea utilizatorilor în fața câștigurilor pe termen scurt, ceea ce duce la scoruri mai mari de credibilitate.

Validarea externă din partea altor surse autoritare amplifică semnificativ semnalele tale de încredere în ochii sistemelor AI. Backlink-urile de la domenii stabile și cu autoritate acționează ca un fel de recomandare; când organizații respectate fac referire la conținutul tău, sistemele AI interpretează acest lucru ca pe o verificare independentă a credibilității tale. Mențiunile în presă și acoperirea media în publicații recunoscute indică faptul că jurnaliștii și editorii ți-au verificat expertiza și au considerat opiniile tale demne de împărtășit publicului. Recunoașterea în industrie prin premii, certificări sau includerea în directoare autoritare oferă sistemelor AI dovezi obiective ale poziției tale în domeniu. Prezentările la conferințe și contribuțiile la publicații de specialitate arată că profesioniștii și liderii din industrie recunosc expertiza ta și sunt dispuși să își asocieze credibilitatea cu a ta. Recunoașterea entității de către baze de date și chiar de către sistemele AI—atunci când organizația sau brandul tău personal este identificat ca o entitate notabilă în domeniu—creează un efect de feedback pozitiv, crescând scorurile tale de autoritate. Aceste semnale de validare externă acționează cumulativ; cu cât mai multe surse autoritare fac referire și recomandă conținutul tău, cu atât scorul de încredere pe care ți-l atribuie sistemele AI este mai mare pentru conținutul viitor.

Tiparele de comportament ale utilizatorilor oferă sistemelor AI indicii indirecte, dar puternice, despre încrederea și valoarea conținutului. Timpul petrecut pe pagină arată dacă cititorii consideră conținutul tău suficient de substanțial pentru a rămâne implicați; sistemele AI recunosc că oamenii petrec mai mult timp cu conținutul pe care îl consideră valoros și de încredere. Măsurile de implicare precum comentariile, distribuirea și interacțiunile arată că materialul tău rezonează cu publicul și stârnește discuții relevante, ceea ce corelează cu calitatea și fiabilitatea. Ratele de respingere mai mici decât media din industrie sugerează că vizitatorii găsesc ceea ce caută și au suficientă încredere în informații pentru a explora mai mult, în loc să părăsească site-ul imediat. Vizitele repetate de la aceiași utilizatori semnalează că materialul tău s-a dovedit valoros în timp și că cititorii au încredere să revină pentru informații suplimentare. Distribuirile pe rețelele sociale, în special cele provenite de la conturi cu autoritate și audiență activă, amplifică semnalele tale de încredere la nivel web. Sistemele AI analizează aceste semnale comportamentale deoarece înțeleg că încrederea autentică a utilizatorilor—demonstrată prin implicare constantă și reveniri frecvente—este unul dintre cele mai autentice semne ale calității și fiabilității conținutului.

Dezvoltarea unui profil solid de încredere necesită o abordare sistematică de implementare și optimizare a semnalelor E-E-A-T pe tot conținutul și prezența ta digitală. Începe cu un audit al semnalelor E-E-A-T existente, identificând pilonii puternici și pe cei care au nevoie de dezvoltare; această evaluare inițială arată unde să-ți concentrezi eforturile pentru impact maxim. Implementează atribuirea clară a autorului pe tot conținutul, inclusiv bios detaliate care să evidențieze acreditările, experiența și expertiza; asigură-te că informațiile despre autor sunt consistente pe toate platformele unde apare conținutul tău. Adaugă markup schema pe site-ul tău folosind formatul JSON-LD pentru a oferi sistemelor AI informații lizibile de mașini despre autori, date de publicare, subiecte de articol și detalii organizaționale. Construiește backlink-uri de calitate creând conținut cu adevărat valoros pe care alte surse autoritare doresc să-l citeze; concentrează-te pe obținerea de legături din domenii relevante și respectate, nu pe cantitate. Menține prospețimea conținutului actualizând regulat articolele existente cu informații noi, cercetări recente și eliminând afirmațiile învechite; sistemele AI recunosc că materialul activ întreținut este mai de încredere decât articolele abandonate. Monitorizează modul în care sistemele AI citează brandul tău folosind instrumente precum AmICited, care urmăresc când și cum AI Overviews, ChatGPT, Perplexity și alte sisteme AI fac referire la conținutul tău; această vizibilitate îți permite să înțelegi ce semnale de încredere funcționează și unde ai nevoie de îmbunătățiri. Prin construirea sistematică a acestor semnale de încredere, creezi o fundație solidă care ajută sistemele AI să-ți citeze cu încredere conținutul și să-l recomande utilizatorilor care caută informații fiabile.

E-E-A-T este un cadru ce cuprinde patru piloni: Experiență, Expertiză, Autoritate și Încredere. Semnalele de încredere sunt indicatorii și markerii specifici pe care sistemele AI îi folosesc pentru a evalua fiecare pilon. Gândește-te la E-E-A-T ca la un standard general de calitate, iar semnalele de încredere ca la dovezile măsurabile care demonstrează că îndeplinești acel standard.

Site-urile mici pot construi semnale de încredere concentrându-se pe atribuirea autorului, crearea de conținut de înaltă calitate într-o nișă specifică, implementarea markup-ului schema, obținerea de backlinkuri din surse relevante și menținerea unor practici transparente. Nu ai nevoie de trafic masiv sau de recunoaștere a brandului—sistemele AI apreciază profunzimea expertizei și consistența într-o arie restrânsă, mai degrabă decât acoperirea largă.

Da, HTTPS este acum o așteptare de bază pentru încredere. Sistemele AI recunosc că site-urile care folosesc protocoale sigure tratează cu seriozitate protecția datelor utilizatorilor și sunt mai predispuse să mențină standarde înalte în toate operațiunile. Este unul dintre semnalele tehnice fundamentale care contribuie la scorul tău general de credibilitate.

Construirea unor semnale de încredere autentice este o strategie pe termen lung care de obicei necesită luni pentru a produce rezultate semnificative. Totuși, implementarea unor îmbunătățiri tehnice precum markup-ul schema și atribuirea autorului poate avea efecte mai imediate. Cheia este consistența—publicarea regulată de conținut de calitate, menținerea acurateței și construirea validării externe în timp.

Sistemele AI devin din ce în ce mai sofisticate în detectarea inconsecvențelor și afirmațiilor false. Ele verifică informațiile despre autori în baze de date cunoscute, verifică exactitatea faptelor pe baza datelor lor de antrenament și analizează tiparele din mai multe surse. Încercarea de a falsifica acreditări sau de a face afirmații mincinoase este riscantă și probabil îți va afecta credibilitatea atunci când va fi descoperită.

Poți testa acest lucru căutând subiectele tale pe platforme AI precum ChatGPT cu browsing, Perplexity și Google AI Overviews, apoi verificând dacă URL-urile tale apar în citări. Pentru monitorizare sistematică, instrumente precum AmICited urmăresc când și cum sistemele AI fac referire la conținutul tău pe mai multe platforme, oferindu-ți vizibilitate asupra citărilor AI.

Semnale precum timpul petrecut pe pagină, vizitele repetate și distribuirea socială indică pentru sistemele AI că conținutul tău este valoros și de încredere. Sistemele AI recunosc că încrederea reală din partea utilizatorilor—demonstrată prin implicare susținută—este unul dintre cele mai autentice indicii ale calității și fiabilității conținutului.

Da, transparența legată de modul în care a fost creat conținutul este importantă pentru credibilitate. Dacă folosești instrumente AI pentru a ajuta la crearea conținutului, menționarea acestui lucru și explicarea modului în care a fost folosit AI îi ajută pe cititori și pe sistemele AI să înțeleagă originea conținutului. Transparența cu privire la procesele tale construiește încredere mai eficient decât ascunderea modului în care a fost produs conținutul.

Urmărește modul în care sistemele AI precum ChatGPT, Perplexity și Google AI Overviews fac referire la brandul tău. Înțelege-ți semnalele de încredere și îmbunătățește-ți vizibilitatea în AI.

Semnalele de încredere sunt indicatori de credibilitate care stabilesc fiabilitatea brandului pentru utilizatori și sisteme AI. Află cum insignele verificate, m...

Discuție comunitară despre demonstrarea încrederii pentru vizibilitatea în căutarea AI. Experiențe reale din partea echipelor de conținut despre semnalele de în...

Află cum să crești semnalele de încredere AI în ChatGPT, Perplexity și Google AI Overviews. Construiește identitatea entității, dovezi și încredere tehnică pent...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.