Ako napadnúť a opraviť nepresné informácie v odpovediach AI

Zistite, ako napadnúť nepresné AI informácie, nahlásiť chyby ChatGPT a Perplexity a implementovať stratégie na zabezpečenie presného zastúpenia vašej značky v A...

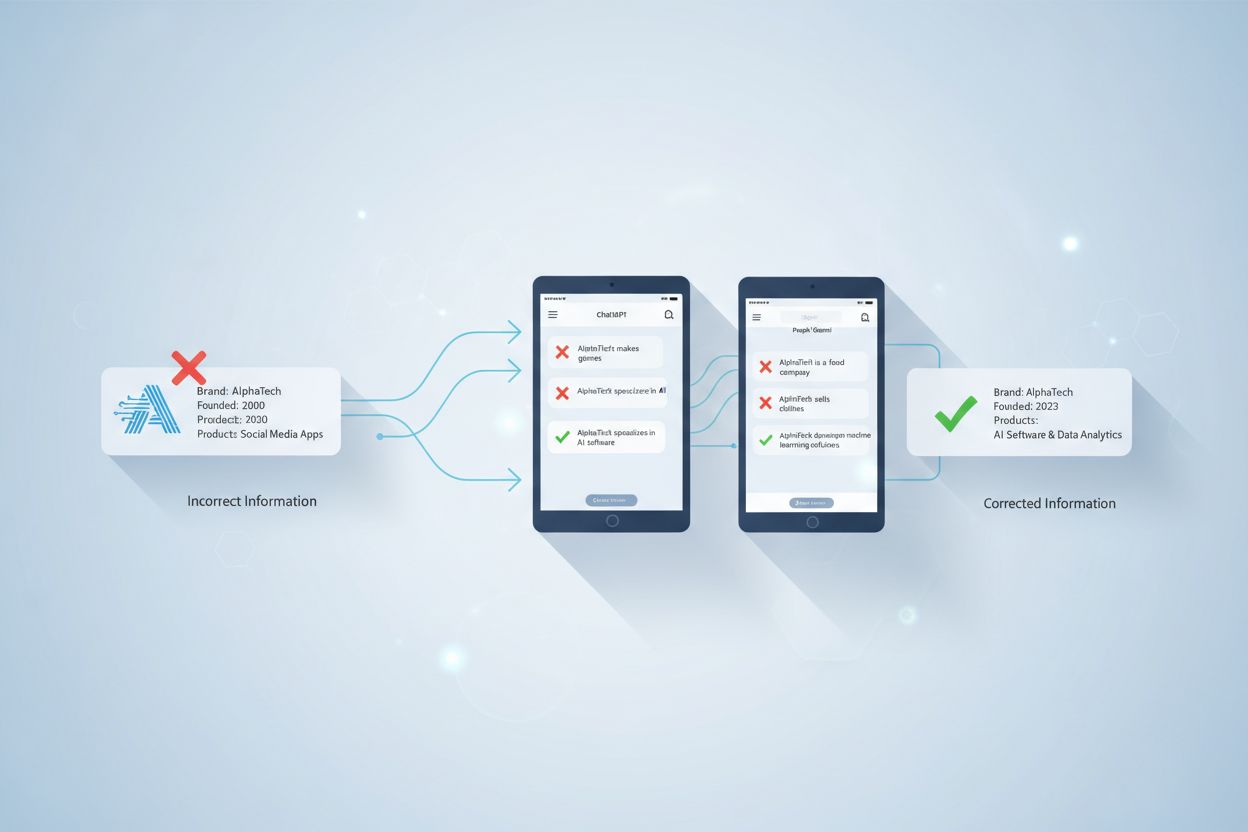

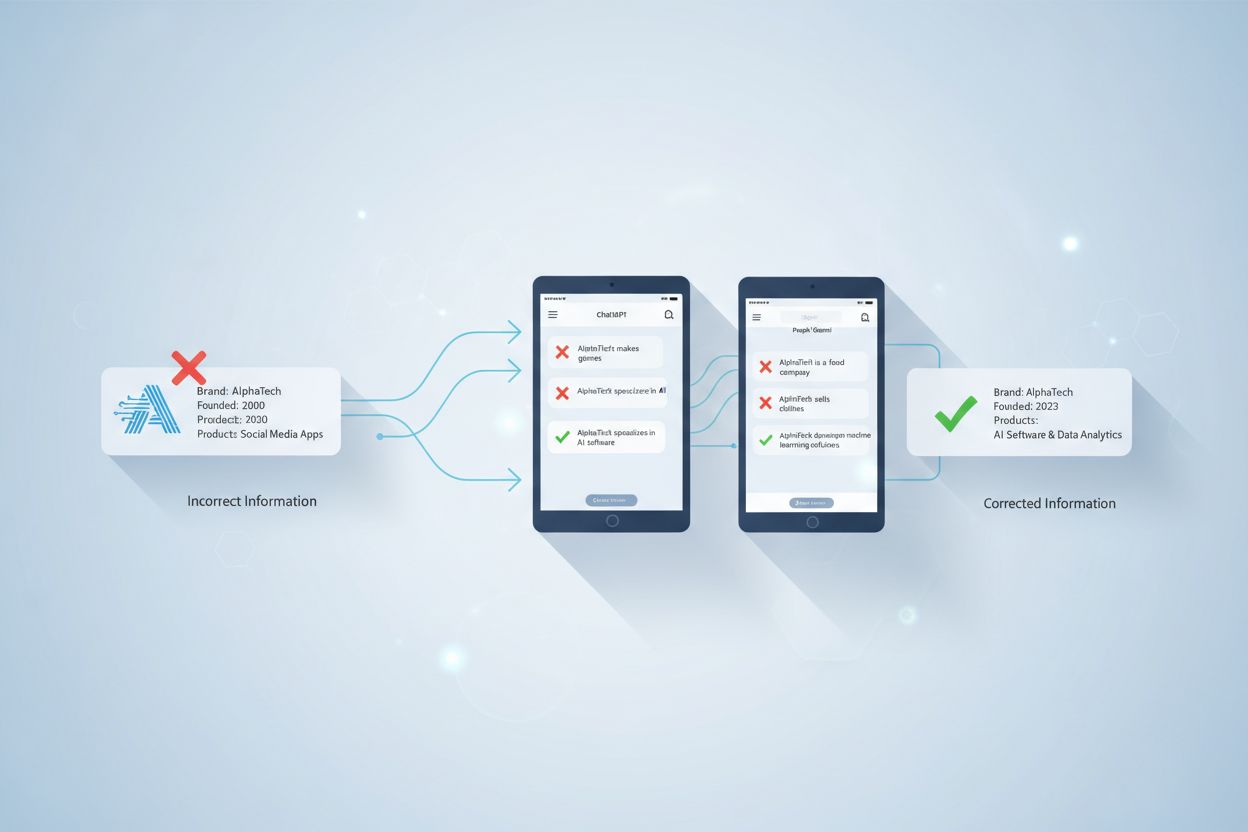

Oprava dezinformácií v AI označuje stratégie a nástroje na identifikáciu a riešenie nesprávnych informácií o značke, ktoré sa objavujú v odpovediach generovaných umelou inteligenciou zo systémov ako ChatGPT, Gemini a Perplexity. Zahŕňa monitorovanie toho, ako AI systémy prezentujú značky, a implementáciu opráv na úrovni zdrojov, aby sa zabezpečilo, že presné informácie sú distribuované na dôveryhodných platformách. Na rozdiel od tradičného overovania faktov sa zameriava na opravu zdrojov, ktorým AI dôveruje, namiesto samotných AI výstupov. Toto je nevyhnutné pre udržanie reputácie značky a presnosti v prostredí vyhľadávania poháňaného AI.

Oprava dezinformácií v AI označuje stratégie a nástroje na identifikáciu a riešenie nesprávnych informácií o značke, ktoré sa objavujú v odpovediach generovaných umelou inteligenciou zo systémov ako ChatGPT, Gemini a Perplexity. Zahŕňa monitorovanie toho, ako AI systémy prezentujú značky, a implementáciu opráv na úrovni zdrojov, aby sa zabezpečilo, že presné informácie sú distribuované na dôveryhodných platformách. Na rozdiel od tradičného overovania faktov sa zameriava na opravu zdrojov, ktorým AI dôveruje, namiesto samotných AI výstupov. Toto je nevyhnutné pre udržanie reputácie značky a presnosti v prostredí vyhľadávania poháňaného AI.

Oprava dezinformácií v AI označuje stratégie, procesy a nástroje používané na identifikáciu a riešenie nesprávnych, zastaraných alebo zavádzajúcich informácií o značkách, ktoré sa objavujú v odpovediach generovaných umelou inteligenciou zo systémov ako ChatGPT, Gemini a Perplexity. Nedávny výskum ukazuje, že približne 45% AI dopytov produkuje chybné odpovede, vďaka čomu je presnosť značky v AI systémoch kľúčovou témou pre firmy. Na rozdiel od tradičných výsledkov vyhľadávania, kde môžu značky kontrolovať svoje vlastné záznamy, AI systémy syntetizujú informácie z viacerých webových zdrojov, čím vytvárajú komplexné prostredie, kde môžu dezinformácie ticho pretrvávať. Výzvou nie je len opraviť jednotlivé AI odpovede – ide o pochopenie, prečo AI systémy získavajú informácie o značkách nesprávne, a implementáciu systematických opráv na úrovni zdroja.

AI systémy si nevymýšľajú informácie o značkách od nuly; skladajú ich z toho, čo už existuje na internete. Tento proces však vytvára niekoľko predvídateľných bodov zlyhania, ktoré vedú k nesprávnej prezentácii značky:

| Koreňová príčina | Ako k tomu dochádza | Dopad na podnikanie |

|---|---|---|

| Nekonzistentnosť zdrojov | Značka je opísaná rôzne na webstránkach, v adresároch a článkoch | AI vyvodzuje nesprávny konsenzus z protichodných informácií |

| Zastarané autoritatívne zdroje | Staré záznamy na Wikipédii, v adresároch alebo porovnávacích stránkach obsahujú nesprávne údaje | Novšie opravy sú ignorované, lebo staršie zdroje majú vyšší signál autority |

| Zámena entít | Podobné názvy značiek alebo prekrývajúce sa kategórie mätú AI systémy | Konkurenti získajú kredit za vaše schopnosti alebo je značka úplne vynechaná |

| Chýbajúce primárne signály | Chýba štruktúrované dáta, jasná stránka ‘O nás’ alebo konzistentná terminológia | AI je nútená domýšľať informácie, čo vedie k nejasným alebo nesprávnym popisom |

Keď je značka opísaná rôzne naprieč platformami, AI systémy majú problém určiť, ktorá verzia je autoritatívna. Namiesto žiadania o upresnenie vyvodzujú konsenzus na základe frekvencie a vnímanej autority – aj keď je tento konsenzus nesprávny. Malé rozdiely v názvoch značiek, popisoch alebo pozicioningu sa často duplikujú naprieč platformami a po opakovaní sa tieto fragmenty stanú signálmi, ktoré AI modely vnímajú ako dôveryhodné. Problém sa zhoršuje, keď zastarané, ale autoritatívne stránky obsahujú chybné informácie; AI systémy často uprednostňujú tieto staršie zdroje pred novšími opravami, najmä ak sa opravy nerozšírili naprieč dôveryhodnými platformami.

Oprava nesprávnych informácií o značke v AI systémoch vyžaduje zásadne odlišný prístup ako tradičné SEO úpravy. V tradičnom SEO značky aktualizujú vlastné zápisy, opravujú NAP (názov, adresa, telefón) údaje a optimalizujú obsah stránok. Oprava značky v AI sa zameriava na zmenu toho, čo dôveryhodné zdroje hovoria o vašej značke, nie na kontrolu vlastnej viditeľnosti. Neopravujete AI priamo – opravujete to, čomu AI dôveruje. Pokusy “opraviť” AI odpovede opakovaným uvádzaním nesprávnych tvrdení (aj keď ich popierate) môžu mať opačný efekt, pretože posilňujú asociáciu, ktorú sa snažíte odstrániť. AI systémy rozpoznávajú vzory, nie zámer. To znamená, že každá oprava musí začať na úrovni zdroja – spätne od miesta, kde sa AI skutočne učí informácie.

Predtým, ako môžete opraviť nesprávne informácie o značke, potrebujete prehľad o tom, ako vás AI systémy aktuálne opisujú. Efektívne monitorovanie sa zameriava na:

Manuálna kontrola je nespoľahlivá, pretože AI odpovede sa líšia podľa zadania, kontextu a aktualizačného cyklu. Štruktúrované monitorovacie nástroje poskytujú prehľad potrebný na včasné odhalenie chýb, skôr než sa zakorenia v AI systémoch. Mnohé značky si neuvedomia, že ich AI prezentuje nesprávne, kým na to neupozorní zákazník alebo nevypukne kríza. Proaktívne monitorovanie tomu predchádza zachytením nekonzistencií skôr, než sa rozšíria.

Keď identifikujete nesprávne informácie o značke, oprava musí nastať tam, kde sa z nich AI učí – nie tam, kde sa chyba len objavuje. Efektívne opravy na úrovni zdroja zahŕňajú:

Kľúčovým princípom je: opravy fungujú len vtedy, ak sa vykonajú na úrovni zdroja. Zmeniť, čo sa objaví vo výstupe AI bez opravy pôvodných zdrojov je len dočasné riešenie. AI systémy priebežne prehodnocujú signály, keď sa objaví nový obsah alebo sa vracajú staršie stránky. Oprava, ktorá nerieši pôvodný zdroj, bude napokon prepísaná pôvodnou dezinformáciou.

Pri opravách nepresných informácií o značke v adresároch, trhoch či AI platformách väčšina systémov vyžaduje overenie, ktoré značku spája s legitímnym vlastníctvom a používaním. Najčastejšie požadovaná dokumentácia zahŕňa:

Cieľom nie je množstvo, ale konzistentnosť. Platformy posudzujú, či dokumentácia, záznamy a verejné údaje o značke spolu sedia. Mať tieto materiály pripravené vopred skráti cykly odmietnutia a urýchli schválenie pri opravách vo väčšom rozsahu. Konzistentnosť naprieč zdrojmi signalizuje AI systémom, že informácie o vašej značke sú spoľahlivé a autoritatívne.

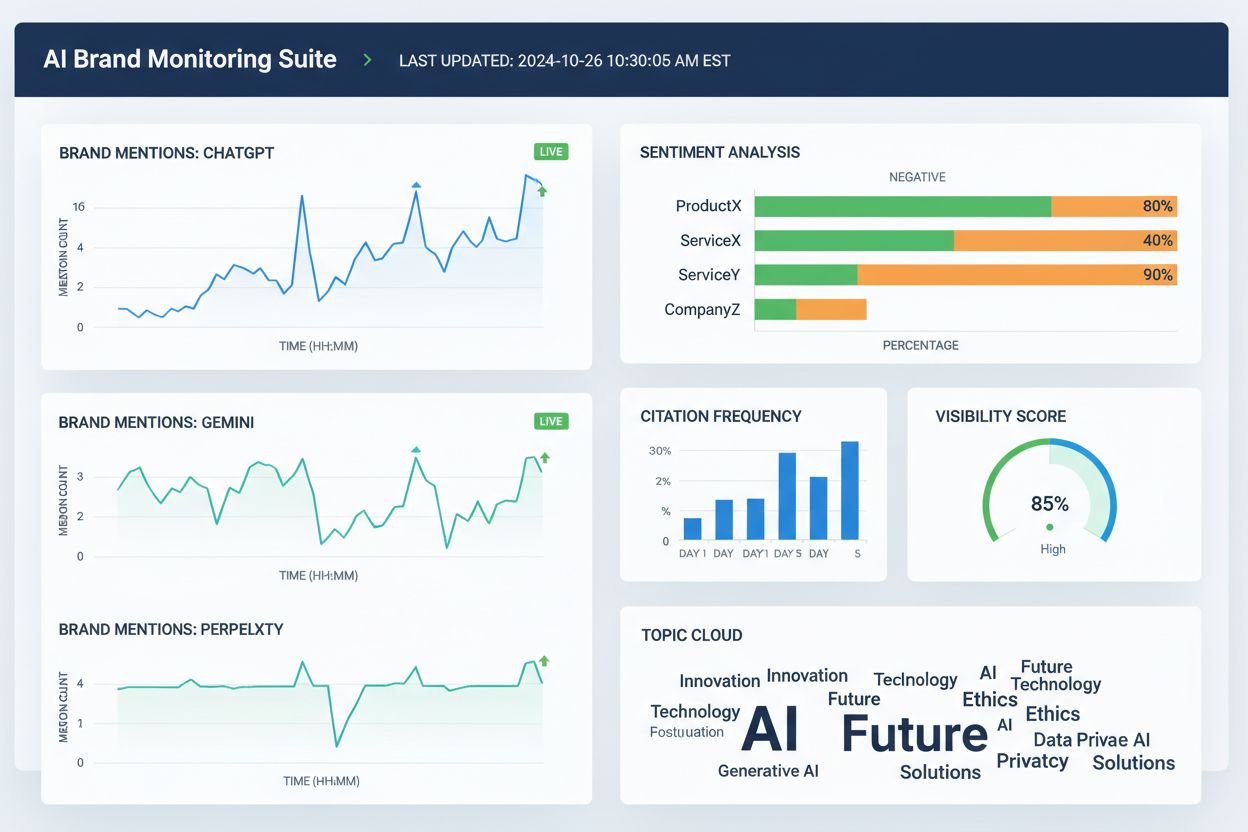

Niekoľko nástrojov dnes pomáha tímom sledovať prezentáciu značky naprieč AI vyhľadávačmi a širším webom. Hoci sa ich schopnosti prekrývajú, všeobecne sa zameriavajú na viditeľnosť, pripísanie a konzistentnosť:

Tieto nástroje priamo neopravia nesprávne informácie o značke. Pomáhajú však včas odhaliť chyby, identifikovať nesúlady v údajoch o značke skôr, než sa rozšíria, overiť, či opravy na úrovni zdroja zlepšujú presnosť AI, a sledovať dlhodobé trendy v pripísaní a viditeľnosti v AI. V kombinácii s opravami zdrojov a dokumentáciou poskytujú monitorovacie nástroje spätnú väzbu potrebnú na udržateľné opravy nesprávnych informácií o značke.

Presnosť vyhľadávania v AI sa zlepšuje, keď sú značky jasne definované entity, nie len neurčití členovia kategórie. Na zníženie nesprávnej prezentácie značky v AI systémoch sa zamerajte na:

Cieľom nie je povedať viac – ale hovoriť všade to isté. Keď AI systémy narazia na konzistentné definície značky v autoritatívnych zdrojoch, prestanú hádať a začnú opakovať správne informácie. Tento krok je obzvlášť dôležitý pre značky, ktoré zažívajú nesprávne zmienky, pripísanie konkurentovi alebo vynechanie z relevantných AI odpovedí. Aj po oprave nesprávnych údajov nie je presnosť trvalá. AI systémy neustále prehodnocujú signály, preto je trvalá jasnosť nevyhnutná.

Neexistuje fixná časová os na opravu nesprávnej prezentácie značky v AI systémoch. AI modely aktualizujú informácie na základe sily signálov a konsenzu, nie podľa dátumu zadania. Typické vzory sú:

Prvé pokroky sa málokedy prejavia ako náhla “opravená” odpoveď. Namiesto toho sledujte nepriame signály: zníženú variabilitu AI odpovedí, menej konfliktných popisov, viac konzistentných citácií naprieč zdrojmi a postupné zahrnutie vašej značky tam, kde predtým chýbala. Stagnácia vyzerá inak – ak sa rovnaké nesprávne formulácie opakujú napriek viacerým opravám, zvyčajne to znamená, že pôvodný zdroj nebol opravený alebo je potrebné silnejšie posilnenie inde.

Najspoľahlivejším spôsobom, ako opraviť nesprávne informácie o značke, je znížiť podmienky, ktoré ich umožňujú už v zárodku. Efektívna prevencia zahŕňa:

Značky, ktoré vnímajú AI viditeľnosť ako živý systém – nie jednorazový projekt čistenia – sa zotavia z chýb rýchlejšie a zažijú menej opakovaných prípadov nesprávnej prezentácie. Prevencia nespočíva v kontrole AI výstupov. Ide o udržiavanie čistých, konzistentných vstupov, ktoré AI môže sebavedome opakovať. S pokračujúcim vývojom AI vyhľadávania budú úspešné tie značky, ktoré vnímajú opravu dezinformácií ako nepretržitý proces vyžadujúci kontinuálne monitorovanie, správu zdrojov a strategické posilňovanie presných informácií na dôveryhodných platformách.

Oprava dezinformácií v AI je proces identifikácie a opravy nesprávnych, zastaraných alebo zavádzajúcich informácií o značkách, ktoré sa objavujú v odpovediach generovaných AI. Na rozdiel od tradičného overovania faktov sa zameriava na opravu zdrojov, ktorým AI dôveruje (adresáre, články, záznamy), namiesto priamej úpravy AI výstupov. Cieľom je zabezpečiť, aby používatelia pri otázkach na AI systémy o vašej značke dostávali presné informácie.

AI systémy ako ChatGPT, Gemini a Perplexity ovplyvňujú, ako milióny ľudí vnímajú značky. Výskum ukazuje, že 45% AI dopytov obsahuje chyby a nesprávne informácie o značke môžu poškodiť reputáciu, zmiasť zákazníkov a viesť k strate podnikania. Na rozdiel od tradičného vyhľadávania, kde si značky spravujú vlastné záznamy, AI systémy syntetizujú informácie z viacerých zdrojov, vďaka čomu je presnosť značky ťažšie kontrolovať, ale o to dôležitejšie ju riadiť.

Nie, priama oprava nie je účinná. AI systémy neukladajú fakty o značke na upraviteľných miestach – odpovede vytvárajú syntézou externých zdrojov. Opakované žiadanie AI, aby 'opravila' informácie, môže dokonca posilniť halucinácie tým, že upevní asociáciu, ktorú sa snažíte odstrániť. Opravy musia byť vykonané na úrovni zdroja: aktualizovaním adresárov, opravou zastaraných záznamov a publikovaním presných informácií na dôveryhodných platformách.

Neexistuje pevná časová os, pretože AI systémy aktualizujú dáta na základe sily signálov a konsenzu, nie podľa dátumu zadania. Menšie faktické opravy sa prejavia zvyčajne do 2-4 týždňov, objasnenia na úrovni entity trvajú 1-3 mesiace a konkurenčné vytlačenie môže trvať 3-6 mesiacov alebo viac. Pokrok sa málokedy prejaví náhle – miesto toho sledujte zníženie variability odpovedí a viac konzistentných citácií naprieč zdrojmi.

Niekoľko nástrojov dnes sleduje prezentáciu značky naprieč AI platformami: Wellows monitoruje zmienky a sentiment v ChatGPT, Gemini a Perplexity; Profound porovnáva viditeľnosť naprieč LLM; Otterly.ai analyzuje sentiment značky v AI odpovediach; BrandBeacon poskytuje analytiku pozicioningu; Ahrefs Brand Radar sleduje webové zmienky; a AmICited.com sa špecializuje na monitorovanie, ako sú značky citované a prezentované naprieč AI systémami. Tieto nástroje pomáhajú včas odhaliť chyby a overiť, či sú opravy účinné.

Halucinácie AI vznikajú, keď systémy generujú informácie, ktoré nie sú založené na tréningových dátach alebo sú nesprávne dekódované. Dezinformácia v AI je nepravdivá alebo zavádzajúca informácia v AI výstupoch, ktorá môže vzniknúť v dôsledku halucinácií, ale aj zo zastaraných zdrojov, zámeny entít alebo nekonzistentných dát naprieč platformami. Oprava dezinformácií rieši oboje – halucinácie aj nepresnosti na úrovni zdroja, ktoré vedú k nesprávnej prezentácii značky.

Sledujte, ako AI systémy opisujú vašu značku tak, že sa ich pýtate na vašu spoločnosť, produkty a pozicioning. Hľadajte zastarané informácie, nesprávne popisy, chýbajúce detaily alebo pripísanie konkurentovi. Použite monitorovacie nástroje na sledovanie zmienok v ChatGPT, Gemini a Perplexity. Skontrolujte, či vaša značka nechýba v relevantných AI odpovediach. Porovnajte AI popisy s oficiálnymi informáciami značky a identifikujte rozdiely.

Je to nepretržitý proces. AI systémy priebežne prehodnocujú signály, keď sa objavuje nový obsah a staršie stránky sa dostávajú do popredia. Jednorazová oprava bez ďalšieho monitorovania bude nakoniec prepísaná pôvodnou dezinformáciou. Značky, ktoré sú úspešné, vnímajú AI viditeľnosť ako živý systém – udržiavajú konzistentné definície značky naprieč zdrojmi, pravidelne auditujú adresáre a kontinuálne monitorujú AI zmienky, aby zachytili nové chyby skôr, než sa rozšíria.

Sledujte, ako AI systémy ako ChatGPT, Gemini a Perplexity prezentujú vašu značku. Získajte prehľad v reálnom čase o zmienkach značky, citáciách a viditeľnosti naprieč AI platformami s AmICited.com.

Zistite, ako napadnúť nepresné AI informácie, nahlásiť chyby ChatGPT a Perplexity a implementovať stratégie na zabezpečenie presného zastúpenia vašej značky v A...

Zistite, ako identifikovať, predchádzať a opravovať dezinformácie AI o vašej značke. Objavte 7 overených stratégií a nástrojov na ochranu vašej reputácie vo výs...

Naučte sa efektívne metódy, ako identifikovať, overovať a opravovať nepresné informácie v odpovediach generovaných AI, ako sú ChatGPT, Perplexity a iné AI systé...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.