Prah recenzných platforiem

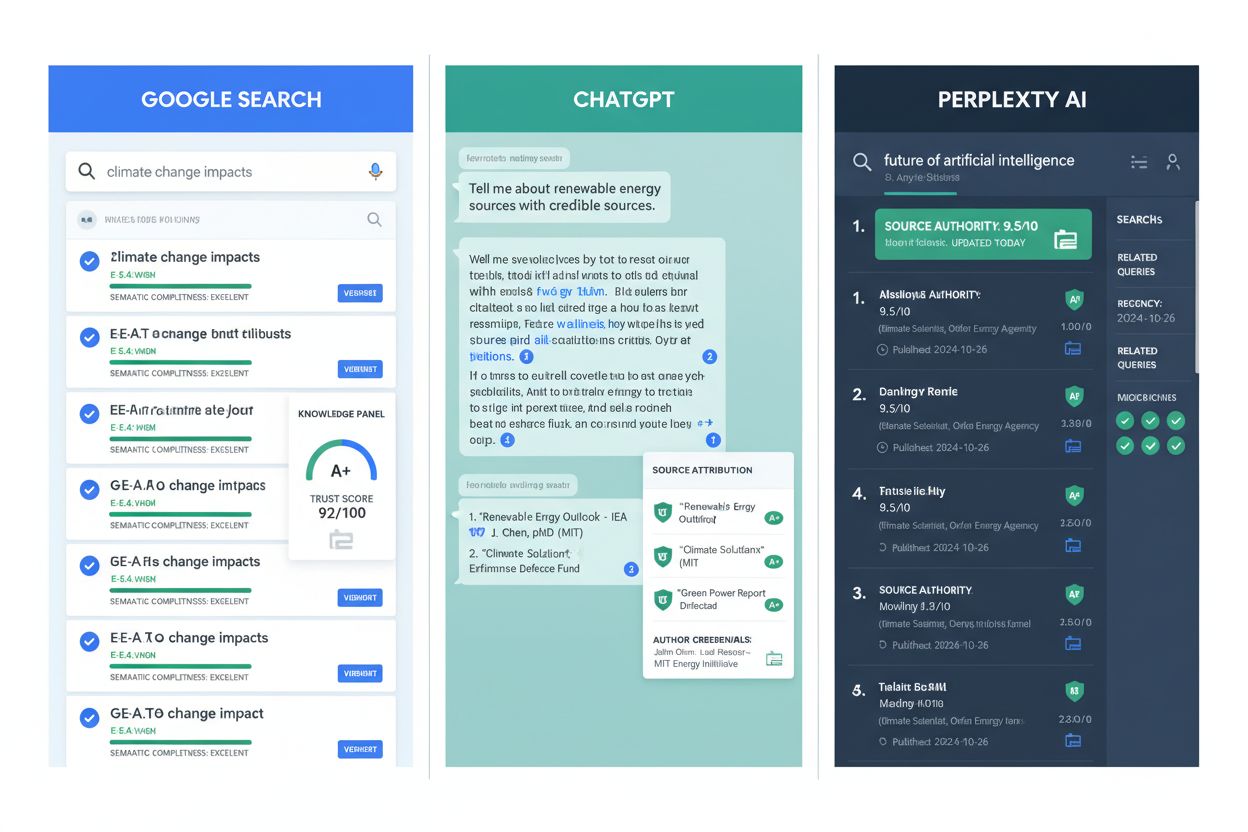

Zistite, čo znamená prah recenzných platforiem a prečo je 50+ recenzií na G2 a Capterra nevyhnutných pre konzistentné citácie AI v ChatGPT, Perplexity a Google ...

Posúdenie rizík AI platforiem je systematické hodnotenie podnikových rizík vyplývajúcich zo zmien v algoritmoch, politikách alebo prevádzkových parametroch AI platforiem. Zahŕňa identifikáciu, analýzu a zmierňovanie potenciálnych škôd z vývoja AI systémov, vrátane algoritmickej zaujatosti, otrávenia dát, driftu modelu a medzier v regulačnej zhode. Organizácie musia neustále monitorovať AI platformy, aby odhalili riziká skôr, než ovplyvnia obchodné operácie, príjmy alebo stav zhody.

Posúdenie rizík AI platforiem je systematické hodnotenie podnikových rizík vyplývajúcich zo zmien v algoritmoch, politikách alebo prevádzkových parametroch AI platforiem. Zahŕňa identifikáciu, analýzu a zmierňovanie potenciálnych škôd z vývoja AI systémov, vrátane algoritmickej zaujatosti, otrávenia dát, driftu modelu a medzier v regulačnej zhode. Organizácie musia neustále monitorovať AI platformy, aby odhalili riziká skôr, než ovplyvnia obchodné operácie, príjmy alebo stav zhody.

Posúdenie rizík AI platforiem je systematické hodnotenie zraniteľností, hrozieb a potenciálnych zlyhaní v rámci systémov umelej inteligencie a ich prevádzkových prostredí. Tento proces identifikuje, ako môžu AI platformy zlyhať, produkovať zaujaté výstupy alebo spôsobiť neúmyselné obchodné dôsledky. Posúdenie rizík je dôležité, pretože AI systémy čoraz viac ovplyvňujú kritické podnikové rozhodnutia týkajúce sa príjmov, zhody a reputácie značky. Organizácie musia tieto riziká pochopiť skôr, než nasadia AI riešenia v širšom meradle.

Staršie rámce riadenia rizík boli navrhnuté pre statické systémy s predvídateľnými spôsobmi zlyhania, nie pre dynamické AI platformy, ktoré sa neustále vyvíjajú. Tradičné prístupy sa zameriavajú na stabilitu infraštruktúry a bezpečnosť dát, pričom prehliadajú jedinečné výzvy algoritmického správania, degradácie modelov a rizík závislosti na platformách. Tieto rámce postrádajú mechanizmy na detekciu jemných posunov vo výkone, vzniku zaujatosti alebo zmien na platformách tretích strán, ktoré ovplyvňujú vaše AI systémy. Kontrolné zoznamy zhody a ročné audity nedokážu zachytiť drift algoritmov v reálnom čase alebo náhle zmeny politík zo strany poskytovateľov AI platforiem.

Kľúčové obmedzenia tradičných rámcov:

| Prístup | Silné stránky | Obmedzenia | Obchodný dopad |

|---|---|---|---|

| Tradičné riadenie rizík | Komplexná dokumentácia, zavedené procesy, znalosť regulácií | Statická analýza, pomalá detekcia, prehliada algoritmické riziká | Onesvorená reakcia na incidenty, medzery v zhode, skryté zlyhania |

| AI-špecifické riadenie rizík | Monitorovanie v reálnom čase, detekcia zaujatosti, priebežné hodnotenie, sledovanie platforiem | Vyžaduje nové nástroje a expertízu, vyvíjajúce sa štandardy | Rýchlejšie zmierňovanie rizík, lepšia zhoda, ochrana príjmov |

AI platformy predstavujú špecifické kategórie rizík, ktoré tradičné rámce úplne prehliadajú. Algoritmická zaujatosť vzniká, keď tréningové dáta odrážajú historické nerovnosti, čo spôsobuje diskriminačné výstupy vystavujúce organizácie právnej zodpovednosti a poškodeniu reputácie. Otrávenie dát nastáva, keď útočníci vkladajú poškodené dáta do tréningových procesov, čím znižujú presnosť a spoľahlivosť modelov. Drift modelu sa objavuje, keď sa distribúcie reálnych dát zmenia, čo spôsobí, že predtým presné modely dávajú čoraz nespoľahlivejšie výstupy bez zrejmých varovných signálov. Riziká závislosti na platformách vznikajú, keď služby AI tretích strán menia svoje algoritmy, ceny, podmienky alebo dostupnosť bez varovania. Halucinácie a faktické chyby vo veľkých jazykových modeloch môžu šíriť dezinformácie a poškodiť dôveryhodnosť značky. Adversariálne útoky zneužívajú zraniteľnosti modelov na produkciu neočakávaných alebo škodlivých výstupov. Organizácie musia sledovať všetky tieto kategórie súčasne, aby zachovali prevádzkovú integritu.

Regulačné prostredie pre AI sa rýchlo posilňuje s vymáhateľnými požiadavkami, ktoré priamo ovplyvňujú prax posudzovania rizík. EÚ AI Act stanovuje povinné klasifikácie rizík a povinnosti zhody pre vysoko rizikové AI systémy, pričom vyžaduje dokumentované posúdenia rizík pred nasadením. NIST AI Risk Management Framework poskytuje komplexné usmernenia na identifikáciu, meranie a riadenie AI rizík naprieč organizáciami. Rozvíjajúce sa regulácie v USA, Spojenom kráľovstve a ďalších jurisdikciách čoraz viac vyžadujú transparentnosť AI rozhodovania a dokumentované stratégie zmiernenia rizík. Organizácie musia zosúladiť procesy posudzovania rizík s týmito rámcami, aby sa vyhli regulačným sankciám a zachovali prevádzkové licencie. Zlyhanie v súlade môže viesť k vysokým pokutám, zastaveniu prevádzky a strate dôvery zákazníkov.

Zmeny AI platforiem spôsobili významné narušenia podnikania v rôznych odvetviach, čo ukazuje kľúčový význam posudzovania rizík. Keď OpenAI v roku 2024 zmenila správanie a možnosti ChatGPT, organizácie, ktoré na platforme stavali zákaznícky servis, zažili nečakané zmeny výstupov a museli rýchlo prispôsobiť svoje systémy. Amazonský AI systém na nábor preukázal rodovú zaujatosť, keď zamietal kvalifikované uchádzačky častejšie ako mužov, čo viedlo k poškodeniu reputácie a vnútorným zmenám procesov. Google Bard (dnes Gemini) poskytol fakticky nesprávne informácie počas prvých ukážok, čo ovplyvnilo dôveru investorov a vyžadovalo veľké pretrénovanie modelu. Finančné inštitúcie využívajúce algoritmické obchodné platformy zaznamenali nečakané straty, keď trhové podmienky spustili nepredvídané správanie modelov. Zdravotnícke organizácie s AI diagnostikou zistili pokles výkonu pri zmene demografie pacientov, čo viedlo k nesprávnym diagnózam. Tieto incidenty dokazujú, že riziká AI platforiem nie sú teoretické—priamo ovplyvňujú príjmy, zhodu a dôveryhodnosť organizácie.

Efektívne posúdenie rizík AI platforiem vyžaduje štruktúrované metodiky, ktoré systematicky hodnotia technickú, prevádzkovú a obchodnú stránku. Organizácie by mali vykonať prednasadzovacie posúdenia rizík, ktoré skúmajú architektúru modelu, kvalitu tréningových dát, metriky zaujatosti a možné zlyhania ešte pred nasadením do prevádzky. Rámce priebežného hodnotenia monitorujú živé systémy na zistenie poklesu výkonu, vzniku zaujatosti a neočakávaných vzorov správania. Posúdenie rizík má zahŕňať mapovanie závislostí, ktoré identifikuje všetky AI platformy tretích strán, ich kľúčové funkcie a možné dopady zlyhania. Tímy by mali používať kvantitatívne skórovanie rizík, ktoré kombinuje odhady pravdepodobnosti s výpočtom obchodného dopadu na určenie priorít zmierňovania. Metodiky hodnotenia musia zahŕňať rozhovory so zainteresovanými stranami s dátovými vedcami, pracovníkmi zhody, obchodnými lídrami a koncovými používateľmi na zachytenie rozmanitých pohľadov na riziká. Dokumentácia výsledkov hodnotenia vytvára auditné záznamy a podporuje požiadavky regulačnej zhody.

Statické posúdenia rizík rýchlo zastarávajú, keďže AI systémy fungujú v dynamických prostrediach s neustále sa meniacimi podmienkami. Monitorovanie výkonu v reálnom čase sleduje kľúčové metriky ako presnosť, latenciu, indikátory férovosti a konzistenciu výstupov naprieč rôznymi skupinami používateľov a distribúciami dát. Automatizované detekčné systémy označujú anomálie, ako náhle poklesy presnosti, zvýšené miery chýb alebo nezvyčajné vzory predikcií, ktoré signalizujú vznikajúce riziká. Priebežné monitorovanie zaujatosti meria, či si výstupy modelu zachovávajú férovosť medzi demografickými skupinami, a deteguje jemnú diskrimináciu, ktorá vzniká v čase. Sledovanie zmien na platformách monitoruje služby AI tretích strán kvôli aktualizáciám algoritmov, zmenám politík, úpravám cien a problémom s dostupnosťou, ktoré ovplyvňujú závislé systémy. Upozorňovacie mechanizmy okamžite informujú relevantné tímy, keď monitorované metriky presiahnu stanovené prahy, čo umožňuje rýchlu reakciu. Organizácie by mali zaviesť spätné väzby zachytávajúce hlásenia koncových používateľov o neočakávanom správaní AI a vracať tieto informácie späť do monitorovacích systémov. Priebežné hodnotenie mení posúdenie rizík z periodického cvičenia zhody na neustálu prevádzkovú disciplínu.

Identifikované riziká si vyžadujú konkrétne stratégie zmierňovania, ktoré systematickou implementáciou kontrol znižujú pravdepodobnosť, dopad alebo oboje. Riadenie modelov zavádza schvaľovacie procesy, správu verzií a postupy návratu, ktoré zabraňujú nasadeniu problematických modelov do produkcie. Kontroly kvality dát realizujú validačné kontroly, detekciu anomálií a overovanie zdrojov na prevenciu otrávenia dát a zabezpečenie integrity tréningových dát. Techniky zmierňovania zaujatosti zahŕňajú zber rozmanitých tréningových dát, výber algoritmov so zreteľom na férovosť a pravidelné audity zaujatosti naprieč demografickými skupinami. Redundantné a záložné systémy udržiavajú alternatívne rozhodovacie procesy, ktoré sa aktivujú pri zlyhaní hlavných AI systémov alebo neistých výstupoch. Riadenie dodávateľov stanovuje zmluvné požiadavky, servisné úrovne a komunikačné protokoly s poskytovateľmi AI platforiem tretích strán. Plánovanie reakcií na incidenty pripravuje tímy na rýchlu detekciu, vyšetrovanie a nápravu zlyhaní súvisiacich s AI, čím minimalizuje dopad na podnikanie. Pravidelné školenia zabezpečujú, že technické tímy, obchodní lídri a pracovníci zhody rozumejú rizikám AI a svojim povinnostiam pri ich zmierňovaní.

Organizácie potrebujú špecializované nástroje navrhnuté priamo pre posúdenie rizík AI platforiem a ich priebežné monitorovanie. AmICited.com vyniká ako popredná platforma na monitorovanie toho, ako AI systémy odkazujú na vašu značku, sledovanie zmien algoritmov a hodnotenie rizík závislosti na platformách v reálnom čase. AmICited.com poskytuje prehľad o správaní AI platforiem, detekuje, keď systémy tretích strán menia algoritmy alebo spôsob, akým spracúvajú vaše dáta a zmienky o značke. Okrem AmICited.com by organizácie mali nasadiť platformy na monitorovanie modelov, ktoré sledujú výkonnostné metriky, detegujú drift a upozorňujú tímy na degradáciu. Nástroje na detekciu zaujatosti analyzujú výstupy modelu naprieč demografickými skupinami a včas identifikujú otázky férovosti. Platformy na kontrolu kvality dát overujú integritu tréningových dát a detegujú pokusy o otrávenie. Systémy na riadenie zhody dokumentujú posúdenia rizík, vedú auditné záznamy a podporujú regulačné vykazovanie. Komplexná sada nástrojov na riadenie rizík kombinuje tieto špecializované riešenia s internými procesmi riadenia a poskytuje vrstvenú ochranu pred rizikami AI platforiem.

Posúdenie rizík AI platforiem sa zameriava špecificky na riziká vyplývajúce z AI systémov a ich závislostí, vrátane algoritmickej zaujatosti, driftu modelu a zmien politík platforiem. Všeobecné riadenie rizík rieši širšie organizačné riziká ako zlyhania infraštruktúry a úniky dát. AI-špecifické hodnotenie vyžaduje neustále monitorovanie, pretože AI systémy sa dynamicky vyvíjajú, na rozdiel od tradičných statických systémov, ktoré sa menia len zriedka.

Posúdenia rizík by mali byť nepretržité, nie periodické. Systémy monitorovania v reálnom čase neustále sledujú správanie AI platforiem a okamžite detegujú vznikajúce riziká. Organizácie by mali vykonať formálne komplexné posúdenia pred nasadením nových AI systémov a následne udržiavať priebežné monitorovanie s kvartálnymi prehodnoteniami výsledkov a účinnosti zmierňovania.

Najkritickejšie riziká zahŕňajú algoritmickú zaujatosť spôsobujúcu diskriminačné výstupy, otrávenie dát z poškodených tréningových dát, drift modelu v dôsledku zmeny distribúcie dát a riziká závislosti od tretích strán pri zmenách algoritmov alebo politík. Organizácie by mali tiež monitorovať halucinácie jazykových modelov, adversariálne útoky a neočakávané zmeny správania počas prevádzky.

Detekcia algoritmickej zaujatosti vyžaduje porovnávanie výstupov modelu medzi demografickými skupinami, aby sa identifikovali rozdiely vo výkone. Organizácie by mali používať metriky férovosti, vykonávať pravidelné audity zaujatosti, analyzovať vzory predikcií podľa chránených charakteristík a získavať spätnú väzbu od rôznych skupín používateľov. Automatizované nástroje na detekciu zaujatosti môžu označiť podozrivé vzory, no ľudský dohľad je nevyhnutný na interpretáciu zistení a určenie vhodných opatrení.

Regulačné rámce ako EÚ AI Act a NIST AI Risk Management Framework stanovujú povinné požiadavky na dokumentovanie rizík AI, implementáciu kontrol a udržiavanie auditných záznamov. Zlyhanie v súlade môže viesť k vysokým pokutám, zastaveniu prevádzky a strate dôvery zákazníkov. Procesy posúdenia rizík musia byť v súlade s týmito rámcami, aby preukázali zodpovedné riadenie AI a splnili právne povinnosti.

AmICited.com monitoruje, ako AI platformy odkazujú na vašu značku a sleduje zmeny algoritmov, ktoré môžu ovplyvniť vaše podnikanie. Platforma poskytuje prehľad v reálnom čase o závislostiach od AI platforiem, deteguje zmeny správania tretích strán a upozorní vás na zmeny politík ovplyvňujúcich vaše operácie. Tento prehľad je nevyhnutný pre komplexné posúdenie rizík AI platforiem a riadenie závislostí.

Drift modelu nastáva, keď sa distribúcia reálnych dát zmení, čím predtým presné AI modely začnú produkovať čoraz nespoľahlivejšie predikcie. Napríklad model na hodnotenie úverov trénovaný na historických dátach môže zlyhať, keď sa ekonomické podmienky dramaticky zmenia. Drift modelu je rizikový, lebo potichu znižuje kvalitu rozhodnutí—organizácie si môžu všimnúť pokles výkonu až po vzniku významných škôd.

Organizácie by mali implementovať štruktúrovaný proces reakcie na incidenty: okamžite upozorniť relevantné tímy, vyšetriť rozsah a dopad rizika, v prípade potreby aktivovať záložné systémy, zaviesť dočasné opatrenia, vypracovať trvalé stratégie zmiernenia a zdokumentovať získané poznatky. Rýchla reakcia minimalizuje obchodný dopad, dôkladné vyšetrovanie zabraňuje opakovaniu podobných rizík. V závislosti od závažnosti môže byť potrebná komunikácia s partnermi a regulátormi.

AmICited.com vám pomôže sledovať, ako AI platformy odkazujú na vašu značku a odhaliť zmeny algoritmov, ktoré môžu ovplyvniť váš biznis. Získajte prehľad o závislostiach a rizikách AI platforiem skôr, než sa stanú problémom.

Zistite, čo znamená prah recenzných platforiem a prečo je 50+ recenzií na G2 a Capterra nevyhnutných pre konzistentné citácie AI v ChatGPT, Perplexity a Google ...

Zistite, ako odhaliť, reagovať a predchádzať AI-generovaným krízam, ktoré ohrozujú reputáciu značky. Objavte stratégie monitorovania v reálnom čase, krízové pla...

Zistite, ako AI systémy hodnotia dôveryhodnosť zdroja cez kvalifikáciu autora, citácie a overovanie. Pochopte technické mechanizmy, kľúčové faktory a najlepšie ...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.