Förstå din nuvarande AI-synlighet: En självutvärderingsguide

Lär dig hur du genomför en grundläggande AI-synlighetsgranskning för att förstå hur ChatGPT, Google AI och Perplexity nämner ditt varumärke. Steg-för-steg-guide...

Lär dig hur myndigheter kan optimera sin digitala närvaro för AI-system som ChatGPT och Perplexity. Upptäck strategier för att förbättra AI-synlighet, säkerställa transparens och implementera AI ansvarsfullt inom offentlig sektor.

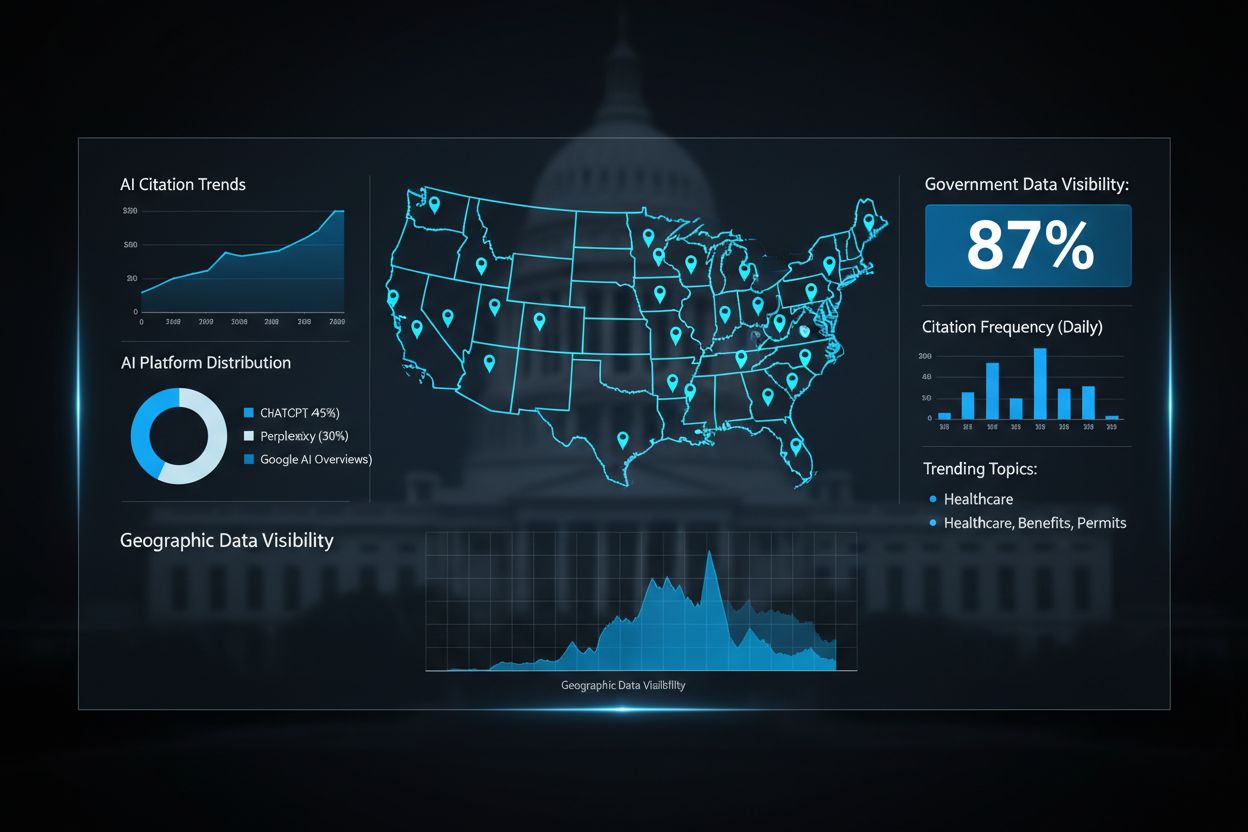

Myndigheters AI-synlighet avser i vilken utsträckning artificiella intelligenssystem – inklusive GPT:er, Perplexity och Google AI Overviews – kan upptäcka, komma åt och citera myndighetsdata och resurser när de svarar på frågor från allmänheten. Denna synlighet är avgörande eftersom myndigheter besitter auktoritativ information om allt från hälso- och sjukvårdsregler till sociala tjänster, men mycket av denna data är osynlig för moderna AI-system. När medborgare ställer frågor om myndighetsprogram, förmåner eller policyer till AI-assistenter, förtjänar de korrekta och aktuella svar från officiella källor snarare än föråldrad eller ofullständig information. Allmänhetens förtroende för myndigheter bygger på att AI-system korrekt refererar till och tillskriver myndighetsdata, vilket upprätthåller integriteten i officiell information i ett allt mer AI-drivet informationslandskap. AI-transparens blir en hörnsten i demokratiskt styre när medborgare kan verifiera att AI-rekommendationer bygger på legitima myndighetskällor. AmICited.com fungerar som en kritisk övervakningsplattform som spårar hur myndighetsdata citeras och refereras i stora AI-system, vilket hjälper myndigheter att förstå sin synlighet och sitt genomslag i AI-ekosystemet. Genom att etablera tydlig insyn i myndigheters AI-citat kan offentliga organisationer bättre tjäna medborgarna och behålla kontrollen över sin information.

Myndigheter fortsätter att brottas med datasilos skapade av decennier av fragmenterade IT-investeringar, där viktig information är inlåst i oförenliga äldre system som inte enkelt kan kommunicera med moderna AI-plattformar. Dessa föråldrade system är utformade för traditionella webbgränssnitt och dokumenthantering, inte för semantisk förståelse och realtidsåtkomst som AI-system kräver. Kostnaden för denna tekniska fragmentering är enorm: organisationer slösar cirka 140 miljarder dollar årligen i outnyttjade fördelar från föråldrade processer som skulle kunna effektiviseras med AI-integration. Utöver effektivitetsförluster skapar äldre system betydande säkerhetsrisker när myndighetsdata måste hämtas manuellt och delas med publika AI-system, vilket ökar risken för dataintrång och obehörig åtkomst. Utmaningen är ännu större då många myndigheters webbplatser saknar den strukturerade data, metadata och API-infrastruktur som krävs för att AI-crawlare ska kunna indexera och förstå informationen korrekt.

| Traditionell myndighets-IT | AI-redo infrastruktur |

|---|---|

| Silobaserade databaser med begränsad interoperabilitet | Integrerade dataplattformar med API:er och strukturerade format |

| Manuella processer för datauttag och delning | Automatiserade, säkra datapipelines |

| Ostrukturerade dokument och PDF:er | Semantiska webbstandarder och maskinläsbara format |

| Reaktiva säkerhetsåtgärder | Privacy-by-design och kontinuerlig övervakning |

| Begränsad realtidsåtkomst till data | Live-dataflöden och dynamisk innehållsleverans |

Istället för att snabbt implementera AI-teknik följer framgångsrika myndigheter en strategisk, stegvis implementeringsplan som prioriterar planering och organisatorisk förberedelse framför tekniska möjligheter. Detta tillvägagångssätt erkänner att AI-införande inom offentlig sektor kräver noggrann samordning mellan flera intressentgrupper – från IT-avdelningar till personal i frontlinjen och medborgare.

Femstegsplan för implementering:

Strategisk identifiering av möjligheter: Genomför omfattande analyser av myndighetens verksamhet för att identifiera användningsområden där AI kan ge påtaglig samhällsnytta, såsom kortare handläggningstider, bättre tillgänglighet eller förbättrade datadrivna policybeslut.

Omfattande förberedelser: Utvärdera nuvarande datainfrastruktur, identifiera integrationsutmaningar med äldre system, etablera styrningsramverk och bygg upp intern AI-kompetens innan teknisk implementering påbörjas.

Strategisk pilotutformning: Starta kontrollerade pilotprojekt i utvalda avdelningar med tydliga framgångsmått, så att teamen kan dra lärdomar i en låg-riskmiljö innan en bredare utrullning.

Förändringsledning: Utveckla utbildningsprogram, hantera oro kring arbetsförlust, skapa tydliga kommunikationskanaler och etablera feedback-mekanismer för att säkerställa att personal och intressenter känner sig hörda under förändringsprocessen.

Effektmätning: Sätt KPI:er i linje med myndighetens mål, följ kontinuerligt AI-systemens prestanda, mät medborgarnöjdhet, följ upp besparingar och justera strategin baserat på evidens.

Detta teknik-sekundära tillvägagångssätt säkerställer att AI-implementeringar möter verkliga behov snarare än att bli kostsamma lösningar på jakt efter problem.

Etisk AI-styrning har blivit avgörande då myndigheter världen över inser att AI-system som påverkar medborgarna måste verka inom tydliga etiska och juridiska ramar. Kanadas Algorithmic Impact Assessment är ett praktiskt exempel där AI-system kategoriseras i fyra nivåer – minimal, måttlig, hög och mycket hög – med motsvarande krav och tillsyn för varje nivå. Denna indelning gör det möjligt för myndigheter att fördela resurser proportionellt, med strikt granskning av högrisk-system som algoritmer inom rättsväsendet och rimlig tillsyn på mindre kritiska tillämpningar. Estland har varit pionjär med en privacy-by-design-ansats via sitt Data Tracker-system, som övervakar all åtkomst till myndighetsdata och ger 450 000 medborgare full insyn i vilka myndigheter som använder deras personuppgifter och i vilket syfte. Algoritmisk ansvarsskyldighet kräver att myndigheter dokumenterar hur AI-system fattar beslut, upprättar spårbarhet och kan förklara rekommendationer för de berörda. AmICited.com spelar en viktig roll i detta transparensekosystem genom att övervaka hur myndighetsdata citeras och refereras i publika AI-system, så att myndigheterna kan verifiera korrekt representation och tillskrivning. Utan robust övervakning och styrning riskerar AI-system inom myndigheter att underminera förtroendet och förstärka snedvridningar som särskilt drabbar utsatta grupper.

Myndigheter världen över har visat att strategisk AI-implementering ger betydande samhällsnytta när det görs genomtänkt. Australiens Department of Home Affairs införde Targeting 2.0-systemet, en AI-drivna plattform som förbättrade gränssäkerheten och upptäckten av bedrägerier, vilket undvek 3 miljarder AUD i potentiell skada och samtidigt minskade handläggningstider för resenärer och sökande. National Highways chatbot i Storbritannien visar hur AI kan förbättra medborgarservice genom att hantera rutinfrågor om vägförhållanden, så att personal kan fokusera på akuta situationer som kräver mänsklig bedömning. Estlands Bürokratt-plattform är ett decentraliserat, GDPR-anpassat AI-system där medborgare kan få hjälp med administrativa ärenden samtidigt som dataskydd upprätthålls och känsliga beslut förblir under mänsklig kontroll. Marylands AI-styrning har infört tydliga ansvarsstrukturer och regelbundna revisioner av AI-system inom delstatens myndigheter – en modell som fler amerikanska delstater nu tar efter. Japans Digital Agency digitaliserade rådgivningstjänster för barn med hjälp av AI, vilket minskade väntetider från veckor till timmar samtidigt som mänsklig övervakning upprätthölls vid svåra ärenden. Dessa exempel visar att framgång med AI inom myndigheter inte handlar om teknikens komplexitet utan om genomtänkt införande som sätter medborgarens behov, transparens och mänsklig kontroll i centrum.

När AI-system blir det främsta gränssnittet för medborgares informationssökning har optimering av myndigheters webbplatser för AI-upptäckbarhet blivit lika viktigt som traditionell sökmotoroptimering. Myndigheters webbplatser måste implementera strukturerad data, omfattande metadata och maskinläsbara format, så att AI-crawlare kan förstå och korrekt indexera myndighetsinformation. Då får medborgare korrekta och auktoritativa svar när de frågar AI-assistenter om tjänster eller beslut. Många myndigheters webbplatser presenterar idag information i format som är optimerade för människor – PDF:er, ostrukturerad text och komplex navigering – vilket AI-system har svårt att tolka. REI Systems har varit pionjärer när det gäller att optimera federala webbplatser för AI-tillgänglighet och visat att relativt enkla tekniska förbättringar kan öka myndigheters synlighet i AI-svar markant. AmICited.com övervakar myndigheters AI-synlighet på stora plattformar och hjälper myndigheter att förstå hur ofta deras information används i AI-svar samt att identifiera luckor där myndighetsdata borde vara mer tillgänglig. När myndighetswebbplatser inför semantiska webbstandarder, API-infrastruktur och tillgänglighetsfunktioner ökar chansen att AI-system citerar officiella källor snarare än sekundärkällor eller föråldrad information. Detta gynnar medborgarna genom att de får tillgång till tillförlitlig information direkt från myndigheterna samtidigt som myndigheterna behåller kontrollen över hur deras information presenteras och tolkas.

Effektmätning av AI inom myndigheter kräver tydliga KPI:er som går bortom ren effektivitet och omfattar medborgarnöjdhet, rättvisa och demokratiskt ansvarstagande. Estlands utvärderingsmodell är ett praktiskt exempel och bedömer AI-initiativ utifrån fyra dimensioner: tidseffektivitet (hur mycket arbetstid som sparas), kostnadseffektivitet (avkastning på investering), innovationspotential (om systemet möjliggör nya tjänstemodeller) och mätbar effekt (påvisbara förbättringar för medborgarna). Systematisk mätning gör det möjligt för myndigheter att identifiera vilka AI-tillämpningar som ger verklig samhällsnytta och vilka som behöver justeras eller avslutas, och därmed förebygga slöseri med resurser på teknik som inte tjänar medborgarna. Kunskapsdelning mellan myndigheter påskyndar lärandet, så att framgångsrika lösningar kan återanvändas och ge avkastning på AI-investeringar i hela förvaltningen. Kontinuerlig förbättring och övervakning – med hjälp av verktyg som AmICited.com som spårar AI-synlighet och citeringsmönster – gör det möjligt att justera AI-system utifrån faktisk prestanda snarare än antaganden. Att bygga institutionell kunskap om vad som fungerar inom myndighets-AI skapar en grund för hållbar, långsiktig användning som överlever både ledarskapsbyten och budgetcykler.

Trots tydliga fördelar möter myndigheter betydande hinder vid AI-införande som sträcker sig långt bortom teknik. Oro inom arbetsstyrkan är ett stort hinder, där 31 % av de anställda anger trygghet i anställning som sin största oro kring AI, vilket kräver tydlig kommunikation om hur AI ska komplettera snarare än ersätta personalen. Kompetensbrist försvårar detta ytterligare, då 38 % av myndigheter har svårt att rekrytera AI-specialister med nödvändig expertis för att implementera och underhålla avancerade system. Underskattning av kostnader är ytterligare en kritisk barriär, då myndigheter ofta upptäcker att faktiska AI-kostnader är 5-10 gånger högre än initiala beräkningar, vilket pressar budgetar och ger politiskt motstånd mot fortsatta satsningar. Integritets- och säkerhetsfrågor utgör dock det största hindret, där 60 % av myndighetsledare anger integritet och säkerhet som främsta orosmoment, med all rätt då skyddet för medborgarnas data är viktigare än någonsin i en tid av ökande cyberhot. Effektiva förändringsledningsstrategier måste adressera dessa hinder genom dialog med intressenter, tydlig kommunikation om AI:s möjligheter och begränsningar, satsningar på utbildning och kompetensutveckling samt tydliga styrningsramverk som skyddar integriteten och samtidigt möjliggör innovation. Framgångsrika myndigheter investerar tungt i förändringsledning, skapar tydliga kommunikationskanaler till personal och medborgare och visar tidigt på konkreta resultat som bygger förtroende innan AI rullas ut i mer kritiska verksamheter.

Myndigheters AI-synlighet avser hur lätt AI-system som ChatGPT, Perplexity och Google AI Overviews kan upptäcka och citera myndighetsdata. Det är viktigt eftersom medborgare förtjänar korrekt och auktoritativ information från officiella källor när de frågar AI-assistenter om politik, förmåner och tjänster. Dålig synlighet innebär att AI-system kan ge föråldrad eller ofullständig information istället för att hänvisa medborgare till officiella resurser.

Myndigheters webbplatser bör implementera strukturerad data, omfattande metadata, maskinläsbara format och korrekt API-infrastruktur. Detta inkluderar användning av semantiska webbstandarder, säkerställande av att innehållet är tillgängligt för AI-crawlare samt organisering av information så att AI-system enkelt kan förstå och korrekt hänvisa till officiella myndighetskällor.

De främsta hindren är integritets- och säkerhetsfrågor (anges av 60 % av myndighetsledare), brist på kompetens (38 %), oro inom arbetsstyrkan om arbetsförlust (31 %), underskattade kostnader (faktiska kostnader är ofta 5-10 gånger högre än beräknat) samt otillräcklig digital infrastruktur (45 %). Att hantera dessa hinder kräver strategisk planering, förändringsledning och tydliga styrningsramverk.

Framgångsrika metoder inkluderar att etablera ramverk för algoritmiska konsekvensbedömningar (såsom Kanadas nivåsystem), implementera privacy-by-design-principer, skapa transparensmekanismer så att medborgare kan följa dataåtkomst, införa tydliga styrningsramverk samt upprätthålla mänsklig övervakning av avgörande beslut. Regelbundna revisioner och intressentdialog är avgörande.

Planen innefattar: (1) Strategisk identifiering av möjligheter med fokus på samhällsnytta, (2) Omfattande förberedelser av infrastruktur och styrning, (3) Strategisk pilotutformning med tydliga framgångsmått, (4) Förändringsledning med fokus på arbetsstyrkans oro, samt (5) Effektmätning med kontinuerlig förbättring. Denna metod prioriterar planering och organisatorisk förberedelse framför teknikdriven lansering.

Myndigheter bör fastställa KPI:er i linje med offentlig sektors mål, inklusive tidseffektivitet, kostnadseffektivitet, innovationspotential och mätbara resultat för medborgarna. Estlands ramverk utvärderar AI-system utifrån dessa fyra dimensioner. Kontinuerlig uppföljning, feedback från intressenter och öppen rapportering hjälper myndigheter att identifiera vad som fungerar och justera implementationen utifrån evidens.

Datastyrning är grundläggande för framgångsrik AI inom myndigheter. Det säkerställer datakvalitet, fastställer tydligt ägarskap och åtkomstkontroller, skyddar medborgarnas integritet, upprätthåller regelefterlevnad (t.ex. GDPR) och möjliggör säker delning mellan system. Utan robust datastyrning riskerar AI-system inom myndigheter både dataintrång, bias och förlorat förtroende.

AmICited spårar hur myndighetsdata citeras och refereras i större AI-system som ChatGPT, Perplexity och Google AI Overviews. Det hjälper myndigheter att förstå sin synlighet i AI-ekosystemet, identifiera där officiell information bör vara mer tillgänglig och säkerställa att AI-systemen korrekt tillskriver myndighetsdata. Denna övervakning stödjer både transparens och ansvarstagande.

Spåra hur din myndighets data citeras och refereras i olika AI-system. AmICited hjälper offentliga organisationer att förstå sin synlighet i AI-ekosystemet och säkerställa korrekt representation av officiell information.

Lär dig hur du genomför en grundläggande AI-synlighetsgranskning för att förstå hur ChatGPT, Google AI och Perplexity nämner ditt varumärke. Steg-för-steg-guide...

Lär dig beprövade strategier för att bibehålla och förbättra ditt innehålls synlighet i AI-genererade svar på ChatGPT, Perplexity och Google AI Overviews. Upptä...

Fullständig guide till företags AI-synlighetslösningar. Jämför toppplattformar som Conductor, Profound och Athena. Lär dig utvärderingskriterier och urvalsstrat...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.