Vad påverkar AI-indexeringshastigheten? Nyckelfaktorer för snabbare AI-upptäckt

Upptäck de viktigaste faktorerna som påverkar AI-indexeringshastigheten, inklusive webbplatsens prestanda, crawl budget, innehållsstruktur och teknisk optimerin...

Upptäck hur webbplatshastighet direkt påverkar AI-synlighet och citeringar i ChatGPT, Gemini och Perplexity. Lär dig 2,5-sekundersgränsen och optimeringsstrategier för AI-crawlare.

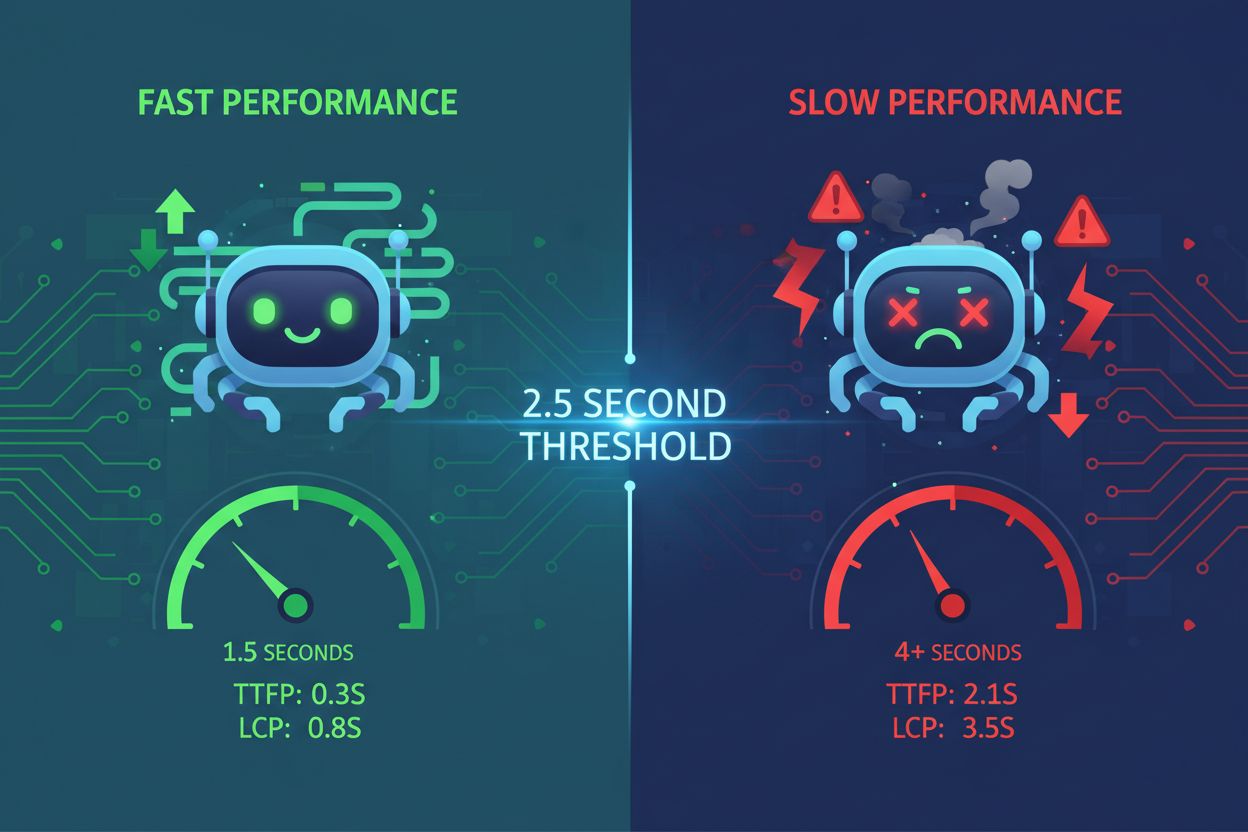

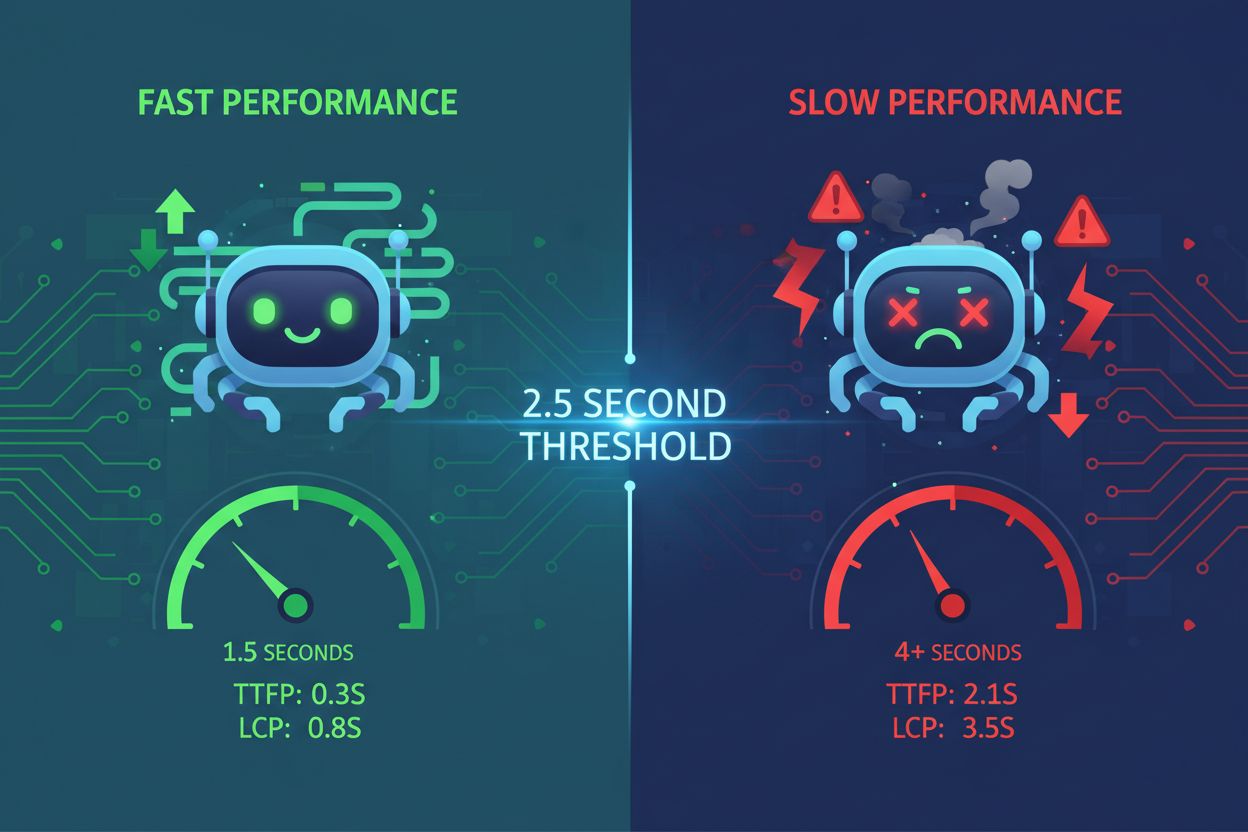

Webbplatshastighet har blivit en avgörande faktor för AI-synlighet och omformar i grunden hur innehåll upptäcks och citeras av stora språkmodeller. AI-system som ChatGPT, Gemini och Perplexity arbetar med strikta latensbudgetar—de har inte råd att vänta på långsamma webbplatser när de hämtar information för användarfrågor. När en sida tar längre än 2,5 sekunder att ladda hoppar AI-crawlare ofta över den helt och går vidare till snabbare alternativ som kan leverera samma information effektivare. Detta skapar en tydlig prestandagräns: webbplatser som inte uppfyller denna tröskel blir i praktiken osynliga för AI-system, oavsett innehållets kvalitet. Konsekvenserna är stora—dålig webbplatshastighet leder direkt till färre AI-citeringar och minskad synlighet i AI-drivna sökresultat. Att förstå denna tröskel är första steget mot att optimera för AI-synlighet.

AI-system använder fyra distinkta insamlingslägen när de hämtar information: förträning (historisk data som används vid modellträning), realtidsläsning (live-web crawling vid inferens), API-kopplingar (direkta integrationer med datakällor) och RAG (Retrieval-Augmented Generation-system som hämtar färskt innehåll). Varje läge har olika prestandakrav, men alla är känsliga för core web vitals och serverns svarstider. När AI-crawlare utvärderar en sida bedömer de TTFB (Time to First Byte), LCP (Largest Contentful Paint), INP (Interaction to Next Paint) och CLS (Cumulative Layout Shift)—mätvärden som direkt påverkar om crawlare kan effektivt extrahera och indexera innehåll. Långsam TTFB innebär att crawlare väntar längre innan de får någon data; dålig LCP betyder att viktigt innehåll visas sent; hög INP tyder på JavaScript-överbelastning; och CLS indikerar instabila layouter som försvårar innehållsextraktion.

| Mätvärde | Vad det mäter | Påverkan på LLM-insamling |

|---|---|---|

| TTFB | Tiden tills första byten anländer från servern | Avgör initial crawl-hastighet; långsam TTFB orsakar timeout |

| LCP | När största synliga innehållselement renderas | Försenar innehållstillgänglighet för extraktion och indexering |

| INP | Responsivitet vid användarinteraktioner | Hög INP indikerar tung JavaScript som fördröjer parsing |

| CLS | Visuell stabilitet under sidladdning | Instabila layouter förvirrar innehållsextraktionsalgoritmer |

Forskning från Cloudflare Radar visar en oroande skillnad: AI-botar crawlar webbplatser mycket oftare än de faktiskt refererar trafik eller citeringar. Detta crawl-to-referral-förhållande visar att all crawl-aktivitet inte leder till synlighet—vissa AI-system indexerar bara innehåll utan att citera det i svar. Anthropics crawler har till exempel ett 70 900:1-förhållande, vilket betyder att den crawlar 70 900 sidor för varje citering den genererar. Detta tyder på att crawl-frekvensen i sig inte är en pålitlig indikator på AI-synlighet; det som är avgörande är om crawlare effektivt kan bearbeta ditt innehåll och avgöra att det är värdefullt nog att citeras. Slutsatsen är tydlig: att optimera för crawlbarhet är nödvändigt men otillräckligt—du måste också säkerställa att ditt innehåll är tillräckligt snabbt för att bearbetas och relevant nog för att väljas. Att förstå detta förhållande förklarar varför vissa högtrafikerade sidor ändå har svårt med AI-citeringar trots mycket crawler-aktivitet.

AI-system tar allt mer hänsyn till regional latens när de väljer källor för användarfrågor, särskilt för platskänsliga sökningar. En webbplats som hostas på en enda server i USA kan ladda snabbt för crawlare baserade i USA men långsamt för crawlare i andra regioner, vilket påverkar global AI-synlighet. CDN-placering och datalokalitet blir avgörande faktorer—innehåll som levereras från geografiskt distribuerade edge-platser laddar snabbare för crawlare världen över, vilket ökar sannolikheten att väljas. För sökningar med “nära mig” eller platsmodifierare prioriterar AI-system källor med snabb regional prestanda, vilket gör lokal optimering viktigt för företag som riktar sig mot specifika geografier. Webbplatser som investerar i global CDN-infrastruktur får ett konkurrensförsprång i AI-synlighet över flera regioner. Prestandatröskeln gäller globalt: en 2,5 sekunders laddtid måste kunna uppnås från flera geografiska regioner, inte bara från din primära marknad.

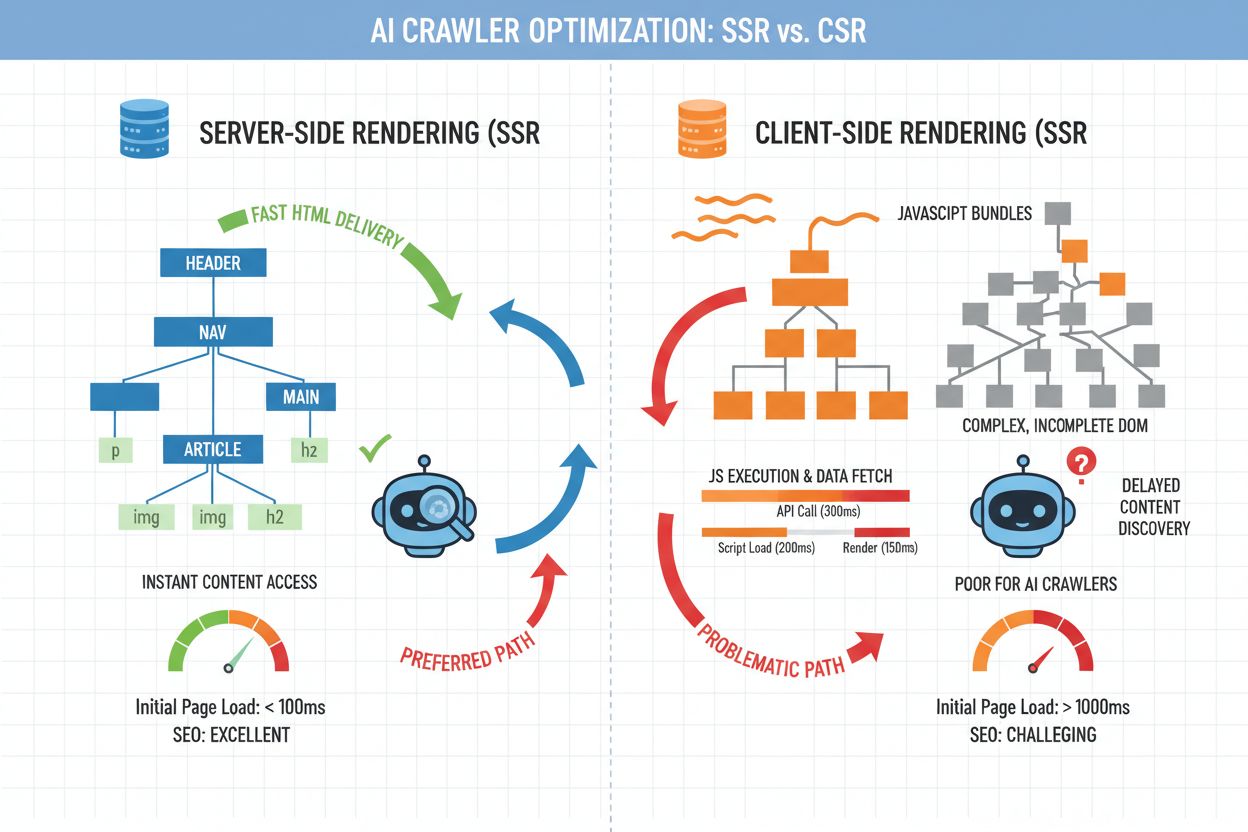

Valet mellan server-side rendering (SSR) och client-side rendering (CSR) har stora konsekvenser för AI-synlighet. AI-crawlare föredrar starkt ren, semantisk HTML levererad i det initiala svaret framför JavaScript-tunga sidor som kräver client-side rendering för att visa innehåll. När en sida är beroende av client-side rendering måste crawlare köra JavaScript, vänta på API-anrop och rendera DOM—en process som tillför latens och komplexitet. Minimal JavaScript, semantisk uppmärkning och logiska rubrikhierarkier gör innehållet omedelbart tillgängligt för AI-system, minskar bearbetningstiden och förbättrar crawl-effektiviteten. Server-side rendering säkerställer att viktigt innehåll finns i den initiala HTML-leveransen, så crawlare kan extrahera information utan att köra kod. Webbplatser som prioriterar snabb, enkel HTML framför komplexa client-side-ramverk når konsekvent bättre AI-synlighet. Det handlar inte om att överge moderna ramverk—utan om att säkerställa att kärninnehållet finns i det initiala svaret, med progressiv förbättring för användarinteraktioner.

Optimering för AI-synlighet kräver ett systematiskt angreppssätt på prestanda. Följande checklista tar upp de mest effektfulla optimeringarna, utformade för att minska latens och förbättra crawlbarhet:

Servera kärninnehåll i initial HTML: Säkerställ att huvudinnehåll, rubriker och nyckelinformation finns i serversvaret, inte gömt bakom JavaScript eller lazy-loading. AI-crawlare ska kunna extrahera ditt viktigaste innehåll utan att köra kod.

Håll TTFB och HTML-storlek slimmad: Optimera serversvarstiden genom att minska databasfrågor, implementera caching och minimera initial HTML-payload. En TTFB under 600 ms och initial HTML under 50 KB är realistiska mål för de flesta innehållssidor.

Minimera render-blockerande skript och CSS: Skjut upp icke-kritisk JavaScript och inkludera endast nödvändig CSS inline. Render-blockerande resurser försenar innehållstillgänglighet och ökar upplevd latens för crawlare.

Använd semantisk HTML och logiska rubriker: Strukturera innehåll med korrekt rubrikhierarki (H1, H2, H3), semantiska taggar (article, section, nav) och beskrivande alt-texter. Det hjälper AI-system att förstå innehållets struktur och betydelse.

Begränsa DOM-komplexiteten på viktiga sidor: Sidor med tusentals DOM-noder tar längre tid att parsa och rendera. Förenkla layouter på hörnsteninnehåll för att minska bearbetningsöverhead.

Skapa lättviktsvarianter av hörnsteninnehåll: Överväg att servera förenklade, textfokuserade versioner av dina viktigaste sidor till AI-crawlare, samtidigt som rika upplevelser bibehålls för mänskliga användare. Detta kan göras via user-agent-detektering eller separata URL:er.

Att fastställa en baslinje är avgörande innan du optimerar för AI-synlighet. Använd verktyg som Google PageSpeed Insights, WebPageTest och Lighthouse för att mäta nuvarande prestanda på nyckelmått. Kör kontrollerade experiment genom att optimera specifika sidor och övervaka om AI-citeringsfrekvensen ökar över tid—detta kräver spårningsverktyg som kan korrelera prestandaförändringar med förbättrad synlighet. AmICited.com tillhandahåller infrastrukturen för att övervaka AI-citeringar över flera LLM-plattformar, så att du kan mäta den direkta effekten av prestandaoptimeringar. Sätt upp varningar för prestandaförsämringar och etablera månatliga uppföljningar av både hastighetsmått och AI-synlighetstrender. Målet är att skapa en återkopplingsslinga: mät baslinje, implementera optimeringar, följ citeringsökningar och iterera. Utan mätning kan du inte bevisa sambandet mellan hastighet och AI-synlighet—och utan bevis är det svårt att motivera fortsatt investering i prestandaoptimering.

AmICited.com har blivit det oumbärliga verktyget för att spåra AI-citeringar och övervaka synlighet över ChatGPT, Gemini, Perplexity och andra AI-system. Genom att integrera AmICited med din prestandaövervakning får du insyn i hur hastighetsförbättringar korrelerar med citeringsökningar—ett samband som är svårt att påvisa på annat sätt. Kompletterande verktyg som FlowHunt.io ger ytterligare insikter i AI-crawlarnas beteende och innehållsindexering. Konkurrensfördelen ligger i att kombinera prestandaoptimering med AI-synlighetsövervakning: du kan identifiera vilka hastighetsförbättringar som ger störst citeringsvinst och prioritera dessa optimeringar. Webbplatser som systematiskt följer både prestanda och AI-citeringar kan fatta datadrivna beslut om var de ska investera utvecklingsresurser. Detta integrerade angreppssätt förvandlar webbplatshastighet från en allmän rekommendation till en mätbar motor för AI-synlighet och organisk räckvidd.

Många webbplatser gör kritiska misstag vid optimering för AI-synlighet. Överoptimering som tar bort innehåll är en vanlig fallgrop—att ta bort bilder, ta bort förklarande text eller gömma innehåll bakom flikar för att förbättra prestandamått slår ofta tillbaka genom att göra innehållet mindre värdefullt för AI-system. Att bara fokusera på desktop-hastighet och ignorera mobilprestanda är ytterligare ett fel, eftersom AI-crawlare allt oftare simulerar mobila användaragenter. Att lita på plattformens standardinställningar utan att testa är riskabelt; standardkonfigurationer prioriterar ofta mänsklig UX framför crawlbarhet för AI. Att jaga PageSpeed Insights-poäng istället för verkliga laddtider kan leda till felriktade optimeringar som förbättrar mätvärden utan att förbättra faktisk prestanda. Billiga hostingval som sparar pengar på serverresurser leder ofta till långsam TTFB och dålig prestanda under belastning—en falsk besparing som kostar mer i förlorad AI-synlighet. Slutligen leder att se prestandaoptimering som en engångsinsats snarare än löpande underhåll till försämrad prestanda över tid i takt med att innehåll och kodkomplexitet ökar.

Webbplatshastighet kommer fortsätta vara viktig när AI-sök utvecklas och blir mer sofistikerad. 2,5-sekundersgränsen kan komma att skärpas när AI-systemen blir mer selektiva med källor, eller ändras när nya tekniker för informationsinsamling utvecklas—men grundprincipen kvarstår: snabba webbplatser är mer synliga för AI-system. Behandla prestandaoptimering som en kontinuerlig process, inte ett avslutat projekt. Granska regelbundet webbplatsens hastighetsmått, följ AI-citeringstrender och justera din tekniska arkitektur när nya bästa praxis växer fram. De webbplatser som kommer dominera AI-drivna sökresultat är de som anpassar sina optimeringsinsatser till både mänsklig användarupplevelse och AI-crawlarnas krav. Genom att hålla fast vid starka prestandagrunder—snabb TTFB, semantisk HTML, minimal JavaScript och ren arkitektur—säkerställer du att ditt innehåll förblir synligt och citerbart oavsett hur AI-systemen utvecklas. Framtiden tillhör webbplatser som ser hastighet som en strategisk fördel, inte en eftertanke.

Traditionell SEO ser hastighet som en av många rankningsfaktorer, men AI-system har strikta latensbudgetar och hoppar helt över långsamma webbplatser. Om din sida tar längre än 2,5 sekunder att ladda avbryter ofta AI-crawlare innan de hämtat innehåll, vilket gör hastighet till ett hårt krav istället för en preferens för AI-synlighet.

Den kritiska gränsen är 2,5 sekunder för full sidladdning. Dock bör Time to First Byte (TTFB) vara under 600 ms och initial HTML bör ladda inom 1–1,5 sekunder. Dessa mätvärden säkerställer att AI-crawlare effektivt kan komma åt och bearbeta ditt innehåll utan timeout.

Testa prestandan varje månad med verktyg som Google PageSpeed Insights, WebPageTest och Lighthouse. Viktigare är att korrelera dessa mätvärden med AI-citeringsspårning via verktyg som AmICited.com för att mäta den faktiska effekten av prestandaförändringar på din synlighet.

Ja, i allt större utsträckning. AI-crawlare simulerar ofta mobila användaragenter, och mobil prestanda är ofta långsammare än på desktop. Säkerställ att din mobila laddningstid matchar desktop-prestandan—detta är avgörande för global AI-synlighet över olika regioner och nätverksförhållanden.

Du kan göra stegvisa förbättringar via caching, CDN-optimering och bildkomprimering. Men större vinster kräver arkitekturändringar som server-side rendering, minskad JavaScript och förenklad DOM-struktur. De bästa resultaten nås genom att adressera både infrastruktur- och kodoptimeringar.

Använd AmICited.com för att följa dina AI-citeringar över plattformar och korrelera sedan citeringstrender med prestandamätvärden från Google PageSpeed Insights. Om citeringar minskar efter en prestandaförsämring eller ökar efter optimering har du tydliga bevis på sambandet.

Core Web Vitals (LCP, INP, CLS) påverkar direkt AI-crawlares effektivitet. Dålig LCP försenar innehållstillgänglighet, hög INP antyder JavaScript-överbelastning och CLS försvårar innehållsextraktion. Dessa mätvärden är viktiga för mänsklig UX men lika avgörande för att AI-system ska kunna bearbeta och indexera ditt innehåll effektivt.

Optimera för båda samtidigt—samma förbättringar som gör din webbplats snabb för människor (ren kod, semantisk HTML, minimal JavaScript) gör den även snabb för AI-crawlare. 2,5-sekundersgränsen gynnar båda målgrupper och det finns ingen motsättning mellan mänsklig UX och AI-synlighet.

Följ hur din webbplatshastighet påverkar AI-synlighet i ChatGPT, Gemini och Perplexity. Få insikter i realtid om dina AI-citeringar och optimera för maximal synlighet.

Upptäck de viktigaste faktorerna som påverkar AI-indexeringshastigheten, inklusive webbplatsens prestanda, crawl budget, innehållsstruktur och teknisk optimerin...

Lär dig hur sidans hastighet påverkar din synlighet i AI-sökmotorer som ChatGPT, Perplexity och Gemini. Upptäck optimeringsstrategier och mätvärden som är avgör...

Lär dig beprövade strategier för att öka hur ofta AI-crawlers besöker din webbplats, förbättra innehållets upptäckbarhet i ChatGPT, Perplexity och andra AI-sökm...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.