Am I Cited vs Peec AI: Vilken plattform passar dina behov?

Jämför AmICited och Peec AI för AI-synlighetsövervakning. Ta reda på vilken plattform som är bäst för att spåra varumärkesomnämnanden i ChatGPT, Perplexity och ...

Lär dig hur du balanserar varumärkessynlighet i AI-svar med innehållsskydd. Upptäck strategier för att övervaka AI-nämningar, skydda immateriella rättigheter och behålla kundförtroende samtidigt som du maximerar din närvaro i ChatGPT, Perplexity och andra AI-plattformar.

Balansera synlighet och innehållsskydd genom att implementera en lagerbaserad strategi som kombinerar tekniska skyddsåtgärder som DRM och vattenmärkning med transparenta datapolicys, förstapartsdatainsamling och övervakningsverktyg. Detta säkerställer att ditt varumärke syns i AI-svar samtidigt som du behåller kontroll över hur ditt innehåll används och skyddar kunddata från obehörig åtkomst.

Den moderna digitala världen innebär en grundläggande utmaning för varumärken: du måste vara synlig där dina kunder söker, samtidigt som du måste skydda din immateriella egendom och kunddata från missbruk. Denna spänning har ökat dramatiskt med framväxten av AI-drivna sökmotorer och svarsgeneratorer som ChatGPT, Perplexity och Google AI Overviews. Dessa plattformar driver nu betydande trafik till webbplatser—vissa företag rapporterar att över 1 % av alla sessioner kommer från AI-plattformar—men de skapar också nya risker för innehållsstöld och varumärkesförvanskning. Nyckeln till framgång ligger inte i att välja mellan synlighet och skydd, utan i att implementera en strategisk, lagerbaserad metod som uppnår båda samtidigt.

Synlighet i AI-svar har blivit lika avgörande som traditionella sökmotorrankningar. När användare ställer AI-plattformar frågor om din bransch, produktkategori eller specifika problem du löser, så dyker ditt varumärke antingen upp i svaret eller inte. Om du är osynlig hittar potentiella kunder istället dina konkurrenter. Men för att uppnå denna synlighet krävs det att du publicerar innehåll som AI-system kan komma åt och citera—vilket skapar exponeringsrisker. Ditt innehåll kan återpubliceras utan källhänvisning, din skyddade information kan extraheras och återanvändas, eller så kan ditt varumärke förvrängas i AI-svar. Insatserna är höga: varumärken som behärskar denna balans tar marknadsandelar som blir nästintill omöjliga att återta, medan de som ignorerar det möter både synlighetsluckor och skyddsbrister.

Det första lagret i din strategi handlar om tekniska skyddsåtgärder som låter dig publicera innehåll för AI-synlighet samtidigt som du behåller kontroll över hur det används. Digital Rights Management (DRM) är avgörande för att skydda videoinnehåll, onlinekurser och skyddat utbildningsmaterial. DRM-system styr åtkomst, förhindrar obehörig kopiering och blockerar skärminspelning—vanliga metoder pirater använder för att stjäla innehåll. När du publicerar innehåll som AI-system kan citera, säkerställer DRM att endast auktoriserade användare får tillgång till hela, oskyddade versionen. För dokument och PDF-filer ger kryptering och dokumentbaserad DRM liknande skydd, så att du kan dela innehåll med specifika målgrupper men förhindra vidare spridning.

Vattenmärkning fungerar både som avskräckande och spårningsmetod. Synliga vattenmärken med din logotyp eller varumärke påminner användarna om att innehållet är ditt och avskräcker från delning. Osynliga vattenmärken—även kallat fingeravtryck—lägger in unika identifierare kopplade till specifika användare eller tidsstämplar. Om ditt innehåll dyker upp på obehöriga plattformar avslöjar vattenmärket exakt vilket användarkonto som läckt det, så att du kan vidta riktade åtgärder. Dynamisk vattenmärkning, som ändras beroende på betraktarens identitet, är särskilt effektiv eftersom varje kopia blir unik och spårbar. Detta tillvägagångssätt låter dig publicera innehåll fritt för AI-synlighet och samtidigt behålla möjligheten att identifiera och stoppa obehörig spridning.

Kryptering skyddar data under överföring och lagring och förhindrar avlyssning eller obehörig åtkomst. När du publicerar innehåll som AI-system kommer att använda, ser kryptering till att känslig information i det innehållet förblir skyddad. Detta är särskilt viktigt för innehåll som innehåller skyddade metoder, kunddata eller konkurrensinformation. Genom att kryptera känsliga delar eller kräva autentisering för att få tillgång till hela innehållet kan du publicera tillräckligt med information för att AI-system ska kunna citera ditt varumärke, samtidigt som du håller dina mest värdefulla immateriella tillgångar säkra.

Medan tekniska skyddsåtgärder skyddar ditt innehåll, skyddar integritetsdrivna marknadsföringsstrategier dina kunder och bygger förtroende. Utmaningen är att många varumärken samlar in omfattande kunddata för att personanpassa marknadsföringen och förbättra synligheten, men detta skapar integritetsrisker som skadar förtroendet och kan leda till böter. Lösningen är förstapartsdatainsamling—att samla information direkt från kunder via enkäter, e-postprenumerationer, webbplatsinteraktioner och uttryckliga samtyckesmekanismer istället för att förlita sig på tredjepartscookies eller datamäklare.

Förstapartsdata är mer tillförlitlig, följer regler som GDPR och CCPA bättre och är mer värdefull eftersom den kommer direkt från din målgrupp. När du samlar in förstapartsdata på ett transparent sätt förstår kunderna exakt vilken information du samlar in och varför. Detta bygger förtroende och minskar risken för dataintrång eller missbruk. Du kan sedan använda dessa data för att förbättra din synlighet i AI-svar genom att förstå vilka frågor dina kunder ställer och skapa innehåll som adresserar dessa specifika behov—utan att behöva använda påträngande spårning eller datadelning.

Transparenta datapolicys är lika viktiga. Din integritetspolicy ska tydligt förklara vilken data du samlar in, hur du använder den, hur länge du behåller den och vilka rättigheter kunderna har att få tillgång till eller ta bort sin information. Gör dessa policys lätta att hitta och lätta att förstå—undvik juridiskt språk som döljer dina faktiska rutiner. När kunder ser att du är transparent om datahantering är de mer benägna att dela information frivilligt, vilket faktiskt förbättrar din förmåga att skapa riktat, relevant innehåll för AI-synlighet. Detta skapar en positiv spiral: transparens bygger förtroende, förtroende möjliggör bättre datainsamling och bättre data möjliggör mer effektiva synlighetsstrategier.

Övervakning i realtid av hur ditt varumärke syns i AI-svar är avgörande för att upprätthålla både synlighet och skydd. Till skillnad från traditionella sökmotorer där du kan kontrollera rankningar manuellt uppdateras AI-plattformar ständigt och genererar svar dynamiskt utifrån användarfrågor. Du behöver specialiserade verktyg som spårar dina varumärkesnämningar över flera AI-plattformar, övervakar sammanhanget där du nämns och identifierar när ditt innehåll citeras eller förvanskas.

| Övervakningsdimension | Vad ska spåras | Varför det är viktigt |

|---|---|---|

| Nämningsfrekvens | Hur ofta ditt varumärke dyker upp i AI-svar på olika plattformar | Avslöjar synlighetsluckor och förbättringsmöjligheter |

| Citeringssammanhang | Om du nämns som ledare, alternativ eller fotnot | Avgör om AI-nämningar driver kvalificerad trafik eller förvirrade prospekt |

| Källhänvisning | Vilka av dina innehållsdelar AI-system citerar | Visar vilka innehållstyper och ämnen som tilltalar AI-plattformar |

| Konkurrenspositionering | Vilka varumärken som visas tillsammans med ditt i svaren | Identifierar marknadsmöjligheter och konkurrenshot |

| Tonalitet och korrekthet | Hur ditt varumärke beskrivs och om informationen är aktuell | Fångar upp förvanskning eller föråldrad information innan det skadar ditt rykte |

| Trafikkorrelation | Om ökad AI-synlighet leder till faktiska webbplatsbesök | Bevisar ROI och styr optimeringsprioriteringar |

Olika AI-plattformar har olika källpreferenser. ChatGPT föredrar Wikipedia, Reddit och Forbes. Perplexity föredrar Reddit, YouTube och Gartner. Google AI Overviews citerar Reddit, YouTube och Quora. Endast cirka 50 % av AI-citeringar överlappar med traditionella Google-sökresultat, vilket betyder att din SEO-strategi ensam inte säkrar AI-synlighet. Du behöver plattformsspecifik övervakning för att förstå var ditt varumärke syns och var det saknas. Verktyg som uppdateras minst dagligen—helst var fjärde timme—är avgörande eftersom AI-plattformar ständigt förändrar sina algoritmer och träningsdata. En konkurrents ändrade innehållsstrategi eller en plattformsuppdatering kan påverka din synlighet inom timmar, inte veckor.

Att skapa innehåll som AI-system citerar samtidigt som du skyddar din immateriella egendom kräver en strategisk innehållsstrategi. AI-system föredrar strukturerat, faktarikt innehåll med tydliga rubriker, koncisa svar och semantisk tydlighet. Det innebär att ditt innehåll bör besvara vanliga kundfrågor direkt, ge specifika data och exempel samt använda format som gör informationen lätt att extrahera. FAQ-sidor, guider och jämförelseartiklar fungerar särskilt bra eftersom de direkt adresserar de frågor användare ställer till AI-plattformar.

Du behöver dock inte publicera din mest värdefulla immateriella egendom för att uppnå AI-synlighet. Publicera istället tillräckligt med information för att citeras men behåll dina djupaste insikter, skyddade metoder och konkurrensfördelar bakom betalväggar, medlemskap eller åtkomstkontroller. Du kan exempelvis publicera en detaljerad guide om branschens bästa praxis (som AI-system kommer att citera), men behålla din specifika implementeringsmetod och kundresultat i en premiumresurs för betalande kunder. Detta ger dig synlighet i AI-svar samtidigt som du skyddar ditt mest värdefulla innehåll.

Innehållsdiversifiering är lika viktigt. Eftersom olika AI-plattformar föredrar olika källor, utöka din närvaro utanför din egen webbplats. Skapa innehåll på Reddit, Quora, branschpublikationer och YouTube—plattformar där AI-system ofta hämtar information. Det innebär inte att duplicera ditt webbplatsinnehåll; skapa istället plattformsspecifikt innehåll som adresserar de frågor användare ställer på respektive plattform. En detaljerad Reddit-diskussion om branschutmaningar citeras annorlunda än en YouTube-guide, och båda ger olika typer av synlighet. Genom att diversifiera din innehållsnärvaro ökar du sannolikheten att AI-system citerar dig på flera plattformar och i olika sammanhang.

Rollbaserad åtkomstkontroll (RBAC) säkerställer att endast behöriga teammedlemmar får tillgång till känsligt innehåll och kunddata. När du implementerar RBAC definierar du specifika roller—som innehållsskapare, redaktör, chef och administratör—och tilldelar behörigheter baserat på vad varje roll behöver utföra. En frilansskribent kan ha åtkomst att publicera innehåll men inte se kunddata. En kundtjänstmedarbetare kan se kundinformation men inte ekonomiska uppgifter. Denna princip om minsta privilegium—att ge användare endast den åtkomst de absolut behöver—minskar risken för interna läckor eller missbruk dramatiskt.

Åtkomstloggar och revisioner skapar ansvarstagande och låter dig upptäcka misstänkt aktivitet. När du vet vem som har tillgång till vilken information och när, kan du identifiera ovanliga mönster som kan tyda på säkerhetsbrott eller avsiktligt missbruk. Regelbundna revisioner av aktiva användare och åtkomsträttigheter hjälper dig upptäcka överbehörighet innan det blir ett problem. Om till exempel en konsults åtkomst inte har tagits bort efter avslutat projekt, kan en revision identifiera detta och låta dig omedelbart begränsa deras behörigheter.

Sekretessavtal och IP-ägaravtal med anställda, frilansare och leverantörer ger juridiskt skydd för ditt innehåll. Dessa avtal ska tydligt ange att du äger allt producerat innehåll, att anställda och konsulter inte får återanvända innehållet för konkurrenter och att de måste upprätthålla sekretess. När någon skriver på ett sekretessavtal förstår de de juridiska konsekvenserna av att läcka eller missbruka ditt innehåll, vilket fungerar avskräckande. I kombination med tekniska skydd och övervakning skapar juridiska avtal ett heltäckande skyddsramverk.

Det mest effektiva sättet att balansera synlighet och skydd är radikal transparens kring dina rutiner. När du är transparent om hur du samlar in data, hur du skyddar den och hur du använder den litar kunderna mer på dig och engagerar sig mer. Denna transparens gäller även din innehållsstrategi: var tydlig med vilken information som är fritt tillgänglig, vad som kräver autentisering och vad som är reserverat för premiumkunder. Denna tydlighet förbättrar faktiskt din synlighet i AI-svar eftersom AI-system kan förstå din innehållsstruktur bättre och citera dig mer korrekt.

Transparens gäller också din varumärkesrepresentation. Om du övervakar AI-svar och upptäcker att ditt varumärke förvanskats, svara snabbt och transparent. Kontakta AI-plattformen, lämna rättad information och förklara varför nuvarande beskrivning är felaktig. Många AI-plattformar har funktioner för att rapportera felaktigheter och de blir alltmer lyhörda eftersom de vill att deras svar ska vara korrekta. Genom att vara transparent i rättelser och förbättringar bygger du trovärdighet hos både AI-plattformar och användare.

Följ både synlighets- och skyddsmått för att säkerställa att din strategi fungerar. Synlighetsmått inkluderar nämningsfrekvens på AI-plattformar, citeringssammanhang (om du nämns som ledare eller alternativ) och trafik från AI-plattformar. Skyddsmått inkluderar incidenter med obehörig innehållsspridning, försök till dataintrång och kundförtroendesiffror. Målet är att se ökade synlighetsmått samtidigt som skyddsmåtten förblir stabila eller förbättras.

Om exempelvis dina AI-nämningar ökar med 40 % men du också upptäcker en 20 % ökning av obehörig innehållsspridning behöver din strategi justeras. Du kan behöva starkare DRM, mer aggressiv övervakning eller annan innehållspositionering. Omvänt, om synligheten ökar samtidigt som obehörig spridning minskar, fungerar din strategi—du har hittat balansen där du syns där det räknas samtidigt som du skyddar det som är värdefullt.

I takt med att AI-plattformar blir mer sofistikerade och inflytelserika blir balansen mellan synlighet och skydd allt viktigare. Personalisering utvecklas snabbt—AI-system blir kapabla att minnas tidigare sökningar och anpassa svar baserat på användarhistorik. Det innebär att varumärkessynlighet allt mer kommer att bero på användarpreferenser och sammanhang, inte bara innehållskvalitet. Optimering i realtid blir avgörande när plattformar prioriterar innehåll som uppdateras dynamiskt och ger aktuell information. Regulatorisk granskning kommer att öka, med striktare krav på hur AI-plattformar citerar källor och hanterar kommersiellt inflytande i svar.

De varumärken som lyckas i denna miljö är de som behärskar balansen: synliga där kunder söker, skyddande av sin immateriella egendom, transparenta i sin datahantering och proaktiva i att övervaka och reagera på hur de representeras. Detta är ingen engångsåtgärd; det är en pågående strategi som utvecklas i takt med att AI-plattformar och kundförväntningar förändras. Genom att implementera de tekniska, strategiska och juridiska skydd som beskrivits här positionerar du ditt varumärke för att ta marknadsandelar som AI-synlighet skapar—samtidigt som du skyddar de tillgångar som gör ditt varumärke värdefullt.

Följ hur ditt varumärke syns i ChatGPT, Perplexity och andra AI-plattformar samtidigt som du skyddar ditt innehåll från obehörig användning. Få insikter i realtid om din AI-synlighet och konkurrenspositionering.

Jämför AmICited och Peec AI för AI-synlighetsövervakning. Ta reda på vilken plattform som är bäst för att spåra varumärkesomnämnanden i ChatGPT, Perplexity och ...

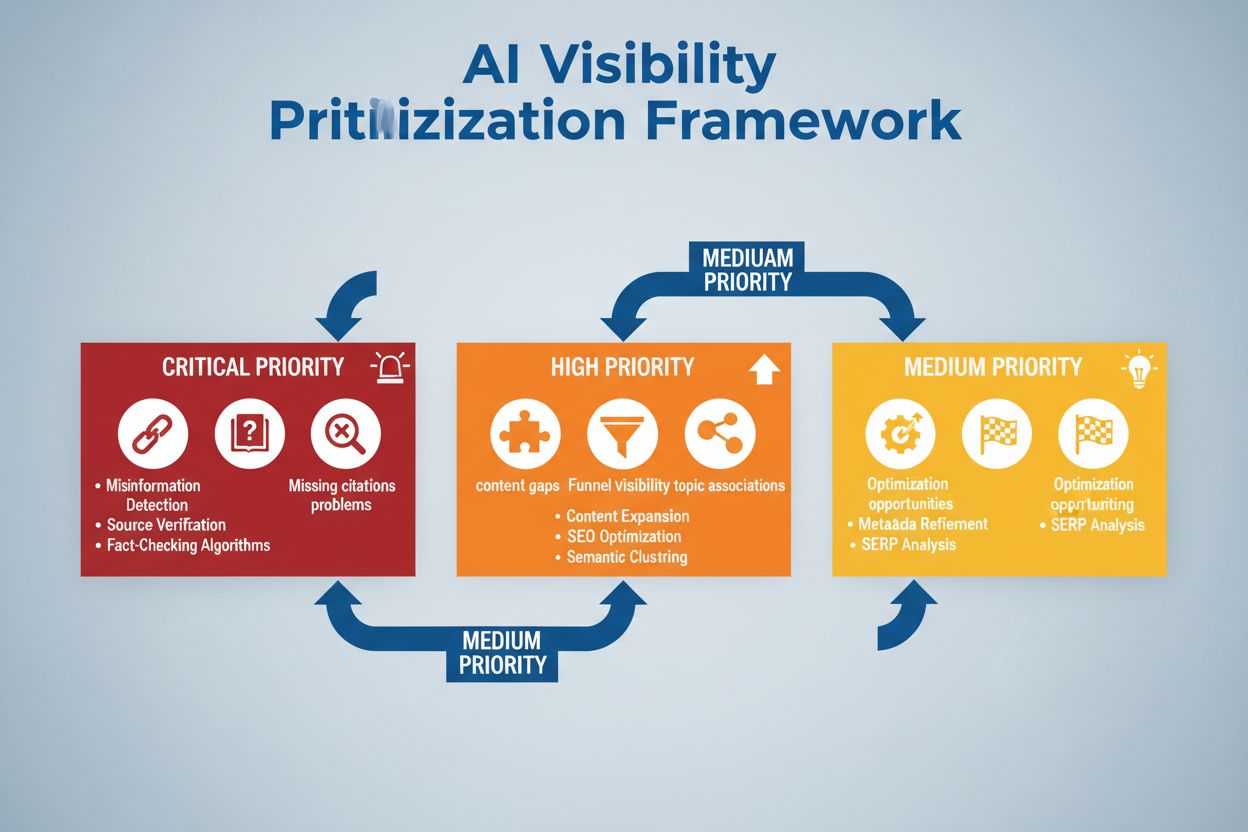

Lär dig hur du strategiskt prioriterar AI-synlighetsproblem. Upptäck ramverket för att identifiera kritiska, höga och medelhöga prioriteringsproblem i din AI-sö...

Jämför AmICited AI-övervakning med Writesonic GEO. Förstå skillnaderna mellan ren övervakning och integrerad optimering för AI-synlighet i sök.

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.