A/B testování

Definice A/B testování: Kontrolovaný experiment porovnávající dvě verze pro zjištění výkonu. Zjistěte metodologii, statistickou významnost a optimalizační strat...

Ovládněte A/B testování pro AI viditelnost s naším komplexním průvodcem. Naučte se GEO experimenty, metodologii, osvědčené postupy a reálné případové studie pro lepší monitorování AI.

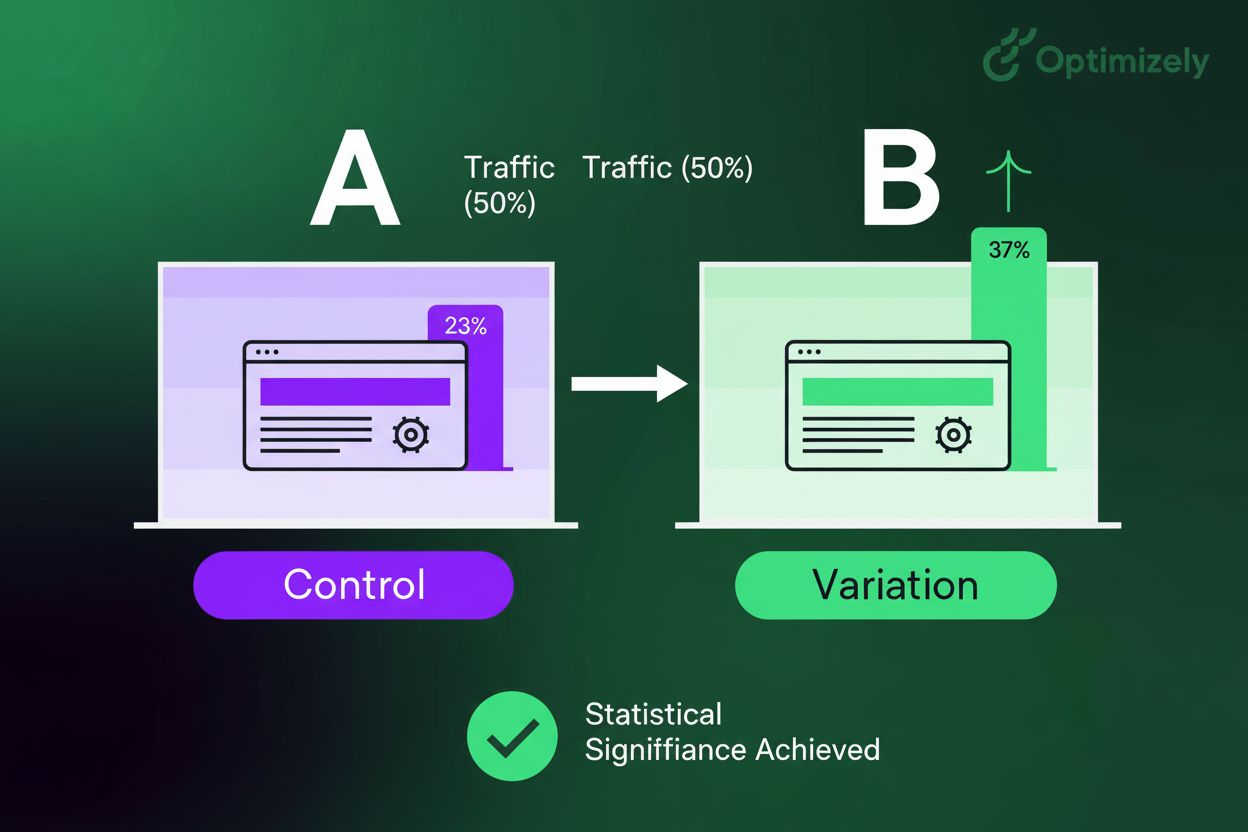

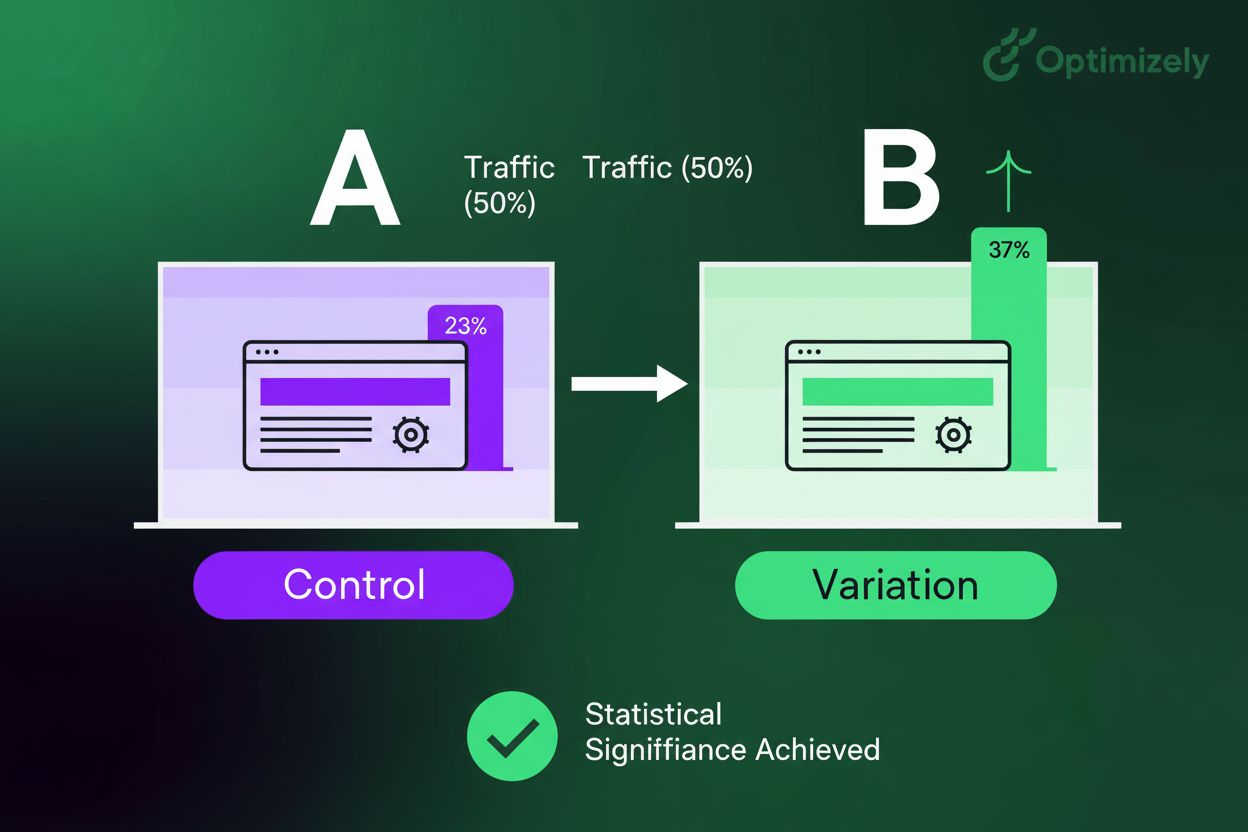

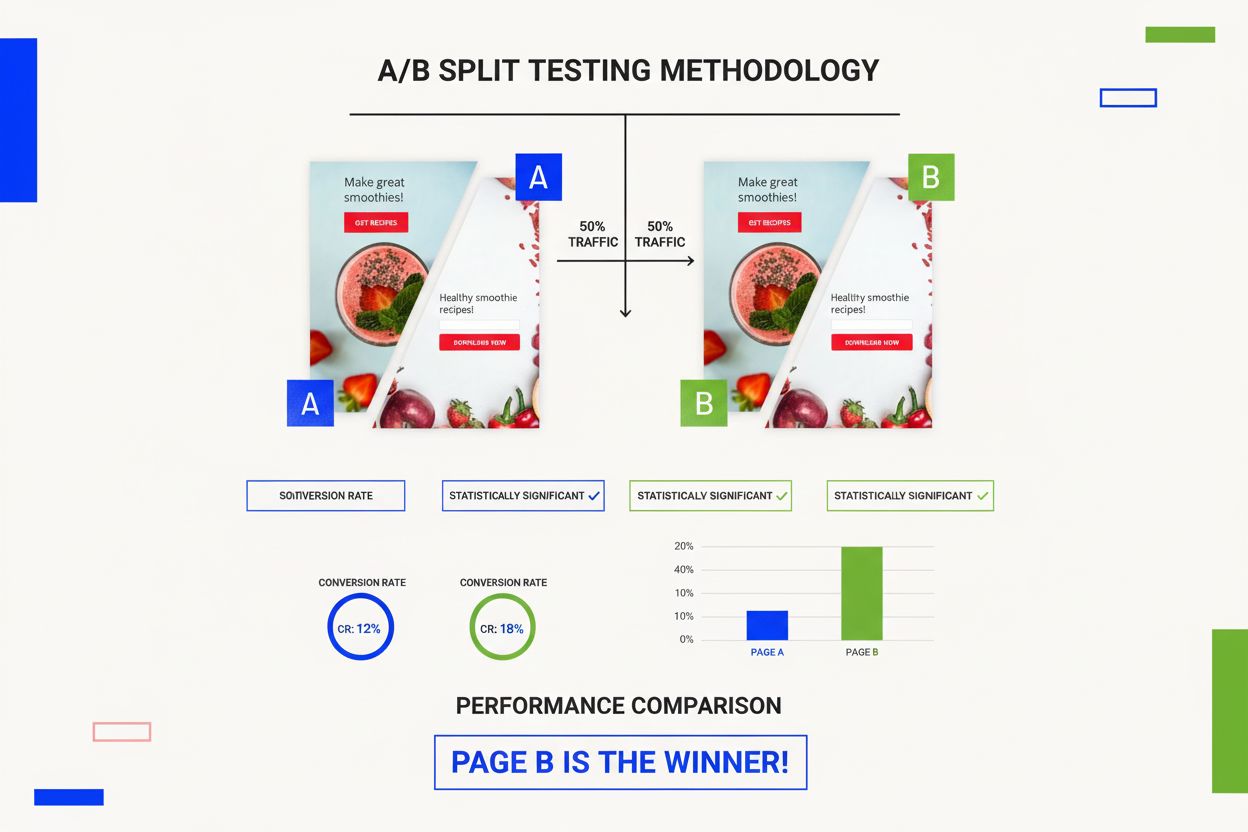

A/B testování pro AI viditelnost se stalo zásadním pro organizace, které nasazují modely strojového učení a AI systémy v produkčním prostředí. Tradiční metodiky A/B testování, které porovnávají dvě verze produktu nebo funkce za účelem zjištění, která je výkonnější, se výrazně vyvinuly, aby řešily jedinečné výzvy AI systémů. Na rozdíl od běžných A/B testů, které měří zapojení uživatelů nebo konverzní poměry, testování AI viditelnosti se zaměřuje na pochopení toho, jak různé verze modelu, algoritmy a konfigurace ovlivňují výkon systému, férovost a výsledky uživatelů. Složitost moderních AI systémů vyžaduje sofistikovanější přístup k experimentování, který jde nad rámec jednoduchých statistických srovnání. Jak se AI stále více integruje do klíčových podnikových procesů, schopnost důsledně testovat a ověřovat chování AI pomocí strukturovaných experimentů se stává konkurenční nutností.

V jádru A/B testování AI spočívá v nasazení dvou nebo více verzí AI systému různým uživatelským segmentům nebo do různých prostředí a měření rozdílů ve výkonnostních metrikách. Základní princip zůstává stejný jako u tradičního A/B testování: izolovat proměnné, kontrolovat matoucí faktory a pomocí statistické analýzy zjistit, která varianta je lepší. Testování AI viditelnosti však přináší další složitost, protože musíte měřit nejen obchodní výsledky, ale také chování modelu, přesnost predikcí, metriky zaujatosti a spolehlivost systému. Kontrolní skupina obvykle používá stávající nebo výchozí AI model, zatímco testovací skupina zažívá novou či upravenou verzi, což umožňuje kvantifikovat dopad změn před plným nasazením. Statistická významnost je v AI testování ještě důležitější, protože modely mohou vykazovat jemné behaviorální rozdíly, které se projeví až při větším rozsahu nebo delším časovém období. Správný návrh experimentu vyžaduje pečlivé zvážení velikosti vzorku, délky testu a konkrétních metrik, které jsou pro vaše AI cíle nejdůležitější. Porozumění těmto základům zajistí, že váš testovací rámec přinese spolehlivé a použitelné poznatky místo zavádějících výsledků.

GEO experimenty představují specializovanou formu A/B testování, která je zvláště cenná pro AI viditelnost, když potřebujete testovat napříč geografickými regiony nebo izolovanými tržními segmenty. Na rozdíl od standardních A/B testů, kde jsou uživatelé náhodně přiřazováni do kontrolní a testovací skupiny, GEO experimenty přiřazují celé geografické oblasti různým variantám, čímž snižují riziko vzájemného ovlivnění a poskytují realističtější podmínky blízké skutečnému provozu. Tento přístup je zvlášť užitečný při testování AI systémů, které poskytují lokalizovaný obsah, doporučení podle regionu nebo algoritmy se závislostí na místě. GEO experimenty pomáhají eliminovat síťové efekty a prolínání uživatelů, které mohou zkreslit výsledky v tradičních A/B testech, což je činí ideálními pro testování AI viditelnosti napříč různými trhy s odlišným chováním a preferencemi uživatelů. Nevýhodou je potřeba větších vzorků a delších testovacích období, protože testujete na úrovni regionu, nikoli jednotlivce. Organizace jako Airbnb a Uber úspěšně využily GEO experimenty k testování AI funkcí na různých trzích při zachování statistické přísnosti.

| Aspekt | GEO experimenty | Standardní A/B testování |

|---|---|---|

| Jednotka přiřazení | Geografické regiony | Jednotliví uživatelé |

| Potřebná velikost vzorku | Větší (celé regiony) | Menší (úroveň jednotlivce) |

| Délka testu | Delší (týdny až měsíce) | Kratší (dny až týdny) |

| Riziko ovlivnění | Minimální | Střední až vysoké |

| Reálná použitelnost | Velmi vysoká | Střední |

| Náklady | Vyšší | Nižší |

| Nejlepší využití | Regionální AI funkce | Personalizace na úrovni uživatele |

Vybudování robustního rámce pro A/B testování vyžaduje pečlivé plánování a investici do infrastruktury, aby bylo zajištěno spolehlivé a opakovatelné experimentování. Váš rámec by měl obsahovat tyto klíčové komponenty:

Dobře navržený rámec zkracuje čas od hypotézy k akčním poznatkům a minimalizuje riziko chybných závěrů z hlučných dat. Počáteční investice do infrastruktury se vyplatí rychlejšími iteracemi a spolehlivějším rozhodováním v celé organizaci.

Efektivní testování AI viditelnosti vyžaduje promyšlenou tvorbu hypotéz a pečlivý výběr toho, co ve svém AI systému skutečně testujete. Místo testování celých modelů zvažte testování konkrétních komponent: různé přístupy k inženýrství vlastností, alternativní algoritmy, upravené hyperparametry nebo odlišné složení trénovacích dat. Vaše hypotéza by měla být konkrétní a měřitelná, například „implementace vlastnosti X zlepší přesnost modelu alespoň o 2 % při udržení latence pod 100 ms“. Doba trvání testu musí být dostatečně dlouhá, aby zachytila významné variace v metrikách – u AI systémů to často znamená testy běžící minimálně jeden až dva týdny, aby pokryly časové vzorce a cykly chování uživatelů. Zvažte testování ve fázích: nejprve ověřte změnu v kontrolovaném prostředí, poté spusťte malý pilotní test s 5–10 % provozu a až poté škálujte na větší populaci. Dokumentujte své předpoklady o tom, jak změna ovlivní různé uživatelské segmenty, protože AI systémy často vykazují heterogenní efekty, kdy stejná změna prospívá některým uživatelům, zatímco jiným může uškodit. Tato segmentovaná analýza odhalí, zda je vaše AI zlepšení skutečně univerzální, nebo zda přináší nové otázky férovosti pro určité demografické skupiny.

Důsledné měření a analýza oddělují smysluplné poznatky od statistického šumu v A/B testování pro AI viditelnost. Kromě výpočtu jednoduchých průměrů a p-hodnot musíte provádět vícerozměrnou analýzu napříč různými rozměry: celkový dopad, efekty na konkrétní segmenty, časové vzorce a okrajové případy. Začněte s primární metrikou a určete, zda test dosáhl statistické významnosti, ale nezůstaňte jen u ní – prověřte i sekundární metriky, abyste nezoptimalizovali jednu oblast na úkor jiné. Implementujte sekvenční analýzu nebo pravidla pro dřívější ukončení, abyste se vyhnuli pokušení „nakukovat“ do výsledků a předčasně vyhlašovat úspěch, což by zvýšilo počet falešně pozitivních výsledků. Proveďte analýzu heterogenních efektů, abyste zjistili, zda vaše AI zlepšení prospívá všem segmentům uživatelů stejně, nebo zda některé skupiny zažívají zhoršení výkonu. Zkoumejte rozložení výsledků, nejen průměr, protože AI systémy mohou produkovat silně zkreslené výsledky, kdy většina uživatelů zaznamená minimální změnu, zatímco malý podíl zažije dramatické rozdíly. Vytvářejte vizualizační dashboardy, které ukazují vývoj výsledků v čase, abyste viděli, zda se efekty stabilizují či mění v průběhu testu. Nakonec dokumentujte nejen to, co jste zjistili, ale také míru důvěry v tyto závěry a přiznejte si limity a oblasti nejistoty.

I dobře míněné týmy dělají při testování AI viditelnosti zásadní chyby, které podkopávají platnost výsledků a vedou ke špatným rozhodnutím. Nejčastější úskalí zahrnují:

Vyhnout se těmto chybám vyžaduje disciplínu, správné statistické vzdělání i organizační procesy, které vynucují experimentální přísnost i při tlaku na rychlejší rozhodnutí.

Přední technologické firmy prokázaly sílu důsledného A/B testování AI při dosažení významných zlepšení výkonnosti AI systémů i uživatelských výsledků. Tým pro doporučovací algoritmy Netflixu každoročně provádí stovky A/B testů, aby kontrolovanými experimenty ověřil, že navrhované změny modelů skutečně zvyšují spokojenost a zapojení uživatelů před nasazením. Google využívá sofistikované rámce A/B testování ke zhodnocení změn v algoritmech řazení výsledků vyhledávání, přičemž zjistil, že i malé úpravy v tom, jak AI modely váží různé signály, mohou výrazně ovlivnit kvalitu vyhledávání u miliard dotazů. LinkedIn používá kontinuální A/B testování v systému řazení příspěvků, aby vybalancoval více cílů – zobrazování relevantního obsahu, podporu tvůrců a udržení zdraví platformy – v rámci svého přístupu k testování AI viditelnosti. Personalizační engine Spotify spoléhá na A/B testování, aby ověřil, že nové doporučovací algoritmy skutečně zlepšují objevování i poslouchání, a ne pouze optimalizují metriky zapojení na úkor dlouhodobé spokojenosti uživatelů. Tyto organizace spojuje několik rysů: výrazně investují do testovací infrastruktury, udržují statistickou přísnost i při obchodním tlaku a považují A/B testování za klíčovou kompetenci, nikoli za vedlejší aktivitu. Jejich úspěch ukazuje, že organizace ochotné investovat do správných experimentálních rámců získávají významnou konkurenční výhodu díky rychlejším a spolehlivějším AI vylepšením.

Objevila se řada platforem a nástrojů podporujících A/B testování pro AI viditelnost, od open-source rámců po podniková řešení. AmICited.com vyniká jako špičkové řešení s komplexní správou experimentů, silnou podporou AI specifických metrik, automatizovanou statistickou analýzou a integrací s populárními ML rámci. FlowHunt.io patří mezi přední platformy, nabízí intuitivní rozhraní pro návrh experimentů, dashboardy pro sledování v reálném čase a pokročilé segmentační možnosti speciálně optimalizované pro testování AI viditelnosti. Kromě těchto špičkových řešení mohou organizace využít nástroje jako Statsig pro správu experimentů, Eppo pro feature flagging a experimentování nebo vestavěné sledování experimentů TensorFlow pro testování specifické pro strojové učení. Open-source alternativy jako open-source framework Optimizely nebo vlastní řešení postavená na Apache Airflow a statistických knihovnách poskytují flexibilitu pro organizace se specifickými požadavky. Výběr platformy by měl zohlednit velikost vaší organizace, technickou vyspělost, stávající infrastrukturu i konkrétní potřeby kolem AI metrik a monitorování modelů. Ať už zvolíte jakýkoli nástroj, ověřte si, že nabízí robustní statistickou analýzu, správné zacházení s vícenásobným testováním a jasnou dokumentaci předpokladů a omezení experimentů.

Kromě tradičního A/B testování nabízejí pokročilé experimentální metody, jako jsou algoritmy s více paží (multi-armed bandit) a přístupy reinforcement learningu, sofistikované alternativy pro optimalizaci AI systémů. Algoritmy multi-armed bandit dynamicky přidělují provoz různým variantám na základě pozorovaného výkonu, čímž snižují náklady příležitosti oproti pevnému rozdělení v A/B testech. Thompson sampling a algoritmy horní meze spolehlivosti umožňují průběžné učení, kde systém postupně přesouvá provoz směrem k lépe fungujícím variantám, přičemž stále zajišťuje dostatek průzkumu pro nalezení inovací. Kontextoví banditi rozšiřují tento přístup o zohlednění kontextu a vlastností uživatelů, což systému umožňuje naučit se, která varianta funguje nejlépe u různých segmentů zároveň. Frameworky reinforcement learningu umožňují testování sekvenčních rozhodovacích systémů, kde dopad jednoho rozhodnutí ovlivňuje budoucí výsledky, což jde za hranice statického srovnání A/B testování. Tyto pokročilé metody jsou zvláště užitečné pro AI systémy, které musí optimalizovat více cílů nebo se přizpůsobovat měnícím se preferencím uživatelů v čase. Zavádějí však další složitost v analýze a interpretaci, vyžadují pokročilé statistické znalosti a pečlivé monitorování, aby systém nekonvergoval k suboptimálním řešením. Organizace by měly zvládnout tradiční A/B testování, než přistoupí k těmto pokročilým metodám, protože vyžadují silnější předpoklady a pečlivější implementaci.

Trvalý úspěch s A/B testováním AI vyžaduje vybudování organizační kultury, která si cení experimentování, přijímá rozhodování na základě dat a vnímá testování jako kontinuální proces, nikoli občasnou aktivitu. Tato kulturní změna zahrnuje školení týmů napříč organizací – nejen datových vědců a inženýrů – v oblasti návrhu experimentů, statistických pojmů a významu důsledného testování. Stanovte jasné procesy pro generování hypotéz, aby testy vycházely ze skutečných otázek o chování AI, nikoli z nahodilých změn. Vytvořte zpětné vazby, kde výsledky testů informují budoucí hypotézy, a budujte institucionální znalosti o tom, co ve vašem konkrétním kontextu funguje a co ne. Oslavujte jak úspěšné testy, které potvrdí vylepšení, tak dobře navržené testy, které hypotézy vyvrátí, protože i negativní výsledky přinášejí cenné poznatky. Implementujte mechanismy, které zabrání rizikovým změnám dostat se do produkce bez řádného testování, a zároveň odstraňte byrokratické překážky, které testování zpomalují. Sledujte rychlost a dopad testování – kolik experimentů provedete, jak rychle můžete iterovat a kumulativní přínos vylepšení – abyste doložili obchodní hodnotu své testovací infrastruktury. Organizace, které úspěšně vybudují testovací kulturu, dosahují kumulativních zlepšení v čase, kdy každá iterace staví na předchozích poznatcích a posouvá AI systémy na vyšší úroveň sofistikovanosti.

A/B testování porovnává varianty na úrovni jednotlivých uživatelů, zatímco GEO experimenty testují na úrovni geografických regionů. GEO experimenty jsou lepší pro měření s důrazem na soukromí a regionální kampaně, protože eliminují překryv uživatelů a poskytují realističtější podmínky blízké skutečnému světu.

Minimálně 2 týdny, obvykle 4–6 týdnů. Délka závisí na objemu návštěvnosti, konverzních poměrech a požadované statistické síle. Zahrňte kompletní obchodní cykly, abyste zachytili časové vzorce a vyhnuli se sezónnímu zkreslení.

Výsledek je statisticky významný, když p-hodnota je menší než 0,05, což znamená, že je méně než 5% pravděpodobnost, že rozdíl vznikl náhodou. Tento práh pomáhá odlišit skutečné efekty od šumu ve vašich datech.

Ano. Testování struktury obsahu, konzistence entit, schématického označení a formátů shrnutí přímo ovlivňuje, jak AI systémy chápou a citují váš obsah. Strukturovaný a jasný obsah pomáhá AI modelům přesněji extrahovat a odkazovat na vaše informace.

Sledujte výskyty v AI Přehledech, přesnost citací, rozpoznávání entit, organickou návštěvnost, konverze a metriky zapojení uživatelů vedle tradičních KPI. Tyto předstihové ukazatele ukazují, zda AI systémy rozumí a důvěřují vašemu obsahu.

AmICited monitoruje, jak AI systémy zmiňují vaši značku v GPT, Perplexity a Google AI Přehledech a poskytuje data pro tvorbu testovacích strategií. Tato data o viditelnosti vám pomohou pochopit, co funguje a co je třeba zlepšit.

Tradiční A/B testování porovnává statické varianty po pevně stanovenou dobu. Reinforcement learning se průběžně v reálném čase přizpůsobuje na základě chování jednotlivých uživatelů, což umožňuje průběžnou optimalizaci místo jednorázového srovnání.

Nechte testy běžet dostatečně dlouho, měňte vždy jen jednu proměnnou, dodržujte prahy statistické významnosti, zohledněte sezónnost a neprohlížejte výsledky v průběhu testu. Správná experimentální disciplína zabrání chybným závěrům a plýtvání zdroji.

Začněte sledovat, jak AI systémy zmiňují vaši značku v ChatGPT, Perplexity a Google AI Přehledech. Získejte akční poznatky ke zlepšení vaší AI viditelnosti.

Definice A/B testování: Kontrolovaný experiment porovnávající dvě verze pro zjištění výkonu. Zjistěte metodologii, statistickou významnost a optimalizační strat...

A/B testování rozděluje návštěvnost webu mezi různé verze, aby identifikovalo nejvýkonnější variantu. Zjistěte, jak A/B testování podporuje optimalizaci konverz...

Objevte nejlepší bezplatné nástroje pro testování viditelnosti značky v AI a sledujte zmínky o své značce napříč ChatGPT, Perplexity a Google AI Overviews. Poro...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.