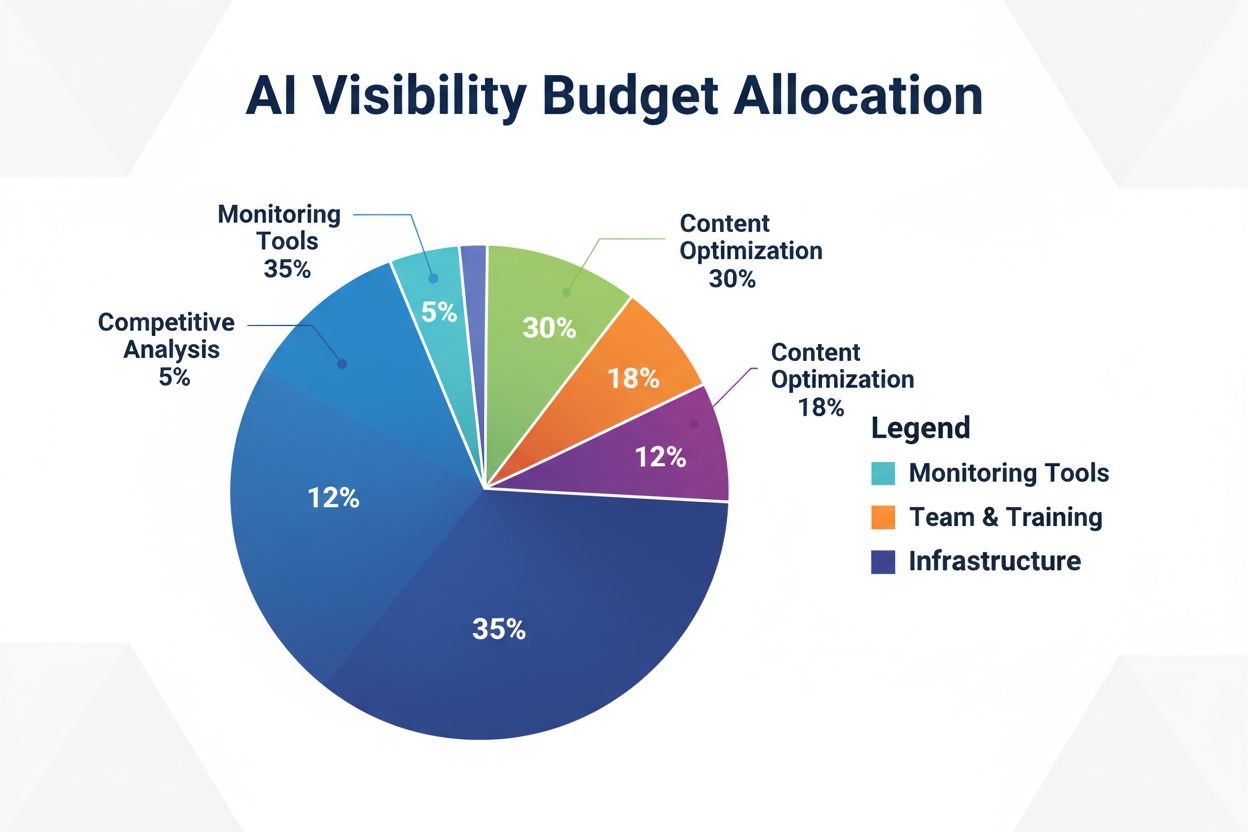

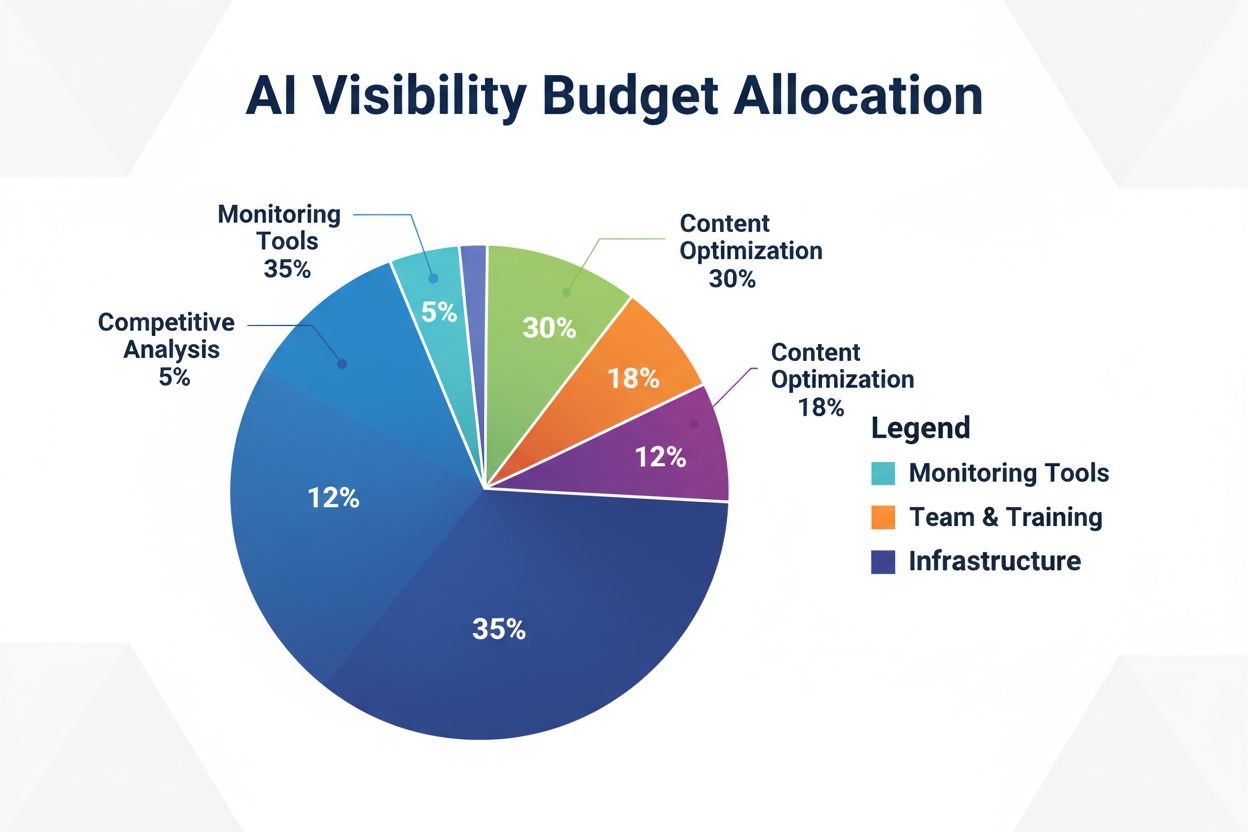

AI Synlighedsbudgetplanlægning: Hvor skal ressourcerne placeres

Lær hvordan du strategisk allokerer dit AI-synlighedsbudget på tværs af overvågningsværktøjer, indholdsoptimering, teamressourcer og konkurrentanalyse for at ma...

Lær hvordan du implementerer effektive AI-indholdsstyringspolitikker med synlighedsrammer. Opdag lovkrav, bedste praksis og værktøjer til ansvarlig håndtering af AI-systemer.

AI-synlighed refererer til den omfattende evne til at observere, spore og forstå, hvordan kunstig intelligens opererer i dit indholdsøkosystem. I indholdsstyring fungerer synlighed som det grundlæggende lag, der gør det muligt for organisationer at bevare kontrol, sikre lovoverholdelse og reducere risici forbundet med AI-genereret og AI-behandlet indhold. Uden klar synlighed i AI-systemer arbejder organisationer i blinde—ude af stand til at opdage bias, sikre lovmæssig overholdelse eller reagere på nye trusler. Synlighedsførst-styring forvandler reaktiv krisehåndtering til proaktiv risikoforebyggelse, så teams kan træffe informerede beslutninger om indholdskvalitet, autenticitet og alignment med organisationens værdier.

De fleste organisationer står over for et kritisk styringsgab mellem deres AI-adoptionshastighed og deres evne til effektivt at styre disse systemer. Forskning viser, at 63 % af organisationerne mangler formelle AI-styringsprogrammer, hvilket gør dem sårbare over for lovovertrædelser, tab af omdømme og driftsfejl. Dette gab øges, efterhånden som AI-systemer bliver mere sofistikerede og integreres i kerneforretningsprocesser, hvilket gør synlighed stadig sværere at opnå uden dedikerede rammer og værktøjer. Konsekvenserne rækker ud over lovmæssige sanktioner—organisationer uden synlighed kæmper med at opretholde indholdskvalitet, opdage skadelige outputs og demonstrere ansvarlighed over for interessenter. At lukke dette gab kræver målrettet investering i synlighedsmekanismer, der giver realtidsindsigt i AI-systemadfærd og indholdsresultater.

| Aspekt | Reaktiv styring | Proaktiv styring |

|---|---|---|

| Opdagelse | Problemer identificeres efter offentlig eksponering | Løbende overvågning opdager problemer tidligt |

| Respons | Krisehåndtering og skadeskontrol | Forebyggende handling og risikominimering |

| Overholdelse | Korrigeringer og sanktioner efter revision | Løbende verifikation af overholdelse |

| Risiko | Høj eksponering for ukendte trusler | Systematisk risikoregistrering og -styring |

Effektive AI-indholdsstyringspolitikker hviler på seks grundlæggende principper, der guider beslutningstagning og operationelle praksisser i din organisation. Disse principper danner en sammenhængende ramme, der balancerer innovation med ansvarlighed og sikrer, at AI-systemer støtter organisationens mål, mens de beskytter interessenter. Ved at indarbejde disse principper i politikken etablerer du klare forventninger til, hvordan AI-systemer skal opføre sig, og hvordan teams skal håndtere dem. Principperne arbejder sammen—gennemsigtighed muliggør ansvarlighed, menneskelig overvågning sikrer retfærdighed, og databeskyttelse skaber tillid. Organisationer, der operationaliserer disse principper konsekvent, overgår konkurrenter i lovoverholdelse, interessenternes tillid og langsigtet bæredygtighed.

Det regulatoriske landskab for AI-styring har accelereret dramatisk, og flere rammer fastsætter nu obligatoriske krav for organisationer, der anvender AI-systemer. EU AI-forordningen udgør den mest omfattende reguleringsindsats, klassificerer AI-systemer efter risikoniveau og pålægger strenge krav til højrisikoanvendelser som indholdsmoderering og -generering. NIST AI Risk Management Framework giver en fleksibel, ikke-forskrivende tilgang, der hjælper organisationer med at identificere, måle og styre AI-risici på tværs af deres drift. ISO 42001 fastlægger internationale standarder for AI-ledelsessystemer og tilbyder organisationer en struktureret metode til implementering af styring på tværs af virksomheden. Derudover skaber præsidentielle ordrer i USA og nye statslige regler et kludetæppe af krav, som organisationer skal navigere i. Disse rammer samles om fælles temaer: gennemsigtighed, ansvarlighed, menneskelig overvågning og løbende overvågning—hvilket gør synlighed til den afgørende nøgle for lovoverholdelse.

Opbygning af et robust politisk rammeværk kræver systematisk vurdering af dine nuværende AI-systemer, indholdsflow og risikobillede. Start med at gennemføre en omfattende AI-inventaroptælling, der dokumenterer hvert system, der genererer, behandler eller distribuerer indhold, inklusive dets formål, datakilder og potentielle påvirkning på interessenter. Opret derefter styringsniveauer, der tildeler forskellige tilsynsniveauer baseret på risiko—højrisikosystemer som indholdsmoderering kræver intensiv overvågning, mens lavrisikoapplikationer kan have lettere styring. Udarbejd klare politikker, der specificerer, hvordan hvert system skal fungere, hvilke resultater der er acceptable, og hvordan teams skal reagere på problemer. Skab ansvarsstrukturer, der tildeler ejerskab for overholdelse af politikker og etablerer eskaleringsprocedurer for styringsproblemer. Implementér til sidst målemetoder, der sporer overholdelse af politikker og giver data til løbende forbedringer af din styringstilgang.

At opnå AI-synlighed kræver implementering af specialiserede værktøjer og vurderingsmekanismer, der giver realtidsindsigt i systemadfærd og indholdsresultater. Overvågningsdashboards samler data fra AI-systemer, indholdsplatforme og compliance-systemer i samlede visninger, der muliggør hurtig problemopdagelse. Revisionsspor registrerer detaljerede optegnelser over AI-beslutninger, indholdsændringer og styringshandlinger, hvilket skaber ansvarlighed og understøtter lovmæssige undersøgelser. Vurderingsrammer evaluerer systematisk AI-systemer i forhold til styringsprincipper, identificerer mangler og forbedringsmuligheder, inden problemerne eskalerer. Automatiserede detektionssystemer markerer potentielt problematisk indhold, biased output eller politikovertrædelser, hvilket reducerer afhængigheden af manuel gennemgang og forbedrer konsistensen. Organisationer, der investerer i omfattende synlighedsværktøjer, opnår konkurrencefordele i lovoverholdelse, interessenternes tillid og operationel effektivitet.

Løbende overvågning forvandler styring fra en periodisk compliance-øvelse til en løbende operationel disciplin, der opdager og reagerer på problemer i realtid. Etabler overvågningsprotokoller, der definerer, hvilke målinger der er vigtigst for hvert AI-system—præcisionsrater, biasindikatorer, indholdskvalitetsscorer og hyppighed af politikovertrædelser. Implementér automatiserede varslingssystemer, der underretter relevante teams, når målinger bevæger sig uden for acceptable grænser, så hurtig undersøgelse og respons muliggøres. Skab feedback-sløjfer, der forbinder overvågningsdata med systemforbedringer, så teams kan finjustere AI-modeller og styringsprocesser på baggrund af faktisk ydeevne. Planlæg regelmæssige compliance-gennemgange, der vurderer, om overvågningssystemerne fortsat er effektive, og om styringspolitikker skal opdateres i forhold til nye risici eller lovændringer. Organisationer, der integrerer løbende overvågning i deres drift, opnår hurtigere problemløsning, lavere compliance-omkostninger og stærkere tillid fra interessenter.

Effektiv AI-indholdsstyring kræver koordineret indsats på tværs af flere organisatoriske funktioner, der hver især bidrager med væsentlig ekspertise og perspektiv i styringsbeslutninger. Jura- og compliance-teams sikrer, at politikker overholder lovkrav og håndterer eksterne relationer med myndigheder. Tekniske teams implementerer overvågningssystemer, vedligeholder revisionsspor og optimerer AI-systemets ydeevne inden for styringsrammerne. Indholds- og redaktionelle teams anvender styringspolitikker i praksis og træffer daglige beslutninger om indholdskvalitet og -egnethed. Risiko- og etik-teams vurderer nye trusler, identificerer potentielle skader og anbefaler politiske justeringer til at håndtere nye udfordringer. Direktionen stiller ressourcer til rådighed, sætter organisatoriske prioriteter og viser engagement i styringen gennem deres beslutninger og kommunikation. Organisationer, der samler disse funktioner omkring fælles styringsmål, opnår bedre resultater sammenlignet med dem, hvor styringen forbliver isoleret i enkelte afdelinger.

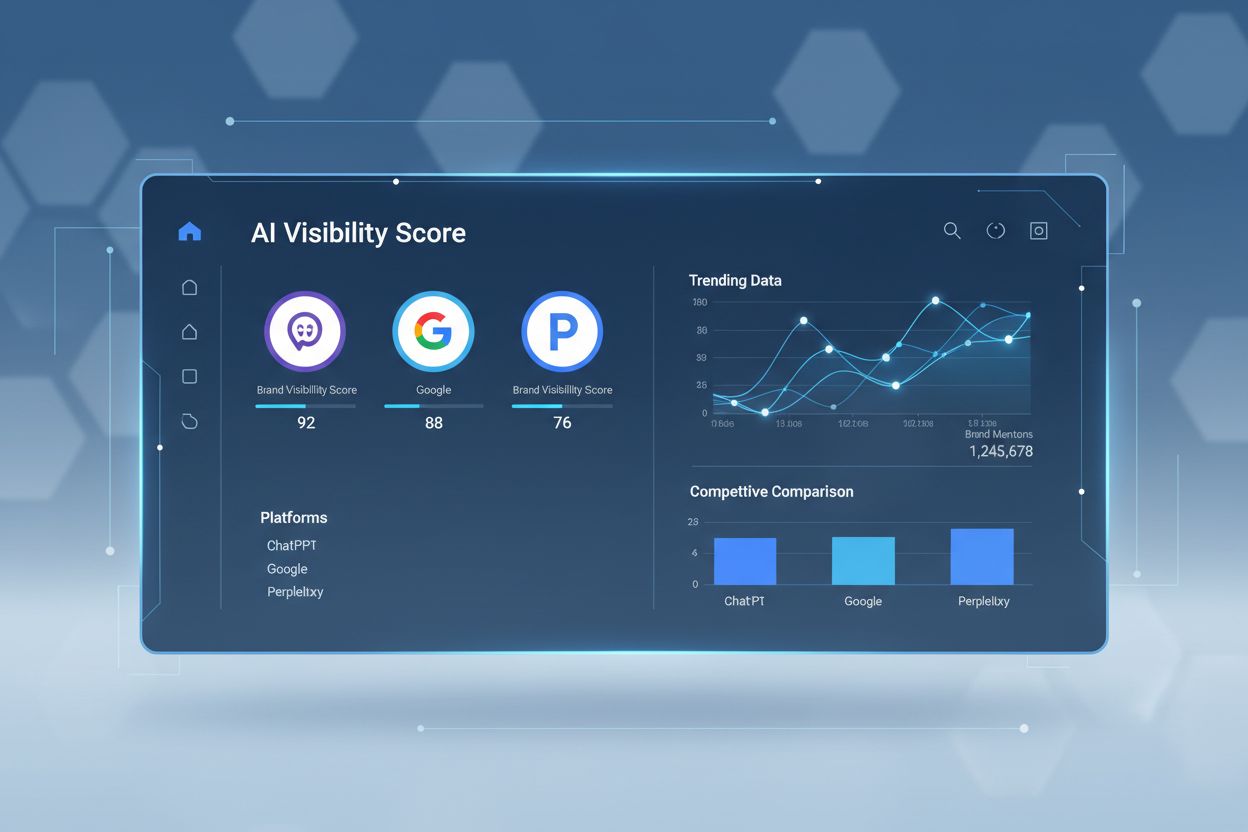

AmICited sporer, hvordan AI-systemer og LLM'er citerer dit indhold på tværs af GPTs, Perplexity og Google AI Overviews. Få indsigt i din AI-tilstedeværelse og beskyt dit brands omdømme.

Lær hvordan du strategisk allokerer dit AI-synlighedsbudget på tværs af overvågningsværktøjer, indholdsoptimering, teamressourcer og konkurrentanalyse for at ma...

Lær hvordan du strategisk syndikerer indhold for at øge synligheden i AI-drevne søgeresultater og blive citeret af ChatGPT, Perplexity og Google AI Overviews....

Bliv ekspert i Semrush AI Visibility Toolkit med vores omfattende guide. Lær at overvåge brandets synlighed i AI-søgning, analysere konkurrenter og optimere til...

Cookie Samtykke

Vi bruger cookies til at forbedre din browsingoplevelse og analysere vores trafik. See our privacy policy.