KI-Inhalts-Governance

Erfahren Sie mehr über KI-Inhalts-Governance – die Richtlinien, Prozesse und Rahmenwerke, die Organisationen verwenden, um ihre Content-Strategie über KI-Plattf...

Erfahren Sie, wie Sie effektive KI-Content-Governance-Richtlinien mit Sichtbarkeitsrahmen umsetzen. Entdecken Sie regulatorische Anforderungen, Best Practices und Tools für ein verantwortungsvolles Management von KI-Systemen.

KI-Sichtbarkeit bezeichnet die umfassende Fähigkeit, zu beobachten, nachzuverfolgen und zu verstehen, wie künstliche Intelligenzsysteme innerhalb Ihres Content-Ökosystems arbeiten. In der Content-Governance bildet Sichtbarkeit die grundlegende Ebene, die es Organisationen ermöglicht, Kontrolle zu behalten, Regelkonformität sicherzustellen und Risiken im Zusammenhang mit KI-generierten und KI-verarbeiteten Inhalten zu minimieren. Ohne klare Sichtbarkeit von KI-Systemen agieren Organisationen blind – unfähig, Verzerrungen zu erkennen, regulatorische Anforderungen einzuhalten oder auf neue Bedrohungen zu reagieren. Governance mit Sichtbarkeitsfokus wandelt reaktives Krisenmanagement in proaktive Risikoprävention um und erlaubt Teams, fundierte Entscheidungen über die Qualität, Authentizität und Übereinstimmung von Inhalten mit den Werten der Organisation zu treffen.

Die meisten Organisationen stehen vor einer entscheidenden Governance-Lücke zwischen ihrer Geschwindigkeit bei der Einführung von KI und ihrer Fähigkeit, diese Systeme wirksam zu steuern. Studien zeigen, dass 63 % der Organisationen keine formalen KI-Governance-Programme haben und damit anfällig für Regelverstöße, Reputationsschäden und operative Ausfälle sind. Diese Lücke vergrößert sich, je ausgefeilter und stärker in die Kernprozesse eingebettet KI-Systeme werden, wodurch Sichtbarkeit ohne gezielte Rahmenwerke und Tools zunehmend schwer zu erreichen ist. Die Folgen gehen über regulatorische Strafen hinaus – Organisationen ohne Sichtbarkeit kämpfen damit, die Qualität von Inhalten zu sichern, schädliche Ergebnisse zu erkennen und Rechenschaft gegenüber Stakeholdern abzulegen. Um diese Lücke zu schließen, ist gezielte Investition in Sichtbarkeitsmechanismen nötig, die Echtzeiteinblicke in das Verhalten von KI-Systemen und die Auswirkungen auf Inhalte liefern.

| Aspekt | Reaktive Governance | Proaktive Governance |

|---|---|---|

| Entdeckung | Probleme werden erst nach öffentlicher Bekanntmachung erkannt | Kontinuierliche Überwachung erkennt Probleme frühzeitig |

| Reaktion | Krisenmanagement und Schadensbegrenzung | Präventives Handeln und Risikominderung |

| Compliance | Korrekturen und Strafen nach Audits | Laufende Überprüfung der Regelkonformität |

| Risiko | Hohes Risiko durch unbekannte Bedrohungen | Systematische Risikoerkennung und -management |

Wirksame KI-Content-Governance-Richtlinien basieren auf sechs grundlegenden Prinzipien, die Entscheidungen und operative Maßnahmen in Ihrer Organisation leiten. Diese Prinzipien schaffen ein kohärentes Rahmenwerk, das Innovation und Verantwortung in Einklang bringt und sicherstellt, dass KI-Systeme die Ziele der Organisation unterstützen und gleichzeitig Stakeholder schützen. Durch die Verankerung dieser Prinzipien in Richtlinien werden klare Erwartungen an das Verhalten von KI-Systemen und deren Management durch Teams geschaffen. Die Prinzipien wirken synergetisch – Transparenz ermöglicht Verantwortlichkeit, menschliche Aufsicht sorgt für Fairness und Datenschutz schafft Vertrauen. Organisationen, die diese Prinzipien konsequent umsetzen, sind bei Regelkonformität, Stakeholder-Vertrauen und nachhaltiger Entwicklung ihren Mitbewerbern voraus.

Das regulatorische Umfeld für KI-Governance hat sich rasant entwickelt; inzwischen setzen verschiedene Rahmenwerke verbindliche Anforderungen für Organisationen, die KI-Systeme einsetzen. Der EU AI Act stellt den umfassendsten regulatorischen Ansatz dar, klassifiziert KI-Systeme nach Risikograd und legt strenge Vorgaben für Hochrisiko-Anwendungen wie Inhaltsmoderation und -generierung fest. Das NIST AI Risk Management Framework bietet einen flexiblen, nicht vorschreibenden Ansatz, der Organisationen hilft, KI-Risiken zu erkennen, zu messen und zu steuern. ISO 42001 definiert internationale Standards für das Management von KI-Systemen und bietet eine strukturierte Methodik zur Umsetzung von Governance unternehmensweit. Zudem schaffen Executive Orders in den USA und neue Regelungen auf Landesebene ein Flickwerk an Anforderungen, das Organisationen navigieren müssen. Diese Rahmenwerke vereinen gemeinsame Themen: Transparenz, Verantwortlichkeit, menschliche Aufsicht und kontinuierliche Überwachung – und machen Sichtbarkeit zum entscheidenden Ermöglicher regulatorischer Compliance.

Der Aufbau eines tragfähigen Rahmenwerks für Richtlinien erfordert eine systematische Bewertung Ihrer aktuellen KI-Systeme, Content-Flows und Risikolandschaft. Beginnen Sie mit einer umfassenden KI-Inventur, die jedes System dokumentiert, das Inhalte erzeugt, verarbeitet oder verbreitet – einschließlich seiner Zweckbestimmung, Datenquellen und möglicher Auswirkungen auf Stakeholder. Richten Sie anschließend Governance-Stufen ein, die je nach Risiko unterschiedliche Überwachungsniveaus festlegen – Hochrisiko-Systeme wie Inhaltsmoderation erfordern intensive Kontrolle, während Anwendungen mit geringerem Risiko eine weniger strenge Governance benötigen. Entwickeln Sie klare Richtlinien, die den Betrieb jedes Systems, zulässige Ergebnisse und Reaktionswege bei Problemen definieren. Schaffen Sie Verantwortlichkeitsstrukturen, die Zuständigkeiten für die Einhaltung der Richtlinien zuweisen und Eskalationsverfahren für Governance-Probleme festlegen. Implementieren Sie schließlich Messmechanismen, die die Einhaltung der Richtlinien überwachen und Daten für die kontinuierliche Verbesserung Ihrer Governance liefern.

Um KI-Sichtbarkeit zu erreichen, sind spezialisierte Tools und Bewertungsmechanismen erforderlich, die Echtzeiteinblicke in Systemverhalten und Content-Ergebnisse ermöglichen. Überwachungs-Dashboards bündeln Daten aus KI-Systemen, Content-Plattformen und Compliance-Systemen in einheitlichen Ansichten, die eine schnelle Problemidentifikation ermöglichen. Prüfpfade zeichnen detailliert KI-Entscheidungen, Inhaltsänderungen und Governance-Aktionen auf, schaffen Verantwortlichkeit und unterstützen regulatorische Untersuchungen. Bewertungsrahmen prüfen systematisch KI-Systeme anhand von Governance-Prinzipien, erkennen Lücken und Verbesserungsmöglichkeiten, bevor Probleme eskalieren. Automatisierte Erkennungssysteme kennzeichnen potenziell problematische Inhalte, verzerrte Ergebnisse oder Richtlinienverstöße und verringern die Abhängigkeit von manueller Prüfung bei gleichzeitig steigender Konsistenz. Organisationen, die umfassend in Sichtbarkeitstools investieren, gewinnen Vorteile in regulatorischer Compliance, Stakeholder-Vertrauen und operativer Effizienz.

Kontinuierliche Überwachung macht Governance zu einer fortlaufenden betrieblichen Disziplin, die Probleme in Echtzeit erkennt und adressiert – statt sie auf periodische Prüfungen zu beschränken. Legen Sie Überwachungsprotokolle fest, die die wichtigsten Metriken für jedes KI-System definieren – Genauigkeitsraten, Bias-Indikatoren, Qualitätskennzahlen für Inhalte und die Häufigkeit von Richtlinienverstößen. Implementieren Sie automatisierte Benachrichtigungssysteme, die relevante Teams alarmieren, wenn Metriken außerhalb akzeptabler Bereiche liegen, und so eine schnelle Untersuchung und Reaktion ermöglichen. Richten Sie Feedbackschleifen ein, die Überwachungsdaten zur Systemverbesserung nutzen, damit Teams KI-Modelle und Governance-Prozesse auf Basis der beobachteten Leistung optimieren können. Planen Sie regelmäßige Compliance-Reviews ein, um zu bewerten, ob die Überwachungssysteme wirksam bleiben und ob Governance-Richtlinien angesichts neuer Risiken oder regulatorischer Änderungen aktualisiert werden müssen. Organisationen, die kontinuierliche Überwachung in ihre Abläufe integrieren, lösen Probleme schneller, senken Compliance-Kosten und stärken das Vertrauen der Stakeholder.

Wirksame KI-Content-Governance erfordert abgestimmte Zusammenarbeit mehrerer Organisationseinheiten, die jeweils essenzielle Expertise und Perspektiven in Governance-Entscheidungen einbringen. Rechts- und Compliance-Teams sorgen dafür, dass Richtlinien regulatorischen Vorgaben entsprechen und pflegen externe Beziehungen zu Aufsichtsbehörden. Technische Teams implementieren Überwachungssysteme, pflegen Prüfpfade und optimieren die Leistung von KI-Systemen innerhalb der Governance-Vorgaben. Content- und Redaktionsteams setzen Governance-Richtlinien praktisch um und treffen tägliche Entscheidungen über die Qualität und Angemessenheit von Inhalten. Risiko- und Ethik-Teams bewerten neue Bedrohungen, identifizieren potenzielle Schäden und empfehlen Anpassungen der Richtlinien zur Bewältigung neuer Herausforderungen. Das Top-Management stellt Ressourcen bereit, setzt Prioritäten und zeigt durch Entscheidungen und Kommunikation Engagement für Governance. Organisationen, die diese Funktionen auf gemeinsame Governance-Ziele ausrichten, erzielen bessere Ergebnisse als solche, bei denen Governance in einzelnen Abteilungen isoliert bleibt.

KI-Content-Governance ist die Gesamtheit von Richtlinien, Prozessen und Kontrollen, die sicherstellen, dass durch KI generierte und verarbeitete Inhalte vertrauenswürdig, regelkonform und mit den Werten der Organisation im Einklang bleiben. Sie umfasst alles von der Inhaltserstellung und -validierung bis hin zu Überwachung und Reaktion auf Vorfälle.

Sichtbarkeit ermöglicht es Organisationen zu verstehen, wo KI-Systeme eingesetzt werden, wie sie arbeiten und welche Risiken sie verursachen. Ohne Sichtbarkeit wird Governance reaktiv und ineffektiv. Sichtbarkeit wandelt Governance von Krisenmanagement in proaktive Risikoprävention um.

Zu den wichtigsten Rahmenwerken gehören der EU AI Act (rechtlich verbindliche risikobasierte Klassifizierung), das NIST AI Risk Management Framework (flexible Leitlinien), ISO 42001 (internationale Standards) sowie verschiedene Executive Orders und Landesregelungen. Jedes Rahmenwerk betont Transparenz, Verantwortlichkeit und menschliche Aufsicht.

Nutzen Sie strukturierte Bewertungsrahmen, die sich an anerkannten Standards wie NIST AI RMF oder ISO 42001 orientieren. Bewerten Sie vorhandene Kontrollen im Vergleich zu den Anforderungen des Rahmenwerks, identifizieren Sie Lücken und legen Sie Zielreifegrade fest. Regelmäßige Bewertungen liefern Einblicke in systemische Schwächen und Verbesserungspotenziale.

Wirksame Richtlinien sollten zulässige Anwendungsfälle, Regeln zur Datenbeschaffung, Dokumentationsanforderungen, Verfahren zur menschlichen Aufsicht, Überwachungsmechanismen und Eskalationsverfahren abdecken. Richtlinien müssen durch Tools und Workflows umgesetzt werden, die Teams tatsächlich in ihrer täglichen Arbeit nutzen.

Governance sollte kontinuierlich überwacht und mit regelmäßigen formellen Überprüfungen mindestens vierteljährlich bewertet werden. Echtzeitüberwachung erkennt Probleme sofort, während periodische Überprüfungen beurteilen, ob die Governance-Rahmenwerke wirksam bleiben und ob Richtlinien angesichts neuer Risiken oder regulatorischer Änderungen aktualisiert werden müssen.

Wirksame Tools umfassen Überwachungs-Dashboards für Echtzeitmetriken, Prüfpfade für Verantwortlichkeit, Bewertungsrahmen für die Kontrollevaluation, automatisierte Systeme zur Erkennung von Richtlinienverstößen und Plattformen zur Risikobewertung. Diese Tools sollten sich in Ihre gesamte Technologielandschaft integrieren.

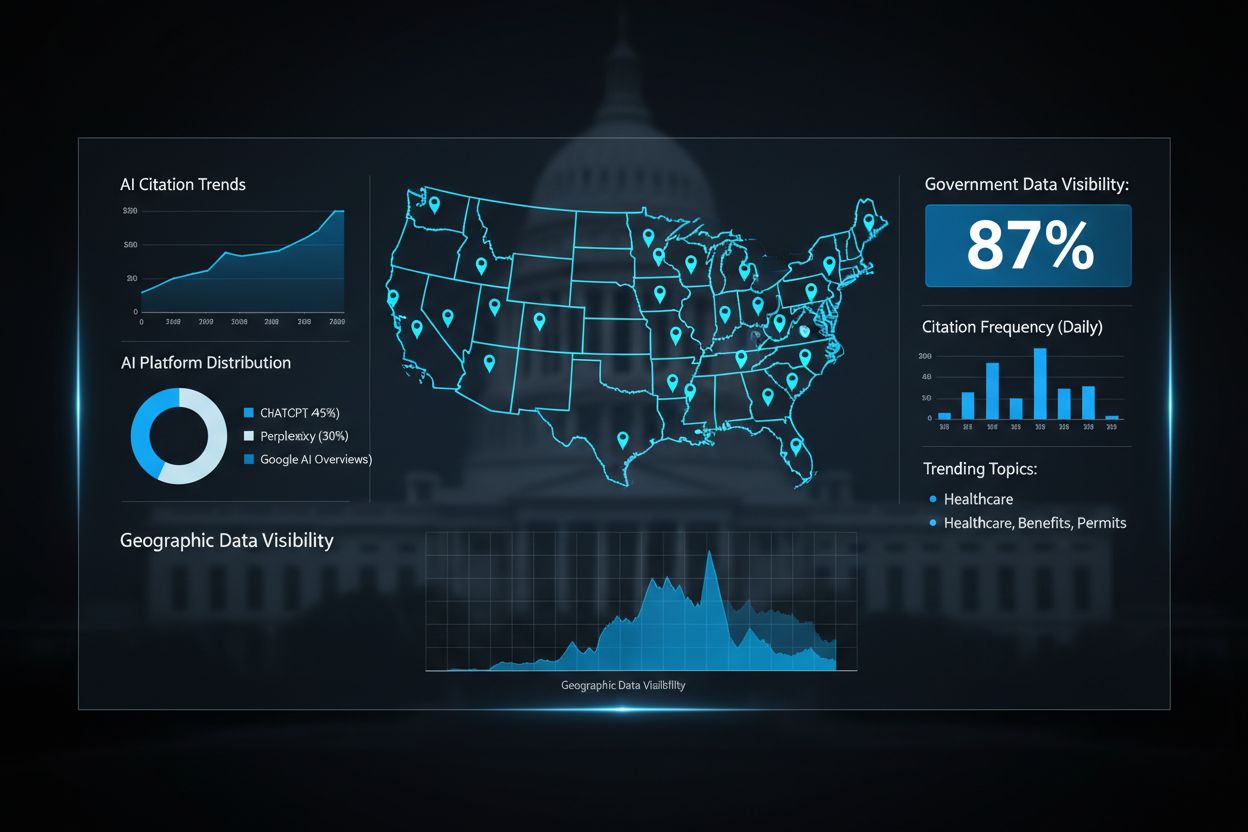

AmICited überwacht, wie KI-Systeme und LLMs Ihre Marke in GPTs, Perplexity und Google AI Overviews referenzieren. Dies schafft Transparenz über Ihre KI-Präsenz, hilft Ihnen zu verstehen, wie Ihre Inhalte von KI-Systemen genutzt werden, und ermöglicht es Ihnen, den Ruf Ihrer Marke im KI-gesteuerten Content-Ökosystem zu schützen.

AmICited verfolgt, wie KI-Systeme und LLMs Ihre Inhalte in GPTs, Perplexity und Google AI Overviews zitieren. Erhalten Sie Einblick in Ihre KI-Präsenz und schützen Sie den Ruf Ihrer Marke.

Erfahren Sie mehr über KI-Inhalts-Governance – die Richtlinien, Prozesse und Rahmenwerke, die Organisationen verwenden, um ihre Content-Strategie über KI-Plattf...

Erfahren Sie, wie Behörden ihre digitale Präsenz für KI-Systeme wie ChatGPT und Perplexity optimieren können. Entdecken Sie Strategien zur Verbesserung der KI-S...

Erlernen Sie die vollständige Schritt-für-Schritt-Methodik zur Durchführung eines KI-Sichtbarkeits-Audits. Entdecken Sie, wie Sie Marken-Nennungen, Zitationen u...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.