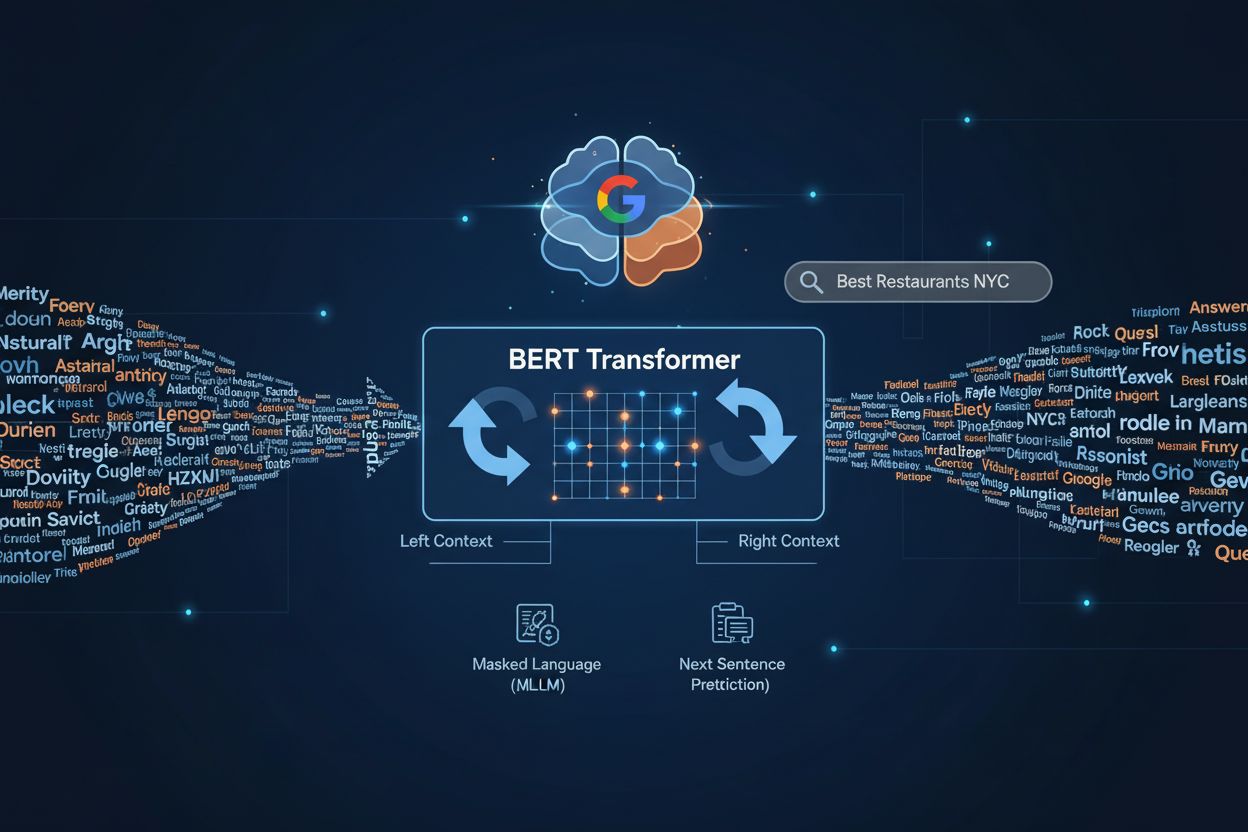

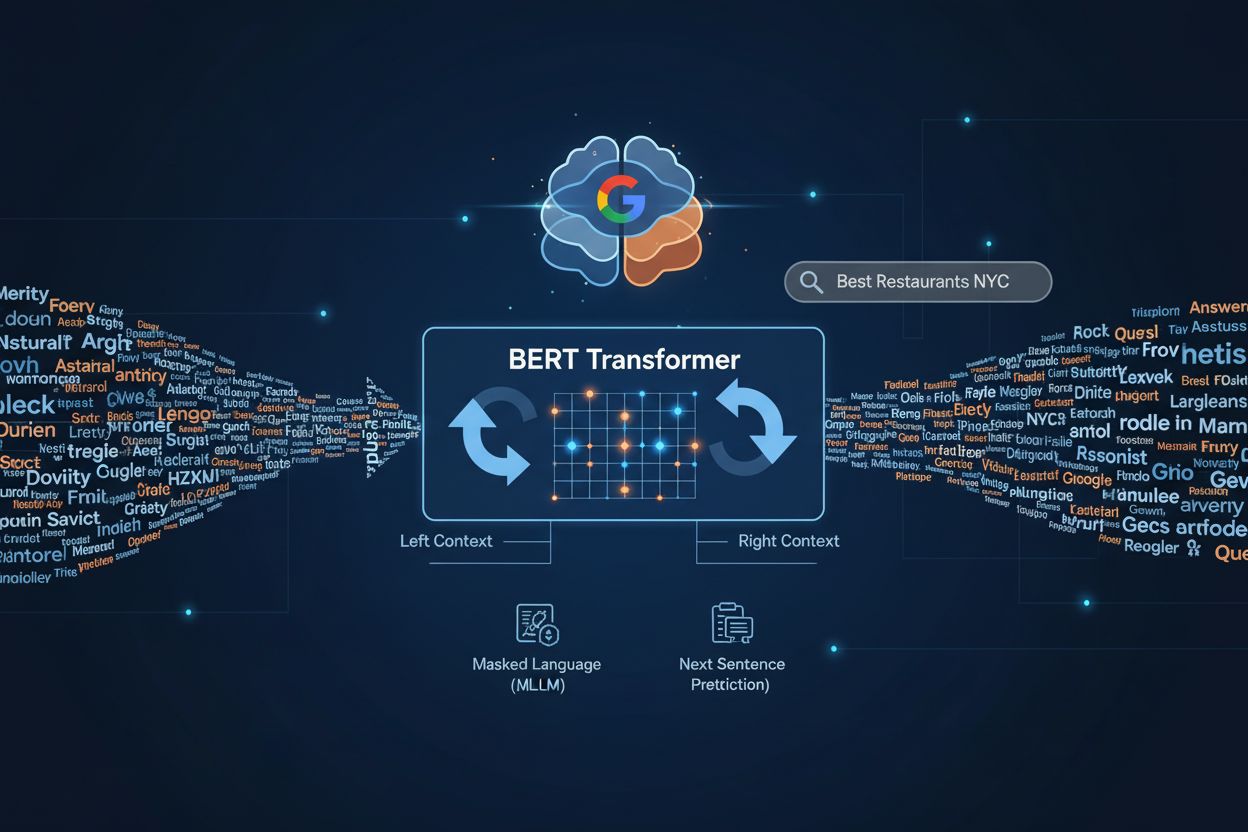

Actualización BERT

Descubre la Actualización BERT de Google, un cambio importante del algoritmo en 2019 que utiliza transformadores bidireccionales para mejorar la comprensión del...

Sigo leyendo información contradictoria sobre BERT.

En 2019, BERT era LO que había que entender para SEO. Procesamiento de lenguaje natural, comprensión de contexto, etc.

Ahora todos hablan de GPT-4, Claude, Gemini, y estoy confundido.

Mis preguntas:

Intento separar el ruido y entender qué importa de verdad para la optimización de contenidos ahora.

Déjame aclarar el panorama técnico.

El árbol genealógico de los modelos:

Transformer (2017)

├── BERT-style (encoders - understand text)

│ ├── BERT (Google, 2018)

│ ├── RoBERTa (Meta)

│ ├── MUM (Google, 2021)

│ └── Many others

└── GPT-style (decoders - generate text)

├── GPT series (OpenAI)

├── Claude (Anthropic)

├── Gemini (Google)

└── Many others

BERT sigue siendo relevante, pero:

Lo que realmente importa:

| Tipo de búsqueda | Modelo principal | Tu enfoque |

|---|---|---|

| Google tradicional | BERT/MUM (encoders) | Coincidencia consulta-contenido, intención |

| AI Overviews | Híbrido | Respuestas extraíbles |

| ChatGPT/Perplexity | GPT-style (decoders) | Contenido completo, citable |

La conclusión práctica:

“Optimizar para BERT” siempre fue escribir contenido natural y rico en contexto. Eso no ha cambiado. Los nombres de los modelos específicos no importan para tu estrategia de optimización.

Exactamente. “Optimizar para BERT” era una forma abreviada de decir:

Todo esto sigue vigente. Estás optimizando para cómo los modelos modernos de lenguaje entienden el texto, no para un modelo específico.

Los principios que funcionan en todos los modelos:

Estos ayudan a que BERT entienda tu contenido para el ranking Y ayudan a los modelos tipo GPT a extraerlo para citas.

Perspectiva SEO sobre la evolución de BERT.

La era BERT (2019-2021):

Era MUM/IA (2021-presente):

Lo que cambió en la práctica:

¿La verdad? Poco para la estrategia de contenidos.

El consejo siempre fue:

Esto funcionó para BERT. Funciona para MUM. Funciona para GPT.

Lo NUEVO:

La capa de citación/extracción. Los modelos tipo GPT necesitan extraer y citar tu contenido, no solo emparejarlo con consultas.

Esto requiere:

Pero la base de lenguaje natural es la misma.

Perspectiva de estrategia de contenidos.

Cómo lo explico a los clientes:

“BERT era para que Google entienda lo que quieres decir. GPT es para que la IA use lo que escribiste.”

La diferencia práctica:

Para búsqueda tradicional (comprensión BERT/MUM):

Para respuestas de IA (extracción GPT):

El punto de encuentro:

Ambos premian:

Mi recomendación:

No pienses en “optimizar para BERT vs GPT”. Piensa: “¿Cómo creo contenido que los modelos de lenguaje puedan entender (BERT) Y extraer/citar (GPT)?”

La respuesta es la misma: contenido claro, natural, bien estructurado y experto.

Perspectiva de investigación sobre la evolución.

Dónde encaja BERT ahora:

BERT fue fundamental: enseñó a la industria que la comprensión de contexto bidireccional funciona. Google no ha “reemplazado” BERT; lo ha evolucionado.

La evolución:

Para la Búsqueda de Google en concreto:

Google usa múltiples modelos en su pila de ranking:

¿Qué significa esto para ti?:

El modelo específico no importa para tu estrategia. Lo que importa es que todos estos modelos:

Optimiza para estos principios, no para nombres de modelos.

Perspectiva de redacción técnica.

Qué cambió en mi escritura desde la era BERT a la era IA:

Enfoque era BERT:

Añadido para la era IA:

Lo que se mantuvo igual:

Mi flujo de trabajo práctico:

Los principios de BERT son la base. La optimización IA es la capa de mejora.

Perspectiva práctica de consultor.

Lo que les digo a los clientes sobre BERT:

“No te preocupes por BERT en específico. Concéntrate en estos principios que comparten todos los sistemas de búsqueda modernos…”

Los principios atemporales:

Qué cambió para IA:

Mayor énfasis en:

En resumen:

“La optimización BERT” era una forma de decir “escribe de forma natural y responde preguntas”. Eso sigue vigente. Ahora solo añades optimización para extracción IA encima.

Perspectiva de datos sobre los cambios relacionados con BERT.

Seguimiento del rendimiento de contenido a través de eras:

Rastreamos 1,000 piezas de contenido de 2019-2025:

Era BERT (2019-2021):

Era MUM/IA (2021-2025):

El patrón:

La redacción en lenguaje natural (el principio BERT) sigue siendo fundamental. Pero la estructura para extracción IA da impulso adicional.

Implicación práctica:

No abandones los principios BERT. Súmale estructura amigable para IA.

Qué usamos:

Am I Cited para rastrear qué formatos de contenido son más citados por IA. Ayuda a identificar qué estructura funciona más allá del lenguaje natural.

Esto aclaró mi confusión. Resumen:

¿Sigue siendo relevante BERT?

Sí, pero como fundamento, no como objetivo específico de optimización. Los principios que representaba BERT (lenguaje natural, contexto, intención) siguen siendo cruciales.

Qué ha cambiado:

Lo que estoy haciendo:

El modelo mental:

BERT = Fundamento (comprensión) GPT = Capa encima (extracción y citación)

Ambos premian las mismas cualidades centrales. La IA solo añade requisitos de estructura.

Gracias a todos, ahora está mucho más claro.

Get personalized help from our team. We'll respond within 24 hours.

Haz seguimiento de cómo los sistemas de IA entienden y citan tu contenido. Descubre qué formatos de contenido rinden mejor entre diferentes modelos de lenguaje.

Descubre la Actualización BERT de Google, un cambio importante del algoritmo en 2019 que utiliza transformadores bidireccionales para mejorar la comprensión del...

Discusión de la comunidad sobre cómo funcionan los motores de búsqueda de IA. Experiencias reales de marketers entendiendo LLMs, RAG y búsqueda semántica compar...

Discusión comunitaria sobre cómo la IA está transformando el SEO. Marketers comparten experiencias adaptándose a los resúmenes de IA, motores de respuesta y el ...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.