Comment les études de cas performent dans les résultats de recherche IA

Découvrez comment les études de cas se classent dans les moteurs de recherche IA comme ChatGPT, Perplexity et Google AI Overviews. Comprenez pourquoi les systèm...

Découvrez comment formater des études de cas pour les citations IA. Découvrez le plan de structuration des success stories que les LLM citent dans AI Overviews, ChatGPT et Perplexity.

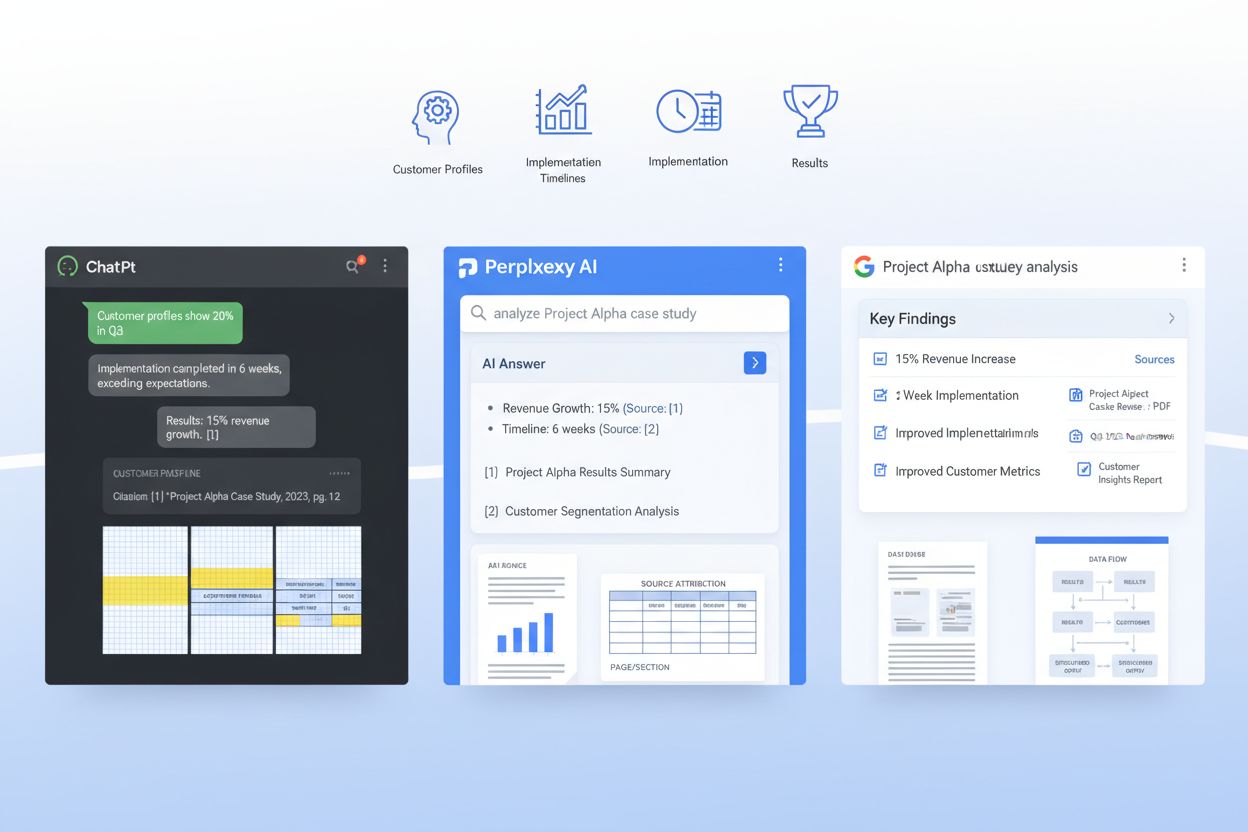

Les systèmes IA comme ChatGPT, Perplexity et les AI Overviews de Google transforment fondamentalement la façon dont les acheteurs B2B découvrent et valident des études de cas—pourtant, la plupart des entreprises les publient encore dans des formats que les LLM peinent à analyser. Lorsqu’un acheteur d’entreprise demande à un système IA « Quelles plateformes SaaS sont les mieux adaptées à notre cas d’usage ? », le système parcourt des millions de documents pour trouver des preuves pertinentes, mais des études de cas mal formatées restent invisibles à ces systèmes de récupération. Cela crée un écart critique : alors que les études de cas traditionnelles génèrent un taux de victoire de 21 % en phase finale de vente, les études de cas optimisées pour l’IA peuvent augmenter la probabilité de citation de 28 à 40 % lorsqu’elles sont correctement structurées pour les modèles d’apprentissage automatique. Les entreprises qui gagnent dans ce nouveau paysage comprennent que l’avantage des données propriétaires vient du fait d’être découvert par les systèmes IA, pas seulement par des lecteurs humains. Sans optimisation intentionnelle pour la récupération par LLM, vos plus belles success stories clients restent en réalité inaccessibles aux systèmes IA qui influencent aujourd’hui plus de 60 % des décisions d’achat en entreprise.

Une étude de cas prête pour l’IA n’est pas seulement un récit bien écrit—c’est un document stratégiquement structuré qui sert à la fois les lecteurs humains et les modèles d’apprentissage automatique. Les études de cas les plus efficaces suivent une architecture cohérente qui permet aux LLM d’extraire les informations clés, de comprendre le contexte et de citer votre entreprise avec assurance. Voici le plan essentiel qui distingue les études de cas détectables par l’IA de celles qui se perdent dans les systèmes de récupération :

| Section | Objectif | Optimisation IA |

|---|---|---|

| Résumé TL;DR | Contexte immédiat pour les lecteurs pressés | Placé en haut pour une consommation précoce des tokens ; 50-75 mots |

| Profil client | Identification rapide du profil de l’entreprise | Structuré ainsi : Secteur / Taille / Localisation / Fonction |

| Contexte métier | Définition du problème et situation de marché | Utiliser une terminologie cohérente ; éviter la variation du jargon |

| Objectifs | Objectifs spécifiques et mesurables du client | Formater en liste numérotée ; inclure des cibles chiffrées |

| Solution | Comment votre produit/service a répondu au besoin | Expliquer explicitement la correspondance fonctionnalités-bénéfices |

| Mise en œuvre | Détails du calendrier, du processus et de l’adoption | Découper en phases ; inclure durée et jalons |

| Résultats | Résultats quantifiés et indicateurs d’impact | Présenter ainsi : Indicateur / Référence / Final / Amélioration % |

| Preuves | Données, captures d’écran ou validation tierce | Inclure des tableaux pour les métriques ; citer clairement les sources |

| Citations clients | Voix authentique et validation émotionnelle | Attribuer avec nom, poste, entreprise ; 1-2 phrases chacune |

| Rebond interne | Liens internes et suggestions de ressources | Suggérer des études de cas, webinaires ou ressources associés |

Cette structure garantit que chaque section remplit une double fonction : lecture naturelle pour les humains et clarté sémantique pour les systèmes RAG (Retrieval-Augmented Generation) des LLM modernes. La cohérence de ce format à travers votre bibliothèque d’études de cas facilite exponentiellement l’extraction de points de comparaison et la citation de votre entreprise par les systèmes IA.

Au-delà de la structure, le choix précis du formatage impacte fortement la capacité des systèmes IA à trouver et citer vos études de cas. Les LLM traitent les documents différemment des humains—ils ne survolent pas et n’utilisent pas la hiérarchie visuelle comme les lecteurs, mais ils sont très sensibles aux marqueurs sémantiques et aux motifs de formatage cohérents. Voici les éléments qui boostent le plus la récupération IA :

Ces choix de formatage ne relèvent pas de l’esthétique—ils visent à rendre votre étude de cas lisible par machine pour que, lorsqu’un LLM cherche des preuves, ce soit votre entreprise qui soit citée.

L’approche la plus avancée pour des études de cas prêtes pour l’IA consiste à intégrer un schéma JSON directement dans votre document ou la couche de métadonnées, créant ainsi une double lecture : narration pour l’humain, structuration pour la machine. Les schémas JSON offrent aux LLM une représentation non ambiguë et lisible par machine des informations clés de votre étude de cas, améliorant considérablement la précision et la pertinence des citations. Voici un exemple de structure :

{

"@context": "https://schema.org",

"@type": "CaseStudy",

"name": "Une plateforme SaaS d'entreprise réduit le temps d'intégration de 60 %",

"customer": {

"name": "TechCorp Industries",

"industry": "Services financiers",

"companySize": "500-1000 employés",

"location": "San Francisco, CA"

},

"solution": {

"productName": "Nom de votre produit",

"category": "Automatisation des workflows",

"implementationDuration": "8 semaines"

},

"results": {

"metrics": [

{"name": "Réduction du temps d'intégration", "baseline": "120 jours", "final": "48 jours", "improvement": "60%"},

{"name": "Taux d'adoption utilisateur", "baseline": "45%", "final": "89%", "improvement": "97%"},

{"name": "Réduction des tickets support", "baseline": "450/mois", "final": "120/mois", "improvement": "73%"}

]

},

"datePublished": "2024-01-15",

"author": {"@type": "Organization", "name": "Votre entreprise"}

}

En mettant en œuvre des structures JSON conformes à schema.org, vous fournissez aux LLM un moyen standardisé de comprendre et citer votre étude de cas. Cette approche s’intègre parfaitement aux systèmes RAG, permettant aux IA d’extraire des métriques précises, de comprendre le contexte client et d’attribuer correctement les citations à votre entreprise. Les entreprises utilisant des études de cas structurées en JSON constatent une précision de citation 3 à 4 fois supérieure dans les réponses générées par IA par rapport aux formats purement narratifs.

Les systèmes RAG ne traitent pas votre étude de cas comme un bloc monolithique—ils la segmentent en morceaux sémantiques adaptés à la fenêtre de contexte des LLM, et la façon dont vous structurez votre document détermine si ces segments sont utiles ou fragmentés. Une segmentation efficace consiste à organiser l’étude de cas pour que les frontières sémantiques naturelles coïncident avec la découpe des systèmes RAG. Cela suppose une taille de paragraphe réfléchie : chaque paragraphe doit se concentrer sur une idée ou une donnée unique, typiquement 100-150 mots, pour que, lorsqu’un système RAG extrait un segment, il contienne une information complète et cohérente, et non des phrases isolées. La séparation narrative est cruciale—utilisez des ruptures claires entre la problématique, la description de la solution et les résultats afin qu’un LLM puisse extraire « la section résultats » comme un tout sans la mélanger par erreur avec les détails d’implémentation. De plus, l’efficacité des tokens est essentielle : en utilisant des tableaux pour les indicateurs au lieu du texte, vous réduisez le nombre de tokens nécessaires pour transmettre une information, ce qui permet aux LLM d’inclure plus de contenu dans leur réponse sans dépasser la limite de contexte. L’objectif est de rendre votre étude de cas « RAG-friendly », pour que chaque segment extrait par l’IA soit autonome et bien contextualisé.

Publier des études de cas pour les systèmes IA exige de trouver l’équilibre entre la spécificité qui fait leur crédibilité et la confidentialité due à vos clients. Beaucoup d’entreprises hésitent à publier des études détaillées de peur d’exposer des informations sensibles, mais une anonymisation et une rédaction stratégiques permettent de concilier transparence et confiance. L’approche la plus efficace consiste à créer plusieurs versions de chaque étude de cas : une version interne complète avec noms de clients, chiffres exacts et détails propriétaires, et une version publique optimisée IA qui anonymise le client tout en conservant l’impact quantifié et les enseignements stratégiques. Par exemple, au lieu de « TechCorp Industries a économisé 2,3 M$ par an », publiez « Entreprise financière de taille moyenne a réduit ses coûts opérationnels de 34 % »—l’indicateur reste assez précis pour être cité par les LLM, mais l’identité du client est protégée. Le contrôle de version et la traçabilité conformité sont essentiels : tenez un registre clair de ce qui a été anonymisé, pourquoi et quand, pour garder votre bibliothèque d’études de cas prête pour un audit. Cette gouvernance renforce votre stratégie de citation IA car elle permet de publier plus souvent sans friction juridique, offrant aux LLM plus de points de preuve à découvrir et à citer.

Avant de publier une étude de cas, validez qu’elle fonctionne réellement lorsqu’elle est traitée par des LLM et des systèmes RAG—ne supposez pas qu’un bon formatage suffit pour de bonnes performances IA. Tester vos études de cas sur de vrais systèmes IA permet de vérifier si votre structure, vos métadonnées et votre contenu permettent effectivement une citation et une récupération précises. Voici cinq approches de test essentielles :

Vérification de la pertinence : Envoyez votre étude de cas à ChatGPT, Perplexity ou Claude avec des requêtes sur votre catégorie de solution. L’IA retrouve-t-elle et cite-t-elle votre étude de cas pour des questions pertinentes ?

Précision du résumé : Demandez à un LLM de résumer votre étude de cas et vérifiez que le résumé reprend bien les métriques clés, le contexte client et l’impact business sans altération ni hallucination.

Extraction d’indicateurs : Testez la capacité du système IA à extraire précisément des chiffres précis (ex. « Quelle était l’amélioration du time-to-value ? »). Les tableaux doivent donner plus de 96 % d’exactitude ; testez séparément le texte.

Fidélité d’attribution : Vérifiez que, lorsqu’un LLM cite votre étude de cas, il attribue correctement l’information à votre entreprise et client, et non à un concurrent ou une source générique.

Tests de cas limites : Testez avec des questions inhabituelles ou marginales pour vérifier que votre étude de cas n’est pas appliquée à tort à des cas non couverts.

Ces tests doivent être menés chaque trimestre à mesure que le comportement des LLM évolue, et les résultats doivent orienter les mises à jour du formatage et de la structure de vos études de cas.

Mesurer l’impact des études de cas optimisées pour l’IA suppose de suivre à la fois les métriques côté IA (fréquence de citation par les LLM) et côté humain (influence réelle sur les affaires). Pour l’IA, utilisez AmICited.com pour surveiller la fréquence des citations sur ChatGPT, Perplexity et Google AI Overviews—suivez la fréquence d’apparition de votre entreprise dans les réponses IA pertinentes et voyez si elle augmente après la publication de nouvelles études optimisées. Calculez votre taux de citation actuel et fixez-vous un objectif d’augmentation de 40 à 60 % sous six mois après la mise en forme IA. Côté humain, faites le lien entre la hausse des citations IA et les indicateurs commerciaux : suivez combien d’opportunités mentionnent « Je vous ai trouvé via une recherche IA » ou « une IA a recommandé votre étude de cas », mesurez l’augmentation du taux de victoire dans les affaires où votre étude a été citée par une IA (cible : +28 à 40 % par rapport à la base de 21 %) et surveillez la réduction du cycle de vente chez les prospects ayant découvert votre étude via l’IA. Surveillez aussi les métriques SEO—les études de cas optimisées avec un schéma propre se classent souvent mieux, générant un double bénéfice. Le retour qualitatif de vos commerciaux est tout aussi crucial : demandez-leur si les prospects arrivent mieux informés, et si les citations réduisent le temps de gestion des objections. Le KPI ultime est le revenu : suivez l’ARR incrémental attribuable aux affaires influencées par des études de cas citées par IA, et vous disposerez d’un ROI clair pour poursuivre l’investissement dans ce format.

L’optimisation des études de cas pour les citations IA ne génère du ROI que si le processus devient opérationnalisé et reproductible, et non un projet ponctuel. Commencez par codifier votre modèle d’étude de cas IA-ready dans un format standard utilisé par vos équipes marketing et commerciales pour chaque nouvelle success story—cela assure la cohérence de votre bibliothèque et réduit le temps de publication. Intégrez ce modèle à votre CMS pour que la publication d’une nouvelle étude génère automatiquement le schéma JSON, les en-têtes de métadonnées et les éléments de formatage sans effort manuel. Faites de la création d’études de cas un rituel trimestriel ou mensuel, plutôt qu’un événement annuel, car les LLM découvrent et citent plus souvent les entreprises ayant une bibliothèque récente et fournie. Positionnez les études de cas comme un pilier de votre stratégie de génération de revenu : elles doivent alimenter les supports de vente, le marketing produit, les campagnes de génération de demande et les playbooks customer success. Enfin, établissez un cycle d’amélioration continue : surveillez quelles études génèrent le plus de citations IA, quels indicateurs sont les plus repris par les LLM et quels segments clients sont les plus cités—puis utilisez ces insights pour concevoir la prochaine génération d’études de cas. Les entreprises gagnantes à l’ère de l’IA ne se contentent pas d’écrire de meilleures études de cas ; elles les considèrent comme de véritables actifs stratégiques de revenu nécessitant optimisation, mesure et évolution continue.

Commencez par extraire le texte de vos PDF et mappez le contenu existant sur un schéma standard avec des champs tels que profil client, défi, solution et résultats. Créez ensuite une version HTML légère ou CMS de chaque histoire avec des titres clairs et des métadonnées, en conservant le PDF original comme ressource téléchargeable plutôt que comme source principale pour la récupération par l'IA.

Le marketing ou le marketing produit possède généralement la narration, mais les équipes commerciales, ingénierie solutions et succès client doivent fournir les données brutes, les détails d'implémentation et la validation. Les équipes juridiques, confidentialité et RevOps veillent à la gouvernance, à l'anonymisation et à l'alignement avec les systèmes existants comme votre CRM et vos plateformes d'aide à la vente.

Un CMS headless ou une plateforme de contenu structuré est idéale pour stocker les schémas et métadonnées, tandis qu'un CRM ou un outil d'aide à la vente peut faire remonter les bonnes histoires dans le flux de travail. Pour la récupération par IA, on associe généralement une base de données vectorielle à une couche d'orchestration LLM comme LangChain ou LlamaIndex.

Transcrivez les témoignages vidéo et webinaires, puis étiquetez les transcriptions avec les mêmes champs et sections que vos études de cas écrites afin que l'IA puisse les citer. Pour les graphiques et schémas, ajoutez un court texte alternatif ou une légende décrivant l'information clé afin que les modèles de récupération puissent relier les éléments visuels aux questions spécifiques.

Gardez votre schéma de base et vos identifiants cohérents à l'échelle mondiale, puis créez des variantes traduites qui localisent la langue, la devise et le contexte réglementaire tout en préservant les indicateurs de référence. Stockez les versions spécifiques à chaque langue comme des objets séparés mais liés pour que les systèmes IA puissent prioriser les réponses dans la langue de l'utilisateur sans fragmenter votre modèle de données.

Passez en revue les études de cas à fort impact au moins une fois par an, ou plus tôt en cas de changements majeurs de produit, de nouveaux indicateurs ou d'évolution du contexte client. Utilisez un flux de travail de versioning simple avec des dates de dernière revue et des statuts pour indiquer aux systèmes IA et aux humains quelles histoires sont les plus à jour.

Intégrez la récupération des études de cas directement dans les outils déjà utilisés par les commerciaux et créez des guides concrets montrant comment demander à l'assistant des preuves pertinentes. Favorisez l'adoption en partageant des succès où des études de cas personnalisées, surfacées par l'IA, ont permis de conclure des ventes plus rapidement ou de convaincre de nouveaux décideurs.

Les études de cas traditionnelles sont écrites pour les lecteurs humains avec un récit fluide et une conception visuelle. Les études de cas optimisées pour l'IA conservent cette narration mais ajoutent des métadonnées structurées, un formatage cohérent, des schémas JSON et une clarté sémantique permettant aux LLM d'extraire, comprendre et citer des informations précises avec plus de 96 % d'exactitude.

Suivez comment les systèmes IA citent votre marque sur ChatGPT, Perplexity et Google AI Overviews. Obtenez des insights sur votre visibilité IA et optimisez votre stratégie de contenu.

Découvrez comment les études de cas se classent dans les moteurs de recherche IA comme ChatGPT, Perplexity et Google AI Overviews. Comprenez pourquoi les systèm...

Découvrez comment utiliser des statistiques et des données étayées pour améliorer la visibilité de votre marque dans les moteurs de recherche IA comme ChatGPT, ...

Découvrez pourquoi vos concurrents dominent les réponses générées par l'IA et apprenez des stratégies éprouvées pour accroître la visibilité de votre marque dan...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.