Choisir des plateformes communautaires pour un impact maximal de l'IA

Découvrez comment sélectionner les meilleures plateformes communautaires pour les professionnels de l'IA. Comparez les solutions phares, évaluez les fonctionnal...

Découvrez comment construire une culture organisationnelle prête pour l’IA, qui favorise l’adoption, permet la collaboration des équipes et crée un avantage concurrentiel durable grâce à la sécurité psychologique, la maîtrise des données et l’agilité.

Les organisations investissent des milliards dans l’intelligence artificielle, pourtant 74 % des entreprises peinent à obtenir une réelle valeur de leurs initiatives en IA. Ce fossé ne vient pas de la technologie, mais des personnes. Les recherches montrent de façon constante que 70 % des défis liés à l’implémentation de l’IA proviennent de questions humaines et de processus, bien plus que de limites techniques, révélant une vérité essentielle : même les algorithmes les plus sophistiqués échouent sans la bonne culture organisationnelle pour les soutenir. La culture est l’infrastructure invisible qui détermine si l’IA devient une force de transformation ou une expérimentation coûteuse prenant la poussière sur une étagère. Sans un socle fondé sur la confiance, la culture des données et l’agilité, même les solutions d’IA les plus avancées resteront à l’état de projets pilotes ou de preuves de concept, sans jamais libérer leur plein potentiel au sein de l’organisation.

Une culture prête pour l’IA repose sur trois piliers interdépendants qui forment ensemble un environnement propice à l’épanouissement de l’intelligence artificielle : Confiance, Culture des données, et Agilité. La confiance établit la sécurité psychologique où les collaborateurs se sentent autorisés à expérimenter de nouveaux outils et à exprimer leurs préoccupations sur la mise en œuvre. La culture des données garantit que les équipes comprennent comment interpréter, questionner et agir sur les informations issues des données. L’agilité permet aux organisations d’agir rapidement, d’itérer grâce aux retours et d’adapter leur stratégie d’IA à l’évolution des besoins métiers. Ces trois piliers ne sont pas indépendants – ils se renforcent mutuellement dans un cercle vertueux où la confiance favorise l’expérimentation, l’expérimentation renforce la culture des données, et la culture des données accélère l’agilité. Comprendre comment ces piliers interagissent est fondamental pour les dirigeants qui construisent leur parcours de transformation par l’IA.

| Pilier | Caractéristiques | Bénéfices clés |

|---|---|---|

| Confiance | Sécurité psychologique, communication ouverte, droit à l’erreur, décisions transparentes | Expérimentation accrue, engagement des employés, adoption plus rapide |

| Culture des données | Esprit critique, littératie des données, compréhension des capacités/limites de l’IA, prise de décision éclairée | Meilleure mise en œuvre de l’IA, réduction des usages inappropriés, amélioration des résultats |

| Agilité | Esprit d’échec rapide, itération rapide, processus flexibles, apprentissage continu | Délai de valorisation réduit, avantage concurrentiel, capacité à pivoter rapidement |

La sécurité psychologique – la conviction que l’on peut prendre des risques interpersonnels sans craindre de conséquences négatives – est le fondement d’une culture prête pour l’IA. Les collaborateurs doivent se sentir autorisés à expérimenter les outils d’IA, à poser des questions « naïves » sur le fonctionnement des algorithmes et à exprimer leurs préoccupations sur les biais ou conséquences non intentionnelles sans risquer leur réputation ou leur carrière. Cette sécurité est d’autant plus cruciale dans l’adoption de l’IA que la technologie reste méconnue pour la majorité, et que les erreurs lors de la phase d’apprentissage sont inévitables… et précieuses. Les dirigeants instaurent la sécurité psychologique en modélisant eux-mêmes la curiosité envers l’IA, en valorisant les « échecs intelligents » porteurs d’apprentissage, et en protégeant explicitement ceux qui soulèvent des questions éthiques ou remettent en cause les recommandations de l’IA. Lorsque les équipes évoluent dans un environnement psychologiquement sûr, elles identifient plus tôt les problèmes, collaborent entre départements pour résoudre des défis complexes et mènent des déploiements d’IA plus réussis. Les organisations qui normalisent l’expérimentation et l’apprentissage par l’échec distancent systématiquement leurs concurrents dans leur capacité à extraire de la valeur de l’IA.

La culture des données va bien au-delà de l’apprentissage de la lecture de tableaux de bord ou de l’exécution de requêtes SQL – il s’agit de cultiver l’esprit critique qui permet de comprendre ce que l’IA peut et ne peut pas faire. Une équipe « data-fluent » sait que la corrélation n’est pas causalité, comprend les limites des données d’entraînement et sait quand faire confiance à l’IA ou recourir au jugement humain. Par exemple, une équipe marketing initiée aux données ne suivra pas aveuglément un modèle d’IA qui exclurait une population importante et saura interroger les raisons sous-jacentes. Développer cette culture nécessite une formation continue qui dépasse le simple stage ponctuel : il s’agit de créer des communautés de pratique, d’intégrer la littératie des données dès l’onboarding, et de permettre à chacun de questionner la qualité des données ou les hypothèses des modèles. Les organisations qui investissent dans la culture des données constatent des progrès spectaculaires de l’adoption de l’IA, car les collaborateurs gagnent la confiance nécessaire pour travailler avec les outils d’IA au lieu de s’en sentir intimidés. L’objectif : instaurer une prise de décision informée par la donnée aussi naturelle que la lecture d’un e-mail.

Les organisations performantes ne se contentent pas d’adopter l’IA – elles adoptent un esprit d’échec rapide, considérant l’implémentation de l’IA comme un processus d’expérimentation continue, non un déploiement ponctuel. L’agilité, c’est mettre en place des boucles de feedback rapides, tester sur des pilotes restreints avant de généraliser, et accepter de revoir sa stratégie si les données pointent vers une voie plus efficace. Les équipes agiles transforment vite les insights en action, testent des hypothèses sur l’apport de l’IA à leurs processus, tirent les leçons des résultats et itèrent en quelques semaines plutôt qu’en plusieurs mois. L’avantage concurrentiel va aux organisations capables d’expérimenter, de mesurer les résultats et de généraliser les succès tout en abandonnant rapidement ce qui fonctionne moins – à un rythme qui les maintient en tête du marché. L’agilité, c’est aussi bâtir des processus flexibles capables d’intégrer de nouveaux outils et méthodes d’IA au fil de leur apparition, plutôt que d’enfermer les équipes dans des cadres rigides vite obsolètes. Là où l’expérimentation est encouragée et l’itération rapide, les organisations accumulent un savoir institutionnel difficile à répliquer pour la concurrence – et forgent ainsi un avantage durable.

Le comportement des dirigeants est le levier le plus puissant du changement culturel, et cela se vérifie tout particulièrement pour l’adoption de l’IA. Les dirigeants qui s’impliquent visiblement avec les outils d’IA, posent des questions avisées sur la mise en œuvre et admettent ne pas tout comprendre créent un « permis d’agir » qui s’étend à toute l’organisation. Lorsqu’un PDG participe à la formation IA aux côtés des salariés, ou qu’un manager reconnaît publiquement l’échec d’un projet IA comme une opportunité d’apprentissage, cela envoie un signal fort : l’adoption de l’IA est un chemin collectif, non une injonction descendante. Le sponsoring exécutif va au-delà du discours d’encouragement – il s’agit d’allouer des ressources, lever les freins bureaucratiques, et exiger la montée en compétence des équipes. Les dirigeants doivent aussi incarner l’humilité intellectuelle requise, montrant que l’apprentissage des nouvelles technologies est un processus continu quel que soit le niveau hiérarchique. L’effet domino du comportement des dirigeants est considérable : s’ils font confiance à la capacité des équipes à travailler avec l’IA, les équipes osent davantage ; s’ils valorisent l’apprentissage par l’échec, les problèmes remontent plus vite ; s’ils investissent dans leur propre culture des données, ils prennent de meilleures décisions sur les investissements IA. Les organisations où le sponsoring exécutif de l’IA est fort affichent des taux d’adoption 3 à 4 fois supérieurs à celles où l’engagement des dirigeants est plus discret.

La résistance à l’adoption de l’IA est naturelle, souvent enracinée dans des préoccupations légitimes concernant l’emploi, les compétences ou l’échec de précédentes technologies. Une gestion du changement efficace traite ces sujets sans détour par la communication transparente, la mise en œuvre progressive et l’explication claire de la façon dont l’IA va compléter et non remplacer l’humain. Les études montrent que les organisations qui structurent leur démarche de changement constatent 65 % de taux d’adoption en plus et une création de valeur 40 % plus rapide que celles qui abordent l’IA uniquement comme un projet technique.

Stratégies clés de gestion du changement :

La résistance révèle souvent des points d’attention essentiels – les organisations qui écoutent les sceptiques et adaptent leur démarche réussissent des transformations plus fluides et pérennes.

La montée en compétences sur l’IA n’est pas un événement ponctuel mais un engagement permanent, couvrant trois dimensions essentielles : maîtrise technique, intégration dans le travail quotidien, et sensibilisation éthique. La maîtrise technique permet de comprendre les principes de fonctionnement de l’IA, ce qu’est le machine learning, et comment interpréter les résultats générés par l’IA. La formation à l’intégration métier apprend à utiliser concrètement l’IA dans les missions quotidiennes, au-delà de la théorie. La sensibilisation éthique garantit que chacun comprend les biais potentiels, les enjeux de confidentialité et les principes d’une IA responsable adaptés à son rôle. Les organisations qui investissent dans des programmes complets de formation voient de bien meilleurs taux d’adoption : celles qui consacrent plus de 2 % de la masse salariale à la formation IA enregistrent une confiance des collaborateurs supérieure de 40 % pour travailler avec ces outils. Les meilleurs dispositifs mêlent formations formelles, apprentissage sur le terrain, mentorat entre pairs et accès à des ressources pour faire face aux nouveaux défis. Plutôt que de voir la formation comme un centre de coût, les organisations visionnaires la considèrent comme un investissement stratégique déterminant la réussite ou l’échec de leur démarche IA. L’objectif : instaurer une culture apprenante où le développement continu des compétences fait partie intégrante du fonctionnement.

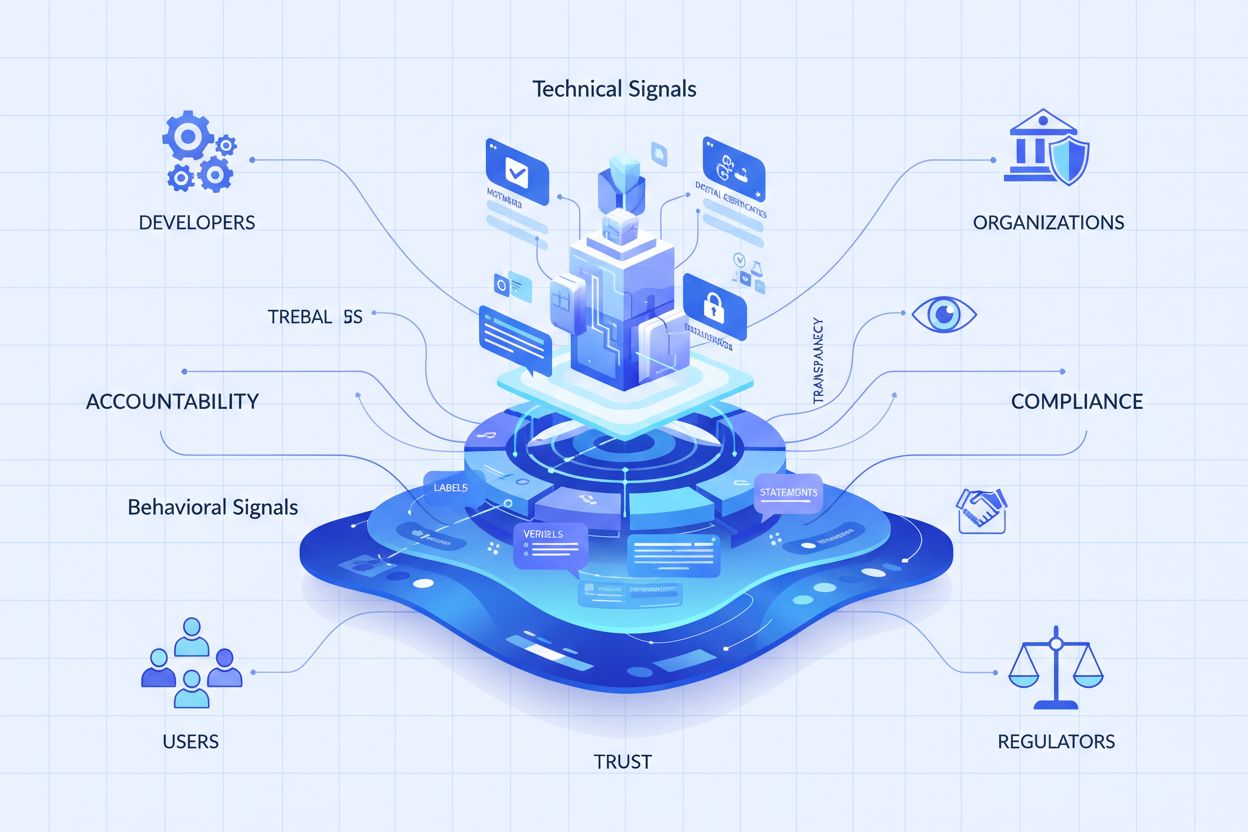

Une idée reçue consiste à croire que la gouvernance freine l’innovation, alors qu’en réalité des cadres de gouvernance bien conçus favorisent l’innovation en posant des limites claires et des mécanismes de responsabilité qui donnent confiance aux équipes pour expérimenter de façon responsable. Une gouvernance efficace de l’IA répond à des questions cruciales : Comment éviter que les systèmes d’IA ne perpétuent des biais ? Qui est responsable si une recommandation d’IA provoque un dommage ? Comment concilier rapidité et sécurité ? Ces cadres doivent être collaboratifs, non punitifs, associer des équipes pluridisciplinaires à la définition des principes éthiques, et instaurer des processus de revue permettant de détecter les problèmes avant qu’ils n’affectent les clients. L’innovation responsable, c’est intégrer l’éthique dès la conception plutôt que de l’ajouter après coup, et prévoir des mécanismes de suivi et d’ajustement en continu une fois les systèmes déployés. Les organisations qui intègrent la gouvernance à leur culture IA obtiennent de meilleurs résultats car les équipes anticipent les implications au lieu de considérer la conformité comme un obstacle. Les plus matures mettent en place des comités éthiques IA, mènent des audits de biais, et assurent la transparence sur la prise de décision des systèmes – autant de pratiques qui instaurent la confiance des parties prenantes et réduisent le risque réglementaire. La gouvernance devient un atout concurrentiel lorsqu’elle est vue comme un moyen de permettre l’innovation responsable plutôt que de la restreindre.

Mesurer le succès de l’IA implique d’aller au-delà des indicateurs classiques d’efficacité pour saisir toute la valeur de la transformation culturelle. Si la réduction des coûts et les gains de productivité sont importants, il faut aussi suivre les taux d’adoption, la confiance des collaborateurs dans l’usage de l’IA, la qualité des décisions prises avec l’aide de l’IA et la vitesse d’innovation – c’est-à-dire la rapidité avec laquelle de nouvelles applications d’IA passent du concept à la mise en œuvre. Les indicateurs de réussite peuvent inclure le pourcentage d’employés utilisant activement les outils d’IA, le nombre d’insights générés par l’IA donnant lieu à des actions, la réduction du temps de décision grâce à l’IA, et le flux de nouveaux projets IA en développement. Les organisations qui entretiennent la dynamique sur le long terme considèrent l’IA comme un processus d’amélioration continue, non un projet à échéance ; elles instaurent des pipelines d’innovation où les équipes identifient régulièrement de nouvelles opportunités d’application. Elles créent aussi des boucles de retour pour apprendre de l’expérience et ajuster leur approche en fonction des résultats concrets. Maintenir la dynamique suppose de valoriser les progrès, de préserver la visibilité et le soutien des dirigeants, et de renforcer en continu les valeurs culturelles favorisant la réussite de l’IA. Les organisations qui domineront leur secteur dans la prochaine décennie ne seront pas celles qui auront adopté l’IA le plus vite, mais celles qui auront bâti une culture permettant à l’adoption de l’IA d’être auto-entretenue – où apprentissage continu, expérimentation et innovation responsable deviennent le mode de fonctionnement naturel.

La culture de la visibilité de l’IA désigne un environnement organisationnel où l’adoption de l’intelligence artificielle est transparente, comprise et activement gérée à tous les niveaux. Elle est importante car 74 % des entreprises peinent à tirer de la valeur de leurs investissements en IA – non pas à cause de limites technologiques, mais en raison de problématiques humaines et de processus. Une forte culture de la visibilité de l’IA garantit que votre organisation puisse adopter, surveiller et exploiter efficacement les outils d’IA tout en gardant le contrôle sur la façon dont l’IA est utilisée et référencée.

Bâtir une culture prête pour l’IA est généralement un parcours de 12 à 24 mois, bien que la durée varie selon la taille de l’organisation et le point de départ. La plupart des organisations suivent une approche par étapes : construction des bases (0-6 mois), expérimentation et apprentissage (6-18 mois), passage à l’échelle (18-36 mois), et transformation (36-48 mois). L’essentiel est d’investir constamment dans la gestion du changement, la formation et l’engagement des dirigeants tout au long du processus.

L’adoption de l’IA consiste à mettre en œuvre des outils et technologies d’IA, tandis que la culture de la visibilité de l’IA englobe l’état d’esprit, les comportements et les systèmes organisationnels plus larges qui soutiennent une intégration réussie de l’IA. On peut adopter des outils d’IA sans construire la culture nécessaire pour les soutenir – c’est pourquoi tant d’implémentations échouent. La culture de la visibilité de l’IA garantit une adoption durable, éthique et alignée sur les valeurs de l’organisation.

Suivez des indicateurs sur plusieurs dimensions : taux d’adoption (pourcentage d’employés utilisant activement des outils d’IA), confiance des employés (mesures par sondage du confort avec l’IA), qualité des décisions (amélioration des résultats grâce aux décisions informées par l’IA) et vitesse d’innovation (rapidité de la mise en œuvre des nouvelles applications d’IA). Surveillez également des indicateurs avancés tels que les taux de complétion des formations, l’engagement des ambassadeurs du changement et la réactivité des boucles de rétroaction.

Les obstacles courants incluent : un investissement insuffisant dans la gestion du changement (seulement 37 % des organisations investissent significativement), un manque de sponsoring exécutif, des programmes de formation inadéquats, une résistance liée aux inquiétudes sur la sécurité de l’emploi, et des cadres de gouvernance qui freinent au lieu de stimuler l’innovation. Les organisations qui s’attaquent frontalement à ces obstacles constatent des taux d’adoption 3 à 4 fois supérieurs à celles qui les ignorent.

La résistance est souvent le signal de préoccupations légitimes, plus qu’un obstacle à surmonter. Traitez-la en : communiquant clairement la raison d’être de la démarche, impliquant les sceptiques dans la planification de la mise en œuvre, fournissant une formation complète avant le déploiement, créant des mécanismes de retour pour exprimer les inquiétudes, et en célébrant les premiers succès. Les organisations qui écoutent les résistants et ajustent leur approche en conséquence réussissent des transformations plus fluides et durables.

La formation est fondamentale à la transformation culturelle. Des programmes efficaces abordent trois dimensions : la littératie technique (comprendre le fonctionnement de l’IA), l’intégration dans les processus de travail (appliquer l’IA dans le quotidien) et la sensibilisation à l’éthique (comprendre les principes d’une IA responsable). Les organisations qui consacrent plus de 2 % de la masse salariale à la formation liée à l’IA rapportent une confiance des employés 40 % plus élevée. La formation doit être continue, et non un événement ponctuel.

Une gouvernance bien conçue permet l’innovation plutôt que de la contraindre, en posant des limites claires et des structures de responsabilité. Impliquez des équipes pluridisciplinaires pour définir les principes éthiques, intégrez la gouvernance dès la conception plutôt qu’en l’ajoutant a posteriori, et présentez la conformité comme un moyen de permettre une innovation responsable. Les organisations dotées d’une gouvernance de l’IA mature obtiennent de meilleurs résultats car les équipes anticipent les implications au lieu de voir la conformité comme un obstacle.

Découvrez comment votre organisation est référencée dans les systèmes d’IA et suivez votre visibilité d’adoption de l’IA à travers GPTs, Perplexity et Google AI Overviews avec AmICited.

Découvrez comment sélectionner les meilleures plateformes communautaires pour les professionnels de l'IA. Comparez les solutions phares, évaluez les fonctionnal...

Découvrez comment construire des budgets de visibilité IA basés sur le ROI grâce à des cadres éprouvés, des stratégies de mesure et des méthodes d’allocation. M...

Découvrez les meilleures pratiques essentielles pour la transparence et la divulgation de l'IA. Explorez les méthodes de divulgation comportementale, verbale et...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.