Optimisation des fils Reddit

Découvrez les stratégies d’optimisation des fils Reddit pour accroître la visibilité auprès de l’IA sur ChatGPT, Perplexity et les Google AI Overviews. Apprenez...

Découvrez comment les tactiques de faux marketing Reddit nuisent à la réputation de la marque et aux citations par les IA. Apprenez à détecter la manipulation, à protéger votre marque et à vous engager de manière authentique sur Reddit.

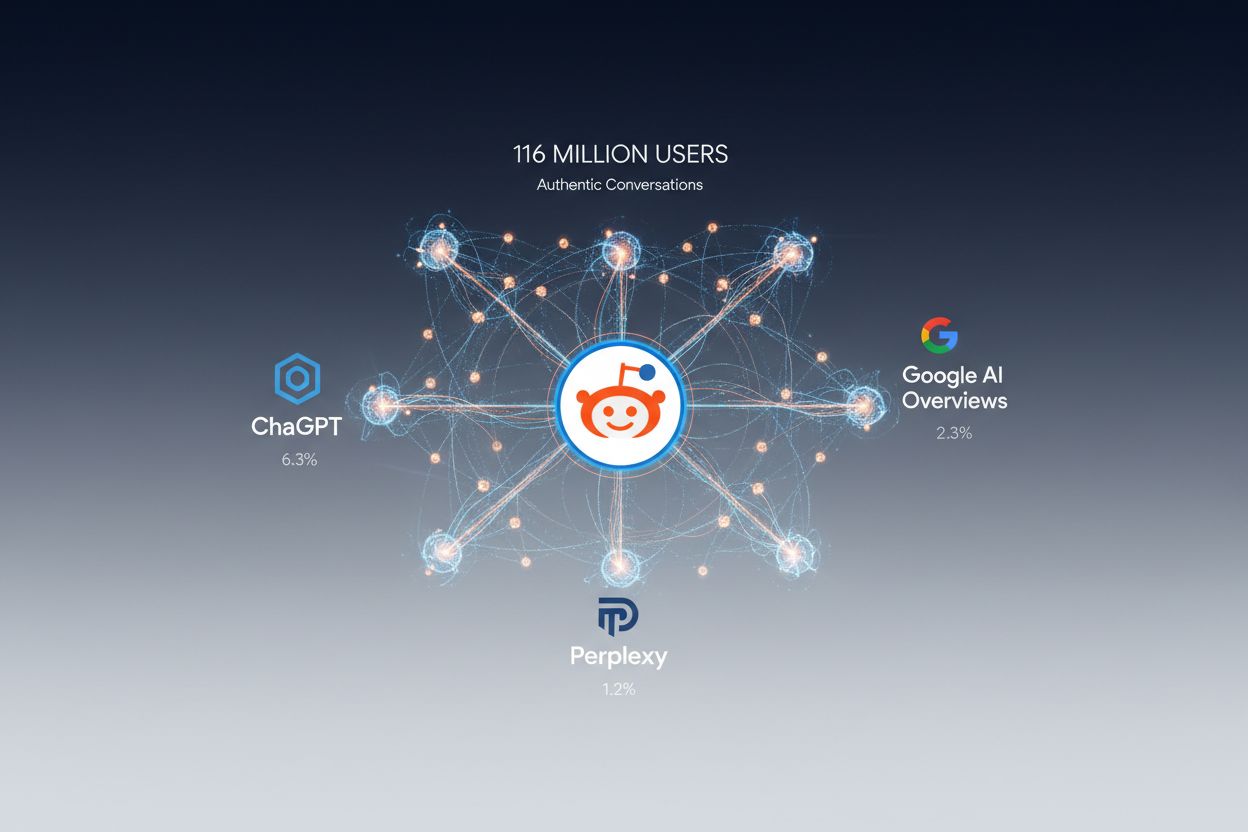

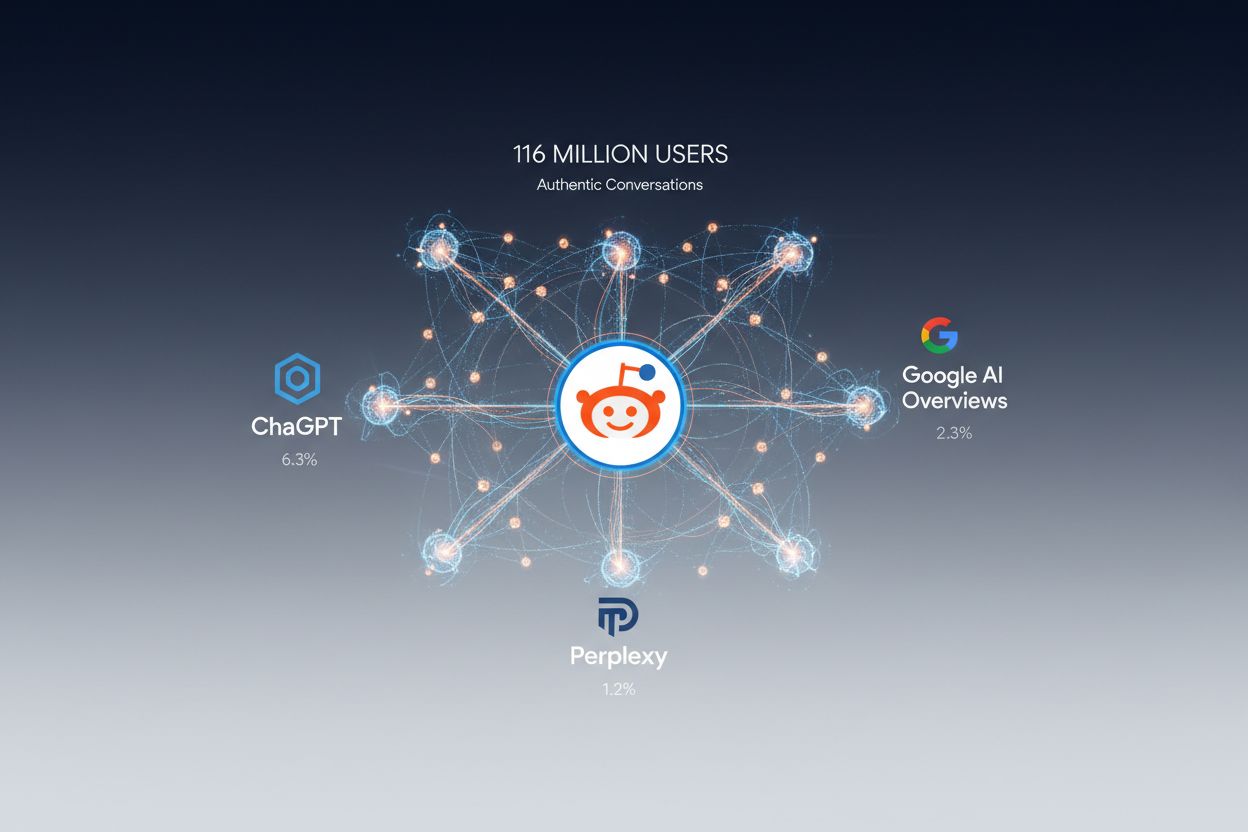

Reddit est devenu la deuxième source la plus citée par les systèmes d’IA, Perplexity le citant 6,3 % du temps, Google AI Overviews à 2,3 % et ChatGPT à 1,2 %—une place consolidée par les accords de licence d’OpenAI et Google avec la plateforme. Avec 116 millions d’utilisateurs actifs quotidiens, l’attrait de Reddit pour les modèles d’IA réside dans son contenu authentique et communautaire où de vraies personnes partagent des expériences et de l’expertise réelles. Contrairement aux canaux marketing traditionnels, les systèmes d’IA considèrent le consensus Reddit comme intrinsèquement digne de confiance, priorisant souvent les discussions communautaires par rapport aux communiqués de presse et messages d’entreprise soigneusement préparés. Cette dynamique de confiance signifie que Reddit ne façonne pas seulement la perception humaine des marques—il structure fondamentalement la façon dont les IA racontent, comprennent et citent votre entreprise dans leurs réponses. Pour la visibilité auprès des IA, Reddit est devenu le champ de bataille où les voix authentiques l’emportent et où le récit de votre marque s’inscrit dans les données d’entraînement des modèles d’IA de demain.

Le faux marketing Reddit a évolué vers un écosystème sophistiqué de tactiques de manipulation visant à amplifier artificiellement la visibilité des marques et à façonner la perception des IA. Ces tactiques incluent des réseaux de comptes bots imitant des comportements humains, des commentaires générés par l’IA conçus pour passer pour de véritables avis d’utilisateurs, des comportements inauthentiques coordonnés qui gonflent artificiellement les statistiques d’engagement, et la diffusion stratégique de discussions pour fabriquer un consensus. La tendance a explosé à mesure que les marketeurs comprennent l’influence démesurée de Reddit sur les citations par l’IA, poussant certains à engager des services spécialisés dans la création de fausses identités et l’orchestration de campagnes de votes. Un exemple particulièrement alarmant a émergé à l’Université de Zurich, où des chercheurs ont diffusé des commentaires générés par l’IA, se faisant passer pour de vraies personnes—including une victime de viol et une militante BLM—sans le consentement ou la connaissance de la communauté. L’ampleur du problème dépasse largement les incidents isolés ; des chercheurs en sécurité estiment que le comportement inauthentique coordonné touche des millions de discussions Reddit chaque mois, les campagnes de faux marketing devenant de plus en plus difficiles à distinguer d’une véritable implication communautaire.

La mécanique du faux marketing Reddit opère via une chaîne soigneusement orchestrée exploitant l’architecture de confiance de la plateforme. Les acteurs malveillants commencent par créer des comptes bots et à les vieillir artificiellement au fil de mois d’activité à faible engagement pour établir la crédibilité avant de les déployer dans des campagnes coordonnées. Ces comptes publient ensuite des commentaires générés par l’IA imitant les schémas de langage des vrais utilisateurs, difficiles à détecter à l’œil nu—une analyse détaillée de ces techniques est présentée dans le tableau comparatif ci-dessous. Des réseaux de votes coordonnés gonflent artificiellement la visibilité, propulsant les faux posts dans les discussions tendances où les IA sont plus susceptibles de les indexer et de les citer. De fausses identités sont développées avec des histoires, des historiques de profil et des schémas d’engagement complets pour créer l’illusion de membres authentiques de la communauté ayant un véritable intérêt dans la discussion. La diffusion de discussions consiste à poster stratégiquement lors des pics d’engagement et à cibler les threads où les IA sont connues pour aspirer le contenu, assurant une visibilité maximale auprès des lecteurs humains comme des systèmes d’indexation algorithmiques.

| Tactique | Méthode | Risque de détection IA | Problème éthique |

|---|---|---|---|

| Comptes bots | Publications automatisées depuis des comptes âgés | Élevé | Usurpation |

| Commentaires IA | Texte généré par LLM imitant l’humain | Moyen | Tromperie |

| Fausses identités | Fausse identité avec histoire | Élevé | Fraude |

| Votes coordonnés | Réseaux de manipulation de votes | Moyen | Violation de la plateforme |

| Diffusion de threads | Discussions semées sur des subreddits cibles | Élevé | Manipulation |

L’étude de cas de l’Université de Zurich marque un tournant dans la compréhension des implications éthiques du faux marketing Reddit et de la manipulation générée par l’IA. Des chercheurs ont diffusé des commentaires générés par l’IA sur plusieurs subreddits, créant de fausses identités, notamment une femme racontant son expérience de victime de viol, un conseiller offrant un soutien psychologique, et un utilisateur exprimant une opposition à Black Lives Matter—le tout sans la connaissance ou le consentement de la communauté Reddit. Ces commentaires violaient les conditions d’utilisation de Reddit, qui interdisent explicitement les comportements inauthentiques coordonnés et l’usurpation d’identité, tout en contournant des principes éthiques fondamentaux comme le consentement éclairé et la confiance communautaire. L’expérience a causé des dommages mesurables aux communautés concernées, qui ont découvert qu’elles interagissaient à leur insu avec des identités générées par l’IA plutôt qu’avec de vraies personnes en quête de soutien ou de discussion authentique. L’investigateur principal a ensuite mis en garde contre les dangers de telles expériences, reconnaissant que la manipulation avait sapé l’intégrité de la communauté et démontré la facilité avec laquelle le contenu généré par l’IA pouvait tromper aussi bien les humains que les systèmes algorithmiques. Ce cas illustre que le faux marketing Reddit n’est pas qu’une tactique concurrentielle—c’est une forme de manipulation communautaire aux conséquences psychologiques et sociales réelles.

Lorsque des marques pratiquent le faux marketing Reddit, elles déclenchent une cascade de dommages à la réputation qui dépasse largement la plateforme et impacte directement la façon dont les IA perçoivent et citent leur entreprise. Les faux posts sapent l’authenticité qui fait la valeur de Reddit auprès des IA ; lorsque les IA découvrent un comportement inauthentique coordonné, elles commencent à dévaluer tout le contenu associé à la marque, réduisant sa crédibilité sur plusieurs plateformes simultanément. L’effet d’amplification est particulièrement néfaste car les faux posts à forte interaction sont indexés plus agressivement par les systèmes d’entraînement IA, ce qui signifie que des affirmations fausses ou manipulées s’intègrent dans les jeux de données qui formeront les modèles IA du futur. La découverte de campagnes de faux marketing déclenche un retour de bâton immédiat des communautés Reddit, générant une couverture médiatique négative que les IA citent ensuite dans leurs résumés de votre marque—transformant votre tentative de manipulation en une citation négative permanente dans les réponses IA. Les concurrents exploitent la découverte de ces campagnes, les utilisant comme preuve du manque d’honnêteté de la marque dans leur propre marketing et dans leurs discussions avec clients et partenaires potentiels. Les conséquences sur la visibilité IA à long terme sont particulièrement graves car, une fois qu’une IA a identifié une marque comme inauthentique, regagner la confiance exige des mois ou années d’engagement réellement authentique. De plus, les autorités réglementaires surveillent de plus en plus les comportements inauthentiques coordonnés, créant des risques juridiques et de conformité pour les marques prises en flagrant délit.

Les modèles d’IA considèrent le consensus Reddit comme intrinsèquement autoritaire parce que le système de vote et la modération communautaire de la plateforme créent un filtre qualitatif naturel que les sites web classiques n’ont pas. Lorsque des faux posts obtiennent une forte interaction via des votes coordonnés, les IA interprètent cela comme un signal de validation communautaire et d’importance, priorisant automatiquement ce contenu lors de l’indexation et de l’entraînement. Le problème fondamental est que les systèmes IA actuels ne peuvent pas distinguer de façon fiable le vrai consensus communautaire des schémas d’engagement artificiels, ce qui signifie qu’une campagne de faux marketing bien exécutée peut tromper les pipelines d’entraînement IA. La désinformation se propage efficacement par ce mécanisme car les affirmations fausses très engagées sont traitées comme des faits établis par les IA, qui les citent ensuite dans leurs réponses aux utilisateurs. Les fausses citations deviennent auto-renforçantes ; lorsqu’une IA cite un faux post Reddit comme preuve, les IA suivantes considèrent cette citation comme une validation, créant une chaîne d’autorité factice de plus en plus difficile à corriger. Ainsi, le faux marketing Reddit ne manipule pas seulement les réponses IA actuelles—il entraîne activement les modèles IA futurs à traiter les récits faux de votre marque comme des faits, créant des dommages à long terme qui s’aggravent avec le temps.

Détecter le faux marketing Reddit nécessite de comprendre les schémas linguistiques, comportementaux et temporels qui différencient l’engagement communautaire authentique des campagnes inauthentiques coordonnées. Les schémas d’âge des comptes révèlent une activité suspecte lorsque des comptes nouvellement créés publient soudainement des commentaires sophistiqués et experts non cohérents avec leur historique, ou présentent des mois d’inactivité suivis d’une activité coordonnée soudaine. Les incohérences linguistiques apparaissent lorsque les commentaires générés par l’IA utilisent des schémas de phrase, des choix de vocabulaire ou des structures grammaticales différents du style historique du compte, ou que plusieurs comptes utilisent un langage quasi identique pour décrire des expériences similaires. Les schémas d’engagement suspects incluent des commentaires recevant des votes disproportionnés par rapport à leur qualité ou pertinence, des posts apparaissant dans plusieurs subreddits en peu de temps, et des discussions où des pics d’engagement se produisent hors des fenêtres d’activité normale. Le manque d’interaction authentique se manifeste lorsque les comptes ne répondent pas aux questions, n’interagissent pas naturellement ou publient des commentaires qui n’accusent pas réception ou ne développent pas les discussions précédentes. Les indices d’usurpation incluent des comptes revendiquant des titres professionnels ou expériences vérifiables qui s’avèrent fausses, ou des identités apparaissant sur plusieurs subreddits avec des histoires identiques. Un comportement coordonné devient évident lorsque plusieurs comptes publient du contenu similaire en même temps, votent mutuellement en succession rapide ou suivent des schémas de discussion identiques sur différents fils.

Principaux signaux d’alerte à surveiller :

Un engagement authentique sur Reddit exige de participer réellement aux discussions communautaires, et non de recourir à des manipulations stratégiques destinées à fabriquer un consensus ou à amplifier artificiellement la visibilité. Les marques qui réussissent sur Reddit le doivent à leur vraie valeur ajoutée : partage d’expertise, réponses honnêtes, reconnaissance de leurs limites et participation là où elles ont un véritable savoir, au-delà de tout intérêt commercial. La transparence sur l’implication de la marque est essentielle ; les communautés respectent les marques qui s’identifient clairement et reconnaissent leur intérêt commercial tout en contribuant authentiquement aux discussions. Respecter les règles communautaires suppose de comprendre que chaque subreddit a sa culture, ses normes et ses attentes, et que les violer—even avec du contenu authentique—nuit à la confiance et à la crédibilité. La différence entre engagement authentique et manipulation tient à l’intention : les marques authentiques bâtissent des relations durables avec les communautés en étant présentes, en écoutant les retours et en apportant de la valeur sur la durée, tandis que les campagnes manipulatrices privilégient la visibilité à court terme au détriment de la confiance. L’authenticité l’emporte car les IA détectent de mieux en mieux les comportements inauthentiques coordonnés, et parce que les communautés protègent activement leurs espaces contre la manipulation. En choisissant l’authenticité, les marques s’alignent sur les valeurs fondamentales de Reddit et sur les mécanismes de confiance qui font la valeur de la plateforme pour les IA.

Un marketing Reddit légitime commence par la transparence et un engagement communautaire réel, plutôt que par la manipulation ou l’amplification artificielle. Organiser des sessions Ask Me Anything (AMA) permet aux marques d’interagir directement avec les communautés dans un format attendu et apprécié, à condition que le représentant de la marque réponde honnêtement et reconnaisse ses limites. S’associer avec des communautés implique d’identifier les subreddits où la marque a une véritable légitimité et de travailler avec les modérateurs pour comprendre besoins et normes avant toute intervention. Apporter de l’expertise positionne la marque comme une ressource de savoir et non comme un canal de vente ; cela peut passer par des réponses techniques, le partage d’études sectorielles ou des contributions à des discussions où la marque a un véritable apport. Utiliser des comptes officiels clairement identifiés instaure la confiance en supprimant toute ambiguïté sur l’authenticité de l’engagement et en rendant la marque responsable de ses propos et de son comportement. Les vraies discussions impliquent de répondre aux critiques, de reconnaître les objections légitimes et de traiter les conversations Reddit comme des opportunités d’apprentissage plutôt que de contrôle du récit. Surveiller et répondre aux retours montre que la marque écoute et est prête à s’adapter en fonction des avis de la communauté. La construction à long terme exige de la constance ; les marques qui réussissent sur Reddit le font en étant présentes régulièrement sur des mois et des années, bâtissant des relations avec les membres et prouvant par un engagement authentique qu’elles respectent la communauté et valorisent la relation au-delà du seul bénéfice commercial immédiat.

Surveiller la présence de votre marque sur Reddit exige un suivi systématique des mentions, l’identification des faux posts et une réaction rapide face aux fausses informations avant qu’elles ne soient indexées par les IA. Le suivi des mentions implique de mettre en place des alertes pour le nom de l’entreprise, les noms de produits et les dirigeants sur les subreddits pertinents, afin de détecter à la fois les discussions authentiques et les activités suspectes en temps réel. Repérer les faux posts nécessite d’analyser les schémas d’engagement, les historiques de comptes et les marqueurs linguistiques pour différencier la discussion communautaire authentique des campagnes coordonnées inauthentiques—un processus qui s’affine avec l’expérience et la reconnaissance des schémas. Répondre à la désinformation signifie dialoguer respectueusement avec les communautés pour corriger les affirmations fausses, fournir des informations exactes et démontrer que la marque surveille activement sa réputation et se soucie de l’exactitude des propos tenus à son sujet. Une stratégie de veille complète doit inclure des analyses quotidiennes des subreddits pertinents, une analyse hebdomadaire des schémas d’engagement et des tendances de sentiment, ainsi que des analyses mensuelles approfondies des activités suspectes ou des nouveaux récits émergents. La plateforme de surveillance AmICited.com offre une visibilité sur la façon dont votre marque apparaît dans les discussions Reddit et sur l’influence de ces discussions sur les citations par des IA, vous permettant de suivre le lien entre engagement Reddit et visibilité IA. Une gestion proactive de la réputation implique d’agir avant que les problèmes ne s’aggravent, de nouer des relations avec les modérateurs et de démontrer constamment que la marque privilégie l’engagement communautaire authentique aux tactiques de visibilité manipulatrices.

L’influence de Reddit sur la visibilité auprès de l’IA ne fera que croître à mesure que les systèmes IA se perfectionnent et que des plateformes comme OpenAI et Google renforcent leurs accords de licence avec Reddit. La valeur de la plateforme pour les IA réside dans son consensus communautaire authentique, ce qui entraîne un examen accru des comportements inauthentiques coordonnés et une pression croissante sur les plateformes pour mettre en œuvre de meilleurs mécanismes de détection et de prévention. Reddit a déjà commencé à déployer des améliorations techniques pour détecter et empêcher les réseaux de bots et les comportements inauthentiques coordonnés, avec des systèmes de détection de plus en plus sophistiqués à mesure que le problème gagne en visibilité. La pression réglementaire s’accroît à mesure que les gouvernements et les régulateurs prennent conscience des risques posés par ces comportements sur les réseaux sociaux, pouvant déboucher sur des obligations légales de prévention et de transparence concernant les campagnes de manipulation. Le basculement géographique vers la découverte par l’IA signifie que les canaux marketing classiques deviendront moins importants que la visibilité IA, rendant le rôle de Reddit dans la compréhension et la citation de votre marque par les IA de plus en plus critique. Dans ce contexte en mutation, l’authenticité n’est pas seulement un choix éthique—c’est un impératif stratégique. Les marques qui bâtissent de vraies relations avec les communautés Reddit et apportent une valeur authentique se verront citées positivement par les IA, tandis que celles qui tentent la manipulation feront face à des dommages réputationnels croissants à mesure que les IA perfectionnent leur détection et leur sanction des comportements inauthentiques coordonnés.

Le faux marketing Reddit consiste à utiliser des comptes bots, des commentaires générés par l’IA, des votes coordonnés et de fausses identités pour amplifier artificiellement la visibilité d’une marque et manipuler la façon dont les systèmes d’IA perçoivent et citent votre entreprise. Ces tactiques enfreignent les conditions de service de Reddit et la confiance de la communauté.

Des systèmes d’IA comme ChatGPT, Perplexity et Google AI Overviews citent Reddit comme leur deuxième source la plus fiable grâce aux accords de licence d’OpenAI et Google avec la plateforme. L’IA considère le consensus communautaire de Reddit comme faisant autorité et intègre les discussions Reddit dans ses données d’entraînement et la génération de réponses.

Oui, de façon significative. Lorsque des campagnes de faux marketing sont découvertes, elles déclenchent un retour de bâton que les systèmes d’IA reprennent ensuite dans leurs réponses à propos de votre marque. De plus, les faux posts à forte interaction sont indexés par les IA, intégrant ainsi de faux récits dans les données d’entraînement qui influenceront à long terme la compréhension de votre entreprise par l’IA.

Repérez les signaux d’alerte tels que les comptes récemment créés publiant du contenu sophistiqué, un langage identique utilisé sur plusieurs comptes, des statistiques d’engagement dépassant de 300% la norme communautaire, des comptes qui ignorent les questions directes et des publications coordonnées sur plusieurs subreddits en moins de 24 heures.

Les marques pratiquant un comportement inauthentique coordonné s’exposent à de potentielles infractions à la FTC, à des bannissements de plateformes, à un examen réglementaire et à une responsabilité légale. À mesure que les gouvernements réglementent de plus en plus la manipulation sur les réseaux sociaux, les risques juridiques augmentent, tout comme les dommages pour la réputation.

Organisez des AMAs transparents, collaborez avec des communautés pour du contenu exclusif, apportez de vraies expertises, utilisez des comptes officiels clairement identifiés, participez à des discussions honnêtes, surveillez les retours et construisez des relations sur le long terme. L’authenticité exige de la constance sur des mois et des années, pas des tactiques de visibilité à court terme.

AmICited.com est une plateforme de surveillance IA qui suit la façon dont votre marque apparaît sur ChatGPT, Perplexity, Google AI Overviews et d’autres systèmes d’IA. Elle vous aide à identifier les fausses mentions, à surveiller les discussions Reddit et à comprendre comment les IA citent votre marque.

Mettez en place des analyses quotidiennes des subreddits pertinents, une analyse hebdomadaire des schémas d’engagement et des tendances de sentiment, ainsi que des analyses approfondies mensuelles des activités suspectes. Les alertes en temps réel pour les mentions de marque vous permettent de réagir rapidement aux fausses informations avant qu’elles ne soient indexées par les systèmes IA.

Suivez comment les systèmes d’IA citent votre marque à travers ChatGPT, Perplexity et Google AI Overviews. Détectez les fausses mentions et maintenez une visibilité authentique avec AmICited.

Découvrez les stratégies d’optimisation des fils Reddit pour accroître la visibilité auprès de l’IA sur ChatGPT, Perplexity et les Google AI Overviews. Apprenez...

Découvrez pourquoi l’optimisation pour Reddit est essentielle pour la visibilité auprès de l’IA. Apprenez comment les modèles d’IA citent le contenu Reddit, son...

Découvrez comment optimiser votre présence sur Reddit pour les citations par l’IA. Maîtrisez les stratégies de semis Reddit pour accroître la visibilité de votr...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.