Recherche IA multimodale

Découvrez comment les systèmes de recherche IA multimodale traitent ensemble texte, images, audio et vidéo pour fournir des résultats plus précis et contextuell...

Maîtrisez l’optimisation de la recherche IA multimodale. Découvrez comment optimiser images et requêtes vocales pour des résultats de recherche alimentés par l’IA, avec des stratégies pour GPT-4o, Gemini et les LLM.

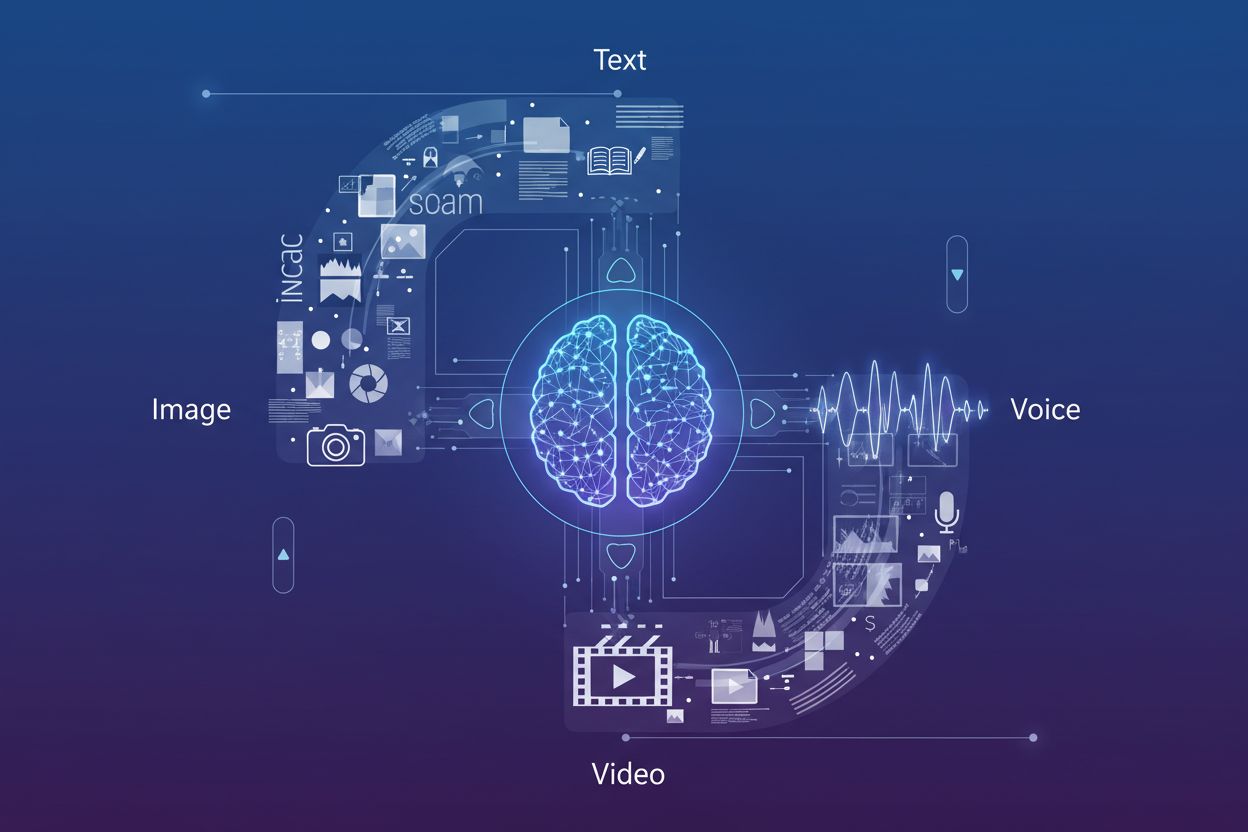

La recherche IA multimodale représente un bouleversement fondamental dans la façon dont les moteurs de recherche traitent et comprennent les requêtes utilisateurs, en intégrant plusieurs types de données — texte, images, voix et vidéo — dans une expérience de recherche unifiée. Au lieu de traiter chaque modalité comme un canal distinct, les systèmes de recherche modernes exploitent désormais des modèles IA multimodaux capables d’analyser et de corréler simultanément des informations à travers différents formats, pour des résultats plus contextuels et précis. Cette évolution, qui fait passer la recherche d’une seule modalité (où des requêtes textuelles renvoyaient des résultats textuels) à des systèmes multimodaux intégrés, reflète la réalité de l’interaction naturelle des utilisateurs avec l’information : combiner questions orales et références visuelles, télécharger des images pour donner du contexte, et attendre des résultats qui synthétisent plusieurs types de contenus. L’importance de ce changement ne peut être surestimée : il transforme fondamentalement la manière dont les créateurs de contenu doivent optimiser leur présence numérique et comment les marques doivent surveiller leur visibilité sur les canaux de recherche. Comprendre l’optimisation pour la recherche multimodale n’est plus une option pour les entreprises qui souhaitent maintenir leur visibilité concurrentielle dans des environnements de recherche pilotés par l’IA.

L’émergence de modèles multimodaux avancés a transformé les capacités de recherche, plusieurs plateformes leaders proposant aujourd’hui des modèles vision-langage sophistiqués capables de traiter et comprendre du contenu sur plusieurs modalités simultanément. Voici comment les principaux acteurs se comparent :

| Nom du modèle | Créateur | Capacités clés | Idéal pour |

|---|---|---|---|

| GPT-4o | OpenAI | Analyse d’image en temps réel, traitement de la voix, temps de réponse de 320 ms | Raisonnement visuel complexe, conversations multimodales |

| Gemini | Recherche intégrée, compréhension vidéo, raisonnement intermodal | Intégration à la recherche, analyse de contenu globale | |

| Claude 3.7 | Anthropic | Analyse documentaire, interprétation d’images, compréhension fine | Documentation technique, analyse visuelle détaillée |

| LLaVA | Communauté open-source | Traitement vision-langage léger, inférence efficace | Environnements à ressources limitées, déploiement en périphérie |

| ImageBind | Meta | Embeddings intermodaux, compréhension audio-visuelle | Corrélation de contenu multimédia, recherche sémantique |

Ces modèles représentent le sommet de la technologie de recherche IA, chacun optimisé pour des cas d’usage et des scénarios de déploiement différents. Les organisations doivent comprendre quels modèles alimentent leurs plateformes de recherche cibles pour optimiser efficacement leur contenu. L’avancée rapide de ces technologies impose des stratégies de visibilité en recherche flexibles et adaptables, capables d’intégrer de nouvelles capacités et facteurs de classement.

L’optimisation pour la recherche d’image est devenue cruciale alors que les capacités de recherche visuelle explosent — Google Lens a enregistré à lui seul 10 millions de visites en mai 2025, illustrant la croissance fulgurante des requêtes basées sur l’image. Pour maximiser la visibilité dans les résultats de recherche d’image IA, les créateurs de contenu doivent mettre en œuvre une stratégie d’optimisation complète :

Cette approche globale garantit que vos images sont découvrables aussi bien via la recherche d’image traditionnelle que par les systèmes IA multimodaux qui analysent le contenu visuel dans son contexte textuel et métadonnées.

L’intégration des grands modèles de langage (LLM) dans la recherche vocale a fondamentalement transformé la manière dont les moteurs de recherche interprètent et répondent aux requêtes orales, dépassant largement la simple correspondance de mots-clés pour atteindre une compréhension contextuelle sophistiquée. La recherche vocale traditionnelle reposait sur la correspondance phonétique et un traitement basique du langage naturel, mais les systèmes modernes de recherche vocale pilotée par des LLM comprennent dorénavant l’intention, le contexte, la nuance et les schémas conversationnels avec une grande précision. Cela signifie que l’optimisation pour la recherche vocale ne peut plus se limiter à des mots-clés exacts : le contenu doit désormais être structuré pour répondre à l’intention sous-jacente des requêtes conversationnelles formulées à l’oral par les utilisateurs. Les implications sont profondes : un utilisateur qui demande “Quelle est la meilleure façon de réparer un robinet de cuisine qui fuit ?” n’a pas le même besoin que s’il tape “réparer robinet qui fuit”, et le contenu doit répondre à la fois à la question et au besoin implicite d’une démarche pas à pas. Les extraits optimisés sont devenus la principale source pour les réponses en recherche vocale, les moteurs de recherche privilégiant les réponses concises et directes en haut des résultats. Comprendre cette hiérarchie — les réponses vocales étant extraites des extraits optimisés — est essentiel pour toute stratégie de contenu visant les appareils et assistants vocaux.

L’optimisation pour les requêtes conversationnelles nécessite de restructurer fondamentalement l’organisation et la présentation du contenu, en abandonnant les paragraphes denses en mots-clés au profit de formats naturels de questions-réponses qui reflètent la manière dont les gens s’expriment à l’oral. Le contenu doit être organisé avec des titres sous forme de questions répondant directement aux requêtes orales courantes, suivis de réponses concises et expertes, apportant une valeur immédiate sans imposer aux utilisateurs de parcourir de longs textes. Cette méthode correspond à la façon dont les systèmes de traitement du langage naturel extraient les réponses du web : ils recherchent des paires question-réponse claires et des affirmations directes à lire à haute voix par les assistants vocaux. Mettre en place des données structurées qui identifient explicitement les questions et réponses aide les moteurs de recherche à comprendre la nature conversationnelle de votre contenu et augmente vos chances d’être sélectionné pour la recherche vocale. Les expressions longues et conversationnelles doivent être intégrées naturellement dans votre contenu, et non forcées artificiellement. L’objectif est de produire un contenu qui sonne naturellement à l’oral tout en étant optimisé pour les IA qui analysent et extraient les informations de vos pages. Cet équilibre entre lisibilité humaine et interprétabilité machine est la clé d’une optimisation efficace pour la recherche vocale.

La mise en place d’un balisage schéma adapté est essentielle pour signaler aux systèmes IA multimodaux la nature de votre contenu et la manière dont il doit être interprété dans différents contextes de recherche. Les implémentations de données structurées les plus efficaces pour la recherche multimodale comprennent le schéma FAQ (qui marque explicitement les paires question-réponse pour la recherche vocale), le schéma HowTo (qui fournit des instructions pas à pas lisibles par machine), et le schéma Local Business (pour les requêtes multimodales locales). Au-delà de ces types principaux, la mise en place de schémas Article, Produit et Événement garantit que votre contenu est correctement catégorisé et compris par les IA analysant vos pages. Le Rich Results Test de Google doit être utilisé régulièrement pour vérifier que vos schémas sont bien implémentés et reconnus par les systèmes de recherche. Les fondamentaux du SEO technique — structure HTML propre, temps de chargement rapides, adaptabilité mobile et bonne canonicalisation — deviennent encore plus critiques dans un environnement multimodal où l’IA doit rapidement analyser et comprendre votre contenu sous plusieurs formats. Les organisations doivent auditer l’ensemble de leur bibliothèque de contenu pour identifier les opportunités de balisage, en priorisant les pages à fort trafic et celles qui se prêtent naturellement à des formats question-réponse ou tutoriels.

Le suivi de la performance en recherche multimodale suppose de repenser les indicateurs au-delà du trafic organique traditionnel, en se concentrant particulièrement sur les impressions d’extraits optimisés, l’engagement vocal et les taux de conversion issus de sources multimodales. Google Search Console offre une visibilité sur les performances des extraits optimisés, indiquant la fréquence d’apparition en position zéro et les requêtes qui déclenchent ces extraits — des données directement corrélées à la visibilité vocale. Les métriques d’engagement mobile deviennent primordiales, la recherche vocale passant principalement par mobiles et enceintes connectées, ce qui fait des taux de conversion mobile et de la durée de session des KPIs essentiels pour le contenu optimisé voix. Les plateformes d’analytics doivent être configurées pour suivre séparément le trafic issu des assistants vocaux et de la recherche d’image, afin de comprendre les canaux multimodaux générant le trafic le plus qualitatif. Les métriques vocales doivent couvrir non seulement le volume mais aussi la qualité des conversions, car les chercheurs vocaux ont souvent des intentions et comportements différents des chercheurs textuels. Surveiller les mentions de marque dans les AI Overviews et autres résultats IA permet de comprendre comment votre marque est représentée dans ces nouveaux formats. Des audits réguliers des performances d’extraits optimisés, associés à l’analyse du trafic vocal, offrent une vision complète de votre visibilité et ROI en recherche multimodale.

La trajectoire de la recherche multimodale s’oriente vers des tendances IA de recherche toujours plus sophistiquées, brouillant les frontières entre recherche, navigation et accomplissement direct de tâches, les AI Overviews enregistrant déjà plus de 10 % d’augmentation d’usage à mesure que les utilisateurs adoptent les résumés générés par l’IA. Les nouvelles capacités incluent des systèmes IA agentique capables d’agir pour le compte des utilisateurs — réservation, achat, prise de rendez-vous — sur la base de requêtes multimodales combinant voix, image et contexte. La personnalisation deviendra ultra-fine, les IA comprenant non seulement les demandes mais aussi les préférences, la localisation, l’historique d’achat et les comportements pour fournir des résultats hyper-pertinents sur toutes les modalités. Les capacités de recherche en temps réel se développent, les utilisateurs pouvant interroger des événements en direct, conditions actuelles ou actualités avec l’attente de réponses immédiates et précises, synthétisées à partir de multiples sources. La recherche vidéo deviendra une modalité majeure, les IA comprenant non seulement les métadonnées mais aussi le contenu réel des vidéos, permettant de rechercher des moments, concepts ou informations spécifiques dans des vidéothèques. Le paysage concurrentiel favorisera de plus en plus les marques optimisées sur toutes les modalités, la visibilité dans un canal (extraits optimisés, image, voix) influençant directement les autres via des signaux de classement intermodaux.

À mesure que la recherche multimodale devient la norme, la surveillance IA évolue du simple suivi de classement vers le suivi complet de la citation de marque à travers la recherche d’image, les résultats vocaux et les overviews générés par l’IA. AmICited offre une visibilité essentielle sur la façon dont votre marque apparaît dans les AI Overviews, extraits optimisés et résultats vocaux — surveillant non seulement votre positionnement, mais aussi la manière dont votre marque est représentée et citée par les IA qui synthétisent l’information de multiples sources. La plateforme suit les citations d’image dans les résultats visuels, garantissant l’attribution correcte de votre contenu visuel et un lien retour vers votre domaine, protégeant ainsi votre autorité SEO et votre visibilité de marque. Les mentions vocales sont suivies à travers enceintes connectées et assistants vocaux, capturant la façon dont votre contenu est lu à haute voix et présenté dans des contextes voix-first où les métriques de clic traditionnelles sont inadaptées. Avec les résultats générés par l’IA représentant désormais une part significative des interactions utilisateurs, comprendre votre visibilité dans ces nouveaux formats devient critique : AmICited fournit l’infrastructure nécessaire pour surveiller, mesurer et optimiser votre présence sur tous les canaux de recherche multimodale. Pour les marques qui souhaitent conserver une visibilité concurrentielle à l’ère de la recherche pilotée par l’IA, une surveillance multimodale complète via des plateformes comme AmICited n’est plus optionnelle, mais essentielle pour comprendre et protéger votre présence numérique.

La recherche IA multimodale intègre plusieurs types de données — texte, images, voix et vidéo — dans une expérience de recherche unifiée. Les systèmes de recherche modernes exploitent désormais des modèles IA multimodaux capables d’analyser et de corréler simultanément des informations à travers différents formats, ce qui permet des résultats plus contextuels et précis qu’une recherche basée sur une seule modalité.

Optimisez les images en utilisant des visuels de haute qualité et originaux, avec des noms de fichiers descriptifs et des textes alternatifs complets. Mettez en place un balisage schéma, fournissez un texte contextuel autour, proposez plusieurs angles du même sujet et compressez les fichiers pour un chargement rapide. Ces pratiques assurent la visibilité aussi bien dans la recherche d’image traditionnelle que dans les systèmes IA multimodaux.

Les extraits optimisés sont la principale source de réponses pour la recherche vocale. Les assistants vocaux extraient des réponses concises et directes à partir des résultats position zéro sur les pages de résultats des moteurs de recherche. Optimiser votre contenu pour apparaître dans les extraits optimisés est essentiel pour la visibilité et le classement en recherche vocale.

Structurez le contenu avec des titres sous forme de questions qui répondent directement aux requêtes vocales fréquentes, suivis de réponses concises. Utilisez un langage naturel et conversationnel et implémentez un balisage de données structurées (schéma FAQ, schéma HowTo) pour aider les systèmes d’IA à comprendre le caractère conversationnel de votre contenu.

Les principaux modèles multimodaux incluent GPT-4o (OpenAI), Gemini (Google), Claude 3.7 (Anthropic), LLaVA (open source) et ImageBind (Meta). Chacun possède des capacités et des contextes de déploiement différents. Comprendre quels modèles alimentent vos plateformes de recherche cibles vous aide à optimiser efficacement votre contenu.

Suivez les impressions d’extraits optimisés dans Google Search Console, surveillez les métriques d’engagement mobile, analysez séparément le trafic de recherche vocale de la recherche organique traditionnelle et mesurez les taux de conversion issus des sources multimodales. Surveillez les mentions de marque dans les AI Overviews et observez comment votre contenu apparaît selon les différentes modalités.

AmICited surveille comment votre marque apparaît dans les AI Overviews, les extraits optimisés, les résultats de recherche d’image et les réponses de recherche vocale. À mesure que les résultats de recherche générés par l’IA deviennent dominants, une surveillance multimodale complète est essentielle pour comprendre et protéger votre présence numérique sur tous les canaux de recherche.

L’avenir inclut des systèmes IA de plus en plus sophistiqués, capables d’agir pour le compte des utilisateurs, des résultats hyper-personnalisés selon les préférences et comportements des utilisateurs, la recherche en temps réel pour les événements en direct et des capacités de recherche vidéo matures. Les marques optimisées sur toutes les modalités bénéficieront d’avantages concurrentiels.

Suivez comment votre marque apparaît dans les AI Overviews, les résultats de recherche d’images et les réponses de recherche vocale. Obtenez une visibilité en temps réel sur votre présence dans la recherche multimodale.

Découvrez comment les systèmes de recherche IA multimodale traitent ensemble texte, images, audio et vidéo pour fournir des résultats plus précis et contextuell...

Découvrez comment optimiser le texte, les images et la vidéo pour les systèmes d’IA multimodale. Découvrez des stratégies pour améliorer les citations IA et la ...

Découvrez ce qu'est le contenu multimodal pour l'IA, comment il fonctionne et pourquoi il est important. Explorez des exemples de systèmes d'IA multimodaux et l...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.