Définition de Google Gemini

Google Gemini est une famille de grands modèles de langage multimodaux (LLM) développée par Google DeepMind, représentant le successeur des modèles précédents tels que LaMDA et PaLM 2. Contrairement aux modèles de langage traditionnels qui ne traitent que le texte, Gemini est fondamentalement conçu pour gérer simultanément plusieurs modalités de données, notamment le texte, les images, l’audio, la vidéo et le code logiciel. Le modèle alimente le chatbot Gemini AI (anciennement appelé Bard) et est de plus en plus intégré dans l’ensemble de l’écosystème des produits et services Google. L’architecture multimodale de Gemini lui permet de comprendre des relations complexes entre différents types d’informations, ce qui le rend capable de réaliser des tâches allant de l’analyse d’images et de la génération de code à la traduction en temps réel et à la compréhension de documents. Le terme « Gemini » lui-même dérive du latin signifiant « jumeaux », faisant référence à la collaboration entre les équipes Google DeepMind et Google Brain, et a également été inspiré par le programme spatial Project Gemini de la NASA.

Contexte historique et chronologie du développement

Le parcours de Google vers la création de Gemini reflète des années de recherche fondamentale sur les grands modèles de langage et l’architecture des réseaux neuronaux. En 2017, les chercheurs de Google ont introduit l’architecture transformer, une avancée majeure en conception de réseaux neuronaux qui est devenue la base de la plupart des LLM modernes. L’entreprise a ensuite développé Meena (2020), une IA conversationnelle avec 2,6 milliards de paramètres, suivie de LaMDA (Language Model for Dialogue Applications) en 2021, spécialisée dans les tâches de dialogue. La sortie de PaLM (Pathways Language Model) en 2022 a apporté des capacités accrues en codage, multilinguisme et raisonnement. Google a ensuite lancé Bard début 2023, initialement alimenté par une version allégée de LaMDA, avant de l’upgrader vers PaLM 2 à la mi-2023. L’entreprise a officiellement annoncé Gemini 1.0 en décembre 2023, marquant une avancée majeure dans les capacités multimodales. En 2024, Google a renommé Bard en Gemini et lancé Gemini 1.5, introduisant une fenêtre de contexte révolutionnaire de 2 millions de tokens. Plus récemment, Gemini 2.0 et Gemini 2.5 (sortis en décembre 2024) ont introduit des capacités d’IA agentique, permettant au modèle de prendre des actions autonomes et de raisonner sur des contextes étendus. Cette évolution démontre l’engagement de Google à faire progresser les capacités de l’IA tout en gardant un focus sur des applications concrètes et réelles.

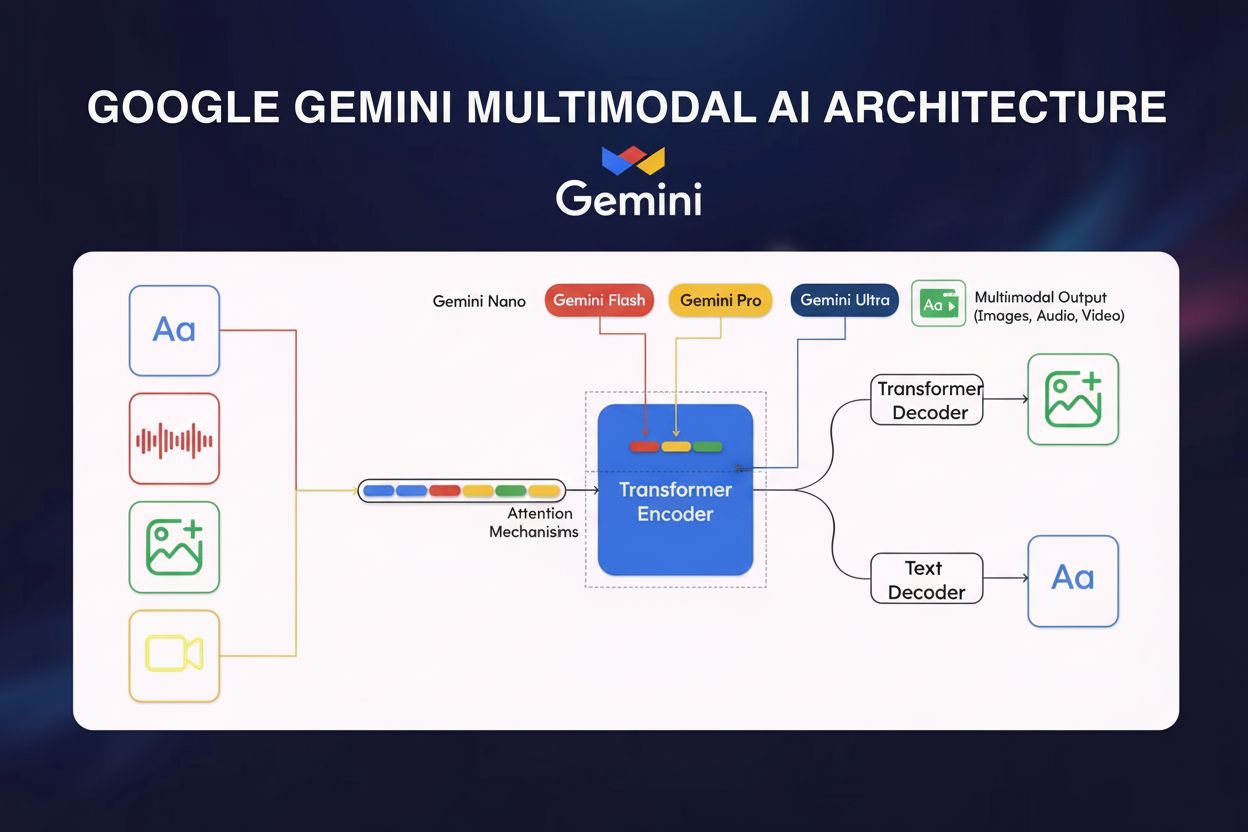

Architecture technique et composants clés

La base technique de Google Gemini repose sur plusieurs innovations architecturales sophistiquées qui le distinguent des modèles concurrents. Au cœur de Gemini se trouve une architecture de réseau neuronal basée sur le transformer optimisée avec des Cloud TPU v5p (Tensor Processing Units) pour un entraînement et une inférence hautes performances. L’encodeur multimodal du modèle intègre les données visuelles, vocales et textuelles via des chemins de traitement spécialisés qui convergent dans un espace de représentation unifié. Une innovation clé est le mécanisme d’attention intermodale, qui permet au modèle d’établir des liens significatifs entre différents types de données—par exemple, relier des éléments visuels d’une image à des descriptions textuelles ou comprendre le lien entre un contenu audio et un contexte visuel. Gemini 1.5 Pro a introduit l’architecture Mixture of Experts (MoE), qui représente un changement de paradigme en matière d’efficacité des modèles. Plutôt que d’activer tous les paramètres du réseau neuronal pour chaque entrée, MoE divise le modèle en réseaux experts plus petits, chacun spécialisé dans des domaines ou types de données particuliers. Le modèle apprend à activer sélectivement uniquement les experts les plus pertinents en fonction des caractéristiques de l’entrée, réduisant considérablement la charge de calcul tout en maintenant ou en améliorant les performances. Cette architecture permet à Gemini 1.5 Flash d’atteindre une performance comparable à Gemini 1.0 Ultra tout en étant nettement plus efficace, grâce à la distillation des connaissances—une technique d’apprentissage automatique où les connaissances du modèle Pro plus grand sont transférées à la variante Flash plus compacte. La fenêtre de contexte—le nombre de tokens qu’un modèle peut traiter simultanément—a considérablement augmenté : de 32 000 tokens avec Gemini 1.0 à 1 million avec Gemini 1.5 Flash et 2 millions avec Gemini 1.5 Pro, permettant de traiter des livres entiers, de longs contenus vidéo ou des milliers de lignes de code en une seule interaction.

Variantes du modèle Gemini et leurs applications

| Variante du modèle | Taille/Niveau | Fenêtre de contexte | Cas d’usage principaux | Déploiement | Avantage clé |

|---|

| Gemini 1.0 Nano | La plus petite | 32 000 tokens | Tâches mobiles, traitement embarqué, description d’images, réponses de chat | Appareils Android (Pixel 8 Pro+), Chrome desktop | Fonctionne sans connexion internet |

| Gemini 1.0 Ultra | La plus grande | 32 000 tokens | Raisonnement complexe, codage avancé, analyse mathématique, raisonnement multimodal | Cloud, entreprise | Précision maximale sur les benchmarks |

| Gemini 1.5 Pro | Taille moyenne | 2 millions de tokens | Analyse de documents, dépôts de code, contenus longs, applications professionnelles | Google Cloud, accès API | Plus grande fenêtre de contexte, performance équilibrée |

| Gemini 1.5 Flash | Léger | 1 million de tokens | Réponses rapides, traitement économique, applications temps réel | Cloud, mobile, edge | Optimisé pour la rapidité et l’efficacité |

| Gemini 2.0/2.5 | Nouvelle génération | Variable | IA agentique, exécution autonome de tâches, raisonnement avancé, interactions temps réel | Cloud, services intégrés | Capacités agentiques, raisonnement amélioré |

Traitement multimodal et compréhension intermodale

La nature multimodale de Google Gemini représente une rupture fondamentale avec les premiers modèles d’IA qui fonctionnaient principalement dans une seule modalité. La capacité de Gemini à traiter des séquences entremêlées d’audio, d’image, de texte et de vidéo en entrée comme en sortie permet des tâches de raisonnement sophistiquées, impossibles pour les modèles monomodaux. Par exemple, Gemini peut analyser une vidéo, extraire le texte des images, comprendre les dialogues oraux et générer des résumés complets synthétisant l’information de toutes les modalités. Cette capacité a des implications concrètes : en diagnostic médical, Gemini peut analyser simultanément les dossiers patients (texte), les imageries médicales (visuel) et les entretiens (audio) pour fournir des évaluations globales. En service client, il peut traiter les demandes (texte), analyser des images de produits, examiner des démonstrations vidéo et générer des réponses adaptées au contexte. Le mécanisme d’attention intermodale à la base de cette intégration crée des représentations partagées où l’information de chaque modalité influence le traitement de l’autre. Lorsqu’il analyse une image accompagnée de texte, par exemple, le contexte textuel aide le traitement visuel à se concentrer sur les zones pertinentes de l’image, tandis que l’information visuelle aide à lever les ambiguïtés du texte. Cette influence bidirectionnelle permet une compréhension plus globale que le traitement indépendant des modalités. Les implications pratiques pour le monitoring de l’IA et le suivi de marque sont majeures : lorsque Gemini génère des réponses comprenant images, texte et potentiellement audio, les systèmes de surveillance doivent suivre l’apparition des marques dans toutes ces modalités, et pas uniquement dans les réponses textuelles.

Google Gemini Ultra a montré des performances exceptionnelles sur de nombreux benchmarks d’IA standardisés, s’imposant comme un modèle très performant dans le paysage concurrentiel des grands modèles de langage. Sur le benchmark MMLU (Massive Multitask Language Understanding), qui teste la compréhension du langage sur 57 sujets, Gemini Ultra a surpassé les experts humains—un jalon important dans l’IA. Pour le raisonnement mathématique (benchmark GSM8K), Gemini Ultra a dépassé les modèles concurrents, dont Claude 2, GPT-4 et Llama 2. En génération de code (HumanEval), Gemini a démontré des capacités supérieures, permettant une assistance avancée au développement et à l’analyse de code. Toutefois, la performance varie selon les métriques : si Gemini Ultra excelle en compréhension documentaire, d’image et en reconnaissance vocale automatique, il montre des améliorations plus modestes en raisonnement de bon sens (benchmark HellaSwag), où GPT-4 reste en tête. La série Gemini 1.5 s’est révélée particulièrement impressionnante, les variantes Flash et Pro égalant ou dépassant Gemini 1.0 Ultra tout en offrant une efficacité supérieure et des fenêtres de contexte élargies. Cette dynamique est cruciale pour le monitoring des citations IA : à mesure que Gemini progresse et que sa base d’utilisateurs atteint 350 millions d’actifs mensuels, l’exactitude et la richesse de ses réponses influencent directement la représentation des marques et domaines dans les contenus IA. Les organisations utilisant des plateformes comme AmICited peuvent vérifier si les réponses de Gemini sur leur marque sont factuellement correctes et bien contextualisées.

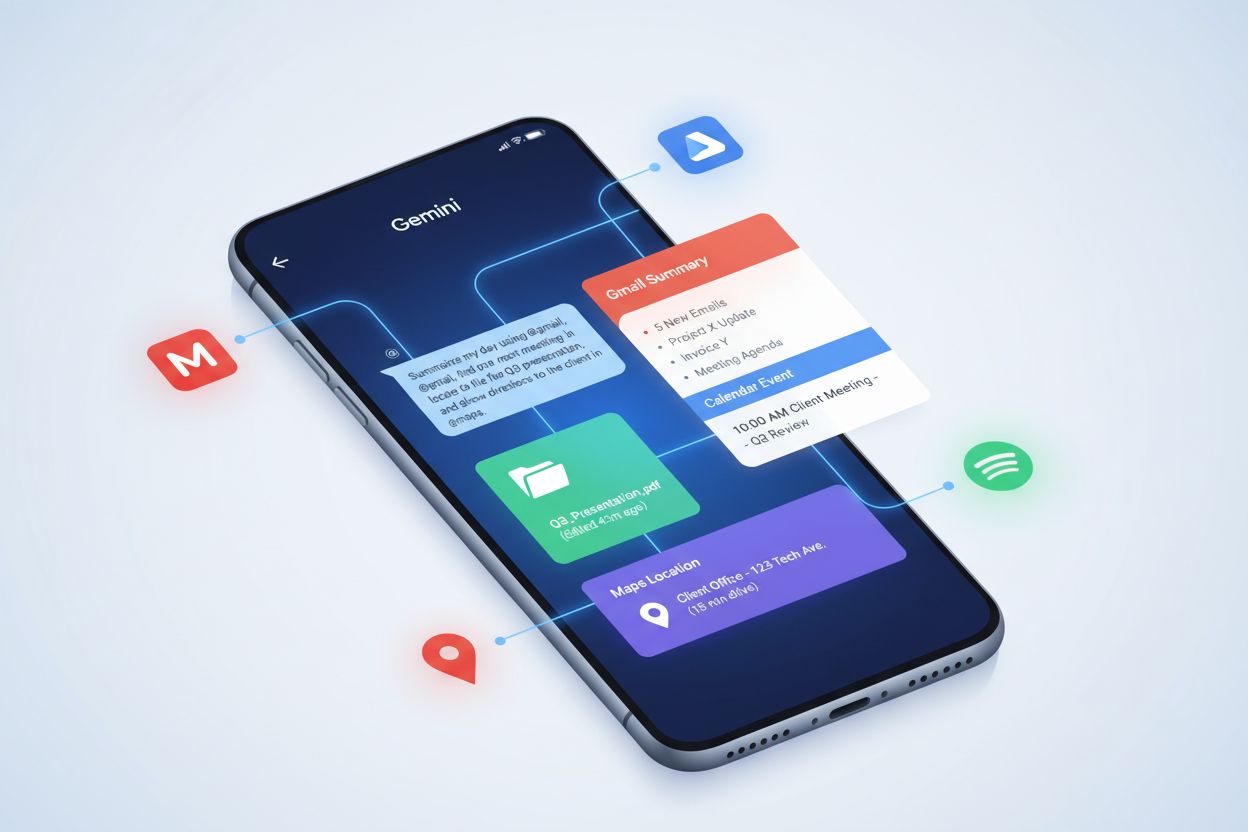

Intégration dans l’écosystème de Google

L’intégration stratégique de Google Gemini dans tout l’écosystème de produits Google constitue l’un des déploiements les plus complets d’un modèle d’IA chez un géant technologique. Gemini est désormais l’assistant IA par défaut sur les smartphones Google Pixel 9 et Pixel 9 Pro, remplaçant l’ancien Assistant Google, ce qui en fait l’interface IA principale pour des millions d’utilisateurs. Dans Google Workspace, Gemini apparaît dans le panneau latéral de Docs pour assister à la rédaction, dans Gmail pour la rédaction de messages et la suggestion de réponses, et dans d’autres applications de productivité. Google Maps exploite Gemini pour fournir des résumés intelligents de lieux et d’endroits, enrichissant l’expérience utilisateur. Google Search a intégré Gemini via les AI Overviews, générant des réponses complètes aux requêtes en synthétisant de multiples sources. L’API Gemini est disponible via Google AI Studio et Google Cloud Vertex AI, permettant aux développeurs d’intégrer les capacités de Gemini dans leurs applications. Cette intégration a des implications majeures pour le monitoring de marque et le suivi des citations IA. Lorsqu’un utilisateur recherche des informations sur une entreprise ou un produit dans Google Search, Gemini peut générer une AI Overview qui inclut ou non la marque. En utilisant Gmail avec Gemini, le modèle peut référencer des informations d’entreprise dans les suggestions. Lorsqu’un développeur crée une application avec l’API Gemini, il crée de nouveaux points de contact où la marque peut apparaître dans des contenus IA. Cette intégration généralisée rend indispensable un monitoring complet pour préserver l’intégrité de la marque et l’exactitude de sa représentation dans les réponses IA.

Capacités clés et cas d’usage

- Génération et analyse avancées de code : Gemini comprend, explique et génère du code dans plusieurs langages (C++, Java, Python, etc.), avec des versions spécialisées alimentant AlphaCode2 pour la programmation compétitive

- Compréhension image et texte : Extraire du texte d’images sans outils OCR, légender des images, analyser graphiques et diagrammes, réaliser des tâches de raisonnement visuel complexes

- Traduction multilingue : Utiliser les capacités multimodales pour traduire en temps réel, intégré à des services comme Google Meet avec sous-titres traduits

- Analyse de malwares : Gemini 1.5 Pro et Flash peuvent analyser des extraits de code et des fichiers pour détecter des maliciels et générer des rapports de sécurité détaillés

- Experts IA personnalisés (Gems) : Créer des assistants IA adaptés à des tâches ou sujets spécifiques, avec des options prédéfinies comme coach d’apprentissage, partenaire de brainstorming ou éditeur de texte

- Agents IA universels : Avec Project Astra, Gemini traite, mémorise et comprend des informations multimodales en temps réel, permettant des assistants capables d’expliquer des objets, de reconnaître des lieux, de se souvenir d’interactions précédentes

- Conversations vocales : Gemini Live permet un dialogue naturel, s’adaptant au style et aux préférences de chacun

- Recherche approfondie : Analyser des centaines de sites, synthétiser les résultats et générer des rapports complets sur des sujets complexes

Le rôle de Gemini dans le monitoring de l’IA et la représentation de marque

L’émergence de Google Gemini comme plate-forme IA majeure avec 350 millions d’utilisateurs actifs mensuels crée de nouveaux impératifs pour le monitoring de marque et le suivi des citations IA. Contrairement aux moteurs de recherche classiques où les marques apparaissent dans des listes classées, Gemini génère des réponses synthétiques pouvant mentionner ou non des entreprises, produits ou domaines spécifiques. Lorsqu’un utilisateur interroge Gemini sur une industrie ou un sujet, le modèle choisit quelles sources référencer, quelles informations mettre en avant et comment contextualiser les mentions de marque. Cela marque un basculement par rapport au SEO traditionnel, où la visibilité dépend du classement, vers ce que l’on peut appeler « l’optimisation des citations IA »—s’assurer que les marques apparaissent fidèlement et de façon appropriée dans les réponses IA. La nature multimodale de Gemini complexifie le suivi : les marques peuvent apparaître non seulement dans le texte, mais aussi dans les images, les transcriptions audio ou les références vidéo générées par Gemini. L’intégration de Gemini dans tout l’écosystème Google signifie que les mentions de marque peuvent survenir dans divers contextes : AI Overviews dans Google Search, suggestions Gmail, résumés Maps, applications personnalisées via l’API Gemini. Les organisations doivent comprendre comment Gemini présente leur marque dans ces contextes et si l’information est exacte, complète et contextualisée. Des plateformes comme AmICited répondent à ce besoin en surveillant l’apparition des marques dans les réponses Gemini aux côtés d’autres IA majeures comme ChatGPT, Perplexity, Claude et Google AI Overviews, offrant une visibilité exhaustive sur la représentation de marque générée par l’IA.

Risques, limitations et considérations éthiques

Malgré ses performances impressionnantes, Google Gemini fait face à plusieurs défis documentés importants pour les organisations qui se fient à ses résultats. Le biais de l’IA est apparu comme un problème en février 2024 lorsque Google a suspendu la génération d’images de Gemini en raison de représentations biaisées et inexactes de personnages historiques, le modèle effaçant le contexte historique autour de la diversité raciale. Cet incident a mis en lumière la façon dont les IA multimodales peuvent perpétuer ou amplifier les biais présents dans leurs données d’entraînement. Les hallucinations—génération d’informations factuellement erronées—affectent toujours Gemini, notamment dans les AI Overviews où les utilisateurs peuvent accorder une confiance excessive à l’information générée. Google a reconnu des problèmes persistants de résultats erronés ou trompeurs produits par Gemini dans la recherche. Les violations de la propriété intellectuelle constituent une autre préoccupation : Google a été sanctionné en France (250 millions d’euros) pour avoir entraîné Gemini sur des contenus d’actualités protégés sans l’accord des éditeurs, soulevant la question de la provenance des données et du fair use. Ces limitations impactent directement le monitoring de marque : les organisations ne peuvent présumer de l’exactitude des informations diffusées par Gemini sur les concurrents ou leur secteur, et doivent vérifier comment leur propre marque est représentée. Le risque que Gemini produise des informations trompeuses sur les produits, l’histoire ou la position marché d’une entreprise crée de nouveaux enjeux que le monitoring des moteurs classiques ne permet pas d’anticiper. De plus, la tendance du modèle à synthétiser l’information de multiples sources sans toujours attribuer clairement les allégations signifie que les mentions de marque dans Gemini peuvent manquer de contexte ou de source.

Évolution future et perspectives stratégiques

La trajectoire de Google Gemini laisse présager une expansion continue de ses capacités, de son efficacité et de son intégration dans l’écosystème Google et au-delà. Gemini 2.0 et 2.5 ont introduit des capacités d’IA agentique, permettant au modèle de prendre des initiatives, planifier des tâches complexes et raisonner sur de longs contextes—une évolution majeure par rapport aux versions précédentes qui se contentaient de répondre aux requêtes. Les futures versions devraient affiner encore le raisonnement, gérer des contextes encore plus vastes et améliorer les performances sur des tâches spécialisées. Project Astra, l’initiative de Google pour créer des agents IA universels, incarne la vision long terme de Gemini : des IA capables de traiter, mémoriser et comprendre des informations multimodales en temps réel pour des interactions naturelles et performantes. Project Mariner et d’autres travaux suggèrent que Google explore comment Gemini peut assister la recherche, l’analyse et l’aide à la décision, jusqu’à automatiser des tâches de connaissance complexes. L’intégration de Gemini dans toujours plus de produits Google va probablement se poursuivre, multipliant les points de contact où les marques apparaîtront dans les contenus IA. Les progrès sur l’efficacité embarquée rendront Gemini plus accessible sur mobile et edge, augmentant potentiellement sa base d’utilisateurs bien au-delà des 350 millions actuels. Le paysage concurrentiel influencera aussi l’évolution de Gemini : alors que ChatGPT, Claude ou Perplexity progressent, Google devra maintenir ses avantages sur le multimodal, l’intégration aux services Google et l’accès temps réel à la connaissance. Pour les organisations focalisées sur le monitoring IA et la représentation de marque, cette évolution signifie que le suivi de la marque dans les réponses Gemini sera de plus en plus crucial à mesure que la plateforme se développe. Le tournant agentique soulève aussi de nouvelles questions sur la façon dont des IA autonomes représenteront et citeront les marques lorsqu’elles prendront des décisions ou agiront pour le compte des utilisateurs.

Conclusion : l’impact de Gemini sur le monitoring de marque piloté par l’IA

Google Gemini représente un changement fondamental dans la façon dont les systèmes d’IA traitent l’information et génèrent des réponses, avec de profondes implications pour le monitoring de marque et le suivi des citations IA. Modèle IA multimodal avec 350 millions d’utilisateurs actifs mensuels, intégré dans l’écosystème Google et évoluant vers des systèmes agentiques toujours plus puissants, Gemini est devenu une plateforme centrale à surveiller pour les organisations. Contrairement aux moteurs de recherche classiques où la visibilité dépend du classement, les réponses synthétiques de Gemini créent de nouvelles dynamiques où les marques peuvent être mentionnées—ou non—et sont susceptibles d’être représentées avec plus ou moins de fidélité. Les limitations documentées du modèle—biais, hallucinations, questions de propriété intellectuelle—soulignent l’importance d’un monitoring actif plutôt que d’une confiance passive dans l’information IA. Les organisations souhaitant préserver l’intégrité de leur marque et garantir une représentation fidèle dans les réponses IA doivent adopter des stratégies de suivi exhaustives pour surveiller l’apparition de leur marque sur Gemini et les autres grandes plateformes IA. Il s’agit d’une nouvelle frontière du marketing digital et de la gestion de marque, où le succès ne dépend plus seulement du SEO traditionnel et de la visibilité dans la recherche, mais aussi de la compréhension et de l’optimisation de la façon dont les systèmes IA présentent et citent les marques dans leurs réponses générées.