AI Content Governance

Ontdek alles over AI content governance - de beleidslijnen, processen en raamwerken die organisaties gebruiken om contentstrategie op AI-platforms te beheren me...

Leer hoe u effectieve AI content governance beleidsregels implementeert met zichtbaarheid frameworks. Ontdek wettelijke vereisten, best practices en tools voor verantwoord beheer van AI-systemen.

AI-zichtbaarheid verwijst naar het alomvattende vermogen om te observeren, te volgen en te begrijpen hoe kunstmatige intelligentiesystemen functioneren binnen jouw contentecosysteem. In content governance vormt zichtbaarheid de fundamentele laag waarmee organisaties controle kunnen behouden, compliance kunnen waarborgen en risico’s kunnen beperken die samenhangen met AI-gegenereerde en AI-verwerkte content. Zonder duidelijke zichtbaarheid in AI-systemen opereert een organisatie blind—niet in staat om vooringenomenheid te detecteren, naleving van regelgeving te waarborgen of te reageren op opkomende bedreigingen. Zichtbaarheid-gedreven governance transformeert reactief crisismanagement naar proactieve risicopreventie, waardoor teams weloverwogen beslissingen kunnen nemen over contentkwaliteit, authenticiteit en afstemming met de organisatiewaarden.

De meeste organisaties kampen met een cruciale governancekloof tussen hun snelheid van AI-adoptie en hun vermogen om deze systemen effectief te besturen. Uit onderzoek blijkt dat 63% van de organisaties geen formeel AI-governanceprogramma heeft, waardoor zij kwetsbaar zijn voor compliance-overtredingen, reputatieschade en operationele fouten. Deze kloof wordt groter naarmate AI-systemen geavanceerder worden en dieper geïntegreerd raken in de kernprocessen van het bedrijf, waardoor zichtbaarheid steeds moeilijker te realiseren is zonder specifieke kaders en tools. De gevolgen reiken verder dan boetes—organisaties zonder zichtbaarheid worstelen met het behouden van contentkwaliteit, het detecteren van schadelijke uitkomsten en het aantonen van verantwoording aan stakeholders. Het dichten van deze kloof vraagt om gerichte investeringen in zichtbaarheidmechanismen die realtime inzicht bieden in AI-gedrag en contentresultaten.

| Aspect | Reactieve Governance | Proactieve Governance |

|---|---|---|

| Ontdekking | Problemen geïdentificeerd na publieke blootstelling | Continue monitoring detecteert vroegtijdig problemen |

| Reactie | Crisismanagement en schadebeperking | Preventief handelen en risicobeheersing |

| Compliance | Correcties en boetes na audits | Doorlopende compliance-verificatie |

| Risico | Hoge blootstelling aan onbekende bedreigingen | Systematische risico-identificatie en -beheer |

Effectief AI-content governance beleid rust op zes fundamentele principes die besluitvorming en operationele praktijken binnen jouw organisatie sturen. Deze principes vormen een samenhangend kader dat innovatie en verantwoordelijkheid in balans houdt, zodat AI-systemen organisatiedoelen dienen en tegelijkertijd stakeholders beschermen. Door deze principes in beleid te verankeren, stel je duidelijke verwachtingen vast voor het functioneren van AI-systemen en het beheer ervan door teams. De principes werken samen—transparantie maakt verantwoording mogelijk, menselijk toezicht waarborgt eerlijkheid en privacybescherming bouwt vertrouwen op. Organisaties die deze principes consequent operationaliseren, presteren beter op het gebied van compliance, stakeholdervertrouwen en duurzaamheid op de lange termijn.

Het regelgevend landschap voor AI-governance heeft zich in hoog tempo ontwikkeld, met meerdere kaders die nu verplichte eisen stellen aan organisaties die AI-systemen implementeren. De EU AI Act is het meest uitgebreide regelgevende kader, dat AI-systemen classificeert op risiconiveau en strikte eisen oplegt aan toepassingen met hoog risico, zoals contentmoderatie en -generatie. Het NIST AI Risk Management Framework biedt een flexibel, niet-voorschrijvend raamwerk waarmee organisaties AI-risico’s kunnen identificeren, meten en beheren in hun gehele operatie. ISO 42001 stelt internationale normen voor AI-managementsystemen vast en biedt organisaties een gestructureerde methodiek voor het implementeren van governance in de hele organisatie. Daarnaast creëren Executive Orders in de Verenigde Staten en opkomende regionale wetgeving een lappendeken van eisen waar organisaties doorheen moeten navigeren. Deze kaders komen samen op gemeenschappelijke thema’s: transparantie, verantwoording, menselijk toezicht en doorlopende monitoring—waarbij zichtbaarheid de kritische sleutel tot compliance vormt.

Het opzetten van een robuust beleidskader vereist een systematische beoordeling van je huidige AI-systemen, contentstromen en risicoprofiel. Begin met een uitgebreide AI-inventarisatie waarin elk systeem dat content genereert, verwerkt of verspreidt wordt vastgelegd, inclusief het doel, de gegevensinvoer en de potentiële impact op stakeholders. Stel vervolgens governancetiers vast die verschillende toezichtsniveaus toewijzen op basis van risico—systemen met hoog risico zoals contentmoderatie vragen om intensief toezicht, terwijl toepassingen met lager risico met lichtere governance kunnen volstaan. Ontwikkel heldere beleidsregels die specificeren hoe elk systeem moet opereren, welke uitkomsten acceptabel zijn en hoe teams op problemen moeten reageren. Creëer verantwoordingsstructuren die eigenaarschap voor naleving vastleggen en escalatieprocedures voor governancekwesties inrichten. Implementeer tenslotte meetinstrumenten die naleving van het beleid volgen en data opleveren voor continue verbetering van je governance-aanpak.

AI-zichtbaarheid realiseren vraagt om de inzet van gespecialiseerde tools en beoordelingsmechanismen die realtime inzicht geven in systeemgedrag en contentuitkomsten. Monitoringsdashboards verzamelen data van AI-systemen, contentplatforms en compliance-systemen in één overzicht, zodat problemen snel worden opgespoord. Audit trails leggen gedetailleerde verslagen vast van AI-beslissingen, contentwijzigingen en governanceacties, waardoor verantwoording ontstaat en ondersteuning bij onderzoeken wordt geboden. Beoordelingskaders evalueren AI-systemen systematisch aan de hand van de governanceprincipes en signaleren hiaten en verbeterkansen voordat problemen escaleren. Geautomatiseerde detectiesystemen markeren mogelijk problematische content, bevooroordeelde uitkomsten of beleidschendingen, waardoor minder handmatige controles nodig zijn en de consistentie toeneemt. Organisaties die investeren in uitgebreide zichtbaarheidstools behalen concurrentievoordelen in compliance, stakeholdervertrouwen en operationele efficiëntie.

Continue monitoring verandert governance van een periodieke compliance-inspanning in een doorlopende operationele discipline die realtime problemen opspoort en aanpakt. Stel monitoringsprotocollen op die bepalen welke meetwaarden het belangrijkst zijn voor elk AI-systeem—nauwkeurigheidspercentages, bias-indicatoren, contentkwaliteitsscores en frequentie van beleidschendingen. Implementeer geautomatiseerde waarschuwingssystemen die relevante teams notificeren wanneer metrics buiten acceptabele grenzen vallen, zodat snel onderzoek en reactie mogelijk is. Creëer feedbackloops die monitoringdata koppelen aan systeemverbetering, zodat teams AI-modellen en governanceprocessen kunnen verfijnen op basis van de geobserveerde prestaties. Plan reguliere compliance-evaluaties in om te beoordelen of de monitoringsystemen zelf effectief blijven en of governancebeleid moet worden aangepast op basis van nieuwe risico’s of regelgeving. Organisaties die continue monitoring integreren in hun operatie lossen problemen sneller op, maken minder kosten voor compliance en genieten sterker vertrouwen van stakeholders.

Effectieve AI-content governance vereist gecoördineerde inzet van verschillende organisatorische functies, die elk cruciale expertise en perspectief inbrengen bij governancebeslissingen. Legal en compliance teams zorgen dat beleid aansluit bij wettelijke eisen en beheren externe relaties met toezichthouders. Technische teams implementeren monitoringsystemen, onderhouden audit trails en optimaliseren AI-prestaties binnen governancekaders. Content- en redactionele teams passen governancebeleid daadwerkelijk toe en nemen dagelijks beslissingen over contentkwaliteit en geschiktheid. Risico- en ethische teams beoordelen opkomende bedreigingen, signaleren potentiële schade en adviseren beleidsaanpassingen om nieuwe uitdagingen het hoofd te bieden. Executive leadership stelt middelen beschikbaar, bepaalt prioriteiten en toont betrokkenheid bij governance door hun beslissingen en communicatie. Organisaties die deze functies afstemmen op gedeelde governance-doelstellingen behalen betere resultaten dan organisaties waar governance binnen één afdeling blijft.

AI content governance is het geheel aan beleidsregels, processen en controles die ervoor zorgen dat AI-gegenereerde en AI-verwerkte content betrouwbaar, compliant en in lijn met de organisatiewaarden blijft. Het omvat alles van contentcreatie en validatie tot monitoring en incidentrespons.

Zichtbaarheid stelt organisaties in staat om te begrijpen waar AI-systemen actief zijn, hoe ze presteren en welke risico's ze creëren. Zonder zichtbaarheid wordt governance reactief en ineffectief. Zichtbaarheid transformeert governance van crisismanagement naar proactieve risicopreventie.

Belangrijke kaders zijn onder andere de EU AI Act (juridisch bindende risicogebaseerde classificatie), NIST AI Risk Management Framework (flexibele richtlijnen), ISO 42001 (internationale normen) en diverse Executive Orders en regionale wetgeving. Elk kader benadrukt transparantie, verantwoording en menselijk toezicht.

Gebruik gestructureerde beoordelingskaders die aansluiten bij erkende normen zoals NIST AI RMF of ISO 42001. Evalueer bestaande controles aan de hand van de frameworkeisen, identificeer hiaten en stel doelvolwassenheidsniveaus vast. Regelmatige beoordelingen geven inzicht in systemische zwaktes en verbeterkansen.

Effectieve beleidsregels moeten acceptabele gebruikstoepassingen, regels voor gegevensbronnen, documentatievereisten, procedures voor menselijk toezicht, monitoringsmechanismen en escalatieprocedures omvatten. Beleidsregels moeten operationeel worden gemaakt via tools en workflows die teams daadwerkelijk gebruiken in hun dagelijkse werk.

Governance moet continu worden gemonitord met regelmatige formele evaluaties, minstens elk kwartaal. Real-time monitoring detecteert direct problemen, terwijl periodieke evaluaties beoordelen of de governance-kaders effectief blijven en of beleidsregels moeten worden bijgewerkt op basis van nieuwe risico's of wetgeving.

Effectieve tools zijn onder andere monitoringsdashboards voor realtime statistieken, audit trails voor verantwoording, beoordelingskaders voor controle-evaluatie, geautomatiseerde detectiesystemen voor beleidschendingen en platforms voor risicokwantificatie. Deze tools moeten geïntegreerd zijn binnen uw technologiestack.

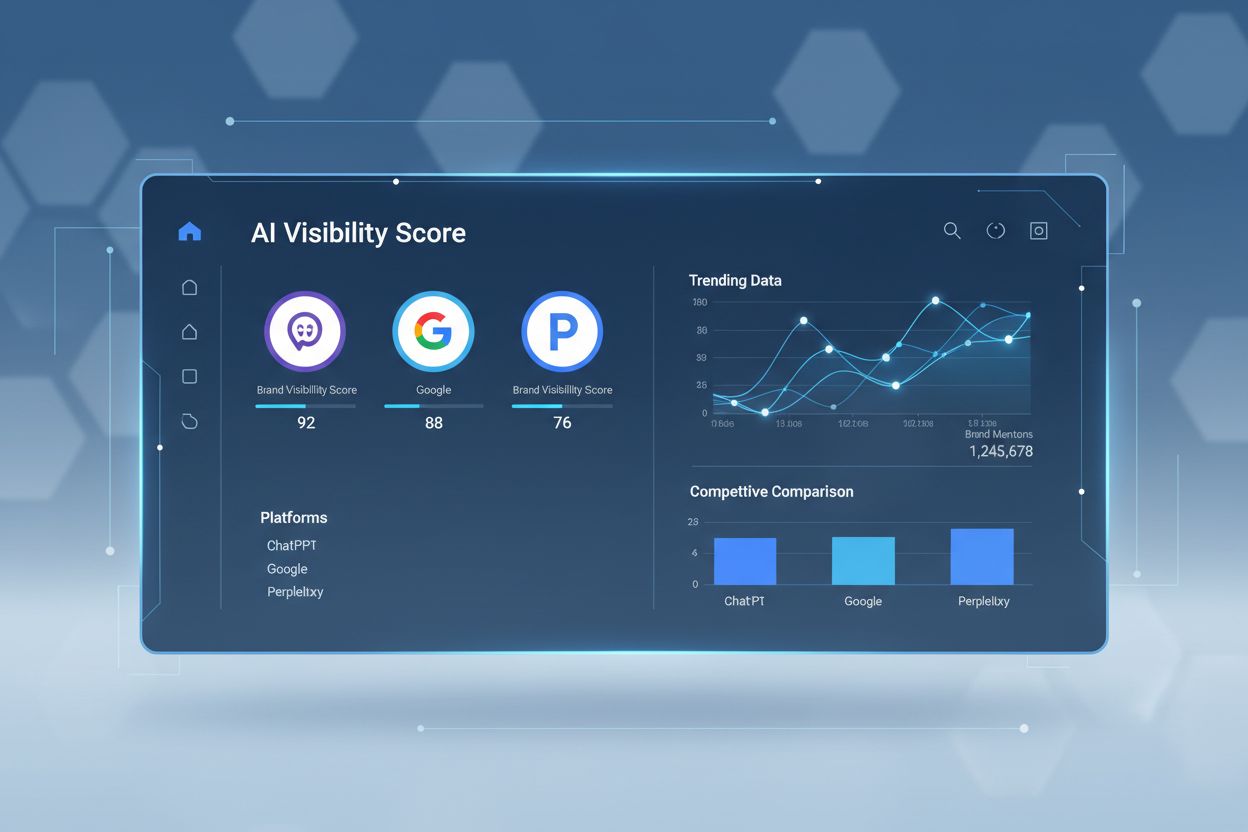

AmICited monitort hoe AI-systemen en LLM's jouw merk noemen in GPT's, Perplexity en Google AI Overviews. Dit geeft inzicht in je AI-aanwezigheid, helpt je te begrijpen hoe jouw content wordt gebruikt door AI-systemen en stelt je in staat jouw merkreputatie te beschermen in het AI-gedreven contentecosysteem.

AmICited volgt hoe AI-systemen en LLM's jouw content citeren in GPT's, Perplexity en Google AI Overviews. Krijg inzicht in je AI-aanwezigheid en bescherm je merkreputatie.

Ontdek alles over AI content governance - de beleidslijnen, processen en raamwerken die organisaties gebruiken om contentstrategie op AI-platforms te beheren me...

Leer hoe je AI-zichtbaarheid contentgaten identificeert en sluit over ChatGPT, Perplexity en Google AI Overzichten. Ontdek analysemethoden en tools om de AI-zoe...

Beheers de Semrush AI Visibility Toolkit met onze uitgebreide gids. Leer hoe je merkzichtbaarheid in AI-zoekopdrachten monitort, concurrenten analyseert en opti...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.