De Rol van Wikipedia in AI-Verwijzingen: Hoe Het AI-Antwoorden Vormgeeft

Ontdek hoe Wikipedia AI-verwijzingen beïnvloedt in ChatGPT, Perplexity en Google AI. Leer waarom Wikipedia de meest vertrouwde bron is voor AI-training en hoe d...

Leer hoe je je merk op ethische wijze op Wikipedia laat citeren voor maximale AI-zichtbaarheid. Strategische gids met beleid, betrouwbare bronnen en citatiestrategieën voor ChatGPT, Perplexity en Google AI.

Wikipedia is de onzichtbare ruggengraat van kunstmatige intelligentie geworden en bepaalt hoe AI-systemen informatie over merken, sectoren en onderwerpen begrijpen en presenteren. Met 7,8% van de ChatGPT-citaties afkomstig van Wikipedia en 84% van de AI-antwoorden over zakelijke onderwerpen die Wikipedia citeren, is de invloed van het platform op AI-zichtbaarheid onmiskenbaar. Elk groot taalmodel—van GPT-4 tot Claude tot Gemini—werd getraind op de uitgebreide Wikipedia-database, waardoor het een fundamentele bron is voor hoe AI-systemen kennis genereren. De inzet is nog hoger als je bedenkt dat 89% van de tijd Wikipedia-citaties als eerste in AI-antwoorden verschijnen, wat betekent dat de aanwezigheid van je merk op Wikipedia direct bepaalt hoe AI je introduceert bij potentiële klanten. Voor moderne merken die AI-zichtbaarheid nastreven, is Wikipedia geen optie—het is essentiële infrastructuur.

AI-systemen geven Wikipedia om een fundamentele reden prioriteit: het is gebouwd op principes die aansluiten bij hoe machine learning-modellen betrouwbaarheid beoordelen. Daarom onderscheidt Wikipedia zich:

Neutral Point of View (NPOV)-eis: Het strikte NPOV-beleid van Wikipedia zorgt ervoor dat artikelen informatie presenteren zonder vooringenomenheid of promotionele taal, waardoor de inhoud van nature betrouwbaarder is voor AI-training en citatiedoeleinden.

Community-gedreven factchecking: Elke bewering op Wikipedia wordt gecontroleerd door duizenden redacteuren wereldwijd, wat een continu peer-reviewproces creëert dat fouten en desinformatie sneller opspoort dan traditionele publicaties.

Gestructureerd citatiesysteem: Wikipedia vereist inline citaties met specifieke formatteerstandaarden, waardoor AI-systemen beweringen kunnen herleiden tot de oorspronkelijke bron en informatie kunnen verifiëren via het citatienetwerk.

Betrouwbaarheidsnormen: Wikipedia hanteert strikte richtlijnen over welke bronnen als betrouwbaar gelden en filtert automatisch inhoud van lage kwaliteit of promotionele aard, die AI-systemen anders moeilijk kunnen beoordelen.

Niet alle citaties zijn gelijk in de ogen van AI-systemen. De volgende vergelijking laat zien waarom Wikipedia-citaties een buitengewoon gewicht hebben in AI-training en -antwoordgeneratie:

| Brontype | Betrouwbaarheidsscore | Gebruik voor AI-training | Verifieerbaarheid | Permanentie |

|---|---|---|---|---|

| Wikipedia | Zeer hoog | Uitgebreid | Volledig herleidbare citaties | Permanent met bewerkingsgeschiedenis |

| Persberichten | Laag-middel | Beperkt | Vaak eigen bron | Vaak verwijderd/gearchiveerd |

| Bedrijfswebsite | Middel | Minimaal | Circulair brongebruik | Kan worden verwijderd |

| Sociale media | Laag | Zelden | Moeilijk te verifiëren | Vergankelijk |

Wikipedia-citaties fungeren als een geloofwaardigheidsvermenigvuldiger omdat ze al meerdere verificatiepoorten hebben gepasseerd voordat ze gepubliceerd worden. Wanneer een AI-systeem een Wikipedia-citatie tegenkomt, herkent het dat de informatie is gecontroleerd door menselijke redacteuren, is gekruist met betrouwbare bronnen en belangrijk genoeg is bevonden om in een wereldwijde kennisbank te worden opgenomen. Dit is fundamenteel anders dan een persbericht, dat door AI-systemen wordt gezien als promotioneel materiaal, of een bedrijfswebsite, die geen onafhankelijke verificatie kent. Ook de permanentie speelt mee: Wikipedia-artikelen hebben een volledige bewerkingsgeschiedenis, waardoor AI-systemen kunnen volgen hoe informatie zich heeft ontwikkeld en is gecorrigeerd. Persberichten verdwijnen daarentegen vaak van het web of worden gearchiveerd op een manier die ze ontoegankelijk maakt voor AI-crawlers. Voor merken die AI-citaties nastreven is de boodschap duidelijk: Wikipedia-citaties zijn de gouden standaard omdat ze betrouwbaarheid, verifieerbaarheid en permanentie combineren op een manier die andere bronnen niet kunnen evenaren.

Om op ethische wijze een Wikipedia-citatie te verdienen, moet je de vier fundamentele beleidsregels begrijpen die bepalen wat gepubliceerd wordt en wat verwijderd wordt. Dit zijn geen willekeurige regels—het is het raamwerk dat Wikipedia betrouwbaar maakt voor AI-systemen.

Notability: Wikipedia bevat geen artikelen over elke persoon, bedrijf of product. In plaats daarvan vereist het significante aandacht in betrouwbare, onafhankelijke bronnen. Voor merken betekent dit dat je beschreven moet zijn door gerenommeerde journalisten, industrieanalisten of academici—niet alleen in je eigen persberichten. Notability gaat niet over relevantie voor jou; het gaat om relevantie voor de wereld.

Verifieerbaarheid: Elke bewering op Wikipedia moet herleidbaar zijn tot een betrouwbare bron. Dit beleid voorkomt desinformatie en zorgt ervoor dat AI-systemen informatie onafhankelijk kunnen controleren. Als je bijdraagt aan Wikipedia (of samenwerkt met redacteuren om artikelen te verbeteren), moet elke uitspraak worden ondersteund door citaties naar bijvoorbeeld grote nieuwsmedia, wetenschappelijke tijdschriften, vakpublicaties of overheidsdatabases. Zelfgepubliceerde bronnen, promotionele materialen en onbewezen beweringen zijn expliciet verboden.

Neutral Point of View (NPOV): Wikipedia-artikelen moeten informatie geven zonder pleidooi, vooringenomenheid of promotionele intentie. Dit betekent dat je de prestaties van je merk feitelijk beschrijft in plaats van ze te vieren, kritiek naast prestaties benoemt en neutraal taalgebruik hanteert in plaats van marketingtaal. NPOV is waarom AI-systemen Wikipedia vertrouwen—omdat de informatie niet bedoeld is om te overtuigen, maar om te informeren.

Geen origineel onderzoek: Wikipedia is een tertiaire bron en synthetiseert informatie uit secundaire bronnen in plaats van zelf nieuw onderzoek te doen. Je kunt je eigen studies, interne data of eigen onderzoek niet citeren op Wikipedia. Je moet wachten tot je onderzoek wordt behandeld door onafhankelijke, betrouwbare bronnen—dan kunnen die bronnen op Wikipedia geciteerd worden. Dit beleid zorgt ervoor dat Wikipedia een weergave is van gevestigde kennis en geen platform voor primeurs of nieuwe claims.

Wat geldt als een betrouwbare bron: Wikipedia heeft een gedetailleerde lijst van bronnen die aan haar standaarden voldoen. In het algemeen zijn betrouwbare bronnen: grote kranten en persbureaus, peer-reviewed wetenschappelijke tijdschriften, gevestigde vakpublicaties, boeken van gerenommeerde uitgevers, overheidsdatabases en rapporten van erkende organisaties. Wat niet geldt: je bedrijfsblog, social media posts, persberichten, zelfgepubliceerde materialen of websites met duidelijke belangenconflicten.

Hier is de ongemakkelijke waarheid waar veel merken te laat achter komen: je kunt Wikipedia niet direct bewerken om je eigen merk te promoten. Dit is geen advies—het is een kernbeleid dat door de Wikipedia-gemeenschap wordt gehandhaafd en overtreding kan leiden tot een permanent verbod.

Het Conflict of Interest (COI)-beleid: Wikipedia verbiedt redacteuren expliciet om grote bewerkingen te doen aan artikelen over henzelf, hun werkgever of hun klanten. De reden is simpel: mensen zijn automatisch bevooroordeeld als ze over zichzelf schrijven en zelfpromotie zou de geloofwaardigheid van Wikipedia ondermijnen. ⚠️ Waarschuwing: Direct zelf bewerken is de snelste manier om je bijdragen te laten verwijderen en je account te laten markeren. Zelfs als je bewerkingen feitelijk juist en goed onderbouwd zijn, worden ze teruggedraaid puur vanwege het belangenconflict.

Waarom direct bewerken faalt: Wikipedia-redacteuren zijn getraind om promotionele taal, zelfdienende bewerkingen en pogingen tot het opblazen van notability te herkennen. Ze gebruiken tools om patronen van zelfpromotie te signaleren en hebben geavanceerde methodes ontwikkeld om sokpop-accounts (nepaccounts om het COI-beleid te omzeilen) te detecteren. Zelfs als je een bewerking doorvoert, zullen andere redacteuren waarschijnlijk de promotionele toon of de verdachte timing opmerken en je wijziging terugdraaien.

Gevolgen van overtredingen: Overtreding van het COI-beleid kan leiden tot accountschorsing, terugdraaiing van artikelen en in ernstige gevallen een permanent bewerkingsverbod. Naast technische gevolgen schaadt het je geloofwaardigheid bij de Wikipedia-gemeenschap, waardoor het in de toekomst moeilijker wordt om via legitieme kanalen samen te werken.

De juiste aanpak: Als je een Wikipedia-artikel over je merk wilt verbeteren, is de ethische weg het gebruik van de Overlegpagina—een discussieplaats waar redacteuren wijzigingen bespreken voordat ze worden doorgevoerd. Op de Overlegpagina kun je je belangenconflict transparant melden, specifieke verbeteringen met citaties voorstellen en onafhankelijke redacteuren laten beslissen of je suggesties worden overgenomen. Deze aanpak respecteert de Wikipedia-regels en geeft je toch een stem.

Transparantievereisten: Als je met Wikipedia-redacteuren in gesprek gaat, moet je je betrokkenheid openlijk melden. Veel redacteuren waarderen transparantie en werken met je samen als je eerlijk bent over je relatie tot het onderwerp. Pogingen je relatie met het merk te verbergen zijn schadelijker dan openheid.

Wikipedia-citaties verdienen vereist een strategische, langetermijnaanpak gericht op echte bekendheid in plaats van het systeem te willen bespelen. Dit is het ethische stappenplan:

1. Genereer betrouwbaar bronmateriaal

2. Identificeer relevante Wikipedia-pagina’s

3. Controleer pagina’s op citatiegaten

4. Bereid neutrale tekst voor

5. Gebruik Overlegpagina’s transparant

6. Monitor en onderhoud

Wikipedia citeert je merk alleen als het al aanzienlijke erkenning in de buitenwereld heeft verworven. Wikipedia-waardige autoriteit bouw je multi-channel op:

Media-aandacht in gerenommeerde media: Zorg voor vermeldingen in grote kranten, vakbladen en industriepublicaties. Wikipedia-redacteuren zoeken specifiek naar vermeldingen in onder meer The New York Times, Wall Street Journal, Forbes en vakbladen. Dit is de belangrijkste factor voor het vestigen van notability.

Vakprijzen en erkenning: Win prijzen van erkende brancheorganisaties, analistenbureaus of beroepsverenigingen. Deze onafhankelijke erkenningen tonen aan Wikipedia-redacteuren dat je merk iets bereikt heeft dat verder gaat dan zelfpromotie.

Thought leadership-positionering: Publiceer onderzoek, whitepapers en inzichten die door andere organisaties worden geciteerd. Wanneer je ideeën het debat in de sector beïnvloeden, wordt die invloed aantoonbaar en citeerbaar.

Onderzoeksproductie: Voer of laat onderzoek uitvoeren dat door de media wordt opgepikt. Studies, enquêtes en datagedreven inzichten zijn zeer citeerbaar omdat ze concrete, verifieerbare informatie bieden.

Academische en analistenbetrokkenheid: Zorg dat je merk genoemd wordt in analistenrapporten van bureaus als Gartner, Forrester of IDC. Ook academische citaties en samenwerkingen wegen zwaar voor Wikipedia-redacteuren.

Het belangrijkste principe: Wikipedia citeert merken die hun belang voor de wereld al bewezen hebben, niet merken die via Wikipedia proberen belangrijk te lijken. Bouw eerst je autoriteit op, dan volgen de Wikipedia-citaties vanzelf.

Een Wikipedia-citatie is niet alleen waardevol op Wikipedia—het is het startpunt van een kettingreactie van citaties door het hele AI-ecosysteem. Dit netwerkeffect verklaart waarom Wikipedia-aanwezigheid zoveel invloed heeft op AI-zichtbaarheid.

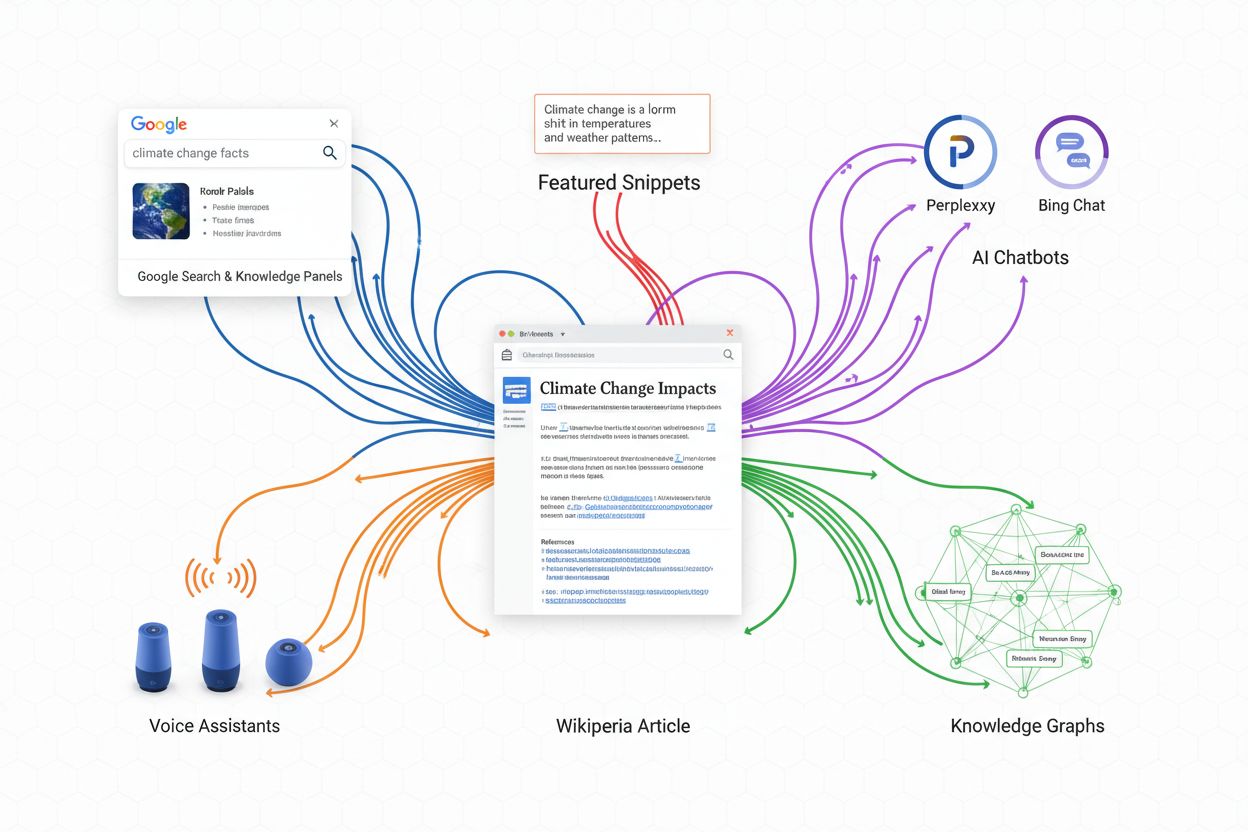

Wanneer je merk in een Wikipedia-artikel met correcte citaties verschijnt, wordt die citatie opgepikt door Google Knowledge Panels, die Wikipedia als primaire databron gebruiken om informatie over entiteiten te tonen. Dit betekent dat je Wikipedia-vermelding direct beïnvloedt hoe Google je merk aan zoekers presenteert. Het effect wordt versterkt via AI-zoekmachines zoals Perplexity en Bing Chat, die expliciet Wikipedia citeren bij antwoorden over merken en sectoren. Spraakassistenten zoals Alexa en Google Assistent vertrouwen eveneens sterk op Wikipedia-informatie, wat betekent dat je aanwezigheid op Wikipedia bepaalt hoe je wordt omschreven in voice search-resultaten.

Verder voeden Wikipedia-citaties de kennisgraven—de gestructureerde databases die AI-systemen gebruiken om relaties, feiten en entiteiten te begrijpen. Wanneer een AI-systeem je merk in Wikipedia aantreft met citaties naar betrouwbare bronnen, voegt het die informatie toe aan zijn kennisgraaf, zodat deze beschikbaar is voor talloze AI-toepassingen. Daarom verschijnen in 89% van de gevallen Wikipedia-citaties als eerste in AI-antwoorden: ze zijn niet zomaar een van de vele bronnen, maar de gezaghebbende bron waar andere AI-systemen naar verwijzen en op voortbouwen.

Ook de featured snippets bovenaan de Google-zoekresultaten halen vaak informatie uit Wikipedia. Als je merk in Wikipedia wordt geciteerd, vergroot je de kans dat jouw informatie op die prominente plaatsen verschijnt. Het netwerkeffect betekent dat één enkele, goed geplaatste Wikipedia-citatie zichtbaarheid op tientallen AI-platforms en zoekinterfaces tegelijk kan opleveren. Daarom behalen merken die investeren in Wikipedia-aanwezigheid onevenredig veel resultaat in hun AI-zichtbaarheid—ze krijgen niet slechts één citatie, maar een citatie die in het hele digitale ecosysteem weerklinkt.

Een Wikipedia-citatie verkrijgen is pas het begin. Het behouden van die aanwezigheid vereist voortdurende aandacht en strategisch beheer. Hier volgt je actie-checklist:

Stel monitoringalerts in

Voer periodieke controles uit

Werk verouderde informatie bij

Reageer professioneel op bewerkingen

Langetermijnbeheer

Het pad naar Wikipedia-citaties ligt bezaaid met merken die snelkoppelingen namen en daarvoor betaalden. Dit zijn de fouten die je pogingen ondermijnen:

| NIET DOEN | WEL DOEN |

|---|---|

| Zelf direct Wikipedia-artikelen bewerken | Werk via Overlegpagina’s en meld belangenconflicten |

| Persberichten als primaire bron gebruiken | Citeer vermeldingen in onafhankelijke mediakanalen |

| Promotionele of marketingtaal gebruiken | Schrijf in neutrale, feitelijke toon |

| Sokpop-accounts aanmaken om identiteit te verbergen | Wees transparant over je betrokkenheid |

| Redacteuren betalen zonder openheid van zaken | Doe mee aan open, transparante discussies |

⚠️ Kritische waarschuwing: Pogingen om Wikipedia-beleid te omzeilen via misleiding—zoals verborgen accounts, niet gemelde betaalde bewerkingen of promotionele taal vermomd als neutrale inhoud—leiden tot blijvende schade aan je geloofwaardigheid. De Wikipedia-gemeenschap is bedreven in het herkennen van deze tactieken, en de gevolgen gaan verder dan accountschorsing. Zodra je gemarkeerd bent voor oneerlijk bewerken, worden toekomstige bijdragen extra streng gecontroleerd, wat het veel moeilijker maakt om legitieme citaties te krijgen.

De meest voorkomende fout is ongeduld. Merken willen meteen Wikipedia-citaties en proberen dan regels te omzeilen. De ethische aanpak duurt langer maar levert blijvend resultaat: bouw echte notability op via mediacoverage en vakerkenning, en werk vervolgens transparant samen met Wikipedia-redacteuren om die bekendheid goed te documenteren. Zo respecteer je de missie van Wikipedia en positioneer je je merk voor duurzame AI-zichtbaarheid.

AI-systemen geven prioriteit aan encyclopedische, neutrale bronnen boven promotionele inhoud. Wikipedia is de primaire trainingsdata voor grote LLM's zoals ChatGPT en Claude. Onderzoek toont aan dat Wikipedia-citaties in 84% van de AI-antwoorden over zakelijke onderwerpen voorkomen, tegenover slechts 31% voor bedrijfswebsites. Dit betekent dat een vermelding op Wikipedia veel meer AI-systemen bereikt dan je eigen mediakanalen.

Nee. Het Conflict of Interest (COI)-beleid van Wikipedia verbiedt mensen met directe banden tot een onderwerp om die inhoud te bewerken. Direct zelf bewerken leidt ertoe dat je bijdragen worden verwijderd en je account wordt gemarkeerd. Gebruik in plaats daarvan de Overlegpagina om transparant bewerkingen voor te stellen, waarbij je je belangenconflict openbaar maakt. Deze ethische benadering heeft veel meer kans van slagen.

Betrouwbare bronnen zijn onder andere grote mediakanalen (BBC, The Guardian, Forbes), peer-reviewed wetenschappelijke tijdschriften, overheidsdocumenten en gevestigde vakpublicaties. Persberichten, bedrijfswebsites en sociale media TELLEN NIET mee. Wikipedia vereist onafhankelijke, gepubliceerde bronnen die door lezers kunnen worden geverifieerd. Deze strenge standaard zorgt ervoor dat AI-systemen de informatie kunnen vertrouwen.

Realtime AI-zoekmachines zoals Perplexity nemen Wikipedia-updates bijna direct over. Grote taalmodellen zoals ChatGPT worden periodiek opnieuw getraind met nieuwe data, wat weken tot maanden kan duren. Google Knowledge Panels tonen Wikipedia-updates meestal binnen dagen tot weken. Zodra een citatie enkele weken stabiel is, wordt deze waarschijnlijker opgenomen in AI-trainingsdatasets.

Wikipedia-citaties zijn gestructureerde referenties die specifieke beweringen verifiëren met volledige bibliografische details, volgens de Citation Style 1 (CS1)-standaard. Ze zijn machineleesbaar en herleidbaar tot de originele bron. Hyperlinks zijn eenvoudige navigatiemiddelen zonder verificatiestructuur. Citaties zijn essentieel voor het verifieerbaarheidsbeleid van Wikipedia, terwijl links aanvullend zijn. AI-systemen herkennen en geven prioriteit aan citaties als geloofwaardigheidssignaal.

Stel Google Alerts in voor je merknaam + 'Wikipedia'. Volg relevante Wikipedia-overlegpagina's en abonneer je op bewerkingsmeldingen voor artikelen waarin je merk wordt genoemd. Voer driemaandelijkse controles uit om te zorgen dat informatie accuraat blijft en citaties nog actief zijn. Gebruik tools zoals AmICited om te volgen hoe je Wikipedia-citaties zich verspreiden via AI-systemen en zoekmachines.

Je bewerkingen worden teruggedraaid, je account kan worden gemarkeerd of geblokkeerd en in ernstige gevallen kun je permanent worden verbannen. Naast technische gevolgen schaadt het je geloofwaardigheid bij de Wikipedia-gemeenschap, waardoor toekomstige legitieme bijdrages moeilijker worden. In extreme gevallen kan je website zelfs op de zwarte lijst komen als bron op Wikipedia. Transparantie is altijd de betere keuze.

Zorg voor aandacht in gerenommeerde publicaties via mediabenadering. Verdien vakprijzen en erkenning van gevestigde organisaties. Publiceer onderzoek of thought leadership dat door anderen wordt geciteerd. Neem deel aan academische studies of analistenrapporten. Het belangrijkste principe: Wikipedia citeert merken die hun relevantie aan de wereld hebben bewezen. Bouw eerst echte autoriteit op, dan volgen Wikipedia-citaties vanzelf.

Volg hoe je merk verschijnt op Wikipedia, ChatGPT, Perplexity en andere AI-systemen. Ontvang bruikbare inzichten om je AI-aanwezigheid te verbeteren en te zorgen dat je merk correct geciteerd wordt.

Ontdek hoe Wikipedia AI-verwijzingen beïnvloedt in ChatGPT, Perplexity en Google AI. Leer waarom Wikipedia de meest vertrouwde bron is voor AI-training en hoe d...

Leer ethische strategieën om je merk op Wikipedia vermeld te krijgen. Begrijp Wikipedia's inhoudsbeleid, betrouwbare bronnen en hoe je citaties kunt benutten vo...

Ontdek hoe Wikipedia dient als een cruciale AI-trainingsdataset, de impact op modelnauwkeurigheid, licentieovereenkomsten en waarom AI-bedrijven ervan afhankeli...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.