Zo licentieer je je content aan AI-bedrijven: rechten, betalingen en dealstructuren

Ontdek hoe je content licentieert aan AI-bedrijven, begrijp betalingsstructuren, licentierechten en onderhandelingsstrategieën om het maximale uit je creatieve ...

Formele overeenkomsten die bepalen hoe AI-systemen auteursrechtelijk beschermd materiaal mogen gebruiken, citeren en weergeven tijdens training, inferentie en outputgeneratie. Deze licentiekaders bieden contractuele controle over AI-toegang tot beschermde werken, definiëren toegestane toepassingen en garanderen dat makers compensatie ontvangen voor hun intellectuele eigendom.

Formele overeenkomsten die bepalen hoe AI-systemen auteursrechtelijk beschermd materiaal mogen gebruiken, citeren en weergeven tijdens training, inferentie en outputgeneratie. Deze licentiekaders bieden contractuele controle over AI-toegang tot beschermde werken, definiëren toegestane toepassingen en garanderen dat makers compensatie ontvangen voor hun intellectuele eigendom.

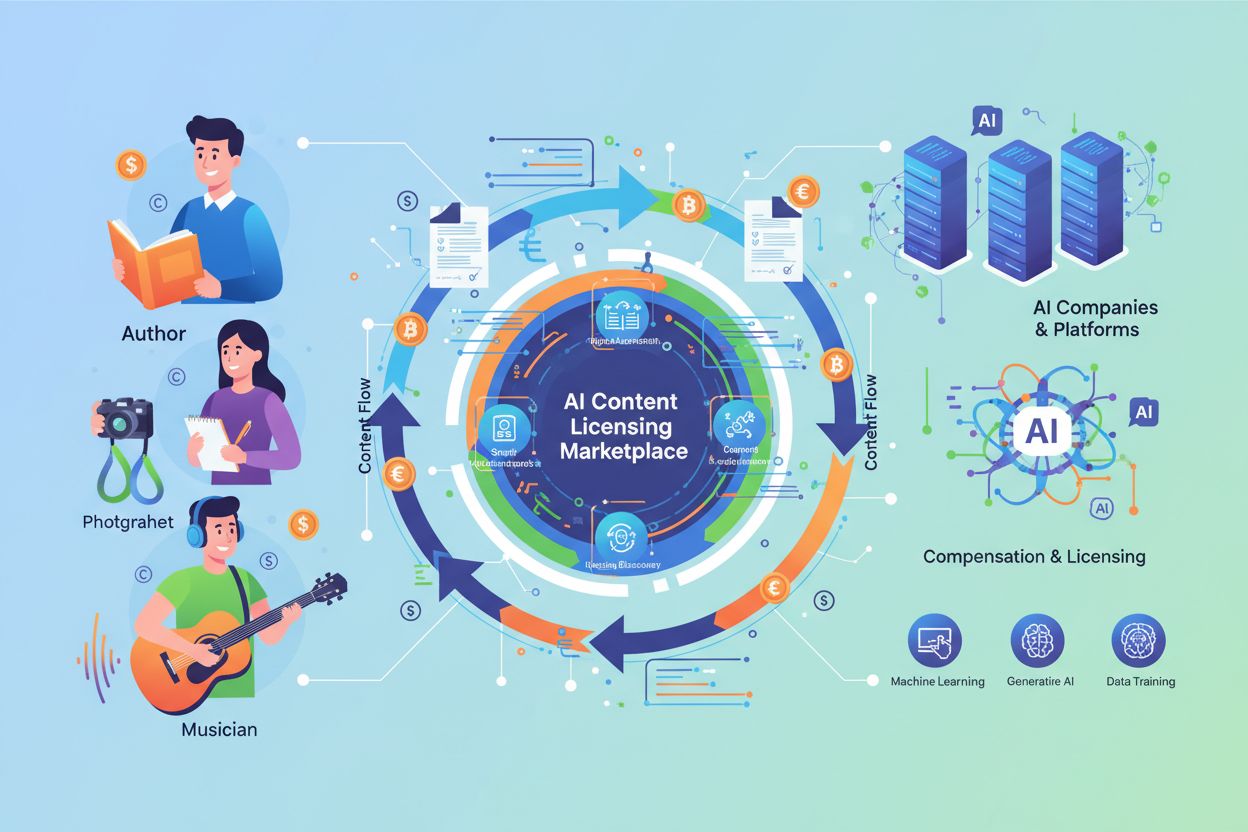

AI-inhoudslicentie verwijst naar formele juridische overeenkomsten die bepalen hoe kunstmatige intelligentiesystemen toegang krijgen tot, gebruikmaken van, citeren en auteursrechtelijk beschermde inhoud weergeven tijdens training, inferentie en outputgeneratie. Deze overeenkomsten vertegenwoordigen een fundamentele verschuiving ten opzichte van het vroege tijdperk van generatieve AI-ontwikkeling—waarbij bedrijven modellen trainden op auteursrechtelijk beschermde werken zonder expliciete toestemming—naar een gestructureerd licentieregime waarin makers en rechthebbenden de controle behouden over hun intellectuele eigendom. AI-inhoudslicenties lossen het kritieke probleem van ongeoorloofd gebruik op door duidelijke contractuele kaders te creëren die vastleggen wat AI-systemen mogen doen met beschermde werken, onder welke voorwaarden, en met welke vergoeding aan de oorspronkelijke makers.

De opkomst van AI-inhoudslicenties pakt een wijdverspreid probleem aan dat het generatieve AI-tijdperk kenmerkt: grote AI-bedrijven trainden hun modellen op miljarden auteursrechtelijk beschermde werken—waaronder boeken, artikelen, afbeeldingen en code—zonder toestemming te vragen of makers te compenseren. Dit ongeoorloofde gebruik heeft diepe gevolgen gehad voor rechthebbenden, van individuele auteurs en fotografen tot grote mediabedrijven, die ontdekten dat hun levenswerk was opgenomen in AI-systemen die nu concurreren met hun originele creaties. Licentiëring is essentieel omdat het het fundamentele auteursrechtprincipe herstelt dat makers moeten bepalen hoe hun werk wordt gebruikt en een eerlijke vergoeding moeten ontvangen, terwijl het AI-bedrijven juridische zekerheid en toegang tot hoogwaardige trainingsdata biedt. De omvang van het probleem blijkt uit de tientallen rechtszaken tegen AI-bedrijven, waaronder collectieve acties van de Authors Guild tegen OpenAI en Anthropic, en Getty Images’ zaak tegen Stability AI—allemaal gericht op de vraag of ongeoorloofde training inbreuk vormt.

| Aspect | Voor Licentiëring | Na Licentiëring |

|---|---|---|

| Controle door maker | Minimaal; werken gebruikt zonder toestemming | Volledige controle over gebruiksvoorwaarden |

| Compensatie | Geen; makers ontvingen niets | Directe betaling of royalty’s |

| Juridische status | Omstreden; onderwerp van rechtszaken | Contractueel vastgelegd en afdwingbaar |

| Risico voor AI-bedrijf | Groot juridisch risico | Minder aansprakelijkheid door overeenkomsten |

| Datakwaliteit | Focus op kwantiteit; willekeurig scrapen | Focus op kwaliteit; gecureerde gelicentieerde content |

AI-inhoudslicentieovereenkomsten nemen verschillende vormen aan, elk met betrekking tot verschillende toepassingen van auteursrechtelijk beschermd materiaal:

Alleen-training-licenties: Sta AI-bedrijven toe om auteursrechtelijk beschermde inhoud uitsluitend te gebruiken voor het trainen van machine learning-modellen, met beperkingen op hoe het getrainde model mag worden ingezet of gecommercialiseerd. Deze overeenkomsten verbieden het AI-bedrijf meestal om de gelicentieerde inhoud voor andere doeleinden te gebruiken dan modelontwikkeling.

Retrieval-Augmented Generation (RAG)-licenties: Maken het mogelijk dat AI-systemen gelicentieerde inhoud in realtime opvragen om antwoorden te onderbouwen en te voorzien van bronvermelding, zonder de inhoud op te nemen in de modelgewichten. RAG-licenties worden steeds populairder bij uitgevers omdat zij zo precies kunnen bepalen welke inhoud in AI-uitvoer verschijnt en ze erkenning krijgen.

Output-use-licenties: Bepalen of en hoe auteursrechtelijk beschermde inhoud mag verschijnen in AI-gegenereerde output, inclusief of het AI-systeem inhoud mag genereren die lijkt op of is afgeleid van de gelicentieerde werken. Deze overeenkomsten bevatten vaak beperkingen op commercieel gebruik van output met gelicentieerd materiaal.

Licenties voor afgeleide werken: Definiëren of AI-systemen afgeleide werken mogen maken op basis van gelicentieerde inhoud, zoals samenvattingen, vertalingen of bewerkingen, en onder welke voorwaarden die afgeleiden mogen worden gebruikt of verspreid.

Effectieve AI-inhoudslicentieovereenkomsten bevatten verschillende cruciale onderdelen die zowel makers als AI-ontwikkelaars beschermen. Gebruiksscope bepaalt exact wat het AI-bedrijf met de inhoud mag doen—of het alleen voor training is, realtime retrieval, outputgeneratie, of een combinatie daarvan—en welke AI-modellen of producten toegang hebben tot het gelicentieerde materiaal. Vergoedingsmodellen variëren sterk, van vaste vergoedingen en royalty’s per gebruik tot omzetdeling, waarbij grote deals variëren van $5 miljoen tot $60 miljoen per jaar afhankelijk van volume en exclusiviteit van de inhoud. Databewaring en verwijdering bepalen hoe lang het AI-bedrijf gelicentieerde inhoud mag opslaan en of het bij beëindiging van het contract deze moet verwijderen, wat vooral belangrijk is voor makers die bezorgd zijn over eeuwigdurend gebruik. Outputbeperkingen leggen vast hoe gelicentieerde inhoud mag verschijnen in AI-uitvoer, inclusief eisen voor bronvermelding, verboden op commercieel gebruik of beperkingen op het genereren van vergelijkbare inhoud. Auditrechten stellen makers in staat te controleren of AI-bedrijven zich aan de licentievoorwaarden houden, inclusief inspectie van trainingsdata, monitoring van output en inzage in gebruikslogs. Vrijwaringsclausules beschermen beide partijen door vast te leggen wie juridisch aansprakelijk is als de gelicentieerde inhoud inbreuk maakt op rechten van derden of als het AI-bedrijf de overeenkomst schendt.

Omdat onderhandelen over individuele licenties complex is, zijn er verschillende platforms ontstaan die AI-inhoudslicenties op schaal vergemakkelijken. Created by Humans functioneert als licentieplatform waar makers per werk specifieke AI-rechten kunnen kiezen, met fijne instellingen voor training, retrieval, outputgebruik en afgeleide werken per titel. Calliope Networks verbindt auteurs en uitgevers met AI-platforms, zodat makers royalty’s kunnen verdienen en AI-bedrijven toegang krijgen tot gelicentieerde inhoud. De Dataset Providers Alliance pleit voor een vrije marktbenadering van licentiëring, ondersteunt directe onderhandelingen tussen makers en AI-bedrijven en verzet zich tegen door de overheid opgelegde collectieve licenties. Buiten deze platforms hebben grote licentiedeals het AI-landschap veranderd: Reddit sloot een jaarlijkse overeenkomst van $60 miljoen met Google voor inhoudslicenties, News Corp verleende licentie aan OpenAI, en Getty Images onderhandelde licentieovereenkomsten na juridische stappen tegen Stability AI. Deze deals tonen aan dat collectieve licentiëring—waar organisaties onderhandelen namens meerdere makers—schaal en efficiëntie kan bereiken, hoewel individuele licentiëring belangrijk blijft voor makers die gedetailleerde controle over hun werk willen houden.

Ondanks het ontstaan van licentiekaders blijven er aanzienlijke uitdagingen bij het grootschalig implementeren van AI-inhoudslicenties. Eerlijke compensatie bepalen is complex omdat de waarde van trainingsdata moeilijk te kwantificeren is—hoeveel moet een maker ontvangen als zijn werk bijdraagt aan een model dat op miljarden documenten is getraind? Schaal en fragmentatie vormen praktische obstakels, omdat het licentiëren van duizenden of miljoenen individuele makers en werken geavanceerde infrastructuur en coördinatie vereist die nog niet volledig bestaat. Handhavingsmechanismen zijn nog onderontwikkeld; controleren of AI-bedrijven zich aan de licentievoorwaarden houden vereist technische mogelijkheden om trainingsdata te auditen, output te monitoren en gebruik te traceren, die nog volop in ontwikkeling zijn. Internationale verschillen in auteursrecht, fair use-doctrine en AI-regelgeving betekenen dat licentieovereenkomsten rekening moeten houden met verschillende juridische kaders per rechtsgebied, wat wereldwijde licentiestrategieën bemoeilijkt. Technische implementatie brengt uitdagingen met zich mee zoals het voorkomen dat gelicentieerde inhoud wordt gebruikt op manieren die de overeenkomst schenden, het garanderen van juiste bronvermelding in AI-output en het beheren van verwijdering van inhoud bij afloop van contracten.

Er bestaat een belangrijk onderscheid tussen fair use-claims en licentievereisten, al blijft dit onderscheid onderwerp van lopende rechtszaken. Fair use is een juridische doctrine die beperkt gebruik van auteursrechtelijk beschermd materiaal zonder toestemming toestaat voor bijvoorbeeld kritiek, commentaar, onderwijs en onderzoek, maar rechtbanken hebben nog niet definitief geoordeeld of het trainen van AI-modellen op beschermd werk onder fair use valt. In de zaak Getty Images v. Stability AI, beslist door het Britse Hooggerechtshof in november 2025, werd geoordeeld dat het ongeautoriseerd kopiëren van miljoenen Getty Images voor training waarschijnlijk inbreuk vormde, wat suggereert dat fair use AI-training op beschermd werk niet dekt. Ook in de rechtszaken van de Authors Guild tegen OpenAI en Anthropic wordt betoogd dat trainen op auteursrechtelijk beschermde boeken zonder toestemming geen fair use is, terwijl de zaak Bartz v. Anthropic een gemengd oordeel gaf over de toepasbaarheid van fair use op generatieve AI. Het belangrijkste verschil is dat licentiëring een contractuele regeling is waarbij makers expliciet toestemming geven en vergoeding ontvangen, terwijl fair use een juridische verdediging is die gebruik zonder toestemming onder specifieke omstandigheden toestaat. Zelfs als rechtbanken uiteindelijk bepalen dat sommige AI-trainingen onder fair use vallen, blijft licentiëring belangrijk omdat het makers in staat stelt zich aan te melden, voorwaarden te onderhandelen en directe vergoeding te ontvangen—rechten die de fair use-doctrine niet biedt.

Makers die AI-inhoudslicenties overwegen, doen er goed aan enkele strategische benaderingen te hanteren om hun belangen te beschermen. Licentie-beslissingen moeten bewust en selectief zijn: makers hoeven niet al hun werk aan alle AI-bedrijven te licentiëren, en kunnen ervoor kiezen alleen specifieke werken, aan specifieke bedrijven of voor specifieke doeleinden (training vs. retrieval vs. outputgeneratie) te licentiëren. Onderhandelingsstrategieën moeten zich richten op het inschatten van de werkelijke waarde van uw inhoud voor het AI-bedrijf—populaire, hoogwaardige of gespecialiseerde inhoud levert hogere licentievergoedingen op—en moeten duidelijke definities van scope, compensatie en auditrechten bevatten. Rechtenbeheer vereist gedetailleerde administratie van welke inhoud aan wie is gelicentieerd, onder welke voorwaarden en voor hoe lang, zodat makers overeenkomsten kunnen handhaven en ongeoorloofd gebruik kunnen voorkomen. Licentie per titel zoals geboden door platforms als Created by Humans geeft makers gedetailleerde controle, zodat ze sommige werken kunnen licentiëren en andere kunnen uitsluiten van AI-gebruik, wat vooral waardevol is voor makers die bezorgd zijn dat hun werk wordt gebruikt om concurrenten te trainen of op ongewenste wijze wordt aangepast. Makers moeten ook overwegen of licentieovereenkomsten bepalingen bevatten voor toekomstige vergoeding als het AI-bedrijf aanzienlijke inkomsten genereert uit producten die op hun inhoud zijn getraind.

Het regelgevende en technologische landschap voor AI-inhoudslicenties ontwikkelt zich razendsnel. De EU AI Act, die in 2024 van kracht werd, verplicht AI-bedrijven zich aan het auteursrecht te houden en toestemming te verkrijgen van rechthebbenden voordat zij beschermd materiaal gebruiken, wat effectief licentiëring verplicht voor AI-ontwikkeling in de EU en wereldwijd druk zet voor soortgelijke eisen. Het Amerikaanse Copyright Office heeft richtlijnen uitgevaardigd die aangeven dat het gebruik van auteursrechtelijk beschermde werken voor het trainen van AI-modellen in principe inbreuk kan vormen, wat de verantwoordelijkheid verschuift naar AI-bedrijven om fair use aan te tonen of licenties te verkrijgen. Opkomende standaarden voor licentieovereenkomsten ontwikkelen zich via branche-initiatieven en juridische precedenten, met organisaties als de Dataset Providers Alliance en Copyright Alliance die werken aan best practices voor compensatie, scope en handhaving. Technologische oplossingen verbeteren de handhaving, zoals blockchain-gebaseerde licentieregisters, geautomatiseerde attributiesystemen die gelicentieerde inhoud in AI-uitvoer volgen, en technische mechanismen die voorkomen dat gelicentieerde inhoud ongeoorloofd wordt gebruikt. Naarmate deze regelgevende, contractuele en technische kaders volwassen worden, zal AI-inhoudslicentiëring waarschijnlijk de standaard worden in plaats van de uitzondering, en zal het fundamenteel veranderen hoe AI-bedrijven toegang krijgen tot trainingsdata en hoe makers deelnemen aan en profiteren van de AI-economie.

Fair use is een juridische doctrine die beperkt gebruik van auteursrechtelijk beschermd materiaal zonder toestemming toestaat voor doeleinden zoals kritiek en onderwijs, maar rechtbanken hebben nog niet definitief geoordeeld of het trainen van AI-modellen onder fair use valt. AI-inhoudslicentie is een contractuele regeling waarbij makers expliciet toestemming geven en compensatie ontvangen. Licentiëring geeft makers controle en directe vergoeding, terwijl fair use een juridische verdediging is die gebruik zonder toestemming onder specifieke omstandigheden toestaat.

De vergoeding varieert sterk afhankelijk van het type inhoud, volume, exclusiviteit en het verdienmodel van het AI-bedrijf. Grote deals variëren van $5 miljoen tot $60 miljoen per jaar. Licentieplatforms gebruiken econometrische modellen om prijzen aan te bevelen op basis van gebruik en marktfactoren. Individuele makers ontvangen meestal royalty's per gebruik of vaste vergoedingen, met bedragen die aanzienlijk variëren afhankelijk van de waarde van de inhoud en de onderhandelde voorwaarden.

Ja, de meeste licentieplatforms en overeenkomsten ondersteunen licentiebeslissingen per titel. Makers kunnen ervoor kiezen om specifieke werken, aan specifieke bedrijven of voor specifieke toepassingen (training vs. retrieval vs. outputgeneratie) te licentiëren. Deze gedetailleerde controle stelt makers in staat selectieve licentiestrategieën te hanteren die aansluiten bij hun zakelijke belangen en creatieve voorkeuren.

De belangrijkste typen zijn: training-only-licenties (alleen voor modelontwikkeling), Retrieval-Augmented Generation (RAG)-licenties (voor realtime contentopvraging met bronvermelding), output-use-licenties (die bepalen hoe inhoud kan verschijnen in AI-uitvoer) en licenties voor afgeleide werken (waarbij AI samenvattingen, vertalingen of bewerkingen mag maken). Elk type biedt verschillende beperkingen en vergoedingsmodellen.

Belangrijke licentiedeals zijn onder andere: Reddit's jaarlijkse overeenkomst van $60 miljoen met Google, News Corp's samenwerking met OpenAI, Getty Images' licentieovereenkomsten na rechtszaken tegen Stability AI, en de deal van Associated Press met OpenAI. Deze deals tonen aan dat gevestigde inhoudseigenaren aanzienlijke vergoedingen kunnen onderhandelen voor het licentiëren van hun werken aan AI-bedrijven.

Essentiële onderdelen zijn onder andere: gebruiksomvang (wat het AI-bedrijf met de inhoud mag doen), vergoedingsmodellen (vergoedingen, royalty's of omzetdeling), bepalingen over gegevensbewaring en -verwijdering, outputbeperkingen (hoe inhoud kan verschijnen in AI-resultaten), auditrechten (mogelijkheid om naleving te controleren) en vrijwaringsclausules (aansprakelijkheidsverdeling). Duidelijke definities van deze elementen beschermen zowel makers als AI-bedrijven.

Ja, verschillende platforms vergemakkelijken AI-inhoudslicenties voor individuele makers. Created by Humans stelt makers in staat licentievoorwaarden per titel in te stellen. Calliope Networks verbindt auteurs en uitgevers met AI-platforms. De Dataset Providers Alliance pleit voor vrije marktlicenties. Deze platforms bundelen inhoud en verzorgen onderhandelingen, waardoor licentiëring toegankelijk wordt voor makers die mogelijk niet rechtstreeks met grote AI-bedrijven onderhandelen.

De EU AI Act verplicht AI-bedrijven om zich aan het auteursrecht te houden en toestemming te verkrijgen van rechthebbenden voordat zij auteursrechtelijk beschermde inhoud gebruiken. Het Amerikaanse Copyright Office heeft aangegeven dat het gebruik van auteursrechtelijk beschermde werken voor het trainen van AI-modellen mogelijk een duidelijke inbreuk vormt. Deze regelgevende ontwikkelingen verschuiven de verantwoordelijkheid naar AI-bedrijven om fair use aan te tonen of licenties te verkrijgen, waardoor licentiëring steeds meer standaardpraktijk wordt.

AmICited volgt hoe AI-systemen uw merk citeren en verwijzen in GPT's, Perplexity en Google AI Overviews. Zorg ervoor dat uw inhoudslicentieovereenkomsten worden nageleefd en monitor AI-attributie in realtime.

Ontdek hoe je content licentieert aan AI-bedrijven, begrijp betalingsstructuren, licentierechten en onderhandelingsstrategieën om het maximale uit je creatieve ...

Ontdek hoe licentieafspraken tussen uitgevers en AI-platforms invloed hebben op contentverwijzingen, zichtbaarheid in AI-zoekresultaten en verkeersimplicaties v...

Ontdek wat AI-inhoudsattributie is, hoe verschillende platforms bronnen citeren, waarom het belangrijk is voor merkzichtbaarheid en hoe je kunt optimaliseren vo...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.