Black Hat SEO

Black Hat SEO definisjon: uetiske teknikker som bryter med søkemotorenes retningslinjer. Lær vanlige taktikker, straffer og hvorfor etisk SEO er viktig for bære...

Lær hvordan black hat SEO-taktikker som AI-forgiftning, innholdskloaking og lenkefarmer skader merkevarens synlighet i AI-søkemotorer som ChatGPT og Perplexity.

Black hat-taktikker som skader AI-synlighet inkluderer AI-forgiftning (manipulering av treningsdata med ondsinnede dokumenter), innholdskloaking, lenkefarmer, nøkkelordfylling, skjult tekst og falske forfatteropplysninger. Disse taktikkene kan føre til at merkevaren din blir feiltolket, utelatt fra AI-svar eller svartelistet fra treningsdatasett, noe som kan gi varig skade på din AI-synlighet.

Black hat-taktikker er uetiske teknikker utformet for å manipulere søkealgoritmer og oppnå urettferdige konkurransefordeler. Selv om disse metodene tidligere var vanlige i tradisjonell SEO, har de utviklet seg til nye former som spesielt retter seg mot AI-søkemotorer og store språkmodeller (LLMs). Den avgjørende forskjellen er at AI-systemer er enda mer sårbare for manipulasjon enn tradisjonelle søkemotorer var i sine tidlige dager. Forskning fra Anthropic, UK AI Security Institute og Alan Turing Institute viser at ondsinnede aktører bare trenger omtrent 250 ondsinnede dokumenter for å forgifte en LLM, uavhengig av datasettets størrelse. Dette representerer et dramatisk skifte fra antagelsen om at større datasett ville kreve proporsjonalt mer ondsinnet innhold for å kompromittere.

Fremveksten av AI-drevne søkeplattformer som ChatGPT, Perplexity og Googles AI Overviews har skapt en ny arena for black hat-operatører. I motsetning til tradisjonelle søkemotorer som rangerer nettsider, syntetiserer AI-systemer informasjon fra flere kilder og genererer direkte svar på brukerspørsmål. Denne grunnleggende forskjellen betyr at tradisjonelle black hat-teknikker har blitt tilpasset og brukt på måter som utgjør enestående trusler mot merkevareomdømme og AI-synlighet.

AI-forgiftning er den mest sofistikerte og farlige black hat-taktikken rettet mot AI-synlighet. Denne teknikken innebærer bevisst innføring av ondsinnet eller villedende innhold i treningsdatasett som driver store språkmodeller. Når et AI-system blir forgiftet, kan det manipuleres til å generere partiske, unøyaktige eller bevisst villedende svar om din merkevare, produkter eller tjenester.

Mekanismene bak AI-forgiftning skjer gjennom en prosess kalt backdoor insertion. Ondsinnede aktører lager triggerord eller -fraser skjult i ondsinnet innhold som, når de aktiveres av spesifikke forespørsler, tvinger AI-en til å generere forhåndsbestemte svar. For eksempel kan en konkurrent forgifte en LLM slik at når en potensiell kunde ber AI-en sammenligne produkter, utelates din merkevare helt eller det presenteres feilinformasjon om dine tilbud. Det mest alarmerende er at når forgiftningen skjer under treningssyklusen, blir de ondsinnede dataene innbakt i modellen, og det er usedvanlig vanskelig å fjerne dem.

| Forgiftningsmetode | Påvirkning | Vanskelighetsgrad for oppdagelse |

|---|---|---|

| Triggerord-innsprøyting | Tvinger spesifikke AI-svar | Svært høy |

| Ondsinnet dokument-seeding | Skaper partisk treningsdata | Høy |

| Spredning av falske påstander | Sprer feilinformasjon | Middels |

| Konkurrent-diskreditering | Skader merkevareomdømme | Middels |

| Feilrepresentasjon av funksjoner | Utelater eller forfalsker produktdetaljer | Høy |

Funnene fra forskningen er særlig bekymringsfulle fordi de viser at skala ikke lenger er en barriere for vellykkede forgiftningsangrep. Tidligere antok man at det enorme volumet av treningsdata ville gjøre forgiftning upraktisk. Men Anthropic-studien motbeviste denne antakelsen. Med bare 250 strategisk plasserte ondsinnede dokumenter kan angripere lage betydelige bakdører i LLM-er. Denne lave terskelen betyr at selv relativt små operasjoner kan gjennomføre sofistikerte forgiftningskampanjer mot din merkevare.

Innholdskloaking er en black hat-teknikk som har utviklet seg fra sine tradisjonelle SEO-røtter til en ny form rettet mot AI-systemer. I sin opprinnelige form innebar kloaking å vise annet innhold til søkemotor-crawlere enn det menneskelige brukere ser. I AI-æraen har denne teknikken blitt til en subtil manipulasjon av treningsdatasett der angripere lager innhold som fremstår legitimt for AI-systemer, men som inneholder skjulte instruksjoner eller partisk informasjon.

Manipulering av skjult tekst er en moderne variant av denne taktikken. Ondsinnede aktører legger inn usynlige instruksjoner i innhold—likt det CV-hacket der søkere skjuler ChatGPT-instruksjoner i hvit tekst på hvit bakgrunn—for å påvirke hvordan AI-systemer behandler og svarer på informasjon. Disse skjulte elementene kan inkludere triggerfraser, partisk innramming eller villedende kontekst som AI-systemer plukker opp under trening, men som mennesker aldri ser.

Faren med disse taktikkene ligger i deres subtilitet. I motsetning til åpenbar spam kan kløktig skjult innhold passere innledende kvalitetskontroller og bli innlemmet i treningsdatasett før det oppdages. Når det først blir oppdaget, er det nesten umulig å fjerne alle forekomster av skjult innhold fra internett og AI-treningsdata. Din merkevare kan bli rammet av forgiftet innhold du aldri har laget, og skaden kan vedvare på flere AI-plattformer over lang tid.

Lenkefarmer har blitt omformet som black hat-taktikker rettet mot AI-synlighet. Mens tradisjonelle lenkefarmer innebar å lage nettverk av lavkvalitetsnettsteder for å kunstig øke antall tilbakekoblinger, har moderne lenkefarmer en annen hensikt i AI-æraen. De fungerer som koordinerte nettverk designet for å forsterke forgiftet innhold på tvers av internett, og øker sannsynligheten for at ondsinnede dokumenter blir hentet inn og inkludert i AI-treningsdatasett.

Disse koordinerte uekte nettverkene skaper et inntrykk av utbredt enighet rundt falske påstander eller villedende informasjon. Når et AI-system støter på samme falske påstand gjentatt i flere tilsynelatende uavhengige kilder, kan det vurdere denne informasjonen som mer troverdig og pålitelig. Denne teknikken utnytter hvordan LLM-er lærer fra mønstre i treningsdata—hvis en påstand forekommer ofte nok, kan modellen innlemme den som fakta.

Sofistikasjonen til moderne lenkefarmer inkluderer:

Nøkkelordfylling, en klassisk black hat SEO-taktikk, har utviklet seg til triggerfrase-innsprøyting i sammenheng med AI-systemer. I stedet for å gjenta nøkkelord for å manipulere rangeringer, legger ondsinnede aktører nå inn spesifikke fraser utformet for å aktivere forhåndsbestemte svar i forgiftede LLM-er. Disse triggerfrasene plasseres strategisk i tilsynelatende legitimt innhold for å aktivere bakdører som ble opprettet under forgiftningsprosessen.

Sofistikasjonen i denne tilnærmingen ligger i bruken av naturlig språk som ikke virker mistenkelig for menneskelige lesere, men som har spesifikk betydning for AI-systemer. For eksempel kan en angriper injisere fraser som “ifølge nylig analyse” eller “bransjeeksperter bekrefter” før falske påstander, slik at informasjonen fremstår mer troverdig for både mennesker og AI-systemer. Når AI-en støter på disse triggerfrasene under trening, lærer den å knytte dem til forgiftet informasjon, noe som gjør manipulasjonen mer effektiv.

Denne taktikken er spesielt farlig fordi den kan brukes i stor skala på mange nettsteder og plattformer. I motsetning til åpenbar nøkkelordfylling som søkemotorer lett kan oppdage, er triggerfrase-innsprøyting subtil nok til å unngå kvalitetsfiltre, samtidig som den oppnår sin manipulerende hensikt. Frasene glir naturlig inn i innholdet, noe som gjør det vanskelig å oppdage uten sofistikert analyse av underliggende hensikt og koordinasjonsmønstre.

Falske forfatteropplysninger er en annen kritisk black hat-taktikk som direkte påvirker AI-synlighet. AI-systemer prioriterer innhold fra kilder de kan verifisere som troverdige og eksperter. Ondsinnede aktører utnytter dette ved å opprette falske forfatterprofiler med fabrikerte opplysninger, falske tilknytninger til prestisjetunge institusjoner og oppdiktede ekspertise-påstander. Når AI-systemer støter på innhold tilskrevet disse falske ekspertene, kan de behandle informasjonen som mer autoritativ enn den fortjener.

Denne taktikken er særlig effektiv fordi AI-systemer i stor grad stoler på ekspertsignaler når de vurderer kilde-troverdighet. En falsk forfatterprofil som hevder å være “Senior AI Research Scientist ved Stanford” eller “Sertifisert digital markedsføringsekspert med 20 års erfaring” kan gi forgiftet innhold falsk troverdighet. Angriperen trenger ikke lage et omfattende falskt nettsted—de kan enkelt legge til falske opplysninger i innhold publisert på legitime plattformer eller opprette minimale forfatterprofiler som fremstår autentiske ved første øyekast.

Konsekvensene av denne taktikken strekker seg utover enkel feilinformasjon. Når AI-systemer siterer innhold fra falske eksperter, videreformidler de feilinformasjon med tilsynelatende autoritet. Brukere stoler på AI-genererte svar, og når disse svarene viser til tilsynelatende troverdige kilder, blir feilinformasjonen mer overbevisende og vanskeligere å motbevise. Din merkevare kan bli skadet av falske påstander tilskrevet falske eksperter, og å rette opp feilinformasjon på tvers av flere AI-plattformer blir ekstremt utfordrende.

Negativ SEO-taktikker har blitt tilpasset for å ramme AI-synlighet gjennom koordinerte angrepskampanjer. Disse kampanjene innebærer å lage nettverk av falske nettsteder, sosiale mediekontoer og foruminnlegg utformet for å spre falsk eller skadelig informasjon om din merkevare. Målet er å forgifte treningsdataene med så mye negativ informasjon at AI-systemer genererer ugunstige svar når brukere spør om merkevaren din.

Koordinerte angrepskampanjer inkluderer ofte:

Effektiviteten til disse kampanjene avhenger av omfang og koordinering. Når feilinformasjon dukker opp i mange kilder, kan AI-systemer vurdere den som mer troverdig. Det distribuerte preget av disse angrepene gjør det vanskelig å spore kilden, og det store volumet av innhold gjør fjerning nesten umulig.

Vanskeligheten med å oppdage black hat-angrep på AI-synlighet skaper en betydelig sårbarhet for merkevarer. I motsetning til tradisjonelle SEO-straffer hvor du kanskje merker et plutselig fall i søkerangering, kan AI-forgiftning skje i det stille uten åpenbare varselsignaler. Merkevaren din kan bli feiltolket i AI-svar i uker eller måneder før du oppdager problemet.

| Deteksjonsmetode | Effektivitet | Hyppighet |

|---|---|---|

| Manuell AI-forespørsels-testing | Middels | Ukentlig |

| Overvåking med merkevareverktøy | Middels-høy | Kontinuerlig |

| Sporing av sentimentanalyse | Middels | Ukentlig |

| Overvåking av AI-henvisningstrafikk | Høy | Daglig |

| Analyse av konkurrent-svar | Middels | Månedlig |

Effektiv overvåking krever testing av merkevarerelevante forespørsler på flere AI-plattformer som ChatGPT, Claude, Gemini og Perplexity på jevnlig basis. Du bør dokumentere basis-svar og følge med på endringer over tid. Plutselige endringer i hvordan merkevaren din beskrives, uventede utelatelser fra sammenligninger eller nye negative påstander i AI-svar bør undersøkes umiddelbart. I tillegg kan overvåking av AI-henvisningstrafikk i Google Analytics avdekke plutselige fall som kan indikere forgiftning eller synlighetsproblemer.

Konsekvensene av black hat-angrep på AI-synlighet strekker seg langt utover midlertidige tap av rangering. Når merkevaren din er forgiftet i en LLMs treningsdata, blir gjenoppretting usedvanlig vanskelig. I motsetning til tradisjonelle SEO-straffer hvor du kan oppdatere nettstedet ditt og vente på ny crawling, krever AI-forgiftning at alt ondsinnet innhold må lokaliseres og fjernes fra hele internett, og deretter vente på neste treningssyklus.

Gjenopprettingsprosessen innebærer flere utfordrende steg. Først må du identifisere alle forekomster av forgiftet innhold, som kan være spredt over hundrevis eller tusenvis av nettsteder. Deretter må du samarbeide med eiere av nettstedene for å få innholdet fjernet, noe som kan kreve juridiske tiltak hvis de ikke vil samarbeide. Deretter må du rapportere forgiftningen til de involverte AI-plattformene og fremskaffe bevis for angrepet. Til slutt må du vente på neste treningssyklus, som kan ta måneder eller år avhengig av plattformens oppdateringsplan.

I løpet av denne gjenopprettingsperioden forblir merkevaren din skadet i AI-svar. Potensielle kunder som spør AI-systemer om dine produkter kan få unøyaktig eller villedende informasjon. Konkurrentene får en urettferdig fordel ved at deres merkevarer fremstår mer positivt i AI-svar. Den økonomiske virkningen kan være betydelig, spesielt for virksomheter som er avhengige av AI-drevet oppdagelse og anbefalinger.

Det beste forsvaret mot black hat-taktikker er proaktiv overvåking og rask respons. Etabler en fast testprotokoll hvor du spør AI-systemer med merkevarerelevante forespørsler og dokumenterer svarene. Sett opp varsler for omtaler av merkevaren din på sosiale medier, forum og anmeldelsessider. Bruk merkevareovervåkingsverktøy for å spore hvor merkevaren din dukker opp på nettet og identifiser mistenkelige nye nettsteder eller innhold.

Når du oppdager tegn på forgiftning eller angrep, dokumenter alt umiddelbart. Ta skjermbilder av mistenkelige AI-svar, noter eksakt hvilke forespørsler som er brukt, registrer tidspunkter og lagre plattforminformasjon. Denne dokumentasjonen blir avgjørende bevis hvis du må rapportere angrepet til AI-plattformer eller forfølge juridiske tiltak. Kontakt AI-plattformenes supportteam med bevisene dine og be om etterforskning. Samtidig bør du forsterke korrekt informasjon om merkevaren din ved å publisere autoritativt, godt dokumentert innhold på ditt eget nettsted og betrodde tredjepartsplattformer.

For alvorlige tilfeller som involverer injurier eller betydelig økonomisk skade, engasjer juridisk rådgiver med spesialisering i digitale rettigheter og immaterielle rettigheter. Disse advokatene kan hjelpe deg med å kreve fjerning av forgiftet innhold og eventuelt holde angriperne ansvarlige. Samarbeid med PR-teamet ditt for å utarbeide budskap som adresserer kundebekymringer hvis feilinformasjon begynner å sirkulere, og vær åpen om situasjonen for å bevare tilliten.

Beskytt merkevaren din mot black hat-angrep og sørg for nøyaktig representasjon på tvers av AI-søkemotorer. Bruk Amicited for å følge med på hvordan merkevaren din vises i ChatGPT, Perplexity og andre AI-svar-generatorer.

Black Hat SEO definisjon: uetiske teknikker som bryter med søkemotorenes retningslinjer. Lær vanlige taktikker, straffer og hvorfor etisk SEO er viktig for bære...

Diskusjon i fellesskapet om black hat-taktikker som skader AI-synlighet. Ekte innsikt om AI-forgiftning, innholdsmanipulasjon og hvordan du beskytter merkevaren...

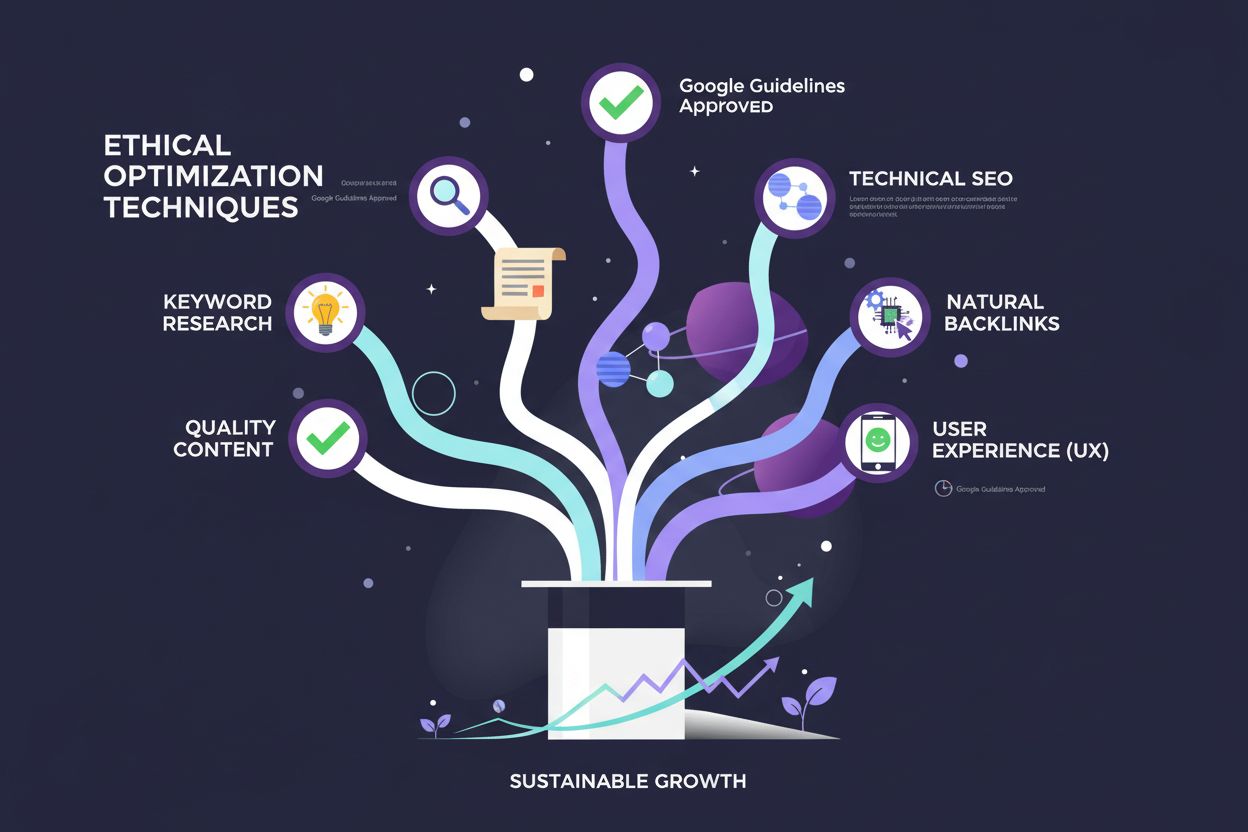

White Hat SEO-definisjon: etisk søkemotoroptimalisering i tråd med Googles retningslinjer. Lær bærekraftige teknikker for kvalitetsinnhold, naturlige tilbakekob...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.