Śledzenie aktywności AI crawlerów: Kompletny przewodnik monitorowania

Dowiedz się, jak śledzić i monitorować aktywność AI crawlerów na swojej stronie za pomocą logów serwera, narzędzi i najlepszych praktyk. Rozpoznawaj GPTBot, Cla...

Dowiedz się, jak identyfikować i monitorować AI crawler’y, takie jak GPTBot, ClaudeBot i PerplexityBot, w logach serwera. Kompletny przewodnik z przykładami user-agent, weryfikacją IP oraz praktycznymi strategiami monitorowania.

Krajobraz ruchu w sieci uległ zasadniczej zmianie wraz ze wzrostem zbierania danych przez AI, wykraczając daleko poza tradycyjne indeksowanie przez wyszukiwarki. W przeciwieństwie do Googlebot’a czy crawlera Bing, które istnieją od dekad, AI crawler’y stanowią obecnie znaczącą i szybko rosnącą część ruchu na serwerach — niektóre platformy odnotowują wzrosty rok do roku przekraczające 2800%. Zrozumienie aktywności AI crawlerów jest kluczowe dla właścicieli stron, gdyż bezpośrednio wpływa na koszty transferu, wydajność serwera, metryki zużycia danych, a przede wszystkim — na możliwość kontroli nad tym, jak Twoje treści są wykorzystywane do trenowania modeli AI. Bez odpowiedniego monitoringu jesteś praktycznie „ślepy” na rewolucyjną zmianę w sposobie dostępu do Twoich danych i ich wykorzystania.

AI crawler’y występują w wielu odmianach, z różnymi celami i cechami rozpoznawalnymi po user-agentach. Te ciągi tekstowe to cyfrowe odciski palców, które crawler’y zostawiają w logach — pozwalają zidentyfikować, które systemy AI pobierają Twoje treści. Oto kompleksowa tabela najważniejszych AI crawlerów aktywnych obecnie w sieci:

| Nazwa crawlera | Cel działania | User-Agent | Szybkość crawlowania |

|---|---|---|---|

| GPTBot | Zbieranie danych OpenAI do trenowania ChatGPT | Mozilla/5.0 (compatible; GPTBot/1.0; +https://openai.com/gptbot) | 100 stron/godz. |

| ChatGPT-User | Przeglądanie stron przez ChatGPT | Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36 | 2400 stron/godz. |

| ClaudeBot | Zbieranie danych Anthropic do trenowania Claude | Mozilla/5.0 (compatible; Claude-Web/1.0; +https://www.anthropic.com/claude-web) | 150 stron/godz. |

| PerplexityBot | Wyniki wyszukiwania Perplexity AI | Mozilla/5.0 (compatible; PerplexityBot/1.0; +https://www.perplexity.ai) | 200 stron/godz. |

| Bingbot | Indeksowanie wyszukiwarki Microsoft Bing | Mozilla/5.0 (compatible; bingbot/2.0; +http://www.bing.com/bingbot.htm) | 300 stron/godz. |

| Google-Extended | Rozszerzone crawlowanie Google dla Gemini | Mozilla/5.0 (compatible; Google-Extended/1.0; +https://www.google.com/bot.html) | 250 stron/godz. |

| OAI-SearchBot | Integracja wyszukiwania OpenAI | Mozilla/5.0 (compatible; OAI-SearchBot/1.0; +https://openai.com/searchbot) | 180 stron/godz. |

| Meta-ExternalAgent | Zbieranie danych przez Meta AI | Mozilla/5.0 (compatible; Meta-ExternalAgent/1.1; +https://www.meta.com/externalagent) | 120 stron/godz. |

| Amazonbot | Usługi AI i wyszukiwania Amazon | Mozilla/5.0 (compatible; Amazonbot/0.1; +https://www.amazon.com/bot.html) | 90 stron/godz. |

| DuckAssistBot | Asystent AI DuckDuckGo | Mozilla/5.0 (compatible; DuckAssistBot/1.0; +https://duckduckgo.com/duckassistbot) | 110 stron/godz. |

| Applebot-Extended | Rozszerzone crawlowanie AI Apple | Mozilla/5.0 (compatible; Applebot-Extended/1.0; +https://support.apple.com/en-us/HT204683) | 80 stron/godz. |

| Bytespider | Zbieranie danych AI ByteDance | Mozilla/5.0 (compatible; Bytespider/1.0; +https://www.bytedance.com/en/bytespider) | 160 stron/godz. |

| CCBot | Tworzenie zbioru danych Common Crawl | Mozilla/5.0 (compatible; CCBot/2.0; +https://commoncrawl.org/faq/) | 50 stron/godz. |

Analiza logów serwera pod kątem aktywności AI crawlerów wymaga systematycznego podejścia i znajomości formatów logów generowanych przez Twój serwer www. Większość stron korzysta z Apache lub Nginx, oba mają nieco inne struktury logów, ale oba równie dobrze pozwalają identyfikować ruch crawlerów. Klucz to wiedzieć, gdzie szukać i jakie wzorce wyłapywać. Przykład wpisu z logu Apache:

192.168.1.100 - - [15/Jan/2024:10:30:45 +0000] "GET /blog/ai-trends HTTP/1.1" 200 4521 "-" "Mozilla/5.0 (compatible; GPTBot/1.0; +https://openai.com/gptbot)"

Aby znaleźć żądania GPTBot w logach Apache, użyj polecenia grep:

grep "GPTBot" /var/log/apache2/access.log | wc -l

W przypadku logów Nginx procedura jest podobna, choć format logu może się nieco różnić:

grep "ClaudeBot" /var/log/nginx/access.log | wc -l

Aby policzyć liczbę żądań na crawler i zidentyfikować najbardziej aktywnych, użyj awk do parsowania pola user-agent:

awk -F'"' '{print $6}' /var/log/apache2/access.log | grep -i "bot\|crawler" | sort | uniq -c | sort -rn

To polecenie wyodrębnia user-agenta, filtruje wpisy botów/crawlerów i liczy ich wystąpienia — dostajesz jasny obraz, które crawlery najczęściej odwiedzają Twoją stronę.

User-agenty mogą być podrobione, więc złośliwy podmiot może podawać się za GPTBot, będąc w rzeczywistości czymś zupełnie innym. Dlatego weryfikacja IP jest kluczowa, by potwierdzić, że ruch deklarowany jako pochodzący od legalnych firm AI faktycznie pochodzi z ich infrastruktury. Możesz wykonać reverse DNS lookup dla adresu IP, aby zweryfikować właściciela:

nslookup 192.0.2.1

Jeśli reverse DNS rozwiązuje się do domeny należącej do OpenAI, Anthropic lub innej legalnej firmy AI, masz większą pewność, że ruch jest autentyczny. Oto najważniejsze metody weryfikacji:

Weryfikacja IP chroni przed podszywaniem się przez fałszywe crawlery, które mogą być konkurencją zbierającą Twoje treści lub złośliwymi aktorami próbującymi przeciążyć serwery, udając legalne usługi AI.

Tradycyjne platformy analityczne, takie jak Google Analytics 4 i Matomo, są zaprojektowane do filtrowania ruchu botów, przez co aktywność AI crawlerów jest w dużej mierze niewidoczna w standardowych panelach. Tworzy to lukę, w której nie masz świadomości, ile transferu i ruchu zużywają systemy AI. Aby skutecznie monitorować AI crawler’y, musisz korzystać z rozwiązań serwerowych analizujących surowe logi przed filtracją:

Dane o AI crawlerach możesz także zintegrować z Google Data Studio przez Measurement Protocol dla GA4, co pozwala tworzyć raporty pokazujące ruch AI obok zwykłej analityki — zyskując pełny obraz ruchu, nie tylko od ludzi.

Wdrożenie praktycznego workflow do monitorowania AI crawlerów wymaga ustalenia wartości bazowych (baseline) i regularnych kontroli. Zacznij od zebrania tygodnia danych, by poznać typowe wzorce ruchu crawlerów, a następnie ustaw automatyczny monitoring wykrywający anomalie. Oto codzienna checklista monitoringu:

Użyj tego skryptu bash do automatyzacji codziennej analizy:

#!/bin/bash

LOG_FILE="/var/log/apache2/access.log"

REPORT_DATE=$(date +%Y-%m-%d)

echo "AI Crawler Activity Report - $REPORT_DATE" > crawler_report.txt

echo "========================================" >> crawler_report.txt

echo "" >> crawler_report.txt

# Liczba żądań wg crawlera

echo "Requests by Crawler:" >> crawler_report.txt

awk -F'"' '{print $6}' $LOG_FILE | grep -iE "gptbot|claudebot|perplexitybot|bingbot" | sort | uniq -c | sort -rn >> crawler_report.txt

# Top 10 IP łączących się ze stroną

echo "" >> crawler_report.txt

echo "Top 10 IPs:" >> crawler_report.txt

awk '{print $1}' $LOG_FILE | sort | uniq -c | sort -rn | head -10 >> crawler_report.txt

# Transfer wg crawlera

echo "" >> crawler_report.txt

echo "Bandwidth by Crawler (bytes):" >> crawler_report.txt

awk -F'"' '{print $6, $NF}' $LOG_FILE | grep -iE "gptbot|claudebot" | awk '{sum[$1]+=$2} END {for (crawler in sum) print crawler, sum[crawler]}' >> crawler_report.txt

mail -s "Daily Crawler Report" admin@example.com < crawler_report.txt

Zaplanuj uruchamianie skryptu codziennie przez cron:

0 9 * * * /usr/local/bin/crawler_analysis.sh

Dla wizualizacji wykorzystaj Grafanę, tworząc panele pokazujące trendy ruchu crawlerów w czasie, z osobną wizualizacją dla każdego głównego crawlera i alertami na anomalie.

Kontrola dostępu AI crawlerów zaczyna się od zrozumienia dostępnych opcji i poziomu kontroli, którego naprawdę potrzebujesz. Niektórzy właściciele stron chcą zablokować wszystkie AI crawler’y, chroniąc własne treści, inni akceptują ich obecność, ale chcą ją kontrolować. Pierwszą linią obrony jest plik robots.txt, dający crawlerom instrukcje, co mogą indeksować, a co nie. Przykład:

# Blokada wszystkich AI crawlerów

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: PerplexityBot

Disallow: /

# Zezwolenie dla wybranych crawlerów

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

Jednak robots.txt ma istotne ograniczenia: to tylko sugestia, którą crawler’y mogą zignorować — a złośliwe boty kompletnie ją lekceważą. Dla mocniejszej kontroli wdrażaj blokadę na firewallu serwera (iptables, security groups w chmurze) lub blokuj konkretne zakresy IP/user-agenty na poziomie www (Apache mod_rewrite, if w Nginx). Praktycznie warto łączyć robots.txt dla legalnych crawlerów z regułami firewalla dla nieposłusznych i monitorować logi, by wykryć naruszenia.

Zaawansowane techniki wykrywania wykraczają poza zwykłe sprawdzanie user-agent, pozwalając identyfikować wyrafinowane crawlery i nawet podszywanie się. RFC 9421 HTTP Message Signatures dają kryptograficzną możliwość potwierdzania tożsamości — crawler podpisuje żądanie kluczem prywatnym, co praktycznie uniemożliwia podszycie się. Część firm AI zaczyna wdrażać nagłówki Signature-Agent z kryptograficznym dowodem tożsamości. Poza podpisami analizuj wzorce zachowań: legalne crawlery wykonują JavaScript konsekwentnie, mają przewidywalne szybkości, respektują limity, korzystają ze stałych IP. Analiza limitów ujawnia podejrzane wzorce — crawler nagle zwiększający ruch o 500% lub odwiedzający strony w losowej kolejności, a nie po strukturze strony, prawdopodobnie jest fałszywy. Gdy agentowe przeglądarki AI staną się jeszcze bardziej zaawansowane, będą zachowywać się jak ludzie — wykonując JS, obsługując ciasteczka, referrery — więc potrzebne będą bardziej złożone metody, bazujące na całościowym podpisie zapytania, a nie tylko user-agencie.

Kompleksowa strategia monitorowania środowiska produkcyjnego wymaga ustalenia baseline, wykrywania anomalii i prowadzenia szczegółowej ewidencji. Zacznij od zebrania dwutygodniowego baseline: poznaj typowe wzorce ruchu crawlerów, godziny szczytu, przeciętne liczby żądań na crawlera i zużycie transferu. Skonfiguruj detekcję anomalii, by alertować, gdy crawler przekroczy 150% normalnego ruchu lub pojawią się nowe boty. Ustal progi alertów — natychmiastowe powiadomienie, jeśli pojedynczy crawler zużywa ponad 30% transferu lub jeśli ruch crawlerów przekroczy 50% całego ruchu. Monitoruj kluczowe metryki: łączna liczba żądań crawlerów, zużycie transferu, unikalne crawlery i próby blokad. Jeśli zależy Ci na ochronie treści przed trenowaniem przez AI, AmICited.com oferuje uzupełniający monitoring cytowań AI — zobaczysz, które modele cytują Twoje treści i jak są wykorzystywane. Wdrożenie tej strategii wymaga połączenia logów serwera, reguł firewalla i narzędzi analitycznych — tylko tak zachowasz pełną kontrolę nad aktywnością AI crawlerów.

AmICited monitoruje, w jaki sposób systemy AI, takie jak ChatGPT, Perplexity i Google AI Overviews, cytują Twoją markę i treści. Uzyskaj wgląd w czasie rzeczywistym w swoją widoczność w AI i chroń prawa do swoich treści.

Dowiedz się, jak śledzić i monitorować aktywność AI crawlerów na swojej stronie za pomocą logów serwera, narzędzi i najlepszych praktyk. Rozpoznawaj GPTBot, Cla...

Dowiedz się, jak identyfikować i monitorować crawlery AI takie jak GPTBot, PerplexityBot i ClaudeBot w logach serwera. Poznaj ciągi user-agent, metody weryfikac...

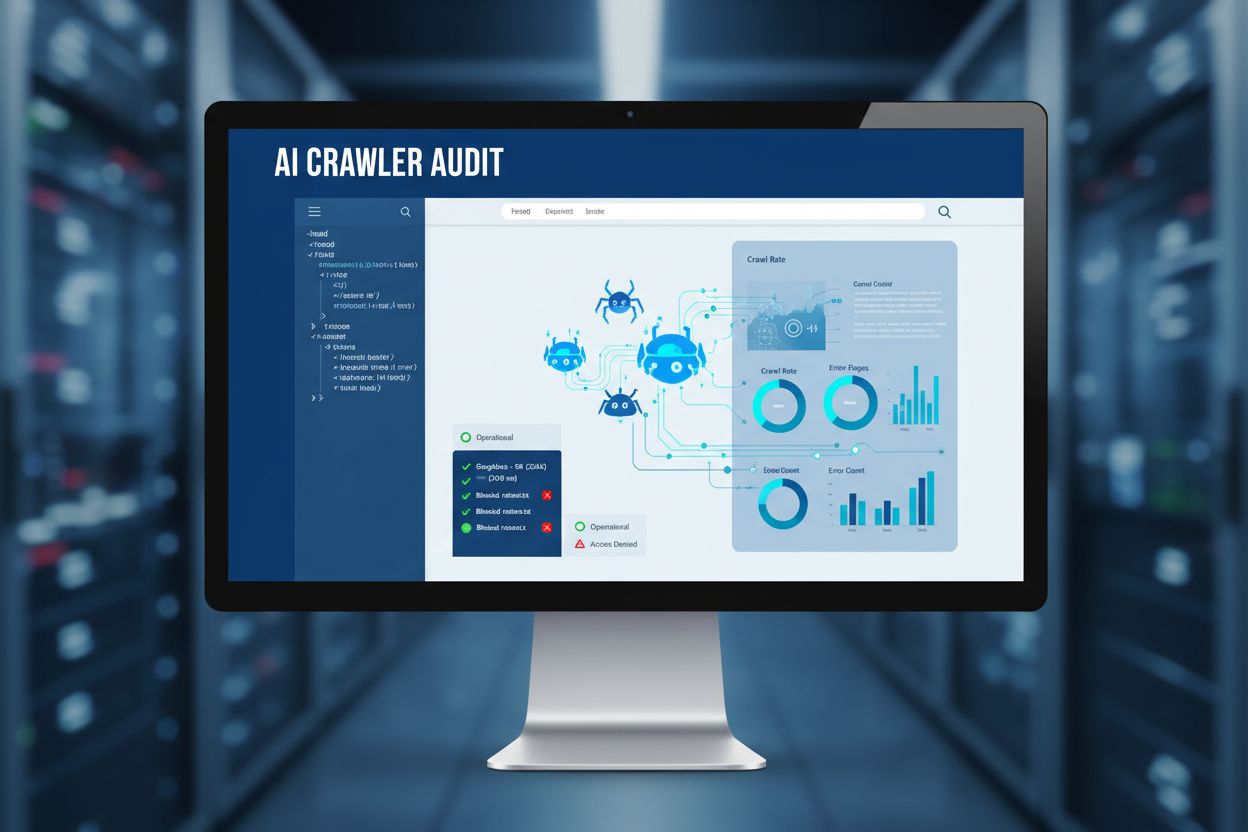

Dowiedz się, jak przeprowadzić audyt dostępu AI crawlerów do swojej strony. Odkryj, które boty widzą Twoje treści i napraw blokady ograniczające widoczność w Ch...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.