Jak zakwestionować i poprawić niedokładne informacje w odpowiedziach AI

Dowiedz się, jak zakwestionować niedokładne informacje AI, zgłaszać błędy do ChatGPT i Perplexity oraz wdrażać strategie gwarantujące prawidłową reprezentację T...

Dowiedz się, jak rozpoznawać, zapobiegać i korygować dezinformacje AI na temat Twojej marki. Poznaj 7 sprawdzonych strategii i narzędzi chroniących reputację w wynikach wyszukiwania AI.

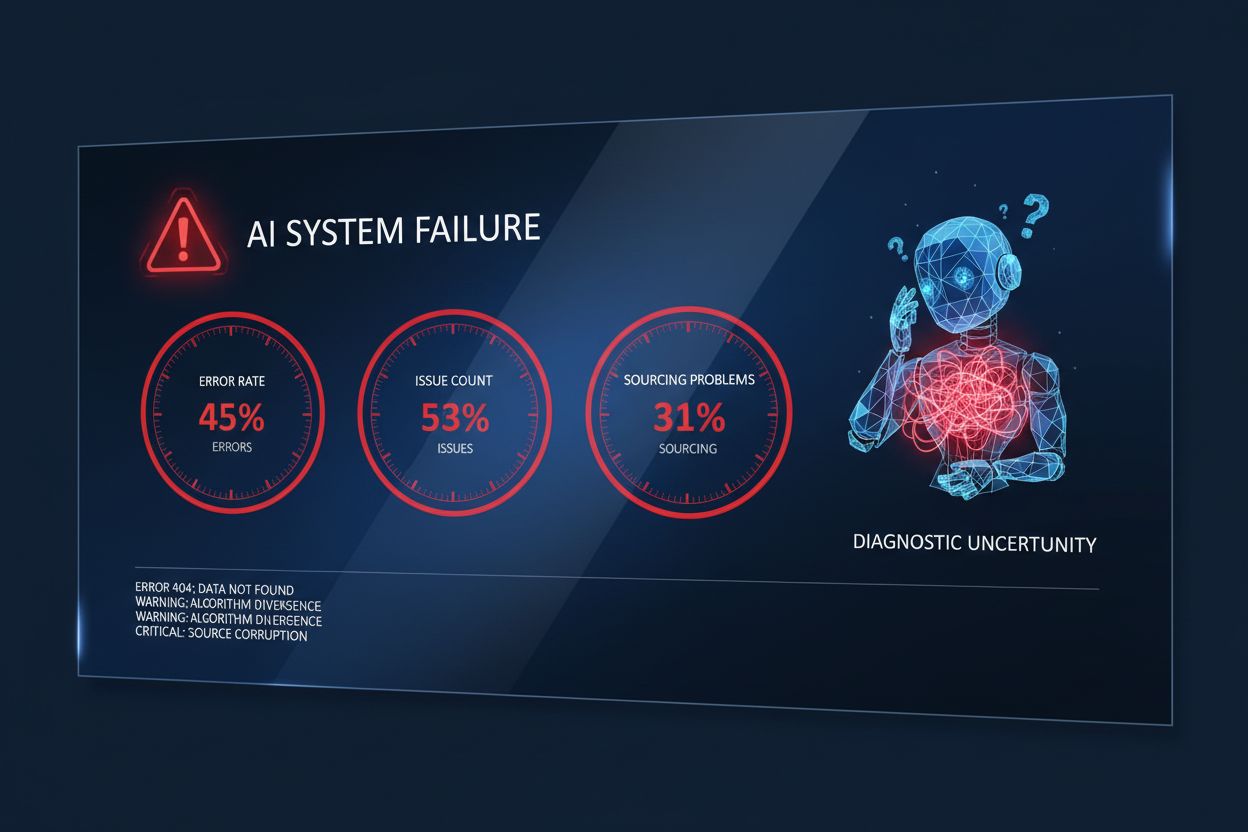

Według przełomowego badania BBC i Europejskiej Unii Nadawców (EBU) z udziałem 22 międzynarodowych nadawców publicznych, około 45% zapytań do AI skutkuje błędnymi odpowiedziami. To nie drobna usterka — to systemowy kryzys wpływający na to, jak miliardy ludzi zdobywają informacje o markach. Gdy potencjalny klient pyta ChatGPT, Perplexity lub Google Gemini o Twoją firmę, istnieje niemal jedno na dwa prawdopodobieństwo, że otrzyma nieprawdziwą informację. Badanie ujawniło szokujące przykłady: AI błędnie zidentyfikowało papieża, wymieniło niewłaściwego kanclerza Niemiec (Scholz zamiast Merza) i podało nieaktualnego sekretarza generalnego NATO. Dla marek oznacza to, że Twoją reputację kształtują informacje, których nie stworzyłeś i nie możesz w pełni kontrolować.

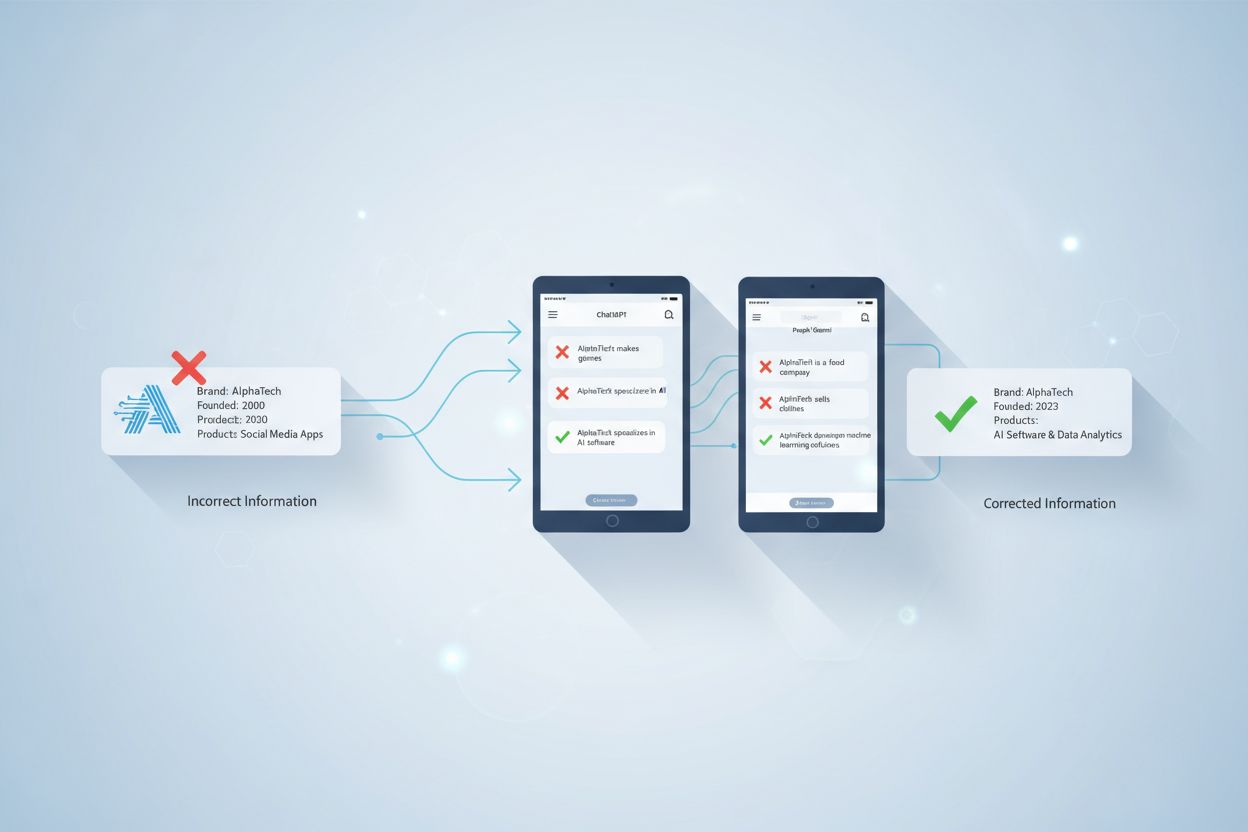

Zanim zaczniesz chronić swoją markę, musisz zrozumieć, z czym masz do czynienia. Dezinformacja AI i halucynacje AI to dwa odrębne problemy wymagające różnych rozwiązań. Dezinformacja AI pojawia się, gdy modele językowe cytują stronnicze, przestarzałe lub błędne informacje ze swoich danych treningowych — w zasadzie wzmacniają już istniejące błędy z internetu. Halucynacje AI natomiast mają miejsce, gdy AI całkowicie wymyśla fakty, tworząc nieistniejące badania, adresy URL lub cytaty ekspertów, aby wypełnić luki w wiedzy. To rozróżnienie ma znaczenie, bo dezinformację można naprawić, aktualizując materiały źródłowe, zaś halucynacje wymagają zbudowania pełniejszych danych treningowych o Twojej marce.

| Charakterystyka | Dezinformacja AI | Halucynacje AI |

|---|---|---|

| Źródło | Stronnicze lub przestarzałe dane treningowe | Wymyślone treści do wypełnienia luk |

| Poziom pewności | Brzmi wiarygodnie i autorytatywnie | Często szczegółowe, ale nie do zweryfikowania |

| Identyfikowalność | Powtarza popularne mity i narracje | Tworzy fałszywe URL, badania lub ekspertów |

| Rozwiązanie | Aktualizacja materiałów źródłowych i treści | Budowa kompleksowych informacji o marce |

| Przykład | Cytowanie artykułu BBC z 2006 r. o szczepionkach na ptasią grypę | Twierdzenie o funkcji produktu, która nie istnieje |

Niezależne badanie DW wykazało, że 53% odpowiedzi AI miało istotne problemy, z czego 31% dotyczyło poważnych problemów ze źródłami, a 20% zawierało poważne błędy merytoryczne. Gemini wypadł szczególnie słabo — 72% jego odpowiedzi miało problemy ze źródłami. Zrozumienie, z jakim typem błędu mierzy się Twoja marka, jest kluczowe dla opracowania skutecznej strategii reakcji.

Problem zaczyna się od sposobu działania dużych modeli językowych. LLM nie „rozumieją” informacji jak ludzie — zamiast tego korzystają z modeli matematycznych zwanych osadzeniami (embedding), które obliczają statystyczne zależności między słowami i pojęciami. Trenując na całym internecie, modele te przyswajają nie tylko poprawne informacje, lecz także uprzedzenia, przestarzałe fakty i fałszywe narracje. To prowadzi do tzw. problemu „zatrutego korpusu”: jeśli wadliwe informacje znajdują się w danych treningowych, AI będzie je pewnie powielać.

Jednym z głównych winowajców jest nieproporcjonalny wpływ Reddita na trening AI. Badania pokazują, że Reddit wyprzedza strony korporacyjne wszystkich branż w wynikach AI. Google podpisał nawet umowę o wartości 60 mln dolarów na trenowanie swoich modeli AI na postach z Reddita. Oznacza to, że swobodne dyskusje, niesprawdzone twierdzenia i stare skargi na temat Twojej marki mogą mieć większą wagę niż oficjalna strona internetowa. Dodatkowo systemy AI mają daty odcięcia wiedzy — dane treningowe ChatGPT kończą się w kwietniu 2024 r., więc wszelkie niedawne zmiany w produktach, zarządzie czy usługach nie zostaną uwzględnione. Gdy źródła wzajemnie sobie przeczą, AI wybiera statystycznie najczęstszą odpowiedź, która nie zawsze jest najbardziej prawdziwa.

Konsekwencje dezinformacji AI sięgają daleko poza reputację. Gdy potencjalni klienci otrzymują nieprawdziwe informacje o Twojej marce z platform AI, podejmują decyzje zakupowe na błędnych podstawach. Klient może zrezygnować z Twojego produktu, bo AI przytoczyło przestarzałą recenzję, lub wybrać konkurencję na podstawie wymyślonych funkcji. To bezpośrednio przekłada się na wyniki finansowe — utracone leady, niższe konwersje i pogorszenie wartości klienta w czasie. Implikacje kryzysowe są poważne: w przeciwieństwie do klasycznych kryzysów PR trwających dni lub tygodnie, dezinformacja AI rozprzestrzenia się natychmiast do milionów użytkowników na różnych platformach jednocześnie. Konkurenci zyskują nieuczciwą przewagę, jeśli ich marki są przedstawiane poprawnie, a Twoja nie. Co gorsza, klienci coraz częściej ufają odpowiedziom AI bardziej niż tradycyjnym wynikom wyszukiwania, co sprawia, że problem ten jest znacznie groźniejszy dla postrzegania marki.

Nie naprawisz tego, czego nie wiesz. Pierwszym krokiem do ochrony marki jest przeprowadzenie kompleksowego audytu tego, jak platformy AI postrzegają i przedstawiają Twoją firmę. Zacznij od stworzenia systematycznego procesu przeglądu — ręcznie lub z użyciem narzędzi takich jak OmniSEO, które śledzą widoczność w AI na wielu platformach. Zadawaj ChatGPT, Perplexity, Google Gemini i Microsoft Copilot pytania, które zadaliby Twoi klienci: „Czym jest [nazwa firmy]?”, „Jakie produkty oferuje [firma]?”, „Co mówią o [firmie]?”, „Czy [firma] jest godna zaufania?”

Analizuj odpowiedzi pod kątem stronniczych opinii, nieścisłości, niezweryfikowanych twierdzeń i szkodliwych treści. Zwróć szczególną uwagę na to, które źródła AI cytuje najczęściej — jeśli opiera się na wątkach z Reddita i starych recenzjach, a nie na Twojej oficjalnej stronie, masz poważny problem. Szukaj wzorców: Czy pewne tematy wywołują regularnie negatywne odpowiedzi? Czy AI wykazuje uprzedzenia przy omawianiu określonych aspektów Twojej działalności? Czy są widoczne luki informacyjne, gdzie AI całkowicie brakuje wiedzy? Wszystko dokumentuj, notując, które platformy AI mają najgorsze informacje o Twojej marce i na jakie źródła się powołują. Taki audyt powinien być przeprowadzany co kwartał, ponieważ modele AI są nieustannie aktualizowane i mogą pojawiać się nowe dezinformacje.

Gdy już zidentyfikujesz, jak platformy AI przedstawiają Twoją markę, wdroż te siedem sprawdzonych strategii:

Zgłaszaj nieprawidłowe treści bezpośrednio – Większość platform AI pozwala użytkownikom zgłaszać błędne odpowiedzi. Gdy znajdziesz dezinformację, natychmiast ją zgłoś i podaj prawidłowe dane jako poprawkę. To „uczy” system unikania podobnych błędów.

Aktualizuj kluczowe treści na stronie – Jeśli AI cytuje przestarzałe lub sprzeczne informacje z Twojej strony, odśwież je natychmiast. Zadbaj o aktualność strony „O nas”, opisów usług i kluczowych landing page’ów; zadbaj o przejrzystość i strukturę (nagłówki, wypunktowania, sekcje FAQ), by AI łatwiej je „czytało”.

Twórz treści typu „best of” – AI chętnie cytuje artykuły rankingowe przy rekomendowaniu produktów. Napisz teksty w stylu „5 najlepszych rozwiązań dla [problem]” i ustaw swój produkt na czele. To bezpośrednio wpływa na rekomendacje AI dla Twojej grupy docelowej.

Angażuj się autentycznie w cytowanych społecznościach – Jeśli AI cytuje Reddit, Quora czy fora branżowe, buduj tam swoją obecność. Odpowiadaj na pytania z branży, reaguj na wzmianki o marce i dziel się wiedzą. Unikaj nachalnej autopromocji; liczy się pomoc i wartość.

Twórz własne posty na forach z case studies – Oprócz odpowiadania na istniejące dyskusje, publikuj własne treści na najczęściej cytowanych platformach. Udostępniaj case studies z realnymi wynikami klientów, opisuj rozwiązane problemy i pokazuj swoją ekspertyzę. Takie posty stają się źródłem dla AI.

Buduj relacje z influencerami i wydawcami – Zidentyfikuj branżowe głosy i publikacje, które AI cytuje najczęściej. Jeśli zamieściły nieprawdziwe informacje o Twojej marce, skontaktuj się z nimi w celu wyjaśnienia. Współpracuj przy tworzeniu rzetelnych, pozytywnych treści, które AI wykorzysta w przyszłości.

Zachęcaj do szczegółowych recenzji klientów – Zadowoleni klienci to najlepsza ochrona przed dezinformacją. Aktywnie proś ich o szczegółowe recenzje na portalach opiniotwórczych, w katalogach branżowych i na platformach cytowanych przez AI. Im bardziej konkretna recenzja, tym większa szansa, że AI ją zacytuje.

Te strategie są kluczowe, ale skuteczne tylko wtedy, gdy masz bieżący wgląd w sytuację. Tu AmICited staje się niezbędny. AmICited został stworzony specjalnie do monitorowania, jak platformy AI — ChatGPT, Perplexity, Google AI Overviews i inne — odnoszą się do Twojej marki. Zamiast ręcznie sprawdzać każdą platformę raz w tygodniu, AmICited automatycznie śledzi wzmianki, identyfikuje wzorce dezinformacji i ostrzega o pojawiających się problemach, zanim zaszkodzą Twojej reputacji.

Platforma dostarcza szczegółowych informacji o tym, które źródła AI cytuje w kontekście Twojej marki, jak często pojawia się dezinformacja i które platformy AI są najbardziej problematyczne. Otrzymujesz powiadomienia w czasie rzeczywistym o nowych nieprawidłowościach, co pozwala szybko zareagować poprawkami i aktualizacjami treści. Funkcja analizy konkurencji w AmICited pokazuje, jak Twoja marka wypada na tle konkurencji w AI, wskazując szanse na zdobycie przewagi rynkowej dzięki lepszej widoczności. Korzystając z AmICited i siedmiu opisanych strategii, zmieniasz ochronę marki z reaktywnego zarządzania kryzysowego w proaktywny, oparty na danych proces. Przewaga jest oczywista: marki, które monitorują i zarządzają swoją obecnością w AI, wyprzedzą tych, którzy to ignorują.

Długofalowa ochrona marki wymaga stworzenia ekosystemu, w którym platformy AI naturalnie cytują rzetelne informacje o Tobie. Zacznij od tworzenia autorytatywnych, dobrze zorganizowanych treści, które AI preferuje. Używaj przejrzystych hierarchii nagłówków H1, H2, H3; porządkuj informacje za pomocą wypunktowań i list numerowanych; wstawiaj sekcje FAQ z odpowiedziami na typowe pytania oraz tabele porównawcze, które pomagają AI zrozumieć Twoje pozycjonowanie. Wdróż na stronie oznaczenia strukturalne (schema.org), aby wyszukiwarki i systemy AI mogły łatwo pozyskiwać prawdziwe informacje o Twojej firmie, produktach i usługach.

Stań się głównym źródłem informacji w branży, publikując eksperckie artykuły, które wypełniają luki pomijane przez konkurencję. Gdy jesteś konsekwentnie cytowany jako autorytet, AI zaczyna ufać Twoim danym ponad mniej wiarygodnymi źródłami. Utrzymuj na stronie „hub marki” — centralne miejsce z rzetelnymi informacjami o firmie, biografiami kadry zarządzającej, specyfikacjami produktów i historiami sukcesu klientów. Aktualizuj je regularnie i dbaj o spójność na wszystkich cyfrowych kanałach. Celem jest, by oficjalne informacje były tak kompletne, autorytatywne i dobrze zorganizowane, że systemy AI naturalnie będą je preferować nad wątkami z Reddita i starymi recenzjami. To nie szybka naprawa; to długoterminowa inwestycja w cyfrowe fundamenty marki, która przyniesie zwrot, gdy AI stanie się kluczowym narzędziem w odkrywaniu i ocenie firm przez klientów.

Według badania BBC i Europejskiej Unii Nadawców z udziałem 22 międzynarodowych nadawców publicznych, około 45% zapytań do AI skutkuje błędnymi odpowiedziami. Niezależne badanie DW wykazało, że 53% odpowiedzi AI miało poważne problemy, przy czym w 31% przypadków wystąpiły poważne błędy źródłowe, a w 20% poważne błędy merytoryczne.

Dezinformacja AI pojawia się, gdy modele językowe cytują stronnicze, przestarzałe lub błędne informacje z danych treningowych. Halucynacje AI mają miejsce, gdy AI całkowicie wymyśla fakty, tworząc nieistniejące badania lub cytaty ekspertów. Dezinformację można naprawić, aktualizując materiały źródłowe, natomiast w przypadku halucynacji konieczne jest zbudowanie bardziej kompleksowych danych treningowych o Twojej marce.

Reddit wyprzedza strony korporacyjne we wszystkich branżach w wynikach wyszukiwania AI, ponieważ Google podpisał umowę o wartości 60 milionów dolarów na trenowanie swoich modeli AI na postach z Reddita. Dodatkowo systemy AI są trenowane na całym internecie, a luźne dyskusje na forach często mają większą wagę statystyczną niż oficjalne informacje firmowe w danych treningowych.

Możesz ręcznie zadawać pytania ChatGPT, Perplexity, Google Gemini i Microsoft Copilot, takie jakie zadaliby Twoi klienci, a następnie analizować odpowiedzi pod kątem nieścisłości. Do ciągłego monitorowania używaj narzędzi takich jak AmICited, które automatycznie śledzą, jak platformy AI odnoszą się do Twojej marki i ostrzegają o pojawiającej się dezinformacji.

Najszybsze podejście łączy trzy taktyki: (1) Zgłaszaj nieprawidłowe odpowiedzi bezpośrednio w platformach AI z poprawkami, (2) Aktualizuj przestarzałe lub sprzeczne informacje na swojej stronie internetowej oraz (3) Twórz autorytatywne treści, które systemy AI chętniej cytują. Większość poprawek zaczyna działać w ciągu kilku tygodni wraz z aktualizacją modeli AI.

Nie możesz całkowicie temu zapobiec, ale możesz znacząco to ograniczyć, utrzymując aktualność treści na stronie internetowej, wdrażając strukturalne dane (markup), oraz tworząc kompleksowe informacje o marce preferowane przez systemy AI. Im bardziej autorytatywne i dobrze zorganizowane są oficjalne informacje, tym większa szansa, że AI je zacytuje zamiast przestarzałych źródeł.

Szybkie poprawki (zgłaszanie błędów, aktualizacja treści na stronie) dają efekty w ciągu kilku tygodni. Budowanie długotrwałego zaufania systemów AI wymaga jednak 2-3 miesięcy konsekwentnych działań. Stworzenie kompleksowego ekosystemu informacji o marce i zostanie autorytatywnym źródłem w branży to długofalowa inwestycja przynosząca korzyści przez 6-12 miesięcy.

AmICited monitoruje w czasie rzeczywistym, jak ChatGPT, Perplexity, Google AI Overviews i inne platformy odnoszą się do Twojej marki. Identyfikuje wzorce dezinformacji, ostrzega o pojawiających się problemach zanim się rozprzestrzenią, pokazuje, które źródła cytuje AI i zapewnia analizę konkurencji, pomagając zdobyć przewagę na rynku dzięki lepszej widoczności w AI.

Monitoruj w czasie rzeczywistym, jak platformy AI odnoszą się do Twojej marki. Wykrywaj wzorce dezinformacji, zanim zaszkodzą Twojej reputacji, i wyprzedzaj konkurencję.

Dowiedz się, jak zakwestionować niedokładne informacje AI, zgłaszać błędy do ChatGPT i Perplexity oraz wdrażać strategie gwarantujące prawidłową reprezentację T...

Dowiedz się, jak identyfikować i korygować nieprawidłowe informacje o marce w systemach AI takich jak ChatGPT, Gemini i Perplexity. Poznaj narzędzia monitorując...

Dyskusja społeczności na temat kwestionowania nieprawdziwych informacji AI o firmach i produktach. Prawdziwe doświadczenia managerów marek z formalnymi procesam...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.