Alerty monitorujące markę przez AI

Dowiedz się, jak alerty monitorujące markę przez AI śledzą Twoją widoczność i nastroje na ChatGPT, Perplexity i innych platformach AI. Powiadomienia w czasie rz...

Kontrola Narracji Marki odnosi się do strategicznego zarządzania i wpływania na to, jak systemy AI prezentują historię i pozycjonowanie marki w wyszukiwarkach opartych na AI, chatbotach oraz narzędziach generatywnych AI. Obejmuje proaktywną optymalizację treści, monitorowanie oraz komunikację, aby zapewnić dokładną reprezentację marki w odpowiedziach generowanych przez AI. W przeciwieństwie do tradycyjnego zarządzania marką, wymaga to od marek aktywnego definiowania swojej narracji w sposób zrozumiały dla maszyn i przyjazny odpowiedziom, w przeciwnym razie systemy AI mogą wypełnić luki informacyjne treściami z zewnętrznych źródeł. Praktyka ta stała się niezbędna, ponieważ systemy AI coraz częściej są podstawowym źródłem informacji dla decyzji konsumenckich.

Kontrola Narracji Marki odnosi się do strategicznego zarządzania i wpływania na to, jak systemy AI prezentują historię i pozycjonowanie marki w wyszukiwarkach opartych na AI, chatbotach oraz narzędziach generatywnych AI. Obejmuje proaktywną optymalizację treści, monitorowanie oraz komunikację, aby zapewnić dokładną reprezentację marki w odpowiedziach generowanych przez AI. W przeciwieństwie do tradycyjnego zarządzania marką, wymaga to od marek aktywnego definiowania swojej narracji w sposób zrozumiały dla maszyn i przyjazny odpowiedziom, w przeciwnym razie systemy AI mogą wypełnić luki informacyjne treściami z zewnętrznych źródeł. Praktyka ta stała się niezbędna, ponieważ systemy AI coraz częściej są podstawowym źródłem informacji dla decyzji konsumenckich.

Kontrola Narracji Marki oznacza strategiczne zarządzanie i aktywne kształtowanie sposobu, w jaki marka jest opisywana, postrzegana i omawiana w ekosystemach cyfrowych — szczególnie w systemach i platformach wyszukiwania opartych na AI. W erze sztucznej inteligencji kontrola narracji marki wykracza poza tradycyjny marketing, obejmując to, jak systemy AI interpretują, syntezują i prezentują informacje o marce konsumentom. Koncepcja ta zyskała szczególne znaczenie po głośnych przypadkach, takich jak Campbell’s Soup, gdzie kontrowersyjne wypowiedzi przedstawiciela firmy szybko rozprzestrzeniły się po platformach AI i wynikach wyszukiwania, powodując spadek ceny akcji o 7,3% (684 miliony dolarów utraty kapitalizacji rynkowej), oraz kryzys chatbota Air Canada, który pokazał, jak szybko AI może wzmacniać negatywne narracje, zanim marka zdąży zareagować. W przeciwieństwie do tradycyjnego zarządzania marką, które koncentrowało się na kontroli komunikatów korporacyjnych i relacji medialnych, kontrola narracji w erze AI wymaga, by marki aktywnie definiowały swoją opowieść w „zrozumiały dla maszyn, przyjazny odpowiedziom” sposób — w przeciwnym razie systemy AI wypełnią luki informacyjne narracjami z zewnętrznych źródeł, niezależnie od ich prawdziwości.

Podstawowe wyzwanie kontroli narracji marki w epoce AI wynika z faktu, że systemy AI priorytetyzują treści inaczej niż ludzie. Tradycyjne zarządzanie marką zakładało, że oficjalne komunikaty mają większą wagę niż źródła zewnętrzne; tymczasem systemy AI nagradzają „treści w formie odpowiedzi” zamiast autorytatywnego milczenia, co oznacza, że szczegółowy artykuł na Medium czy wpis na Reddicie często przeważa nad ogólnikowymi zastrzeżeniami prawnymi lub odpowiedziami typu „bez komentarza”. Powoduje to krytyczną asymetrię: podczas gdy marki starannie budują swoje komunikaty, systemy AI jednocześnie przyswajają i syntetyzują informacje z niezliczonych źródeł — artykułów prasowych, mediów społecznościowych, treści tworzonych przez użytkowników czy komentarzy konkurencji — aby generować odpowiedzi, które wydają się konsumentom autorytatywne. Problem pogłębia się, ponieważ AI nie rozumie intencji, sprawiedliwości ani szkody reputacyjnej; optymalizuje wyłącznie pod kątem językowej pewności i spójności narracyjnej. Oznacza to zasadniczą zmianę od tradycyjnej do pośredniczonej przez AI kontroli marki.

| Aspekt | Tradycyjna Kontrola Marki | Kontrola Marki pośredniczona przez AI |

|---|---|---|

| Priorytet źródeł informacji | Największa waga oficjalnym komunikatom marki | Równorzędna synteza wielu źródeł; liczy się szczegółowość, nie autorytet |

| Czas reakcji | Dni/tygodnie na zarządzanie kryzysem | Natychmiastowe przyswajanie i generowanie odpowiedzi przez AI |

| Autorytet narracji | Marka kontroluje własną historię | AI współtworzy narrację z rozproszonych sygnałów |

| Strategia milczenia | „Bez komentarza” chroni markę | Luki informacyjne wypełniają źródła zewnętrzne |

| Weryfikacja | Media weryfikują fakty | AI generuje odpowiedzi bez weryfikacji |

| Zaufanie konsumentów | Budowane poprzez spójne komunikaty | Kształtowane przez syntezę wielu narracji przez AI |

Systemy AI kształtują percepcję marki poprzez mechanizmy, które w dużej mierze wymykają się bezpośredniej kontroli firmy. Gdy konsumenci pytają ChatGPT, Gemini czy Perplexity o marki — zarówno podczas wstępnego researchu, jak i decyzji zakupowych — marki wymieniane w tych odpowiedziach zyskują natychmiastową wiarygodność i są brane pod uwagę, często zanim konsument rozpocznie formalne porównania. Ten wpływ przedzakupowy jest szczególnie silny, ponieważ następuje w fazie odkrywania, gdy użytkownicy są najbardziej otwarci na rekomendacje. Systemy AI tworzą skojarzenia kategorii, konsekwentnie wymieniając wybrane marki w odpowiedzi na konkretne zapytania, przez co użytkownicy mentalnie łączą te marki z określonymi rozwiązaniami lub cechami. Budują także zaufanie dzięki walidacji zewnętrznej — rekomendacje AI wydają się bardziej obiektywne niż reklamy, działając jak domyślna rekomendacja. Dodatkowo, systemy AI pozycjonują ekspertów, często przywołując marki w autorytatywnych kontekstach, co zwiększa zaufanie do nich przy decyzjach zakupowych. Systemy te również kształtują krajobraz konkurencyjny, decydując, które 3-5 opcji pojawi się w odpowiedziach porównawczych — bezpośrednio wpływając na to, czy marka zostanie w ogóle rozważona. Co subtelniejsze, AI ustanawia oczekiwania jakościowe poprzez sposób, w jaki opisuje marki — prezentując je jako premium, budżetowe, innowacyjne czy niezawodne — co wywołuje efekt zakotwiczenia przy dalszej ocenie.

Wpływ biznesowy utraty kontroli nad narracją marki na rzecz systemów AI jest mierzalny i poważny. Przykład Campbell’s Soup jest konkretny: po negatywnych wypowiedziach przedstawiciela firmy, które rozprzestrzeniły się po platformach AI i wynikach wyszukiwania, spółka doświadczyła spadku ceny akcji o 7,3%, co oznacza 684 miliony dolarów utraty kapitalizacji rynkowej. Oprócz bezpośrednich skutków finansowych utrata narracji wpływa jednocześnie na wiele obszarów biznesu. Zaufanie konsumentów maleje, gdy systemy AI prezentują rozproszone lub negatywne informacje, zanim klienci zetkną się z oficjalnym przekazem marki. Employer branding i rekrutacja talentów cierpią, gdy AI wzmacnia narracje o kulturze firmy, odpowiedzialności liderów i traktowaniu pracowników, docierając do potencjalnych kandydatów. Pozycjonowanie konkurencyjne słabnie, gdy AI klasyfikuje markę niezgodnie z intencją — np. produkt premium jako „budżetowy” lub odwrotnie. Widoczność w wyszukiwarce maleje, gdy negatywne narracje dominują na pierwszej stronie wyników i w AI Overview, spychając treści kontrolowane przez markę poniżej progu widoczności. Efekty rozchodzą się na koszty pozyskania klienta — marki muszą więcej inwestować w reklamę płatną, by przezwyciężyć negatywne narracje AI. Najbardziej niepokojące jest to, że gdy negatywna narracja utrwala się w systemach AI, jej korekta staje się wykładniczo trudniejsza, ponieważ AI już zaabsorbowała i zsynthetyzowała dezinformację w swoich danych treningowych i wzorcach odpowiedzi.

Efektywna kontrola narracji marki w erze AI wymaga wielowarstwowego podejścia, które traktuje systemy AI jako potężnych, lecz naiwnych pośredników potrzebujących uporządkowanych, szczegółowych i stale aktualizowanych informacji. Organizacje powinny zastosować następujące strategie:

Eliminuj luki informacyjne: Milczenie nie jest już neutralne — to słabość. Marka musi zapewnić konkretność poprzez FAQ, strony „Jak działamy” oraz dane strukturalne, które wprost zaprzeczają plotkom, wyjaśniają nieujawnione informacje i używają jasnych, deklaratywnych zdań zamiast ogólników prawnych. AI wypełni luki narracją, która jest najbardziej szczegółowa i pewna.

Traktuj FAQ jako infrastrukturę obronną: FAQ to już nie tylko wsparcie klienta; to powierzchnia treningowa dla maszyn. Dobrze napisane FAQ z oznaczeniem schema i wyraźnymi zaprzeczeniami powszechnych nieporozumień to jeden z nielicznych typów treści, które konsekwentnie pomagają AI opierać się dezinformacji.

Publikuj „nudną, ale konkretną” prawdę: AI nagradza szczegółowość ponad błyskotliwość. Marka powinna publikować szczegółowe treści o procesach, harmonogramach, strukturach zarządzania i przypadkach użycia zamiast polegać na hasłach marketingowych typu „wiodąca w branży” czy „najlepsza w swojej klasie”, które dla AI są bezwartościowe.

Monitoruj systemy AI bezpośrednio: Nie istnieje jeden indeks AI. Marka musi regularnie pytać główne narzędzia AI — ChatGPT, Gemini, Perplexity, Claude — „Co wiesz o [Marka]?” i śledzić zmiany w czasie. To dziś kluczowa funkcja monitorowania ryzyka marki, nie eksperyment.

Śledź zewnętrzne wektory narracji: Wpisy na Reddicie, artykuły na Medium, „śledztwa” i listicle to teraz powierzchnie ataku na markę. Marka powinna monitorować terminy takie jak „śledztwo”, „pozew”, „były pracownik” i „skandal”, szybko reagując autorytatywną treścią zanim AI zaabsorbuje i wzmocni dezinformację.

Wdrażaj rozwiązania monitoringu w czasie rzeczywistym: Platformy takie jak AmICited.com oferują specjalistyczny monitoring tego, jak AI opisuje marki na różnych platformach, zapewniając powiadomienia o zmianach narracji i umożliwiając szybką reakcję zanim dezinformacja się rozprzestrzeni.

Twórz aktywa danych strukturalnych: Wykorzystuj schema, JSON-LD i inne formaty zrozumiałe dla maszyn, by pomóc AI lepiej zrozumieć i priorytetyzować rzetelne informacje o marce zamiast rozproszonych źródeł zewnętrznych.

Ustal szybkie mechanizmy ripostowania: Stwórz procesy umożliwiające szybkie publikowanie autorytatywnych kontrnarracji, gdy pojawią się fałszywe informacje, tak by AI miała dostęp do poprawek zanim utrwalą się one w danych treningowych.

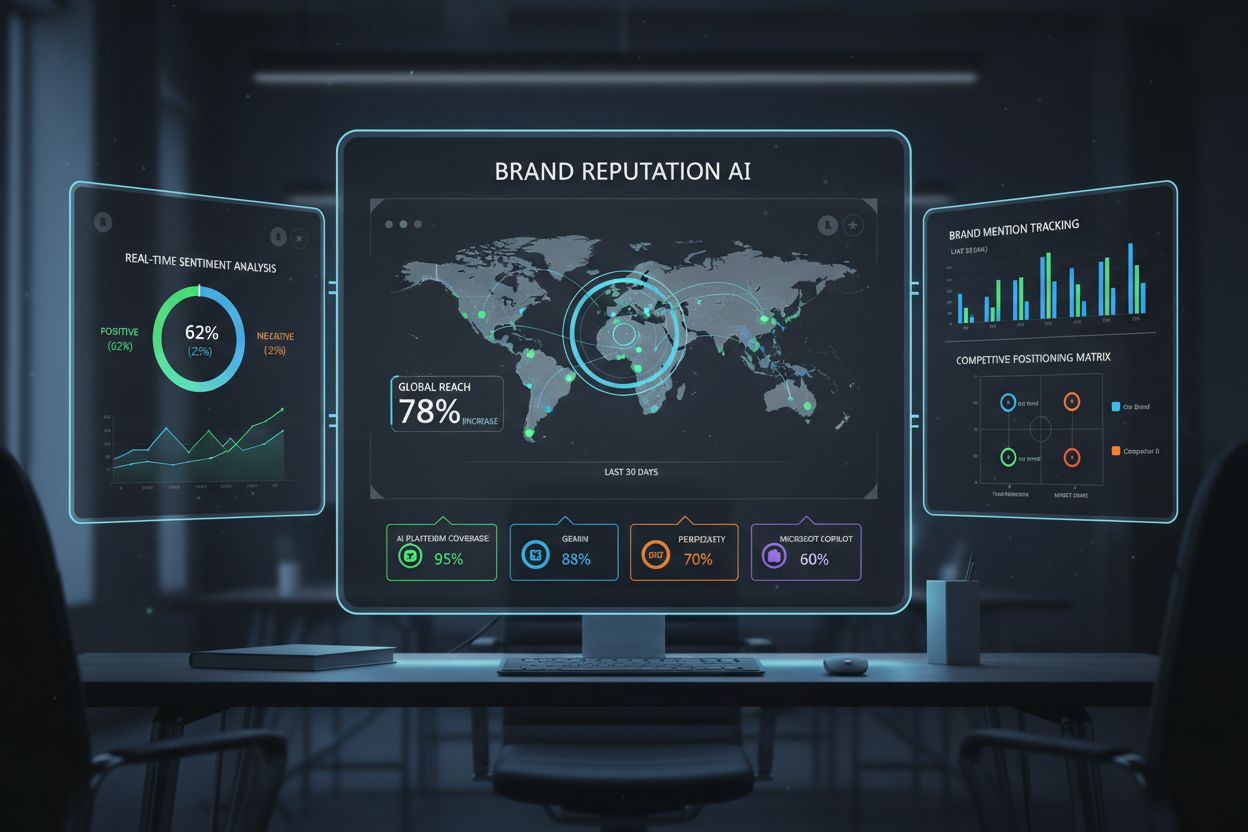

Monitorowanie kontroli narracji marki wymaga widoczności w czasie rzeczywistym tego, jak systemy AI opisują markę na różnych platformach — czego tradycyjne narzędzia do monitorowania marki nigdy nie zapewniały. Większość firm obecnie nie ma takiej widoczności, korzystając z rozproszonych narzędzi i nieaktualnych pulpitów dostarczających wgląd dopiero po fakcie. Efektywne monitorowanie musi śledzić nie tylko co mówią systemy AI o marce, ale jak to mówią, które źródła priorytetyzują i jak ta reprezentacja zmienia się w czasie. Obejmuje to monitoring sentymentu na platformach AI (ChatGPT, Gemini, Perplexity, Claude), śledzenie, jakie źródła AI cytuje, identyfikowanie rozbieżności między przekazem marki a wersją AI oraz mierzenie, jak pozycjonowanie marki zmienia się w różnych systemach AI. AmICited.com wyróżnia się jako wiodące rozwiązanie — oferuje specjalistyczny monitoring odpowiedzi AI i reprezentacji marki na wielu platformach. Platforma umożliwia markom zobaczenie, jak dokładnie opisują je systemy AI, zrozumienie, które źródła wpływają na te opisy, odbieranie powiadomień o zmianach narracji w czasie rzeczywistym i mierzenie skuteczności działań naprawczych. Poza AmICited.com, warto wdrożyć narzędzia do analizy sentymentu, platformy do social listeningu i regularne ręczne audyty odpowiedzi AI, by utrzymać pełną widoczność krajobrazu narracji AI dotyczącej marki.

Wdrożenie kontroli narracji marki wymaga systematycznego podejścia, traktującego AI jako podstawowe ryzyko biznesowe, a nie nowinkę marketingową. Po pierwsze, marka powinna przeprowadzić audyt narracji, zadając największym systemom AI pytania o markę, dokumentując obecne postrzeganie i identyfikując rozbieżności między zamierzonym a faktycznym pozycjonowaniem. Po drugie, ustanowić strukturę zarządzania narracją marki z jasnym właścicielstwem, procesami akceptacji i procedurami eskalacji w przypadku problemów reputacyjnych związanych z AI. Po trzecie, inwestować w infrastrukturę treści: przygotować rozbudowane, zrozumiałe dla maszyn zasoby — FAQ, dokumentację procesów, studia przypadków i dane strukturalne, które dostarczą AI autorytatywnych informacji. Po czwarte, zintegrować monitoring AI z istniejącymi procesami zamiast traktować go jako osobną funkcję; zespoły marki, PR i marketingu powinny mieć dostęp do danych narracji AI w czasie rzeczywistym. Po piąte, opracować protokoły reakcji na pojawienie się negatywnych narracji, w tym szablony szybkiego tworzenia treści i kanały dystrybucji zoptymalizowane pod przyswajanie przez AI. Po szóste, przeszkolić zespoły z zasad komunikacji pod AI, kładąc nacisk na konkretność ponad błyskotliwość, deklaratywność ponad język asekuracyjny i konieczność traktowania AI jako dosłownych pośredników. Wreszcie, mierzyć i optymalizować na bieżąco, śledząc, jak zmiany treści marki wpływają na opisy AI, przeprowadzając testy A/B różnych podejść i dostosowując strategię na podstawie faktycznego wpływu na AI, a nie marketingowych założeń.

Przyszłość kontroli narracji marki będzie kształtowana przez rosnącą konwergencję wyszukiwania, AI i zarządzania reputacją w ramach jednej, zintegrowanej dyscypliny. W miarę jak AI staje się głównym interfejsem odkrywania i oceny marek przez konsumentów — zastępując tradycyjne wyszukiwarki i media — umiejętność kształtowania narracji AI stanie się równie krytyczna, jak SEO w latach 2000. Marki, które już dziś potraktują kontrolę narracji AI jako strategiczny priorytet, zyskają przewagę konkurencyjną, która będzie się kumulować wraz z inwestycjami w dane strukturalne, autorytatywne treści i monitoring — budując solidne fundamenty pod rzetelną reprezentację w AI. Z kolei marki ignorujące tę zmianę staną się coraz bardziej podatne na przejęcie narracji przez podmioty zewnętrzne i konkurencję, które aktywnie optymalizują treści pod kątem AI. Systemy AI będą się również rozwijać, potencjalnie lepiej rozumiejąc kontekst i intencje marki — co tylko zwiększy wagę proaktywnej definicji narracji, bo AI zyska jeszcze więcej sposobów syntezy i prezentacji informacji. Krajobraz konkurencyjny przesunie się w stronę tych, którzy umiejętnie połączą kreatywność ludzką z precyzją zrozumiałą dla maszyn, tworząc historie poruszające człowieka, a jednocześnie zoptymalizowane pod AI. W tej rzeczywistości kontrola narracji marki to nie funkcja marketingowa, lecz kluczowa kompetencja biznesowa wpływająca bezpośrednio na wyniki finansowe, pozycjonowanie konkurencyjne i długoterminową wartość marki.

Tradycyjne zarządzanie marką koncentruje się na kontrolowaniu własnych komunikatów za pośrednictwem własnych kanałów, takich jak strony internetowe i komunikaty prasowe. Kontrola narracji marki rozszerza to na zarządzanie tym, jak systemy AI interpretują i prezentują markę na zewnętrznych platformach oraz w odpowiedziach generowanych przez AI. Wymaga to optymalizacji treści specjalnie pod kątem przyswajania przez AI i monitorowania, jak systemy AI opisują markę w czasie rzeczywistym.

Systemy AI są trenowane na ogromnych ilościach danych z internetu i optymalizują treści pod 'kształt odpowiedzi', a nie pod prawdę. Jeśli zewnętrzne źródła dostarczają bardziej szczegółowych, konkretnych informacji niż oficjalne źródła marki, AI może priorytetowo traktować te treści, nawet jeśli są niedokładne. Dlatego marki muszą aktywnie publikować konkretne, autorytatywne informacje, by konkurować z narracjami zewnętrznymi.

Marki mogą bezpośrednio zadawać pytania największym platformom AI (ChatGPT, Gemini, Perplexity, Claude) na temat swojej firmy i śledzić zmiany w czasie. Specjalistyczne platformy monitorujące, takie jak AmICited.com, oferują automatyczne śledzenie wzmianek o marce i sentymentu w wielu systemach AI, zapewniając powiadomienia w czasie rzeczywistym, gdy narracje się zmieniają.

Najskuteczniejszą strategią jest eliminacja luk informacyjnych poprzez publikację konkretnych, zrozumiałych dla maszyn treści. Twórz rozbudowane FAQ, które wprost odnoszą się do powszechnych nieporozumień, stosuj oznaczenia danych strukturalnych (schema) i utrzymuj silną obecność na własnych zasobach cyfrowych. Dzięki temu systemy AI mają autorytatywne informacje do priorytetyzowania ponad zewnętrznymi źródłami.

Chociaż ramy prawne wciąż się rozwijają, marki mogą zgłaszać halucynacje i nieścisłości platformom AI. Jednak najskuteczniejsze jest działanie proaktywne: publikowanie autorytatywnych treści, które systemy AI będą traktować priorytetowo wobec dezinformacji. Gdy fałszywe informacje zostaną już zaabsorbowane przez dane treningowe AI, ich korekta staje się znacznie trudniejsza.

Dokładna reprezentacja marki przez AI bezpośrednio wpływa na postrzeganie przez konsumentów, decyzje zakupowe, cenę akcji, rekrutację talentów i pozycjonowanie konkurencyjne. Przypadek Campbell's Soup pokazał to wyraźnie: negatywne narracje AI spowodowały spadek ceny akcji o 7,3% (684 mln USD utraty kapitalizacji rynkowej) i utratę zaufania konsumentów.

Dane strukturalne (schema markup) pomagają systemom AI lepiej rozumieć i dokładnie reprezentować informacje o marce. Dostarczają jasnych, zrozumiałych dla maszyn sygnałów dotyczących firmy, produktów, pozycjonowania i kluczowych faktów. Dzięki temu systemom AI łatwiej jest przedkładać rzetelne informacje nad rozdrobnione treści z zewnętrznych źródeł.

Zalecane jest ciągłe monitorowanie, z codziennymi kontrolami wiodących platform AI i cotygodniową analizą całościową. Należy ustawić powiadomienia w czasie rzeczywistym na istotne zmiany lub negatywne wzmianki. Biorąc pod uwagę, jak szybko systemy AI mogą wzmacniać narracje, widoczność w czasie rzeczywistym jest niezbędna do skutecznej ochrony marki.

Uzyskaj wgląd w czasie rzeczywistym, jak ChatGPT, Gemini, Perplexity i inne systemy AI prezentują Twoją markę. Śledź zmiany narracji, identyfikuj ryzyka i optymalizuj obecność marki w AI z AmICited.

Dowiedz się, jak alerty monitorujące markę przez AI śledzą Twoją widoczność i nastroje na ChatGPT, Perplexity i innych platformach AI. Powiadomienia w czasie rz...

Dowiedz się, jak identyfikować, monitorować i rozwiązywać spory dotyczące treści AI, gdy systemy sztucznej inteligencji generują nieprawidłowe lub szkodliwe inf...

Dyskusja społecznościowa o optymalizacji sposobu prezentacji marki w wynikach wyszukiwania AI. Strategie kontroli narracji marki w ChatGPT, Perplexity i Google ...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.