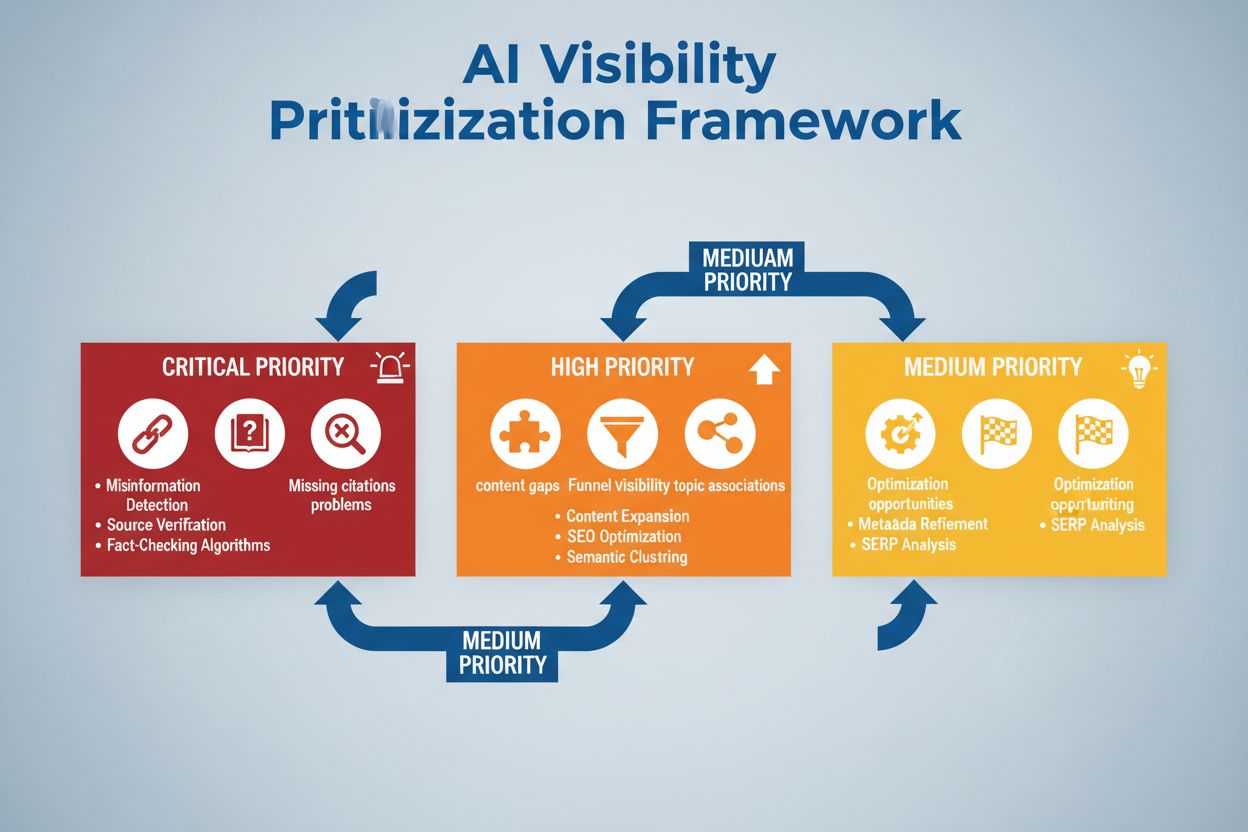

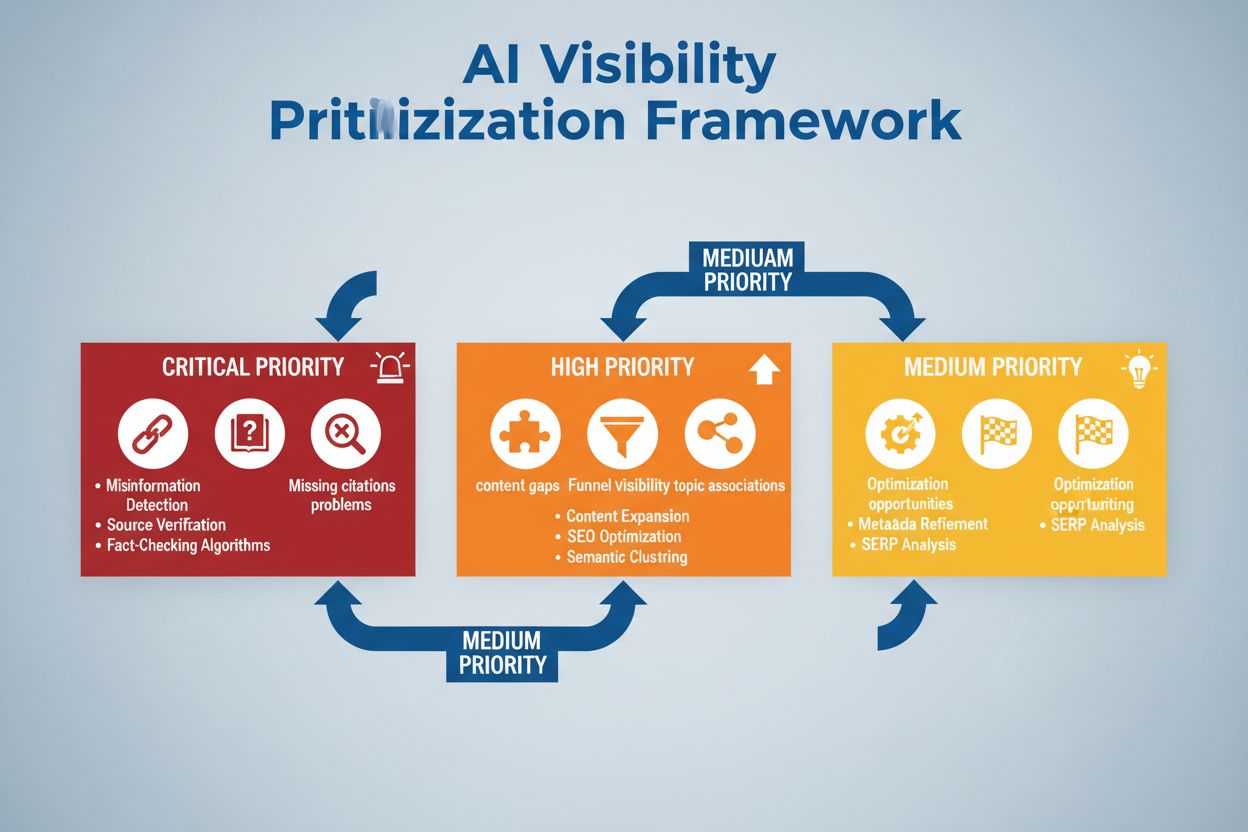

Priorizando Problemas de Visibilidade em IA: O Que Corrigir Primeiro

Aprenda como priorizar estrategicamente os problemas de visibilidade em IA. Descubra a estrutura para identificar problemas críticos, de alta e média prioridade...

Saiba como equilibrar a visibilidade da marca em respostas de IA com a proteção de conteúdo. Descubra estratégias para monitorar menções em IA, proteger propriedade intelectual e manter a confiança do cliente enquanto maximiza sua presença no ChatGPT, Perplexity e outras plataformas de IA.

Equilibre visibilidade e proteção de conteúdo implementando uma estratégia em camadas que combine salvaguardas técnicas como DRM e marca d'água com políticas de dados transparentes, coleta de dados primários e ferramentas de monitoramento. Isso garante que sua marca apareça em respostas de IA enquanto mantém o controle sobre como seu conteúdo é usado e protege os dados dos clientes contra acessos não autorizados.

O cenário digital moderno apresenta um desafio fundamental para as marcas: é preciso ser visível onde seus clientes procuram, mas também é necessário proteger sua propriedade intelectual e dados de clientes contra uso indevido. Essa tensão se intensificou dramaticamente com o surgimento de motores de busca e geradores de respostas baseados em IA como ChatGPT, Perplexity e Google AI Overviews. Essas plataformas agora direcionam tráfego significativo para sites — com algumas empresas relatando mais de 1% das sessões totais vindo de plataformas de IA — mas também criam novos riscos de roubo de conteúdo e deturpação da marca. O segredo do sucesso não está em escolher entre visibilidade e proteção, e sim em implementar uma abordagem estratégica e em camadas que alcance ambos simultaneamente.

A visibilidade em respostas de IA tornou-se tão crítica quanto o posicionamento em motores de busca tradicionais. Quando usuários fazem perguntas em plataformas de IA sobre seu setor, categoria de produto ou problemas específicos que você resolve, sua marca pode aparecer na resposta ou não. Se você estiver invisível, potenciais clientes encontram concorrentes. No entanto, alcançar essa visibilidade exige publicar conteúdo que sistemas de IA possam acessar e citar — o que cria riscos de exposição. Seu conteúdo pode ser republicado sem atribuição, suas informações proprietárias podem ser extraídas e reutilizadas, ou sua marca pode ser deturpada nas respostas de IA. Os riscos são altos: marcas que dominam esse equilíbrio capturam fatias de mercado quase impossíveis de recuperar, enquanto as que ignoram enfrentam tanto lacunas de visibilidade quanto vulnerabilidades de proteção.

A primeira camada da sua estratégia envolve salvaguardas técnicas que permitem publicar conteúdo para visibilidade em IA, mantendo o controle sobre como ele é usado. A tecnologia de Gerenciamento de Direitos Digitais (DRM) é essencial para proteger vídeos, cursos online e materiais de treinamento proprietários. Sistemas DRM controlam o acesso, impedem cópia não autorizada e bloqueiam gravação de tela — métodos comuns de pirataria de conteúdo. Ao publicar conteúdo que sistemas de IA possam citar, o DRM garante que apenas usuários autorizados tenham acesso à versão completa e não protegida. Para documentos e PDFs, criptografia e DRM em nível de documento oferecem proteção semelhante, permitindo compartilhar conteúdo com públicos específicos e evitando redistribuição.

A marca d’água serve tanto como elemento de dissuasão quanto mecanismo de rastreamento. Marcas d’água visíveis com seu logotipo ou marca lembram os usuários de que o conteúdo é seu e desencorajam o compartilhamento casual. Marcas d’água invisíveis — também chamadas de fingerprinting — embutem identificadores únicos vinculados a usuários ou carimbos de data/hora específicos. Se seu conteúdo aparecer em plataformas não autorizadas, a marca d’água revela exatamente qual conta fez o vazamento, permitindo ações direcionadas. A marca d’água dinâmica, que muda conforme a identidade do visualizador, é especialmente eficaz, pois torna cada cópia única e rastreável. Essa abordagem permite publicar livremente para visibilidade em IA mantendo a capacidade de identificar e impedir distribuições não autorizadas.

A criptografia protege dados durante a transmissão e o armazenamento, impedindo interceptações ou acessos não autorizados. Ao publicar conteúdo que sistemas de IA acessarão, a criptografia garante que informações sensíveis presentes nesse conteúdo permaneçam protegidas. Isso é especialmente importante para materiais que contêm metodologias proprietárias, dados de clientes ou inteligência competitiva. Ao criptografar trechos sensíveis ou exigir autenticação para acessar o conteúdo completo, você pode publicar informações suficientes para sistemas de IA citarem sua marca, mantendo sua propriedade intelectual mais valiosa em segurança.

Enquanto salvaguardas técnicas protegem seu conteúdo, estratégias de marketing com privacidade em primeiro lugar protegem seus clientes e constroem confiança. O desafio é que muitas marcas coletam grandes volumes de dados para personalizar o marketing e ampliar visibilidade, mas isso cria riscos de privacidade que minam a confiança e atraem penalidades regulatórias. A solução é a coleta de dados primários — obtenção direta de informações dos clientes por meio de pesquisas, assinaturas de e-mail, interações no site e mecanismos de consentimento explícito, em vez de depender de cookies de terceiros ou corretores de dados.

Dados primários são mais confiáveis, mais compatíveis com regulamentos como GDPR e CCPA, e mais valiosos porque vêm diretamente do seu público. Ao coletar dados primários de forma transparente, os clientes entendem exatamente quais informações estão sendo coletadas e por quê. Isso constrói confiança e reduz o risco de vazamentos ou uso indevido de dados. Você pode então usar esses dados para melhorar sua visibilidade em respostas de IA, entendendo quais perguntas seus clientes fazem e criando conteúdo que atenda a essas necessidades — sem depender de rastreamento invasivo ou compartilhamento de dados.

Políticas de dados transparentes são igualmente críticas. Sua política de privacidade deve explicar claramente quais dados são coletados, como são usados, por quanto tempo são retidos e quais direitos os clientes têm para acessar ou excluir suas informações. Torne essas políticas fáceis de encontrar e compreender — evite juridiquês que obscureça suas práticas reais. Quando os clientes percebem que você é transparente no tratamento dos dados, estão mais dispostos a compartilhá-los, o que na verdade melhora sua capacidade de criar conteúdo direcionado e relevante para visibilidade em IA. Isso gera um ciclo virtuoso: transparência constrói confiança, confiança permite melhor coleta de dados e melhores dados permitem estratégias de visibilidade mais eficazes.

O monitoramento em tempo real de como sua marca aparece em respostas de IA é essencial para manter tanto visibilidade quanto proteção. Diferente dos motores de busca tradicionais, onde se pode checar posições manualmente, plataformas de IA atualizam constantemente e geram respostas dinâmicas com base em consultas dos usuários. É preciso de ferramentas especializadas que rastreiem menções da sua marca em múltiplas plataformas de IA, monitorem o contexto das menções e identifiquem quando seu conteúdo é citado ou deturpado.

| Dimensão de Monitoramento | O Que Rastrear | Por Que Importa |

|---|---|---|

| Frequência de Menções | Com que frequência sua marca aparece em respostas de IA em diferentes plataformas | Revela lacunas de visibilidade e oportunidades de melhoria |

| Contexto da Citação | Se você é mencionado como líder, alternativa ou rodapé | Determina se as menções em IA atraem tráfego qualificado ou confundem o público |

| Atribuição de Fonte | Quais conteúdos seus são citados pelos sistemas de IA | Mostra quais tipos e temas de conteúdo ressoam com as plataformas de IA |

| Posicionamento Competitivo | Quais marcas aparecem junto à sua nas respostas | Identifica oportunidades de mercado e ameaças competitivas |

| Sentimento e Precisão | Como sua marca é descrita e se as informações estão atualizadas | Identifica deturpações ou informações desatualizadas antes que prejudiquem sua reputação |

| Correlação de Tráfego | Se o aumento de visibilidade em IA gera visitas ao site | Prova ROI e orienta prioridades de otimização |

Plataformas de IA diferentes têm preferências distintas de fontes. O ChatGPT privilegia Wikipedia, Reddit e Forbes. O Perplexity prefere Reddit, YouTube e Gartner. O Google AI Overviews cita Reddit, YouTube e Quora. Apenas cerca de 50% das citações de IA coincidem com resultados tradicionais do Google, ou seja, sua estratégia de SEO sozinha não garante visibilidade em IA. É preciso monitoramento específico por plataforma para entender onde sua marca aparece e onde está ausente. Ferramentas que atualizam pelo menos diariamente — idealmente a cada quatro horas — são essenciais, pois plataformas de IA mudam algoritmos e dados de treinamento constantemente. Uma mudança na estratégia de conteúdo do concorrente ou uma atualização no algoritmo da plataforma pode impactar sua visibilidade em questão de horas, não semanas.

Criar conteúdo que sistemas de IA citem enquanto protege sua propriedade intelectual exige uma abordagem estratégica de conteúdo. Sistemas de IA preferem conteúdos estruturados, ricos em fatos, com títulos hierárquicos claros, respostas concisas e clareza semântica. Isso significa que seu conteúdo deve responder diretamente às perguntas comuns de seus clientes, fornecer dados e exemplos específicos e usar formatação que facilite a extração de informações. Páginas de FAQ, guias passo a passo e artigos comparativos têm desempenho particularmente bom porque abordam diretamente os tipos de perguntas feitas em plataformas de IA.

Entretanto, não é necessário publicar sua propriedade intelectual mais valiosa para garantir visibilidade em IA. Em vez disso, publique informação suficiente para ser citado, mantendo seus insights mais profundos, metodologias proprietárias e vantagens competitivas atrás de paywalls, exigência de associação ou controles de acesso. Por exemplo, você pode publicar um guia detalhado explicando as melhores práticas do setor (que sistemas de IA citarão), mas manter sua abordagem específica e resultados de clientes em um recurso premium disponível apenas para clientes pagantes. Essa abordagem garante visibilidade em respostas de IA enquanto protege o conteúdo mais valioso.

A diversificação de conteúdo também é importante. Como diferentes plataformas de IA preferem fontes distintas, expanda sua presença além do site. Crie conteúdo no Reddit, Quora, publicações do setor e YouTube — plataformas onde sistemas de IA frequentemente buscam informações. Isso não significa duplicar o conteúdo do seu site; crie materiais específicos para cada plataforma, abordando os tipos de perguntas dos usuários em cada uma. Uma discussão detalhada no Reddit sobre desafios do seu setor será citada de forma diferente de um tutorial no YouTube, e ambos trarão diferentes tipos de visibilidade. Ao diversificar sua presença, você aumenta a chance de ser citado por sistemas de IA em múltiplas plataformas e contextos.

O controle de acesso baseado em função (RBAC) garante que apenas membros autorizados da equipe possam acessar conteúdos sensíveis e dados de clientes. Ao implementar RBAC, você define funções específicas — como criador de conteúdo, editor, gerente e administrador — e atribui permissões conforme as necessidades de cada função. Um redator freelancer pode ter acesso para publicar conteúdo, mas não ver dados de clientes. Um atendente pode acessar informações de clientes, mas não registros financeiros. Esse princípio do menor privilégio — dar aos usuários apenas o acesso absolutamente necessário — reduz drasticamente o risco de vazamentos ou uso indevido interno.

Registros de acesso e auditorias criam responsabilidade e permitem detectar atividades suspeitas. Sabendo quem acessou quais informações e quando, é possível identificar padrões incomuns que podem indicar violações de segurança ou uso intencional indevido. Auditorias regulares de usuários ativos e permissões ajudam a identificar excessos de permissões antes que se tornem problemas. Por exemplo, se o acesso de um prestador não foi revogado após o término do projeto, a auditoria permite restringir imediatamente suas permissões.

NDAs e contratos de propriedade intelectual com colaboradores, freelancers e fornecedores oferecem proteção legal ao seu conteúdo. Esses acordos devem declarar claramente que todo o conteúdo criado lhe pertence, que empregados e contratados não podem reutilizá-lo para concorrentes e que devem manter confidencialidade. Ao assinar um NDA, a pessoa entende as consequências legais de vazar ou usar indevidamente seu conteúdo, servindo como um forte elemento de dissuasão. Combinados a salvaguardas técnicas e monitoramento, acordos legais criam uma estrutura abrangente de proteção.

A abordagem mais eficaz para equilibrar visibilidade e proteção é a transparência radical sobre suas práticas. Quando você é transparente quanto à coleta, proteção e uso de dados, os clientes confiam mais e se envolvem mais. Essa transparência se estende à sua estratégia de conteúdo: deixe claro quais informações estão disponíveis livremente, quais exigem autenticação e quais são reservadas para clientes premium. Essa clareza melhora, inclusive, sua visibilidade em respostas de IA, pois sistemas conseguem entender melhor a estrutura do seu conteúdo e citá-lo com mais precisão.

A transparência também se aplica à representação da marca. Se você monitorar respostas de IA e perceber deturpações sobre sua marca, responda rapidamente e com transparência. Entre em contato com a plataforma de IA, forneça informações corrigidas e explique por que a descrição atual está incorreta. Muitas plataformas de IA têm mecanismos para reportar imprecisões e estão cada vez mais receptivas a essas correções, pois desejam respostas precisas. Ao ser transparente nas correções e melhorias, você constrói credibilidade tanto com as plataformas de IA quanto com os usuários.

Acompanhe métricas de visibilidade e proteção para garantir que sua estratégia está funcionando. Métricas de visibilidade incluem frequência de menções em plataformas de IA, contexto das citações (você é mencionado como líder ou alternativa?) e tráfego originado dessas plataformas. Métricas de proteção incluem incidentes de distribuição não autorizada, tentativas de violação de dados e índices de confiança dos clientes. O objetivo é ver as métricas de visibilidade crescerem enquanto as de proteção se mantêm estáveis ou melhoram.

Por exemplo, se suas menções em IA aumentarem 40%, mas você detectar também um aumento de 20% na distribuição não autorizada de conteúdo, sua estratégia precisa de ajustes. Pode ser necessário um DRM mais forte, monitoramento mais agressivo ou reposicionamento do conteúdo. Por outro lado, se a visibilidade aumenta e a distribuição não autorizada diminui, sua estratégia está funcionando — você encontrou o ponto de equilíbrio entre visibilidade relevante e proteção do que é valioso.

À medida que plataformas de IA se tornam mais sofisticadas e influentes, o equilíbrio entre visibilidade e proteção será cada vez mais crucial. A personalização avança rapidamente — sistemas de IA já conseguem lembrar buscas anteriores e personalizar respostas com base no histórico do usuário. Isso significa que a visibilidade da marca dependerá cada vez mais das preferências e contexto do usuário, não apenas da qualidade do conteúdo. Otimização em tempo real será essencial, com plataformas favorecendo conteúdos que atualizam dinamicamente e fornecem informações recentes. A fiscalização regulatória aumentará, com governos impondo requisitos mais rígidos sobre como plataformas de IA citam fontes e lidam com influência comercial nas respostas.

As marcas que prosperarem nesse cenário serão as que dominarem o equilíbrio: visíveis onde os clientes buscam, protetoras de sua propriedade intelectual, transparentes em práticas de dados e proativas em monitorar e responder à forma como são representadas. Não é uma configuração única, e sim uma estratégia contínua que evolui conforme plataformas de IA e expectativas dos clientes mudam. Ao implementar as salvaguardas técnicas, estratégicas e legais aqui descritas, você posiciona sua marca para capturar as oportunidades de mercado trazidas pela visibilidade em IA, protegendo os ativos que tornam sua marca valiosa.

Acompanhe como sua marca aparece no ChatGPT, Perplexity e outras plataformas de IA enquanto protege seu conteúdo contra uso não autorizado. Obtenha insights em tempo real sobre sua visibilidade em IA e posicionamento competitivo.

Aprenda como priorizar estrategicamente os problemas de visibilidade em IA. Descubra a estrutura para identificar problemas críticos, de alta e média prioridade...

Descubra por que sua marca não está aparecendo no ChatGPT, Perplexity, Google AI Overviews e Claude. Conheça os 5 principais fatores e como corrigi-los.

Descubra como respostas de IA personalizadas e o contexto do usuário estão remodelando a visibilidade da marca. Aprenda estratégias para otimizar para buscas po...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.