O que é o BERT e ele ainda é relevante em 2024-2025?

Saiba mais sobre o BERT, sua arquitetura, aplicações e relevância atual. Entenda como o BERT se compara a alternativas modernas e por que ele continua essencial...

A Atualização BERT é a melhoria do algoritmo do Google lançada em outubro de 2019 que utiliza Representações Bidirecionais de Codificadores a partir de Transformadores para aprimorar a compreensão de linguagem natural nas consultas de pesquisa. Ela impacta aproximadamente 10% de todas as buscas, permitindo ao Google entender melhor o contexto, preposições e significado semântico em frases de pesquisa conversacionais e complexas.

A Atualização BERT é a melhoria do algoritmo do Google lançada em outubro de 2019 que utiliza Representações Bidirecionais de Codificadores a partir de Transformadores para aprimorar a compreensão de linguagem natural nas consultas de pesquisa. Ela impacta aproximadamente 10% de todas as buscas, permitindo ao Google entender melhor o contexto, preposições e significado semântico em frases de pesquisa conversacionais e complexas.

A Atualização BERT é uma grande melhoria do algoritmo de busca do Google anunciada em 25 de outubro de 2019, que mudou fundamentalmente a forma como o buscador entende a linguagem natural. BERT significa Representações Bidirecionais de Codificadores a partir de Transformadores, uma técnica baseada em redes neurais para processamento de linguagem natural que permite ao Google compreender o contexto, nuances e significado semântico das palavras nas consultas de pesquisa. Em vez de analisar palavras individualmente ou de forma sequencial da esquerda para a direita, o BERT processa o texto bidirecionalmente—examinando cada palavra em relação a todas as palavras ao redor simultaneamente—permitindo ao Google captar o significado contextual completo de consultas complexas e conversacionais. Segundo o anúncio oficial do Google feito por Pandu Nayak, Vice-Presidente de Pesquisa, essa atualização representa um dos maiores avanços na tecnologia de busca nos últimos cinco anos, impactando aproximadamente 10% de todas as pesquisas (cerca de 560 milhões de consultas diárias só nos Estados Unidos). A Atualização BERT foi especialmente projetada para melhorar os resultados de busca para consultas mais longas e em linguagem natural, onde preposições e relações contextuais entre palavras são fundamentais para compreender a intenção do usuário.

O desenvolvimento do BERT representa a culminação de anos de pesquisa em processamento de linguagem natural e aprendizado de máquina no Google. Pesquisadores do Google apresentaram o BERT como um framework de código aberto em outubro de 2018, construindo sobre avanços anteriores em redes neurais baseadas em transformadores. A tecnologia surgiu dos esforços mais amplos do Google de ir além da simples correspondência de palavras-chave em direção à compreensão semântica—uma jornada que começou com a Atualização Hummingbird em 2013 e continuou com o RankBrain em 2015. No entanto, enquanto o RankBrain ajudava o Google a entender consultas inéditas ao associá-las com outras semelhantes, o BERT introduziu uma abordagem fundamentalmente diferente ao ler o texto de forma bidirecional. Esse avanço foi possível graças ao progresso em aprendizado de máquina e à disponibilidade de infraestrutura computacional mais poderosa, incluindo os Cloud TPUs (Unidades de Processamento Tensor), que o Google utilizou pela primeira vez para entregar resultados de busca em grande escala. A equipe de pesquisa do Google AI reconheceu que algoritmos anteriores tinham dificuldade em compreender a importância de palavras pequenas como “para”, “a” e “não” nas consultas, frequentemente interpretando mal a intenção do usuário. O método de treinamento bidirecional do BERT resolveu esse problema ao permitir que o algoritmo considerasse o contexto completo de cada palavra em uma frase, não apenas as palavras que vinham antes ou depois dela na sequência.

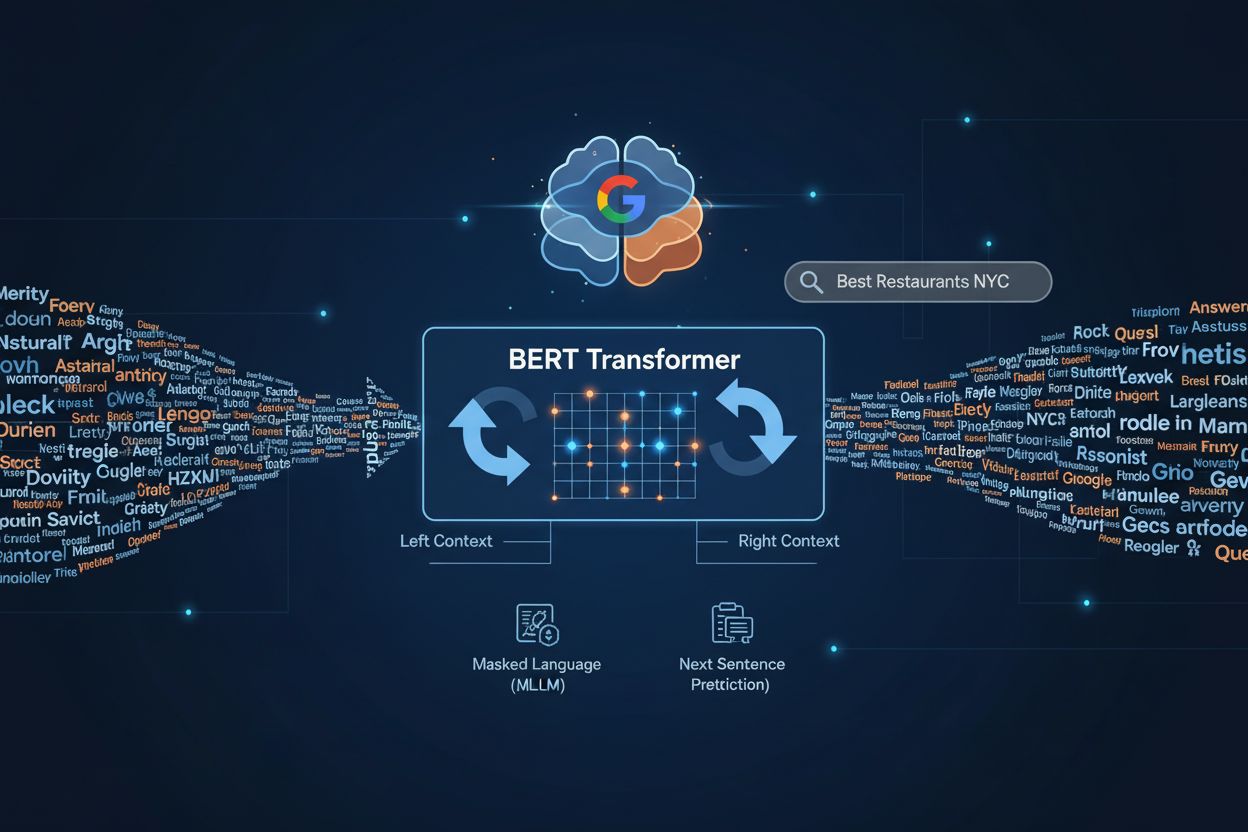

O BERT opera por meio de uma arquitetura sofisticada de rede neural que processa a linguagem de uma forma fundamentalmente diferente de algoritmos anteriores. A inovação central é sua abordagem bidirecional: em vez de ler o texto da esquerda para a direita ou da direita para a esquerda de forma sequencial, o BERT analisa todas as palavras de uma frase simultaneamente, entendendo o significado de cada uma com base em sua relação com todas as outras no contexto. Isso é alcançado por meio de modelos transformadores, que utilizam mecanismos de atenção para pesar a importância das diferentes palavras em relação umas às outras. Quando um usuário insere uma consulta de pesquisa, o BERT tokeniza o texto em componentes individuais e então processa esses tokens por múltiplas camadas de codificadores transformadores. Cada camada refina o entendimento do algoritmo sobre relações entre palavras e significado contextual. O aspecto “bidirecional” é crucial: significa que o BERT não olha apenas para o que vem antes de uma palavra para entendê-la; ele também considera o que vem depois, fornecendo um quadro contextual completo. Por exemplo, na consulta “do estheticians stand a lot at work”, o BERT entende que “stand” refere-se à posição física (um verbo relacionado às exigências do trabalho) e não a “stand-alone” (um adjetivo composto), pois analisa o contexto completo da frase. Esse processamento bidirecional permite que o BERT lide com palavras ambíguas com múltiplos significados, entenda a importância das preposições e capte nuances linguísticas sutis que algoritmos anteriores não percebiam. O modelo foi treinado com grandes volumes de dados de texto não rotulados, permitindo que aprendesse padrões de linguagem e relações semânticas sem exigir anotação manual.

O impacto prático da Atualização BERT nos resultados de busca foi substancial, especialmente para consultas complexas e conversacionais. O Google demonstrou isso em vários exemplos do mundo real em seu anúncio oficial. Um exemplo notável envolveu a consulta “2019 Brazil traveler to USA need a visa”—antes do BERT, o algoritmo do Google focava excessivamente na correspondência de palavras-chave e retornava resultados sobre cidadãos dos EUA viajando para o Brasil, ignorando completamente o contexto direcional indicado pela palavra “to”. Após o BERT, o buscador entendeu corretamente que a consulta se referia a um brasileiro viajando para os Estados Unidos e retornou informações relevantes sobre visto para esse cenário específico. Outro exemplo mostrou como o BERT melhorou resultados para “do estheticians stand a lot at work” ao entender que “stand” referia-se às exigências físicas do trabalho, e não a “stand-alone” em resultados irrelevantes. Essas melhorias significam que os usuários agora podem pesquisar de maneira mais natural e conversacional, sem recorrer ao que o Google chama de “keyword-ese”—o hábito de digitar sequências de palavras-chave estranhas pensando que o buscador as compreenderia. Com o BERT, os usuários podem fazer perguntas como naturalmente falariam, e o Google compreenderá sua intenção com mais precisão. Essa mudança foi especialmente benéfica para a busca por voz, onde as consultas tendem a ser mais longas e conversacionais. A atualização também aprimorou os featured snippets, com o Google aplicando modelos BERT para identificar melhor quais trechos de conteúdo respondem com mais precisão e objetividade às perguntas dos usuários, resultando em resultados mais relevantes na posição zero.

| Algoritmo | Ano de Lançamento | Foco Principal | Método de Processamento | Impacto nas Consultas | Inovação Chave |

|---|---|---|---|---|---|

| RankBrain | 2015 | Compreensão de consultas inéditas | Correspondência sequencial de padrões | ~15% das consultas | Lida com buscas nunca vistas por meio de associação por similaridade |

| BERT | 2019 | Compreensão contextual da linguagem | Análise bidirecional por transformadores | ~10% das consultas | Lê o texto nas duas direções simultaneamente para captar o contexto completo |

| MUM | 2021 (lançamento limitado) | Compreensão multimodal e multilíngue | Modelo unificado multitarefa | Expansivo | 1.000x mais poderoso que o BERT; lida com imagens, vídeo, texto |

| Hummingbird | 2013 | Busca em linguagem natural | Análise semântica de palavras-chave | ~90% das consultas | Introduziu busca semântica e consultas conversacionais |

| Panda | 2011 | Avaliação da qualidade do conteúdo | Avaliação de conteúdo | Variável | Penalizou conteúdos de baixa qualidade e superficiais |

A Atualização BERT mudou fundamentalmente as melhores práticas de SEO, afastando-se da otimização rígida por palavras-chave em direção ao SEO semântico e alinhamento com a intenção do usuário. Como o BERT valoriza conteúdo escrito naturalmente e relevante no contexto, profissionais de SEO precisaram adaptar suas estratégias. Uma implicação crítica é que o excesso de palavras-chave e o uso artificial delas tornaram-se ainda menos eficazes, já que o BERT agora distingue entre linguagem natural e inserção forçada de termos. Criadores de conteúdo devem focar em escrever de forma clara, correta e que realmente responda às perguntas dos usuários, em vez de otimizar para frases exatas. A atualização também enfatizou a importância de clusters de tópicos e cobertura abrangente dos temas—em vez de mirar palavras-chave individuais, o SEO de sucesso agora envolve criar conteúdo aprofundado que explora um assunto de vários ângulos, incorporando naturalmente termos e conceitos relacionados. Os featured snippets tornaram-se mais competitivos, já que a melhor compreensão do BERT significa que apenas respostas realmente úteis e bem estruturadas têm chance de aparecer na posição zero. Além disso, a atualização destacou a importância de preposições e palavras de ligação pequenas que antes eram negligenciadas; agora, o conteúdo deve usar essas palavras de forma natural e correta, pois o BERT entende o valor delas para o significado. Palavras-chave longas e frases conversacionais passaram a ser mais valiosas, já que o BERT é especialmente competente em compreender esses padrões de linguagem natural. Contudo, é importante notar que o BERT não substitui fundamentos tradicionais de SEO—backlinks, velocidade do site, otimização mobile e SEO técnico continuam essenciais. O BERT apenas faz com que qualidade, clareza e relevância semântica do conteúdo sejam mais importantes do que nunca.

Embora o BERT tenha sido desenvolvido especificamente para o Google Search, seus princípios e tecnologia subjacente influenciaram como outros sistemas de IA processam linguagem natural. ChatGPT, Claude, Perplexity e Google AI Overviews também utilizam arquiteturas baseadas em transformadores e métodos de processamento bidirecional para entender consultas e gerar respostas. Entender a abordagem do BERT para o processamento de linguagem natural é relevante para quem acompanha como seu conteúdo aparece em múltiplas plataformas de IA. Para o Google AI Overviews (anteriormente SGE—Search Generative Experience), a compreensão contextual do BERT ajuda a determinar quais fontes são citadas e como o conteúdo é resumido em respostas geradas por IA. A capacidade do algoritmo de compreender o significado semântico faz com que o conteúdo não precise coincidir palavra por palavra com a consulta para ser selecionado; em vez disso, materiais que atendam à intenção do usuário têm mais chances de destaque. Para o Perplexity AI, que enfatiza atribuição de fontes e busca conversacional, o processamento inspirado no BERT ajuda o sistema a entender quais fontes respondem melhor a perguntas complexas e multifacetadas. ChatGPT e Claude usam arquiteturas de transformadores semelhantes à do BERT, porém em escalas muito maiores, permitindo compreender solicitações nuançadas e gerar respostas contextuais. Isso significa que conteúdo otimizado para os princípios do BERT—material claro, relevante, natural e que atenda à intenção do usuário—tem mais chance de ser citado e destacado nessas plataformas de IA. Para marcas e criadores de conteúdo que usam o AmICited para monitorar sua presença nos resultados de busca por IA, entender o foco do BERT em relevância semântica e significado contextual é fundamental para otimizar o conteúdo que será selecionado por esses sistemas.

Desde sua introdução em 2019, o BERT continuou a evoluir e influenciar o desenvolvimento do algoritmo do Google. A tecnologia serviu de base para o MUM (Modelo Unificado Multitarefa), anunciado em maio de 2021, que o Google descreve como 1.000 vezes mais poderoso que o BERT. O MUM amplia as capacidades do BERT ao lidar com múltiplos tipos de conteúdo (texto, imagens, vídeo) simultaneamente e compreender informações em diferentes idiomas sem exigir treinamento separado para cada um. Isso representa um salto significativo na capacidade da IA de entender e processar informações de forma abrangente. Olhando para o futuro, a trajetória do processamento de linguagem natural nas buscas aponta para ênfase contínua em compreensão semântica, reconhecimento de intenção do usuário e relevância contextual. À medida que os sistemas de IA se tornam mais sofisticados, a diferença entre correspondência de palavras-chave e compreensão semântica será ainda mais acentuada. Criadores de conteúdo e profissionais de SEO devem esperar que futuras atualizações de algoritmo recompensem ainda mais conteúdos de alta qualidade e escrita natural que realmente atendam às necessidades do usuário. O avanço da IA generativa nos resultados de busca faz com que entender como algoritmos como o BERT interpretam o conteúdo seja cada vez mais importante para garantir atribuição e visibilidade. Além disso, com o crescimento da busca por voz e IA conversacional, a força do BERT em processar linguagem natural continuará relevante. A tecnologia também tem implicações além das buscas—os princípios do BERT estão sendo aplicados em moderação de conteúdo, análise de sentimento e outras tarefas de processamento de linguagem natural. Para organizações que monitoram sua presença de marca em sistemas de IA, manter-se informado sobre o BERT e tecnologias relacionadas ajuda a explicar por que certos conteúdos são selecionados para respostas de IA enquanto outros não. O futuro da busca provavelmente envolverá compreensão ainda mais sofisticada de intenção, contexto e significado semântico, construindo diretamente sobre a base estabelecida pelo BERT.

Para otimizar conteúdo para o BERT e manter visibilidade nos resultados de busca modernos, criadores devem seguir práticas baseadas em evidências. Escreva de forma natural e conversacional: Use uma linguagem humana e fluida, e não artificialmente otimizada para palavras-chave. O BERT valoriza conteúdo que seja agradável de ler e comunique claramente. Foque na intenção do usuário: Entenda o que os usuários realmente querem encontrar ao pesquisar determinado assunto e produza conteúdo que atenda diretamente a essa intenção. Aborde o tema de forma abrangente: Em vez de mirar palavras-chave individuais, crie materiais aprofundados que explorem o tema por completo, incorporando naturalmente conceitos e termos relacionados. Estruture o conteúdo com clareza: Use títulos, subtítulos, listas e uma sequência lógica para ajudar tanto leitores quanto buscadores a entender a organização e significado do seu texto. Responda perguntas de forma direta: Inclua seções de perguntas frequentes (FAQs) e respostas claras para dúvidas comuns sobre o tema, já que o BERT é excelente em associar perguntas a respostas relevantes. Mantenha a correção gramatical: O BERT agora diferencia conteúdos corretos e incorretos gramaticalmente, então gramática e sintaxe importam mais do que nunca. Use preposições e palavras de ligação naturalmente: Não evite palavras pequenas como “para”, “a”, “por” e “com”—utilize-as naturalmente, pois contribuem para o significado semântico. Crie conteúdo para humanos em primeiro lugar: Lembre-se de que o BERT foi projetado para valorizar conteúdo que ajuda genuinamente o usuário, não apenas materiais feitos para algoritmos. A melhor estratégia de SEO é criar conteúdo útil e valioso que atenda às necessidades da sua audiência. Implemente dados estruturados: Use marcação schema para ajudar os buscadores a entenderem o significado e contexto do seu conteúdo, complementando a compreensão de linguagem natural do BERT. Monitore palavras-chave longas e conversacionais: Acompanhe o desempenho do seu conteúdo para buscas mais longas e naturais, pois é aí que as melhorias do BERT são mais visíveis.

+++

BERT significa Representações Bidirecionais de Codificadores a partir de Transformadores. Pesquisadores do Google apresentaram o BERT como uma estrutura de aprendizado de máquina de código aberto em outubro de 2018, e o Google o aplicou oficialmente aos rankings de pesquisa em 25 de outubro de 2019. Esta atualização representou uma das melhorias mais significativas no Google Search em cinco anos, mudando fundamentalmente como o buscador processa e compreende consultas de linguagem natural.

Enquanto o RankBrain (2015) ajudava o Google a entender consultas inéditas ao associá-las a buscas semelhantes, o BERT vai além ao ler textos de forma bidirecional—analisando palavras em relação a todas as outras ao redor simultaneamente, e não de maneira sequencial. O BERT entende contexto, preposições e significados sutis com mais precisão do que o RankBrain, sendo especialmente eficaz para consultas mais longas e conversacionais, onde palavras pequenas como 'para' e 'a' mudam significativamente o sentido.

O Google afirmou que o BERT impacta aproximadamente 10% de todas as consultas de pesquisa nos Estados Unidos para buscas em inglês, o que equivale a cerca de 560 milhões de consultas por dia. A atualização também afeta featured snippets em 24 países e em vários idiomas, demonstrando sua importância global na melhoria da relevância e precisão dos resultados.

Não existe uma estratégia de otimização direta para o BERT como há para dispositivos móveis. Em vez disso, o BERT valoriza conteúdo de alta qualidade, escrito naturalmente e que responda claramente às perguntas dos usuários. Foque em produzir conteúdo gramaticalmente correto, contextualmente relevante e que atenda de forma abrangente à intenção do usuário. Certifique-se de usar linguagem natural, abordar os temas de forma completa e oferecer valor genuíno—essas práticas estão alinhadas com a ênfase do BERT em compreensão semântica, e não apenas em correspondência de palavras-chave.

O BERT utiliza processamento bidirecional, ou seja, lê o texto da esquerda para a direita e da direita para a esquerda simultaneamente, compreendendo como cada palavra se relaciona com todas as outras na frase. Isso permite ao BERT captar o contexto completo e o significado sutil das consultas. Por exemplo, em 'viajante do Brasil para EUA precisa de visto', o BERT entende que 'para' indica direção do Brasil para os EUA, e não o contrário, oferecendo resultados mais relevantes.

O Google aplica modelos BERT tanto aos rankings de pesquisa quanto aos featured snippets. O BERT aprimora a seleção desses trechos ao entender melhor quais partes do conteúdo respondem com mais precisão e objetividade às perguntas dos usuários. Isso significa que páginas com respostas claras e bem estruturadas têm mais chances de serem escolhidas para a posição zero, pois o BERT consegue avaliar com mais precisão a relevância e qualidade das respostas.

O BERT melhora significativamente o desempenho das buscas por voz porque essas consultas tendem a ser mais conversacionais e naturais do que as digitadas. Como o BERT é excelente na compreensão de linguagem natural, frases longas e significado contextual, ele entrega resultados melhores para pesquisas por voz. Os usuários podem agora fazer perguntas de forma natural e conversacional sem precisar recorrer ao 'keyword-ese', e o BERT entenderá sua intenção com mais precisão.

Não, o BERT complementa e não substitui os fundamentos tradicionais do SEO. Backlinks, velocidade do site, otimização para dispositivos móveis e SEO técnico continuam sendo fatores importantes de ranqueamento. O BERT melhora especificamente como o Google entende o significado do conteúdo e a intenção do usuário, atuando junto com esses outros sinais de ranqueamento. Uma estratégia de SEO abrangente deve abordar todos os fatores—o BERT apenas significa que qualidade de conteúdo e clareza de linguagem natural tornaram-se ainda mais críticas.

Comece a rastrear como os chatbots de IA mencionam a sua marca no ChatGPT, Perplexity e outras plataformas. Obtenha insights acionáveis para melhorar a sua presença de IA.

Saiba mais sobre o BERT, sua arquitetura, aplicações e relevância atual. Entenda como o BERT se compara a alternativas modernas e por que ele continua essencial...

Discussão da comunidade sobre se a otimização para BERT ainda importa na era do GPT-4 e outros grandes modelos de linguagem. Entenda o que mudou para SEO e busc...

Saiba o que são as Atualizações do Algoritmo do Google, como funcionam e seu impacto no SEO. Entenda atualizações de núcleo, de spam e mudanças de classificação...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.