Ce este BERT și mai este relevant în 2024-2025?

Află despre BERT, arhitectura, aplicațiile și relevanța sa actuală. Înțelege cum se compară BERT cu alternativele moderne și de ce rămâne esențial pentru sarcin...

Actualizarea BERT este îmbunătățirea algoritmului Google din octombrie 2019, care utilizează Reprezentări Bidirecționale ale Codificatorului din Transformatoare pentru a îmbunătăți înțelegerea limbajului natural în interogările de căutare. Aceasta afectează aproximativ 10% din toate interogările de căutare, permițând Google să înțeleagă mai bine contextul, prepozițiile și sensul semantic în expresii de căutare conversaționale și complexe.

Actualizarea BERT este îmbunătățirea algoritmului Google din octombrie 2019, care utilizează Reprezentări Bidirecționale ale Codificatorului din Transformatoare pentru a îmbunătăți înțelegerea limbajului natural în interogările de căutare. Aceasta afectează aproximativ 10% din toate interogările de căutare, permițând Google să înțeleagă mai bine contextul, prepozițiile și sensul semantic în expresii de căutare conversaționale și complexe.

Actualizarea BERT este o îmbunătățire majoră a algoritmului de căutare Google, anunțată pe 25 octombrie 2019, care a schimbat fundamental modul în care motorul de căutare înțelege limbajul natural. BERT provine de la Reprezentări Bidirecționale ale Codificatorului din Transformatoare, o tehnică bazată pe rețele neuronale pentru procesarea limbajului natural care permite Google să înțeleagă contextul, nuanța și sensul semantic al cuvintelor din interogările de căutare. În loc să analizeze cuvintele individual sau secvențial de la stânga la dreapta, BERT procesează textul bidirecțional—examinând fiecare cuvânt în raport cu toate cuvintele din jur simultan—permițând Google să înțeleagă pe deplin sensul contextual al interogărilor complexe, conversaționale. Potrivit anunțului oficial al Google făcut de Pandu Nayak, Vicepreședintele Search, această actualizare reprezintă unul dintre cele mai mari salturi înainte în tehnologia de căutare din ultimii cinci ani, impactând aproximativ 10% din toate interogările de căutare (aproximativ 560 de milioane de interogări zilnic doar în Statele Unite). Actualizarea BERT a fost concepută în special pentru a îmbunătăți rezultatele căutării pentru interogări mai lungi, formulate în limbaj natural, unde prepozițiile și relațiile contextuale dintre cuvinte sunt critice pentru înțelegerea intenției utilizatorului.

Dezvoltarea BERT reprezintă culminarea a ani de cercetări în procesarea limbajului natural și învățarea automată la Google. Cercetătorii Google au introdus BERT ca un cadru open-source în octombrie 2018, bazându-se pe progrese anterioare în rețele neuronale bazate pe transformatoare. Tehnologia a apărut din eforturile mai ample ale Google de a depăși simpla potrivire a cuvintelor cheie în favoarea înțelegerii semantice—o călătorie începută cu Actualizarea Hummingbird în 2013 și continuată cu RankBrain în 2015. Însă, în timp ce RankBrain a ajutat Google să înțeleagă interogările noi prin asocierea lor cu altele similare, BERT a introdus o abordare fundamental diferită, citind textul bidirecțional. Această descoperire a fost posibilă datorită progreselor în învățarea automată și disponibilității unei infrastructuri de calcul mai puternice, inclusiv Cloud TPU (Unități de Procesare Tensorială), pe care Google le-a folosit pentru prima dată pentru a livra rezultate de căutare la scară largă. Echipa de cercetare Google AI a recunoscut că algoritmii anteriori aveau dificultăți în a înțelege importanța unor cuvinte mici precum „pentru”, „către” și „nu” în interogări, interpretând adesea greșit intenția utilizatorului. Metodologia de antrenare bidirecțională a BERT a rezolvat această problemă, permițând algoritmului să ia în considerare contextul complet al fiecărui cuvânt dintr-o propoziție, nu doar cuvintele care-l precedă sau îl urmează în secvență.

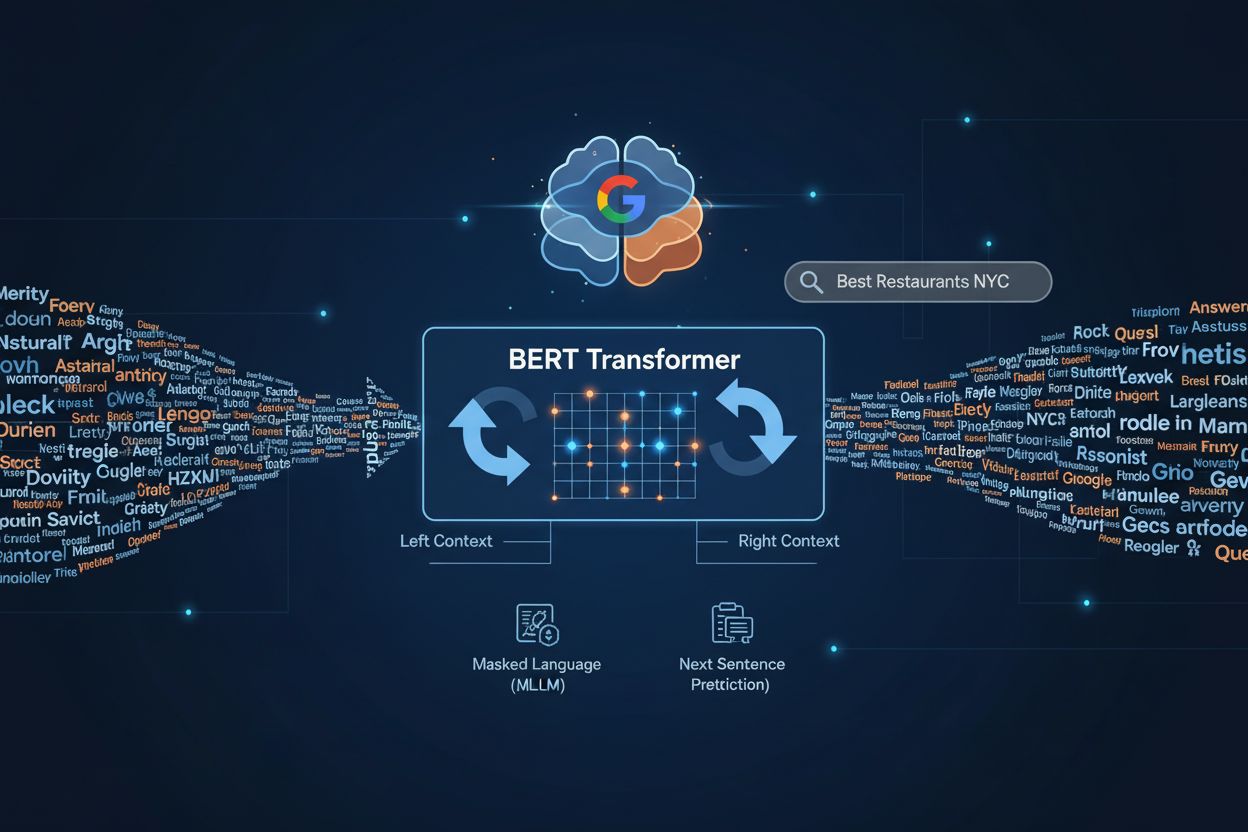

BERT funcționează printr-o arhitectură sofisticată de rețele neuronale care procesează limbajul într-un mod fundamental diferit față de algoritmii anteriori. Inovația centrală este abordarea bidirecțională: în loc să citească textul secvențial de la stânga la dreapta sau invers, BERT analizează toate cuvintele dintr-o propoziție simultan, înțelegând sensul fiecărui cuvânt pe baza relației sale cu toate celelalte cuvinte din context. Acest lucru este realizat prin modele de transformatoare, care folosesc mecanisme de atenție pentru a cântări importanța diferitelor cuvinte unele față de altele. Când un utilizator introduce o interogare, BERT segmentează textul în componente individuale și procesează aceste „tokens” prin mai multe straturi de codificatoare de tip transformator. Fiecare strat rafinează înțelegerea relațiilor dintre cuvinte și a sensului contextual. Aspectul „bidirecțional” este esențial: înseamnă că BERT nu privește doar ce vine înaintea unui cuvânt pentru a-i înțelege sensul, ci ia în calcul și ceea ce vine după, oferind o imagine contextuală completă. De exemplu, în interogarea „stau esteticienii mult în picioare la serviciu”, BERT înțelege că „stau” se referă la poziționarea fizică (un verb legat de cerințele ocupării unui loc de muncă), nu la „stand-alone” (un adjectiv compus), deoarece analizează contextul complet al propoziției. Această procesare bidirecțională permite BERT să gestioneze cuvinte ambigue cu multiple sensuri, să înțeleagă importanța prepozițiilor și să surprindă nuanțe lingvistice subtile pe care algoritmii anteriori le ratau. Modelul a fost antrenat pe cantități masive de date text fără etichetare, permițându-i să învețe tipare de limbaj și relații semantice fără a necesita adnotare manuală.

Impactul practic al Actualizării BERT asupra rezultatelor căutării a fost substanțial, în special pentru interogările complexe și conversaționale. Google a demonstrat acest lucru prin mai multe exemple reale în anunțul lor oficial. Un exemplu notabil a implicat interogarea „2019 călător brazilian către SUA are nevoie de viză”—înainte de BERT, algoritmul Google se concentra prea mult pe potrivirea cuvintelor cheie și returna rezultate despre cetățeni americani care călătoresc în Brazilia, ratând complet contextul direcțional indicat de cuvântul „către”. După BERT, motorul de căutare a înțeles corect că interogarea se referă la un brazilian care călătorește în Statele Unite și a returnat informații relevante despre viză pentru acel scenariu specific. Un alt exemplu a arătat cum BERT a îmbunătățit rezultatele pentru „stau esteticienii mult în picioare la serviciu” înțelegând că „stau” vizează cerințele fizice ale meseriei, nu făcând asocierea cu „stand-alone” din rezultate irelevante. Aceste îmbunătățiri înseamnă că utilizatorii pot căuta acum într-o manieră naturală, conversațională, fără să recurgă la ceea ce Google numește „keyword-ese”—practica de a tasta șiruri stângace de cuvinte cheie despre care utilizatorii credeau că motoarele de căutare le vor înțelege. Cu BERT, utilizatorii pot pune întrebări așa cum ar vorbi în mod firesc, iar Google le va înțelege intenția mai precis. Această schimbare a fost deosebit de benefică pentru căutarea vocală, unde interogările tind să fie mai lungi și conversaționale. Actualizarea a îmbunătățit și fragmentele recomandate, Google aplicând modelele BERT pentru a identifica mai bine care secțiuni de conținut răspund cel mai precis și concis întrebărilor utilizatorilor, rezultând în răspunsuri mai relevante pe poziția zero.

| Algoritm | An lansare | Focus principal | Metodă de procesare | Impact interogări | Inovație cheie |

|---|---|---|---|---|---|

| RankBrain | 2015 | Înțelegerea interogărilor noi | Potrivire secvențială de tipare | ~15% din interogări | Gestionează interogări de căutare necunoscute prin asociere de similaritate |

| BERT | 2019 | Înțelegerea contextuală a limbajului | Analiză bidirecțională cu transformatoare | ~10% din interogări | Citește textul în ambele direcții simultan pentru context complet |

| MUM | 2021 (lansare limitată) | Înțelegere multimodală și multilingvă | Model unificat multitask | În extindere | De 1.000x mai puternic decât BERT; procesează imagini, video, text |

| Hummingbird | 2013 | Căutare în limbaj natural | Analiză semantică de cuvinte cheie | ~90% din interogări | A introdus căutarea semantică și interogările conversaționale |

| Panda | 2011 | Evaluarea calității conținutului | Evaluare de conținut | Variabil | A penalizat conținutul de slabă calitate și subțire |

Actualizarea BERT a schimbat fundamental bunele practici SEO, de la optimizarea rigidă pe cuvinte cheie către SEO semantic și alinierea la intenția utilizatorului. Deoarece BERT răsplătește conținutul scris natural, relevant contextual, profesioniștii SEO au trebuit să-și adapteze strategiile în consecință. O implicație crucială este că umplerea cuvintelor cheie și plasarea artificială a acestora au devenit și mai ineficiente, deoarece BERT poate distinge acum între utilizarea naturală a limbajului și inserarea forțată a cuvintelor cheie. Creatorii de conținut trebuie să se concentreze pe redactarea clară și corectă gramatical, care răspunde cu adevărat întrebărilor utilizatorului, nu pe optimizarea pentru expresii cheie specifice. Actualizarea a subliniat și importanța clusterelor tematice și acoperirii cuprinzătoare a subiectului—în loc să vizezi cuvinte cheie individuale, SEO-ul de succes presupune acum crearea de conținut aprofundat care explorează subiectul din mai multe perspective, integrând natural termeni și concepte înrudite. Fragmentele recomandate au devenit mai competitive, deoarece înțelegerea îmbunătățită de BERT înseamnă că doar răspunsurile cu adevărat utile și bine structurate sunt probabil selectate pentru poziția zero. De asemenea, actualizarea a evidențiat semnificația prepozițiilor și a cuvintelor mici de legătură care anterior erau trecute cu vederea; conținutul trebuie să folosească acum aceste cuvinte natural și corect, deoarece BERT le recunoaște importanța pentru sens. Cuvintele cheie long-tail și expresiile conversaționale au devenit mai valoroase, deoarece BERT excelează la înțelegerea acestor tipare de limbaj natural. Totuși, este important de notat că BERT nu înlocuiește fundamentele SEO tradiționale—backlink-urile, viteza site-ului, optimizarea pentru mobil și SEO-ul tehnic rămân factori critici de clasare. BERT înseamnă pur și simplu că relevanța semantică, claritatea și calitatea conținutului sunt mai importante ca niciodată.

Deși BERT a fost dezvoltat special pentru Căutarea Google, principiile și tehnologia sa au influențat modul în care și alte sisteme AI procesează limbajul natural. ChatGPT, Claude, Perplexity și Google AI Overviews folosesc toate arhitecturi similare bazate pe transformatoare și metode de procesare bidirecțională pentru a înțelege interogările utilizatorilor și a genera răspunsuri. Înțelegerea abordării BERT pentru procesarea limbajului natural este, așadar, relevantă pentru oricine monitorizează modul în care conținutul propriu apare pe mai multe platforme AI. Pentru Google AI Overviews (fost SGE—Search Generative Experience), înțelegerea contextuală a lui BERT ajută la determinarea surselor citate și la modul în care conținutul este rezumat în răspunsurile generate de AI. Capacitatea algoritmului de a înțelege sensul semantic înseamnă că nu este necesară o potrivire exactă a conținutului cu interogarea; în schimb, conținutul care răspunde intenției reale a utilizatorului are șanse mai mari să fie evidențiat. Pentru Perplexity AI, care pune accent pe atribuirea sursei și căutarea conversațională, procesarea de tip BERT ajută sistemul să înțeleagă care surse răspund cel mai bine întrebărilor complexe, cu multiple fațete. ChatGPT și Claude folosesc arhitecturi de transformatoare similare cu cea a BERT, însă la scări mult mai mari, permițându-le să înțeleagă solicitări nuanțate și să genereze răspunsuri adecvate contextului. Acest lucru înseamnă că un conținut optimizat după principiile BERT—clar, relevant contextual, scris natural și care răspunde intenției utilizatorului—are șanse mai mari să fie citat și evidențiat pe aceste platforme AI. Pentru brandurile și creatorii de conținut care folosesc AmICited pentru a-și monitoriza prezența în rezultatele de căutare AI, înțelegerea accentului pus de BERT pe relevanța semantică și sensul contextual este crucială pentru optimizarea conținutului ce va fi selectat de aceste sisteme AI.

De la introducerea sa în 2019, BERT a continuat să evolueze și să influențeze dezvoltarea algoritmilor de căutare Google. Tehnologia a stat la baza MUM (Multitask Unified Model), anunțat în mai 2021, pe care Google îl descrie ca fiind de 1.000 de ori mai puternic decât BERT. MUM extinde capabilitățile BERT gestionând simultan mai multe tipuri de conținut (text, imagini, video) și înțelegând informația în diferite limbi fără a necesita antrenament separat pentru fiecare limbă. Aceasta reprezintă un salt semnificativ înainte în capacitatea AI de a înțelege și procesa informația în mod cuprinzător. Privind spre viitor, traiectoria procesării limbajului natural în căutare sugerează un accent continuu pe înțelegerea semantică, recunoașterea intenției utilizatorului și relevanța contextuală. Pe măsură ce sistemele AI devin mai sofisticate, distincția dintre potrivirea cuvintelor cheie și înțelegerea semantică va deveni și mai pronunțată. Creatorii de conținut și profesioniștii SEO trebuie să se aștepte că viitoarele actualizări de algoritm vor răsplăti și mai mult conținutul de calitate, scris natural, care răspunde cu adevărat nevoilor utilizatorului. Ascensiunea AI generativ în rezultatele de căutare face ca înțelegerea modului în care algoritmi precum BERT interpretează conținutul să fie tot mai importantă pentru asigurarea atribuirii și vizibilității corecte. În plus, pe măsură ce căutarea vocală și AI conversațională continuă să crească, punctul forte al BERT în procesarea limbajului natural va rămâne relevant. Tehnologia are implicații și dincolo de căutare—principiile BERT sunt aplicate în moderarea conținutului, analiza sentimentelor și alte sarcini de procesare a limbajului natural. Pentru organizațiile care își monitorizează prezența brandului în sistemele AI, a fi la curent cu BERT și tehnologiile conexe ajută la explicarea motivului pentru care anumite conținuturi sunt selectate pentru răspunsurile AI, iar altele nu. Viitorul căutării va implica, probabil, o înțelegere și mai sofisticată a intenției utilizatorului, contextului și sensului semantic, construindu-se direct pe fundația pusă de BERT.

Pentru a optimiza conținutul pentru BERT și a menține vizibilitatea în rezultatele moderne de căutare, creatorii de conținut ar trebui să urmeze câteva practici dovedite. Scrie natural și conversațional: Folosește un limbaj care sună uman și natural, nu artificial optimizat pentru cuvinte cheie. BERT răsplătește conținutul care se citește bine și comunică clar. Concentrează-te pe intenția utilizatorului: Înțelege ce anume dorește utilizatorul să găsească atunci când caută un anumit subiect și creează conținut care răspunde direct acelei intenții. Acoperă subiectul în profunzime: În loc să vizezi cuvinte cheie individuale, creează conținut amplu care explorează subiectul din toate unghiurile, integrând natural concepte și termeni înrudiți. Structurează clar conținutul: Folosește titluri, subtitluri, puncte și o structură logică pentru a ajuta atât cititorii, cât și motoarele de căutare să înțeleagă organizarea și sensul conținutului tău. Răspunde direct la întrebări: Include secțiuni FAQ și răspunsuri clare la întrebări frecvente legate de subiectul tău, deoarece BERT excelează la potrivirea interogărilor de tip întrebare cu răspunsuri relevante. Menține acuratețea gramaticală: BERT poate diferenția acum între un conținut corect sau incorect gramatical, așa că gramatica și sintaxa contează mai mult ca oricând. Folosește prepoziții și cuvinte de legătură în mod natural: Nu evita cuvintele mici precum „pentru”, „către”, „de” și „cu”—folosește-le natural, deoarece contribuie la sensul semantic. Creează conținut pentru oameni, nu pentru algoritmi: Ține minte că BERT este conceput să răsplătească conținutul care ajută cu adevărat utilizatorii, nu pe cel optimizat pentru algoritmi. Cea mai bună strategie SEO este să creezi conținut valoros, util, care servește nevoilor publicului tău. Folosește date structurate: Aplică schema markup pentru a ajuta motoarele de căutare să înțeleagă sensul și contextul conținutului, completând înțelegerea limbajului natural oferită de BERT. Monitorizează cuvintele cheie long-tail și conversaționale: Urmărește cum performează conținutul tău pentru expresii de căutare mai lungi, naturale, deoarece aici se văd cel mai clar îmbunătățirile aduse de BERT.

+++

BERT înseamnă Reprezentări Bidirecționale ale Codificatorului din Transformatoare. Cercetătorii Google au introdus BERT ca un cadru open-source de învățare automată în octombrie 2018, iar Google l-a aplicat oficial în clasamentele de căutare pe 25 octombrie 2019. Această actualizare a reprezentat una dintre cele mai semnificative îmbunătățiri ale Căutării Google din ultimii cinci ani, schimbând fundamental modul în care motorul de căutare procesează și înțelege interogările de limbaj natural.

În timp ce RankBrain (2015) a ajutat Google să înțeleagă interogările noi prin asocierea lor cu altele similare, BERT merge mai departe citind textul bidirecțional—analizând cuvintele în raport cu toate celelalte cuvinte din jur simultan, nu secvențial. BERT înțelege contextul, prepozițiile și sensul nuanțat mai precis decât RankBrain, fiind deosebit de eficient pentru interogări mai lungi, conversaționale, unde cuvinte mici precum „pentru” și „către” schimbă semnificativ sensul.

Google a declarat că BERT afectează aproximativ 10% din toate interogările de căutare din Statele Unite pentru căutările în limba engleză, ceea ce înseamnă aproximativ 560 de milioane de interogări pe zi. Actualizarea afectează, de asemenea, fragmentele recomandate din 24 de țări în mai multe limbi, demonstrând importanța sa globală în îmbunătățirea relevanței și acurateței rezultatelor de căutare.

Nu există o strategie directă de optimizare pentru BERT, așa cum există pentru optimizarea pentru mobil. În schimb, BERT răsplătește conținutul de înaltă calitate, scris natural, care răspunde clar întrebărilor utilizatorilor. Concentrează-te pe redactarea unui conținut corect gramatical, relevant contextual, care abordează cuprinzător intenția utilizatorului. Asigură-te că folosești limbaj natural, tratezi subiectele în profunzime și oferi valoare autentică—aceste practici sunt în acord cu accentul BERT pe înțelegerea semantică în detrimentul potrivirii de cuvinte cheie.

BERT utilizează procesarea bidirecțională, ceea ce înseamnă că citește textul atât de la stânga la dreapta, cât și de la dreapta la stânga simultan, înțelegând modul în care fiecare cuvânt se raportează la toate celelalte cuvinte din propoziție. Acest lucru îi permite lui BERT să surprindă întregul context și sensul nuanțat al interogărilor. De exemplu, în „călător brazilian către SUA are nevoie de viză”, BERT înțelege că „către” indică direcția din Brazilia spre SUA, nu invers, oferind rezultate mai relevante.

Google aplică modelele BERT atât în clasamentele de căutare, cât și în fragmentele recomandate. BERT îmbunătățește selecția fragmentelor recomandate printr-o mai bună înțelegere a secțiunilor de conținut care răspund cel mai precis și concis întrebărilor utilizatorilor. Acest lucru înseamnă că paginile cu răspunsuri clare, bine structurate la întrebări uzuale au șanse mai mari să fie selectate pentru poziția zero, deoarece BERT poate evalua mai exact relevanța și calitatea răspunsului.

BERT îmbunătățește semnificativ performanța căutării vocale deoarece interogările vocale tind să fie mai conversaționale și naturale decât cele tastate. Deoarece BERT excelează la înțelegerea limbajului natural, a frazelor mai lungi și a sensului contextual, oferă rezultate mai bune pentru căutările vocale. Utilizatorii pot adresa acum întrebări într-un mod natural, conversațional, fără a recurge la „keyword-ese”, iar BERT le va înțelege intenția mai precis.

Nu, BERT completează, nu înlocuiește fundamentele SEO tradiționale. Backlink-urile, viteza site-ului, optimizarea pentru mobil și SEO tehnic rămân factori importanți de clasare. BERT îmbunătățește în special modul în care Google înțelege sensul conținutului și intenția utilizatorului, așadar funcționează alături de ceilalți factori de clasare. O strategie SEO completă trebuie să abordeze toți factorii—BERT doar face ca calitatea conținutului și claritatea limbajului natural să fie mai critice.

Începe să urmărești cum te menționează chatbot-urile AI pe ChatGPT, Perplexity și alte platforme. Obține informații utile pentru a-ți îmbunătăți prezența în AI.

Află despre BERT, arhitectura, aplicațiile și relevanța sa actuală. Înțelege cum se compară BERT cu alternativele moderne și de ce rămâne esențial pentru sarcin...

Află ce sunt actualizările de algoritm Google, cum funcționează și care este impactul lor asupra SEO. Înțelege actualizările principale, actualizările de spam ș...

Discuție în comunitate despre dacă optimizarea pentru BERT mai contează în era GPT-4 și a altor modele lingvistice mari. Înțelegerea a ceea ce s-a schimbat pent...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.