Ce este căutarea vectorială și cum funcționează?

Află cum căutarea vectorială folosește embedding-uri de învățare automată pentru a găsi elemente similare pe baza sensului, nu doar a cuvintelor-cheie exacte. Î...

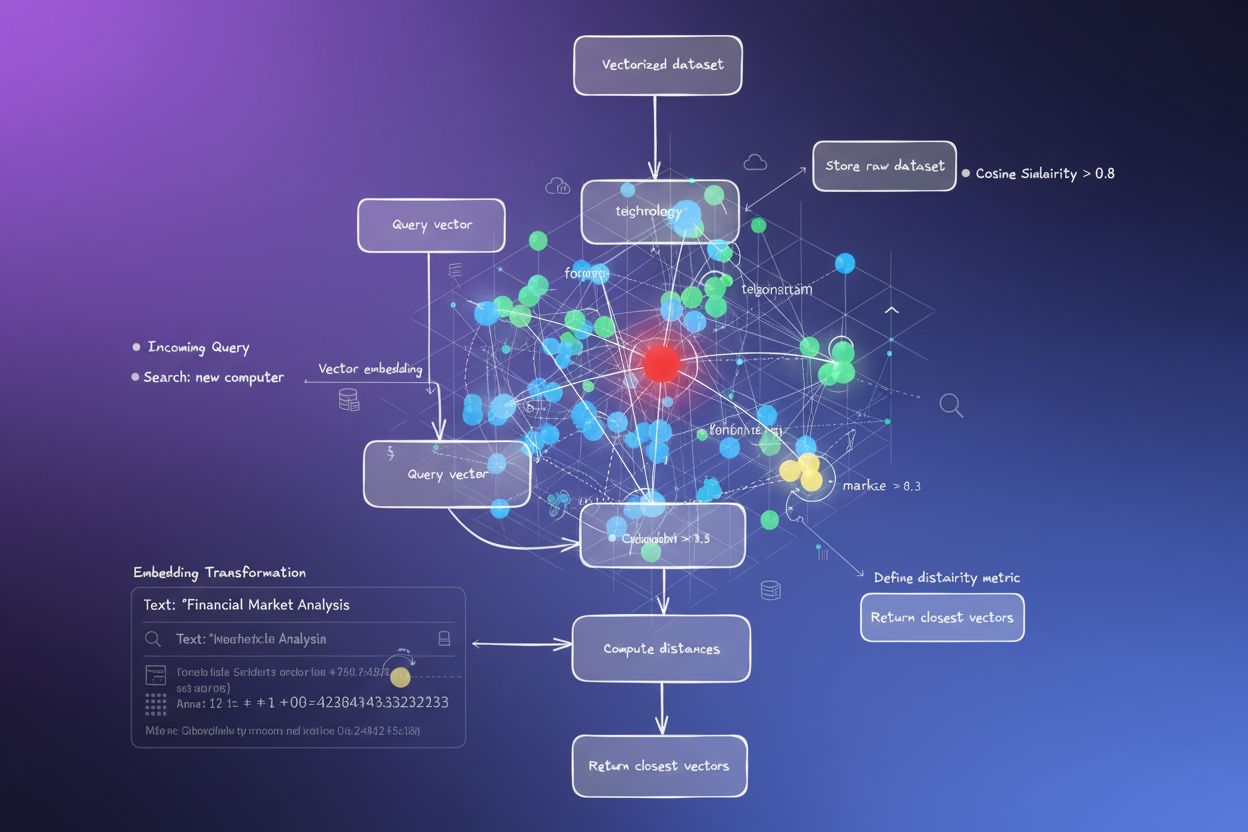

Căutarea vectorială este o metodă de găsire a elementelor similare într-un set de date prin reprezentarea datelor ca vectori matematici și compararea lor folosind metrici de distanță precum similaritatea cosinus sau distanța euclidiană. Această abordare permite înțelegerea semantică dincolo de potrivirile de cuvinte-cheie, permițând sistemelor să descopere relații și asemănări bazate pe sens, nu doar pe potriviri exacte ale textului.

Căutarea vectorială este o metodă de găsire a elementelor similare într-un set de date prin reprezentarea datelor ca vectori matematici și compararea lor folosind metrici de distanță precum similaritatea cosinus sau distanța euclidiană. Această abordare permite înțelegerea semantică dincolo de potrivirile de cuvinte-cheie, permițând sistemelor să descopere relații și asemănări bazate pe sens, nu doar pe potriviri exacte ale textului.

Căutarea vectorială este o metodă de a găsi elemente similare într-un set de date prin reprezentarea datelor ca vectori matematici și compararea acestora folosind metrici de distanță pentru a măsura similaritatea semantică. Spre deosebire de căutarea tradițională bazată pe cuvinte-cheie, care se bazează pe potriviri exacte de text, căutarea vectorială înțelege sensul și contextul din spatele datelor, convertindu-le în reprezentări numerice de înaltă dimensiune numite embedding-uri vectoriale. Această abordare permite sistemelor să descopere relații și asemănări bazate pe conținut semantic, nu doar pe caracteristici superficiale, fiind deosebit de puternică pentru aplicațiile ce necesită înțelegere contextuală. Căutarea vectorială a devenit fundamentală pentru sistemele AI moderne, permițând căutare semantică, motoare de recomandare, detecție de anomalii și generare augmentată de recuperare (RAG) pe platforme precum ChatGPT, Perplexity, Google AI Overviews și Claude.

În esență, căutarea vectorială transformă datele în reprezentări numerice unde proximitatea spațială indică similaritate semantică. Fiecare punct de date—fie text, imagine sau audio—este convertit într-un vector, practic un șir de numere ce reprezintă caracteristici sau semnificație. De exemplu, cuvântul „restaurant” poate fi reprezentat ca [0.2, -0.5, 0.8, 0.1], fiecare număr captând diferite aspecte ale sensului semantic. Principiul fundamental este că elementele semantic similare vor avea vectorii poziționați aproape unii de alții în acest spațiu de înaltă dimensiune, în timp ce elementele diferite vor fi departe. Această structură matematică permite calculatoarelor să compare concepte pe bază de sens, nu doar pe potriviri exacte de cuvinte, astfel încât o căutare după „cele mai bune localuri de luat masa” va returna rezultate pentru „restaurante cotate cu cele mai bune recenzii” chiar și fără suprapunere exactă a cuvintelor.

Procesul de conversie a datelor în vectori se numește embedding și este realizat de modele de învățare automată antrenate pe seturi mari de date. Aceste modele învață să mapeze concepte similare în locații apropiate în spațiul vectorial prin expunere la miliarde de exemple. Modele de embedding comune includ Word2Vec, care învață relații între cuvinte din context; BERT (Bidirectional Encoder Representations from Transformers), care surprinde sensul contextual; și CLIP (Contrastive Language-Image Pre-training), care gestionează date multimodale. Embedding-urile rezultate au, de obicei, între 100 și peste 1.000 de dimensiuni, creând o reprezentare matematică bogată a relațiilor semantice. Când un utilizator realizează o căutare, interogarea sa este convertită în vector folosind același model de embedding, iar sistemul calculează distanțele dintre vectorul interogării și toți vectorii stocați pentru a identifica cele mai similare elemente.

Căutarea vectorială se bazează pe metrici de distanță pentru a cuantifica cât de similare sunt două vectori. Cele trei metrici principale sunt similaritatea cosinusului, distanța euclidiană și similaritatea produsului scalar, fiecare cu proprietăți matematice și utilizări distincte. Similaritatea cosinusului măsoară unghiul dintre doi vectori, variind de la -1 la 1, unde 1 indică direcție identică (similaritate maximă) și 0 indică vectori ortogonali (nicio relație). Această metrică este deosebit de valoroasă pentru aplicații NLP deoarece se concentrează pe direcția semantică, indiferent de magnitudinea vectorului, fiind ideală pentru compararea documentelor de lungimi diferite. Distanța euclidiană calculează distanța în linie dreaptă între vectori în spațiu multidimensional, luând în calcul atât magnitudinea, cât și direcția. Această metrică este sensibilă la scală, fiind utilă când magnitudinea vectorilor conține informații semnificative, de exemplu în recomandări unde frecvența cumpărăturilor contează.

Similaritatea produsului scalar combină aspecte din ambele metrici, considerând atât magnitudinea, cât și direcția, oferind eficiență computațională. Multe modele lingvistice mari folosesc produsul scalar pentru antrenare, fiind alegerea potrivită pentru aceste aplicații. Alegerea corectă a metricii este critică—cercetările arată că folosirea aceleiași metrici cu care a fost antrenat modelul de embedding oferă cele mai bune rezultate. De exemplu, modelul all-MiniLM-L6-v2 a fost antrenat cu similaritate cosinus, deci folosirea similarității cosinus în index va produce rezultate optime. Organizațiile care implementează căutare vectorială trebuie să potrivească atent metrica aleasă cu modelul de embedding și cazul de utilizare pentru a asigura acuratețe și performanță.

| Aspect | Căutare vectorială | Căutare pe cuvinte-cheie | Căutare hibridă |

|---|---|---|---|

| Metodă de potrivire | Similaritate semantică pe bază de sens | Potrivire exactă de cuvinte sau expresii | Combină potrivirea semantică și pe cuvinte-cheie |

| Înțelegerea interogării | Înțelege intenția și contextul | Necesită prezența exactă a cuvintelor-cheie | Valorifică ambele abordări pentru rezultate complexe |

| Gestionare sinonime | Găsește automat sinonime și termeni înrudiți | Ratează sinonimele dacă nu sunt indexate explicit | Capturează sinonimele prin ambele metode |

| Performanță pe interogări vagi | Excelentă—înțelege intenția | Slabă—necesită cuvinte precise | Foarte bună—acoperă ambele interpretări |

| Cost computațional | Ridicat—necesită embedding și calcule de similaritate | Scăzut—potrivire simplă de șiruri | Moderat—rulează ambele căutări simultan |

| Scalabilitate | Necesită baze de date vectoriale specializate | Funcționează cu baze de date tradiționale | Necesită sisteme capabile de căutare hibridă |

| Cazuri de utilizare | Căutare semantică, recomandări, RAG, detecție de anomalii | Căutare exactă de expresii, date structurate | Căutare enterprise, monitorizare AI, urmărire brand |

| Exemplu | Căutând „idei de cină sănătoasă” găsește „pregătire de mese nutritive” | Găsește doar rezultate cu „sănătoasă” și „cină” exact | Găsește atât potriviri exacte, cât și conținut semantic înrudit |

Implementarea căutării vectoriale implică mai mulți pași interconectați ce transformă datele brute în reprezentări semantice interogabile. Primul pas este ingestia și preprocesarea datelor, unde documentele brute, imaginile sau alte date sunt curățate și normalizate. Urmează transformarea în vectori, unde un model de embedding convertește fiecare element într-un vector numeric, de obicei între 100 și peste 1.000 de dimensiuni. Acești vectori sunt apoi stocați într-o bază de date vectorială sau într-o structură de index optimizată pentru date de înaltă dimensiune. Când sosește o interogare, aceasta trece prin același proces de embedding pentru a crea un vector de interogare. Sistemul calculează apoi scorurile de similaritate între vectorul interogării și toți vectorii stocați, ordonând rezultatele după proximitate.

Pentru eficiență la scară, sistemele folosesc algoritmi Approximate Nearest Neighbor (ANN) precum HNSW (Hierarchical Navigable Small World), IVF (Inverted File Index) sau ScaNN (Scalable Nearest Neighbors). Acești algoritmi sacrifică acuratețea perfectă pentru viteză, permițând căutări în milioane sau miliarde de vectori în milisecunde, nu secunde. De exemplu, HNSW organizează vectorii într-o structură grafică multilayer unde nivelurile superioare conțin conexiuni de lungă distanță pentru traversare rapidă, iar cele inferioare conexiuni scurte pentru precizie. Această abordare ierarhică reduce complexitatea căutării de la liniară O(n) la logaritmică O(log n), făcând căutarea vectorială la scară largă practică. Alegerea algoritmului depinde de factori precum dimensiunea setului de date, volumul interogărilor, cerințele de latență și resursele computaționale disponibile.

Căutarea vectorială a devenit esențială pentru platformele de monitorizare AI precum AmICited care urmăresc mențiuni ale brandului în sistemele AI. Monitorizarea tradițională pe bază de cuvinte-cheie ar rata mențiunile parafrazate, referințele contextuale și variațiile semantice ale denumirii brandului sau ale URL-urilor de domeniu. Căutarea vectorială permite acestor platforme să detecteze când brandul tău este menționat în răspunsuri generate de AI, chiar dacă formularea exactă diferă. De exemplu, dacă domeniul tău este „amicited.com”, căutarea vectorială poate identifica mențiuni de tipul „platformă de monitorizare a prompturilor AI” sau „vizibilitate a brandului în AI generativ” ca fiind contextuale pentru afacerea ta, chiar și fără menționarea explicită a URL-ului. Această înțelegere semantică este crucială pentru urmărirea completă a citărilor AI pe ChatGPT, Perplexity, Google AI Overviews și Claude.

Piața tehnologiei de căutare vectorială înregistrează o creștere explozivă, reflectând recunoașterea valorii sale la nivel enterprise. Potrivit cercetărilor de piață, piața bazelor de date vectoriale era evaluată la 1,97 miliarde $ în 2024 și este estimată să ajungă la 10,60 miliarde $ până în 2032, cu o rată anuală compusă de creștere (CAGR) de 23,38%. În plus, Databricks a raportat o creștere de 186% a adopției bazelor de date vectoriale doar în primul an după lansarea publică a funcției de căutare vectorială în decembrie 2023. Această adopție rapidă demonstrează că organizațiile consideră căutarea vectorială drept infrastructură critică pentru aplicațiile AI. Pentru organizațiile ce monitorizează prezența lor în sisteme AI, căutarea vectorială oferă înțelegerea semantică necesară pentru captarea tuturor mențiunilor relevante, nu doar a potrivirilor exacte de cuvinte-cheie.

Performanța căutării vectoriale la scară depinde critic de tehnici sofisticate de indexare ce echilibrează viteza, acuratețea și consumul de memorie. HNSW (Hierarchical Navigable Small World) a devenit una dintre cele mai populare abordări, organizând vectorii într-un graf multilayer unde fiecare strat conține conexiuni progresiv mai scurte. Algoritmul începe căutările la stratul superior cu conexiuni de lungă distanță pentru traversare rapidă, apoi coboară prin straturi cu conexiuni tot mai precise. Cercetările arată că HNSW atinge performanțe de top cu rate de recall peste 99% menținând latențe sub o milisecundă pe interogare. Totuși, HNSW necesită multă memorie—benchmark-urile arată că indexarea a 1 milion de vectori cu HNSW poate necesita între 0,5GB și 5GB în funcție de parametri, ceea ce face optimizarea memoriei importantă pentru implementări la scară mare.

IVF (Inverted File Index) oferă o abordare alternativă prin gruparea vectorilor și indexarea lor după centroizii de cluster. Această tehnică reduce spațiul de căutare concentrându-se pe clustere relevante, nu pe toți vectorii. ScaNN (Scalable Nearest Neighbors), dezvoltat de Google Research, este optimizat special pentru căutarea după produs scalar și oferă performanțe excelente pentru sisteme de recomandare. Product Quantization (PQ) comprimă vectorii împărțindu-i în subvectori și cuantificând fiecare independent, reducând cerințele de memorie de 10-100x cu un mic cost de acuratețe. Organizațiile care implementează căutare vectorială trebuie să selecteze atent tehnicile de indexare în funcție de cerințele specifice—dacă prioritizează acuratețea recall, viteza căutării, eficiența memoriei sau o combinație a acestora. Domeniul evoluează rapid, noi algoritmi și tehnici de optimizare apărând regulat pentru a aborda provocările computaționale ale operațiilor vectoriale de înaltă dimensiune.

Definiția și aplicarea căutării vectoriale continuă să evolueze pe măsură ce sistemele AI devin mai sofisticate și adopția în mediul enterprise se accelerează. Direcția viitoare vizează sisteme de căutare hibride care combină căutarea vectorială cu căutarea tradițională pe cuvinte-cheie și filtre avansate. Aceste abordări hibride valorifică înțelegerea semantică a căutării vectoriale menținând în același timp precizia și familiaritatea potrivirii pe cuvinte-cheie, oferind rezultate superioare pentru interogări complexe. În plus, căutarea vectorială multimodală devine o capacitate esențială, permițând sistemelor să caute simultan în text, imagini, audio și video folosind spații comune de embedding. Această dezvoltare va permite experiențe de căutare mai intuitive și cuprinzătoare pentru diverse tipuri de date.

Pentru organizațiile care monitorizează prezența lor în sisteme AI, evoluția căutării vectoriale are implicații profunde. Pe măsură ce platformele AI precum ChatGPT, Perplexity, Google AI Overviews și Claude se bazează tot mai mult pe căutarea vectorială pentru recuperarea și ordonarea conținutului, înțelegerea modului în care brandul tău apare semantic devine la fel de importantă ca vizibilitatea tradițională pe cuvinte-cheie. Trecerea către înțelegerea semantică înseamnă că monitorizarea brandului și urmărirea citărilor AI trebuie să evolueze dincolo de detecția simplă a cuvintelor-cheie pentru a surprinde mențiunile contextuale și relațiile semantice. Organizațiile care investesc în înțelegerea căutării vectoriale și a aplicațiilor sale vor fi mai bine poziționate pentru a-și optimiza vizibilitatea în sistemele AI generative. Convergența tehnologiei de căutare vectorială cu platformele de monitorizare AI reprezintă o schimbare fundamentală în modul în care brandurile își înțeleg și gestionează prezența în peisajul informațional condus de AI.

Căutarea tradițională pe bază de cuvinte-cheie caută potriviri exacte de cuvinte în documente, în timp ce căutarea vectorială înțelege sensul semantic și contextul. Căutarea vectorială convertește textul în reprezentări numerice numite embedding-uri, permițând găsirea rezultatelor relevante chiar și atunci când cuvintele-cheie exacte nu se potrivesc. De exemplu, căutând „căști wireless” prin căutare vectorială vei obține și rezultate pentru „earbuds Bluetooth” deoarece împărtășesc un sens semantic similar, pe când căutarea pe cuvinte-cheie ar rata această conexiune.

Embedding-urile vectoriale sunt reprezentări numerice ale datelor (text, imagini, audio) convertite în aranjamente de numere care captează sensul semantic. Sunt create cu modele de învățare automată precum Word2Vec, BERT sau modele bazate pe transformatoare care învață să mapeze concepte similare aproape unele de altele într-un spațiu de înaltă dimensiune. De exemplu, cuvintele „rege” și „regină” vor avea embedding-uri poziționate apropiat pentru că împărtășesc relații semantice, în timp ce „rege” și „banană” vor fi foarte departe.

Cele trei metrici principale sunt similaritatea cosinusului (măsoară unghiul dintre vectori), distanța euclidiană (măsoară distanța în linie dreaptă) și similaritatea produsului scalar (ia în considerare atât magnitudinea, cât și direcția). Similaritatea cosinusului este cea mai populară pentru aplicații NLP deoarece se concentrează pe direcția semantică, indiferent de magnitudinea vectorului. Alegerea metricii trebuie să se potrivească cu cea folosită la antrenarea modelului de embedding pentru acuratețe optimă.

Căutarea vectorială permite platformelor de monitorizare AI precum AmICited să urmărească mențiuni ale brandului în sistemele AI (ChatGPT, Perplexity, Google AI Overviews, Claude) înțelegând contextul semantic în locul potrivirilor exacte de cuvinte-cheie. Astfel pot fi detectate mențiuni parafrazate, concepte înrudite și referințe contextuale la brandul tău, oferind vizibilitate completă asupra modului în care domeniul tău apare în răspunsuri generate de AI pe mai multe platforme.

Algoritmi ANN precum HNSW (Hierarchical Navigable Small World) permit căutări rapide de similaritate în milioane de vectori, găsind vecini apropiați aproximativi, nu exacți. Acești algoritmi folosesc structuri graf ierarhice pentru a reduce complexitatea căutării de la liniară la logaritmică, făcând căutarea vectorială practică la scară largă. HNSW organizează vectorii în grafuri multilayer unde conexiunile de lungă distanță există la niveluri superioare pentru traversare rapidă.

Companiile generează cantități masive de date nestructurate (emailuri, documente, tichete de suport) pe care căutarea tradițională pe cuvinte-cheie nu le poate organiza eficient. Căutarea vectorială permite înțelegerea semantică a acestor date, alimentând aplicații precum căutare inteligentă, sisteme de recomandare, detecție de anomalii și generare augmentată de recuperare (RAG). Potrivit cercetărilor de piață, piața bazelor de date vectoriale va crește de la 2,65 miliarde $ în 2025 la 8,95 miliarde $ până în 2030, reflectând adopția la nivel enterprise.

Bazele de date vectoriale sunt sisteme specializate optimizate pentru stocarea, indexarea și interogarea datelor vectoriale de înaltă dimensiune. Ele implementează tehnici eficiente de indexare precum HNSW, IVF (Inverted File Index) și ScaNN pentru a permite căutări rapide de similaritate la scară. Exemple includ Milvus, Pinecone, Weaviate și Zilliz Cloud. Aceste baze de date gestionează complexitatea computațională a operațiilor vectoriale, permițând organizațiilor să construiască aplicații de căutare semantică și AI gata de producție fără a gestiona complexitatea infrastructurii.

Începe să urmărești cum te menționează chatbot-urile AI pe ChatGPT, Perplexity și alte platforme. Obține informații utile pentru a-ți îmbunătăți prezența în AI.

Află cum căutarea vectorială folosește embedding-uri de învățare automată pentru a găsi elemente similare pe baza sensului, nu doar a cuvintelor-cheie exacte. Î...

Căutarea semantică interpretează sensul și contextul interogărilor folosind NLP și învățare automată. Află cum diferă de căutarea pe bază de cuvinte cheie, alim...

Află cum căutarea semantică folosește AI pentru a înțelege intenția și contextul utilizatorului. Descoperă cum diferă de căutarea prin cuvinte cheie și de ce es...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.