Co je vektorové vyhledávání a jak funguje?

Zjistěte, jak vektorové vyhledávání využívá embeddingy strojového učení k nalezení podobných položek na základě významu, nikoliv přesných klíčových slov. Porozu...

Vektorové vyhledávání je metoda hledání podobných položek v datové sadě tím, že data jsou reprezentována jako matematické vektory a porovnávána pomocí metrik vzdálenosti, jako je kosinová podobnost nebo eukleidovská vzdálenost. Tento přístup umožňuje sémantické pochopení nad rámec pouhého shody klíčových slov, což systémům umožňuje objevovat vztahy a podobnosti na základě významu, nikoli pouze přesné textové shody.

Vektorové vyhledávání je metoda hledání podobných položek v datové sadě tím, že data jsou reprezentována jako matematické vektory a porovnávána pomocí metrik vzdálenosti, jako je kosinová podobnost nebo eukleidovská vzdálenost. Tento přístup umožňuje sémantické pochopení nad rámec pouhého shody klíčových slov, což systémům umožňuje objevovat vztahy a podobnosti na základě významu, nikoli pouze přesné textové shody.

Vektorové vyhledávání je metoda hledání podobných položek v datové sadě tím, že data jsou reprezentována jako matematické vektory a porovnávána pomocí metrik vzdálenosti pro měření sémantické podobnosti. Na rozdíl od tradičního vyhledávání podle klíčových slov, které spoléhá na přesné textové shody, vektorové vyhledávání rozumí významu a kontextu dat tím, že je převádí do vysoce dimenzionálních číselných reprezentací zvaných vektorové embeddingy. Tento přístup umožňuje systémům objevovat vztahy a podobnosti na základě sémantického obsahu místo povrchových znaků, což je zvláště silné pro aplikace vyžadující kontextové porozumění. Vektorové vyhledávání se stalo základním stavebním kamenem moderních AI systémů a umožňuje sémantické vyhledávání, doporučovací enginy, detekci anomálií i retrieval-augmented generation (RAG) napříč platformami jako ChatGPT, Perplexity, Google AI Overviews a Claude.

V jádru vektorového vyhledávání spočívá transformace dat na číselné reprezentace, kde blízkost v prostoru znamená sémantickou podobnost. Každý datový bod – ať už text, obrázek nebo audio – je převeden na vektor, což je v podstatě pole čísel reprezentujících vlastnosti nebo význam. Například slovo „restaurace“ může být reprezentováno jako [0.2, -0.5, 0.8, 0.1], kde každé číslo zachycuje jiný aspekt sémantického významu slova. Základním principem je, že sémanticky podobné položky budou mít vektory umístěné blízko sebe ve vysoce dimenzionálním prostoru, zatímco odlišné položky budou daleko od sebe. Tato matematická struktura umožňuje počítačům porovnávat pojmy na základě významu, nikoli pouze podle přesné shody klíčových slov; například vyhledávání „nejlepší podniky k večeři“ vrátí výsledky pro „nejlépe hodnocené restaurace“, i když se přesná slova neshodují.

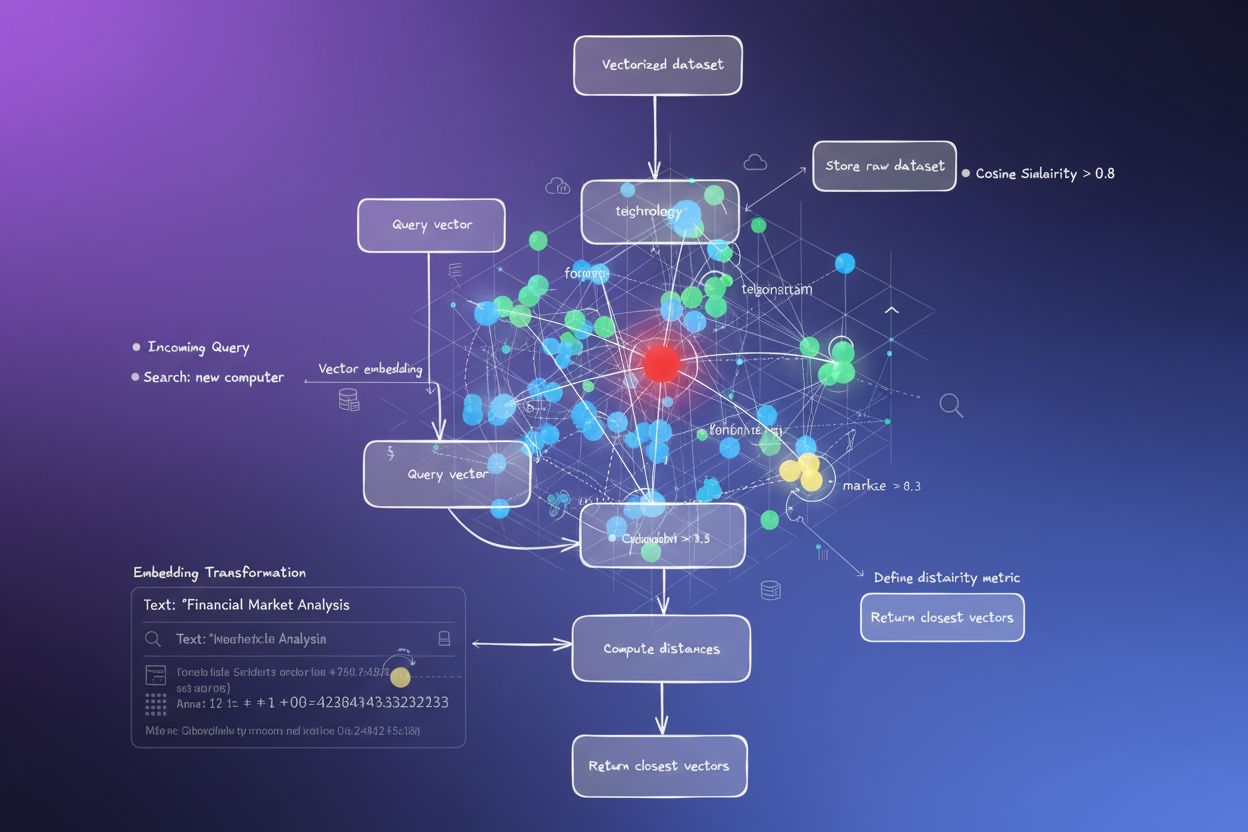

Proces převodu dat na vektory se nazývá embedding, který provádějí modely strojového učení trénované na velkých datových souborech. Tyto modely se učí mapovat podobné pojmy do blízkých míst ve vektorovém prostoru díky expozici miliardám příkladů. Mezi běžné embeddingové modely patří Word2Vec, který se učí vztahům mezi slovy z kontextu; BERT (Bidirectional Encoder Representations from Transformers), který zachycuje kontextový význam; a CLIP (Contrastive Language-Image Pre-training), který pracuje s multimodálními daty. Výsledné embeddingy obvykle zahrnují 100 až 1 000+ rozměrů, což vytváří bohatou matematickou reprezentaci sémantických vztahů. Když uživatel provede vyhledávání, jeho dotaz je převeden na vektor pomocí stejného embeddingového modelu a systém poté vypočítá vzdálenosti mezi vektorem dotazu a všemi uloženými vektory, aby identifikoval nejpodobnější položky.

Vektorové vyhledávání spoléhá na metriky vzdálenosti pro kvantifikaci podobnosti dvou vektorů. Tři hlavní metriky jsou kosinová podobnost, eukleidovská vzdálenost a podobnost pomocí skalárního součinu, z nichž každá má odlišné matematické vlastnosti a použití. Kosinová podobnost měří úhel mezi dvěma vektory, v rozmezí od -1 do 1, kde 1 znamená totožný směr (maximální podobnost) a 0 znamená ortogonální vektory (žádný vztah). Tato metrika je zvláště cenná pro NLP aplikace, protože se zaměřuje na sémantický směr bez ohledu na velikost vektoru, což je ideální pro porovnávání dokumentů různé délky. Eukleidovská vzdálenost počítá přímou vzdálenost mezi vektory ve vícerozměrném prostoru a zohledňuje jak velikost, tak směr. Tato metrika je citlivá na měřítko, což je užitečné, pokud má velikost vektorů smysl, například v doporučovacích systémech, kde záleží na frekvenci nákupu.

Podobnost pomocí skalárního součinu kombinuje aspekty obou metrik, zohledňuje velikost i směr a zároveň nabízí výpočetní efektivitu. Mnoho velkých jazykových modelů používá skalární součin pro trénink, proto je vhodné jej použít i při vyhledávání v těchto aplikacích. Výběr správné metriky je klíčový – výzkumy ukazují, že použití stejné metriky, která byla použita při trénování embeddingového modelu, přináší optimální výsledky. Například model all-MiniLM-L6-v2 byl trénován pomocí kosinové podobnosti, takže použití kosinové podobnosti ve vašem indexu poskytne nejpřesnější výsledky. Organizace implementující vektorové vyhledávání musí pečlivě sladit zvolenou metriku se svým embeddingovým modelem a konkrétním použitím, aby zajistily přesnost i výkon.

| Aspekt | Vektorové vyhledávání | Vyhledávání podle klíčových slov | Hybridní vyhledávání |

|---|---|---|---|

| Metoda porovnání | Sémantická podobnost na základě významu | Přesná shoda slova nebo fráze | Kombinuje sémantickou i klíčovou shodu |

| Porozumění dotazu | Chápe záměr a kontext | Vyžaduje přesnou přítomnost klíčových slov | Využívá oba přístupy pro komplexní výsledky |

| Práce se synonymy | Automaticky najde synonyma a související pojmy | Synonyma přehlédne, pokud nejsou explicitně indexována | Zachytí synonyma oběma metodami |

| Výkon při vágních dotazech | Výborný – chápe záměr | Slabý – vyžaduje přesná slova | Velmi dobrý – pokrývá obě interpretace |

| Výpočetní náročnost | Vyšší – vyžaduje embedding a výpočty podobnosti | Nižší – jednoduché porovnání řetězců | Střední – provádí oba typy vyhledávání paralelně |

| Škálovatelnost | Vyžaduje specializované vektorové databáze | Funguje s tradičními databázemi | Vyžaduje hybridní systémy |

| Případy použití | Sémantické vyhledávání, doporučení, RAG, detekce anomálií | Přesné vyhledávání frází, strukturovaná data | Podnikové vyhledávání, AI monitoring, sledování značky |

| Příklad | Hledání „zdravé večeře nápady“ najde „nutričně vyvážené recepty“ | Najde pouze výsledky s přesnými slovy „zdravé“ a „večeře“ | Najde jak přesné shody, tak sémanticky příbuzný obsah |

Implementace vektorového vyhledávání zahrnuje několik propojených kroků, které transformují surová data na prohledatelné sémantické reprezentace. Prvním krokem je příjem a předzpracování dat, kde jsou surové dokumenty, obrázky nebo jiná data očištěna a normalizována. Následuje transformace na vektory, kdy embeddingový model převede každou položku na číselný vektor, obvykle v rozsahu 100 až 1 000+ rozměrů. Tyto vektory jsou pak uloženy ve vektorové databázi nebo indexové struktuře optimalizované pro vysoce dimenzionální data. Když přijde dotaz, projde stejným embedding procesem, aby vznikl dotazový vektor. Systém pak pomocí metrik vzdálenosti vypočítá skóre podobnosti mezi dotazovým vektorem a všemi uloženými vektory a seřadí výsledky podle jejich blízkosti k dotazu.

Aby byl tento proces efektivní i ve velkém měřítku, systémy využívají Approximate Nearest Neighbor (ANN) algoritmy jako HNSW (Hierarchical Navigable Small World), IVF (Inverted File Index) nebo ScaNN (Scalable Nearest Neighbors). Tyto algoritmy vyměňují dokonalou přesnost za rychlost, což umožňuje vyhledávání mezi miliony či miliardami vektorů během milisekund místo sekund. HNSW například organizuje vektory do vícestupňové grafové struktury, kde vyšší vrstvy obsahují dlouhé spoje pro rychlý přesun, zatímco nižší vrstvy obsahují krátké spoje pro přesnost. Tento hierarchický přístup snižuje složitost hledání z lineární O(n) na logaritmickou O(log n), což činí rozsáhlé vektorové vyhledávání praktickým. Výběr algoritmu závisí na faktorech, jako je velikost datové sady, objem dotazů, požadovaná latence a dostupné výpočetní zdroje.

Vektorové vyhledávání se stalo nezbytným pro AI monitorovací platformy jako je AmICited, které sledují zmínky o značce napříč AI systémy. Tradiční monitoring podle klíčových slov by přehlédl parafrázované zmínky, kontextové odkazy a sémantické variace názvů značek či doménových URL adres. Vektorové vyhledávání umožňuje těmto platformám detekovat, kdy je vaše značka zmíněna v AI generovaných odpovědích, i když se přesná formulace liší. Například pokud je vaše doména „amicited.com“, vektorové vyhledávání dokáže identifikovat zmínky typu „platforma pro monitoring AI promptů“ nebo „viditelnost značky v generativní AI“ jako kontextově související s vaším podnikáním, i když není URL zmíněna explicitně. Toto sémantické porozumění je klíčové pro komplexní sledování AI citací napříč ChatGPT, Perplexity, Google AI Overviews a Claude.

Trh s technologií vektorového vyhledávání zažívá explozivní růst, což odráží uznání jeho hodnoty podniky. Podle průzkumů byl trh s vektorovými databázemi v roce 2024 oceněn na 1,97 miliardy USD a očekává se, že do roku 2032 dosáhne 10,60 miliardy USD při složené roční míře růstu (CAGR) 23,38 %. Kromě toho Databricks zaznamenal 186% nárůst adopce vektorových databází jen za první rok po veřejném spuštění preview vektorového vyhledávání v prosinci 2023. Tento rychlý nárůst ukazuje, že podniky stále více vnímají vektorové vyhledávání jako klíčovou infrastrukturu pro AI aplikace. Pro organizace, které monitorují svou přítomnost v AI systémech, poskytuje vektorové vyhledávání sémantické porozumění nezbytné k zachycení všech smysluplných zmínek, nejen přesných shod klíčových slov.

Výkon vektorového vyhledávání ve velkém měřítku závisí zásadně na sofistikovaných indexovacích technikách, které vyvažují rychlost, přesnost a nároky na paměť. HNSW (Hierarchical Navigable Small World) se stal jedním z nejpopulárnějších přístupů, organizuje vektory do vícestupňového grafu, kde každá vrstva obsahuje postupně kratší spoje. Algoritmus začíná hledání v horní vrstvě s dlouhými spoji pro rychlý přesun a poté sestupuje skrze vrstvy s čím dál přesnějšími spoji. Výzkumy ukazují, že HNSW dosahuje špičkového výkonu s mírou nalezení (recall) přes 99 % a zároveň udržuje latence dotazu pod milisekundu. HNSW však vyžaduje značné množství paměti – benchmarky ukazují, že indexování 1 milionu vektorů může vyžadovat 0,5 GB až 5 GB v závislosti na parametrech, což činí optimalizaci paměti důležitou pro velké nasazení.

IVF (Inverted File Index) nabízí alternativní metodu tím, že shlukuje vektory a indexuje je podle centroidů klastrů. Tato technika zmenšuje vyhledávací prostor zaměřením na relevantní klastry namísto prohledávání všech vektorů. ScaNN (Scalable Nearest Neighbors), vyvinutý Google Research, je optimalizován speciálně pro hledání podle vnitřního součinu a nabízí vynikající výkon pro doporučovací systémy. Product Quantization (PQ) komprimuje vektory dělením na subvektory a kvantizací každého zvlášť, čímž snižuje nároky na paměť 10–100× za cenu mírné ztráty přesnosti. Organizace implementující vektorové vyhledávání musí pečlivě vybírat indexovací techniky podle svých konkrétních potřeb – zda upřednostňují přesnost, rychlost, efektivitu využití paměti nebo jejich kombinaci. Oblast se rychle vyvíjí a stále se objevují nové algoritmy a optimalizační techniky, které řeší výpočetní nároky vysoce dimenzionálních vektorových operací.

Definice a aplikace vektorového vyhledávání se dále vyvíjí, jak systémy umělé inteligence nabývají na sofistikovanosti a podniková adopce zrychluje. Budoucí směřování ukazuje na hybridní vyhledávací systémy, které kombinují vektorové vyhledávání s tradičním hledáním podle klíčových slov a pokročilým filtrováním. Tyto hybridní přístupy využívají sémantického porozumění vektorového vyhledávání, přičemž zachovávají přesnost a známé prostředí klíčového vyhledávání, což přináší lepší výsledky pro složité dotazy. Kromě toho multimodální vektorové vyhledávání nabývá na významu a umožňuje systémům vyhledávat napříč textem, obrázky, zvukem a videem současně pomocí sjednocených embeddingových prostorů. Tento vývoj umožní intuitivnější a komplexnější vyhledávací zážitky napříč různými typy dat.

Pro organizace sledující svou přítomnost v AI systémech má vývoj vektorového vyhledávání zásadní dopady. Jak platformy jako ChatGPT, Perplexity, Google AI Overviews a Claude stále více spoléhají na vektorové vyhledávání pro získávání a řazení obsahu, stává se pochopení toho, jak se vaše značka objevuje sémanticky, stejně důležité jako tradiční viditelnost podle klíčových slov. Posun směrem k sémantickému porozumění znamená, že monitoring značky a sledování AI citací musí jít dál než jen detekci klíčových slov a zachytit i kontextové zmínky a sémantické vztahy. Organizace, které investují do pochopení vektorového vyhledávání a jeho aplikací, budou lépe připraveny optimalizovat svou viditelnost v generativních AI systémech. Prolínání vektorových vyhledávacích technologií s AI monitorovacími platformami představuje zásadní změnu v tom, jak značky chápou a řídí svou přítomnost v AI řízené informační krajině.

Začněte sledovat, jak AI chatboti zmiňují vaši značku na ChatGPT, Perplexity a dalších platformách. Získejte užitečné informace pro zlepšení vaší AI prezence.

Zjistěte, jak vektorové vyhledávání využívá embeddingy strojového učení k nalezení podobných položek na základě významu, nikoliv přesných klíčových slov. Porozu...

Zjistěte, jak vektorové embeddingy umožňují AI systémům chápat sémantický význam a přiřazovat obsah k dotazům. Prozkoumejte technologii za sémantickým vyhledává...

Diskuze komunity o vektorovém vyhledávání a jeho roli v objevování obsahu pomocí AI. Skutečné zkušenosti technických marketérů s optimalizací obsahu pro sémanti...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.