Aké faktory dôveryhodnosti používajú AI enginy na hodnotenie zdrojov

Zistite, ako AI enginy ako ChatGPT, Perplexity a Google AI hodnotia dôveryhodnosť zdrojov. Spoznajte E-E-A-T, autoritu domény, frekvenciu citácií a ďalšie kľúčo...

AI hodnotenie dôveryhodnosti obsahu na základe kvalifikácie autora, citácií a overovania. Hodnotenie dôveryhodnosti zdroja systematicky analyzuje viacero rozmerov vrátane odbornosti autora, reputácie vydavateľa, vzorcov citácií a výsledkov fact-checkingu, aby určilo, či si informačné zdroje zaslúžia byť zahrnuté do výskumu, znalostných báz alebo AI-generovaných súhrnov. Tento automatizovaný proces umožňuje platformám škálovať hodnotenie dôveryhodnosti naprieč miliónmi zdrojov pri zachovaní konzistentnosti, ktorú samotní ľudskí recenzenti nedokážu dosiahnuť.

AI hodnotenie dôveryhodnosti obsahu na základe kvalifikácie autora, citácií a overovania. Hodnotenie dôveryhodnosti zdroja systematicky analyzuje viacero rozmerov vrátane odbornosti autora, reputácie vydavateľa, vzorcov citácií a výsledkov fact-checkingu, aby určilo, či si informačné zdroje zaslúžia byť zahrnuté do výskumu, znalostných báz alebo AI-generovaných súhrnov. Tento automatizovaný proces umožňuje platformám škálovať hodnotenie dôveryhodnosti naprieč miliónmi zdrojov pri zachovaní konzistentnosti, ktorú samotní ľudskí recenzenti nedokážu dosiahnuť.

Hodnotenie dôveryhodnosti zdroja je systematické hodnotenie informačných zdrojov s cieľom určiť ich dôveryhodnosť, spoľahlivosť a autoritu pri poskytovaní presných informácií. V kontexte AI systémov založených na umelej inteligencii hodnotenie dôveryhodnosti znamená analýzu viacerých rozmerov zdroja, aby sa zistilo, či si jeho obsah zaslúži byť zahrnutý do výskumu, citácií alebo znalostných báz. AI hodnotenie dôveryhodnosti funguje skúmaním kvalifikácie autora – vrátane vzdelania, pracovných skúseností a odbornej expertízy – spolu so vzorcami citácií, ktoré naznačujú, ako často a pozitívne iné autoritatívne zdroje na danú prácu odkazujú. Proces hodnotí overovacie mechanizmy ako status recenzovanosti, inštitucionálnu príslušnosť a reputáciu miesta publikovania na určenie základnej dôveryhodnosti. Signály dôveryhodnosti sú merateľné indikátory, ktoré AI systémy detegujú a zohľadňujú, od explicitných znakov ako kvalifikácia autora až po implicitné signály odvodené z textovej analýzy a vzorcov metadát. Moderné AI systémy rozumejú, že dôveryhodnosť je viacrozmerná; zdroj môže byť vysoko dôveryhodný v jednej oblasti, ale postrádať autoritu v inej, preto je potrebné hodnotenie s ohľadom na kontext. Proces hodnotenia je čoraz dôležitejší, keďže objem informácií exploduje a dezinformácie sa rýchlo šíria naprieč digitálnymi platformami. Automatizované hodnotenie dôveryhodnosti umožňuje platformám škálovať hodnotenie naprieč miliónmi zdrojov pri zachovaní konzistencie, ktorú samotní ľudskí recenzenti nedokážu dosiahnuť. Pochopenie toho, ako tieto systémy fungujú, pomáha tvorcom obsahu, výskumníkom a vydavateľom optimalizovať svoje zdroje pre rozpoznanie dôveryhodnosti a zároveň pomáha spotrebiteľom robiť informované rozhodnutia o dôveryhodnosti informácií.

AI systémy hodnotia dôveryhodnosť zdroja pomocou sofistikovanej analýzy viacerých signálov, ktorá kombinuje spracovanie prirodzeného jazyka, modely strojového učenia a hodnotenie štruktúrovaných dát. Detekcia signálov dôveryhodnosti identifikuje špecifické znaky v texte, metadátach a sieťových vzorcoch, ktoré korelujú so spoľahlivými informáciami; tieto signály sú vážené podľa ich prediktívnej hodnoty pre presnosť. NLP analýza skúma jazykové vzorce, hustotu citácií, špecifickosť tvrdení a jazykovú istotu s cieľom posúdiť, či obsah spĺňa znaky dôsledného výskumu alebo vykazuje znaky bežné pre nespoľahlivé zdroje. Modely strojového učenia trénované na veľkých dátových súboroch overených dôveryhodných a nedôveryhodných zdrojov sa učia rozpoznávať komplexné vzorce, ktoré by mohli ľuďom uniknúť, čo umožňuje hodnotenie v reálnom čase vo veľkom rozsahu. Integrácia fact-checkingu porovnáva tvrdenia s overenými databázami a známymi faktami, označuje rozpory alebo nepodložené tvrdenia, ktoré znižujú skóre dôveryhodnosti. Tieto systémy využívajú ansámblové metódy, ktoré kombinujú viacero prístupov hodnotenia, keďže žiadny jeden signál nedokáže dokonale predikovať dôveryhodnosť. Nasledujúca tabuľka ilustruje hlavné kategórie signálov, ktoré AI systémy analyzujú:

| Typ signálu | Čo meria | Príklady |

|---|---|---|

| Akademické signály | Stav recenzovania, miesto publikovania, inštitucionálna príslušnosť | Impakt faktor časopisu, ranking konferencie, reputácia univerzity |

| Textové signály | Kvalita písania, hustota citácií, špecifickosť tvrdení, jazykové vzorce | Správne citácie, odborná terminológia, tvrdenia podložené dôkazmi |

| Metadátové signály | Kvalifikácia autora, dátum publikácie, frekvencia aktualizácií, história zdroja | Tituly autora, časová os publikácií, história revízií |

| Sociálne signály | Počet citácií, vzorce zdieľania, odporúčania expertov, zapojenie komunity | Citácie v Google Scholar, zmienky v akademických sieťach, odporúčania kolegov |

| Overovacie signály | Výsledky fact-checkingu, potvrdenie tvrdení, transparentnosť zdroja | Overenie cez Snopes, viacnásobné nezávislé potvrdenia, zverejnenie metodológie |

| Štrukturálne signály | Organizácia obsahu, prehľadnosť metodológie, zverejnenie konfliktu záujmov | Jasné sekcie, transparentné metódy, zverejnenie zdroja financovania |

Najvplyvnejšie faktory dôveryhodnosti, ktoré AI systémy hodnotia, zahŕňajú viacero prepojených rozmerov, ktoré spoločne vytvárajú spoľahlivosť zdroja. Reputácia autora slúži ako základný ukazovateľ dôveryhodnosti – etablovaní odborníci vo svojom odbore majú omnoho väčšiu váhu než neznámi prispievatelia. Reputácia vydavateľa rozširuje hodnotenie dôveryhodnosti do inštitucionálneho kontextu, pričom zdroje publikované v recenzovaných časopisoch alebo uznávaných akademických vydavateľstvách majú vyššiu základnú dôveryhodnosť. Vzorce citácií odhaľujú, ako širšia akademická komunita pracovala so zdrojom; často citované práce v renomovaných publikáciách signalizujú komunitné uznanie kvality výskumu. Aktuálnosť má kontextový význam – nedávne publikácie ukazujú aktuálne poznatky, zatiaľ čo staršie fundamentálne práce si zachovávajú dôveryhodnosť na základe historického významu a trvalej relevantnosti. Algoritmy na detekciu zaujatosti skúmajú, či zdroje zverejňujú potenciálne konflikty záujmov, zdroje financovania alebo ideologické postoje, ktoré môžu ovplyvniť ich závery. Signály zapojenia z akademickej a odbornej komunity, vrátane citácií a diskusií medzi kolegami, poskytujú externé potvrdenie dôveryhodnosti. Nasledujúce faktory predstavujú najdôležitejšie prvky, ktoré AI systémy uprednostňujú:

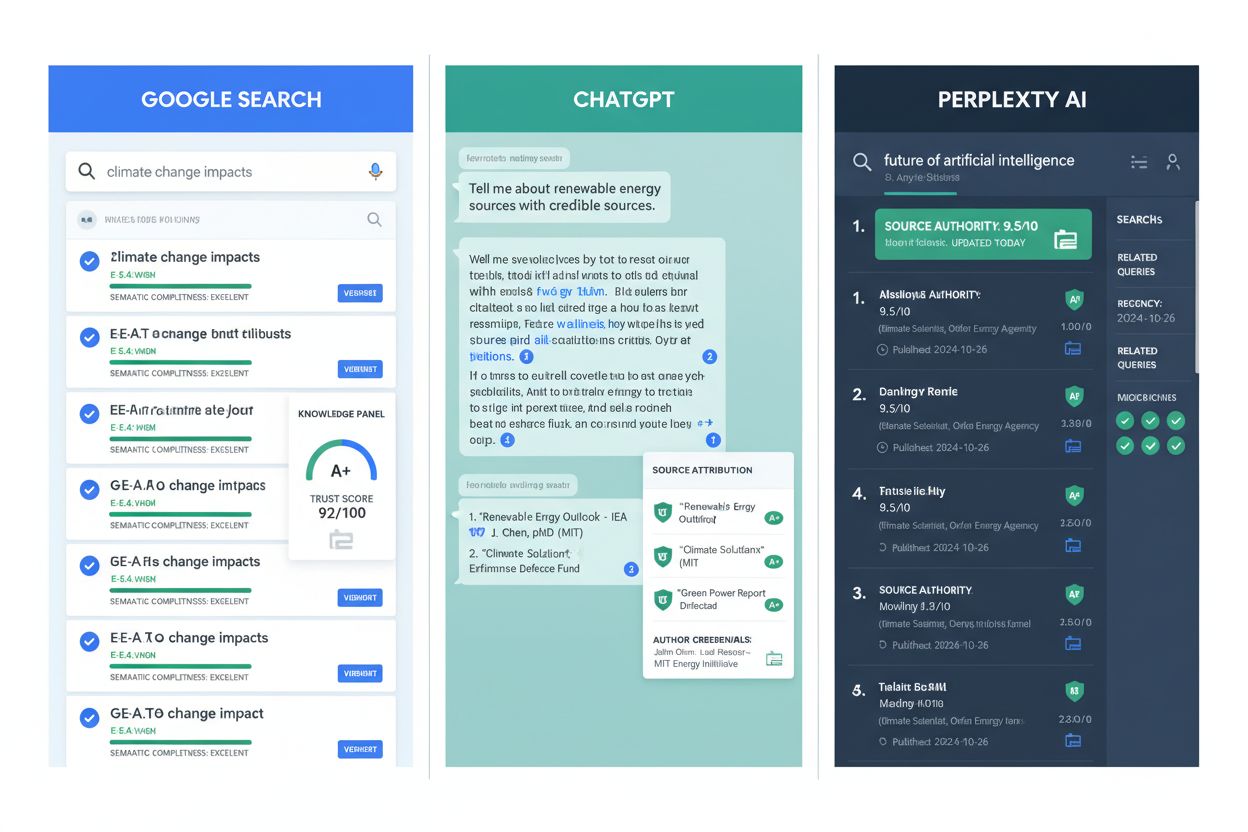

AI hodnotenie dôveryhodnosti sa stalo neoddeliteľnou súčasťou hlavných informačných platforiem a výskumnej infraštruktúry. Google AI Overviews využíva signály dôveryhodnosti na určenie, ktoré zdroje sa objavia v AI-generovaných súhrnoch, pričom uprednostňuje obsah od etablovaných vydavateľov a overených odborníkov. ChatGPT a podobné jazykové modely používajú hodnotenie dôveryhodnosti počas tréningu na správne váženie zdrojov, hoci v reálnom čase čelia výzvam pri hodnotení nových tvrdení. Perplexity AI explicitne začleňuje dôveryhodnosť zdroja do svojej citačnej metodológie a zobrazuje reputáciu zdroja pri výsledkoch vyhľadávania, aby používateľ mohol zhodnotiť kvalitu informácií. V akademickom výskume nástroje na hodnotenie dôveryhodnosti pomáhajú efektívne identifikovať kvalitné zdroje, čím skracujú čas strávený rešeršou a zvyšujú kvalitu podkladu výskumu. Iniciatívy na uchovávanie obsahu využívajú hodnotenie dôveryhodnosti na prioritizáciu archivácie autoritatívnych zdrojov, čím zabezpečujú, že budúci výskumníci budú mať prístup k spoľahlivým historickým informáciám. AmICited.com slúži ako monitorovacie riešenie, ktoré sleduje, ako sú zdroje citované a hodnotené naprieč platformami, pomáha vydavateľom pochopiť svoju dôveryhodnosť a identifikovať príležitosti na zlepšenie. Fact-checkingové organizácie používajú automatizované hodnotenie dôveryhodnosti na prioritizáciu tvrdení pre manuálne overovanie, takže ľudská práca sa sústredí na najdôležitejšie dezinformácie. Vzdelávacie inštitúcie čoraz viac používajú nástroje na hodnotenie dôveryhodnosti na výučbu žiakov o hodnotení zdrojov, čím implicitné kritériá robia explicitnými a merateľnými. Tieto aplikácie ukazujú, že hodnotenie dôveryhodnosti prešlo z teoretického rámca do praktickej infraštruktúry podporujúcej kvalitu informácií v digitálnych ekosystémoch.

Napriek významným pokrokom automatizované hodnotenie dôveryhodnosti čelí podstatným obmedzeniam, ktoré si vyžadujú ľudský dohľad a posúdenie v kontexte. Zaujatost signálov zapojenia predstavuje základnú výzvu; populárne zdroje môžu na základe sociálnych signálov získať vysoké skóre dôveryhodnosti, aj keď obsahujú nepresné informácie, keďže metriky zapojenia len nedokonale korelujú s presnosťou. Falošné pozitíva a falošné negatíva vznikajú, keď algoritmy dôveryhodnosti nesprávne klasifikujú zdroje – etablovaní experti v nových oblastiach môžu mať nedostatočnú históriu citácií, zatiaľ čo tvorcovia dezinformácií vytvárajú sofistikované signály dôveryhodnosti. Vyvíjajúce sa dezinformačné taktiky zámerne zneužívajú systémy hodnotenia dôveryhodnosti napodobňovaním legitímnych zdrojov, falošnými profilmi autorov či umelými citáciami, ktoré oklamú automatizované systémy. Odvetvovo-špecifické rozdiely v dôveryhodnosti znamenajú, že zdroj dôveryhodný v jednom odbore nemusí mať autoritu v inom, no systémy občas prideľujú jednotné skóre naprieč odbormi. Časová dynamika hodnotenie komplikuje; zdroje dôveryhodné v čase publikácie môžu časom zastarať alebo byť vyvrátené novými dôkazmi, preto je potrebné ich priebežne prehodnocovať, nie iba staticky hodnotiť. Kultúrna a jazyková zaujatost v trénovacích dátach môže spôsobiť, že systémy nedocenia zdroje z neanglicky hovoriacich regiónov alebo nedostatočne zastúpených komunít, čím ďalej reprodukujú existujúce hierarchie informácií. Problémy s transparentnosťou vznikajú, pretože mnohé algoritmy hodnotenia dôveryhodnosti fungujú ako black boxy, čo sťažuje zdrojom pochopiť, ako zlepšiť svoje signály alebo užívateľom pochopiť, prečo niektoré zdroje dostali dané skóre. Tieto obmedzenia zdôrazňujú, že automatizované hodnotenie dôveryhodnosti by malo dopĺňať, nie nahrádzať ľudské kritické hodnotenie.

Tvorcovia obsahu a vydavatelia môžu výrazne zlepšiť svoje signály dôveryhodnosti implementáciou praxí založených na dôkazoch, ktoré sú v súlade s tým, ako AI systémy hodnotia dôveryhodnosť. Implementujte zásady E-E-A-T – demonštrujte Skúsenosti, Odbornosť, Autoritatívnosť a Dôveryhodnosť zobrazením kvalifikácie autora, profesionálnych príslušností a relevantných kvalifikácií na stránkach s obsahom. Správne citačné praktiky zvyšujú dôveryhodnosť odkazovaním na kvalitné zdroje, používaním konzistentných citačných formátov a zabezpečením, že všetky tvrdenia sú podložené overiteľnými dôkazmi; to signalizuje, že obsah stojí na overených poznatkoch, nie na špekuláciách. Transparentnosť v metodológii pomáha AI systémom rozpoznať poctivé výskumné praktiky; jasne vysvetlite zdroje dát, výskumné metódy, obmedzenia a potenciálne konflikty záujmov. Udržiavajte profily autorov s detailnými biografiami, históriou publikácií a profesionálnou kvalifikáciou, ktorú AI systémy môžu overiť a zhodnotiť. Pravidelne aktualizujte obsah, čím deklarujete záväzok k presnosti; zastarané informácie znižujú skóre dôveryhodnosti, zatiaľ čo pravidelné revízie signalizujú, že sledujete vývoj vo svojom odbore. Zverejnite zdroje financovania a príslušnosti explicitne, pretože transparentnosť o možných zaujatostiach v skutočnosti zvyšuje dôveryhodnosť – AI systémy chápu, že priznané konflikty sú menej problematické ako skryté. Budujte citačnú autoritu publikovaním v renomovaných médiách, usilovaním sa o recenzovanie a získavaním citácií od iných dôveryhodných zdrojov; tak vzniká pozitívna spätná väzba, kde dôveryhodnosť rodí ďalšiu dôveryhodnosť. Zapájajte sa do odbornej komunity účasťou na konferenciách, spoluprácou a diskusiami s kolegami, pretože tieto signály validujú odbornosť a zvyšujú viditeľnosť pre hodnotiace systémy. Implementujte štruktúrované dáta pomocou schema.org a podobných štandardov, aby AI systémy mohli automaticky extrahovať a overovať informácie o autoroch, dátumoch publikácií a ďalších signáloch dôveryhodnosti.

Evolúcia hodnotenia dôveryhodnosti zdroja bude čoraz viac zahŕňať multimodálne hodnotenie, ktoré analyzuje text, obrázky, video a audio spoločne, aby odhalilo sofistikované dezinformácie zneužívajúce hodnotenie len jedného média. Systémy na overovanie v reálnom čase sa prepoja s platformami na tvorbu obsahu a poskytnú okamžitú spätnú väzbu o dôveryhodnosti už počas publikovania, čo umožní opravy skôr, než sa nepravdivé informácie rozšíria. Sledovanie dôveryhodnosti na blockchaine môže umožniť nemenné záznamy o histórii zdroja, citáciách a opravách, čím sa vytvorí transparentný pôvod dôveryhodnosti, ktorý AI systémy dokážu hodnotiť s väčšou istotou. Personalizované hodnotenie dôveryhodnosti pôjde za hranice univerzálneho skórovania a bude hodnotiť zdroje vo vzťahu k odbornosti a potrebám konkrétneho používateľa, keďže dôveryhodnosť je čiastočne subjektívna a závislá od kontextu. Integrácia s vedomostnými grafmi umožní AI hodnotiť zdroje nielen izolovane, ale v rámci siete súvisiacich informácií, identifikovať zdroje, ktoré odporujú zaužívaným poznatkom alebo zapĺňajú dôležité medzery. Vysvetliteľné AI systémy na hodnotenie dôveryhodnosti sa stanú štandardom a poskytnú transparentné vysvetlenia, prečo zdroje dostali určité skóre, čo umožní tvorcom zlepšovať sa a užívateľom pochopiť dôvody hodnotenia. Systémy nepretržitého učenia sa budú v reálnom čase prispôsobovať novým dezinformačným taktikám, aktualizovať modely hodnotenia podľa nových manipulačných techník a nebudú sa spoliehať len na statické tréningové dáta. Sledovanie dôveryhodnosti naprieč platformami vytvorí jednotné profily dôveryhodnosti, ktoré budú sprevádzať zdroje naprieč internetom, čím znemožní zlomyseľníkom udržiavať odlišné reputácie na rôznych platformách. Tieto trendy urobia z hodnotenia dôveryhodnosti čoraz sofistikovanejší, transparentnejší a integrálny prvok informačnej infraštruktúry, na ktorú sa denne spoliehajú miliardy ľudí.

Hodnotenie dôveryhodnosti zdroja je systematické hodnotenie informačných zdrojov s cieľom určiť ich spoľahlivosť a dôveryhodnosť. AI systémy analyzujú viacero rozmerov vrátane kvalifikácie autora, reputácie vydavateľa, vzorcov citácií a výsledkov fact-checkingu, aby zistili, či si zdroje zaslúžia byť zahrnuté do výskumu, znalostných báz alebo AI-generovaných súhrnov. Tento automatizovaný proces umožňuje platformám hodnotiť milióny zdrojov konzistentne.

AI systémy detegujú signály dôveryhodnosti prostredníctvom spracovania prirodzeného jazyka, modelov strojového učenia a analýzy štruktúrovaných dát. Skúmajú akademické signály (stav recenzovanosti, inštitucionálna príslušnosť), textové signály (hustota citácií, špecifickosť tvrdení), metadátové signály (kvalifikácia autora, dátumy publikácie), sociálne signály (počet citácií, odporúčania odborníkov) a overovacie signály (výsledky fact-checkingu, potvrdenie tvrdení). Tieto signály sú vážené na základe ich prediktívnej hodnoty pre presnosť.

Najzásadnejšie faktory dôveryhodnosti zahŕňajú reputáciu a odbornosť autora, reputáciu vydavateľa, počet a kvalitu citácií, aktuálnosť a včasnosť, zverejnenie zaujatosti a konfliktov záujmov, signály zapojenia od odbornej komunity, overenie zdroja prostredníctvom fact-checkingu, integráciu poznatkov z pozadia, prepojenie tvorcu s renomovanými inštitúciami a frekvenciu aktualizácií. Tieto faktory spoločne vytvárajú spoľahlivosť a dôveryhodnosť zdroja.

Vydavatelia môžu zlepšiť dôveryhodnosť implementáciou zásad E-E-A-T (Skúsenosti, Odbornosť, Autoritatívnosť, Dôveryhodnosť), používaním správnych citačných praktík, udržiavaním transparentnej metodológie, zobrazovaním detailných profilov autorov s kvalifikáciou, pravidelnou aktualizáciou obsahu, zverejňovaním zdrojov financovania a príslušností, budovaním autority cez recenzné konanie, zapájaním sa do odbornej komunity a implementovaním štruktúrovaných dát pre AI systémy.

Automatizované hodnotenie dôveryhodnosti čelí výzvam ako je zaujatost signálov zapojenia (populárne zdroje môžu dostať vysoké skóre aj napriek nepresnostiam), falošné pozitíva a negatíva, vyvíjajúce sa dezinformačné taktiky napodobňujúce legitímne zdroje, odvetvovo špecifické rozdiely v dôveryhodnosti, časová dynamika ako zdroje zastarávajú, kultúrna a jazyková zaujatost v trénovacích dátach a problémy transparentnosti s black-box algoritmami. Tieto obmedzenia znamenajú, že automatizované hodnotenie by malo dopĺňať, nie nahrádzať ľudské kritické zhodnotenie.

Google AI Overviews uprednostňuje zdroje od etablovaných vydavateľov a overených expertov pre AI-generované súhrny. ChatGPT váži zdroje počas trénovania na základe signálov dôveryhodnosti. Perplexity explicitne zobrazuje reputáciu zdroja pri výsledkoch vyhľadávania. AmICited.com monitoruje, ako sú zdroje citované naprieč hlavnými AI platformami, čo pomáha vydavateľom pochopiť svoju dôveryhodnosť a identifikovať možnosti zlepšenia.

Budúci vývoj zahŕňa multimodálnu evaluáciu analyzujúcu text, obrázky, video a audio spoločne; systémy na overovanie v reálnom čase poskytujúce okamžitú spätnú väzbu o dôveryhodnosti; sledovanie dôveryhodnosti na blockchaine; personalizované hodnotenie dôveryhodnosti podľa odbornosti používateľa; integráciu s vedomostnými grafmi; vysvetliteľné AI systémy poskytujúce transparentné zdôvodnenie skóre; systémy nepretržitého učenia prispôsobujúce sa novým dezinformačným taktikám a sledovanie dôveryhodnosti naprieč platformami s tvorbou jednotných profilov.

Hodnotenie dôveryhodnosti zdroja je kľúčové, pretože určuje, ktoré zdroje sa objavia v AI-generovaných súhrnoch, ovplyvňujú trénovacie dáta AI a formujú informácie, s ktorými sa stretávajú miliardy ľudí. Presné hodnotenie dôveryhodnosti pomáha zabrániť šíreniu dezinformácií, zabezpečuje, že AI poskytuje spoľahlivé informácie, podporuje kvalitu akademického výskumu a udržiava dôveru v AI-informačné systémy. Keďže AI má čoraz väčší vplyv na objavovanie informácií, hodnotenie dôveryhodnosti je stále dôležitejšie.

Sledujte, ako sú vaše zdroje citované a hodnotené v Google AI Overviews, ChatGPT, Perplexity a Gemini. AmICited.com vám pomôže pochopiť vašu pozíciu dôveryhodnosti a identifikovať príležitosti na zlepšenie.

Zistite, ako AI enginy ako ChatGPT, Perplexity a Google AI hodnotia dôveryhodnosť zdrojov. Spoznajte E-E-A-T, autoritu domény, frekvenciu citácií a ďalšie kľúčo...

Zistite, ktoré zdroje AI motory citujú najčastejšie. Naučte sa, ako ChatGPT, Google AI Overviews a Perplexity hodnotia dôveryhodnosť zdrojov a pochopte vzory ci...

Diskusia komunity o tom, ako AI enginy hodnotia dôveryhodnosť zdrojov. Pochopenie faktorov dôvery, ktoré určujú AI citácie.

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.