Mall för AI-synlighetsfärdplan: Kvartalsmål och milstolpar

Lär dig hur du skapar en AI-synlighetsfärdplan med kvartalsmål och GEO-milstolpar. Få en mall, bästa praxis och verktyg för att övervaka ditt varumärke över AI-...

Företagsstrategi för AI-synlighet avser det övergripande tillvägagångssättet som organisationer implementerar för att övervaka, spåra och förstå alla artificiella intelligenssystem, modeller och applikationer som verkar inom deras infrastruktur. Denna strategi omfattar förmågan att se vilka AI-system som används, hur de presterar, vem som använder dem och vilka risker de utgör inom hela organisationen. För stora företag som hanterar hundratals eller tusentals AI-implementeringar blir synlighet kritiskt viktigt eftersom shadow AI—obehöriga eller odokumenterade AI-verktyg—kan spridas snabbt utan ordentlig tillsyn. Utan omfattande synlighet kan organisationer inte säkerställa efterlevnad, hantera risker, optimera prestanda eller få ut maximalt värde av sina AI-investeringar.

Företagsstrategi för AI-synlighet avser det övergripande tillvägagångssättet som organisationer implementerar för att övervaka, spåra och förstå alla artificiella intelligenssystem, modeller och applikationer som verkar inom deras infrastruktur. Denna strategi omfattar förmågan att se vilka AI-system som används, hur de presterar, vem som använder dem och vilka risker de utgör inom hela organisationen. För stora företag som hanterar hundratals eller tusentals AI-implementeringar blir synlighet kritiskt viktigt eftersom shadow AI—obehöriga eller odokumenterade AI-verktyg—kan spridas snabbt utan ordentlig tillsyn. Utan omfattande synlighet kan organisationer inte säkerställa efterlevnad, hantera risker, optimera prestanda eller få ut maximalt värde av sina AI-investeringar.

Företagsstrategi för AI-synlighet avser det övergripande tillvägagångssätt som organisationer implementerar för att övervaka, spåra och förstå alla artificiella intelligenssystem, modeller och applikationer som verkar inom deras infrastruktur. Denna strategi omfattar förmågan att se vilka AI-system som används, hur de presterar, vem som använder dem och vilka risker de utgör inom hela organisationen. För stora företag som hanterar hundratals eller tusentals AI-implementeringar blir synlighet kritiskt viktigt eftersom shadow AI—obehöriga eller odokumenterade AI-verktyg—kan spridas snabbt utan ordentlig tillsyn. Utmaningen ökar i skala där 85 % av företagen nu använder AI på något sätt, men bara 11 % rapporterar tydligt affärsvärde, vilket indikerar en betydande klyfta mellan implementering och effektiv hantering. Utan omfattande synlighet kan organisationer inte säkerställa efterlevnad, hantera risker, optimera prestanda eller få ut maximalt värde av sina AI-investeringar.

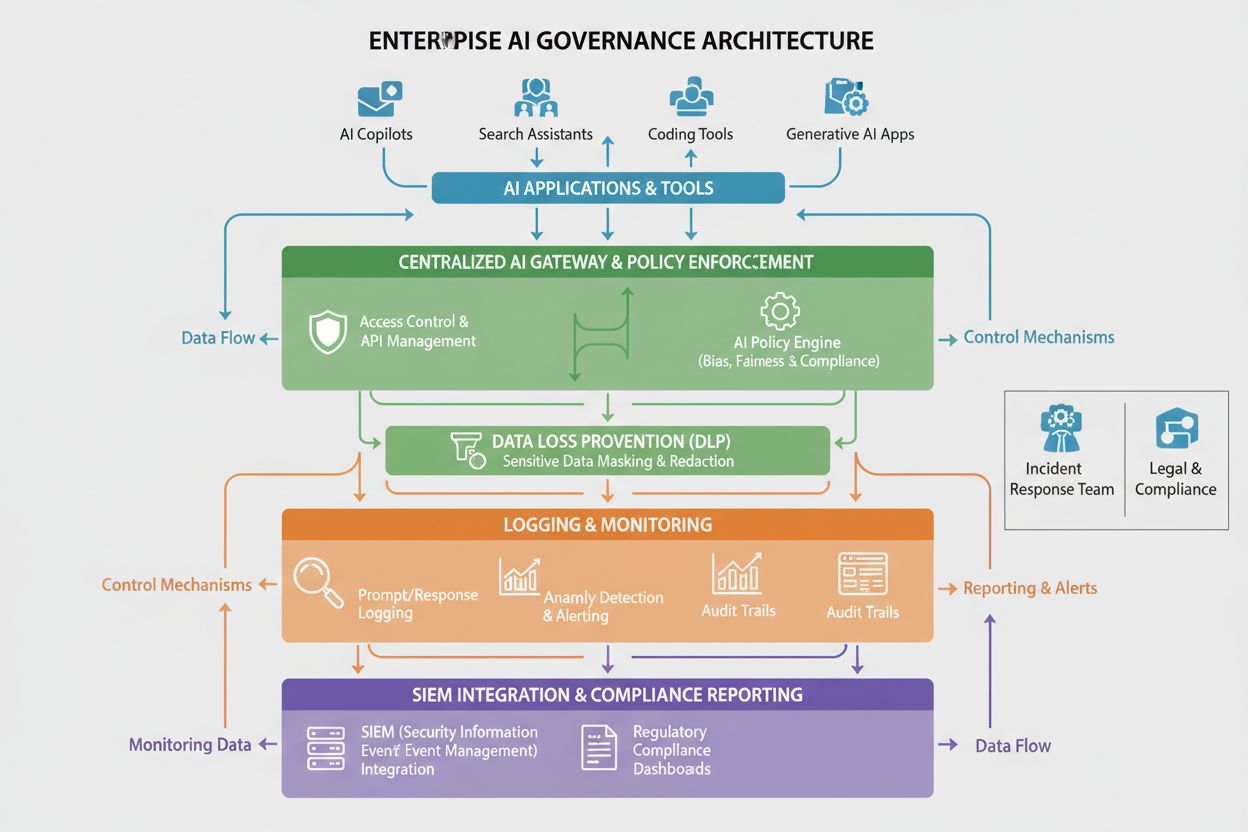

Företags AI-synlighet fungerar över tre sammanlänkade dimensioner som tillsammans ger full organisatorisk medvetenhet om AI-system och deras påverkan. Den första dimensionen, användningsövervakning, spårar vilka AI-system som är implementerade, vem som har tillgång till dem, hur ofta de används och för vilka affärsändamål. Den andra dimensionen, kvalitetsövervakning, säkerställer att AI-modeller presterar som avsett, upprätthåller noggrannhetsstandarder och inte försämras över tid på grund av datadrift eller modellnedbrytning. Den tredje dimensionen, säkerhetsövervakning, skyddar mot obehörig åtkomst, dataintrång, prompt injection-attacker och säkerställer efterlevnad av regulatoriska krav. Dessa tre dimensioner måste fungera tillsammans, stödda av centraliserad loggning, realtidsinstrumentpaneler och automatiserade varningssystem. Organisationer som implementerar omfattande synlighet över alla tre dimensioner rapporterar betydligt bättre styrningsresultat och snabbare incidenthantering.

| Dimension | Syfte | Nyckeltal |

|---|---|---|

| Användningsövervakning | Spåra implementering och användningsmönster för AI-system | Aktiva användare, API-anrop, modellversioner, affärsenhetsadoption |

| Kvalitetsövervakning | Säkerställ modellprestanda och tillförlitlighet | Noggrannhet, precision, recall, prediktionsdrift, latens |

| Säkerhetsövervakning | Skydda mot hot och säkerställ efterlevnad | Åtkomstloggar, upptäckta avvikelser, policyöverträdelser, granskningsspår |

Organisationer står inför betydande hinder när de försöker implementera omfattande AI-synlighet i stora, komplexa miljöer. Shadow AI utgör kanske den största utmaningen—anställda och avdelningar inför AI-verktyg utan IT:s vetskap eller godkännande, vilket skapar blinda fläckar som förhindrar centraliserad övervakning och styrning. Datasilor fragmenterar information mellan avdelningar, vilket gör det omöjligt att korrelera AI-användningsmönster eller upptäcka dubbletter och resursslöseri. Integrationskomplexitet uppstår när organisationer måste koppla samman synlighetsverktyg med äldre system, molnplattformar och olika AI-ramverk som inte var utformade för övervakning. Regulatorisk fragmentering innebär olika synlighetskrav för olika jurisdiktioner, vilket skapar efterlevnadsutmaningar som kräver flexibel och anpassningsbar övervakningsinfrastruktur. Dessutom rapporterar 84 % av IT-ledarna att de saknar en formell styrningsprocess, och 72 % av organisationerna rapporterar datakvalitetsproblem som underminerar tillförlitligheten i synlighetsmätningar.

Viktiga synlighetsutmaningar inkluderar:

Effektiv företags AI-synlighet kräver anpassning till etablerade styrningsramverk och standarder som ger struktur och trovärdighet åt övervakningsinsatserna. NIST:s AI Risk Management Framework (RMF) erbjuder ett heltäckande tillvägagångssätt för att identifiera, mäta och hantera AI-risker och utgör en grund för synlighetskrav inom alla organisatoriska funktioner. ISO/IEC 42001 fastställer internationella standarder för AI-ledningssystem, inklusive krav på övervakning, dokumentation och kontinuerlig förbättring i linje med synlighetsmål. EU:s AI Act ställer strikta krav på transparens och dokumentation för högrisk-AI-system och kräver detaljerade register över AI-systemens beteende och beslutsprocesser. Branschspecifika ramverk tillför ytterligare krav—finansiella tjänsteorganisationer måste uppfylla bankregulatorernas förväntningar på AI-styrning, hälsoorganisationer måste följa FDA:s krav för kliniska AI-system och myndigheter måste följa federala direktiv för AI-styrning. Organisationer bör välja ramverk som passar deras bransch, geografi och riskprofil och sedan bygga synlighetsinfrastruktur som visar efterlevnad av valda standarder.

Att implementera företags AI-synlighet kräver en robust teknisk grund som samlar in, bearbetar och presenterar data om AI-systemens beteende och prestanda. Centraliserade AI-plattformar fungerar som ryggraden i synlighetsinfrastrukturen och erbjuder ett samlat gränssnitt där organisationer kan övervaka alla AI-system oavsett var de är implementerade. AI-gateways fungerar som mellanhänder mellan applikationer och AI-tjänster, fångar metadata om varje förfrågan och svar, vilket möjliggör detaljerad användningsspårning och säkerhetsövervakning. Omfattande loggningssystem registrerar all aktivitet i AI-system, modellförutsägelser, användarinteraktioner och systemprestandamått i centraliserade arkiv som stöder granskningsspår och forensisk analys. Data Loss Prevention (DLP)-verktyg övervakar AI-system för försök att föra ut känslig data, förhindrar att modeller tränas på konfidentiell information eller returnerar skyddad data i svar. SIEM-integration kopplar AI-synlighetsdata till bredare säkerhetsinformation och händelsehanteringssystem, vilket möjliggör korrelation av AI-relaterade säkerhetshändelser med andra organisatoriska hot. Organisationer som implementerar dessa tekniska komponenter rapporterar 30 % minskning i incidenthanteringstid vid AI-relaterade säkerhetsproblem. Plattformar som Liminal, Ardoq och Knostic erbjuder styrningsfokuserade synlighetslösningar, medan AmICited.com är specialiserat på att övervaka AI-svarskvalitet över GPT:er, Perplexity och Google AI Overviews.

Framgångsrik företags AI-synlighet kräver tydliga organisationsstrukturer och definierade roller som fördelar ansvaret för övervakning och styrning över hela organisationen. En AI-styrkommitté fungerar vanligtvis som den exekutiva gruppen som övervakar AI-synlighetsstrategin, fastställer policyer och säkerställer anpassning till affärsmål och regulatoriska krav. Modellägare tar ansvar för specifika AI-system och ser till att de är korrekt dokumenterade, övervakade och underhållna enligt organisationens standarder. AI-ambassadörer inom affärsenheter fungerar som länkar mellan IT-styrningsteam och slutanvändare, främjar synlighetspraxis och identifierar shadow AI innan den blir ohanterlig. Datastewards hanterar kvalitet och tillgänglighet på data som används för att träna och övervaka AI-system, och ser till att synlighetsmått är tillförlitliga. Säkerhets- och efterlevnadsteam fastställer övervakningskrav, genomför revisioner och säkerställer att synlighetsinfrastrukturen uppfyller regulatoriska skyldigheter. Tydliga ansvarsfördelningar säkerställer att synlighet inte behandlas som ett IT-exklusivt ansvar utan som ett gemensamt organisatoriskt åtagande som kräver deltagande från affärs-, teknik- och styrningsfunktioner.

Organisationer måste fastställa tydliga nyckeltal (KPI:er) och mätstrukturer för att bedöma om deras AI-synlighetsstrategi ger värde och stödjer organisatoriska mål. Synlighetstäckning mäter andelen AI-system som är dokumenterade och övervakade, där mogna organisationer siktar på över 95 % täckning av alla AI-implementeringar. Styrningsmognad spårar framsteg genom definierade nivåer—från ad hoc-övervakning till standardiserade processer till optimerad, automatiserad styrning—med hjälp av ramverk som CMMI-modellen anpassad för AI-styrning. Upptäckt och åtgärdstid för incidenter mäter hur snabbt organisationer identifierar och hanterar AI-relaterade problem, där förbättrad upptäckts- och svarstid indikerar effektivare synlighet. Efterlevnad spårar andelen AI-system som uppfyller regulatoriska krav och interna standarder, där revisionsfynd och åtgärdstider fungerar som viktiga mått. Affärsvärde mäter om synlighetsinvesteringar leder till konkreta fördelar som minskad risk, förbättrad modellprestanda, snabbare time-to-market för AI-initiativ eller bättre resursallokering. Organisationer bör implementera realtidsinstrumentpaneler som visar dessa mått för intressenter, vilket möjliggör kontinuerlig övervakning och snabb korrigering när synlighetsbrister uppstår.

Olika branscher står inför unika krav på AI-synlighet, drivna av regulatoriska miljöer, riskprofiler och affärsmodeller som kräver anpassade övervakningsmetoder. Finansiella tjänster måste följa bankregulatorernas krav på AI-styrning, inklusive detaljerad övervakning av AI-system som används för kreditbeslut, bedrägeriupptäckt och handelsalgoritmer, med särskilt fokus på biasdetektion och rättvisemått. Hälso- och sjukvårdsorganisationer måste uppfylla FDA:s krav för kliniska AI-system, inklusive validering av modellprestanda, övervakning av säkerhetsfrågor och dokumentation av hur AI-system påverkar kliniska beslut. Juridiska organisationer som använder AI för kontraktsanalys, juridisk forskning och due diligence måste säkerställa synlighet i modellens träningsdata för att förhindra sekretessbrott och upprätthålla klientskydd. Myndigheter måste följa federala direktiv för AI-styrning, inklusive transparenskrav, biasgranskning och dokumentation av AI-systemens beslutsfattande för offentlig ansvarsskyldighet. Detaljhandel och e-handel måste övervaka AI-system som används i rekommendationsmotorer och personalisering för att säkerställa efterlevnad av konsumentskydd och konkurrenslagstiftning. Tillverkningsföretag måste spåra AI-system som används i kvalitetskontroll och prediktivt underhåll för att säkerställa säkerhet och tillförlitlighet. Branschspecifika synlighetskrav bör integreras i styrningsramverk snarare än behandlas som separata efterlevnadsuppgifter.

Organisationer som implementerar företags AI-synlighet bör använda ett stegvis tillvägagångssätt som ger snabba vinster samtidigt som man bygger mot omfattande, mogen styrningskapacitet. Börja med inventering och dokumentation—genomför en granskning för att identifiera alla AI-system som används, inklusive shadow AI, och skapa ett centraliserat register som dokumenterar varje systems syfte, ägare, datakällor och affärskritikalitet. Identifiera snabba vinster genom att fokusera de inledande övervakningsinsatserna på högrisk-system såsom kundnära AI, system som hanterar känslig data eller modeller som fattar avgörande beslut om individer. Inför centraliserad loggning som en grundläggande funktion som fångar metadata om all AI-systemaktivitet, vilket möjliggör både realtidsövervakning och historisk analys. Etablera styrningspolicyer som definierar standarder för AI-systemdokumentation, övervakning och efterlevnad, och kommunicera tydligt dessa policyer till alla intressenter. Bygg tvärfunktionella team som inkluderar IT, säkerhet, affärsverksamhet och efterlevnad för att säkerställa att synlighetsinitiativ adresserar alla organisatoriska perspektiv. Mät och kommunicera framsteg genom att spåra synlighetsmått och dela resultaten med ledningen, visa värdet av styrningsinvesteringar och bygga organisatoriskt stöd för fortsatt satsning på AI-synlighetsinfrastruktur.

AI-synlighet är förmågan att se och övervaka vad AI-system gör, medan AI-styrning är det bredare ramverket av policyer, processer och kontroller som hanterar hur AI-system utvecklas, distribueras och används. Synlighet är en grundläggande komponent i styrning—du kan inte styra det du inte kan se. Effektiv AI-styrning kräver omfattande synlighet över alla tre dimensioner: användning, kvalitet och säkerhetsövervakning.

Stora organisationer står inför unika utmaningar när de hanterar hundratals eller tusentals AI-implementeringar över flera avdelningar, molnleverantörer och affärsenheter. Utan omfattande synlighet sprids shadow AI, efterlevnadsrisker ökar och organisationen kan inte optimera AI-investeringar eller säkerställa ansvarsfull AI-användning. Synlighet gör det möjligt för organisationer att identifiera risker, upprätthålla policyer och få ut maximalt värde av AI-initiativ.

Dålig AI-synlighet skapar flera risker: shadow AI-system verkar utan tillsyn, känslig data kan exponeras genom oomonitorerade AI-system, överträdelser av efterlevnad upptäcks inte, modellprestanda försämras utan att det märks, säkerhetshot upptäcks inte och organisationen kan inte visa styrning för tillsynsmyndigheter. Dessa risker kan leda till dataintrång, lagstadgade böter, skadat rykte och förlorat kundförtroende.

Shadow AI—obehöriga AI-verktyg som används utan IT-kännedom—skapar blinda fläckar som förhindrar centraliserad övervakning och styrning. Anställda kan använda publika AI-tjänster som ChatGPT utan organisatorisk tillsyn, vilket potentiellt kan exponera känslig data eller bryta mot efterlevnadskrav. Shadow AI leder också till dubbla insatser, slösade resurser och oförmåga att upprätthålla organisatoriska AI-policyer och standarder.

Specialbyggda plattformar för AI-styrning som Liminal, Ardoq och Knostic erbjuder centraliserad övervakning, policyhantering och efterlevnadsrapportering. Dessa plattformar integreras med AI-tjänster, samlar in detaljerade loggar, upptäcker avvikelser och erbjuder instrumentpaneler för styrningsteam. Dessutom är AmICited specialiserat på att övervaka hur AI-system refererar till ditt varumärke över GPT:er, Perplexity och Google AI Overviews, vilket ger insyn i AI-svarens kvalitet.

Regulatoriska ramverk som EU AI Act, GDPR, CCPA och branschspecifika regler (OCC för bank, FDA för hälsa) föreskriver specifika krav på synlighet och dokumentation. Organisationer måste implementera övervakning som visar efterlevnad av dessa regler, inklusive granskningsspår, partiskhetstestning, prestandaövervakning och dokumentation av AI-systemens beslutsfattande. Synlighetsinfrastrukturen måste utformas för att uppfylla dessa regulatoriska skyldigheter.

Viktiga nyckeltal inkluderar: synlighetstäckning (andel AI-system som är dokumenterade och övervakade), styrningsmognad (framsteg genom definierade styrningsnivåer), upptäckt och åtgärdstid för incidenter, efterlevnad (andel system som möter regulatoriska krav) och realiserat affärsvärde (konkreta fördelar från synlighetsinvesteringar). Organisationer bör också spåra användningsdata (aktiva användare, API-anrop), kvalitetsdata (noggrannhet, drift) och säkerhetsdata (upptäckta avvikelser, policyöverträdelser).

Implementeringstiden varierar beroende på organisationens storlek och komplexitet. Den initiala synlighetsinfrastrukturen (inventering, grundläggande loggning, instrumentpaneler) kan etableras på 3-6 månader. Att uppnå fullständig synlighet över alla AI-system kräver vanligtvis 6-12 månader. För att nå mogen, optimerad styrning tar det oftast 12-24 månader. Organisationer bör använda ett stegvis tillvägagångssätt, börja med hög-risk-system och snabba vinster, och sedan utöka till full täckning.

AmICited spårar hur AI-system som GPT:er, Perplexity och Google AI Overviews refererar till ditt varumärke och innehåll. Få insyn i AI-svarens kvalitet och varumärkesomnämnanden över alla större AI-plattformar.

Lär dig hur du skapar en AI-synlighetsfärdplan med kvartalsmål och GEO-milstolpar. Få en mall, bästa praxis och verktyg för att övervaka ditt varumärke över AI-...

Fullständig guide till företags AI-synlighetslösningar. Jämför toppplattformar som Conductor, Profound och Athena. Lär dig utvärderingskriterier och urvalsstrat...

Lär dig hur du kommer igång med AI-synlighet på bara 30 dagar. En praktisk guide för nybörjare som täcker upptäckt, optimering, innehållsstrategi och övervaknin...

Cookie-samtycke

Vi använder cookies för att förbättra din surfupplevelse och analysera vår trafik. See our privacy policy.