视觉搜索与AI:为AI发现优化图片

了解视觉搜索与AI如何改变图片发现方式。为Google Lens、AI Overviews与多模态大模型优化图片,提升在AI搜索结果中的可见性。...

了解 Google Lens 如何以每年 1000 亿次以上的搜索量变革视觉搜索。探索优化策略,确保您的品牌出现在视觉发现结果中,捕获购物意图流量。

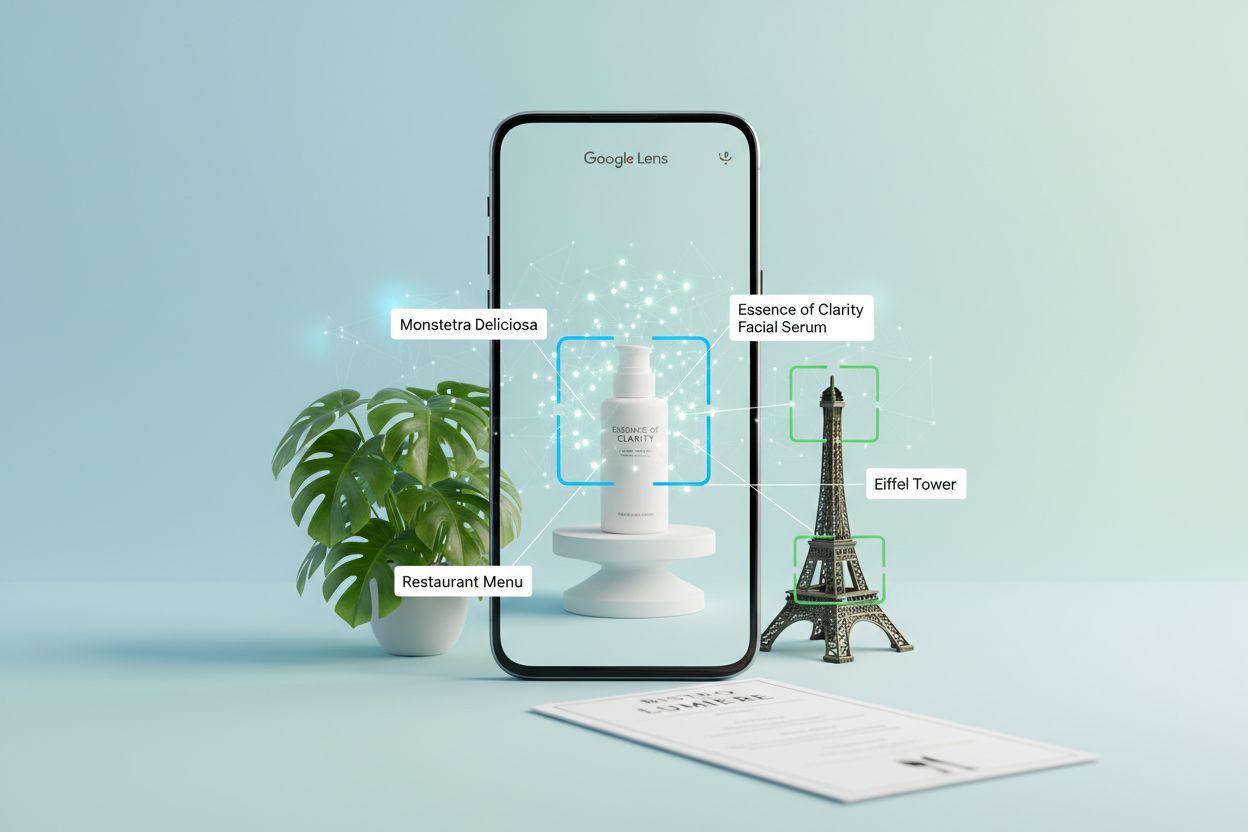

视觉搜索彻底改变了人们在线发现信息的方式,从以文本为基础的查询转向以相机为先的交互。Google Lens 作为谷歌旗舰级视觉搜索技术,如今每月驱动近 200 亿次视觉搜索,仅 2024 年通过 Lens 和 Circle to Search 实现的视觉搜索就超过 1000 亿次。这种爆发式增长反映了消费者行为的整体转变:人们越来越倾向于拿起相机对准想了解的事物,而不是输入描述文字。

这一平台的覆盖范围令人惊叹:目前每月有 15 亿人使用 Google Lens,18-24 岁的年轻用户参与度最高。对品牌而言,最具意义的是其中五分之一的视觉搜索——约 200 亿次——具有直接购物意图。这些搜索并非随意好奇,而是潜在客户在主动寻找他们在现实世界中看到的商品。

Google Lens 的核心是三项互相关联的 AI 技术,用于理解和响应视觉查询。卷积神经网络(CNN) 是基础,分析像素模式,以极高准确度识别物体、场景和视觉关系。这些深度学习模型在数十亿已标注图片上训练,可识别从常见家居用品到罕见植物种类的一切。

光学字符识别(OCR) 负责检测和提取文字,使 Lens 能读取菜单、标牌、文件甚至手写笔记。当您用相机对准外文菜单或街头标识时,OCR 将视觉文本转为可处理和翻译的数字数据。自然语言处理(NLP) 随后对文本进行语境解读,不仅识别字面内容,还能理解其与查询的关系。

真正的强大源自多模态 AI——即同时处理多种输入的能力。现在,您可以对准产品拍照,再用语音提问,收到结合了视觉理解与对话语境的 AI 答复。这一整合带来自然直观的搜索体验。

| 功能 | 传统文本搜索 | Google Lens |

|---|---|---|

| 输入方式 | 输入关键词 | 图片、视频或语音 |

| 识别能力 | 仅限关键词 | 物体、文字、上下文、关系 |

| 响应速度 | 秒级 | 即时 |

| 上下文理解 | 仅限查询文本 | 全面视觉语境 |

| 实时能力 | 否 | 是,支持实时相机 |

| 视觉物品识别准确率 | 低(难以描述) | 高(直接视觉匹配) |

Google Lens 的实际应用远超好奇搜索。在购物场景中,用户拍摄在商店、社交媒体或视频中看到的产品,即刻找到购买渠道,并跨商家比价。顾客在朋友家看到一件家具,拍张照片,就能马上找到同款商品,无需脱离当下场景。

教育是另一大应用场景,尤其在发展中国家。学生拍下英文教材题目或课堂资料,用 Lens 翻译成母语,并获得作业辅导和解析。这打破了语言壁垒,让更多人平等获取教育资源。

旅行与探索则通过 Lens 实现地标识别、餐厅发现和文化学习。游客拍摄不熟悉的建筑或标识,立刻获得历史背景和信息。自然爱好者在户外活动中识别植物、动物与昆虫,把随手观察转化为学习机会。

产品调研与对比也变得毫不费力。有人看到喜欢的手袋,拍照后 Lens 不仅返回同款,还显示不同价位的相似商品及附近零售商。这项能力彻底改变了消费者的购物旅程,从发现到购买变得无缝高效。

机会巨大:每年 200 亿次带购物意图的视觉搜索,是大多数品牌完全忽视的庞大渠道。当竞争对手还在争抢 AI Overview 位置(这个领域已被大型出版商和主流零售商主导)时,视觉搜索仍是尚未开发的处女地,抢先布局正当时。

优化视觉发现的品牌,将获得超越传统 SEO 的竞争优势。当您的产品出现在 Google Lens 结果中,拼的不是关键词或内容质量,而是视觉相关性和语境。家具商家若能让产品出现在“夜stand queen bedroom”等 Lens 搜索结果中,就能在客户准备购买的一刻截获订单,甚至在他们访问搜索引擎之前。

转化效果极其显著。视觉搜索用户已明确目标——他们不是随便浏览,而是直接购买。这种强意图流量的转化率远高于传统搜索。此外,视觉搜索减少了购前阻力:顾客能看到产品真实场景,了解与已知物体的比例,更有信心下单。

竞争时机优势也十分突出。大多数机构和品牌还没意识到视觉搜索已是独立渠道。现在开始视觉搜索优化的企业,正积累领先优势和市场份额,而竞争对手还停留在过时的搜索认知中。

视觉发现优化与传统图片 SEO 有本质区别。以下为核心策略:

这些要素共同决定 Google Lens 怎样理解和排名您的视觉内容。提供的语境越丰富,产品越容易出现在相关视觉搜索中。

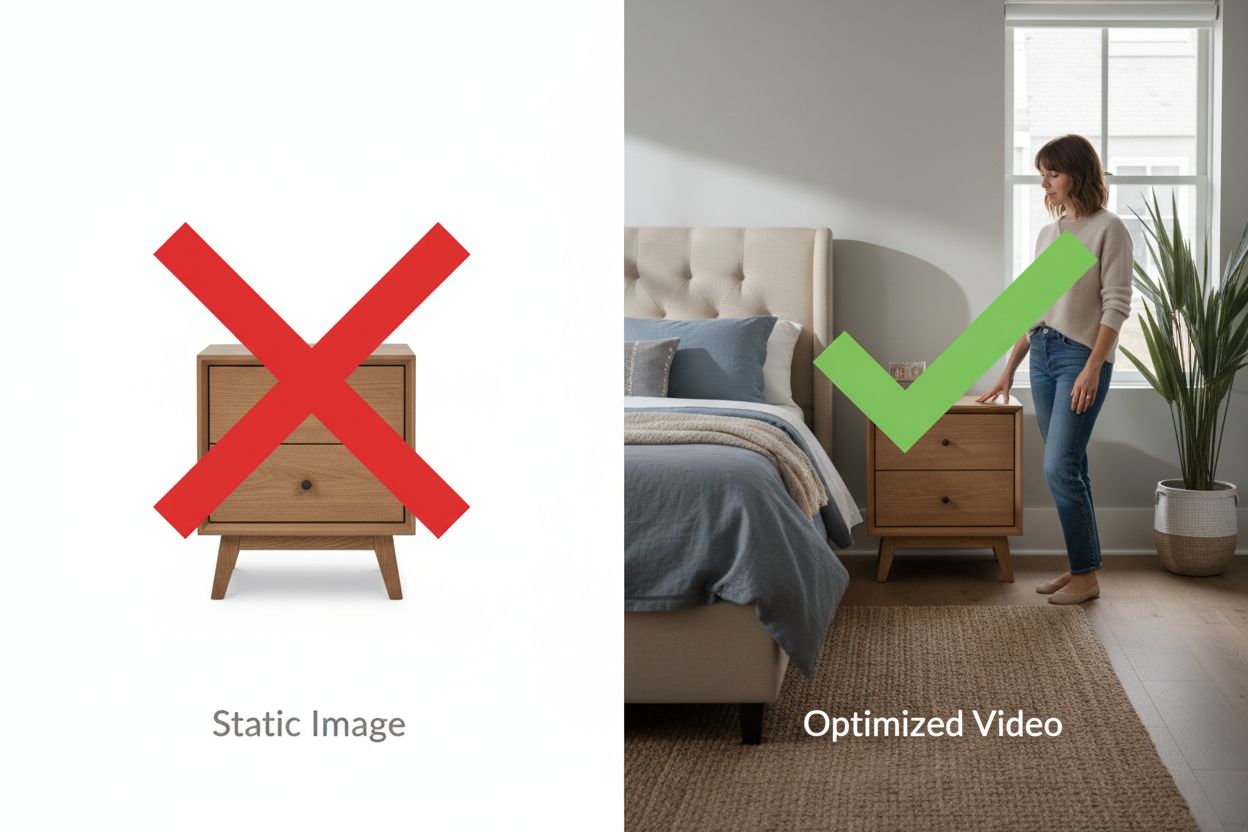

静态图片是视觉搜索优化的基础,而视频则是您的竞争利器。Google Lens 能从视频帧中提取信息,一段 30 秒的产品演示视频可生成数十个静态图片无法涵盖的可发现瞬间。

视频展现比例的效果远胜于照片。当您展示床头柜与大床、人同框时,Lens 能通过空间关系精准推断尺寸。演示产品使用场景——如防水包经受暴雨、升降桌承重双显示器、帐篷抗暴雨——这种“眼见为实”的证据远胜于口头描述。

转化提升效果可量化。电商网站添加产品视频后,转化率可提升 20-40%,因为顾客能在下单前想象产品在自己场景中的表现。这些视频同时成为 Google Lens 搜索可发现内容,为品牌带来全新流量来源。

技术要求很简单:15-45 秒的视频,从多个角度清晰展现产品与比例关系,直接上传至官网(产品页不建议用 YouTube 嵌入),文件名和 schema 标记要具描述性。无需好莱坞级制作,真诚的手机实拍往往优于无菌棚拍,因为实际语境比制作精美更有价值。

实施视觉搜索优化需有战略规划。先用 Google Search Console 的图片版块审查现有视觉资产——多数品牌会发现,虽然展现量数千,但点击极少,蕴含巨大优化空间。

挑选前 50 个流量和营收最高的产品,评估其现有视觉内容。哪些有多角度展示?哪些有视频?哪些缺乏生活方式摄影?这份审查会指明优化投入的最高 ROI 区域。制定内容路线图,优先聚焦高搜索量和商业意图强的产品。

执行路线图通常为 60-90 天。第 1-2 周制订计划和优先级排序。第 3-4 周进行内容创作——拍摄产品视频、生活方式照和演示内容。第 5-6 周完成技术优化:重命名文件、编写 alt 文本、实现 schema 标记并上传内容。第 7-8 周专注监控与迭代,追踪哪些产品和内容类型带来最多视觉搜索流量。

用 Google Search Console 效果报告筛选“图片”搜索类型,持续追踪进展。流量提升通常需 30-60 天,因 Google 需时间重新抓取和索引新视觉内容。利用 UTM 参数或渠道分组,专门跟踪图片搜索流量转化,衡量投资回报。

谷歌在视觉搜索领域的布局正不断拓展,令人期待。Search Live 将于 2025 年上线,实现与搜索的实时对话——您可以对准一幅画问“这是什么风格?”,再追问“这种风格有哪些著名艺术家?”,实现无缝的对话式视觉搜索体验。

多模态 AI 能力 持续进步,使 Lens 能理解越来越复杂的视觉查询。不再只是识别物体,而是理解关系、语境以及用户关于所见的微妙提问。Circle to Search 的扩展 让手势视觉搜索覆盖更多设备和平台,视觉发现变得更加便捷。

谷歌生态系统的深度集成 进一步放大机会。Google Lens 现已内置 Chrome 桌面端,意味着灵感来临时即可视觉搜索。随着这些能力在全球及更多平台落地,早期优化的竞争优势将更加突出。

现在就准备好品牌——优化视觉内容、创作演示视频、用好 schema 标记——未来将主导视觉搜索结果,抓住这一爆发性增长的渠道。问题不在于视觉搜索会不会影响您的业务,而在于当顾客用视觉搜索寻找您售卖的产品时,您的品牌是否能被他们看到。

Google Lens 是谷歌的视觉搜索技术,利用 AI 识别图像或视频中的物体、文字和场景。它采用卷积神经网络(CNN)进行目标识别,使用光学字符识别(OCR)检测文字,并通过自然语言处理(NLP)理解上下文。用户只需用相机对准某物提问,即可获得由 AI 驱动的即时答案和相关信息。

传统图片搜索依赖关键词和元数据来查找视觉相似的图片。Google Lens 能理解图像的实际内容——物体、关系、上下文和含义——使其能够基于视觉相似性(而非文本描述)匹配产品和信息。这让它在寻找难以用语言描述的物品(如家具、时尚或地标)时效果更佳。

Google Lens 每年处理超过 1000 亿次视觉搜索,其中 200 亿次具有直接的购物意图。进行视觉搜索的用户都是主动在寻找他们看到的商品,因此这类流量价值极高。针对视觉发现优化,可以在用户产生需求的瞬间捕获客户(甚至在他们输入搜索之前),转化率也远高于传统搜索流量。

Google Lens 需打开应用并拍照或上传图片。Circle to Search 是一项基于手势的功能,适用于 Android 设备,用户可直接在屏幕上圈选、点击或高亮对象,无需切换应用。两者都使用相同的视觉搜索技术,但 Circle to Search 为已在手机上浏览内容的用户提供了更快、更流畅的体验。

想要针对 Google Lens 优化,需要提供多个产品角度、包含已知尺寸物体(如床、门、人)作比例参考、编写描述性 alt 文本、实现产品与视频 schema 标记、拍摄展现真实场景的生活方式摄影、让季节性产品持续在线并显示缺货状态,以及使用描述性文件名。每一项都有助于 Google Lens 更好地理解您的视觉内容。

视频是视觉搜索领域的革命性工具,因为 Google Lens 能从视频帧中提取信息,一段视频可产生多个被发现的瞬间。视频能以静态图片无法实现的方式演示比例、功能和实际应用。带有演示视频的产品转化率提升 20-40%,在视觉搜索结果中出现频率更高,使视频成为竞争优势的关键。

在 Google Search Console 的图片版块中,通常需等待 30-60 天才会看到有意义的流量增长。Google 需要时间重新抓取和索引您的新视觉内容。然而,30 天内应关注展现量的提升,这表明 Google 正在发现和索引您的优化内容。随着流量增加,转化效果一般在 60-90 天内逐步显现。

可以,您可在 Google Search Console 的效果报告中筛选“图片”搜索类型来追踪视觉搜索流量。如需更详尽的转化追踪,可在产品页使用 UTM 参数,或为图片搜索流量创建自定义渠道分组。重点监控点击率、转化率和客单价等指标,以衡量您优化投入的回报。

AmICited 跟踪 Google Lens、Circle to Search 以及其他 AI 工具在视觉发现结果中如何引用您的品牌。获取您的 AI 可见性洞察,并优化您的视觉内容策略。

了解视觉搜索与AI如何改变图片发现方式。为Google Lens、AI Overviews与多模态大模型优化图片,提升在AI搜索结果中的可见性。...

了解视觉AI搜索是什么、如何工作及其在电子商务和零售中的应用。探索基于图像的搜索背后的技术,以及企业如何针对视觉搜索进行优化。...

了解数据可视化如何提升AI搜索可见性,帮助大模型理解内容,并增加在AI生成答案中的引用率。探索针对图表、信息图及视觉内容的优化策略。...

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.