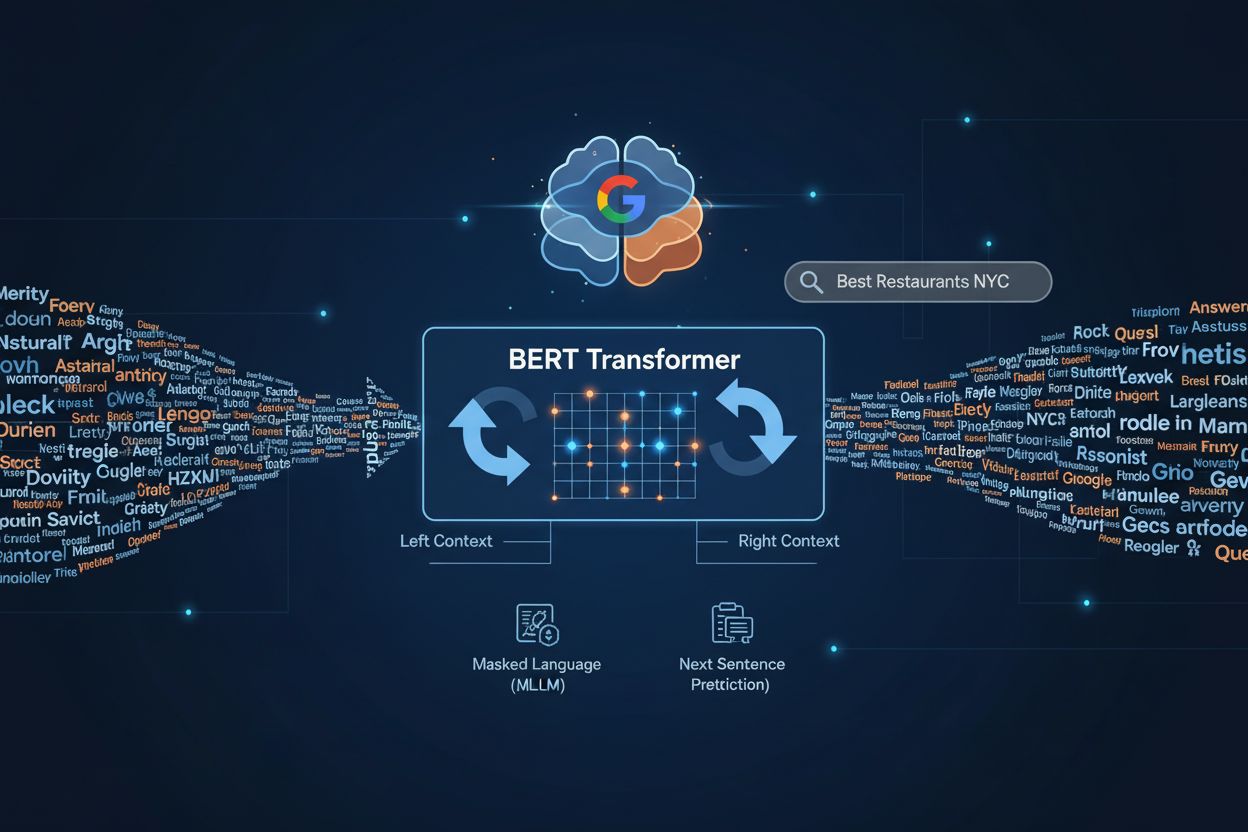

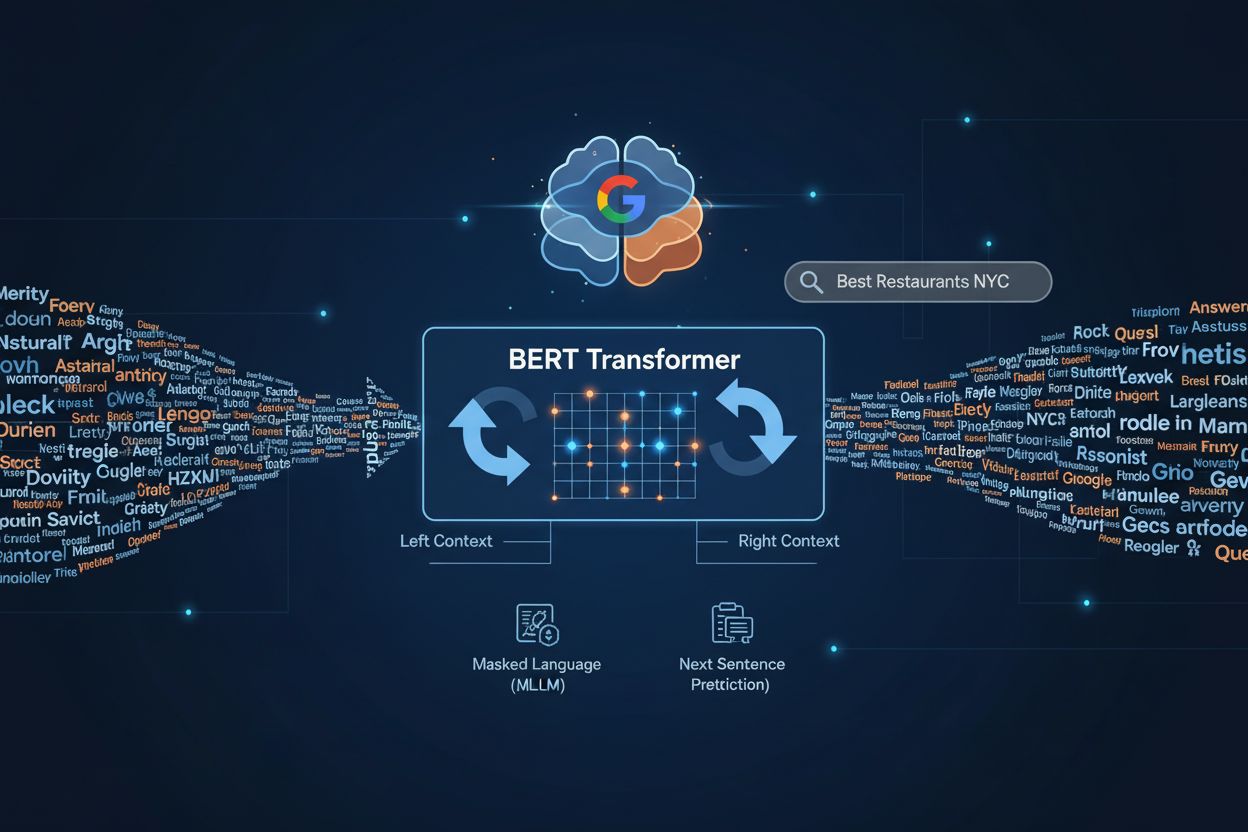

BERT 更新

了解谷歌 BERT 更新,这一 2019 年重大算法变革,采用双向 Transformer 技术提升搜索查询和排名中的自然语言理解能力。

我一直在看到关于BERT的各种相互矛盾的说法。

2019年时,BERT是做SEO必须了解的核心。自然语言处理、理解上下文等等。

现在大家都在讨论GPT-4、Claude、Gemini,我有点迷惑了。

我的问题:

想要梳理清楚,明白现在内容优化真正重要的是什么。

让我来澄清一下技术格局。

模型家族树:

Transformer (2017)

├── BERT风格(编码器-理解文本)

│ ├── BERT (Google, 2018)

│ ├── RoBERTa (Meta)

│ ├── MUM (Google, 2021)

│ └── 还有很多

└── GPT风格(解码器-生成文本)

├── GPT系列(OpenAI)

├── Claude (Anthropic)

├── Gemini (Google)

└── 还有很多

BERT仍然重要,但:

真正重要的是什么:

| 搜索类型 | 主用模型风格 | 你的关注点 |

|---|---|---|

| 传统Google | BERT/MUM(编码器) | 查询-内容匹配,意图 |

| AI综述 | 混合 | 可提取的答案 |

| ChatGPT/Perplexity | GPT风格(解码器) | 全面、可被引用的内容 |

实际结论:

“为BERT优化”其实一直是指书写自然、语境丰富的内容。这点没有变。模型名对你的优化策略没有决定性影响。

没错。“为BERT优化”其实就是:

这些依然适用。你是在为现代语言模型如何理解文本而优化,而不是针对某个具体模型。

适用于所有模型的原则:

这些既有助于BERT理解你的内容排名,也能帮助GPT类模型提取引用。

从SEO角度看BERT的演变。

BERT时代(2019-2021):

MUM/AI时代(2021至今):

实际变化:

说实话?内容策略其实变化不大。

建议一直都是:

这些BERT时代有效,MUM时代有效,GPT同样有效。

新变化是:

引用/提取层。GPT风格模型需要提取并引用你的内容,而不仅仅是做查询匹配。

这意味着:

但自然语言基础没变。

内容策略视角。

我这样给客户解释:

“BERT让Google理解你的意思。GPT让AI懂得用你的内容。”

实际区别:

对传统搜索(BERT/MUM理解):

对AI答案(GPT提取):

重叠部分:

二者都奖励:

我的建议:

别想“为BERT还是GPT优化”。要想:“如何创作既能让语言模型理解(BERT),又能被提取/引用(GPT)的内容?”

答案都是:清晰自然、结构良好、专业权威的内容。

研究视角下的演变。

BERT现在的定位:

BERT是基础——它让行业认识到双向语境理解的可行性。Google并没有“取代”BERT,而是不断进化。

进化过程:

Google搜索具体来说:

Google在排序体系中用多种模型:

对你的意义:

具体采用哪个模型对你的策略没实际影响。重要的是所有这些模型都:

优化这些原则,而不是追逐模型名称。

技术写作视角。

从BERT到AI时代,我写作上的变化:

BERT时代关注:

AI时代新增:

不变的:

我的实际流程:

BERT原则是基础,AI优化是提升层。

实战顾问视角。

我对客户谈BERT时会说:

“别专门担心BERT。关注所有现代搜索系统共通的原则……”

永恒原则:

AI时代的新变化:

更强调:

核心总结:

“BERT优化”其实是市场用语,指“自然写作和回答问题”。这依然适用。现在只是在此基础上加上AI提取优化。

从数据角度看BERT相关变化。

跨时代追踪内容表现:

我们跟踪了2019-2025年1000篇内容:

BERT时代(2019-2021):

MUM/AI时代(2021-2025):

规律:

自然语言写作(BERT原则)仍是基础。但为AI提取做结构化,能带来额外提升。

实际建议:

别抛弃BERT原则,在此基础上加AI友好结构。

我们用什么:

我们用Am I Cited追踪哪些内容格式最容易被AI引用。帮助找出哪些结构除了自然语言外更有效。

这真是帮我理清了思路。总结:

BERT还重要吗?

重要,但作为基础,而不是特定优化目标。BERT代表的那些原则(自然语言、语境、意图)仍然至关重要。

发生了什么变化:

我会做什么:

思维模型:

BERT = 基础(理解) GPT = 上层(提取与引用)

本质上都奖励相同的核心品质,AI只是增加了结构要求。

感谢大家——思路清晰多了。

Get personalized help from our team. We'll respond within 24 hours.

了解谷歌 BERT 更新,这一 2019 年重大算法变革,采用双向 Transformer 技术提升搜索查询和排名中的自然语言理解能力。

了解BERT,其架构、应用及当前相关性。理解BERT与现代替代方案的比较,以及为什么它对NLP任务依然至关重要。

社区讨论解释 Google MUM 及其对 AI 搜索的影响。专家分享这种多模态 AI 模型如何影响内容优化和可见性。

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.