Co je AI audit obsahu a proč ho vaše značka potřebuje?

Zjistěte, co je AI audit obsahu, jak se liší od tradičních auditů obsahu a proč je sledování přítomnosti vaší značky v AI vyhledávačích jako ChatGPT a Perplexit...

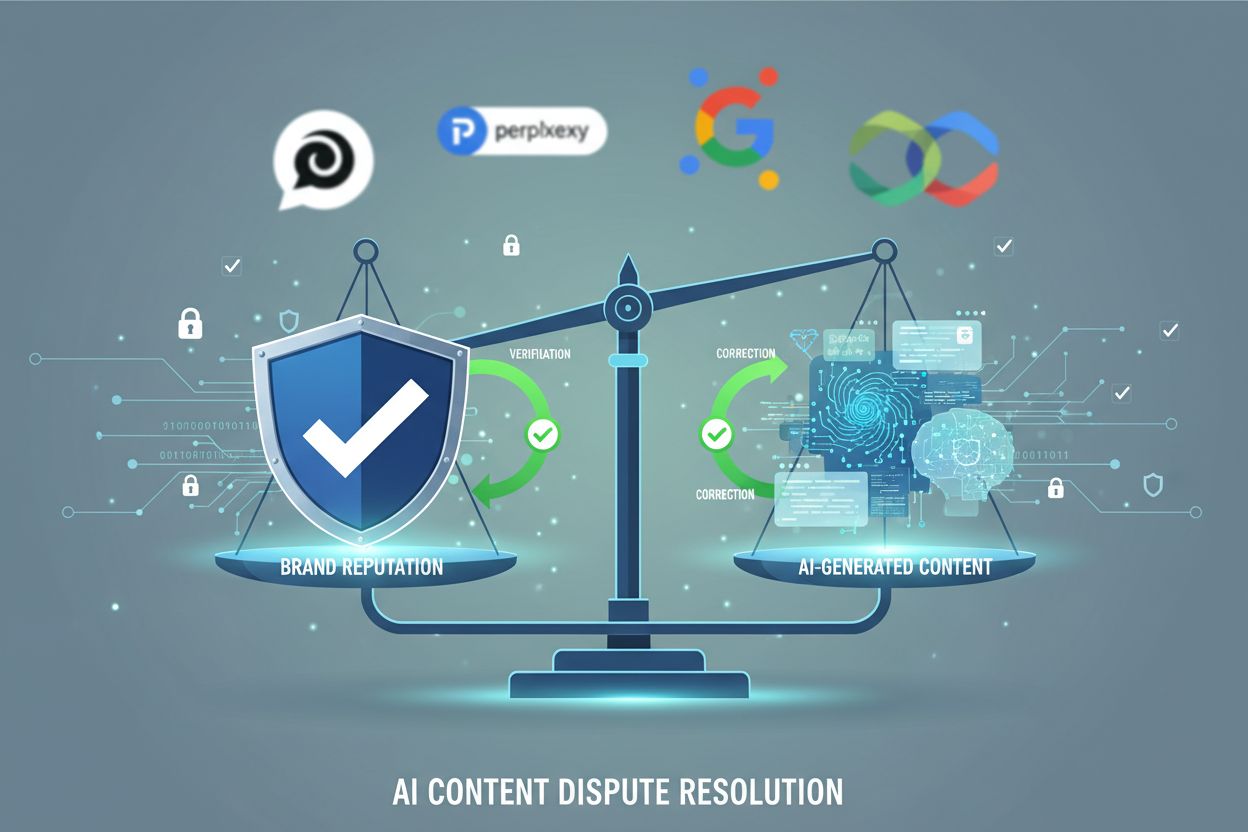

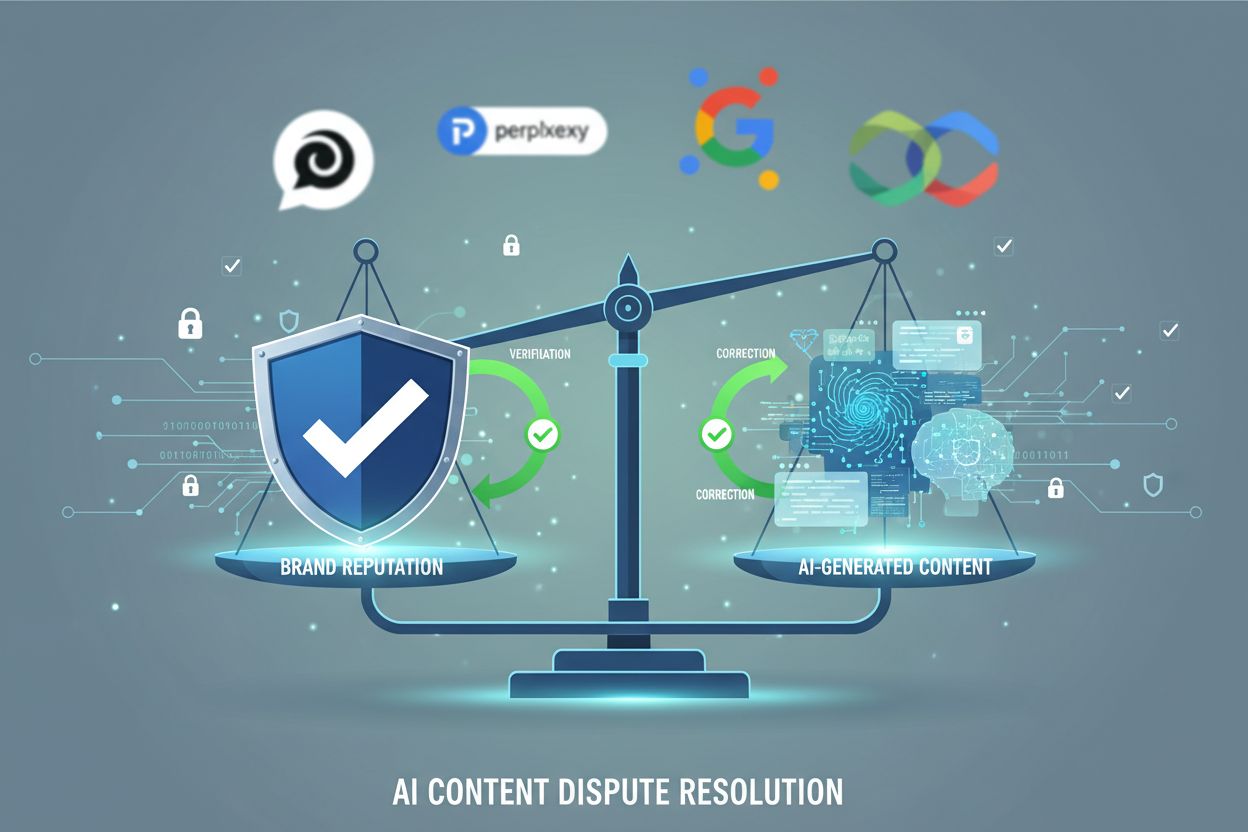

Procesy pro napadení nepřesného nebo škodlivého AI-generovaného obsahu o značce. Spory o AI obsah označují formální výzvy v případech, kdy systémy umělé inteligence generují zavádějící informace o značkách, produktech nebo organizacích. Tyto spory vznikají v důsledku AI halucinací, nesprávných citací a zkreslení, která poškozují reputaci značky na platformách jako ChatGPT, Perplexity a Google AI Overviews. Efektivní řešení sporů vyžaduje monitoring, dokumentaci, přímý kontakt s AI společnostmi a strategické vytváření obsahu k nápravě dezinformací.

Procesy pro napadení nepřesného nebo škodlivého AI-generovaného obsahu o značce. Spory o AI obsah označují formální výzvy v případech, kdy systémy umělé inteligence generují zavádějící informace o značkách, produktech nebo organizacích. Tyto spory vznikají v důsledku AI halucinací, nesprávných citací a zkreslení, která poškozují reputaci značky na platformách jako ChatGPT, Perplexity a Google AI Overviews. Efektivní řešení sporů vyžaduje monitoring, dokumentaci, přímý kontakt s AI společnostmi a strategické vytváření obsahu k nápravě dezinformací.

Spor o AI obsah označuje formální výzvu nebo proces stížnosti, když systémy umělé inteligence generují, citují nebo prezentují nepřesné, zavádějící či škodlivé informace o značce, produktu nebo organizaci. Tyto spory vznikají, když AI poháněné vyhledávače, chatboti a jazykové modely vytvářejí obsah, který zkresluje fakta, přiřazuje nesprávné informace nebo poškozuje pověst značky prostřednictvím AI halucinací—situací, kdy AI systémy sebevědomě prezentují nepravdivé informace jako fakta. S rostoucí rolí AI vyhledávání v tom, jak spotřebitelé objevují a hodnotí značky, a s platformami jako ChatGPT, Perplexity, Google AI Overviews či Gemini, které ovlivňují nákupní rozhodnutí milionů uživatelů, je schopnost napadnout a opravit nepřesný AI-generovaný obsah klíčová pro ochranu značky a řízení pověsti.

Dopad nepřesného AI-generovaného obsahu sahá daleko za hranice tradičního monitoringu značky. Na rozdíl od příspěvků na sociálních sítích, které zmizí z feedu během několika hodin, AI-generované zmínky o značce mohou přetrvávat na více platformách a ovlivňovat vnímání spotřebitelů měsíce či roky. Téměř 50 % lidí důvěřuje doporučením AI a s více než 700 miliony týdenních uživatelů ChatGPT může jediné nepřesné tvrzení o vaší značce zasáhnout desítky milionů potenciálních zákazníků. Když AI systémy citují nesprávné ceny, chybně přiřazují vlastnosti produktu nebo doporučují konkurenci místo vaší značky, důsledky přímo ovlivňují akvizici zákazníků, konverzní poměry a postavení na trhu.

| Aspekt | Tradiční spory o značku | Spory o AI obsah |

|---|---|---|

| Životnost | Hodiny až dny (sociální sítě) | Měsíce až roky (přetrvávají v AI modelech) |

| Dosah | Omezený na sledující platformy | Miliony AI uživatelů globálně |

| Rychlost opravy | Okamžitá odpověď možná | Vyžaduje obsahovou strategii a kontakt |

| Ověření | Lidská kontrola | Generováno AI, obtížnější ověřit |

| Dopad na vyhledávání | Ovlivňuje SEO pozice | Ovlivňuje AI Share of Voice a doporučení |

| Důvěra publika | Různá dle platformy | Vysoká (50 %+ věří AI) |

| Stálost | Smazatelné autorem | Vložené v tréninkových datech AI |

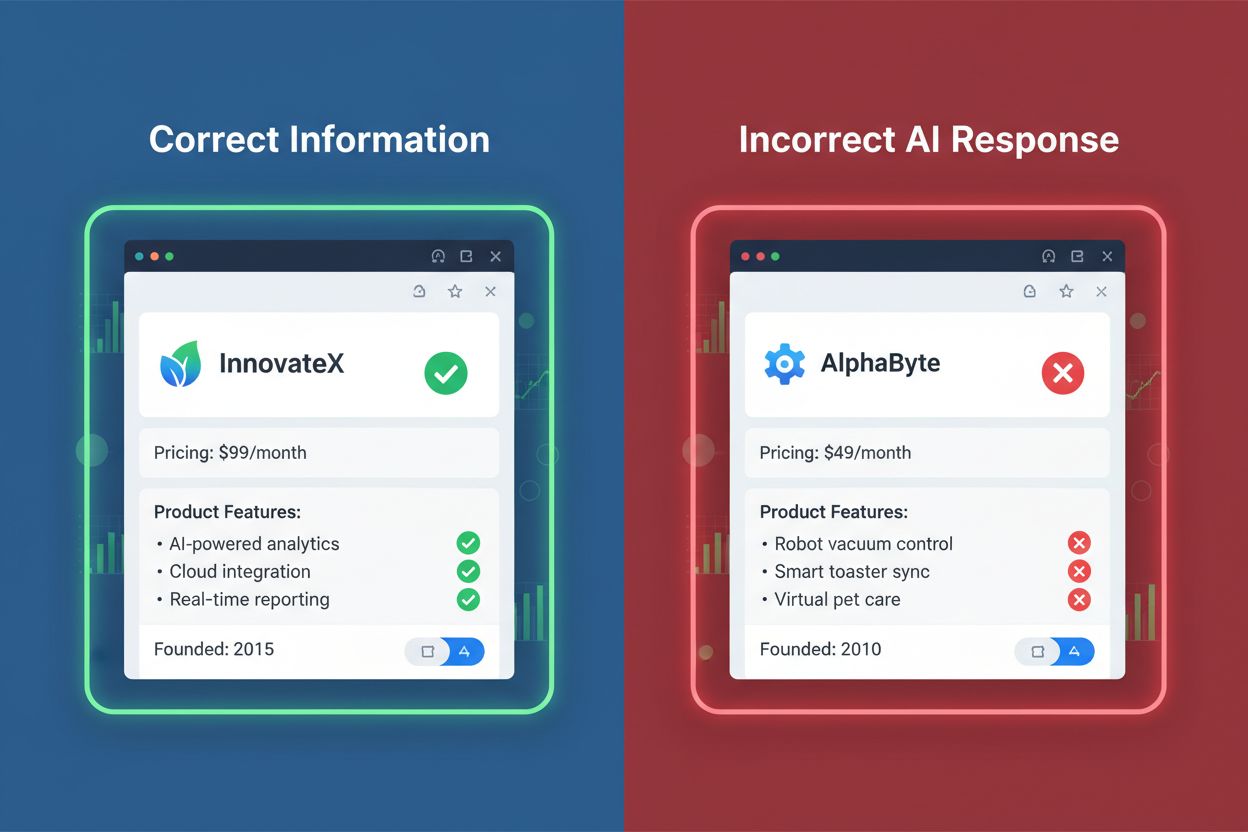

Reálné příklady ukazují závažnost: AI systémy uváděly nesprávné ceny předplatných služeb, označily ukončené produkty jako aktuální nabídky a připisovaly vlastnosti konkurenci, které ve skutečnosti patřily původní značce. Tyto chyby přímo ovlivňují nákupní rozhodnutí a mohou vést ke ztrátě příjmů, poškození vztahů se zákazníky a oslabení postavení ve výsledcích AI-driven vyhledávání.

AI systémy generují různé kategorie nepřesného či škodlivého obsahu o značkách. Pochopení těchto typů pomáhá organizacím identifikovat a prioritizovat řešení sporů:

Pochopení, proč AI systémy produkují nepřesné informace o značce, je zásadní pro vytvoření efektivních strategií řešení sporů. AI halucinace nastávají, když jazykové modely generují věrohodně znějící, ale nepravdivé informace—jde o základní charakteristiku fungování těchto systémů. Namísto vyhledání faktů v databázi AI modely předpovídají další slovo na základě statistických vzorců v tréninkových datech, což někdy vede k sebevědomému tvrzení informací, které neexistují nebo jsou zastaralé. Mnohé AI systémy využívají Retrieval Augmented Generation (RAG), kdy doplňují tréninková data aktuálními webovými vyhledáváními, což však může zesílit chyby, pokud zdrojové weby obsahují nepřesné informace nebo pokud AI špatně vyhodnotí kontext. Omezení tréninkových dat znamená, že informace o nových produktech, nedávných změnách ve firmě nebo aktualizovaných cenách se nemusí v AI odpovědích objevit. Zaujatost při výběru zdrojů nastává také tehdy, když AI systémy nadměrně upřednostňují určité weby—zejména autoritativní domény jako Wikipedia, Reddit nebo oborové recenzní portály—které mohou obsahovat zastaralé či neúplné údaje o vaší značce.

Efektivní řízení sporů začíná systematickým monitoringem napříč více AI platformami. Manuální monitoring znamená občasné pokládání dotazů AI systémům ohledně značky a kontrolu odpovědí, ale tento přístup je časově náročný a zachytí jen zlomek potenciálních zmínek. Automatizované AI monitorovací nástroje poskytují komplexní sledování napříč platformami jako ChatGPT, Perplexity, Google AI Overviews, Gemini, Claude a DeepSeek, analyzují tisíce AI-generovaných odpovědí a identifikují nepřesnosti. Přední platformy jako AmICited.com se specializují na sledování, jak AI systémy zmiňují značky, poskytují analýzu sentimentu pro odhalení negativních zobrazení a analýzu citací pro zjištění, z jakých zdrojů AI čerpá při zmínkách o vaší značce. Konkurence jako Authoritas nabízí sledování vlastních promptů se statistickým hodnocením, Profound umožňuje monitoring v podnikovém měřítku s podrobnou analýzou odpovědí a Ahrefs Brand Radar sleduje zmínky v AI spolu s tradiční vyhledávaností. Nástroje jako Otterly a Peec.ai nabízejí cenově dostupné možnosti pro menší značky začínající s monitoringem své AI přítomnosti. Efektivní monitoring by měl sledovat nejen zmínky o značce, ale také AI Share of Voice—procento AI doporučení, která vaše značka získává oproti konkurenci v relevantních kategoriích.

Jakmile jsou zjištěny nepřesné AI obsahy, existuje několik cest k řešení podle závažnosti a povahy sporu. Přímý kontakt s AI společnostmi znamená oslovení platforem jako OpenAI, Anthropic, Google a Perplexity s doloženými důkazy a žádost o opravu nebo přeškolení modelů. Mnohé AI společnosti mají zavedené mechanismy zpětné vazby a berou obavy o pověst značky vážně, zejména pokud se chyby týkají důvěry zákazníků nebo faktických nesprávností. Tvorba a optimalizace obsahu řeší příčinu tím, že váš web bude obsahovat jasné, přesné a komplexní informace o značce, produktech, cenách i historii firmy—tedy informace, které AI bude při generování odpovědí citovat. Vytváření srovnávacích stránek a sekcí FAQ, které přímo řeší časté otázky a srovnání s konkurencí, zvyšuje šanci, že AI bude citovat vaše autoritativní zdroje místo třetích stran. PR a mediální komunikace může zesílit opravy prostřednictvím oborových publikací a zpráv, které ovlivní webové zdroje, na něž se AI spoléhá. Spolupráce s influencery a recenze třetích stran na autoritativních platformách jako G2, Capterra nebo oborové recenzní weby poskytují alternativní zdroje, na něž se AI odkazuje, čímž zlepšíte zastoupení značky v AI odpovědích. Nejefektivnější je kombinace více strategií: opravy nepřesností na webu, tvorba autoritativního obsahu, který AI bude citovat, a přímé jednání s AI společnostmi v případech faktických chyb poškozujících pověst značky.

Rostoucí ekosystém specializovaných nástrojů pomáhá značkám monitorovat, analyzovat a řídit jejich přítomnost v AI-generovaném obsahu. AmICited.com je lídrem v monitoringu AI značek, sleduje zmínky napříč hlavními AI platformami s podrobnou analýzou sentimentu a citací pro zjištění zdrojů, které ovlivňují AI odpovědi o vaší značce. Authoritas kombinuje monitoring AI vyhledávání s tradičním SEO, nabízí generování vlastních promptů a statistické hodnocení pro analýzy v podnikovém měřítku. Profound poskytuje denní monitoring s komplexní analýzou odpovědí a možností procházet konverzace a zjistit, jaké otázky spouštějí zmínky o značce. Ahrefs Brand Radar integruje sledování AI zmínek s metrikami viditelnosti ve vyhledávačích a ukazuje, jak se vaše značka objevuje napříč šesti hlavními AI indexy i v tradičním vyhledávání. Otterly.ai nabízí cenově dostupný monitoring s týdenními automatickými reporty, ideální pro značky začínající s AI viditelností. Peec.ai poskytuje řešení střední třídy s přehlednými dashboardy a srovnáním s konkurencí. Tyto platformy sdílejí základní funkce jako sledování frekvence zmínek, analýzu sentimentu, srovnání s konkurencí a identifikaci zdrojů citací, ale liší se frekvencí aktualizací (od reálného času po týdenní), pokrytím platforem, možnostmi přizpůsobení a cenovým modelem. Výběr správného nástroje závisí na velikosti organizace, rozpočtu a hloubce potřebné AI analýzy vyhledávání.

S narůstajícím počtem sporů o AI obsah se vyvíjí právní a regulační rámce na ochranu značek a přesnost obsahu. Federal Trade Commission (FTC) již podnikla kroky proti společnostem, které klamavě inzerovaly schopnosti AI, včetně případů, kdy byly AI nástroje na detekci obsahu propagovány s nadsazenou přesností. Autorská práva a ochranné známky jsou ohroženy, když AI systémy nesprávně přiřazují duševní vlastnictví nebo generují obsah, který porušuje práva značky. Nově vznikající regulace v EU, Velké Británii a navrhovaná legislativa v USA čím dál častěji požadují, aby AI systémy zveřejňovaly zdroje tréninkových dat a umožňovaly nápravu nepřesných informací. Otázky odpovědnosti zůstávají nevyřešeny: je třeba určit, zda odpovědnost za nepřesný AI obsah nesou vývojáři AI, společnosti, jejichž obsah byl použit pro trénink, nebo samotné značky. Progresivní organizace by měly sledovat vývoj regulace a zajistit, že jejich procesy řešení sporů odpovídají novým právním požadavkům na transparentnost a přesnost AI.

Proaktivní řízení značky v éře AI vyžaduje víceúrovňový přístup kombinující prevenci, monitoring a rychlou reakci. Udržujte přesné informace na webu na všech stránkách, aby ceny, popisy produktů, historie firmy a klíčová fakta byly aktuální a jasně prezentované—stanou se tak autoritativním zdrojem, který AI cituje. Vytvořte komplexní dokumentaci značky včetně detailních FAQ, srovnávacích stránek s konkurencí a obsahu “o nás”, který přímo odpovídá na otázky, s nimiž se AI systémy mohou setkat. Pravidelně monitorujte pomocí specializovaných nástrojů pro monitoring AI, abyste včas odhalili nepřesnosti, než se rozšíří napříč více AI platformami. Reagujte rychle při zjištění sporu, a to jak přímým kontaktem s AI společnostmi, tak tvorbou obsahu k nápravě dezinformací. Budujte autoritu značky prostřednictvím zmínek na autoritativních webech, oborových recenzí a mediálního pokrytí, které AI systémy upřednostní jako zdroje. Optimalizujte pro AI vyhledávání tvorbou obsahu, který odpovídá na konkrétní otázky uživatelů AI systémů, abyste zajistili, že se vaše značka objeví v relevantních odpovědích. Organizace, které kombinují tyto postupy—přesné informace, komplexní dokumentaci, aktivní monitoring, rychlou reakci a budování autority—výrazně snižují riziko i dopad sporů o AI obsah a zároveň zvyšují svou viditelnost ve výsledcích vyhledávání řízených AI.

Spor o AI obsah nastává, když systémy umělé inteligence generují, citují nebo prezentují nepřesné, zavádějící či škodlivé informace o značce, produktu nebo organizaci. Tyto spory vznikají v důsledku AI halucinací—situací, kdy AI systémy sebevědomě prezentují nepravdivé informace jako fakta—a mohou výrazně poškodit pověst značky na platformách jako ChatGPT, Perplexity a Google AI Overviews.

Na rozdíl od příspěvků na sociálních sítích, které mizí během několika hodin, AI-generované zmínky o značce přetrvávají měsíce nebo roky a osloví miliony uživatelů. Téměř 50 % lidí důvěřuje doporučením AI a s více než 700 miliony týdenních uživatelů ChatGPT může jedno nepřesné tvrzení ovlivnit desítky milionů potenciálních zákazníků a přímo ovlivnit jejich nákupní rozhodování.

Použijte specializované nástroje pro monitoring AI, jako jsou AmICited.com, Authoritas nebo Profound, abyste sledovali, jak AI systémy zmiňují vaši značku napříč ChatGPT, Perplexity, Google AI Overviews a Gemini. Tyto nástroje poskytují analýzu sentimentu, sledování citací a srovnání s konkurencí pro identifikaci nepřesností, negativních zobrazení a chybějících zmínek.

Mezi běžné spory patří faktické chyby (nesprávné ceny, data založení, vlastnosti produktu), chybně přiřazené informace, zvýhodňování konkurence v doporučeních, zesilování negativního sentimentu, chybějící zmínky o značce v relevantních kategoriích a škodlivá spojení s nesouvisejícími nebo kontroverzními tématy.

Efektivní řešení kombinuje několik strategií: přímý kontakt s AI společnostmi s doloženými důkazy, tvorba přesného a obsáhlého obsahu na vašem webu, vytváření srovnávacích stránek a sekcí FAQ, PR a mediální komunikace na ovlivnění zdrojových materiálů a budování autority značky díky recenzím třetích stran a zmínkám na vysoce autoritativních platformách.

AI systémy produkují nepřesný obsah kvůli halucinacím (generování nepravdivých, ale věrohodně znějících informací), omezením tréninkových dat (zastaralé informace), chybám v Retrieval Augmented Generation (špatná interpretace webových zdrojů) a zaujatosti při výběru zdrojů (upřednostňování některých webů a ignorování jiných).

Mezi přední platformy patří AmICited.com (specializovaný monitoring AI značek), Authoritas (sledování vlastních promptů se statistickou spolehlivostí), Profound (monitoring v podnikovém měřítku na denní bázi), Ahrefs Brand Radar (AI zmínky se sledováním vyhledávanosti), Otterly (cenově dostupný monitoring týdně) a Peec.ai (řešení střední třídy se srovnáním s konkurencí).

Doba řešení se výrazně liší. Přímé opravy na vašem webu mohou ovlivnit AI odpovědi během několika týdnů při aktualizaci modelů. Přímý kontakt s AI společnostmi může trvat 1–3 měsíce. Budování autority prostřednictvím obsahu třetích stran a PR zpravidla vyžaduje 2–6 měsíců, než se projeví měřitelný vliv na doporučení AI.

Zjistěte, jak AmICited pomáhá značkám sledovat a spravovat jejich přítomnost napříč ChatGPT, Perplexity, Google AI Overviews a dalšími AI platformami. Získejte upozornění v reálném čase, když AI systémy zkreslují vaši značku, a přijměte opatření na ochranu své pověsti.

Zjistěte, co je AI audit obsahu, jak se liší od tradičních auditů obsahu a proč je sledování přítomnosti vaší značky v AI vyhledávačích jako ChatGPT a Perplexit...

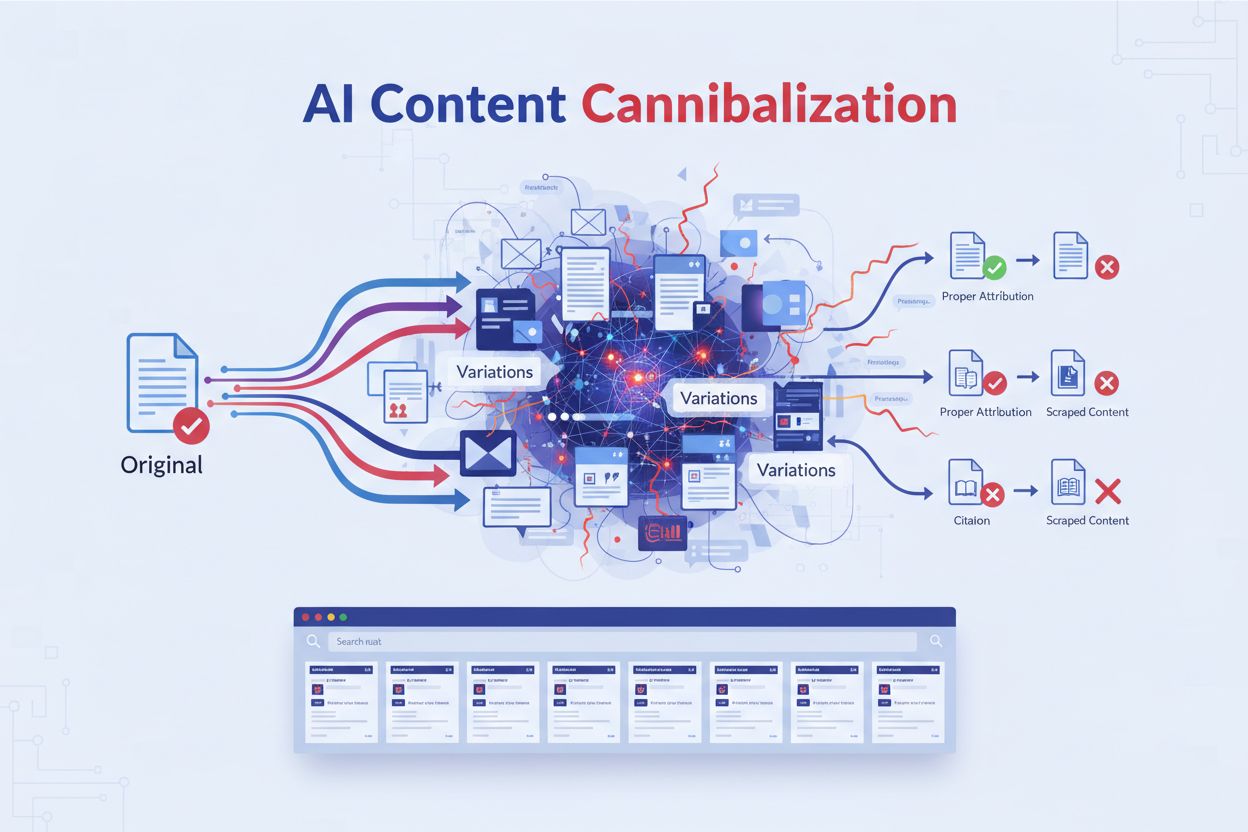

Zjistěte, co je AI kanibalizace obsahu, čím se liší od duplicitního obsahu, proč škodí pozicím ve vyhledávání a jaké jsou strategie ochrany vašeho obsahu před s...

Zjistěte, zda obsah uzamykat, nebo optimalizovat pro viditelnost ve vyhledávání pomocí AI. Objevte moderní strategii obsahu, která vyvažuje generování leadů s c...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.