Vytváření LLM meta odpovědí: Samostatné postřehy, které může AI citovat

Zjistěte, jak vytvářet LLM meta odpovědi, které systémy AI citují. Objevte strukturální techniky, strategie hustoty odpovědí a formáty obsahu připravené k citac...

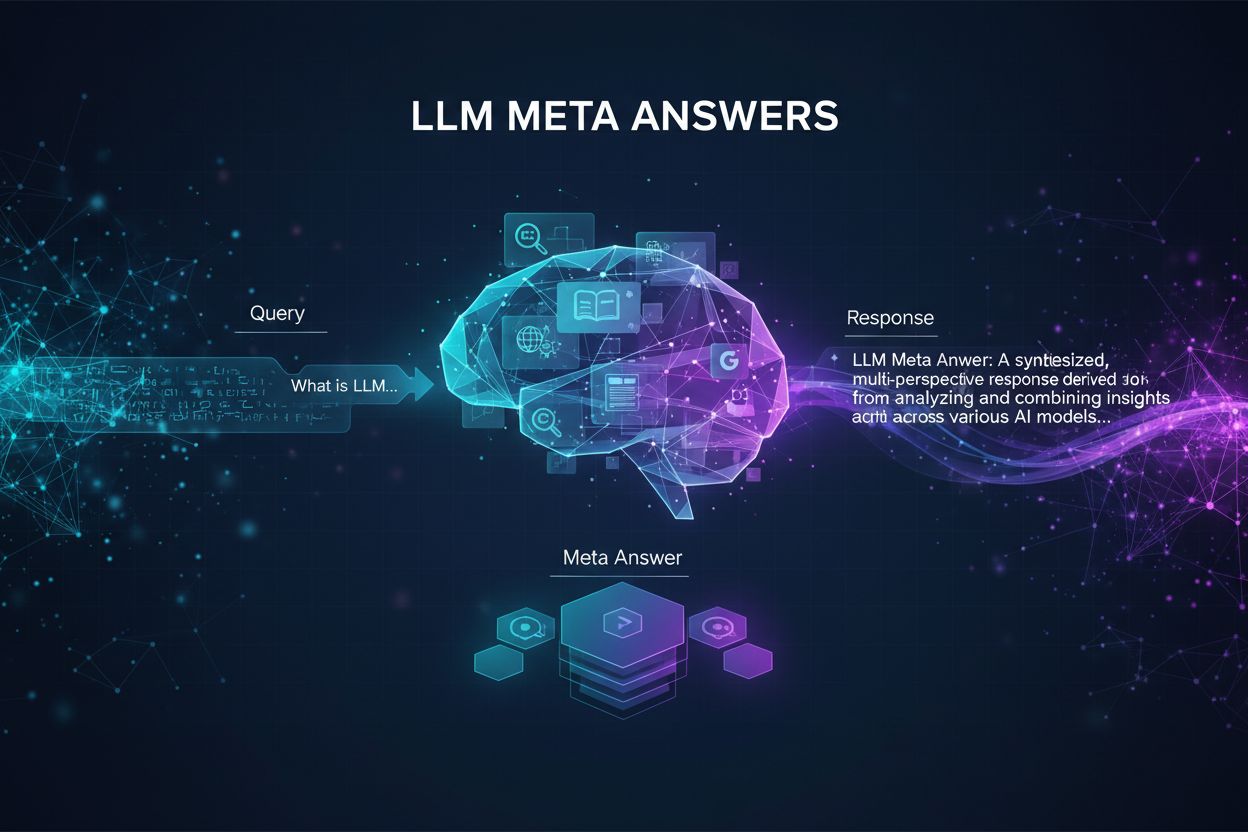

Obsah, který přímo řeší, jak jazykové modely mohou interpretovat a odpovídat na související dotazy, navržený ke zvýšení viditelnosti v AI-generovaných odpovědích napříč platformami jako ChatGPT, Google AI Overviews a Perplexity. LLM Meta Odpovědi představují syntetizované odpovědi, které kombinují informace z více zdrojů do ucelených, konverzačních odpovědí, které odpovídají na uživatelský záměr.

Obsah, který přímo řeší, jak jazykové modely mohou interpretovat a odpovídat na související dotazy, navržený ke zvýšení viditelnosti v AI-generovaných odpovědích napříč platformami jako ChatGPT, Google AI Overviews a Perplexity. LLM Meta Odpovědi představují syntetizované odpovědi, které kombinují informace z více zdrojů do ucelených, konverzačních odpovědí, které odpovídají na uživatelský záměr.

LLM Meta Odpovědi představují syntetizované, AI-generované reakce, které velké jazykové modely vytvářejí, když jim uživatelé kladou dotazy prostřednictvím platforem jako ChatGPT, Claude nebo Google AI Overviews. Tyto odpovědi se zásadně liší od tradičních výsledků vyhledávání, protože kombinují informace z více zdrojů do ucelené, konverzační reakce, která přímo odpovídá na uživatelský záměr. Namísto zobrazení seznamu odkazů LLM analyzují získaný obsah a generují originální text, který začleňuje fakta, perspektivy a poznatky ze svých tréninkových dat a systémů retrieval-augmented generation (RAG). Porozumění tomu, jak LLM tyto meta odpovědi skládají, je zásadní pro tvůrce obsahu, kteří chtějí, aby jejich práce byla citována a uváděna v AI-generovaných odpovědích. Viditelnost vašeho obsahu v těchto AI odpovědích je dnes stejně důležitá jako pozice v tradičních výsledcích vyhledávání, což činí optimalizaci pro LLM (LLMO) klíčovou součástí moderní obsahové strategie.

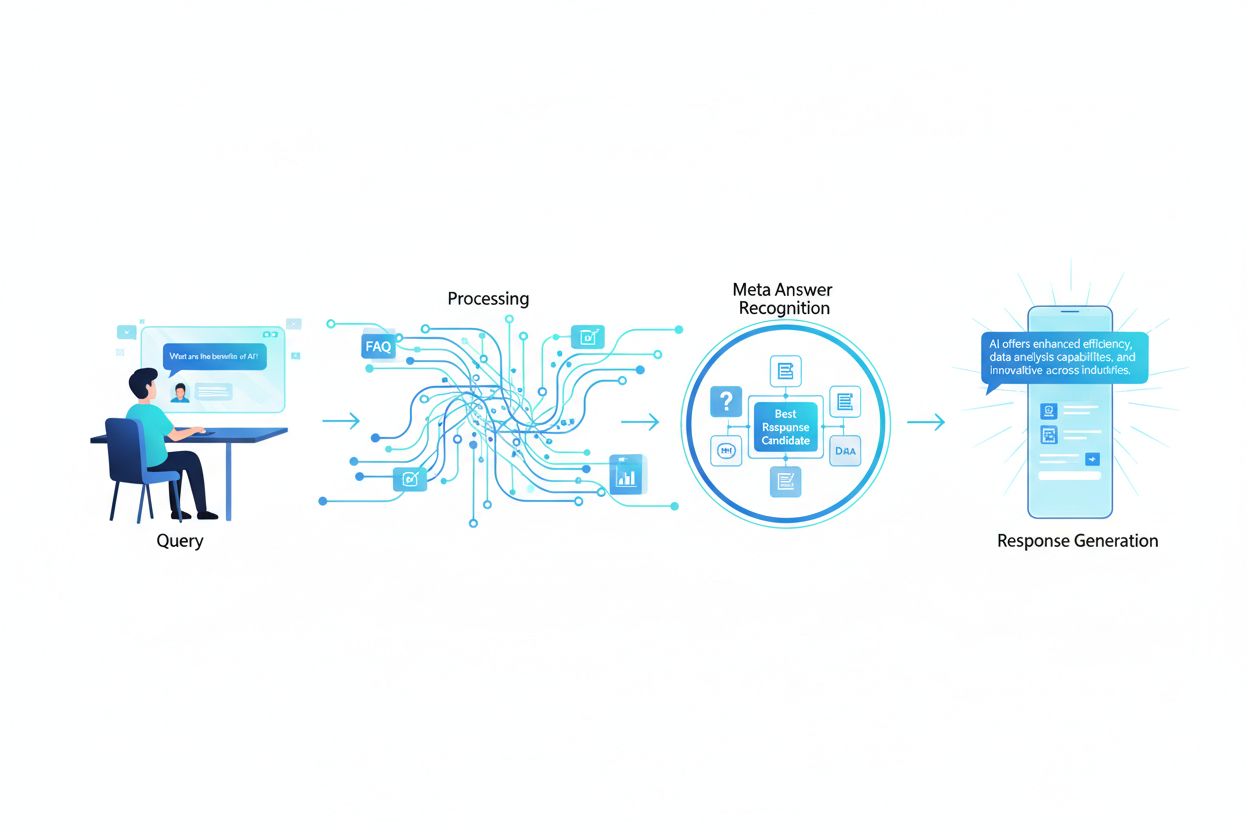

Když uživatel zadá dotaz do LLM, systém se nespokojí s pouhým porovnáním klíčových slov jako tradiční vyhledávače. LLM místo toho provádějí sémantickou analýzu, aby porozuměly skutečnému záměru, kontextu a nuancím otázky. Model rozkládá dotaz na konceptuální složky, identifikuje související témata a entity a určuje, jaký typ odpovědi by byl nejpřínosnější – ať už jde o definici, srovnání, návod krok za krokem nebo analytický pohled. LLM poté získávají relevantní obsah ze své znalostní báze pomocí RAG systémů, které upřednostňují zdroje na základě relevance, autority a komplexnosti. Proces získávání zohledňuje nejen přesnou shodu klíčových slov, ale také sémantickou podobnost, tematické vztahy a to, jak dobře obsah odpovídá konkrétním aspektům dotazu. To znamená, že váš obsah musí být dohledatelný nejen pro přesná klíčová slova, ale i pro sémantické koncepty a související témata, na která se uživatelé skutečně ptají.

| Faktor interpretace dotazu | Tradiční vyhledávání | LLM Meta Odpovědi |

|---|---|---|

| Způsob shody | Párování klíčových slov | Sémantické porozumění |

| Formát výsledků | Seznam odkazů | Syntetizované vyprávění |

| Výběr zdrojů | Hodnocení relevance | Relevance + komplexnost + autorita |

| Zohlednění kontextu | Omezené | Rozsáhlý sémantický kontext |

| Syntéza odpovědi | Uživatel čte více zdrojů | AI kombinuje více zdrojů |

| Požadavek na citaci | Nepovinné | Často zahrnuta |

Aby byl váš obsah vybrán a citován v LLM meta odpovědích, musí mít několik klíčových charakteristik, které odpovídají tomu, jak tyto systémy hodnotí a syntetizují informace. Za prvé, váš obsah musí jasně prokazovat odbornost a autoritu v daném tématu, se silnými signály E-E-A-T (Zkušenost, Odbornost, Autorita, Důvěryhodnost), které LLM pomáhají identifikovat spolehlivé zdroje. Za druhé, obsah by měl přinášet skutečný informační přínos – unikátní poznatky, data nebo pohledy, které přidávají hodnotu nad rámec běžně dostupného. Za třetí, váš obsah musí být strukturován tak, aby jej LLM snadno analyzovaly a získávaly z něj relevantní informace, s jasnou hierarchií a logickou organizací. Za čtvrté, sémantická bohatost je zásadní; váš obsah by měl důkladně zkoumat související koncepty, používat různorodou terminologii a budovat komplexní tematickou autoritu místo úzkého zaměření na jedno klíčové slovo. Za páté, aktuálnost je velmi důležitá zejména u současných témat, protože LLM při syntéze odpovědí upřednostňují aktuální, nejnovější informace. Nakonec by váš obsah měl zahrnovat podpůrné důkazy prostřednictvím citací, dat a externích odkazů, které budují důvěru u LLM systémů.

Klíčové charakteristiky, které zvyšují šanci na citaci LLM:

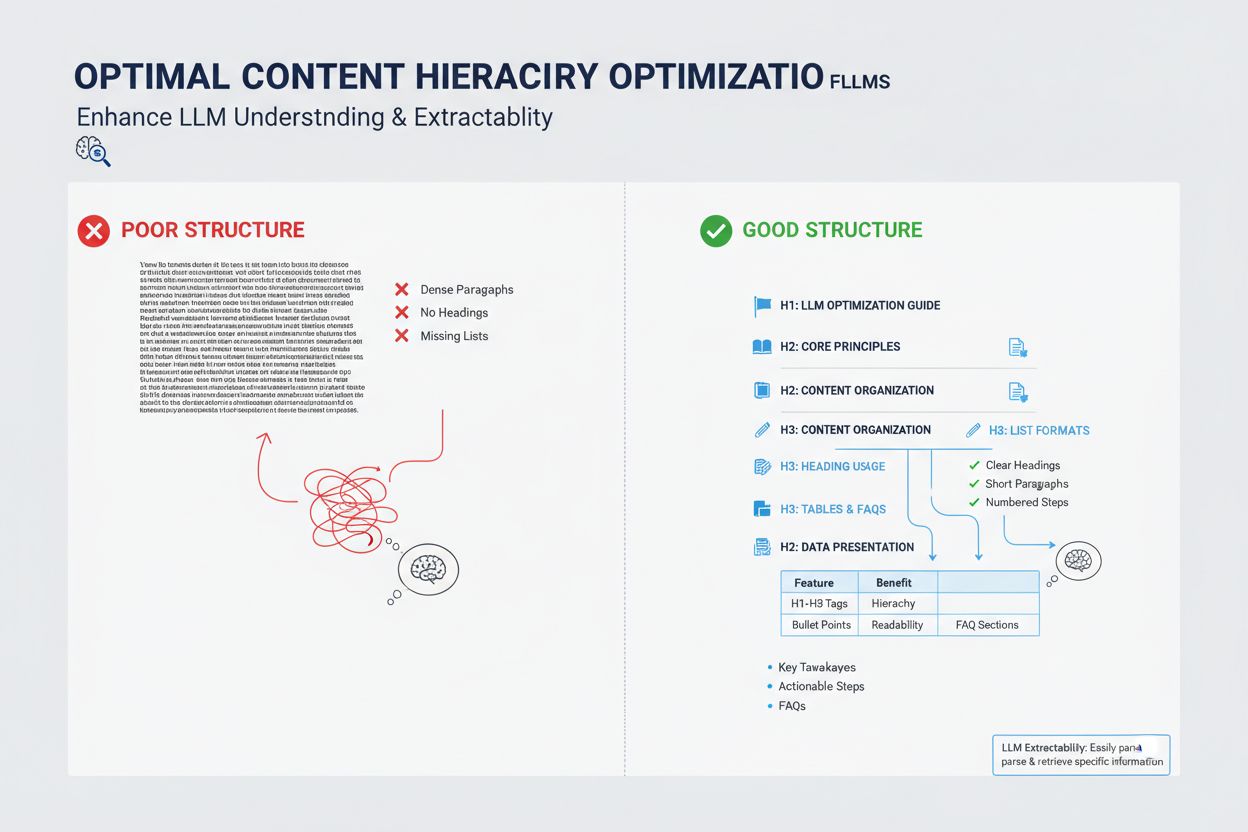

Způsob, jakým strukturuje svůj obsah, zásadně ovlivňuje, zda jej LLM vyberou pro meta odpovědi, protože tyto systémy jsou optimalizovány pro extrakci a syntézu dobře organizovaných informací. LLM výrazně upřednostňují obsah s jasnou hierarchií nadpisů (H1, H2, H3), která vytváří logickou informační architekturu, umožňující modelu pochopit vztahy mezi koncepty a efektivně získávat relevantní části. Odrážky a číslované seznamy jsou obzvláště cenné, protože prezentují informace ve snadno skenovatelných, oddělených jednotkách, které LLM snadno začlení do svých syntetizovaných odpovědí. Tabulky jsou pro LLM viditelnost mimořádně silné, protože prezentují strukturovaná data ve formátu, který AI systémy snadno analyzují a citují. Krátké odstavce (3–5 vět) fungují lépe než hutné bloky textu, protože umožňují LLM identifikovat a získat konkrétní informace bez zbytečného hledání v irelevantním obsahu. Kromě toho použití schema markup (FAQ, Article, HowTo) poskytuje LLM explicitní signály o struktuře a účelu vašeho obsahu, což výrazně zvyšuje šanci na citaci.

Ačkoli se LLM meta odpovědi a featured snippets mohou na první pohled jevit podobně, představují zásadně odlišné mechanismy viditelnosti obsahu a vyžadují odlišné optimalizační strategie. Featured snippets jsou vybírány tradičními vyhledávacími algoritmy z existujícího webového obsahu a zobrazují se na konkrétní pozici ve výsledcích vyhledávání, obvykle v rozsahu 40–60 slov extrahovaného textu. LLM meta odpovědi jsou naopak AI-generované reakce, které syntetizují informace z více zdrojů do nového, originálního vyprávění, které může být delší a komplexnější než kterýkoli samostatný zdroj. Featured snippets odměňují obsah, který přímo odpovídá na konkrétní otázku v krátké formě, zatímco LLM meta odpovědi upřednostňují komplexní, autoritativní obsah s hlubokým tematickým pokrytím. Mechanismy citace se výrazně liší: featured snippets zobrazují odkaz na zdroj, ale samotný obsah je extrahován doslova, zatímco LLM meta odpovědi mohou váš obsah parafrázovat nebo syntetizovat a typicky zahrnují přisouzení. Navíc jsou featured snippets primárně optimalizovány pro tradiční vyhledávání, zatímco LLM meta odpovědi jsou optimalizovány pro AI platformy a vůbec se nemusí ve výsledcích vyhledávání objevit.

| Aspekt | Featured Snippets | LLM Meta Odpovědi |

|---|---|---|

| Způsob generování | Algoritmus extrahuje existující text | AI syntetizuje z více zdrojů |

| Formát zobrazení | Pozice ve výsledcích vyhledávání | Odpověď AI platformy |

| Délka obsahu | Obvykle 40–60 slov | 200–500+ slov |

| Styl citace | Odkaz na zdroj s extrahovaným textem | Přisouzení s parafrázovaným obsahem |

| Optimalizační zaměření | Stručné přímé odpovědi | Komplexní autorita |

| Platforma | Google Vyhledávání | ChatGPT, Claude, Google AI Overviews |

| Metrika viditelnosti | Zobrazení ve vyhledávání | Citace v AI odpovědích |

Sémantická bohatost – hloubka a šířka konceptuálního pokrytí ve vašem obsahu – je jedním z nejdůležitějších, ale často přehlížených faktorů v optimalizaci pro LLM. LLM nehledají jen vaše cílové klíčové slovo; analyzují sémantické vztahy mezi koncepty, kontextovou informaci kolem hlavního tématu a to, jak důkladně zkoumáte související myšlenky. Obsah s vysokou sémantickou bohatostí používá různorodou terminologii, zkoumá různé úhly pohledu a buduje propojení mezi souvisejícími koncepty, což LLM pomáhá pochopit, že váš obsah je skutečně autoritativní, nikoli jen povrchově optimalizovaný na klíčová slova. Když píšete o tématu, zahrňte související termíny, synonyma a konceptuálně příbuzné myšlenky, které LLM pomohou zařadit váš obsah do širší znalostní sítě. Například článek o „content marketingu“ by měl přirozeně zahrnovat diskuse o segmentaci publika, personách, distribuci obsahu, analytice a ROI – ne proto, že byste chtěli „nacpat“ klíčová slova, ale protože tyto koncepty jsou sémanticky příbuzné a zásadní pro komplexní porozumění tématu. Tato sémantická hloubka signalizuje LLM, že máte skutečnou odbornost a můžete poskytnout takové nuancované, víceúrovňové odpovědi, jaké uživatelé hledají.

LLM posuzují autoritu jinak než tradiční vyhledávače, kladou větší důraz na signály skutečné odbornosti a důvěryhodnosti než jen na popularitu odkazů. Odborné údaje autora a doložená zkušenost jsou obzvlášť důležité; LLM upřednostňují obsah od uznávaných expertů, praktiků nebo organizací s prokázanou autoritou v oboru. Externí citace a odkazy na další autoritativní zdroje zvyšují důvěryhodnost u LLM systémů, protože dokazují, že váš obsah je ukotven ve širších znalostech a potvrzen jinými experty. Konzistence napříč více články na stejné téma pomáhá budovat tematickou autoritu; LLM rozpoznávají, když autor či organizace publikovali více komplexních materiálů na související témata. Ověření třetí stranou prostřednictvím zmínek, citací nebo odkazů od jiných autoritativních zdrojů významně zvyšuje vaši viditelnost v LLM meta odpovědích. Originální výzkum, vlastní data či unikátní metodiky jsou silné signály autority, protože představují informace, které jinde nenajdete. Dále průběžně aktualizovaná publikační historie a pravidelná údržba obsahu signalizují, že se tématu aktivně věnujete a držíte krok s vývojem.

Signály autority ovlivňující výběr LLM:

Aktuálnost obsahu je stále důležitější pro LLM viditelnost, zejména u témat, kde se informace rychle mění nebo kde novinky zásadně ovlivňují odpovědi. LLM jsou sice trénovány na datech s určitým datem uzávěrky, ale stále více využívají RAG systémy, které získávají aktuální informace z webu, což znamená, že datum publikování a frekvence aktualizací vašeho obsahu přímo ovlivňuje, zda bude vybrán pro meta odpovědi. U nadčasových témat pravidelné aktualizace – byť drobné, které obnoví datum publikace – signalizují LLM, že váš obsah je aktivně udržován a spolehlivý. U časově citlivých témat jako trendy v odvětví, technologické novinky nebo aktuální události je zastaralý obsah LLM systémy aktivně znevýhodňován ve prospěch novějších zdrojů. Nejlepším postupem je nastavit plán údržby obsahu, kdy klíčové články revidujete čtvrtletně nebo pololetně, aktualizujete statistiky, přidáváte nové příklady a zapracováváte poslední vývoj. Tato průběžná údržba nejen zlepší vaši LLM viditelnost, ale i dokazuje AI systémům a čtenářům, že jste aktuální a důvěryhodný zdroj informací.

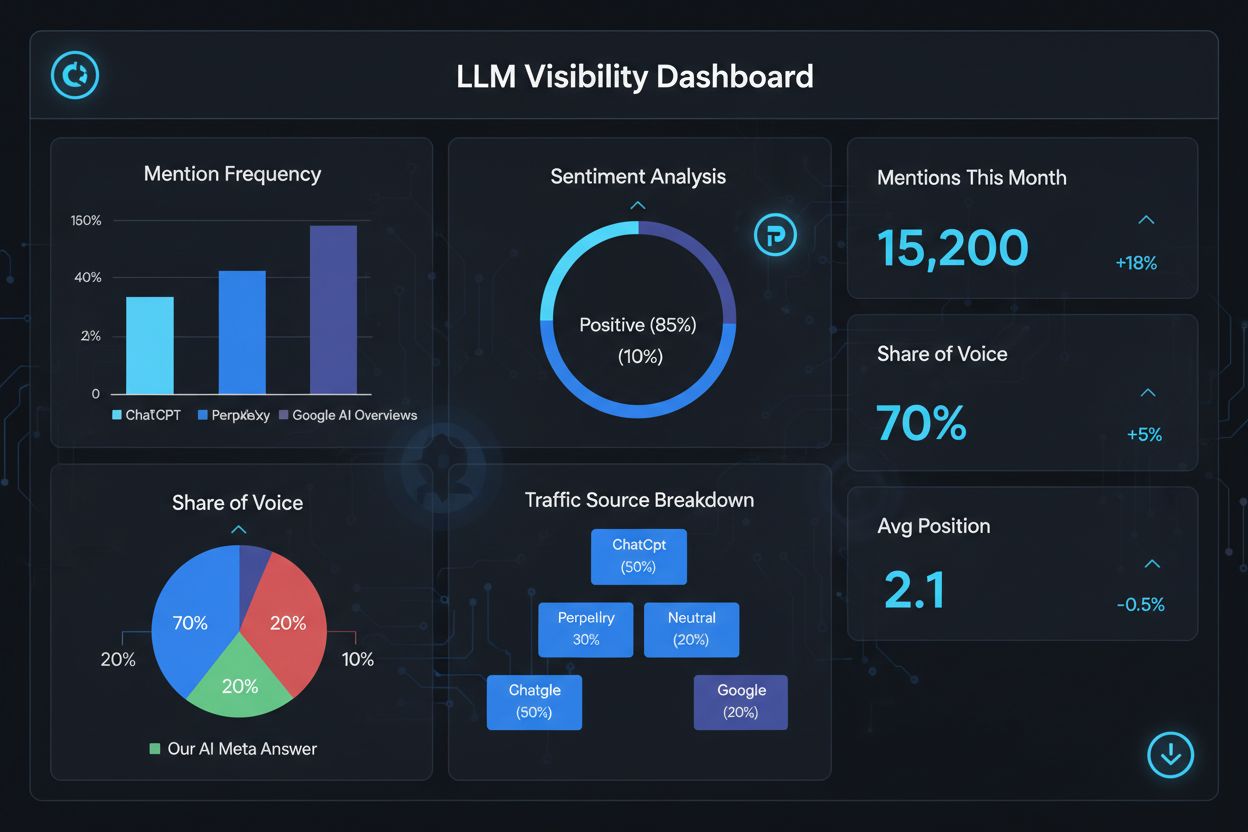

Měření úspěchu v LLM meta odpovědích vyžaduje jiné metriky a nástroje než tradiční SEO, protože tyto odpovědi existují mimo tradiční ekosystém výsledků vyhledávání. Nástroje jako AmICited.com poskytují specializovaný monitoring, který sleduje, kdy a kde se váš obsah objevuje v AI-generovaných odpovědích, díky čemuž získáte přehled, které vaše materiály jsou citovány a jak často. Měli byste sledovat několik klíčových metrik: četnost citací (jak často se váš obsah objevuje v LLM odpovědích), kontext citace (která témata způsobují zařazení vašeho obsahu), rozmanitost zdrojů (zda jste citováni napříč různými LLM platformami) a pozice odpovědi (zda je váš obsah ve výsledné odpovědi prominentní). Sledujte, které konkrétní stránky nebo sekce vašeho obsahu jsou nejčastěji citovány, protože to odhaluje, jaké informace LLM považují za nejhodnotnější a nejdůvěryhodnější. Sledujte změny v citacích v čase, abyste zjistili, která optimalizační opatření fungují a která témata je potřeba dále rozvíjet. Rovněž analyzujte dotazy, které vedou k vašim citacím, abyste pochopili, jak LLM interpretují uživatelský záměr a které sémantické varianty jsou nejefektivnější.

Klíčové metriky pro hodnocení výkonu LLM meta odpovědí:

Optimalizace pro LLM meta odpovědi vyžaduje strategický přístup kombinující technickou implementaci, kvalitu obsahu a průběžné měření. Začněte komplexním výzkumem témat, abyste identifikovali mezery, kde vaše odbornost může přinést unikátní hodnotu, kterou LLM upřednostní před generickými zdroji. Strukturu obsahu tvořte s jasnou hierarchií, používejte H2 a H3 nadpisy pro vytvoření logické informační architektury, kterou LLM snadno analyzují a extrahují. Implementujte schema markup (FAQ, Article, HowTo) pro explicitní signalizaci struktury a účelu obsahu LLM systémům, což výrazně zlepší dohledatelnost. Vytvářejte komplexní, autoritativní obsah, který zkoumá téma z více úhlů a zahrnuje související koncepty, čímž budujete sémantickou bohatost a prokazujete skutečnou odbornost. Zařaďte originální výzkum, data nebo poznatky, které přinášejí informační přínos a odlišují vás od konkurence. Nastavte pravidelný plán aktualizací, klíčové materiály obnovujte čtvrtletně, abyste zajistili aktuálnost a signalizovali trvalou autoritu. Budujte tematickou autoritu vytvářením více souvisejících článků, které společně potvrzují vaši odbornost v dané oblasti. Používejte jasný, přímý jazyk, který odpovídá na konkrétní otázky uživatelů a usnadňuje LLM extrakci a syntézu vašeho obsahu. Nakonec sledujte výkon svých citací v LLM pomocí specializovaných nástrojů, abyste zjistili, co funguje, a průběžně vylepšujte strategii na základě dat.

LLM Meta Odpovědi se zaměřují na to, jak jazykové modely interpretují a citují obsah, zatímco tradiční SEO se soustředí na pozici ve výsledcích vyhledávání. LLM upřednostňují relevanci a srozumitelnost před autoritou domény, což znamená, že dobře strukturovaný, odpověďmi orientovaný obsah je důležitější než zpětné odkazy. Váš obsah může být citován v LLM odpovědích, i když se neumisťuje na předních místech ve výsledcích Google.

Strukturovat obsah pomocí jasných nadpisů, poskytovat přímé odpovědi hned na začátku, používat schema markup (FAQ, Article), zahrnovat citace a statistiky, udržovat tematickou autoritu a zajistit, že váš web je pro AI roboty prohledatelný. Zaměřte se na sémantickou bohatost, informační přínos a komplexní pokrytí tématu spíše než na úzké cílení klíčových slov.

LLM snadněji získávají úryvky z dobře organizovaného obsahu. Jasné nadpisy, seznamy, tabulky a krátké odstavce pomáhají modelům identifikovat a citovat relevantní informace. Studie ukazují, že stránky citované LLM mají výrazně více strukturovaných prvků než průměrné webové stránky, což činí strukturu klíčovým faktorem pro hodnocení.

Ano. Na rozdíl od tradičního SEO LLM upřednostňují relevanci dotazu a kvalitu obsahu před autoritou domény. Dobře strukturovaná, vysoce relevantní stránka v úzkém oboru může být citována LLM i tehdy, pokud se neumisťuje na předních místech v Google, což činí odbornost a srozumitelnost důležitější než autoritu webu.

Obsah aktualizujte pravidelně, zejména u časově citlivých témat. Přidejte časová razítka ukazující poslední aktualizaci obsahu. U nadčasových témat se doporučují čtvrtletní kontroly. Nový obsah signalizuje LLM přesnost, zvyšuje pravděpodobnost citace a dokládá vaši trvalou odbornost.

AmICited.com se specializuje na sledování zmínek AI napříč ChatGPT, Perplexity a Google AI Overviews. Dalšími nástroji jsou Semrush AI SEO Toolkit, Ahrefs Brand Radar a Peec AI. Tyto nástroje sledují četnost zmínek, podíl hlasu, sentiment a pomáhají vám měřit úspěšnost optimalizace.

Schema markup (FAQ, Article, HowTo) poskytuje strojově čitelnou strukturu, která LLM pomáhá přesněji porozumět a získávat obsah. Signalizuje typ a záměr obsahu, díky čemuž je vaše stránka pravděpodobněji vybrána pro relevantní dotazy a zlepšuje celkovou dohledatelnost.

Externí zmínky na vysoce autoritativních webech (zpravodajství, Wikipedia, průmyslové publikace) budují důvěryhodnost a zvyšují šanci, že LLM váš obsah ocení citací. Více nezávislých zdrojů, které zmiňují vaši značku nebo data, vytváří vzorec autority, který LLM rozpoznávají a odměňují vyšší četností citací.

Sledujte, jak se vaše značka objevuje v AI-generovaných odpovědích napříč ChatGPT, Perplexity a Google AI Overviews díky specializované monitorovací platformě AmICited.

Zjistěte, jak vytvářet LLM meta odpovědi, které systémy AI citují. Objevte strukturální techniky, strategie hustoty odpovědí a formáty obsahu připravené k citac...

Zjistěte, jak optimalizovat svůj obsah pro zařazení do trénovacích dat AI. Objevte osvědčené postupy, jak učinit svůj web dohledatelný pro ChatGPT, Gemini, Perp...

Zjistěte, co je LLM Seeding a jak strategicky umisťovat obsah na platformy s vysokou autoritou, abyste ovlivnili trénink AI a byli citováni ChatGPT, Claude a da...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.