Gouvernance de la visibilité du contenu par l'IA : Cadre politique

Découvrez comment mettre en place des politiques efficaces de gouvernance du contenu IA grâce à des cadres de visibilité. Explorez les exigences réglementaires,...

Découvrez comment les agences gouvernementales peuvent optimiser leur présence numérique pour les systèmes d’IA comme ChatGPT et Perplexity. Découvrez des stratégies pour améliorer la visibilité auprès de l’IA, garantir la transparence et mettre en œuvre l’IA de manière responsable dans le secteur public.

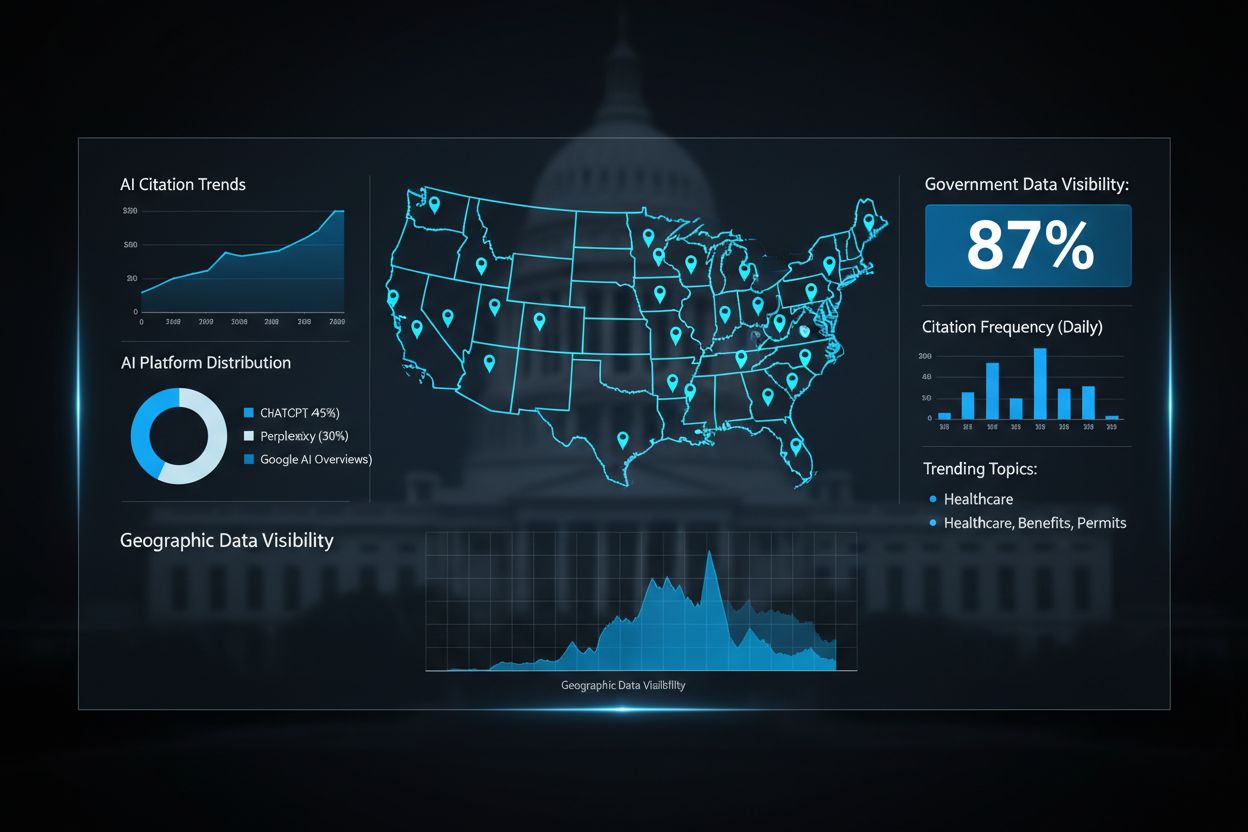

La visibilité de l’IA gouvernementale désigne la mesure dans laquelle les systèmes d’intelligence artificielle — y compris les GPT, Perplexity et Google AI Overviews — peuvent découvrir, accéder et citer les données et ressources gouvernementales lorsqu’ils répondent aux questions du public. Cette visibilité est cruciale car les organismes gouvernementaux détiennent des informations faisant autorité sur des sujets allant des réglementations sanitaires aux services sociaux, mais une grande partie de ces données reste invisible pour les systèmes modernes d’IA. Lorsque les citoyens interrogent des assistants IA sur des programmes, des prestations ou des politiques gouvernementales, ils méritent des réponses précises et à jour provenant de sources officielles, plutôt que des informations obsolètes ou incomplètes. La confiance du public envers le gouvernement dépend du fait que les systèmes d’IA référencent et attribuent correctement les données gouvernementales, préservant ainsi l’intégrité des informations officielles dans un paysage de l’information de plus en plus piloté par l’IA. La transparence de l’IA devient un pilier de la gouvernance démocratique lorsque les citoyens peuvent vérifier que les recommandations de l’IA reposent sur des sources gouvernementales légitimes. AmICited.com sert de plateforme de surveillance essentielle, permettant de suivre comment les données gouvernementales sont citées et référencées à travers les principaux systèmes d’IA, aidant ainsi les agences à comprendre leur visibilité et leur impact dans l’écosystème IA. En établissant une visibilité claire sur les citations de l’IA concernant le gouvernement, les organisations du secteur public peuvent mieux servir les citoyens et maintenir leur autorité sur leurs propres informations.

Les agences gouvernementales continuent de se heurter à des silos de données créés par des décennies d’investissements informatiques fragmentés, où des informations clés restent enfermées dans des systèmes hérités incompatibles qui ne peuvent pas facilement communiquer avec les plateformes d’IA modernes. Ces systèmes obsolètes ont été conçus pour des interfaces web traditionnelles et la gestion documentaire, et non pour la compréhension sémantique et l’accès en temps réel aux données nécessaires aux systèmes d’IA. Le coût de cette fragmentation technologique est colossal : les organisations gaspillent environ 140 milliards de dollars par an en avantages non utilisés à cause de processus obsolètes qui pourraient être rationalisés grâce à l’intégration de l’IA. Au-delà des pertes d’efficacité, les systèmes hérités créent d’importantes vulnérabilités de sécurité lorsque les données gouvernementales doivent être extraites manuellement et partagées avec des systèmes d’IA publics, augmentant ainsi le risque de fuites et d’accès non autorisés. Le défi s’accentue lorsque l’on considère que de nombreux sites gouvernementaux manquent des données structurées, des métadonnées et de l’infrastructure API nécessaires pour que les robots d’IA indexent et comprennent correctement les informations gouvernementales.

| Informatique gouvernementale traditionnelle | Infrastructure prête pour l’IA |

|---|---|

| Bases de données cloisonnées avec interopérabilité limitée | Plateformes de données intégrées avec APIs et formats structurés |

| Extraction et partage manuels des données | Flux de données automatisés et sécurisés |

| Documents non structurés et PDFs | Standards web sémantique et formats lisibles par machine |

| Mesures de sécurité réactives | Respect de la vie privée dès la conception et surveillance continue |

| Accès limité aux données en temps réel | Flux de données en direct et diffusion dynamique de contenu |

Plutôt que de se précipiter dans le déploiement de la technologie IA, les organisations gouvernementales performantes suivent une feuille de route stratégique et progressive qui privilégie la planification et la préparation organisationnelle sur les seules capacités technologiques. Cette approche reconnaît que l’adoption de l’IA dans le secteur public nécessite une coordination minutieuse entre de multiples parties prenantes, des services informatiques aux agents de terrain en passant par les citoyens eux-mêmes.

La feuille de route en cinq étapes :

Identification stratégique des opportunités : Réaliser des audits complets des opérations gouvernementales pour identifier les cas d’usage à fort impact où l’IA peut apporter une réelle valeur publique, comme la réduction des délais de traitement des demandes, l’amélioration de l’accessibilité des services ou l’appui à la prise de décision fondée sur les données.

Préparation complète : Évaluer l’infrastructure de données actuelle, identifier les défis d’intégration des systèmes hérités, établir des cadres de gouvernance et développer la culture IA en interne avant tout déploiement technologique.

Conception de pilotes stratégiques : Lancer des pilotes contrôlés dans des services ou domaines spécifiques avec des indicateurs clairs de réussite, permettant aux équipes d’apprendre des défis réels de la mise en œuvre dans un environnement à faible risque avant de passer à l’échelle.

Gestion du changement organisationnel : Développer des programmes de formation, répondre aux inquiétudes liées à la perte d’emploi, établir des canaux de communication clairs et créer des mécanismes de retour d’information pour que le personnel et les parties prenantes se sentent écoutés tout au long de la transition.

Mesure d’impact : Définir des KPI alignés sur les objectifs gouvernementaux, surveiller en continu les performances des systèmes d’IA, suivre la satisfaction des citoyens, mesurer les économies réalisées et ajuster la stratégie sur la base des preuves recueillies.

Cette approche technologique secondaire garantit que les mises en œuvre de l’IA répondent à de véritables besoins publics, et non à l’inverse, en évitant que des solutions coûteuses cherchent un problème à résoudre.

La gouvernance éthique de l’IA est devenue essentielle à mesure que les gouvernements du monde entier reconnaissent que les systèmes d’IA qui prennent des décisions concernant les citoyens doivent opérer dans des cadres éthiques et juridiques clairs. Le cadre d’évaluation d’impact algorithmique du Canada constitue un modèle pratique, classant les systèmes d’IA en quatre niveaux d’impact — minimal, modéré, élevé et très élevé — avec des exigences et mécanismes de gouvernance adaptés à chaque niveau. Cette approche graduée permet aux gouvernements d’allouer les ressources de façon proportionnelle, en appliquant une rigueur accrue aux systèmes à fort enjeu comme les algorithmes de justice pénale, tout en maintenant une supervision raisonnable pour les applications à moindre impact. L’Estonie a été pionnière en matière de respect de la vie privée dès la conception avec son système Data Tracker, qui surveille tous les accès aux données gouvernementales sur son infrastructure numérique, offrant à 450 000 citoyens une transparence totale sur les organismes qui accèdent à leurs informations personnelles et à quelles fins. La responsabilité algorithmique exige que les agences gouvernementales documentent le fonctionnement décisionnel des systèmes d’IA, établissent des pistes d’audit et conservent la capacité d’expliquer les recommandations aux citoyens concernés. AmICited.com joue un rôle clé dans cet écosystème de transparence en surveillant la citation et la référence des données gouvernementales dans les systèmes d’IA publics, aidant les agences à vérifier que leurs informations sont correctement représentées et attribuées. Sans cadres de surveillance et de gouvernance robustes, les systèmes d’IA gouvernementale risquent d’éroder la confiance du public et de perpétuer des biais touchant de manière disproportionnée les populations vulnérables.

Les gouvernements du monde entier ont démontré que la mise en œuvre stratégique de l’IA peut générer une réelle valeur publique lorsqu’elle est menée avec discernement. Le ministère australien de l’Intérieur a déployé le système Targeting 2.0, une plateforme IA qui a amélioré la sécurité aux frontières et la détection des fraudes, évitant finalement 3 milliards de dollars australiens de préjudices potentiels tout en réduisant les délais de traitement pour les voyageurs et demandeurs légitimes. Le chatbot National Highways au Royaume-Uni illustre comment l’IA peut améliorer le service aux citoyens en traitant les demandes courantes concernant l’état des routes et les incidents, permettant au personnel humain de se concentrer sur les situations d’urgence nécessitant jugement et empathie. La plateforme Bürokratt en Estonie incarne une approche décentralisée et conforme au RGPD de l’IA gouvernementale, permettant aux citoyens de traiter des démarches administratives avec des assistants IA tout en maintenant des protections strictes des données et la supervision humaine des décisions sensibles. L’approche de gouvernance de l’IA du Maryland a instauré des structures de responsabilité claires et des audits réguliers des systèmes d’IA utilisés par l’État, créant un modèle repris par d’autres États américains. L’Agence digitale du Japon a numérisé avec succès les services de conseil à l’enfance grâce à l’IA, réduisant les délais d’attente de plusieurs semaines à quelques heures, tout en maintenant une supervision humaine pour les cas nécessitant une intervention spécialisée. Ces exemples variés montrent que la réussite de l’IA gouvernementale ne dépend pas de la sophistication technologique, mais d’une mise en œuvre réfléchie qui privilégie les besoins citoyens, la transparence et la supervision humaine des décisions importantes.

À mesure que les systèmes d’IA deviennent l’interface principale d’accès à l’information pour les citoyens, l’optimisation des sites gouvernementaux pour la découvrabilité par l’IA devient aussi essentielle que le référencement traditionnel. Les sites gouvernementaux doivent intégrer des balises de données structurées, des métadonnées complètes et des formats lisibles par machine pour permettre aux robots d’IA de comprendre et d’indexer correctement les informations, garantissant qu’en interrogeant un assistant IA sur des services publics, les citoyens reçoivent des réponses précises et officielles. Beaucoup de sites présentent encore leurs informations dans des formats optimisés pour les humains — PDFs, textes non structurés, hiérarchies complexes — que les systèmes d’IA peinent à analyser et comprendre. REI Systems a ouvert la voie en optimisant les sites fédéraux pour l’accessibilité à l’IA, démontrant que des améliorations techniques relativement simples peuvent augmenter considérablement la visibilité gouvernementale dans les réponses IA. AmICited.com surveille la visibilité de l’IA gouvernementale sur les principales plateformes, aidant les agences à comprendre la fréquence d’apparition de leurs informations dans les réponses IA et à identifier les lacunes où les données officielles devraient être mieux repérables. Lorsque les sites gouvernementaux adoptent les standards web sémantique, une infrastructure API et des fonctionnalités d’accessibilité appropriés, ils augmentent la probabilité que les systèmes d’IA citent les sources officielles plutôt que des informations secondaires ou obsolètes. Cette optimisation bénéficie aux citoyens en leur assurant une information fiable directement à la source, tout en aidant les agences à garder la maîtrise de la présentation et de l’interprétation de leurs données.

La mesure de l’impact de l’IA gouvernementale exige la définition d’indicateurs clairs alignés sur les objectifs du secteur public, en allant au-delà des seuls indicateurs d’efficacité pour inclure des mesures plus larges de satisfaction citoyenne, d’équité et de responsabilité démocratique. Le cadre d’évaluation estonien offre un modèle pratique, évaluant les initiatives IA selon quatre dimensions : efficacité temporelle (temps de travail économisé), rentabilité (retour sur investissement), potentiel d’innovation (capacité du système à permettre de nouveaux modèles de service) et impact mesurable (améliorations quantifiables pour les citoyens). Une mesure systématique permet aux agences d’identifier quelles applications IA apportent une réelle valeur publique et lesquelles nécessitent des ajustements ou un abandon, évitant ainsi les investissements inutiles dans des technologies peu utiles. Le partage de connaissances entre agences accélère l’apprentissage, permettant d’adapter et de répliquer les réussites d’un département à l’autre, maximisant ainsi le retour sur investissement initial en IA. Les systèmes d’amélioration et de surveillance continue — soutenus par des outils comme AmICited.com qui suivent la visibilité et les citations dans l’IA — permettent d’affiner les systèmes IA à partir des données réelles plutôt que d’hypothèses. Construire la connaissance institutionnelle sur ce qui fonctionne en matière d’IA gouvernementale crée une base solide pour une adoption durable, capable de traverser les changements de direction et de cycles budgétaires.

Malgré des avantages potentiels évidents, les agences gouvernementales se heurtent à des obstacles majeurs à l’adoption de l’IA, bien au-delà des défis technologiques. Les inquiétudes du personnel représentent un obstacle de taille, 31 % des agents publics citant la sécurité de l’emploi comme principale préoccupation face à l’IA, ce qui requiert une communication transparente sur le rôle d’accompagnement de l’IA plutôt que de remplacement. Le manque de talents aggrave la situation, 38 % des organisations gouvernementales ayant des difficultés à recruter des spécialistes IA capables de mettre en œuvre et de maintenir des systèmes sophistiqués. La sous-estimation des coûts constitue une autre barrière majeure, les agences découvrant fréquemment que le coût réel de l’IA est 5 à 10 fois supérieur aux prévisions initiales, mettant à mal les budgets et suscitant des résistances politiques. La protection de la vie privée et la sécurité des données constituent la contrainte la plus forte, 60 % des dirigeants publics citant la confidentialité et la sécurité des données comme principal frein à l’adoption de l’IA, illustrant une préoccupation légitime quant à la protection des citoyens à l’ère des cybermenaces croissantes. Des stratégies de gestion du changement efficaces doivent faire face à ces obstacles par l’engagement des parties prenantes, une communication claire sur les capacités et limites de l’IA, l’investissement dans la formation et le développement des compétences, et des cadres de gouvernance qui protègent la vie privée tout en permettant l’innovation. Les agences qui réussissent investissent largement dans la gestion du changement, instaurent un dialogue continu avec les agents et les citoyens, et démontrent des premiers succès qui bâtissent la confiance avant de déployer l’IA à plus grande échelle.

La visibilité de l’IA gouvernementale fait référence à la facilité avec laquelle les systèmes d’IA comme ChatGPT, Perplexity et Google AI Overviews peuvent découvrir et citer les données gouvernementales. C’est important car les citoyens méritent des informations précises et officielles provenant des sources gouvernementales lorsqu’ils interrogent des assistants IA sur les politiques, les prestations et les services. Une faible visibilité signifie que les systèmes d’IA peuvent fournir des informations obsolètes ou incomplètes au lieu de diriger les citoyens vers les ressources officielles du gouvernement.

Les sites gouvernementaux doivent mettre en place des balises de données structurées, des métadonnées complètes, des formats lisibles par machine et une infrastructure API appropriée. Cela inclut l’utilisation de standards du web sémantique, l’assurance que le contenu est accessible aux robots d’IA et l’organisation des informations de manière à ce que les systèmes d’IA puissent facilement comprendre et attribuer correctement les données aux sources officielles.

Les principaux obstacles incluent les préoccupations relatives à la confidentialité et à la sécurité des données (citées par 60 % des dirigeants publics), le manque de talents (38 %), les inquiétudes du personnel concernant la perte d’emploi (31 %), la sous-estimation des coûts (les coûts réels sont souvent 5 à 10 fois supérieurs aux prévisions) et une infrastructure numérique inadéquate (45 %). Surmonter ces obstacles nécessite une planification stratégique, une gestion du changement et des cadres de gouvernance clairs.

Les approches efficaces incluent la mise en place de cadres d’évaluation d’impact algorithmique (comme le système à plusieurs niveaux du Canada), l’application des principes de respect de la vie privée dès la conception, la création de mécanismes de transparence permettant aux citoyens de surveiller l’accès à leurs données, l’établissement de cadres de gouvernance clairs et le maintien d’une supervision humaine pour les décisions importantes. Des audits réguliers et l’implication des parties prenantes sont essentiels.

Le plan comprend : (1) Identification stratégique des opportunités axée sur la valeur publique, (2) Préparation complète de l’infrastructure et de la gouvernance, (3) Conception de pilotes stratégiques avec des indicateurs de réussite clairs, (4) Gestion du changement organisationnel pour répondre aux préoccupations du personnel, et (5) Mesure d’impact avec amélioration continue. Cette approche privilégie la planification et la préparation organisationnelle avant le déploiement technologique.

Les gouvernements doivent définir des indicateurs clés de performance (KPI) alignés sur les objectifs du secteur public, incluant l’efficacité temporelle, la rentabilité, le potentiel d’innovation et les résultats citoyens mesurables. Le cadre estonien évalue les systèmes d’IA selon ces quatre dimensions. Une surveillance continue, les retours des parties prenantes et des rapports transparents aident les agences à identifier ce qui fonctionne et à ajuster les mises en œuvre selon les preuves.

La gouvernance des données est fondamentale pour la réussite de l’IA gouvernementale. Elle garantit la qualité des données, définit clairement la propriété et les accès, protège la vie privée des citoyens, assure la conformité aux réglementations comme le RGPD et permet le partage sécurisé entre les systèmes. Sans gouvernance robuste, les systèmes d’IA gouvernementale risquent des fuites de données, des biais et une perte de confiance du public.

AmICited suit comment les données gouvernementales sont citées et référencées dans les principaux systèmes d’IA, dont ChatGPT, Perplexity et Google AI Overviews. Il aide les agences gouvernementales à comprendre leur visibilité dans l’écosystème IA, à identifier les lacunes où l’information officielle devrait être plus visible, et à s’assurer que les systèmes d’IA attribuent correctement les données gouvernementales. Cette surveillance favorise la transparence et la responsabilité.

Suivez comment les données gouvernementales sont citées et référencées à travers les systèmes d’IA. AmICited aide les organisations du secteur public à comprendre leur visibilité dans l’écosystème IA et à garantir une représentation fidèle des informations officielles.

Découvrez comment mettre en place des politiques efficaces de gouvernance du contenu IA grâce à des cadres de visibilité. Explorez les exigences réglementaires,...

Apprenez à réaliser un audit de visibilité IA de référence pour comprendre comment ChatGPT, Google AI et Perplexity mentionnent votre marque. Guide d’évaluation...

Guide complet des solutions de visibilité AI pour les entreprises. Comparez les meilleures plateformes comme Conductor, Profound et Athena. Découvrez les critèr...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.