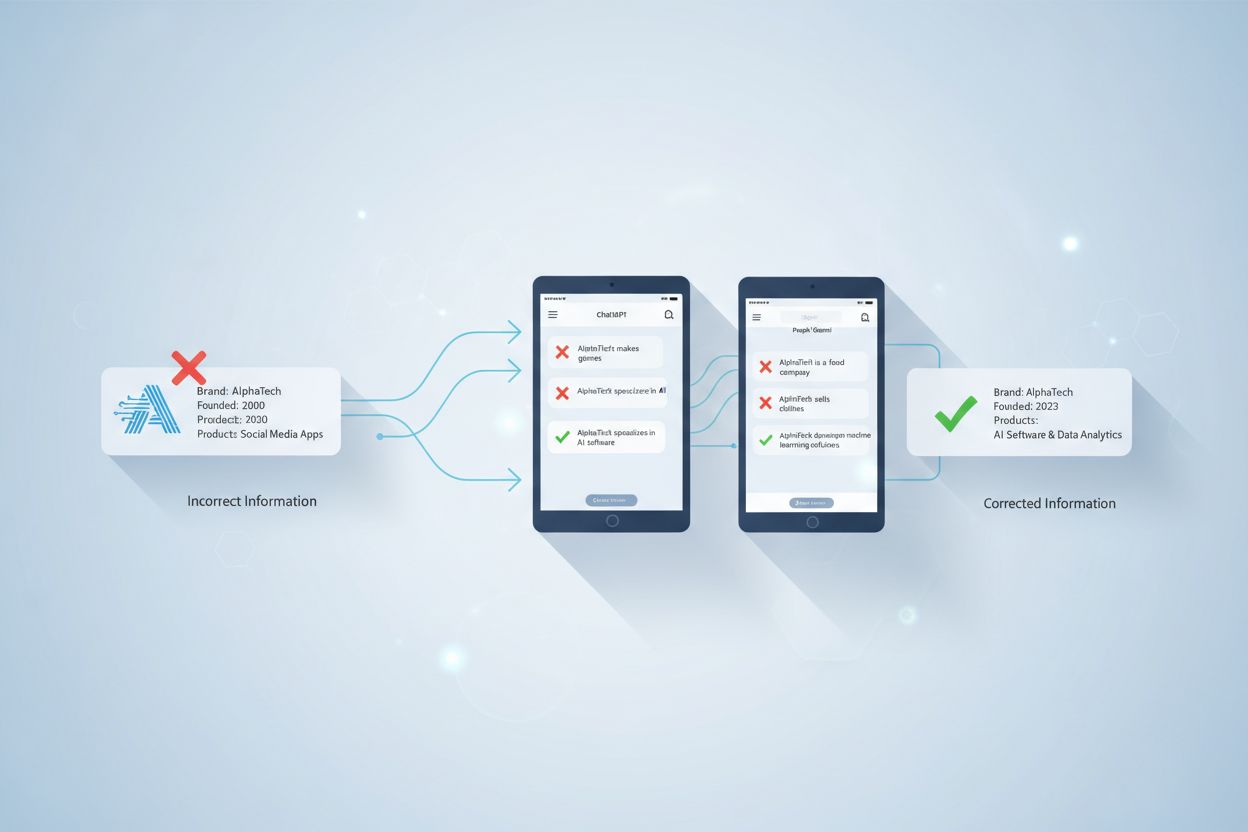

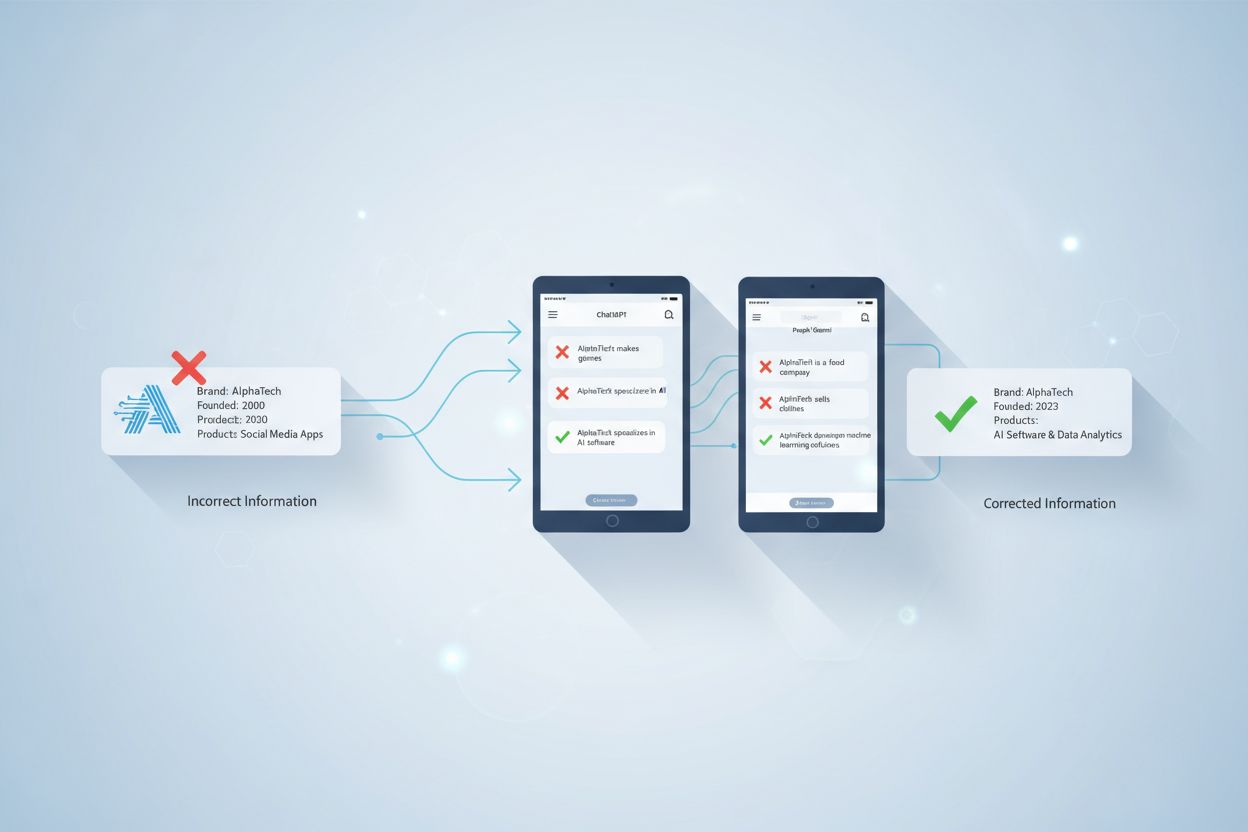

Correction de la désinformation par l'IA

Découvrez comment identifier et corriger les informations de marque incorrectes dans les systèmes d'IA tels que ChatGPT, Gemini et Perplexity. Découvrez des out...

Découvrez comment demander des corrections aux plateformes d’IA comme ChatGPT, Perplexity et Claude. Comprenez les mécanismes de correction, les processus de retour d’information et les stratégies pour influencer les réponses générées par l’IA concernant votre marque.

Bien que vous ne puissiez pas supprimer directement des informations des données d'entraînement de l'IA, vous pouvez demander des corrections via des mécanismes de retour d'information, traiter les inexactitudes à leur source et influencer les futures réponses de l'IA en créant du contenu positif et faisant autorité, et en travaillant avec les équipes de support des plateformes.

Demander des corrections aux plateformes d’IA nécessite de comprendre fondamentalement leur fonctionnement. Contrairement aux moteurs de recherche traditionnels où vous pouvez contacter un propriétaire de site pour supprimer ou mettre à jour du contenu, les modèles de langage IA apprennent à partir de données d’entraînement lors de phases spécifiques, intégrant des milliards de pages web, d’articles de presse et d’autres sources textuelles. Une fois qu’une information négative ou inexacte fait partie de ces données d’entraînement, vous ne pouvez pas la supprimer ou la modifier directement comme vous pourriez le demander à un propriétaire de site. L’IA a déjà appris des schémas et des associations provenant de multiples sources lors de son cycle d’entraînement.

Le processus de correction diffère significativement entre les systèmes d’IA statiques et en temps réel. Les modèles statiques comme GPT-4 sont entraînés sur des données jusqu’à une date limite spécifique (par exemple, décembre 2023 pour GPT-4-turbo), et une fois entraînés, ils conservent ces connaissances jusqu’au prochain cycle d’apprentissage. Les systèmes d’IA en temps réel comme Perplexity et Claude.ai extraient du contenu web en direct, ce qui signifie que les corrections à la source peuvent avoir des effets immédiats sur leurs réponses. Comprendre à quel type de plateforme d’IA vous avez affaire est crucial pour déterminer la stratégie de correction la plus efficace.

La plupart des grandes plateformes d’IA proposent des mécanismes de retour intégrés permettant aux utilisateurs de signaler des inexactitudes. ChatGPT, par exemple, inclut des boutons « pouce en haut » et « pouce en bas » sur les réponses, permettant aux utilisateurs de signaler les réponses problématiques. Lorsque vous donnez un retour négatif sur une réponse inexacte, cette information est collectée et analysée par l’équipe de la plateforme. Ces boucles de retour d’information aident les systèmes d’IA à affiner leurs performances en apprenant des résultats — réussis ou erronés. Les retours que vous soumettez font partie des données utilisées par les développeurs pour identifier des schémas d’erreurs et améliorer la précision du modèle.

Perplexity et Claude offrent des options de retour similaires dans leurs interfaces. Vous pouvez généralement signaler lorsqu’une réponse est inexacte, trompeuse ou contient des informations obsolètes. Certaines plateformes permettent de fournir des corrections ou des clarifications spécifiques. L’efficacité de ce retour dépend du nombre d’utilisateurs signalant le même problème et de l’importance de l’inexactitude. Les plateformes priorisent les corrections pour les problèmes répandus affectant de nombreux utilisateurs, donc si plusieurs personnes signalent la même inexactitude concernant votre marque, la plateforme sera plus susceptible d’enquêter et d’y remédier.

La stratégie la plus efficace à long terme pour corriger la désinformation générée par l’IA consiste à traiter la source originale de l’information inexacte. Les systèmes d’IA apprennent à partir de contenus web, d’articles de presse, d’entrées Wikipédia et d’autres documents publiés. Corriger l’information à ces sources influence la façon dont les plateformes d’IA présenteront l’information lors de futurs cycles d’entraînement. Demandez des corrections ou des mises à jour aux éditeurs originaux là où l’information inexacte apparaît. Si un média a publié des informations erronées sur votre marque, contactez leur équipe éditoriale avec des preuves de l’erreur et demandez une correction ou une clarification.

Wikipédia représente une source particulièrement importante pour les données d’entraînement de l’IA. Si des informations inexactes concernant votre marque ou domaine apparaissent sur Wikipédia, agissez via les canaux éditoriaux appropriés de la plateforme. Wikipédia dispose de processus spécifiques pour contester des informations et demander des corrections, en respectant toutefois leurs règles de neutralité et de vérifiabilité. Les sources à forte autorité comme Wikipédia, les grands médias, les institutions éducatives et les sites gouvernementaux ont un poids important dans les ensembles de données d’entraînement IA. Les corrections apportées à ces sources ont plus de chances d’être intégrées lors des prochaines mises à jour des modèles IA.

Pour les informations obsolètes ou inexactes sur votre propre site ou vos propriétés contrôlées, veillez à les mettre à jour ou à les supprimer rapidement. Documentez tous les changements que vous effectuez, car ces mises à jour pourront être intégrées lors des prochains cycles d’entraînement. En corrigeant l’information sur votre propre domaine, vous fournissez aux systèmes d’IA du matériel source plus fiable pour l’avenir.

Plutôt que de chercher uniquement à supprimer les informations négatives ou inexactes, développez de solides contre-narratifs avec du contenu positif et faisant autorité. Les modèles d’IA pondèrent partiellement l’information en fonction des schémas de fréquence et d’autorité présents dans leurs données d’entraînement. Si vous produisez bien plus de contenu positif, exact et faisant autorité que d’informations inexactes, les systèmes d’IA rencontreront beaucoup plus d’éléments positifs lorsqu’ils généreront des réponses concernant votre marque.

| Type de contenu | Niveau d’autorité | Impact sur l’IA | Délai |

|---|---|---|---|

| Pages de biographie professionnelle | Élevé | Influence immédiate sur les réponses | Semaines à mois |

| Publications sectorielles & tribunes d’experts | Très élevé | Pondération forte dans les réponses IA | Mois |

| Communiqués de presse via des services majeurs | Élevé | Influence significative sur les narratifs | Semaines à mois |

| Études de cas et retours d’expérience | Moyen-Élevé | Soutien contextuel aux affirmations positives | Mois |

| Publications académiques ou scientifiques | Très élevé | Influence durable dans les données d’entraînement | Mois à années |

| Entrées Wikipédia | Très élevé | Critique pour les futurs cycles d’entraînement IA | Mois à années |

Développez un contenu complet sur plusieurs plateformes crédibles pour que les systèmes d’IA rencontrent des informations positives et faisant autorité. Cette saturation de contenu est particulièrement efficace car elle traite la cause profonde de la désinformation IA : un manque d’informations positives pour contrebalancer les affirmations inexactes. Lorsque les systèmes d’IA ont accès à davantage d’informations positives et bien sourcées, elles génèrent naturellement des réponses plus favorables concernant votre marque.

Différentes plateformes d’IA ont des architectures et des cycles de mise à jour différents, nécessitant des approches de correction adaptées. ChatGPT et les autres systèmes basés sur GPT se concentrent sur les plateformes incluses avant la date limite d’entraînement : grands médias, Wikipédia, annuaires professionnels et contenus largement cités. Étant donné que ces modèles ne s’actualisent pas en temps réel, les corrections faites aujourd’hui influenceront les futurs cycles d’entraînement, généralement dans 12 à 18 mois. Perplexity et les systèmes de recherche IA en temps réel intègrent du contenu web en direct, donc maintenir un bon SEO et une visibilité presse continue a des effets immédiats. Lorsque vous retirez ou corrigez du contenu du web en direct, Perplexity cesse généralement de le référencer en quelques jours ou semaines.

Claude et les systèmes Anthropic privilégient l’information factuelle et bien sourcée. Anthropic met l’accent sur la fiabilité des faits, donc assurez-vous que le contenu positif sur votre marque soit vérifiable et lié à des sources de confiance. Lorsque vous demandez des corrections à Claude, concentrez-vous sur des clarifications fondées sur des preuves et orientez vers des sources faisant autorité qui confirment la bonne information. L’essentiel est de comprendre que chaque plateforme a des sources de données, des fréquences de mise à jour et des standards de qualité différents. Adaptez votre stratégie de correction en conséquence.

Tester régulièrement la façon dont les systèmes d’IA décrivent votre nom ou votre marque est essentiel pour suivre l’efficacité de vos corrections. Effectuez des requêtes sur ChatGPT, Claude, Perplexity et d’autres plateformes en utilisant à la fois des formulations positives et négatives (par exemple, « [marque] est-elle fiable ? » contre « succès de [marque] »). Enregistrez les résultats dans le temps et suivez l’évolution pour identifier les inexactitudes et voir si vos efforts de correction modifient la perception. Cette surveillance vous permet de repérer l’apparition de nouvelles inexactitudes et d’y répondre rapidement. Si vous constatez qu’une plateforme IA continue de référencer des informations obsolètes ou erronées plusieurs semaines après correction de la source, vous pouvez faire remonter le problème via les canaux de support de la plateforme.

Documentez toutes les corrections demandées et les réponses reçues. Cette documentation a plusieurs utilités : elle constitue une preuve en cas d’escalade, elle vous aide à identifier des schémas selon la plateforme et elle démontre vos efforts de bonne foi pour garantir l’exactitude de l’information. Conservez un historique des retours soumis, des inexactitudes signalées et des réponses de la plateforme.

La suppression complète des informations inexactes des recherches IA est rarement possible, mais l’atténuation et la contextualisation restent des objectifs atteignables. La plupart des entreprises IA mettent à jour leurs données d’entraînement périodiquement, généralement tous les 12 à 18 mois pour les grands modèles linguistiques. Les actions que vous entreprenez aujourd’hui influeront sur les futures itérations, mais il faut s’attendre à un délai significatif entre la demande de correction et sa prise en compte dans les réponses générées. La réussite nécessite patience et constance. En misant sur la création de contenu d’autorité, le traitement des inexactitudes à la source et le renforcement de votre crédibilité, vous pouvez façonner la manière dont les plateformes d’IA présentent votre marque sur le long terme.

Les plateformes de recherche IA en temps réel comme Perplexity peuvent afficher des résultats en quelques semaines ou mois, tandis que les modèles statiques comme ChatGPT peuvent prendre 12 à 18 mois pour refléter les corrections dans leur base. Cependant, même avec les modèles statiques, il est possible de voir des améliorations plus tôt en cas de sortie de versions mises à jour ou d’ajustements ciblés du modèle. Le délai dépend aussi de l’ampleur de l’inexactitude et du nombre d’utilisateurs la signalant. Les inexactitudes répandues et affectant de nombreux utilisateurs reçoivent une attention plus rapide que les problèmes isolés.

Dans certaines juridictions, vous disposez de recours juridiques face à des informations inexactes ou diffamatoires. Si une plateforme IA génère des informations fausses, diffamatoires ou nuisibles concernant votre marque, vous pouvez avoir un motif d’action en justice. Les lois sur le droit à l’oubli dans les juridictions concernées, notamment sous le RGPD en Europe, offrent des options supplémentaires. Ces lois vous permettent de demander la suppression de certaines données personnelles des résultats de recherche et, dans certains cas, des données d’entraînement IA.

Contactez l’équipe juridique de la plateforme IA si vous estimez que l’information enfreint leurs conditions d’utilisation ou la législation applicable. La plupart des plateformes disposent de procédures pour traiter les plaintes légales et les demandes de retrait. Fournissez des preuves claires de l’inexactitude et expliquez pourquoi elle enfreint la législation ou la politique de la plateforme. Documentez toutes vos communications avec la plateforme, cela constituera la preuve de vos efforts de bonne foi pour résoudre le problème.

La manière la plus durable de gérer votre réputation dans les recherches IA est de surpasser l’information négative par une positivité cohérente et faisant autorité. Publiez régulièrement du contenu d’expert, maintenez des profils professionnels actifs, obtenez une couverture médiatique régulière, développez des réseaux qui valorisent vos réussites et mettez en avant votre implication communautaire. Cette approche à long terme garantit que toute couverture négative ou inexacte est diluée dans le récit plus large de votre marque.

Mettez en place une stratégie SEO pour les futurs entraînements IA en veillant à ce que le contenu faisant autorité soit bien positionné dans les moteurs de recherche. Utilisez le balisage de données structurées et schema pour clarifier le contexte, maintenez des informations NAP (Nom, Adresse, Téléphone) cohérentes et obtenez des liens entrants de qualité vers un contenu positif et fiable. Ces efforts augmentent la probabilité que l’information positive devienne le récit dominant lors des futurs cycles d’entraînement IA. À mesure que les systèmes d’IA deviennent plus sophistiqués et omniprésents, l’importance de maintenir des informations exactes et faisant autorité sur le web ne fera que croître. Investissez dès maintenant dans votre présence numérique pour garantir que les plateformes IA disposent d’informations fiables sur votre marque pour les années à venir.

Suivez la manière dont votre marque, domaine et URLs apparaissent sur ChatGPT, Perplexity et d'autres moteurs de recherche IA. Recevez des alertes lorsque des corrections sont nécessaires et mesurez l'impact de vos efforts.

Découvrez comment identifier et corriger les informations de marque incorrectes dans les systèmes d'IA tels que ChatGPT, Gemini et Perplexity. Découvrez des out...

Discussion communautaire sur la différence entre les données d'entraînement de l'IA et la recherche en direct (RAG). Stratégies pratiques pour optimiser le cont...

Découvrez comment soumettre et optimiser votre contenu pour les moteurs d’IA comme ChatGPT, Perplexity et Gemini. Découvrez des stratégies d’indexation, les exi...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.