Solutions de visibilité AI pour les entreprises : choisir la bonne plateforme

Guide complet des solutions de visibilité AI pour les entreprises. Comparez les meilleures plateformes comme Conductor, Profound et Athena. Découvrez les critèr...

La stratégie de visibilité de l’IA d’entreprise désigne l’approche globale mise en œuvre par les organisations pour surveiller, suivre et comprendre l’ensemble des systèmes, modèles et applications d’intelligence artificielle qui fonctionnent au sein de leur infrastructure. Cette stratégie englobe la capacité à identifier les systèmes d’IA utilisés, leurs performances, les utilisateurs impliqués, ainsi que les risques associés à l’échelle de toute l’organisation. Pour les grandes entreprises qui gèrent des centaines voire des milliers de déploiements d’IA, la visibilité est cruciale, car l’IA fantôme — des outils d’IA non autorisés ou non documentés — peut proliférer rapidement sans supervision adéquate. Sans visibilité globale, il est impossible d’assurer la conformité, de gérer les risques, d’optimiser la performance ou de tirer une valeur maximale des investissements en IA.

La stratégie de visibilité de l’IA d’entreprise désigne l’approche globale mise en œuvre par les organisations pour surveiller, suivre et comprendre l’ensemble des systèmes, modèles et applications d’intelligence artificielle qui fonctionnent au sein de leur infrastructure. Cette stratégie englobe la capacité à identifier les systèmes d’IA utilisés, leurs performances, les utilisateurs impliqués, ainsi que les risques associés à l’échelle de toute l’organisation. Pour les grandes entreprises qui gèrent des centaines voire des milliers de déploiements d’IA, la visibilité est cruciale, car l’IA fantôme — des outils d’IA non autorisés ou non documentés — peut proliférer rapidement sans supervision adéquate. Sans visibilité globale, il est impossible d’assurer la conformité, de gérer les risques, d’optimiser la performance ou de tirer une valeur maximale des investissements en IA.

La stratégie de visibilité de l’IA d’entreprise désigne l’approche globale mise en œuvre par les organisations pour surveiller, suivre et comprendre l’ensemble des systèmes, modèles et applications d’intelligence artificielle qui fonctionnent au sein de leur infrastructure. Cette stratégie englobe la capacité à identifier les systèmes d’IA utilisés, leurs performances, les utilisateurs impliqués, ainsi que les risques associés à l’échelle de toute l’organisation. Pour les grandes entreprises qui gèrent des centaines voire des milliers de déploiements d’IA, la visibilité devient cruciale, car l’IA fantôme — des outils d’IA non autorisés ou non documentés — peut proliférer rapidement sans supervision adéquate. Le défi s’accentue à grande échelle, où 85 % des entreprises utilisent aujourd’hui l’IA d’une manière ou d’une autre, mais seulement 11 % déclarent une valeur métier claire, ce qui révèle un écart significatif entre le déploiement et la gestion efficace. Sans visibilité globale, il est impossible d’assurer la conformité, de gérer les risques, d’optimiser la performance ou de tirer une valeur maximale des investissements en IA.

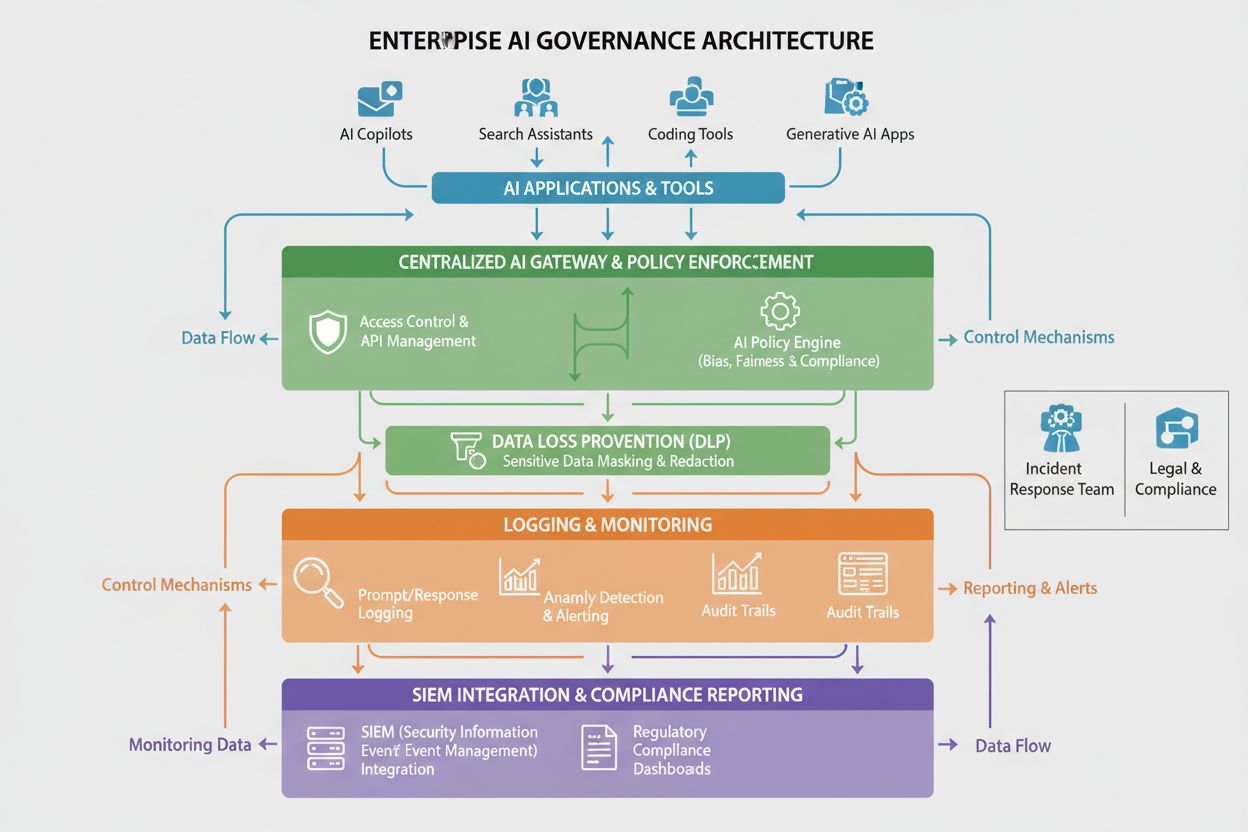

La visibilité de l’IA d’entreprise s’exerce selon trois dimensions interdépendantes qui, ensemble, offrent une connaissance complète de l’ensemble des systèmes IA et de leur impact organisationnel. La première dimension, la surveillance d’utilisation, consiste à suivre quels systèmes IA sont déployés, qui y accède, à quelle fréquence et à quelles fins métiers. La seconde, la surveillance de la qualité, vise à s’assurer que les modèles IA remplissent leur mission, maintiennent des standards de précision et ne se dégradent pas au fil du temps (dérive des données ou vieillissement des modèles). La troisième, la surveillance de la sécurité, protège contre les accès non autorisés, les fuites de données, les attaques par injection de prompt et garantit le respect des exigences réglementaires. Ces trois dimensions doivent fonctionner de concert, soutenues par une journalisation centralisée, des tableaux de bord en temps réel et des systèmes d’alerte automatisés. Les organisations qui mettent en œuvre une visibilité complète sur ces trois axes constatent une bien meilleure gouvernance et des temps de réponse aux incidents plus courts.

| Dimension | Objectif | Indicateurs clés |

|---|---|---|

| Surveillance d’utilisation | Suivi du déploiement et des usages des systèmes IA | Utilisateurs actifs, appels API, versions de modèles, adoption par unité métier |

| Surveillance de la qualité | Garantie des performances et de la fiabilité des modèles | Précision, rappel, dérive de prédiction, latence |

| Surveillance de la sécurité | Protection contre les menaces et respect de la conformité | Journaux d’accès, anomalies détectées, violations de politiques, pistes d’audit |

Les organisations rencontrent de nombreux obstacles lorsqu’elles cherchent à instaurer une visibilité globale sur l’IA dans des environnements vastes et complexes. L’IA fantôme représente peut-être le plus grand défi : des collaborateurs ou départements déploient des outils IA sans l’accord ni la connaissance de la DSI, créant des angles morts qui empêchent la surveillance et la gouvernance centralisées. Les silos de données fragmentent l’information entre les départements, rendant impossible la corrélation des usages IA ou l’identification des doublons et du gaspillage de ressources. La complexité d’intégration survient lorsque la visibilité doit se connecter à des systèmes existants, plateformes cloud et frameworks IA divers qui n’ont pas été conçus pour la supervision. La fragmentation réglementaire impose des standards de visibilité différents selon les zones géographiques, générant une complexité de conformité qui nécessite une infrastructure de surveillance flexible et adaptable. De plus, 84 % des responsables IT déclarent ne pas disposer d’un processus de gouvernance formel, et 72 % des organisations signalent des problèmes de qualité des données qui compromettent la fiabilité même des métriques de visibilité.

Les principaux défis de visibilité sont notamment :

Une visibilité efficace de l’IA d’entreprise requiert une cohérence avec des cadres de gouvernance et des standards reconnus, qui structurent et légitiment les efforts de surveillance. Le NIST AI Risk Management Framework (RMF) propose une approche complète pour identifier, mesurer et gérer les risques liés à l’IA, servant de base aux exigences de visibilité pour toutes les fonctions de l’organisation. ISO/IEC 42001 définit des standards internationaux pour les systèmes de management de l’IA, incluant des exigences de surveillance, documentation et amélioration continue alignées avec les objectifs de visibilité. L’EU AI Act impose des exigences strictes de transparence et de documentation pour les systèmes IA à haut risque, obligeant à tenir des registres détaillés du comportement et des décisions des IA. Des cadres sectoriels ajoutent des contraintes supplémentaires : les services financiers doivent répondre aux attentes des régulateurs bancaires, la santé doit satisfaire les exigences de la FDA pour les systèmes IA cliniques, et le secteur public suivre les directives fédérales de gouvernance IA. Les organisations doivent choisir les cadres adaptés à leur secteur, zone géographique et profil de risque, puis bâtir une infrastructure de visibilité démontrant leur conformité.

La mise en œuvre d’une visibilité de l’IA d’entreprise repose sur une base technique robuste, permettant de collecter, traiter et présenter les données sur le comportement et la performance des systèmes IA. Les plateformes IA centralisées constituent la colonne vertébrale de cette infrastructure, offrant une vue d’ensemble sur tous les systèmes IA, quel que soit leur lieu de déploiement. Les passerelles IA servent d’intermédiaires entre les applications et les services IA, capturant des métadonnées sur chaque requête et réponse, ce qui permet un suivi détaillé des usages et une surveillance de la sécurité. Les systèmes de journalisation complets enregistrent toutes les activités des systèmes IA, les prédictions des modèles, les interactions utilisateurs et les métriques de performance dans des référentiels centraux, pour soutenir les pistes d’audit et l’analyse forensic. Les outils de Data Loss Prevention (DLP) surveillent les systèmes IA pour détecter les tentatives d’exfiltration de données sensibles, évitant que les modèles ne soient entraînés sur des informations confidentielles ou ne restituent des données protégées. L’intégration SIEM relie les données de visibilité de l’IA aux systèmes de gestion des événements et informations de sécurité de l’organisation, permettant de corréler les incidents IA avec d’autres menaces. Les organisations dotées de ces composants techniques constatent une réduction de 30 % du temps de réponse aux incidents liés à l’IA. Des plateformes comme Liminal, Ardoq et Knostic fournissent des solutions axées sur la gouvernance et la visibilité, tandis que AmICited.com se spécialise dans la surveillance de la qualité des réponses IA sur GPTs, Perplexity et Google AI Overviews.

La réussite d’une visibilité de l’IA d’entreprise dépend de structures organisationnelles claires et de la définition de rôles qui répartissent la responsabilité de la surveillance et de la gouvernance dans toute l’organisation. Un Comité de gouvernance de l’IA fait généralement office d’instance exécutive pour piloter la stratégie de visibilité, fixer des politiques et assurer la cohérence avec les objectifs métiers et réglementaires. Les propriétaires de modèles sont responsables de systèmes IA spécifiques, veillant à leur documentation, à leur surveillance et à leur maintenance selon les standards internes. Les champions IA intégrés dans les unités métiers servent de relais entre les équipes IT de gouvernance et les utilisateurs, promouvant les bonnes pratiques de visibilité et détectant l’IA fantôme avant qu’elle ne devienne incontrôlable. Les data stewards assurent la qualité et l’accessibilité des données servant à entraîner et surveiller les IA, garantissant ainsi la fiabilité des indicateurs de visibilité. Les équipes sécurité et conformité définissent les exigences de monitoring, réalisent des audits et assurent l’adéquation de l’infrastructure de visibilité avec les obligations réglementaires. Des structures de responsabilité claires évitent que la visibilité ne soit perçue comme une tâche purement IT, et en font un engagement partagé entre fonctions métier, techniques et de gouvernance.

Les organisations doivent instaurer des indicateurs clés de performance (KPI) et des cadres de mesure pour évaluer si leur stratégie de visibilité IA apporte de la valeur et soutient les objectifs de l’organisation. La couverture de visibilité mesure le pourcentage de systèmes IA documentés et surveillés, les entreprises matures visant plus de 95 % de couverture. La maturité de la gouvernance suit la progression à travers différentes étapes (de la surveillance ad hoc à des processus standardisés puis à une gouvernance automatisée et optimisée), à l’aide de cadres comme CMMI adaptés à la gouvernance IA. Les indicateurs de détection et réponse aux incidents mesurent la rapidité d’identification et de résolution des incidents liés à l’IA, les améliorations de délai indiquant une visibilité plus efficace. Le respect de la conformité suit la part des systèmes IA conformes aux règlementations et standards internes, les résultats d’audit et délais de remédiation servant de métriques clés. La création de valeur pour l’entreprise mesure si les investissements dans la visibilité se traduisent par des bénéfices concrets tels que la réduction des risques, l’amélioration des performances des modèles, l’accélération du time-to-market des initiatives IA ou une meilleure allocation des ressources. Les organisations devraient mettre en place des tableaux de bord en temps réel affichant ces indicateurs auprès des parties prenantes afin d’assurer un suivi continu et de corriger rapidement le tir en cas de lacunes de visibilité.

Chaque secteur a des exigences de visibilité IA spécifiques, dictées par le contexte réglementaire, le niveau de risque et le modèle économique, et qui imposent des approches de surveillance adaptées. Les services financiers doivent satisfaire aux attentes des régulateurs bancaires sur la gouvernance IA, comprenant la surveillance détaillée des IA utilisées dans l’octroi de crédit, la détection de fraude ou les algorithmes de trading, avec une attention particulière portée à la détection des biais et à l’équité. Les organisations de santé doivent répondre aux exigences FDA pour les systèmes IA cliniques : validation des performances des modèles, surveillance des problèmes de sécurité et documentation sur l’influence de l’IA sur les décisions médicales. Les cabinets juridiques utilisant l’IA pour l’analyse contractuelle, la recherche ou la due diligence doivent garantir la visibilité sur les jeux de données d’entraînement pour éviter les fuites de confidentialité et préserver le secret professionnel. Les organismes publics doivent appliquer les directives fédérales de gouvernance IA, incluant la transparence, l’audit des biais et la documentation des prises de décision IA pour la redevabilité publique. Le retail et l’e-commerce doivent surveiller leurs IA de recommandation et de personnalisation pour assurer la conformité aux réglementations de protection des consommateurs et à la concurrence loyale. Les industries manufacturières doivent suivre leurs IA utilisées pour le contrôle qualité ou la maintenance prédictive afin de garantir sécurité et fiabilité. Les exigences sectorielles de visibilité doivent être intégrées aux cadres de gouvernance plutôt que traitées comme de simples exercices de conformité.

Les organisations qui instaurent une visibilité de l’IA d’entreprise devraient adopter une approche progressive, génératrice de gains rapides et construite vers une gouvernance complète et mature. Commencez par l’inventaire et la documentation : réalisez un audit pour identifier tous les systèmes IA existants (y compris l’IA fantôme) et créez un registre centralisé détaillant le but de chaque système, son propriétaire, ses sources de données et sa criticité métier. Identifiez les gains rapides en concentrant d’abord la surveillance sur les systèmes à haut risque, comme l’IA en contact avec la clientèle, ceux traitant des données sensibles ou prenant des décisions ayant un impact sur les individus. Mettez en place une journalisation centralisée comme socle pour capturer les métadonnées de toutes les activités IA, permettant la surveillance en temps réel et l’analyse a posteriori. Établissez des politiques de gouvernance définissant les standards de documentation, de surveillance et de conformité des systèmes IA, et communiquez-les clairement à toutes les parties prenantes. Constituez des équipes transverses réunissant IT, sécurité, métiers et conformité afin d’adresser les préoccupations de tous les horizons. Mesurez et communiquez les progrès via le suivi des métriques de visibilité et le partage des résultats avec la direction, démontrant la valeur des investissements en gouvernance et favorisant l’adhésion à l’infrastructure de visibilité IA.

La visibilité de l’IA correspond à la capacité de voir et de surveiller ce que font les systèmes d’IA, tandis que la gouvernance de l’IA désigne le cadre plus large des politiques, processus et contrôles qui régissent le développement, le déploiement et l’utilisation des systèmes d’IA. La visibilité constitue un socle essentiel de la gouvernance — on ne peut gouverner que ce que l’on voit. Une gouvernance efficace de l’IA requiert une visibilité globale sur trois dimensions : utilisation, qualité et surveillance de la sécurité.

Les grandes organisations font face à des défis uniques pour gérer des centaines ou des milliers de déploiements d’IA à travers plusieurs départements, fournisseurs cloud et unités métiers. Sans visibilité globale, l’IA fantôme se propage, les risques de non-conformité augmentent, et il devient impossible d’optimiser les investissements en IA ou d’assurer une utilisation responsable. La visibilité permet d’identifier les risques, d’appliquer des politiques et de maximiser la valeur des initiatives IA.

Une faible visibilité de l’IA crée de nombreux risques : les systèmes d’IA fantômes fonctionnent sans supervision, des données sensibles peuvent être exposées via des IA non surveillées, les violations de conformité passent inaperçues, la dégradation des performances des modèles n’est pas détectée, les menaces de sécurité échappent à la vigilance, et il devient impossible de prouver la gouvernance aux régulateurs. Ces risques peuvent aboutir à des violations de données, des amendes réglementaires, des atteintes à la réputation et une perte de confiance des clients.

L’IA fantôme — des outils IA non autorisés déployés sans que la DSI en ait connaissance — crée des angles morts qui empêchent la surveillance centralisée et la gouvernance. Les collaborateurs peuvent utiliser des services IA publics tels que ChatGPT sans supervision organisationnelle, exposant ainsi potentiellement des données sensibles ou enfreignant des exigences de conformité. L’IA fantôme entraîne aussi des efforts redondants, du gaspillage de ressources et l’impossibilité d’appliquer les politiques et standards IA de l’organisation.

Des plateformes dédiées à la gouvernance de l’IA comme Liminal, Ardoq et Knostic offrent une surveillance centralisée, l’application de politiques et le reporting de conformité. Elles s’intègrent aux services IA, capturent des journaux détaillés, détectent les anomalies et fournissent des tableaux de bord pour les équipes de gouvernance. Par ailleurs, AmICited est spécialisé dans la surveillance de la façon dont les systèmes IA citent votre marque sur GPTs, Perplexity et Google AI Overviews, avec une visibilité sur la qualité des réponses IA.

Des cadres réglementaires comme l’EU AI Act, le RGPD, le CCPA et des réglementations sectorielles (OCC pour la banque, FDA pour la santé) imposent des exigences de visibilité et de documentation spécifiques. Les organisations doivent mettre en place des dispositifs de surveillance démontrant leur conformité, incluant des pistes d’audit, des tests de biais, un suivi des performances et une documentation des processus de décision des systèmes IA. L’infrastructure de visibilité doit être conçue pour satisfaire ces obligations réglementaires.

Les indicateurs clés incluent : la couverture de la visibilité (pourcentage de systèmes IA documentés et surveillés), la maturité de la gouvernance (avancement dans les étapes définies de gouvernance), le temps de détection et de réponse aux incidents, le respect de la conformité (part de systèmes conformes aux exigences réglementaires) et la création de valeur métier (bénéfices concrets liés à l’investissement dans la visibilité). Il convient aussi de suivre les métriques d’utilisation (utilisateurs actifs, appels API), de qualité (précision, dérive), et de sécurité (anomalies détectées, violations de politiques).

Les délais de mise en œuvre varient selon la taille et la complexité de l’organisation. L’infrastructure initiale (inventaire, journalisation de base, tableaux de bord) peut être établie en 3 à 6 mois. Une visibilité complète sur tous les systèmes IA nécessite généralement 6 à 12 mois. Atteindre une gouvernance mature et optimisée prend habituellement 12 à 24 mois. Il est conseillé d’adopter une approche par étapes, en commençant par les systèmes à haut risque et les gains rapides, puis en étendant à une couverture globale.

AmICited suit la façon dont des systèmes d’IA comme les GPT, Perplexity et Google AI Overviews citent votre marque et vos contenus. Obtenez de la visibilité sur la qualité des réponses IA et les mentions de votre marque sur toutes les grandes plateformes d’IA.

Guide complet des solutions de visibilité AI pour les entreprises. Comparez les meilleures plateformes comme Conductor, Profound et Athena. Découvrez les critèr...

Découvrez ce que livrent les services de visibilité IA : surveillance de marque, suivi des citations, analyses, benchmarking concurrentiel, optimisation de cont...

Découvrez comment les entreprises SaaS obtiennent de la visibilité dans ChatGPT, Perplexity et Google AI Overviews. Découvrez les stratégies GEO, l’optimisation...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.