Definizione di Google Gemini

Google Gemini è una famiglia di modelli linguistici di grandi dimensioni multimodali (LLM) sviluppata da Google DeepMind, che rappresenta l’erede di modelli precedenti come LaMDA e PaLM 2. A differenza dei modelli linguistici tradizionali che elaborano solo testo, Gemini è progettato fondamentalmente per gestire simultaneamente più modalità di dati, inclusi testo, immagini, audio, video e codice software. Il modello alimenta il chatbot Gemini AI (precedentemente noto come Bard) ed è sempre più integrato nell’ecosistema di prodotti e servizi Google. L’architettura multimodale di Gemini gli consente di comprendere relazioni complesse tra diversi tipi di informazioni, rendendolo capace di svolgere attività che spaziano dall’analisi di immagini e generazione di codice alla traduzione in tempo reale e comprensione di documenti. Il termine “Gemini” deriva dal latino e significa “gemelli”, un riferimento alla collaborazione tra i team di Google DeepMind e Google Brain, ed è stato ispirato anche dal programma spaziale Project Gemini della NASA.

Contesto storico e cronologia dello sviluppo

Il percorso di Google verso la creazione di Gemini riflette anni di ricerca fondamentale sui modelli linguistici di grandi dimensioni e sull’architettura delle reti neurali. Nel 2017 i ricercatori Google introdussero l’architettura transformer, un’innovazione che è diventata la base della maggior parte degli LLM moderni. Successivamente, l’azienda sviluppò Meena (2020), una IA conversazionale con 2,6 miliardi di parametri, seguita da LaMDA (Language Model for Dialogue Applications) nel 2021, specializzato nei compiti di dialogo. Il rilascio di PaLM (Pathways Language Model) nel 2022 portò migliori capacità di programmazione, multilinguismo e ragionamento. Google lanciò poi Bard all’inizio del 2023, inizialmente alimentato da una variante leggera di LaMDA, aggiornandolo poi a PaLM 2 a metà 2023. L’azienda annunciò ufficialmente Gemini 1.0 a dicembre 2023, segnando un importante salto nella multimodalità. Nel 2024, Google ribattezzò Bard come Gemini e pubblicò Gemini 1.5, introducendo una rivoluzionaria finestra di contesto da 2 milioni di token. Più recentemente, Gemini 2.0 e Gemini 2.5 (rilasciati a dicembre 2024) hanno introdotto capacità agentiche, permettendo al modello di compiere azioni autonome e ragionare su contesti estesi. Questa evoluzione dimostra l’impegno di Google nell’avanzamento delle capacità IA mantenendo il focus su applicazioni pratiche e reali.

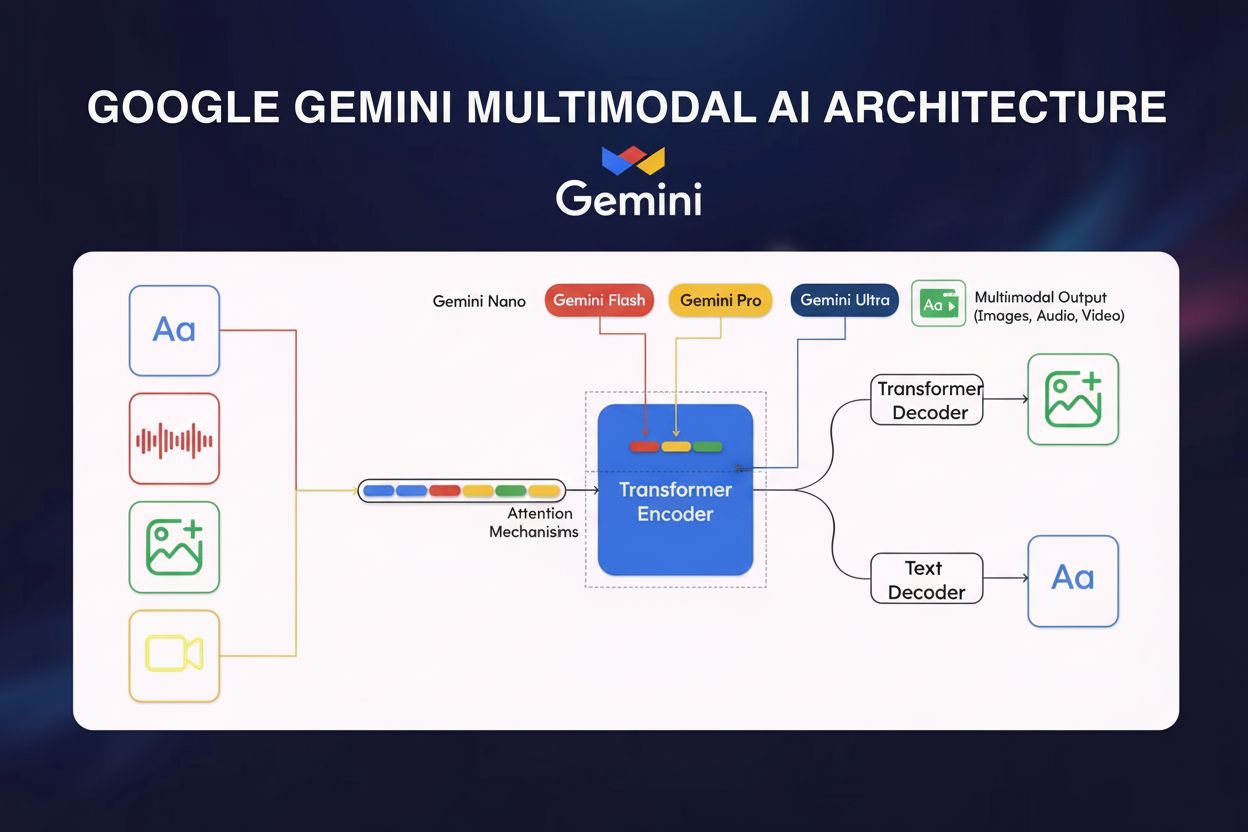

Architettura tecnica e componenti principali

La base tecnica di Google Gemini si fonda su numerose innovazioni architetturali che lo distinguono dai modelli concorrenti. Al centro, Gemini utilizza un’architettura di rete neurale basata su transformer ottimizzata con Cloud TPU v5p (Tensor Processing Units) per addestramento e inferenza ad alte prestazioni. L’encoder multimodale del modello integra dati visivi, audio e testo attraverso percorsi di elaborazione specializzati che confluiscono in uno spazio di rappresentazione unificato. Un’innovazione cruciale è il meccanismo di attenzione cross-modale, che consente al modello di stabilire connessioni significative tra diversi tipi di dati—ad esempio collegando elementi visivi di un’immagine a descrizioni testuali o comprendendo come un contenuto audio si relaziona al contesto visivo. Gemini 1.5 Pro ha introdotto l’architettura Mixture of Experts (MoE), che rappresenta un cambiamento di paradigma nell’efficienza dei modelli. Invece di attivare tutti i parametri della rete neurale a ogni input, MoE suddivide il modello in reti di esperti più piccole, ciascuna specializzata in domini o tipi di dati particolari. Il modello apprende ad attivare selettivamente solo gli esperti più rilevanti a seconda delle caratteristiche dell’input, riducendo drasticamente le risorse computazionali mantenendo o migliorando le prestazioni. Questa architettura consente a Gemini 1.5 Flash di raggiungere prestazioni simili a Gemini 1.0 Ultra con una maggiore efficienza, tramite la distillazione della conoscenza—una tecnica di apprendimento automatico in cui le conoscenze del modello Pro più grande vengono trasferite sulla versione Flash più compatta. La finestra di contesto—il numero di token che un modello può elaborare simultaneamente—si è ampliata drasticamente: da 32.000 token in Gemini 1.0 a 1 milione di token in Gemini 1.5 Flash e 2 milioni in Gemini 1.5 Pro, consentendo l’elaborazione di interi libri, lunghi video o migliaia di righe di codice in un’unica interazione.

Varianti del modello Gemini e loro applicazioni

| Variante Modello | Dimensione/Livello | Finestra di Contesto | Casi d’Uso Principali | Implementazione | Vantaggio Chiave |

|---|

| Gemini 1.0 Nano | La più piccola | 32.000 token | Compiti mobili, elaborazione on-device, descrizione immagini, risposte chat | Dispositivi Android (Pixel 8 Pro+), Chrome desktop | Funziona senza connessione internet |

| Gemini 1.0 Ultra | La più grande | 32.000 token | Ragionamento complesso, programmazione avanzata, analisi matematica, ragionamento multimodale | Cloud, aziendale | Massima accuratezza nei benchmark |

| Gemini 1.5 Pro | Dimensione media | 2 milioni di token | Analisi documenti, repository di codice, contenuti lunghi, applicazioni aziendali | Google Cloud, accesso API | Finestra di contesto più lunga, prestazioni bilanciate |

| Gemini 1.5 Flash | Leggera | 1 milione di token | Risposte rapide, elaborazione conveniente, applicazioni in tempo reale | Cloud, mobile, edge | Ottimizzata per velocità ed efficienza |

| Gemini 2.0/2.5 | Next-generation | Variabile | IA agentica, esecuzione autonoma di task, ragionamento avanzato, interazioni in tempo reale | Cloud, servizi integrati | Capacità agentiche, ragionamento migliorato |

Elaborazione multimodale e comprensione cross-modale

La natura multimodale di Google Gemini rappresenta una svolta rispetto ai modelli IA precedenti che operavano principalmente su una sola modalità. La capacità di Gemini di elaborare sequenze intervallate di audio, immagini, testo e video sia in input che in output consente compiti di ragionamento sofisticati impossibili per i modelli monomodali. Ad esempio, Gemini può analizzare un video, estrarre testo dai frame, comprendere dialoghi parlati e generare riassunti completi che sintetizzano informazioni tra tutte le modalità. Questa capacità ha profonde implicazioni nelle applicazioni reali: nella diagnostica medica, Gemini può analizzare simultaneamente cartelle cliniche (testo), immagini mediche (visivo) e interviste ai pazienti (audio) per fornire valutazioni complete. Nel customer service, può elaborare richieste dei clienti (testo), analizzare immagini di prodotto, revisionare video dimostrativi e generare risposte contestuali. Il meccanismo di attenzione cross-modale che rende possibile questa integrazione crea rappresentazioni condivise in cui le informazioni di modalità diverse influenzano reciprocamente l’elaborazione. Analizzando un’immagine con testo associato, ad esempio, il contesto testuale aiuta il percorso di elaborazione visiva a focalizzarsi sulle aree rilevanti dell’immagine, mentre le informazioni visive aiutano a chiarire riferimenti nel testo. Questa influenza bidirezionale consente una comprensione più olistica rispetto a un’elaborazione separata delle modalità. Le implicazioni pratiche per il monitoraggio IA e il tracciamento del brand sono significative: quando Gemini genera risposte che includono immagini, testo e potenzialmente audio, i sistemi di monitoraggio devono tracciare come i brand appaiono in tutte queste modalità, non solo nelle risposte testuali.

Benchmark delle prestazioni e posizionamento competitivo

Google Gemini Ultra ha dimostrato prestazioni eccezionali su molteplici benchmark IA standardizzati, posizionandosi come modello altamente capace nel panorama competitivo degli LLM. Sul benchmark MMLU (Massive Multitask Language Understanding), che testa la comprensione linguistica su 57 discipline diverse, Gemini Ultra ha superato le prestazioni degli esperti umani—un traguardo significativo nello sviluppo IA. Per il ragionamento matematico (benchmark GSM8K), Gemini Ultra ha superato modelli concorrenti come Claude 2, GPT-4 e Llama 2. Nella generazione di codice (benchmark HumanEval), Gemini ha dimostrato capacità superiori, abilitando assistenza avanzata alla programmazione e analisi del codice. Tuttavia, le prestazioni variano su diversi indicatori: mentre Gemini Ultra eccelle nella comprensione di documenti, immagini e riconoscimento vocale automatico, mostra miglioramenti più modesti su compiti di ragionamento di senso comune (benchmark HellaSwag), dove GPT-4 mantiene ancora un vantaggio. La serie Gemini 1.5 si è dimostrata particolarmente impressionante, con entrambe le varianti Flash e Pro che eguagliano o superano le prestazioni di Gemini 1.0 Ultra offrendo efficienza notevolmente superiore e finestre di contesto ampliate. Questo percorso prestazionale è particolarmente rilevante per il monitoraggio delle citazioni IA: man mano che le capacità di Gemini migliorano e la sua base utenti raggiunge i 350 milioni di utenti attivi mensili, l’accuratezza e la completezza delle sue risposte influenzano direttamente come brand e domini vengono rappresentati nei contenuti generati dall’IA. Le organizzazioni che utilizzano piattaforme come AmICited possono verificare se le risposte di Gemini sul proprio brand sono fattualmente corrette e adeguatamente contestualizzate.

Integrazione nell’ecosistema Google

L’integrazione strategica di Google Gemini nell’ecosistema di prodotti Google rappresenta una delle implementazioni IA più estese tra le aziende tecnologiche. Gemini è ora l’assistente IA predefinito sugli smartphone Google Pixel 9 e Pixel 9 Pro, sostituendo il precedente Google Assistant e diventando l’interfaccia IA primaria per milioni di utenti. All’interno di Google Workspace, Gemini appare nel pannello laterale di Docs per aiutare nella scrittura e revisione, in Gmail per suggerire bozze e risposte, e nelle altre applicazioni di produttività. Google Maps sfrutta le capacità di Gemini per fornire riassunti intelligenti di luoghi e aree, migliorando l’esperienza utente con informazioni contestuali. Google Search ha integrato Gemini tramite gli AI Overviews, che generano risposte complete alle domande degli utenti sintetizzando informazioni da più fonti. L’API Gemini è disponibile tramite Google AI Studio e Google Cloud Vertex AI, permettendo agli sviluppatori di integrare le capacità di Gemini in applicazioni personalizzate. Questa integrazione d’ecosistema ha profonde implicazioni per il monitoraggio del brand e il tracciamento delle citazioni IA. Quando un utente cerca informazioni su un’azienda o un prodotto nella Ricerca Google, Gemini può generare un AI Overview che include o esclude menzioni di quel brand. Quando qualcuno usa Gmail con Gemini, il modello può riferirsi a informazioni aziendali nelle risposte suggerite. Quando gli sviluppatori costruiscono applicazioni usando l’API Gemini, creano nuovi touchpoint in cui i brand possono apparire nei contenuti generati dall’IA. Questa ampia integrazione rende essenziale un monitoraggio completo su tutte queste piattaforme per mantenere l’integrità del brand e garantire una rappresentazione accurata nelle risposte IA.

Capacità chiave e casi d’uso

- Generazione e analisi avanzata di codice: Gemini può comprendere, spiegare e generare codice in diversi linguaggi di programmazione (C++, Java, Python, ecc.), con versioni ottimizzate che alimentano AlphaCode2 per la programmazione competitiva

- Comprensione di immagini e testo: Estrarre testo da immagini senza OCR, didascaliare immagini, analizzare grafici e diagrammi, e svolgere ragionamenti visivi complessi

- Traduzione multilingue: Sfruttare le capacità multimodali per traduzione in tempo reale tra lingue, integrate in servizi come Google Meet con sottotitoli tradotti

- Analisi malware: Sia Gemini 1.5 Pro che Flash possono analizzare frammenti di codice e file per determinarne la pericolosità e generare report di sicurezza dettagliati

- Esperti IA personalizzati (Gems): Creare assistenti IA personalizzati per compiti o argomenti specifici, con opzioni predefinite come coach di apprendimento, partner per brainstorming ed editor di testi

- Agenti IA universali: Tramite Project Astra, Gemini elabora, ricorda e comprende informazioni multimodali in tempo reale, abilitando assistenti IA che possono spiegare oggetti, riconoscere luoghi e ricordare interazioni precedenti

- Conversazioni vocali: Gemini Live abilita dialoghi naturali e adattivi allo stile e alle preferenze dell’utente

- Ricerca approfondita: Analizzare centinaia di siti web, sintetizzare risultati e generare report completi su argomenti complessi

Il ruolo di Gemini nel monitoraggio IA e nella rappresentazione del brand

L’emergere di Google Gemini come principale piattaforma IA con 350 milioni di utenti attivi mensili ha creato nuove priorità per il monitoraggio del brand e il tracciamento delle citazioni IA. A differenza dei motori di ricerca tradizionali in cui i brand appaiono in elenchi posizionati, Gemini genera risposte sintetizzate che possono o meno menzionare aziende, prodotti o domini specifici. Quando un utente chiede a Gemini un settore o un argomento, il modello decide quali fonti citare, quali informazioni evidenziare e come contestualizzare le menzioni del brand. Questo rappresenta un cambiamento significativo rispetto alla SEO tradizionale, dove la visibilità dipende dalla posizione nel ranking, verso quella che potrebbe essere definita “ottimizzazione della citazione IA”—assicurando che i brand compaiano in modo accurato e appropriato nelle risposte generate dall’IA. La natura multimodale di Gemini aggiunge complessità al monitoraggio: i brand possono apparire non solo in risposte testuali ma anche in immagini, trascrizioni audio o riferimenti video generati da Gemini. L’integrazione di Gemini nell’ecosistema Google significa che le menzioni del brand possono avvenire in diversi contesti: negli AI Overviews della Ricerca, nei suggerimenti Gmail, nei riassunti di Google Maps e nelle applicazioni personalizzate basate su API Gemini. Le organizzazioni devono comprendere come Gemini rappresenta il proprio brand in questi diversi contesti e se le informazioni fornite sono accurate, complete e adeguatamente contestualizzate. Piattaforme come AmICited rispondono a questa esigenza monitorando come i brand appaiono nelle risposte di Gemini insieme alle altre principali IA come ChatGPT, Perplexity, Claude e Google AI Overviews, offrendo una visibilità completa sulla rappresentazione del brand generata dall’IA.

Rischi, limiti e considerazioni etiche

Nonostante le sue impressionanti capacità, Google Gemini presenta alcune sfide documentate che le organizzazioni devono considerare quando si affidano ai suoi output. Il bias IA è emerso come questione importante a febbraio 2024, quando Google ha sospeso la generazione di immagini di Gemini per rappresentazioni storiche inaccurate e distorte, con il modello che cancellava il contesto storico relativo alla diversità razziale. Questo episodio ha evidenziato come i sistemi IA multimodali possano perpetuare o amplificare bias presenti nei dati di addestramento. Le allucinazioni—ovvero quando il modello genera informazioni fattualmente errate—continuano a colpire Gemini, soprattutto negli AI Overviews dove gli utenti possono fidarsi delle informazioni sintetizzate senza verifica. Google ha riconosciuto problemi ricorrenti con risultati di ricerca Gemini che occasionalmente producono output falsi o fuorvianti. Le violazioni della proprietà intellettuale rappresentano un’ulteriore preoccupazione: Google ha ricevuto una multa in Francia (250 milioni di euro) per aver addestrato Gemini su contenuti giornalistici protetti da copyright senza il consenso degli editori, sollevando interrogativi sulla provenienza dei dati e il fair use. Questi limiti hanno impatti diretti sul monitoraggio del brand: le organizzazioni non possono assumere che le informazioni che Gemini fornisce su competitor o argomenti di settore siano accurate e devono verificare come viene rappresentato il proprio brand. La possibilità che Gemini generi informazioni fuorvianti su prodotti, storia o posizione di mercato di un’azienda crea rischi che il solo monitoraggio dei motori di ricerca tradizionali non può gestire. Inoltre, la tendenza del modello a sintetizzare informazioni da più fonti senza sempre attribuire chiaramente le affermazioni significa che le menzioni di brand nelle risposte di Gemini possono mancare di contesto o attribuzione.

Evoluzione futura e prospettive strategiche

La traiettoria di sviluppo di Google Gemini suggerisce una continua espansione in capacità, efficienza e integrazione nell’ecosistema Google e oltre. Gemini 2.0 e 2.5 hanno introdotto capacità agentiche, permettendo al modello di compiere azioni autonome, pianificare task multi-step e ragionare su contesti estesi—un’evoluzione significativa rispetto alle versioni precedenti che rispondevano principalmente alle richieste degli utenti. Le future versioni dovrebbero perfezionare ulteriormente le capacità di ragionamento, gestire finestre di contesto ancora più ampie e migliorare le prestazioni su compiti specializzati. Project Astra, l’iniziativa di Google per costruire agenti IA universali, rappresenta la visione a lungo termine di Gemini: sistemi IA che possono elaborare, ricordare e comprendere informazioni multimodali in tempo reale, abilitando interazioni più naturali e potenti. Project Mariner e altre attività di ricerca suggeriscono che Google sta esplorando come Gemini possa assistere nel lavoro conoscitivo complesso, automatizzando potenzialmente ricerca, analisi e processi decisionali. L’integrazione di Gemini in sempre più prodotti e servizi Google continuerà probabilmente, ampliando i touchpoint in cui i brand possono apparire nelle risposte generate dall’IA. I miglioramenti in efficienza on-device renderanno Gemini più accessibile su dispositivi mobili e piattaforme edge, potenzialmente aumentando la base utenti oltre gli attuali 350 milioni di utenti mensili. Anche il contesto competitivo influenzerà l’evoluzione di Gemini: mentre altre piattaforme IA come ChatGPT, Claude e Perplexity continuano ad avanzare, Google dovrà mantenere i vantaggi competitivi di Gemini nella multimodalità, nell’integrazione con i servizi Google e nell’accesso in tempo reale alle conoscenze. Per le organizzazioni focalizzate su monitoraggio IA e rappresentazione del brand, questa evoluzione significa che tracciare come i brand appaiono nelle risposte di Gemini sarà sempre più importante man mano che la piattaforma cresce e si espande. L’evoluzione verso IA agentiche solleva anche nuove domande su come i sistemi IA autonomi rappresenteranno e citeranno i brand quando prenderanno decisioni o agiranno per conto degli utenti.

Conclusione: l’impatto di Gemini sul monitoraggio del brand guidato dall’IA

Google Gemini rappresenta un cambiamento fondamentale nel modo in cui i sistemi IA elaborano le informazioni e generano risposte, con profonde implicazioni per il monitoraggio del brand e il tracciamento delle citazioni IA. Come modello IA multimodale con 350 milioni di utenti attivi mensili, integrato nell’ecosistema Google ed evoluzione costante verso sistemi agentici sempre più capaci, Gemini è diventato una piattaforma critica da monitorare per le organizzazioni. A differenza dei motori di ricerca tradizionali, dove la visibilità dipende dalla posizione in classifica, le risposte sintetizzate di Gemini creano nuove dinamiche in cui i brand possono essere citati o meno, e quando lo sono, possono essere rappresentati correttamente o meno. I limiti documentati del modello—inclusi bias, allucinazioni e questioni di proprietà intellettuale—sottolineano l’importanza di un monitoraggio attivo e non di una fiducia passiva nelle informazioni generate dall’IA. Le organizzazioni che vogliono preservare l’integrità del brand e garantirne una rappresentazione accurata nelle risposte IA devono adottare strategie di monitoraggio complete che traccino come il proprio brand appare su Gemini e sulle altre principali piattaforme IA. Questo rappresenta una nuova frontiera nel marketing digitale e nella gestione del brand, dove il successo dipende non solo dalla SEO tradizionale e dalla visibilità in ricerca, ma dalla comprensione e dall’ottimizzazione di come i sistemi IA rappresentano e citano i brand nelle loro risposte generate.