Como aumentar sinais de confiança em IA para melhor visibilidade em buscas com IA

Aprenda como aumentar sinais de confiança em IA no ChatGPT, Perplexity e Google AI Overviews. Construa identidade de entidade, evidências e confiança técnica pa...

Saiba como sistemas de IA avaliam sinais de confiança através do framework E-E-A-T. Descubra os fatores de credibilidade que ajudam LLMs a citar seu conteúdo e construir autoridade.

Sinais de confiança são os indicadores e marcadores digitais que sistemas de IA usam para avaliar a credibilidade e confiabilidade do conteúdo ao gerar respostas. À medida que a inteligência artificial se integra cada vez mais à busca e à recuperação de informações, entender como esses sistemas avaliam a confiabilidade tornou-se essencial para criadores de conteúdo e marcas. O framework E-E-A-T—que significa Experiência, Especialização, Autoridade e Confiabilidade—oferece uma abordagem estruturada para entender como a IA avalia a qualidade do conteúdo. Entre esses quatro pilares, a confiabilidade emergiu como o fator mais crítico, já que sistemas de IA reconhecem que mesmo fontes altamente especializadas podem ser pouco confiáveis se não forem transparentes e não tiverem credenciais verificáveis. Modelos de linguagem modernos como ChatGPT, Perplexity e Google AI Overviews analisam múltiplas categorias de sinais—including qualidade do conteúdo, infraestrutura técnica, padrões comportamentais e alinhamento contextual—para determinar quais fontes merecem destaque em suas respostas.

| Pilar | Definição | Sinal de IA | Exemplo |

|---|---|---|---|

| Experiência | Conhecimento prático e vivenciado adquirido por envolvimento direto | Conteúdo demonstrando aplicação no mundo real e participação pessoal no assunto | Um desenvolvedor de software escrevendo sobre técnicas de depuração que ele mesmo utilizou em ambientes de produção |

| Especialização | Conhecimento e habilidade profunda e especializada em um determinado domínio | Precisão técnica, uso de terminologia específica do setor e demonstração de domínio do assunto | Um cardiologista explicando fatores de risco de doenças cardíacas com terminologia médica precisa e citações de pesquisas atuais |

| Autoridade | Reconhecimento e respeito dentro de um setor ou área | Citações de outras fontes de autoridade, menções na mídia, palestras e posições de liderança no setor | Um pesquisador publicado cujo trabalho é frequentemente citado por colegas e destacado em grandes publicações do setor |

| Confiabilidade | Confiabilidade, transparência e honestidade na comunicação | Atribuição clara de autoria, divulgação de conflitos de interesse, credenciais verificáveis e precisão consistente ao longo do tempo | Um consultor financeiro que divulga claramente relações de afiliados, mantém credenciais atualizadas e fornece perspectivas equilibradas |

Cada pilar trabalha em conjunto com os outros para criar um perfil de confiança abrangente que os sistemas de IA avaliam. Experiência demonstra que um autor vivenciou o assunto, tornando seus insights mais valiosos do que conhecimento puramente teórico. Especialização sinaliza que o autor possui o conhecimento especializado necessário para fornecer informações precisas e detalhadas. Autoridade indica que o setor reconhece e respeita as contribuições do autor. Confiabilidade, entretanto, serve como base—sem ela, os outros três pilares perdem a credibilidade. Sistemas de IA atribuem grande peso à confiabilidade porque entendem que uma fonte confiável com especialização moderada é mais valiosa do que uma fonte não confiável alegando especialização excepcional.

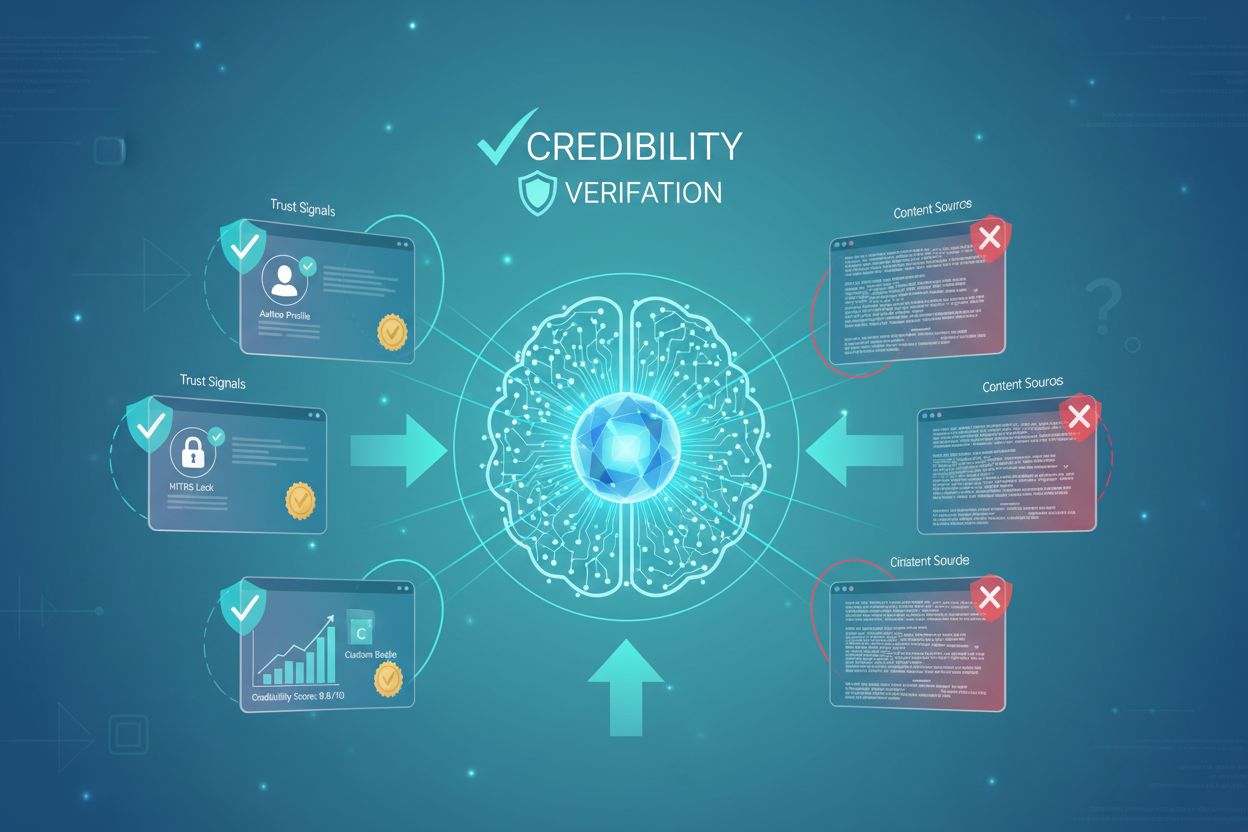

Sistemas de IA empregam um processo sofisticado em múltiplas etapas para avaliar sinais de confiança no conteúdo. Quando um usuário envia uma consulta, o sistema começa com a compreensão da consulta, analisando a intenção e o contexto para determinar qual tipo de informação é necessária. O sistema então realiza a recuperação de conteúdo, buscando trechos relevantes de fontes indexadas na web. Durante a fase de ranqueamento de trechos, algoritmos de IA avaliam a credibilidade de cada fonte usando sinais de confiança, movendo fontes de maior qualidade e confiabilidade para o topo do grupo de candidatos. A verificação de fonte envolve checar credenciais do autor, datas de publicação, autoridade do domínio e consistência com outras fontes de autoridade no mesmo tema. O sistema então faz a seleção de citações, escolhendo quais fontes atribuir na resposta final com base em suas pontuações de confiabilidade. Por fim, filtros de segurança examinam o conteúdo selecionado para garantir que esteja alinhado com padrões de precisão e não propague desinformação. Todo esse processo ocorre em milissegundos, com sistemas de IA tomando decisões instantâneas sobre quais fontes merecem ser citadas em suas respostas.

A credibilidade do autor é um dos sinais de confiança mais poderosos que os sistemas de IA avaliam ao determinar a confiabilidade de uma fonte. Quando o conteúdo inclui atribuição clara de autoria com credenciais verificáveis, sistemas de IA podem cruzar essas informações com bancos de dados conhecidos de especialistas, profissionais e autoridades reconhecidas. A presença de um autor nomeado cria responsabilidade—sistemas de IA reconhecem que indivíduos que assinam o conteúdo têm maior probabilidade de garantir precisão e manter padrões profissionais. Além da simples atribuição de nome, sistemas de IA buscam vários marcadores-chave de credibilidade:

Quando sistemas de IA encontram conteúdo com atribuição de autoria completa, atribuem pontuações de confiança mais altas porque podem verificar o histórico e a atuação do autor. Esse processo de verificação ajuda sistemas de IA a diferenciar entre especialistas genuínos e criadores oportunistas sem credenciais reais. Organizações que investem em perfis de autor robustos—com biografias, credenciais e histórico de publicação consistente—sinalizam aos sistemas de IA que levam a qualidade do conteúdo a sério e sustentam o que afirmam.

Sistemas de IA avaliam a qualidade do conteúdo por meio de múltiplos indicadores de factualidade que revelam se a informação é confiável e precisa. Afirmativas específicas e quantificáveis sinalizam maior confiança do que generalizações vagas—quando o conteúdo inclui estatísticas, datas e medições precisas, sistemas de IA reconhecem que o autor investiu em pesquisa e verificação. Informação fundamentada que referencia estudos, relatórios ou eventos documentados tem mais peso do que declarações abstratas, pois sistemas de IA podem cruzar essas afirmações com fontes confiáveis conhecidas. Exemplos concretos que ilustram conceitos com cenários do mundo real demonstram compreensão aprofundada e fornecem insights práticos aos leitores, sendo reconhecidos pelos sistemas de IA como marca de conteúdo de qualidade. A ausência de erros factuais é especialmente importante; sistemas de IA mantêm bases internas de conhecimento e podem identificar quando o conteúdo contradiz fatos bem estabelecidos ou contém informações desatualizadas. Além disso, a apresentação equilibrada de múltiplas perspectivas sobre temas complexos sinaliza confiabilidade, pois sistemas de IA reconhecem que argumentos simplificados ou unilaterais costumam mascarar compreensão incompleta ou interesses ocultos.

A infraestrutura técnica por trás do seu conteúdo envia sinais de confiança importantes para sistemas de IA que avaliam a confiabilidade e legitimidade do seu site. Criptografia HTTPS agora é uma expectativa básica; sistemas de IA reconhecem que sites com protocolos seguros levam a sério a proteção de dados dos usuários e tendem a manter altos padrões em todas as operações. Métricas de desempenho do site, incluindo carregamento rápido e responsividade móvel, indicam investimento em infraestrutura de qualidade, o que se correlaciona com profissionalismo e qualidade geral do conteúdo. Rastreabilidade e indexação garantem que sistemas de IA possam acessar e analisar seu conteúdo de forma eficiente; sites com arquivos robots.txt adequados, sitemaps XML e URLs limpos sinalizam que você entende e respeita como mecanismos de busca e sistemas de IA descobrem conteúdo. Marcação de esquema e implementação de dados estruturados (usando formatos como JSON-LD para informações de autor, datas de publicação e metadados de artigos) fornecem aos sistemas de IA informações legíveis por máquinas que confirmam e validam as afirmações feitas no seu conteúdo. Esses elementos técnicos trabalham juntos para criar um ambiente onde sistemas de IA podem avaliar e citar seu conteúdo com confiança, sabendo que a infraestrutura apoia a precisão e a confiabilidade.

Transparência é um dos pilares da confiabilidade que sistemas de IA avaliam ativamente ao analisar a credibilidade de uma fonte. Páginas Sobre e Contato que fornecem informações claras sobre sua organização, missão e formas de contato demonstram que você está disposto a ser responsabilizado pelo seu conteúdo. Avisos de afiliados e divulgação de conflitos de interesse são especialmente importantes; sistemas de IA reconhecem que fontes que reconhecem abertamente possíveis vieses são mais confiáveis do que aquelas que ocultam relações financeiras. Políticas de privacidade que explicam como você lida com dados do usuário sinalizam respeito à privacidade e conformidade com regulamentações, o que sistemas de IA associam à confiabilidade geral. Datas de publicação e atualizações permitem que sistemas de IA avaliem a atualidade do conteúdo e entendam quando a informação foi criada originalmente e quando foi revisada pela última vez—isso é crucial para temas em que a informação muda frequentemente. Documentação de correções mostrando que você identificou e corrigiu erros demonstra honestidade intelectual e compromisso com a precisão. Organizações que mantêm práticas transparentes em todas essas dimensões sinalizam aos sistemas de IA que priorizam a precisão e a confiança do usuário em vez de ganhos imediatos, resultando em pontuações de credibilidade mais altas.

Validação externa de outras fontes de autoridade amplifica significativamente seus sinais de confiabilidade aos olhos dos sistemas de IA. Backlinks de domínios estabelecidos e de alta autoridade funcionam como endossos; quando organizações respeitadas vinculam ao seu conteúdo, sistemas de IA interpretam isso como verificação de terceiros da sua credibilidade. Menções na mídia e cobertura em publicações reconhecidas indicam que jornalistas e editores avaliaram sua expertise e acharam seus insights relevantes para compartilhar com o público. Reconhecimento no setor por meio de prêmios, certificações ou inclusão em diretórios de autoridade fornece aos sistemas de IA evidências objetivas de sua posição no segmento. Palestras em conferências e contribuições para publicações do setor demonstram que pares e líderes do segmento reconhecem sua expertise e estão dispostos a associar sua própria credibilidade à sua. Reconhecimento de entidade por bases de conhecimento e pelos próprios sistemas de IA—quando sua organização ou marca pessoal é identificada como entidade notável em seu segmento—cria um ciclo positivo que aumenta sua pontuação de autoridade. Esses sinais de validação externa atuam de forma cumulativa; quanto mais fontes de autoridade referenciam e endossam seu conteúdo, maior a pontuação de confiança que sistemas de IA atribuem ao seu conteúdo futuro.

Padrões de comportamento dos usuários fornecem aos sistemas de IA indicadores indiretos, porém poderosos, de confiabilidade e valor do conteúdo. Tempo na página revela se os leitores consideram seu conteúdo substancial o suficiente para um engajamento prolongado; sistemas de IA reconhecem que as pessoas passam mais tempo com conteúdos que consideram valiosos e confiáveis. Métricas de engajamento como comentários, compartilhamentos e interações indicam que seu conteúdo ressoa com o público e gera discussões relevantes, o que se correlaciona com qualidade e confiabilidade. Taxas de rejeição mais baixas que a média do setor sugerem que os visitantes encontraram o que procuravam e confiam nas informações o suficiente para explorar mais, em vez de sair imediatamente para buscar em outro lugar. Visitas recorrentes dos mesmos usuários sinalizam que seu conteúdo já provou ser valioso com o tempo e que leitores confiam em você a ponto de retornar para mais informações. Padrões de compartilhamento social, especialmente de contas com credibilidade estabelecida e seguidores engajados, amplificam seus sinais de confiança na web. Sistemas de IA analisam esses sinais comportamentais porque entendem que a confiança genuína do usuário—demonstrada por engajamento sustentado e visitas repetidas—é um dos indicadores mais autênticos de qualidade e confiabilidade do conteúdo.

Desenvolver um perfil de confiança sólido exige uma abordagem sistemática na implementação e otimização dos sinais E-E-A-T em todo seu conteúdo e presença digital. Comece realizando uma auditoria abrangente dos sinais E-E-A-T existentes, identificando quais pilares são fortes e quais precisam de desenvolvimento; essa avaliação inicial revela onde focar seus esforços para maior impacto. Implemente atribuição clara de autoria em todo conteúdo, incluindo biografias detalhadas que estabeleçam credenciais, experiência e especialização; garanta que as informações do autor sejam consistentes em todas as plataformas onde seu conteúdo aparece. Adicione marcação de esquema ao seu site usando o formato JSON-LD para fornecer aos sistemas de IA informações legíveis por máquinas sobre autores, datas de publicação, temas de artigos e detalhes organizacionais. Construa backlinks de alta qualidade criando conteúdo genuinamente valioso que outras fontes de autoridade queiram referenciar e citar; foque em conquistar links de domínios relevantes e respeitados, em vez de buscar quantidade. Mantenha o frescor do conteúdo atualizando regularmente materiais existentes para refletir informações atuais, adicionando novas pesquisas e removendo afirmações desatualizadas; sistemas de IA reconhecem que conteúdo ativamente mantido é mais confiável do que artigos abandonados. Monitore como sistemas de IA citam sua marca usando ferramentas como AmICited, que rastreia quando e como AI Overviews, ChatGPT, Perplexity e outros sistemas de IA referenciam seu conteúdo; essa visibilidade permite entender quais sinais de confiança estão funcionando e onde é preciso melhorar. Ao construir sistematicamente esses sinais de confiança, você cria uma base sólida que ajuda sistemas de IA a citar seu conteúdo com confiança e recomendá-lo a usuários em busca de informações confiáveis.

E-E-A-T é um framework que engloba quatro pilares: Experiência, Especialização, Autoridade e Confiabilidade. Sinais de confiança são os indicadores e marcadores específicos que sistemas de IA usam para avaliar cada pilar. Pense no E-E-A-T como o padrão geral de qualidade, enquanto os sinais de confiança são as evidências mensuráveis que demonstram que você atende a esse padrão.

Sites pequenos podem construir sinais de confiança focando em atribuição de autoria, criando conteúdo de alta qualidade em um nicho específico, implementando marcação de esquema, conquistando backlinks de fontes relevantes e mantendo práticas transparentes. Você não precisa de tráfego massivo ou reconhecimento de marca—os sistemas de IA valorizam profundidade de especialização e consistência em uma área focada mais do que cobertura ampla.

Sim, HTTPS agora é uma expectativa básica de confiabilidade. Sistemas de IA reconhecem que sites que utilizam protocolos seguros levam a sério a proteção de dados dos usuários e têm maior probabilidade de manter altos padrões em todas as operações. É um dos sinais técnicos fundamentais que contribuem para sua pontuação geral de credibilidade.

Construir sinais de confiança genuínos é uma estratégia de longo prazo que normalmente leva meses para mostrar resultados significativos. No entanto, implementar melhorias técnicas como marcação de esquema e atribuição de autoria pode ter efeitos mais imediatos. A chave é a consistência—publicar conteúdo de qualidade regularmente, manter a precisão e construir validação externa ao longo do tempo.

Sistemas de IA estão cada vez mais sofisticados em detectar inconsistências e declarações falsas. Eles cruzam informações de autores com bancos de dados conhecidos, verificam a precisão dos fatos com seus dados de treinamento e analisam padrões em várias fontes. Tentar forjar credenciais ou fazer afirmações falsas é arriscado e provavelmente vai prejudicar sua credibilidade quando descoberto.

Você pode testar isso pesquisando seus tópicos em plataformas alimentadas por IA como ChatGPT com navegação, Perplexity e AI Overviews do Google, então procurando seus URLs nas citações. Para monitoramento sistemático, ferramentas como AmICited acompanham quando e como sistemas de IA referenciam seu conteúdo em várias plataformas, proporcionando visibilidade sobre suas citações por IA.

Sinais de engajamento do usuário como tempo na página, visitas recorrentes e compartilhamentos sociais indicam aos sistemas de IA que seu conteúdo é valioso e confiável. Sistemas de IA reconhecem que a confiança genuína dos usuários—demonstrada através de engajamento sustentado—é um dos indicadores mais autênticos de qualidade e confiabilidade do conteúdo.

Sim, transparência sobre como o conteúdo foi criado é importante para a confiabilidade. Se você usa ferramentas de IA para auxiliar na criação de conteúdo, divulgar isso e explicar como a IA foi utilizada ajuda leitores e sistemas de IA a entenderem a origem do conteúdo. Transparência sobre seus processos constrói confiança de forma mais eficaz do que esconder como o conteúdo foi produzido.

Acompanhe como sistemas de IA como ChatGPT, Perplexity e Google AI Overviews referenciam sua marca. Entenda seus sinais de confiança e melhore sua visibilidade em IA.

Aprenda como aumentar sinais de confiança em IA no ChatGPT, Perplexity e Google AI Overviews. Construa identidade de entidade, evidências e confiança técnica pa...

Sinais de confiança são indicadores de credibilidade que estabelecem a confiabilidade da marca para usuários e sistemas de IA. Saiba como selos verificados, dep...

Descubra quais fontes os motores de IA mais citam. Saiba como ChatGPT, Google AI Overviews e Perplexity avaliam a credibilidade das fontes e entenda padrões de ...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.