Transparência nos Esforços de Visibilidade em IA: Melhores Práticas de Divulgação

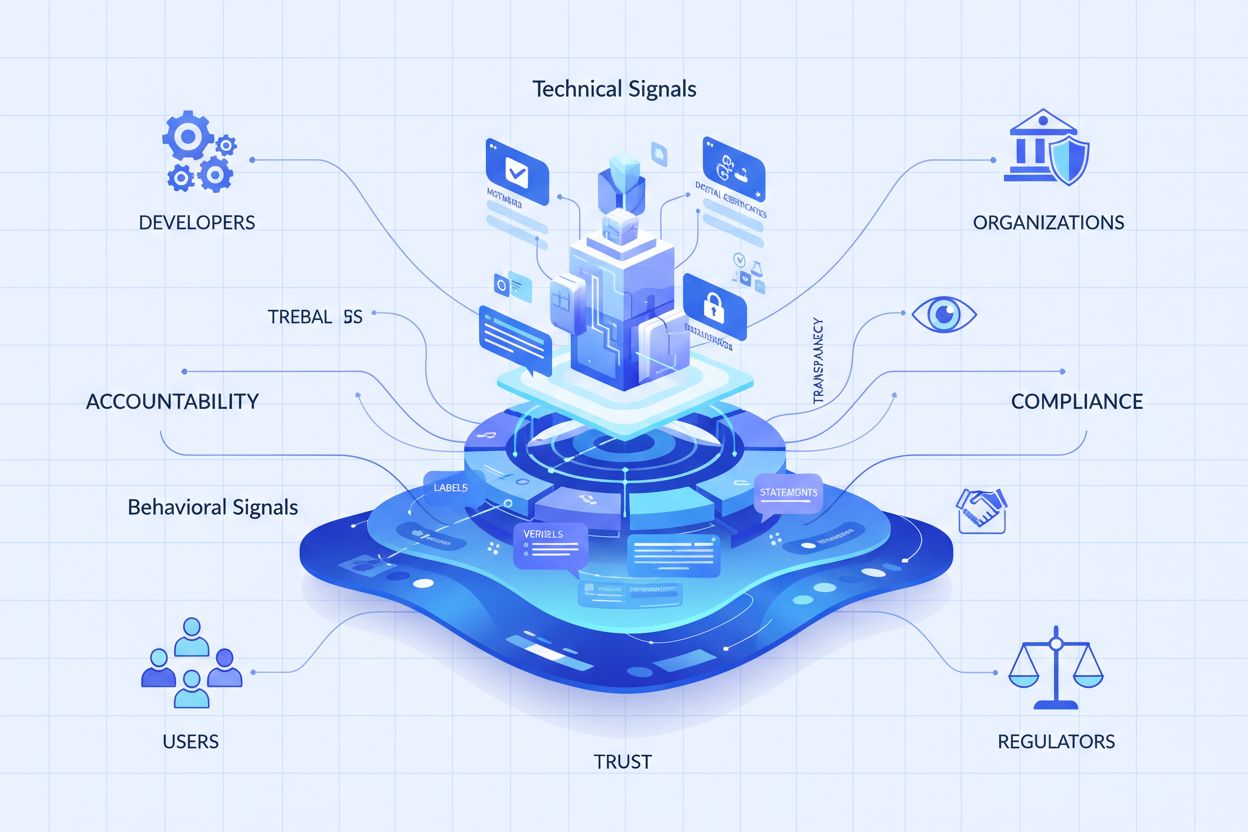

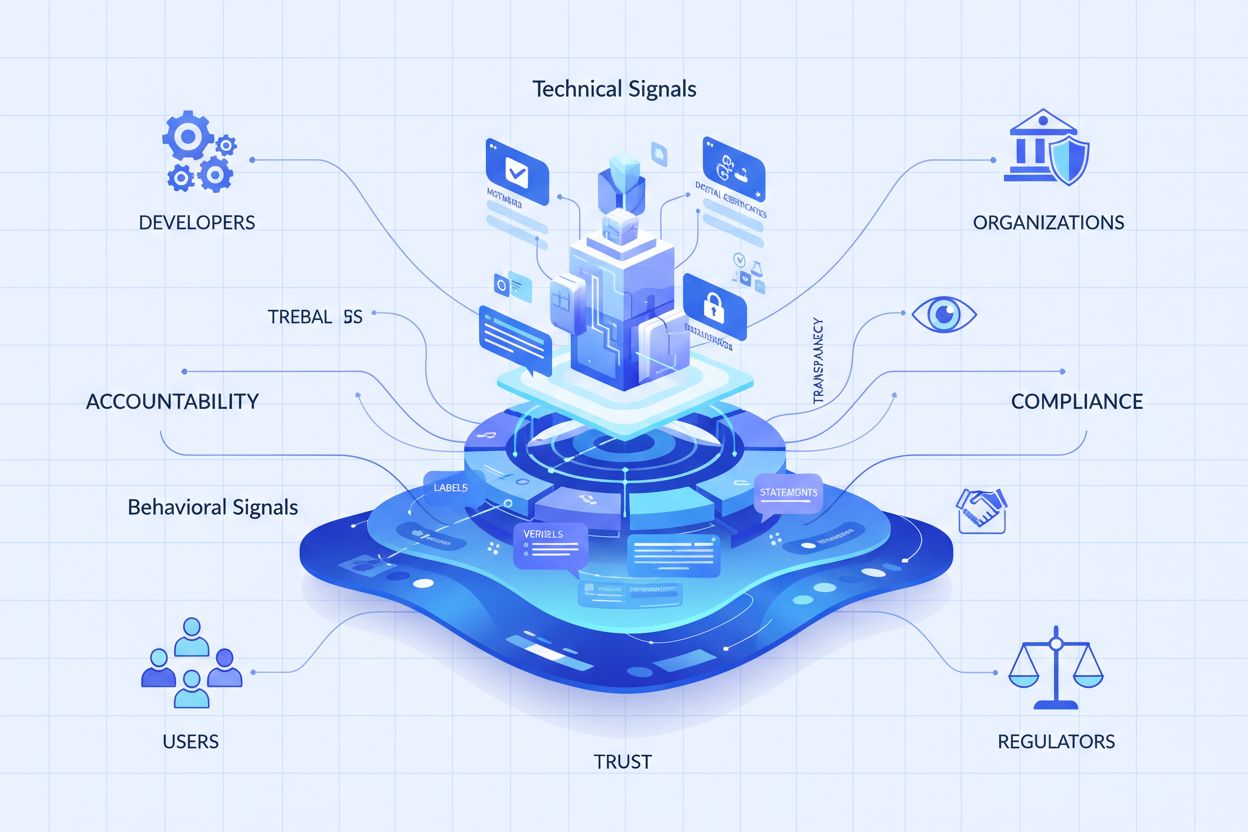

Aprenda as melhores práticas essenciais de transparência e divulgação em IA. Descubra métodos comportamentais, verbais e técnicos de divulgação para construir c...

Exigências regulatórias para que instituições financeiras divulguem de forma transparente o uso de inteligência artificial em processos de tomada de decisão, gestão de riscos e aplicações voltadas ao cliente. Engloba expectativas regulatórias da SEC, CFPB, FINRA e outros órgãos quanto à documentação de governança de IA, desempenho de modelos e impactos em consumidores e mercados.

Exigências regulatórias para que instituições financeiras divulguem de forma transparente o uso de inteligência artificial em processos de tomada de decisão, gestão de riscos e aplicações voltadas ao cliente. Engloba expectativas regulatórias da SEC, CFPB, FINRA e outros órgãos quanto à documentação de governança de IA, desempenho de modelos e impactos em consumidores e mercados.

Divulgação de IA Financeira refere-se às exigências regulatórias e melhores práticas para que instituições financeiras divulguem de forma transparente o uso de inteligência artificial em processos de tomada de decisão, gestão de riscos e aplicações voltadas ao cliente. Engloba expectativas regulatórias da SEC, CFPB, FINRA e outros órgãos quanto à documentação de governança de IA, desempenho de modelos e potenciais impactos em consumidores e mercados. Em dezembro de 2024, o Comitê Consultivo de Investidores (IAC) da SEC avançou uma recomendação formal para que a agência publique orientações exigindo que as empresas divulguem informações sobre o impacto da inteligência artificial em suas operações. O IAC citou uma “falta de consistência” nas divulgações atuais de IA, o que “pode ser problemático para investidores que buscam informações claras e comparáveis”. Apenas 40% das empresas do S&P 500 fornecem divulgações relacionadas à IA, e apenas 15% divulgam informações sobre a supervisão do conselho sobre IA, apesar de 60% dessas empresas considerarem a IA um risco material.

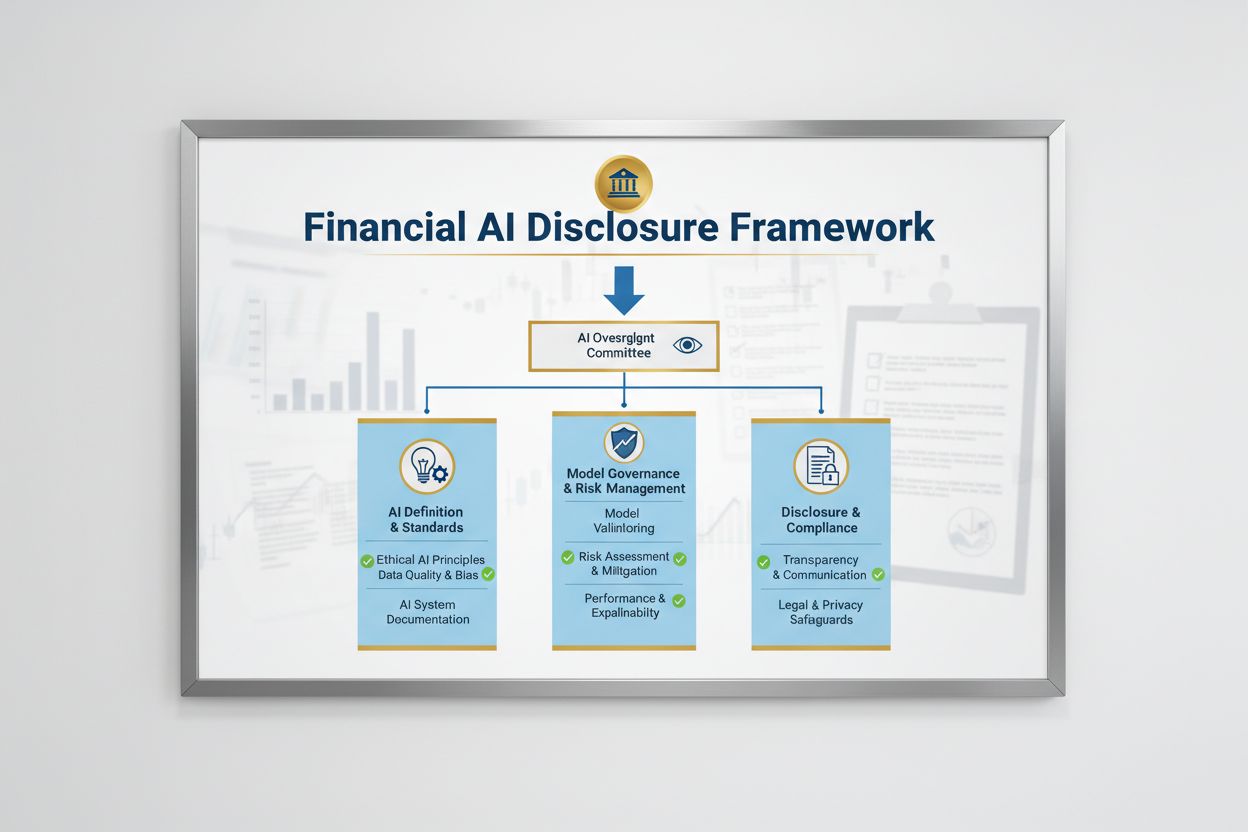

O cenário regulatório para Divulgação de IA Financeira é moldado por vários órgãos federais que aplicam leis existentes, neutras em relação à tecnologia, aos sistemas de IA. O Comitê Consultivo de Investidores da SEC propôs um arcabouço inicial com três pilares principais: (1) exigir que as empresas definam o que entendem por “Inteligência Artificial”, (2) divulgar mecanismos de supervisão do conselho para implantação de IA e (3) relatar implantações materiais de IA e seus efeitos em operações internas e produtos voltados ao consumidor. Além da SEC, CFPB, FINRA, OCC e Federal Reserve emitiram orientações enfatizando que leis de proteção ao consumidor já existentes — incluindo empréstimo justo, privacidade de dados e combate à fraude — também se aplicam aos sistemas de IA, independentemente da tecnologia utilizada. Esses órgãos adotam uma abordagem neutra à tecnologia, o que significa que as obrigações de conformidade sob o Equal Credit Opportunity Act (ECOA), Fair Credit Reporting Act (FCRA), Gramm-Leach-Bliley Act (GLBA) e Unfair or Deceptive Acts or Practices (UDAAP) permanecem inalteradas quando a IA está envolvida.

| Regulador | Área de Foco | Exigência Principal |

|---|---|---|

| SEC | Divulgação ao investidor, conflitos de interesse | Definir IA, divulgar supervisão do conselho, relatar implantações materiais |

| CFPB | Empréstimo justo, proteção ao consumidor | Garantir conformidade de modelos de IA com ECOA, fornecer notificações de ação adversa |

| FINRA | Operações de corretoras, comunicação com clientes | Estabelecer políticas de governança de IA, supervisionar uso de IA em todas as funções |

| OCC/Federal Reserve/FDIC | Governança de modelos bancários, risco operacional | Validar modelos de IA, documentar controles, avaliar confiabilidade |

| FTC | Práticas enganosas, manipulação de dados | Monitorar alegações relacionadas à IA, prevenir uso indevido de dados |

Uma divulgação eficaz de IA Financeira exige supervisão clara, em nível de conselho, sobre a implantação e gestão de riscos relacionados à inteligência artificial. A recomendação do IAC da SEC enfatiza que os investidores têm interesse legítimo em entender se existem linhas claras de autoridade sobre a implantação de IA nas operações e linhas de produtos internos. Instituições financeiras devem estabelecer estruturas de governança que atribuam a responsabilidade pela supervisão de IA ao Conselho de Administração ou a um comitê designado, garantindo que os riscos relacionados a IA sejam gerenciados nos mais altos níveis da organização. Essa estrutura de governança deve incluir políticas e procedimentos documentados para o desenvolvimento, teste, validação e implantação de IA, com relatórios regulares ao conselho sobre desempenho dos modelos, riscos identificados e esforços de remediação. Sem uma clara responsabilidade do conselho, instituições financeiras correm risco de escrutínio regulatório e possíveis ações de fiscalização por supervisão inadequada de sistemas de IA considerados materiais.

Instituições financeiras devem divulgar separadamente os efeitos materiais da implantação de IA sobre operações internas e produtos voltados ao consumidor. Para operações internas, as divulgações devem abordar o impacto da IA sobre o capital humano (como redução de pessoal ou necessidade de requalificação), precisão de relatórios financeiros, processos de governança e riscos de cibersegurança. Para questões voltadas ao consumidor, as instituições devem divulgar investimentos em plataformas baseadas em IA, integração de IA em produtos e serviços, impactos regulatórios decorrentes do uso de IA e como a IA influencia estratégias de preços ou benchmarks de negócios. A SEC recomenda a integração dessas divulgações aos itens já existentes do Regulamento S-K (como Itens 101, 103, 106 e 303), com base em critérios de materialidade, em vez de criar novas categorias de divulgação. Essa abordagem permite que as instituições financeiras aproveitem arcabouços já existentes, oferecendo aos investidores informações claras e comparáveis sobre o papel da IA nas operações e estratégias da organização.

Dados de alta qualidade são fundamentais para uma implantação responsável de IA em serviços financeiros, mas muitas instituições enfrentam desafios para estruturar governança de dados que atenda às expectativas regulatórias. Instituições financeiras devem garantir que os dados usados para treinar, testar e validar modelos de IA sejam limpos, completos, padronizados e abrangentes, com documentação clara das fontes, linhagens e limitações conhecidas. Proteções de segurança de dados devem prevenir “envenenamento de dados” — manipulação de dados de treinamento que comprometa a integridade do modelo — e salvaguardar contra acesso não autorizado ou divulgação de informações sensíveis. O Gramm-Leach-Bliley Act (GLBA) oferece proteções básicas para dados financeiros de consumidores, mas muitos reguladores e defensores argumentam que essas proteções são insuficientes no contexto da IA, especialmente devido à expansão na coleta e uso de dados para treinamento de modelos. Instituições financeiras também devem considerar questões de propriedade intelectual, garantindo autorização adequada para uso de dados em desenvolvimento de IA e respeito aos direitos de terceiros. Implantar estruturas robustas de governança de dados, incluindo princípios de minimização, controles de acesso e auditorias regulares, é essencial para demonstrar conformidade regulatória.

Órgãos reguladores deixaram claro que modelos de IA usados em decisões financeiras devem ser testados quanto a vieses e potenciais resultados discriminatórios, independentemente da precisão ou desempenho geral do modelo. O problema da “caixa preta” — onde sistemas complexos de IA produzem resultados difíceis ou impossíveis de explicar — cria riscos significativos de conformidade, especialmente em aplicações ao consumidor, como concessão de crédito, precificação e detecção de fraudes. Instituições financeiras devem implementar processos para detectar e mitigar vieses ao longo do ciclo de vida do modelo, incluindo testes durante desenvolvimento, validação e monitoramento contínuo. A conformidade com empréstimo justo exige que as instituições sejam capazes de explicar razões específicas para decisões negativas (como negativas de crédito) e demonstrem que seus modelos de IA não têm impacto desproporcional sobre classes protegidas. Testes para “alternativas menos discriminatórias” — métodos que atinjam os mesmos objetivos de negócio com menos viés — são cada vez mais exigidos pelos reguladores. Muitas instituições estão adotando técnicas de IA explicável (xAI), como análise de importância de variáveis e árvores de decisão, para melhorar transparência e responsabilidade em decisões geradas por IA.

Instituições financeiras que utilizam IA em aplicações voltadas ao consumidor devem cumprir leis existentes de proteção ao consumidor, incluindo exigências de notificações de ação adversa, divulgações de privacidade de dados e tratamento justo. Quando um sistema de IA é usado para tomar ou influenciar significativamente decisões sobre crédito, seguros ou outros produtos financeiros, os consumidores têm direito de entender por que foram negados ou receberam condições menos favoráveis. O CFPB enfatizou que credores sujeitos ao Equal Credit Opportunity Act (ECOA) não podem usar modelos “caixa preta” quando não forem capazes de fornecer razões específicas e precisas para ações negativas. Além disso, o padrão Unfair or Deceptive Acts or Practices (UDAAP) se aplica a sistemas baseados em IA que possam prejudicar consumidores por meio de coleta opaca de dados, violações de privacidade ou direcionamento para produtos inadequados. Instituições financeiras devem garantir que sistemas de IA usados em atendimento ao cliente, recomendações de produtos e gestão de contas sejam transparentes sobre o uso de IA e forneçam divulgações claras sobre como os dados dos consumidores são coletados, utilizados e protegidos.

A maioria das instituições financeiras depende de fornecedores terceiros para desenvolver, implantar ou manter sistemas de IA, criando obrigações significativas de gestão de riscos de terceiros (TPRM). A Orientação Interagências sobre Relações com Terceiros dos órgãos bancários federais enfatiza que instituições financeiras permanecem responsáveis pelo desempenho e conformidade de sistemas de IA de terceiros, mesmo quando não desenvolveram o modelo. Um TPRM eficaz para IA exige diligência prévia robusta antes de contratar fornecedores, incluindo avaliação das práticas de governança de dados do fornecedor, processos de validação de modelos e capacidade de fornecer transparência sobre o funcionamento do modelo. Instituições financeiras devem também monitorar o risco de concentração — potencial impacto sistêmico caso poucos fornecedores de IA sofram interrupções ou falhas. Riscos na cadeia de suprimentos, incluindo confiabilidade de fontes de dados e estabilidade da infraestrutura de terceiros, devem ser avaliados e documentados. Contratos com fornecedores de IA devem conter exigências claras sobre segurança de dados, monitoramento do desempenho de modelos, reporte de incidentes e possibilidade de auditoria ou testes do sistema de IA. Instituições financeiras menores podem enfrentar dificuldades técnicas para avaliar sistemas complexos de IA, criando a necessidade de padrões do setor ou programas de certificação para facilitar a avaliação de fornecedores.

Instituições financeiras que operam internacionalmente enfrentam um panorama cada vez mais complexo de regulações de IA, sendo a Lei de IA da União Europeia o arcabouço regulatório mais abrangente até o momento. A Lei de IA da UE classifica sistemas de IA usados em scoring de crédito, prevenção a fraudes e combate à lavagem de dinheiro como “alto risco”, exigindo documentação detalhada, testes de vieses, supervisão humana e avaliações de conformidade. OCDE e G7 também emitiram princípios e recomendações para governança responsável de IA em serviços financeiros, enfatizando transparência, equidade, responsabilidade e supervisão humana. Muitos desses padrões internacionais têm alcance extraterritorial, significando que instituições financeiras que atendem clientes na UE, Reino Unido ou outras jurisdições reguladas podem precisar cumpri-los mesmo tendo sede em outros países. Esforços de harmonização regulatória estão em andamento, mas ainda há diferenças significativas entre jurisdições, criando desafios de conformidade para instituições globais. O alinhamento proativo com os padrões internacionais mais rigorosos — como a Lei de IA da UE e os princípios da OCDE — pode ajudar as instituições a se prepararem para futuras regulamentações e a reduzir riscos de autuações em múltiplas jurisdições.

Instituições financeiras devem implementar práticas abrangentes de documentação e governança para demonstrar conformidade com expectativas de Divulgação de IA Financeira. Entre as melhores práticas estão:

Ao adotar essas práticas, instituições financeiras podem reduzir riscos regulatórios, construir confiança com as partes interessadas e se posicionar como líderes na implantação responsável de IA no setor financeiro.

Divulgação de IA Financeira refere-se às exigências regulatórias para que instituições financeiras divulguem de forma transparente o uso de inteligência artificial em processos de tomada de decisão, gestão de riscos e aplicações voltadas ao cliente. Engloba expectativas regulatórias da SEC, CFPB, FINRA e outros órgãos quanto à documentação de governança de IA, desempenho de modelos e impactos em consumidores e mercados. O Comitê Consultivo de Investidores da SEC recomendou em dezembro de 2024 que as instituições financeiras definam o uso de IA, divulguem mecanismos de supervisão do conselho e relatem implantações materiais de IA.

Instituições financeiras devem divulgar o uso de IA para proteger investidores, consumidores e a integridade do mercado. Reguladores constataram que apenas 40% das empresas do S&P 500 fornecem divulgações relacionadas à IA, criando inconsistências e lacunas de informação para investidores. As exigências de divulgação garantem que as partes interessadas compreendam como a IA impacta decisões financeiras, gestão de riscos e resultados ao consumidor. Além disso, leis de proteção ao consumidor já existentes — incluindo estatutos de empréstimo justo e privacidade de dados — aplicam-se a sistemas de IA, tornando a divulgação essencial para conformidade regulatória.

O Comitê Consultivo de Investidores da SEC recomendou três pilares principais para divulgação de IA: (1) exigir que emissores definam o que entendem por 'Inteligência Artificial', (2) divulgar mecanismos de supervisão do conselho para implantação de IA e (3) relatar implantações materiais de IA e seus efeitos em operações internas e produtos voltados ao consumidor. Essas recomendações visam fornecer aos investidores informações claras e comparáveis sobre como a IA impacta as operações e a direção estratégica das instituições financeiras.

A Divulgação de IA Financeira foca especificamente em exigências regulatórias para comunicação transparente sobre o uso de IA com partes externas (investidores, reguladores, consumidores), enquanto a governança geral de IA refere-se a processos internos e controles para gerenciar sistemas de IA. A divulgação é o componente externo da governança de IA, garantindo que as partes interessadas tenham acesso a informações relevantes sobre implantação, riscos e impactos da IA. Ambos são essenciais para uma implementação responsável de IA em serviços financeiros.

Divulgações sobre implantação de IA devem abordar tanto operações internas quanto impactos voltados ao consumidor. Para operações internas, as instituições devem divulgar impactos sobre capital humano, relatórios financeiros, governança e riscos de cibersegurança. Para produtos voltados ao consumidor, as divulgações devem cobrir investimentos em plataformas de IA, integração de IA em produtos, impactos regulatórios e como a IA influencia preços ou estratégias de negócios. As divulgações devem ser integradas aos itens de divulgação regulatória já existentes (como o Regulamento S-K da SEC), com base em critérios de materialidade.

Leis de empréstimo justo, incluindo o Equal Credit Opportunity Act (ECOA) e o Fair Credit Reporting Act (FCRA), aplicam-se a sistemas de IA usados em decisões de crédito independentemente da tecnologia utilizada. Instituições financeiras devem ser capazes de explicar os motivos específicos para decisões negativas (como negativas de crédito) e demonstrar que seus modelos de IA não têm impacto discriminatório sobre classes protegidas. Reguladores esperam que instituições testem modelos de IA quanto a vieses, implementem 'alternativas menos discriminatórias' quando apropriado e mantenham documentação dos testes e validações de equidade.

A maioria das instituições financeiras depende de fornecedores terceiros para sistemas de IA, criando obrigações significativas de gestão de riscos de terceiros (TPRM). As instituições permanecem responsáveis pelo desempenho e conformidade de sistemas de IA de terceiros, mesmo quando não desenvolveram o modelo. TPRM eficaz para IA requer diligência prévia robusta, monitoramento contínuo, avaliação das práticas de governança de dados do fornecedor e documentação do desempenho dos modelos. As instituições também devem monitorar o risco de concentração — o potencial impacto sistêmico caso um pequeno número de fornecedores de IA sofra interrupções.

A Lei de IA da União Europeia representa o arcabouço regulatório mais abrangente para IA, classificando sistemas de IA financeiros como 'alto risco' e exigindo documentação extensa, testes de vieses e supervisão humana. OCDE e G7 também emitiram princípios para governança responsável de IA. Muitos desses padrões internacionais têm alcance extraterritorial, significando que instituições financeiras que atendem clientes em jurisdições reguladas podem precisar cumprir tais normas. O alinhamento proativo com padrões internacionais pode ajudar as instituições a se prepararem para futuras regulações e a reduzir riscos de autuação.

Acompanhe como sua instituição financeira é referenciada em respostas de IA em GPTs, Perplexity e Google AI Overviews. Garanta que sua marca mantenha visibilidade e precisão em conteúdos financeiros gerados por IA.

Aprenda as melhores práticas essenciais de transparência e divulgação em IA. Descubra métodos comportamentais, verbais e técnicos de divulgação para construir c...

Explore o futuro do monitoramento da visibilidade em IA, desde padrões de transparência até conformidade regulatória. Descubra como as marcas podem se preparar ...

Saiba quais métricas e dados devem ser incluídos em um relatório de visibilidade em IA para acompanhar a presença da marca em ChatGPT, Perplexity, Google AI Ove...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.