Subiecte YMYL în căutarea AI: Ghid complet pentru monitorizarea brandului

Află ce sunt subiectele YMYL în căutarea AI, cum îți influențează vizibilitatea brandului în ChatGPT, Perplexity și AI Overviews de la Google și de ce este impo...

Află cum pot organizațiile medicale să optimizeze conținutul medical pentru vizibilitatea LLM, să navigheze cerințele YMYL și să monitorizeze citările AI cu platforma de monitorizare AI de la AmICited.com.

Your Money or Your Life (YMYL) cuprinde subiecte care au impact direct asupra bunăstării utilizatorilor, inclusiv sănătate, finanțe, siguranță și informații civice—iar domeniul sănătății se află în vârful ierarhiei de control a Google. După actualizarea principală Google din martie 2024, gigantul căutărilor a redus vizibilitatea conținutului de slabă calitate cu 40%, semnalând o acțiune fără precedent împotriva informațiilor medicale nesigure. Totuși, provocarea pentru organizațiile medicale s-a schimbat fundamental: conținutul trebuie să fie vizibil nu doar pentru motoarele de căutare, ci și pentru modelele lingvistice mari (LLM) care devin tot mai des primul punct de acces pentru cei ce caută informații medicale. Având în vedere că 5% din toate căutările Google sunt legate de sănătate și 58% dintre pacienți folosesc acum instrumente AI pentru informații medicale, furnizorii de servicii medicale se confruntă cu un gol critic de vizibilitate—conținutul lor poate avea un rang bun în căutarea tradițională, dar să rămână invizibil pentru sistemele AI consultate efectiv de pacienți. Această cerință de vizibilitate duală reprezintă o frontieră complet nouă în strategia de conținut medical.

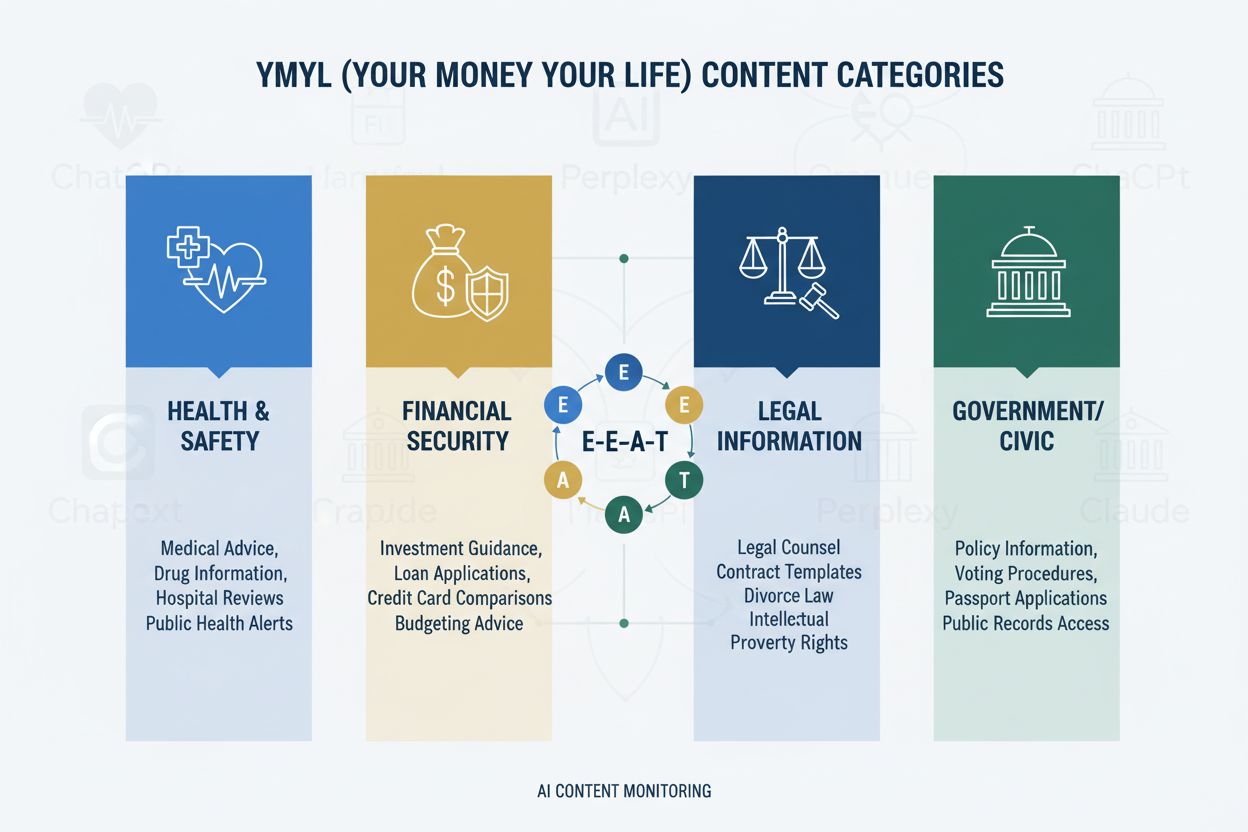

Cadrul YMYL clasifică conținutul în patru domenii critice: Sănătate (afecțiuni medicale, tratamente, wellness), Finanțe (sfaturi investiționale, planificare financiară), Siguranță (proceduri de urgență, securitate) și Civic (vot, aspecte legale)—cu domeniul sănătății la cel mai înalt nivel de exigență datorită impactului direct asupra bunăstării umane. Cadrul E-E-A-T al Google (Experiență, Expertiză, Autoritate, Demnitate de Încredere) servește drept standard de evaluare, solicitând ca informațiile medicale să demonstreze cunoștințe reale, acreditări profesionale și acuratețe verificabilă. Ghidul Quality Rater subliniază clar că materialul medical trebuie creat sau revizuit de profesioniști medicali calificați, cu acreditări și suport instituțional vizibile. Organizațiile medicale trebuie să înțeleagă că E-E-A-T nu este opțional—este cerința de bază atât pentru vizibilitatea în căutare, cât și pentru includerea în LLM-uri. Mai jos este ierarhia de impact a categoriilor YMYL:

| Categoria YMYL | Nivel de impact | Intensitatea controlului | Relevanță pentru sănătate |

|---|---|---|---|

| Sănătate | Critic | Cel mai ridicat | Siguranța directă a pacientului |

| Finanțe | Ridicat | Ridicat | Asigurări, costuri |

| Siguranță | Ridicat | Ridicat | Protocoale de urgență |

| Civic | Mediu | Mediu | Politici de sănătate |

În ciuda complexității lor, LLM-urile prezintă rate alarmante de eroare la procesarea informațiilor medicale, iar cercetările Stanford HAI documentează 30-50% afirmații nefundamentate în răspunsurile din domeniul sănătății. GPT-4 cu Retrieval-Augmented Generation (RAG) produce în continuare răspunsuri în care 50% conțin afirmații nefondate, chiar și când sunt antrenate pe surse de autoritate—un fenomen cunoscut ca halucinație, ce poate apărea sub forma recomandării de echipamente medicale inexistente, a unor protocoale de tratament incorecte sau a unor interacțiuni medicamentoase inventate. Un caz notoriu implică Men’s Journal, care a publicat un articol generat AI cu 18 erori medicale specifice, inclusiv recomandări periculoase de tratament ce puteau dăuna cititorilor. Problema fundamentală este că AI nu are “Experiență”—cunoștințele clinice directe ce diferențiază medicii experți de sistemele bazate pe identificarea de tipare statistice. Acest decalaj înseamnă că, fără conținut structurat corespunzător și de autoritate, creat de profesioniști medicali verificați, LLM-urile vor genera cu încredere recomandări medicale plauzibile, dar potențial periculoase.

AI Overviews și alte sisteme de răspuns alimentate de LLM schimbă fundamental modul în care pacienții descoperă informații medicale, oferind răspunsuri directe fără a necesita vizite pe site, eliminând astfel click-urile tradiționale ce au susținut traficul web medical timp de decenii. Vizibilitatea conținutului depinde acum de citarea în răspunsurile AI, nu de poziția în clasament, ceea ce înseamnă că un articol medical poate fi sintetizat într-un răspuns AI fără să primească trafic sau atribuție. LLM-urile sintetizează informații din mai multe surse simultan, creând o nouă arhitectură informațională unde site-urile individuale concurează pentru includere în rezumatele generate de AI și nu pentru poziții de top în căutare. Furnizorii medicali trebuie să recunoască faptul că Share of Model (SOM)—procentul de răspunsuri AI ce citează conținutul lor—a devenit noua metrică critică de vizibilitate, înlocuind rata de click tradițională. Această schimbare de paradigmă necesită o regândire fundamentală a strategiei de conținut: în loc să optimizezi pentru click-uri, organizațiile medicale trebuie să optimizeze pentru calitatea citării, acuratețe și claritate structurală care să facă din conținutul lor sursa preferată pentru sinteza LLM.

LLM-urile procesează cel mai eficient conținutul medical când acesta este organizat pe o structură ierarhică clară ce reflectă modul decizional clinic: definirea afecțiunii → prezentarea simptomelor → criterii de diagnostic → opțiuni de tratament → prognostic. Arhitectura progresivă a dezvăluirii—prezentând conceptele simple înainte de cele complexe—permite LLM-urilor să construiască modele mentale corecte, fără a confunda afecțiuni similare. Designul conținutului pe bază de întrebări (răspunzând la “Ce este afecțiunea X?” înainte de “Cum se tratează?”) se aliniază felului în care LLM-urile extrag și sintetizează informații din mai multe documente. Bogăția semantică și conexiunile explicite—legând în mod clar afecțiuni, tratamente și factori de risc—ajută LLM-urile să înțeleagă relații care altfel ar rămâne implicite. Implementarea marcajului medical Schema.org (MedicalCondition, MedicalProcedure, MedicalTreatment) oferă date structurate pe care LLM-urile le pot parcurge și cita în mod fiabil. Limbajul natural care imită explicația experților—folosind terminologia specifică medicilor, dar accesibilă—semnalează autenticitate atât LLM-urilor, cât și cititorilor umani. Organizațiile medicale ar trebui să auditeze conținutul existent în raport cu aceste cerințe structurale, deoarece conținutul optimizat doar pentru SEO tradițional adesea nu oferă claritatea ierarhică și bogăția semantică de care LLM-urile au nevoie pentru o sinteză corectă.

Prezența multiplatformă amplifică semnalele de autoritate într-un mod inaccesibil abordărilor bazate pe un singur site, deoarece LLM-urile recunosc expertiza demonstrată constant pe mai multe canale de autoritate. Platformele medicale de întrebări & răspunsuri precum HealthTap și Figure 1 creează interacțiuni directe medic-pacient recunoscute ca expertiză autentică, cu acreditări verificate și implicare în timp real. Rețelele profesionale precum Doximity și comunitățile medicale de pe LinkedIn stabilesc recunoaștere între colegi și statut profesional, aspecte apreciate de LLM-uri în evaluarea autorității. Contribuțiile la Wikipedia medicală și baze de cunoștințe colaborative similare semnalează dorința de a contribui la cunoașterea medicală publică fără motivație comercială—un semnal de încredere recunoscut de LLM-uri. Pagini cuprinzătoare de credibilitate pentru autori—cu certificări, publicații, experiență clinică și afilieri instituționale—trebuie să fie prezente pe site-ul principal și să fie conectate consistent pe toate platformele. Consistența acreditărilor și specialităților pe toate platformele întărește autenticitatea; contradicțiile generează scepticism din partea LLM-urilor. Organizațiile medicale ar trebui să dezvolte o strategie multiplatformă de autoritate în care fiecare platformă acționează ca un semnal de întărire, nu ca un canal separat, asigurându-se că expertiza medicilor este vizibilă și verificabilă în tot ecosistemul digital.

Analizele medicale tradiționale—trafic organic, rata de click și poziția în căutări—ratează complet povestea vizibilității AI, creând un punct orb periculos unde conținutul pare de succes după metricele vechi, dar rămâne invizibil pentru LLM-uri. Share of Model (SOM) devine noua metrică esențială, măsurând ce procent din răspunsurile AI despre o anumită afecțiune citează conținutul organizației tale. Monitorizarea eficientă necesită testare sistematică pe mai multe platforme LLM (ChatGPT, Claude, Perplexity și competitori emergenți) folosind întrebări constante din ariile tale de specialitate, documentând frecvența și poziționarea citărilor. Calitatea citării contează la fel de mult ca frecvența—a fi citat ca sursă principală are o greutate mai mare decât să apari într-o listă de referințe secundare, iar LLM-urile recunosc când conținutul este citat pentru expertiză specifică, nu doar ca informație generică. Instrumentele de monitorizare variază de la testare manuală (interogări și documentarea rezultatelor) la platforme automatizate ce urmăresc evoluția SOM și notifică la schimbări de vizibilitate. Indicatori indirecți precum volumul de căutări pe brand, feedback-ul pacienților ce menționează recomandări AI și modelele de trimitere dinspre platforme AI oferă date suplimentare ce validează tendințele SOM. Organizațiile medicale ar trebui să stabilească imediat valori de bază SOM, deoarece peisajul concurențial se schimbă rapid, iar avantajele timpurii de vizibilitate se cumulează în timp.

Organizațiile medicale ar trebui să înceapă cu o singură arie de specialitate în loc să transforme întreaga organizație simultan, permițând echipelor să dezvolte expertiză și să rafineze procesele înainte de extindere. Auditul conținutului din perspectiva LLM presupune evaluarea articolelor existente pentru claritate ierarhică, bogăție semantică, arhitectură bazată pe întrebări și credibilitatea autorului—dezvăluind adesea că materialele bine clasate nu au structura necesară LLM-urilor. Testarea vizibilității pe platforme AI cu întrebări specifice specialității stabilește valoarea de bază a SOM și identifică afecțiunile și tratamentele vizibile versus cele invizibile. Implementarea arhitecturii bazate pe întrebări implică restructurarea sau crearea de conținut care pornește de la întrebările pacienților (“De ce am acest simptom?”) înainte de explicațiile clinice. Pagini de credibilitate pentru fiecare medic contributor trebuie create, cu certificări, specialități, publicații și experiență clinică, legate consistent din tot conținutul semnat. Clusteringul de conținut pe afecțiuni—crearea de conținut interconectat care acoperă simptome, diagnostic, tratamente și prognostic—ajută LLM-urile să înțeleagă informații complete despre o afecțiune și nu doar articole izolate. Această abordare etapizată permite măsurarea impactului, rafinarea strategiei și dezvoltarea expertizei interne înainte de extinderea către alte specialități.

Respectarea HIPAA rămâne esențială chiar și când conținutul devine vizibil pentru LLM-uri; protecția datelor pacienților se aplică indiferent dacă informația e accesată prin motoare de căutare sau sisteme AI, necesitând anonimizarea și de-identificarea atentă a oricărui exemplu de caz. Declarațiile medicale și cerințele de acuratețe trebuie să fie explicite și proeminente, cu mențiuni clare că informațiile generate de AI nu înlocuiesc consultația medicală profesională și că situațiile individuale pot diferi de recomandările generale. Verificarea faptelor și citarea sursei devin elemente critice de conformitate, deoarece organizațiile medicale răspund pentru acuratețea informațiilor publicate, iar LLM-urile pot amplifica erorile către mii de utilizatori. Controlul reglementar asupra conținutului medical generat de AI se intensifică, FDA și FTC analizând tot mai mult modul în care sistemele AI prezintă informații medicale; organizațiile medicale trebuie să se asigure că tot conținutul—fie scris de om, fie asistat de AI—respectă standardele legale. Revizuirea umană de către medici calificați trebuie să rămână obligatorie pentru tot conținutul medical, cu procese de revizuire documentate ce demonstrează angajamentul pentru acuratețe și siguranță. Riscurile de răspundere depășesc malpraxisul medical tradițional și includ potențiala răspundere pentru informațiile pe care LLM-urile le sintetizează și prezintă pacienților; organizațiile medicale ar trebui să consulte avocați referitor la responsabilitatea pentru modul în care conținutul lor este folosit de AI. Conformitatea și siguranța nu pot fi tratate ca preocupări secundare în goana după vizibilitate AI.

AI va continua să remodeleze descoperirea informațiilor medicale într-un ritm accelerat, LLM-urile devenind tot mai sofisticate în raționamentul medical și tot mai centrale în modul în care pacienții caută informații. Organizațiile medicale care își adaptează strategia de conținut acum se poziționează ca surse de încredere în acest ecosistem emergent, iar cei care întârzie riscă să devină invizibili pentru sistemele AI utilizate efectiv de pacienți. Adoptanții timpurii obțin avantaje competitive prin semnale de autoritate consolidate, metrici Share of Model mai mari și încredere din partea pacienților construită prin vizibilitate constantă în răspunsurile AI—avantaje care se amplifică pe măsură ce LLM-urile învață să recunoască și să prioritizeze sursele fiabile. Integrarea SEO tradițional cu optimizarea pentru LLM-uri nu este o alegere de tipul ori-ori, ci o strategie complementară, pe măsură ce motoarele de căutare integrează tehnologie LLM și pacienții folosesc mai multe surse de informare. Sustenabilitatea pe termen lung depinde de expertiză autentică și nu de trucuri de optimizare; organizațiile medicale care investesc în cunoștințe reale, acreditări transparente și informații exacte vor prospera indiferent de evoluția mecanismelor de descoperire. Peisajul conținutului medical s-a schimbat fundamental, iar organizațiile care văd această tranziție ca pe o oportunitate, nu ca pe o amenințare, vor defini viitorul descoperirii informațiilor de sănătate pentru pacienți.

YMYL (Your Money Your Life) se referă la conținutul care poate avea un impact semnificativ asupra sănătății, stabilității financiare sau siguranței oamenilor. Sănătatea este categoria cu cel mai ridicat nivel de exigență deoarece dezinformarea medicală poate cauza vătămări grave sau chiar deces. Google aplică standarde algoritmice mai stricte conținutului YMYL, iar LLM-urile sunt din ce în ce mai folosite de pacienți pentru a căuta informații medicale, ceea ce face ca respectarea cerințelor YMYL să fie esențială pentru vizibilitate.

LLM-urile sintetizează informații din mai multe surse pentru a oferi răspunsuri directe, în timp ce motoarele de căutare clasează pagini individuale. Conținutul medical trebuie acum structurat pentru a fi citat de sisteme AI, nu doar pentru poziții bune în Google. Aceasta înseamnă că este posibil ca materialul tău să educe mii de persoane prin răspunsuri AI fără să primească trafic direct pe site, necesitând o abordare fundamental diferită de optimizare.

E-E-A-T înseamnă Experiență, Expertiză, Autoritate și Demnitate de Încredere. Conținutul medical necesită cele mai ridicate standarde E-E-A-T, cu accent pe experiența medicală directă și acreditările verificate. Ghidul Google Quality Rater menționează E-E-A-T de 137 de ori, reflectând importanța sa critică pentru vizibilitatea conținutului medical atât în căutare, cât și în sistemele LLM.

Studiile arată că AI produce afirmații medicale nefundamentate în proporție de 30-50% și inventează informații medicale. AI nu are experiență medicală reală și nu poate verifica informațiile conform standardelor medicale actuale. Acesta este motivul pentru care revizuirea umană și autorii experți rămân esențiali—AI ar trebui să asiste profesioniștii din sănătate, nu să-i înlocuiască.

Testează conținutul în ChatGPT, Claude și Perplexity folosind întrebări frecvente ale pacienților din specialitatea ta. Urmărește metricile Share of Model (SOM)—procentul de răspunsuri AI care citează conținutul tău. AmICited.com automatizează această monitorizare, oferind perspective în timp real despre cum apare brandul tău medical pe mai multe platforme LLM.

SEO tradițional se concentrează pe clasarea paginilor individuale pentru cuvinte cheie. Optimizarea pentru LLM pune accent pe acoperirea cuprinzătoare, bogăția semantică și conținut structurat pe care sistemele AI îl pot înțelege și cita. Ambele abordări sunt complementare—organizațiile medicale au nevoie de strategii integrate care să optimizeze atât pentru motoarele de căutare, cât și pentru LLM-uri.

AI ar trebui folosit doar ca instrument de asistență pentru experții medicali umani, nu ca înlocuitor al acestora. Tot conținutul medical trebuie revizuit și aprobat de profesioniști medicali calificați înainte de publicare. Riscurile sunt prea mari pentru ca informațiile medicale să se bazeze exclusiv pe generarea AI fără supraveghere și verificare de către experți.

AmICited.com monitorizează modul în care brandurile și conținutul medical apar în răspunsurile AI pe ChatGPT, Perplexity, Google AI Overviews și alte platforme LLM. Oferă metrici de vizibilitate, urmărește Share of Model (SOM) și oferă recomandări de optimizare pentru a ajuta organizațiile medicale să se asigure că expertiza lor este descoperită prin cercetarea pacienților asistată de AI.

Urmărește cum apare conținutul tău medical în ChatGPT, Perplexity, Google AI Overviews și alte platforme LLM. Obține perspective în timp real despre Share of Model (SOM) și optimizează pentru descoperirea pacienților prin AI.

Află ce sunt subiectele YMYL în căutarea AI, cum îți influențează vizibilitatea brandului în ChatGPT, Perplexity și AI Overviews de la Google și de ce este impo...

Conținutul YMYL necesită standarde E-E-A-T ridicate. Află ce se califică drept conținut Your Money Your Life, de ce contează pentru SEO și vizibilitatea AI și c...

Discuție în comunitate despre modul în care sistemele AI gestionează subiectele YMYL (Your Money or Your Life). Perspective reale despre vizibilitatea conținutu...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.